Die Masken der Technokraten sind gefallen!

Jahrzehntelang tappten die Massen im Dunkeln, wer die Marionettenspieler [Schwarzgeld] sind, welche die Fäden ihrer Gefolgsleute ziehen – die „auserwählt“ wurden, um die mächtigen Institutionen der Welt zu leiten. Die Menschen dachten nach viel Belehrung durch „offizielle“ Kanäle, dass die öffentlichen Amtsträger selbst das Sagen hätten.

Futuristische Autoren von George Orwell bis Ayn Rand (und viele Science-Fiction-Autoren) haben vor den Gefahren einer zentralisierten Macht gewarnt, die dazu neigt, in den falschen Händen zu landen. Aber nur wenige schenkten den Warnungen Beachtung, und wie Audrey in „Little Shop of Horrors“ fütterten sie das menschenfressende Monster so lange, bis es groß genug war, um ihr Leben zu beherrschen.

Auch Dichter, wie W.B. Yeats in seinem Gedicht „The Second Coming“, haben davor gewarnt, dass eine ungepflegte Zivilisation außer Kontrolle geraten kann:

Die Dinge fallen auseinander, das Zentrum hat keinen Halt, die Welt ist in Anarchie versunken.

Das haben auch Liedermacher wie Barry McGuire:

Du glaubst nicht an den Krieg, aber was ist das für eine Waffe, die du da schwenkst? Und sogar im Jordan treiben Leichen.

Erst letzten Monat schrieb der bekannte Historiker Victor Davis Hanson: „Zum ersten Mal seit einem Jahrtausend spielt Europa keine entscheidende Rolle mehr bei der Förderung der westlichen Zivilisation oder in der Weltgeschichte im Allgemeinen.“

Hanson sagt, dass sich die europäischen Nationen, nachdem sie ihre Sicherheit am Ende des Zweiten Weltkriegs an die Vereinigten Staaten abgegeben hatten, für einen postmodernen, pazifistischen, utopischen Sozialismus entschieden, der sich auf Umverteilungsansprüche, offene Grenzen und eine radikale grüne Politik konzentrierte, die zusammen den schwindenden Einfluss Europas auf das Weltgeschehen beschleunigten. Europa war also nicht auf den Krieg zwischen Russland und der Ukraine vorbereitet.

Laut der französischen Journalistin Anne-Elisabeth Moutet schrieben 20 französische Generäle im Ruhestand mit Unterstützung von über 100 Offizieren im Jahr 2021 einen offenen Brief, in dem sie Präsident Emmanuel Macron warnten, dass die Spaltungen zwischen den Gemeinschaften in Frankreich und die zunehmende „Gewalt und der Nihilismus“ das Land auf einen sozialen Zusammenbruch zusteuerten, mit dem Risiko eines „Chaos’“, das zu einem „Bürgerkrieg“ führe, der dann eine militärische „Intervention erfordern“ würde.

Manche fragen sich, ob den USA ein ähnliches Schicksal bevorstehen könnte.

Vor weniger als einem Monat warnte der französische Kabinettssprecher Olivier Vȇran, dass Frankreich aufgrund der gleichen von Hanson festgestellten politischen Fehler an einem „Kipppunkt“ stehen könnte. Das Ergebnis ist, so Moutet, dass das Vertrauen zwischen den „herrschenden“ Klassen und der französischen Öffentlichkeit im Gleichschritt mit dem wirtschaftlichen und sozialen Niedergang Frankreichs abgenommen hat.

Das Problem der meisten öffentlichen Proteste, so Seamus Bruner in seinem bahnbrechenden Buch „Controligarchs“, besteht darin, dass die wahren Ziele – die Puppenspieler – seit langem verborgen sind und von einer Öffentlichkeit, die von rechts und links gefüttert wird, um sich auf Prominente zu konzentrieren (praktisch die Handelsvertreter und öffentlichen Gesichter der „Controligarchs“), nicht einmal erkannt werden.

Im Kapitel „The Great Reset“ zeigt Bruner, wie die Rockefellers und der Gründer des Weltwirtschaftsforums Klaus Schwab, Erfinder des „Stakeholder-Kapitalismus“ und Verfechter der „ökologischen und sozialen Governance“, China dazu brachten, sich vom agrarischen Maoismus zu dem amoralischen Technokratenstaat zu wandeln, der es heute ist. Und es ist dieses chinesische Governance-Modell, dem viele westliche Progressive und Unternehmensführer nacheifern wollen.

Schwab tat sich auch mit den Rockefellers zusammen, um die Philosophie der „Grenzen des Wachstums“ zu propagieren, deren krude Computermodelle ohne drastische Maßnahmen katastrophale Folgen für den Planeten vorhersagten. Als ihre Angstmacherei über die Erschöpfung der Ressourcen durch neue Entdeckungen entlarvt wurde, wechselten sie das Mantra zu der leichter zu manipulierenden „globalen Erwärmung“.

Bruner verweist auf ein Eingeständnis im Bericht des Club of Rome von 1991: „Wir sind auf die Idee gekommen, dass Umweltverschmutzung, die Bedrohung durch die globale Erwärmung, Wasserknappheit, Hungersnöte und ähnliches die Lösung sein könnten … Der wahre Feind ist also die Menschheit selbst.“

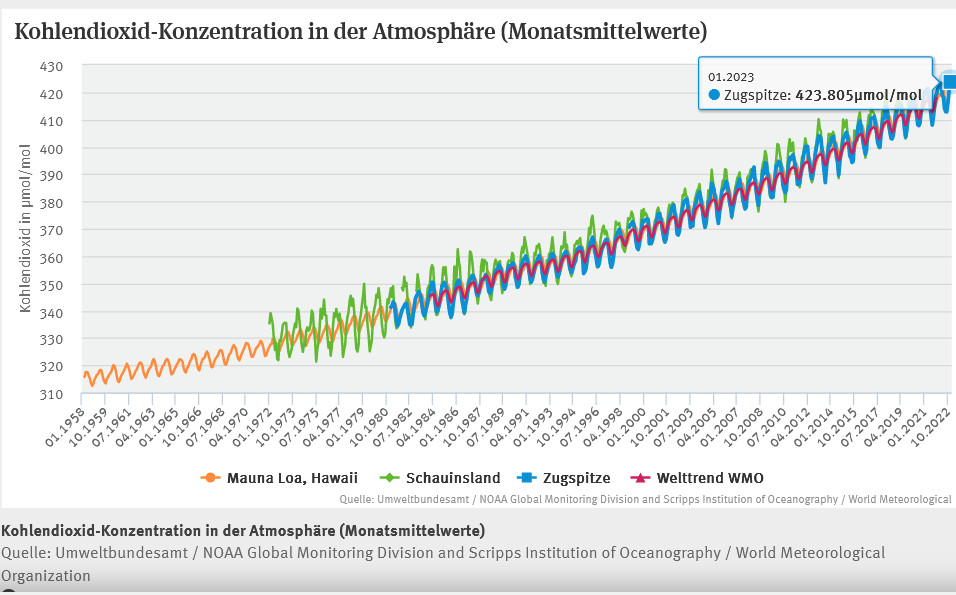

Al Gore argumentierte 1992 in seinem Buch Earth in the Balance, dass „die Rettung der Umwelt zum zentralen Organisationsprinzip der Zivilisation werden muss“. Zwar enthielt die Liste der „entscheidenden Schadstoffe“ des Clean Air Act von 1970 kein Kohlendioxid, doch waren die ersten sechs bereits deutlich unter Kontrolle gebracht worden. Daher waren die Regulierungsbehörden bestrebt, Kohlendioxid – das von jedem lebenden Tier emittiert wird und für fast alle Pflanzen lebenswichtig ist – als ein Übel hinzuzufügen, das sie eindämmen müssen.

Sich auf Kohlendioxid zu konzentrieren war ein genialer Coup, der einen Vorwand für die Kontrolle von Verkehr, Produktion, Landwirtschaft usw. lieferte. Er „rechtfertigte“ die absolute Notwendigkeit einer zentralisierten globalen Regierung. Die Erde kann nicht sicher sein, solange die Retter nicht alles – und jeden – kontrollieren. Und wüssten Sie es nicht? Die Kontrolltechnologie und die Daten waren bereits im Entstehen.

Dreißig Jahre später hatte sich die „globale Erwärmung“ in „Klimawandel“ verwandelt, und Gore hatte die „Rettung der Umwelt“ durch „Dekarbonisierung“ ersetzt und damit signalisiert, dass „die Umwelt“ nicht mehr zählt. In der heutigen Klima-verrückten Matrix sind Glattwale und Buckelwale ein Ärgernis, dessen Untergang in Kauf genommen werden kann, um die Kontrollinfrastruktur einer rein elektrischen Gesellschaft aufzubauen.

Aber das sind die Menschen auch. Menschen, die es wagen, sich riesigen Solaranlagen und Windparks zu widersetzen; Menschen, die sich dagegen sträuben, zuverlässige Verkehrsmittel und Haushaltsgeräte gegen teurere, weniger effiziente Modelle einzutauschen, die ihnen von der Regierung aufgezwungen werden; Menschen, die die verworrene Logik nicht akzeptieren können, nach der intermittierende Flüsse als „schiffbare Gewässer“ bezeichnet werden. Vor allem aber Menschen, deren Stimmen Widerstand gegen ihre grandiosen Ziele hervorrufen könnten.

Und genau hier kommt der „Sozialkredit“ ins Spiel. Der Plan sieht vor, dass Finanzinstitute, Medien und sogar Zulassungsstellen wirksame Gegner entweder mit einem Schweige-Gebot belegen oder ganz ausschalten können. Besser noch: Sie können Unternehmen und Dissidenten zu „Geständnissen“ zwingen, sie überreden oder ihnen sogar schmeicheln, wie man es von gefangenen Soldaten kennt.

Der Schwab-Schüler und -Schützling Yuval Noah Harari schwärmt von Mikrochips im Gehirn, „Glückspillen“ für die Selbstzufriedenheit und Virtual-Reality-Erfahrungen als Möglichkeiten, die Bevölkerung kurzfristig zu besänftigen – und von einer Welt, in der die Eliten durch biotechnische Upgrades Unsterblichkeit kaufen können.

Da künstliche Intelligenz bei der Schaffung einer „übermenschlichen“ Klasse hilft, wird der Großteil der Menschheit, der keinen solchen Zugang hat, „nutzlos“, sagt Harari. Die schwierige Entscheidung ist dann, „was man mit all diesen nutzlosen Menschen macht“.

Im Jahr 2012 beklagte Mitt Romney die „47 % nutzloser“ Menschen, die von der Regierung versorgt werden und damit (seiner Meinung nach) in der Hand von staatlichen Wohltätern sind. Im Jahr 2016 prangerte Hillary Clinton die „unverbesserlichen Bedauernswerten“ an – jeden, der sich ihrer Agenda widersetzte. Für beide (unterlegenen) Kandidaten waren solche Menschen entbehrlich.

Mindestens drei Jahrzehnte lang hat Al Gore im Namen der „herrschenden Klassen“ verkündet, dass Menschen weit weniger wichtig sind als „die Umwelt“. Doch nicht viele haben die Bedeutung seiner Verkündigung begriffen. Heute jedoch haben die meisten Menschen in Afrika und viele sogar in den Industrieländern die Pläne der Elite für ihre Zukunft verstanden. Und sie werden zunehmend lauter.

Vielleicht war es die COVID-Pandemie und die Einschüchterungstaktik, mit der Regierungen und Aufsichtsbehörden die meisten Menschen der ersten Welt dazu zwangen, sich ungetestete Impfstoffe injizieren zu lassen. Aber viele der schlafenden Massen wachten auf und erkannten, wie Präsident Reagan schon vor langer Zeit sagte, dass die Regierung NICHT „hier ist, um zu helfen“.

Damit die Massen verhindern können, dass die Kontrolleure sie auf den Müllhaufen der Geschichte befördern, brauchen sie so edle und engagierte Kämpfer wie den legendären William Wallace, Rosa Parks und Jeanne d’Arc. Zu den ersten Früchten der „Anti-Kontrolligarchen“-Revolte gehören die Wahlen von Meloni in Italien, Milei in Argentinien und Luxon in Neuseeland.

Aber mehr noch als die Anführer müssen diejenigen, die ihre Menschlichkeit und ihre Freiheiten schätzen, die Betrüger beim Namen nennen und ihnen entgegentreten, die den Deckmantel des „Klimawandels“ benutzt haben, um uns sogar unsere „unveräußerlichen Rechte“ zu nehmen.

Die Zeit ist knapp, aber die Masken sind gefallen. Wir wissen, wer sie sind.

Und sie sind Legion. Oder vielleicht Rumpelstilzchen.

This piece originally appeared at RealClearEnergy.com and has been republished here with permission.

Link: https://cornwallalliance.org/2024/02/the-technocracys-masks-are-all-off-now/

Übersetzt von Christian Freuer für das EIKE