Können Wind- und Solarenergie um das 50- bis 100-fache erweitert werden?

Edward Ring

Auf der jüngsten „Konferenz der Vertragsparteien“, auch bekannt als die Sonderveranstaltung der Vereinten Nationen, die alle paar Jahre stattfindet und auf der die Staats- und Regierungschefs der Welt die Klimakrise diskutieren, wurden mehrere Ziele öffentlich verkündet. Besonders hervorzuheben sind die Ziele, die Erzeugung von erneuerbarer Energie bis 2030 zu verdreifachen und die Erzeugung von Kernenergie bis 2050 ebenfalls verdreifachen. Wo stehen die Ziele der COP 28 für die weltweite Energiewirtschaft vor dem Hintergrund der derzeitigen globalen Energieproduktion nach Energieträgern und, wie in Teil 1 quantifiziert, dem Ziel, die Gesamtenergieproduktion von 600 Exajoule im Jahr 2022 auf mindestens 1.000 Exajoule im Jahr 2050 zu steigern? Wie stark muss die Produktion von erneuerbaren Energien steigen?

Bei der Beantwortung dieser Frage muss berücksichtigt werden, dass die meisten erneuerbaren Energien in Form von Strom aus Wind, Sonne oder Erdwärme erzeugt werden. Und wenn es darum geht zu messen, wie viel die bisher installierte Basis an erneuerbaren Energien zum Ziel von 1.000 Exajoule Energieproduktion pro Jahr beitragen wird, um – im besten Fall – 800 Exajoule an Energiedienstleistungen zu realisieren, sind die im Statistical Review of Global Energy angegebenen Daten zutiefst irreführend.

Ohne zu verstehen, wie die aktuellen Daten zu erneuerbaren Energien, wie sie in den zusammenfassenden Diagrammen angegeben werden, einen Analysten dazu verleiten können, ihren derzeitigen Beitrag zur globalen Energieversorgung zu hoch anzusetzen, ist es unmöglich, das wahre Ausmaß des Ausbaus der erneuerbaren Energien genau zu beurteilen, der erforderlich ist, um das Ziel von 1.000 Exajoule globaler Energieerzeugung pro Jahr zu erreichen. Wie die zusammenfassenden Diagramme in die Irre führen, ist im Anhang nachzulesen.

Die Autoren zeigen im Anhang (siehe Seite 56, „Methodik“): „In der Statistischen Übersicht über die Weltenergie wurde die Primärenergie nicht-fossiler Elektrizität (Kernenergie, Wasserkraft, Windkraft, Solarenergie, Erdwärme, Biomasse in der Stromerzeugung und andere erneuerbare Energiequellen) auf einer ‚input-äquivalenten‘ Basis berechnet – d.h. auf der Grundlage der äquivalenten Menge an fossilen Brennstoffen, die erforderlich ist, um diese Menge an Elektrizität in einem Standard-Wärmekraftwerk zu erzeugen.“

Es kann gar nicht hoch genug eingeschätzt werden, wie wichtig es ist, diese scheinbar harmlose Fußnote nicht zu übersehen.

Im Klartext heißt das, dass sie, wenn sie (siehe Seite 9 „Primärenergie: Verbrauch nach Brennstoffen“) den Anteil aller nicht-thermischen Energiequellen – Wasser, Kernkraft, Wind und Sonne – an der weltweiten Energieerzeugung angeben, die niedrigere, tatsächliche Produktionszahl hochrechnen und in der Tabelle einen fiktiven, viel größeren Betrag ausweisen, der so berechnet wird, als ob diese vier Energiequellen mit dem Wirkungsgrad thermischer Kraftwerke arbeiten würden, d. h. mit einem Wirkungsgrad von 40 Prozent.

Warum? Wir können davon ausgehen, dass die diese Diagramme erstellenden Energieanalysten den Beitrag der nicht-thermischen Energie hochrechnen (Lawrence Livermore tut dies übrigens auch in seinem Energieflussdiagramm), um zu zeigen, wie viel der fossilen Brennstoffproduktion durch die Nutzung nicht-thermischer Quellen ausgeglichen wird. Das scheint unverfänglich zu sein. Aber es ist irreführend.

Wenn wir uns ein Ziel von 1.000 Exajoule für die Weltenergieproduktion setzen und davon ausgehen, dass 80 Prozent dieser 1.000 Exajoule als Energiedienstleistungen für den Endverbraucher realisiert werden sollen, dann müssen wir untersuchen, wie viel nutzbare Energie aus Wind, Sonne, Wasser und Kernkraft heute tatsächlich erzeugt wird. Das heißt, wir müssen wissen, wie viel Strom sie tatsächlich erzeugen und in das Netz einspeisen. Eine unterstellte, hochgerechnete Zahl ist nicht hilfreich.

Auf dem Weg zu 1.000 Exajoule pro Jahr ohne Kohle, Öl und Gas

Erfreulicherweise ist die tatsächliche Strommenge, die derzeit durch Wasser-, Kernkraft-, Wind- und Sonnenenergie erzeugt wird, in den inneren Kapiteln des Statistischen Berichts zu finden. Es ist jedoch wichtig zu erkennen, dass bei einer Verlagerung der Energieerzeugung von thermischen Quellen auf Elektrizität immer noch mindestens 1000 Exajoule an Stromerzeugung erforderlich sind, um 800 Exajoule an Energiedienstleistungen zu erzeugen.

Es muss noch einmal betont werden, dass es eine außergewöhnliche Annahme ist, eine 80-prozentige Rückhaltung von Energie von der Einspeisung ins Netz bis zum tatsächlichen Endverbrauch zu prognostizieren. Wir könnten zum Beispiel davon ausgehen, dass von der Erzeugungsanlage 5 Prozent bei der Übertragung verloren gehen, weitere 5 Prozent beim Laden und anschließenden Entladen des Stroms in und aus Energiespeicherbatterien, weitere 5 Prozent beim Lade-/Entladezyklus durch eine Bordbatterie in einem Elektrofahrzeug und weitere 5 Prozent bei der Umwandlung des Stroms in Traktion durch den Elektromotor. Das sind außerordentlich optimistische Zahlen, wenn man ein Best-Case-Beispiel zugrunde legt. Ist eine Wärmepumpe so effizient, oder eine Klimaanlage, ein Kochfeld oder eine beliebige Anzahl von Geräten, Landmaschinen, Industrieanlagen und andere wichtige Infrastrukturen? Definitiv noch nicht, und sehr wahrscheinlich auch nie.

Es geht darum, dass 1000 Exajoule das absolute Minimum darstellen, auf das die weltweite Energieproduktion in den nächsten 25 Jahren steigen muss, wenn jeder Mensch auf der Erde Zugang zu genügend Energie haben soll, um Wohlstand und Sicherheit zu ermöglichen. Wie kommen wir dorthin? Nehmen wir die Experten beim Wort und gehen wir davon aus, dass die Nutzung von Kohle, Öl und Gas bis 2050 vollständig eingestellt wird.

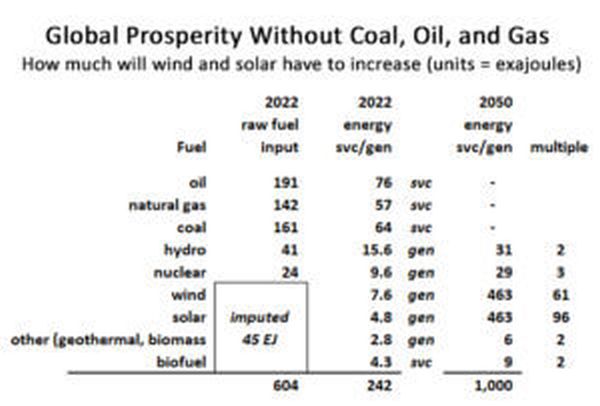

In der nachstehenden Grafik entsprechen die Annahmen für den künftigen weltweiten Brennstoffmix den Beschlüssen, die auf der jüngsten Konferenz der Vertragsparteien gefasst wurden. Das heißt, die Kernenergie wird verdreifacht, und die Nutzung von Erdöl, Erdgas und Kohle wird eingestellt. Um den erforderlichen Ausbau der Solar- und Windenergie etwas zu entlasten, wird für diese Analyse die hochtrabende Annahme getroffen, dass die Wasserkraftkapazität verdoppelt, die geothermische Produktion verdoppelt und die Biokraftstoffproduktion verdoppelt wird. Das wird nicht viel ausmachen. Es geht los:

An diesen Daten gibt es viel zu verarbeiten, aber die Mühe lohnt sich. Denn die Fakten, die sie präsentieren, sind unumstößlich und haben erhebliche Auswirkungen auf die globale Energiepolitik. Die erste Datenspalte zeigt, wie viel Brennstoff im Jahr 2022 weltweit verbrannt oder erzeugt wurde – die rohen Brennstoffinputs, die sich auf 604 Exajoule belaufen.

Die zweite Datenspalte zeigt die Anzahl der Energie-Dienstleistungen, die die Endverbraucher im Jahr 2022 in Form von Heizung, Kühlung, Antrieb, Licht, Kommunikation usw. erreicht haben. Es ist klar, dass die niedrigeren Zahlen für thermische Energiequellen den derzeit weltweit geschätzten Umwandlungs-Wirkungsgrad von etwa 40 Prozent reflektieren. Bei den nichtthermischen Energieträgern (rechts mit „gen“ für erzeugte Energie) basieren diese Zahlen auf Terawattstunden-Berichten, die in den einzelnen Abschnitten des Statistischen Berichts für diese Energieträger aufgeführt sind. Bei der Umrechnung von Terawattstunden in Exajoule handelt es sich um die tatsächliche Strommenge, die weltweit in die Übertragungsleitungen eingespeist wurde, um von den Endverbrauchern verbraucht zu werden.

In der dritten Spalte wird ein hypothetischer globaler Brennstoffmix für 2050 auf der Grundlage der auf der COP 28 vereinbarten Ziele berechnet. Wie in Spalte 4 „Mehrfaches“ zu sehen ist, wird die Kernenergie in Übereinstimmung mit COP 28 verdreifacht. In Übereinstimmung mit der COP 28 wird auch die Nutzung von Kohle, Öl und Gas abgeschafft. Um das Ziel von 1000 Exajoule zu erreichen, wird die Produktion von Erdwärme und Biokraftstoffen verdoppelt, was auf der COP 28 nicht vereinbart wurde. Der verbleibende Rest des Energiebedarfs wird (in diesem Beispiel) zu gleichen Teilen durch Wind- und Sonnenenergie gedeckt. Nach allem, was sie in Dubai und Davos sagen, kann man davon ausgehen, dass dies das Modell ist. Dies ist die logische Umsetzung dessen, was sie fordern.

Diese Berechnungen ergeben einen überwältigenden Realitätscheck. Doch welche Annahme ist falsch? Das Ziel von 1000 Exajoule ist mit Sicherheit zu niedrig angesetzt. Die Kernenergie wird verdreifacht, die Wasserkraft und die Biokraftstoffe werden jeweils verdoppelt. Nichts davon ist einfach; im Falle des Biokraftstoffs könnte es zu einer Umweltkatastrophe kommen. Aber selbst wenn diese anderen nicht-thermischen Energiequellen um das Zwei- bis Dreifache zunehmen würden, wäre ohne Kohle, Öl und Gas ein verblüffender Ausbau von Wind und Sonne erforderlich. Mit einer „Verdreifachung“ dieser erneuerbaren Energieträger kommen wir nicht einmal in die Nähe des Ziels.

Um die Welt bis 2050 mit 1000 Exajoule Strom zu versorgen, müssten für jede Windturbine, die wir heute haben, mehr als 60 davon aufgestellt werden. Für jedes Feld der Photovoltaik, das wir heute haben, müssen wir mit fast 100 weiteren rechnen. Ist das machbar? Denn von Dubai bis Davos wird behauptet, dass wir genau das tun werden.

Angesichts dieser Tatsachen mögen selbst die enthusiastischsten Befürworter von Wind- und Solarenergie zögern, wenn sie die Größe der Aufgabe betrachten. Der völlige Verzicht auf die Produktion fossiler Brennstoffe bis zum Jahr 2050 sollte in der Praxis als unmöglich angesehen werden. Der Anstieg des Bergbaus, der Landverbrauch, der Ausbau der Übertragungsleitungen, die Notwendigkeit einer gewaltigen Menge an Stromspeichern, um diese intermittierenden Quellen auszugleichen, die Anfälligkeit von Wind- und Solarfarmen für Wetterereignisse wie Frost, Tornados und Hagel und die verblüffende Aufgabe, alles alle 20 bis 30 Jahre neu zu machen, wenn die Windturbinen, Photovoltaikmodule und Speicherbatterien das Ende ihrer Nutzungsdauer erreichen – all dies deutet darauf hin, dass die Beschaffung von mehr als 90 Prozent der weltweiten Energie aus Wind- und Sonnenenergie ein aussichtsloses Unterfangen ist.

Wenn Kohle, Öl und Gas auslaufen und es unrealistisch ist zu erwarten, dass fast 1000 Exajoule Strom durch Wind- und Sonnenenergie erzeugt werden, was bleibt dann noch übrig? Im dritten Teil dieser Serie wird das Potenzial der verbleibenden Energiealternativen – Kernenergie, Wasserkraft, Biokraftstoffe, Erdwärme – sowie mögliche Innovationen untersucht, die eines Tages die Regeln ändern könnten.

Edward Ring is a senior fellow of the Center for American Greatness. He is also is a contributing editor and senior fellow with the California Policy Center, which he co-founded in 2013 and served as its first president. Ring is the author of Fixing California: Abundance, Pragmatism, Optimism (2021) and The Abundance Choice: Our Fight for More Water in California (2022).

Originally published by American Greatness. Republished with permission.

Um mehr über die Grenzen von Wind- und Solarenergie zu erfahren, klicken Sie hier.

Link: https://heartlanddailynews.com/2024/02/can-wind-solar-energy-expand-50-100-times/?

Übersetzt von Christian Freuer für das EIKE