„Der Klima-Aktivismus ist zur neuen Religion des 21. Jahrhunderts geworden – Ketzer sind nicht willkommen, und es dürfen keine Fragen gestellt werden“, sagt der Astrophysiker Willie Soon.

Alex Newman

Temperaturaufzeichnungen, die von Klimawissenschaftlern und Regierungen verwendet werden, um Modelle zu erstellen, die dann gefährliche Auswirkungen der vom Menschen verursachten globalen Erwärmung vorhersagen, weisen ernsthafte Probleme und sogar Fälschungen in den Daten auf, so mehrere Wissenschaftler gegenüber The Epoch Times, die kürzlich Studien zu diesem Thema veröffentlicht haben.

Die Regierung Biden stützt sich auf ihren jüngsten Bericht über die nationale Klimabilanz als Beweis dafür, dass die globale Erwärmung durch menschliche Aktivitäten beschleunigt wird. In dem Dokument heißt es, dass die menschlichen Emissionen von „Treibhausgasen“ wie Kohlendioxid die Erde in gefährlicher Weise erwärmen.

Der IPCC vertritt die gleiche Ansicht, und seine führenden Vertreter drängen daraufhin auf umfassende Änderungen der globalen Politik.

Doch wissenschaftliche Experten aus aller Welt und aus den verschiedensten Disziplinen wehren sich dagegen. In von Fachleuten begutachteten Studien weisen sie auf eine Vielzahl von Mängeln bei den globalen Temperaturdaten hin, die für die düsteren Schlussfolgerungen herangezogen wurden; sie sagen, es sei an der Zeit, die gesamte Darstellung zu überdenken.

Zu den Problemen mit den Temperaturdaten gehören der Mangel an geographisch und historisch repräsentativen Daten, die Kontaminierung der Aufzeichnungen durch Wärme aus städtischen Gebieten und die Verfälschung der Daten durch einen als „Homogenisierung“ bezeichneten Prozess.

Die Mängel sind so gravierend, dass sie die Temperaturdaten – und die darauf basierenden Modelle – im Grunde unbrauchbar oder sogar noch schlimmer machen, erklärten drei unabhängige Wissenschaftler des Center for Environmental Research and Earth Sciences (CERES).

Die Experten sagten, dass die vermeintliche, angeblich durch menschliche Aktivitäten verursachte „Klimakrise“ verschwindet, wenn man die Datenverfälschung berücksichtigt. Stattdessen biete die natürliche Klimavariabilität eine viel bessere Erklärung für die Beobachtungen, so die Experten.

Experten: Fixierung auf CO₂ ignoriert wahren Treiber der Temperatur

Einige Experten erklärten gegenüber der Epoch Times, dass es sich offenbar um vorsätzlichen Betrug handele, während andere eher harmlose Erklärungen anführten.

Doch unabhängig von der Ursache der Probleme können die Auswirkungen der Ergebnisse kaum überschätzt werden.

Wenn es keine Klimakrise gibt, fällt die Rechtfertigung für Billionen von Dollar an Staatsausgaben und kostspielige Änderungen der öffentlichen Politik zur Begrenzung der Kohlendioxid (CO₂)-Emissionen in sich zusammen, erklärten die Wissenschaftler in einer Reihe von Interviews über ihre Forschung.

„In den letzten 35 Jahren wurden die Worte des IPCC als Evangelium betrachtet“, so der Astrophysiker und CERES-Gründer Willie Soon. Bis vor kurzem arbeitete er als Forscher am Center for Astrophysics, Harvard & Smithsonian. „Und tatsächlich ist der Klima-Aktivismus zur neuen Religion des 21. Jahrhunderts geworden – Ketzer sind nicht willkommen, und es dürfen keine Fragen gestellt werden. Gute Wissenschaft verlangt aber, dass Wissenschaftler ermutigt werden, das Dogma des IPCC in Frage zu stellen. Die angebliche Reinheit der globalen Temperaturaufzeichnungen ist eines der heiligsten Dogmen des IPCC.“

Im jüngsten Bericht der US-Regierung über die nationale Klimabilanz heißt es: „Menschliche Aktivitäten verändern das Klima. Die Beweise für eine Erwärmung in vielen Bereichen des Erdsystems sind unbestreitbar, und die Wissenschaft ist sich einig, dass die Zunahme der atmosphärischen Treibhausgase für viele der beobachteten Trends und Veränderungen verantwortlich ist.“

Dem Bericht zufolge ist dies vor allem auf menschliche Aktivitäten wie die Verbrennung fossiler Brennstoffe für Verkehr, Energie und Landwirtschaft zurückzuführen.

Ein Blick auf die Zeitskala macht die großen Probleme mit dieser Darstellung deutlich, so Soon: „Wenn die Leute nach der globalen Erwärmung oder dem Klimawandel fragen, ist es wichtig zu fragen: ‚Seit wann? Die Daten zeigen, dass es sich seit den 1970er Jahren erwärmt hat, aber dass dies auf eine Abkühlungsphase seit den 1940er Jahren folgte.“

Zwar ist es jetzt „definitiv wärmer“ als im 19. Jahrhundert, sagte Soon, doch zeigen die Proxy-Temperaturdaten, dass das 19. Jahrhundert „außergewöhnlich kalt war. Es war das Ende einer Periode, die als Kleine Eiszeit bekannt ist“, sagte er.

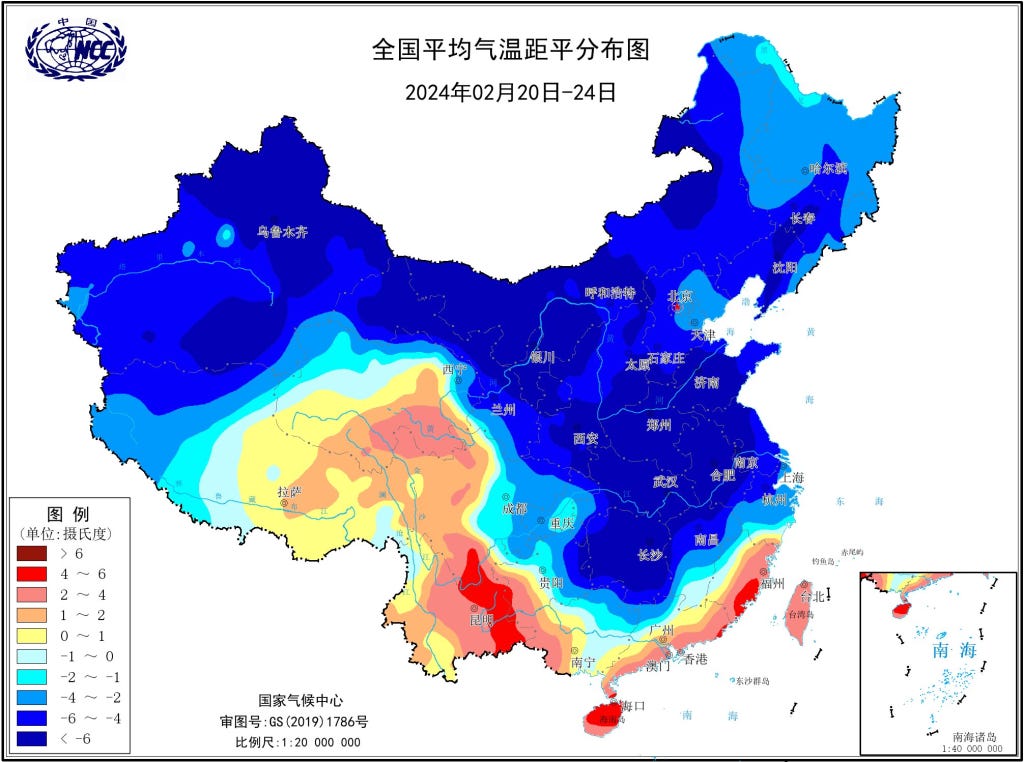

Daten von Temperaturstationen in ländlichen Gebieten, Ozeanmessungen, Wetterballone, Satellitenmessungen und alternative Temperaturdaten wie Baumringe, Gletscher und Seesedimente „zeigen, dass sich das Klima immer verändert hat“, sagte Soon. „Sie zeigen, dass das derzeitige Klima außerhalb der Städte nicht ungewöhnlich ist“ und fügte hinzu, dass die Wärme aus städtischen Gebieten die Daten unzulässig beeinflusst.

„Wenn wir die Temperaturdaten aus den Städten herausnehmen, die nur 3 Prozent des Planeten ausmachen, erhalten wir ein ganz anderes Bild des Klimas.“

Homogenisierung

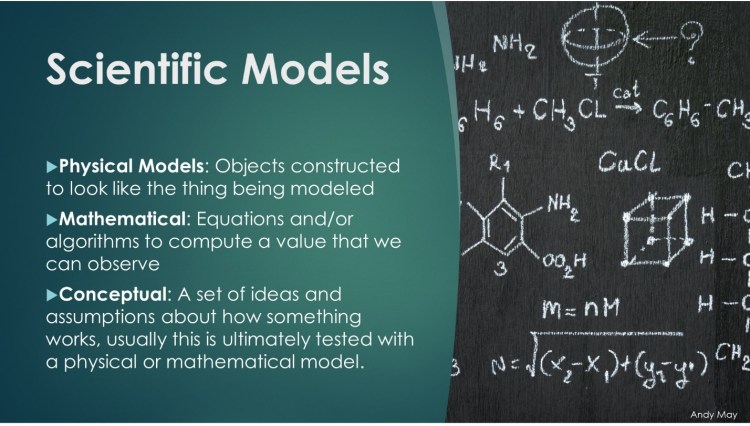

Ein Problem, das nach Ansicht der Wissenschaftler die Daten verfälscht, ist ein obskurer Prozess, der als „Homogenisierung“ bekannt ist.

Nach Angaben von Klimawissenschaftlern, die mit Regierungen und der UNO zusammenarbeiten, sind die für die Homogenisierung verwendeten Algorithmen darauf ausgelegt, verschiedene, in den rohen Temperaturdaten möglicherweise vorhanden Verzerrungen so weit wie möglich zu korrigieren.

Zu diesen Verzerrungen gehören u. a. die Verlegung von Temperatur-Messstationen, Änderungen in der zur Datenerfassung verwendeten Technologie oder Veränderungen in der Umgebung eines Thermometers, die sich auf dessen Messwerte auswirken könnten.

Wenn beispielsweise eine Temperaturmessstation ursprünglich auf einem leeren Feld platziert war, dieses Feld aber inzwischen zu einem Parkplatz umgewandelt wurde, würde die Aufzeichnung viel höhere Temperaturen anzeigen. Daher wäre es sinnvoll, zu versuchen, die erfassten Daten zu korrigieren.

Praktisch niemand bestreitet, dass eine gewisse Homogenisierung erforderlich ist, um verschiedene Faktoren zu berücksichtigen, welche die Temperaturdaten kontaminieren können.

Eine genauere Untersuchung des Prozesses, wie er jetzt abläuft, gibt jedoch Anlass zu großen Bedenken, sagte Ronan Connolly, ein unabhängiger Wissenschaftler bei CERES. „Während die wissenschaftliche Gemeinschaft süchtig danach geworden ist, diese Computerprogramme blind zu benutzen, um die Datenverzerrungen zu korrigieren, hat sich bis vor kurzem niemand die Mühe gemacht, unter die Haube zu schauen, um zu sehen, ob die Programme funktionieren, wenn sie auf reale Temperaturdaten angewandt werden“, sagte er gegenüber The Epoch Times.

Seit Anfang der 2000er Jahre verlassen sich verschiedene staatliche und zwischenstaatliche Organisationen, die globale Temperaturaufzeichnungen erstellen, auf Computerprogramme zur automatischen Anpassung der Daten.

Soon, Connolly nebst einem Team von Wissenschaftlern aus der ganzen Welt haben sich jahrelang mit diesen Programmen beschäftigt, um herauszufinden, wie sie funktionieren und ob sie zuverlässig sind.

Einer der an der Analyse beteiligten Wissenschaftler, Peter O’Neill, hat die Daten der National Oceanographic and Atmospheric Administration (NOAA) und ihres Global Historical Climatology Network seit 2011 täglich verfolgt und heruntergeladen. Er fand heraus, dass die NOAA jeden Tag andere Anpassungen an den Daten vornimmt.

„Sie verwenden dasselbe Computerprogramm zur Homogenisierung und führen es etwa alle 24 Stunden erneut aus“, so Connolly. „Aber jeden Tag sind die Anpassungen der Homogenisierung anders, die sie für jede Temperaturaufzeichnung berechnen. Das ist sehr bizarr. Wenn die Anpassungen für eine bestimmte Wetterstation irgendeine Grundlage in der Realität haben, dann würden wir erwarten, dass das Computerprogramm jedes Mal die gleichen Anpassungen berechnet. Wir haben festgestellt, dass dies nicht der Fall ist.“

Diese Bedenken waren der Auslöser für die internationale Untersuchung des Themas durch Soon et al.

Da die NOAA keine historischen Informationen über ihre Wetterstationen aufbewahrt, wandten sich die CERES-Wissenschaftler an europäische Wissenschaftler, welche die Daten für die von ihnen betreuten Stationen zusammengestellt hatten.

Sie fanden heraus, dass nur 17 Prozent der NOAA-Anpassungen konsequent angewendet wurden. Und weniger als 20 Prozent der NOAA-Anpassungen waren eindeutig mit einer dokumentierten Änderung der Stationsbeobachtungen verbunden. „Als wir unter die Motorhaube schauten, stellten wir fest, dass statt eines Motors ein Hamster im Rad lief“, sagte Connolly. „Es scheint, dass bei diesen Homogenisierungsprogrammen das Heilmittel schlimmer ist als die Krankheit“.

Ein Sprecher der Nationalen Zentren für Umweltinformationen der NOAA spielte die Bedeutung herunter, sagte aber, dass die Behörde daran arbeite, die in den Dokumenten angesprochenen Probleme zu lösen.

„Die NOAA verwendet den gut dokumentierten paarweisen Homogenisierungs-Algorithmus jeden Tag für die GHCNm (monatlich)-Version 4, und die Ergebnisse spezifischer Anpassungen einzelner Stationsreihen können sich von Lauf zu Lauf unterscheiden“, sagte der Sprecher und fügte hinzu, dass die fraglichen Arbeiten nicht die Ansicht unterstützten, dass die Bedenken über die Homogenisierung der Daten diese unbrauchbar oder schlechter machten. „Die NOAA wird die in diesen beiden Arbeiten aufgeworfenen Fragen in einer zukünftigen Version des GHCNm-Temperaturdatensatzes und der dazugehörigen Dokumentation behandeln.“

Städtische Wärmeinseln

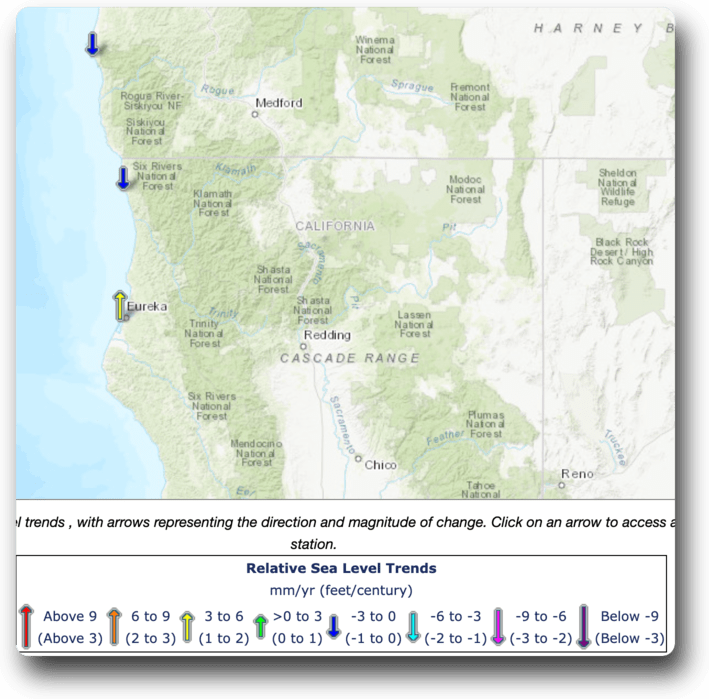

Einer der größten Fehler in den Temperaturdaten, der eine Homogenisierung überhaupt erst notwendig macht, ist der so genannte städtische Wärmeinseleffekt (UHI).

Im Wesentlichen sind die Temperaturstationen, die sich früher in ländlichen Gebieten befanden, heute in vielen Fällen von Straßen, Gebäuden, Flughäfen und Städten umgeben. Dies führt zu einer zusätzlichen lokalen Erwärmung in der Umgebung des Thermometers, was den Anschein einer drastischen „globalen Erwärmung“ erweckt, wenn viele ähnliche Stationen zusammen untersucht werden.

Der Weltklimarat hat den städtischen Wärmeinseleffekt und die Kontaminierung der Daten anerkannt, doch nach Ansicht der Wissenschaftler, die mit The Epoch Times sprachen, hat die UN-Organisation fälschlicherweise angenommen, es handele sich um ein geringfügiges Problem.

In einer neuen, von Experten begutachteten Studie schätzt die Koalition von Wissenschaftlern, dass bis zu 40 Prozent der beobachteten Erwärmung seit dem 19. Jahrhundert, die vom IPCC verwendet wird, tatsächlich das Ergebnis dieser städtischen Wärmeverzerrung ist – und nicht eines der CO₂-getriebenen globalen Erwärmung.

„Wenn wir uns die nicht-städtischen Temperaturdaten für das Land, die Ozeane und andere Temperaturaufzeichnungen ansehen, ist die Erwärmung viel weniger dramatisch und scheint anderen Warmzeiten vor der industriellen Revolution zu ähneln“, sagte Connolly. „Der IPCC berücksichtigt den städtischen Wärmeinseleffekt nicht“.

Als Connolly und andere Wissenschaftler eine Temperaturreihe erstellten, bei dem nur ländliche Temperaturstationen verwendet wurden, verschwand fast die Hälfte der von der UNO unterstellten globalen Erwärmung. In der Tat stimmen die Datensätze, die nur für den ländlichen Raum gelten, viel besser mit den Daten von Wetterballonen und Satelliten überein.

Insgesamt zeigen die nur für den ländlichen Raum geltenden Aufzeichnungen, dass die mäßige Erwärmung wahrscheinlich nur eine Erholung von der Kleinen Eiszeit von etwa 1300 bis 1900 n. Chr. ist, die wiederum auf die mittelalterliche Warmzeit von etwa 800 bis 1200 n. Chr. folgte, in der die Wikinger in Grönland Landwirtschaft betrieben.

„Die mittelalterliche Warmzeit scheint in etwa so warm gewesen zu sein wie die moderne Warmzeit, aber nur, wenn wir die Aufzeichnungen nur für den ländlichen Raum verwenden“, sagte Connolly. „Während es seit dem Ende der Kleinen Eiszeit eine globale Erwärmung gegeben hat, zeigen alle primären globalen Temperaturschätzungen, dass der Planet zwischen Phasen der Erwärmung und der Abkühlung wechselt, wenn die städtischen Datensätze ausgeschlossen werden“, sagte er.

Die derzeitige Erwärmung begann in den 1970er Jahren, als die Wissenschaftler noch vor der angeblich vom Menschen verursachten globalen Abkühlung warnten, die in den 1940er Jahren eingesetzt hatte.

Michael Connolly, ein weiterer unabhängiger Wissenschaftler bei CERES und Vater von Ronan Connolly, stellte fest, dass die Erwärmung in den etwa 3 Prozent der Landoberfläche der Erde bedeckenden Städten tatsächlich zu einem „großen Problem“ wird, das angegangen werden sollte.

„Aber es kann nicht durch Treibhausgaspolitik gelöst werden“, sagte er. „Stattdessen sollten wir mehr in die Begrünung der Städte und andere Maßnahmen investieren, um die Hitzewellen in den Städten zu reduzieren.“

Vermischung von Daten aus ländlichen und städtischen Gebieten

Ein anderes Problem mit Homogenisierungs-Algorithmen wurde in einer anderen Studie untersucht, die letztes Jahr im Journal of Applied Meteorology and Climatology veröffentlicht wurde.

Das Problem, das Ronan Connolly und seine Kollegen als „Urban Blending“ [urbane Vermischung] bezeichnen, betrifft die Vergleiche zwischen den Temperaturaufzeichnungen einer Station und anderen in der Umgebung.

Wenn die Daten einer Station nicht mit den anderen übereinstimmt, geht das Programm davon aus, dass es sich um eine nichtklimatische Abweichung handelt, die korrigiert werden sollte.

Das vielleicht größte Problem dabei ist, dass die Erwärmung in den Städten die gesamte Temperaturaufzeichnung kontaminieren kann, indem sie mit Daten aus dem ländlichen Raum vermischt wird.

Das Ergebnis ist, dass städtische und ländliche Daten miteinander vermischt werden, so dass ein Teil der städtischen Erwärmung in die ländlichen Daten hinein gemengt wird, obwohl das Problem bei diesen nicht auftritt.

„Eine nützliche Analogie ist, dass wenn man Erdbeeren und Bananen in einem Mixer mischt, man am Ende eine homogene Mischung hat, die weder aus Erdbeeren noch aus Bananen besteht“, sagte Ronan Connolly. „Betrachtet man die Temperaturdaten, bedeutet dies, dass die homogenisierten ländlichen Aufzeichnungen ebenfalls die städtische Erwärmung enthalten.“

Die angeblich „ungewöhnliche“ globale Erwärmung, auf die sich der IPCC und andere Quellen berufen, sei nur in den städtischen Daten zu finden, die durch die mit den Städten verbundene Wärme kontaminiert seien, sagte er. Aber durch die Verwendung der homogenisierten Daten werden alle Daten durch den städtischen Wärmeeffekt künstlich verzerrt.

„Wenn wir uns die Temperaturdaten ansehen, die nicht durch die Erwärmung in den Städten kontaminiert wurden, scheint es, dass die Temperaturveränderungen seit der Zeit vor der industriellen Revolution fast zyklisch verlaufen sind – Abkühlungsperioden gefolgt von Erwärmungsperioden“, so Ronan Connolly. „Dies lässt sich nicht mit dem Anstieg der Treibhausgase erklären, da diese nur nach oben gehen. Stattdessen deutet es darauf hin, dass die Wissenschaftler, die fälschlicherweise die Erwärmung in den Städten mit den Temperaturveränderungen außerhalb der Städte vermischt haben, mit ihrer Überzeugung, dass CO₂ der Haupttreiber des Klimas ist, einem Ablenkungsmanöver hinterherlaufen.“

Allerdings ist nicht jeder davon überzeugt, dass diese Probleme so bedeutsam sind, wie die CERES-Wissenschaftler behauptet haben.

Professor Robert Lund, ein anerkannter Experte auf diesem Gebiet und Lehrstuhlinhaber für Statistik an der Universität von Kalifornien-Santa Cruz, erklärte gegenüber der Epoch Times, dass ihn die von Herrn Soon und seinen Kollegen vorgebrachten Argumente „erschaudern“ ließen.

„Es stimmt, dass viele Klimawissenschaftler im Allgemeinen nicht die besten Methoden verwenden, um die Daten zu bereinigen“, sagte Lund. „Aber die Behauptung der CERES-Wissenschaftler, dass die Rückschlüsse auf die Erwärmung, die wir machen, wegen der Veränderungen der Messgeräte und der Verlegung der Messstationen und ihrer suboptimalen Behandlung in den Homogenisierungsverfahren falsch sind, ist einfach nicht wahr“, sagte er. „Unabhängig davon, wie man mit der Frage der Veränderungspunkte umgeht, weisen alle global gemittelten Reihen (wie die IPCC-Reihen) starke Aufwärtstrends auf. So einfach ist das. Das Homogenisierungsproblem könnte vielleicht 0,1 oder 0,2 Grad Celsius pro Jahrhundert von den 1,3 [Grad Celsius] ausmachen, die wir global erwärmen, aber nicht mehr“.

Er warf den CERES-Wissenschaftlern vor, dass sie „versuchen, jede Menge Unsicherheit einzuführen, diese zu potenzieren und alles zu diskreditieren“.

Auf die Frage, ob er vorhabe, ihre Studien in einer eigenen Arbeit zu widerlegen, sagte Lund, dass er und andere auf diesem Gebiet des Kampfes gegen Wissenschaftler überdrüssig geworden seien, die vor allem daran interessiert seien, das Klimanarrativ zu diskreditieren.

Eine Reihe anderer Wissenschaftler auf beiden Seiten der Debatte reagierte nicht auf Bitten um Kommentare.

Mehrere Kritiker der vom Menschen verursachten globalen Erwärmung baten darum, sich inoffiziell zu äußern, da sie Vergeltungsmaßnahmen seitens ihrer Institutionen, Kollegen, Zeitschriften oder Geldgeber befürchteten.

[Hervorhebung vom Übersetzer]

Weitere Probleme

Vor den 1970er Jahren gibt es eigentlich keine historischen Temperaturdaten, was jede Art von Langzeitstudie erschwert. Und außerhalb Europas und Nordamerikas gibt es nur sehr wenige Daten.

Bis vor kurzem waren die Daten aus den Ozeanen – die mehr als zwei Drittel der Erdoberfläche ausmachen – ebenfalls spärlich und beschränkten sich hauptsächlich auf gelegentliche Messungen an den Haupt-Schifffahrtsrouten der nördlichen Hemisphäre.

Die NOAA wurde dafür kritisiert, dass mehr als 90 Prozent ihrer Klimastationen von der städtischen Wärmeverzerrung betroffen sind, berichtete die Epoch Times im Januar unter Berufung auf Wissenschaftler und eine separate Studie, in welcher die Temperaturaufzeichnungen der NOAA separat untersucht wurden.

Eine Studie des Meteorologen Anthony Watts ergab, dass im Jahr 2022 rund 96 Prozent der Stationen die Zuverlässigkeitsstandards der Behörde nicht erfüllen werden.

Michael Connolly wies darauf hin, dass die Wetterstationen ursprünglich zur Überwachung des täglichen Wetters und nicht zur Beobachtung langfristiger Klimaveränderungen eingerichtet worden seien. „Die meisten Wissenschaftler, mit denen ich persönlich spreche, geben zwar zu, dass sie Vorbehalte gegen bestimmte Aspekte der derzeitigen Darstellung des Klimawandels haben, aber sie sagen, dass ihre Institutionen darunter leiden würden, wenn sie sich äußern würden“, sagte er.

[Hervorhebung vom Übersetzer]

Soon räumte ein, dass die Messung des Klimawandels ein „sehr schwieriges wissenschaftliches Problem“ sei, vor allem weil die Daten unvollkommen seien. Aber Wissenschaftler haben die Pflicht, in dieser Hinsicht ehrlich zu sein. „Viele Forschungsgruppen scheinen in der Hektik, Zuschüsse zu erhalten und ihre Arbeit zu veröffentlichen, die schwerwiegenden Probleme der von ihnen verwendeten Daten zu übersehen“, sagte er und fügte hinzu, dass viele Wissenschaftler um ihre Arbeitsplatzsicherheit besorgt seien und sich nicht trauten, ihre Meinung zu sagen.

[Hervorhebung vom Übersetzer]

Aber einige Analysten, die sich mit dieser Problematik auseinander gesetzt haben sagen, dass es sich um vorsätzlichen Betrug handelt.

Der Wissenschaftler und Ingenieur Tony Heller von der Website Real Climate Science sagte, dass die Temperaturdaten – sowohl die historischen als auch die geographischen – „völlig unzureichend“ seien.

Die Bedenken über Homogenisierung und Vermischung wiederholend sagte er der Epoch Times, dass „die Theorie zu sein scheint, dass das Mischen einer Menge sehr schlechter Zutaten eine gute Suppe ergibt“.

Heller beschuldigt die NOAA, ihre Daten zu manipulieren, um den „Anschein einer Erwärmun“ zu erwecken, und nennt die globalen und US-amerikanischen Temperaturaufzeichnungen „Propaganda, nicht Wissenschaft“.

Die irreführenden Anpassungen der Daten und die allgemeine Täuschung seien „absolut vorsätzlich“, sagte er. „Billionen Dollar werden in die Propagierung der globalen Erwärmung und des Klimawandels gesteckt.“

Bislang wurden die Studien von Soon und anderen in keiner von Fachleuten überprüften Literatur widerlegt. Einige prominente Wissenschaftler, die für die Bundesregierung und andere mit der Klimabewegung verbundene Einrichtungen arbeiten, haben die Autoren jedoch lächerlich gemacht und beleidigt, wie die Epoch Times im Oktober 2023 berichtete.

Weder der IPCC noch der führende NASA-Klimaforscher Gavin Schmidt reagierten auf die Bitte um Stellungnahme.

————————-

Übersetzt von Christian Freuer für das EIKE

Dieser Beitrag ist per E-Mail übermittelt worden, so dass kein expliziter Link angegeben werden kann. Wer die Übersetzung überprüfen will, kann das mit dem DOC-Dokument im Anhang tun.

Außerdem ist die gesamte Studie von Soon et al. im PDF beigefügt.

AlexNewman24-Feb28-TextoftheArticle-SoonCERES022824

AlexNewman24-Feb28-New Studies Undercut Key Climate Change Claims