Wie viele Milliarden Menschen würden im Zuge von Net Zero zu Tode kommen?

Chris Morrison, THE DAILY SCEPTIC

Der BBC-Kauz Chris Packham hat sich gegen Behauptungen in Neil Olivers GB News-Show gewehrt, wonach die Hälfte der Weltbevölkerung sterben könnte, wenn Net Zero vollständig umgesetzt würde. „Können Sie bitte erklären, wie Sie die Ausstrahlung dieses völligen Blödsinns zulassen können“, schimpft er. Zu Ofcom zu rennen scheint eine Schutzmaßnahme für den Handel zu sein – Millionen werden sterben ist seit Jahrzehnten der bewährte Modus Operandi des Klimakatastrophisten Chris.

Es scheint sich um denselben Chris Packham zu handeln, der im Oktober 2010 dem Telegraph sagte, es gebe zu viele Menschen auf dem Planeten und „wir müssen etwas dagegen tun“. Im Jahr 2020 teilte er der Daily Mail mit, dass Pocken, Masern, Mumps und Malaria „ganz offen gesagt“ dazu da seien, „unsere Bevölkerung zu regulieren“. Im Laufe seiner Fernsehkarriere hat Packham, unbehelligt vom Interesse der Ofcom, ein Massenaussterben allen Lebens auf der Erde an die Wand gemalt, wenn die Menschen nicht aufhören, Kohlenwasserstoffe zu verbrennen. Natürlich gibt es Leute, die darauf hinweisen, dass diese populären Massenaussterben nur in Computermodellen zu existieren scheinen. In der Zwischenzeit haben Kohlenwasserstoffe in vielen Teilen des Planeten, der heute eine nachhaltige Bevölkerung von acht Milliarden Menschen beherbergt, zu einem beispiellosen Wohlstand und einer Gesundheit geführt, die für frühere Generationen unvorstellbar war.

Natürlich wird Net Zero nicht vier Milliarden Menschen umbringen, denn Net Zero wird es nie geben. Tag für Tag bröckelt die Unterstützung auf der ganzen Welt, da das politische Kollektivierungsprojekt, das sich auf zunehmend diskreditierte Computermodelle stützt, auf den harten Felsen der Realität zu stoßen beginnt. Die Geschichte lehrt uns, dass Stämme, die schwach und dekadent werden, eine leichte Beute für ihre stärkeren Nachbarn sind. Aber die Behauptung, dass vier Milliarden Menschen sterben werden, wenn die Weltbevölkerung jemals den Netto-Nullpunkt erreichen sollte, ist es wert, untersucht zu werden. Schließlich ist es wahrscheinlich, dass sie wahr ist.

Die in GB News erwähnten vier Milliarden Toten gehen auf eine Bemerkung von Dr. Patrick Moore zurück, einem der ursprünglichen Gründer von Greenpeace. In einem Interview auf Fox News sagte er: „Wenn wir fossile Brennstoffe verbieten, würde die landwirtschaftliche Produktion zusammenbrechen. Die Menschen würden verhungern, und die Hälfte der Bevölkerung würde in kürzester Zeit sterben“. Vier Milliarden Tote bei einem Verbot von Kunstdünger sind kein „BS“, sondern ein fast garantiertes Ergebnis. In einer kürzlich erschienenen wissenschaftlichen Abhandlung stellten die emeritierten Professoren William Happer und Richard Lindzen vom Princeton bzw. MIT fest, dass „die Abschaffung von Stickstoffdünger und Pestiziden, gewonnen aus fossilen Brennstoffen, zu einer weltweiten Hungersnot führen wird“. Dank des Einsatzes von Stickstoffdünger sind die Ernteerträge in den letzten Jahrzehnten weltweit stark angestiegen, und natürliche Hungersnöte – im Gegensatz zu den vom Menschen verursachten lokalen Ausbrüchen – sind weitgehend verschwunden.

Ein Großteil der Net-Zero-Besessenheit der luxuriösen Mittelschicht beruht auf einem scheinbaren Hass auf den menschlichen Fortschritt. Es ist eine Kampagne, um die Vorteile der Massenindustrialisierung zurückzudrängen, obwohl es zweifelhaft ist, dass viele der glühenden Befürworter glauben, dass die drastischen Reduzierungen des Lebensstandards sie selbst betreffen werden. Es handelt sich um Narzissmus auf Stelzen, der auf einer fast vollständigen Unkenntnis darüber beruht, wie die Lebensmittel auf ihre Teller kommen, die sie zu sich nehmen. Es zeigt eine völlige Missachtung der zentralen Rolle, die Kohlenwasserstoffe in ihrem Leben spielen. Sie beruht auf einer tiefen Abneigung gegen fast alle modernen Herstellungsverfahren. Heutzutage kennen sie keine Menschen mehr, die tatsächlich etwas herstellen, und wenn sie sie treffen, mögen sie sie oft nicht. Der durchgeknallte Guardianista George Monbiot twitterte kürzlich, dass die Abschaffung der Tierhaltung genauso wichtig sei wie die Beibehaltung der fossilen Brennstoffe im Boden. „Der Verzehr von Fleisch, Milch und Eiern ist ein Genuss, den sich der Planet nicht leisten kann“, fügte er hinzu.

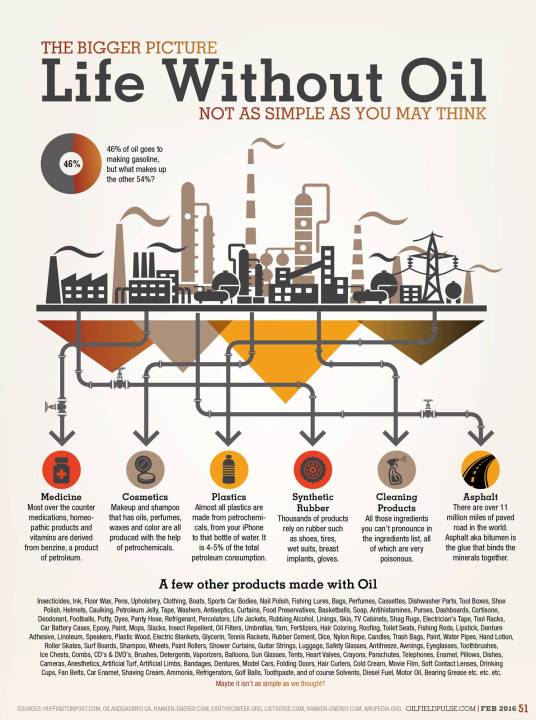

Wenn wir die fossilen Brennstoffe im Boden lassen, werden die Folgeprodukte weitgehend verschwinden.

Die Illustration, die in den sozialen Medien verbreitet und kürzlich von Paul Homewood veröffentlicht wurde, ist ein Weckruf für die Bedeutung von Kohlenwasserstoffen. Ohne sie wäre es für die Menschen schwierig, viele Medikamente und Kunststoffe herzustellen. Ähnliche Schwierigkeiten gäbe es bei der Herstellung gängiger Produkte wie Kleidung, Lebensmittel Konservierungsmittel für Lebensmittel, Reinigungsmittel und weiche Kontaktlinsen.

Alec Epstein, der Autor des Bestsellers Fossil Future, stimmt zu, dass eine Netto-Null-Politik bis 2050 „apokalyptisch zerstörerisch“ wäre und in der Tat bereits katastrophal zerstörerisch gewesen ist, obwohl sie bislang kaum umgesetzt wurde. Dies ist vielleicht eine Anspielung auf die bösartige Politik westlicher Banken und Eliten, die sich weigern, Kredite für den Bau von mit Kohlenwasserstoffen betriebenen Wasseraufbereitungsanlagen in den ärmeren Teilen der Entwicklungsländer zu vergeben. Milliarden von Menschen fehlt immer noch die kostengünstige Energie, die sie für ein Leben in Wohlstand und Sicherheit benötigen, stellt Epstein fest. Viele Menschen in den Entwicklungsländern kochen immer noch mit Holz und Dung. Wie Happer und Lindzen ist auch er der Meinung, dass bei einer Umsetzung von Net Zero „praktisch alle acht Milliarden Menschen auf der Welt in Armut und einen vorzeitigen Tod stürzen werden“.

Vieles von dem, was geplant ist, liegt im Verborgenen. Die von reichen Milliardären finanzierte C40-Gruppe, deren Vorsitz der Londoner Bürgermeister Sadiq Khan innehat, hat eine Rationierung im Stil des Zweiten Weltkriegs mit einer täglichen Fleischmenge von 44 g untersucht. Auch die Einschränkung des Individualverkehrs und massive Beschränkungen des Flugverkehrs wurden in Betracht gezogen. Das Mitglied der Labour-Partei, Khan, hat die Anliegen seiner elitären Zahlmeister bereits in Angriff genommen, indem er vor kurzem viele Autos der weniger Wohlhabenden mit speziellen Strafgebühren von den Londoner Straßen vertrieben hat.

Bei der von der britischen Regierung finanzierten Organisation UK FIRES herrscht Ehrlichkeit vor. Dort zeigen Wissenschaftler aus dem Elfenbeinturm grausam offene Berichte, die zeigen, dass Net Zero die verfügbare Energie um etwa drei Viertel reduzieren würde. Sie gehen zu Recht davon aus, dass es derzeit und in absehbarer Zukunft keine realistische Technologie gibt, um die aus den unregelmäßigen Brisen und Sonnenstrahlen gewonnene Energie zu sichern. Es ist die Rede von Flugverbot, Schifffahrtsverbot, drastischer Einschränkung des Fleischkonsums und dem Verbot des Heizens. Vorgeschlagen wird auch eine rücksichtslose Abschaffung moderner Baumaterialien, wobei traditionelle Baustoffe durch neue Materialien wie Stampflehm ersetzt werden sollen.

Eine Rückkehr zum Primitivismus deutet sich auch in einem kürzlich erschienenen Bericht der Vereinten Nationen an, in dem vorgeschlagen wird, mit Lehmziegeln, Bambus und „Waldabfällen“ zu bauen. Man könnte meinen, dass Lehm- und Grashütten kaum ausreichen werden, um unfreundliche fremde Horden abzuschrecken, die sich in Zukunft am Horizont abzeichnen. Und es macht auch keinen Sinn, den Letzten zu bitten, das Licht auszumachen, weil es sowieso keinen Strom geben wird.

Chris Morrison is the Daily Sceptic’s Environment Editor.

Link: https://wattsupwiththat.com/2024/04/22/how-many-billions-of-people-would-die-under-net-zero/

Übersetzt von Christian Freuer für das EIKE