Ozeane der Erde kühlen sich rasant ab – und Wissenschaftler haben noch keinen von der Partei anerkannten Grund dafür gefunden!

Cap Allon

Jüngste Daten zeigen einen signifikanten und raschen Rückgang der Temperaturen der Ozeane weltweit, was die Wissenschaftler vor ein Rätsel stellt – oder genauer gesagt, sie „suchen immer noch nach einer Erklärung, die mit dem Mainstream-Narrativ übereinstimmt“.

Die mit dieser plötzlichen Abkühlung einhergehende Konfusion steht in krassem Gegensatz zu dem Alarm und der Gewissheit, die mit den steigenden Temperaturen der letzten Jahre einhergingen. Ohne zu zögern schrieb „The Science“ die wärmeren Ozeane dem vom Menschen verursachten Klimawandel zu, wobei die Hitze „32,4-mal wahrscheinlicher auf den menschlichen Wohlstand zurückzuführen ist“ – oder so ähnlich. Doch nun, da die Temperaturen sinken, ist allgemeines Kopfschütteln zu beobachten, während das Establishment verzweifelt nach einer von der Partei genehmigten Antwort sucht.

Wie schon oben erwähnt werden sie niemals behaupten, dass das Klimasystem der Erde durch natürliche Einflüsse/Zyklen für immer ein Gleichgewicht anstrebt, was bedeutet, dass es keinen Grund zur Sorge gibt. Niemals. Seit fast zwei Jahren ist das Thema „kochende Ozeane“ ein beliebtes Thema für Aktivisten, Wissenschaftler und Panikmacher gleichermaßen, das häufig zur Rechtfertigung drastischer Maßnahmen und zum Schüren öffentlicher Ängste verwendet wird.

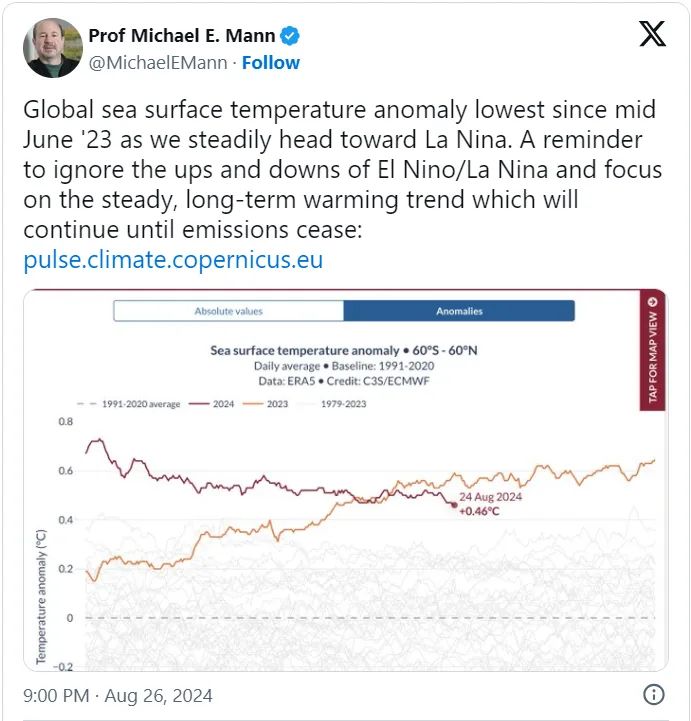

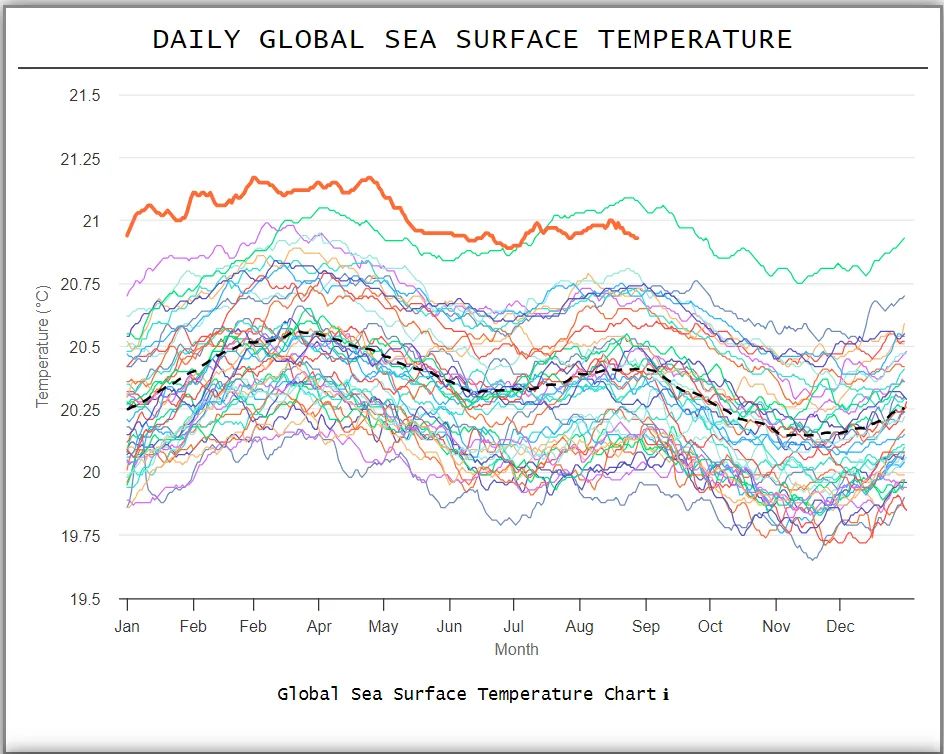

Ein wichtiges, bis vor kurzem weit verbreitet Bild war die Grafik der globalen Meerestemperaturen (SST). Im Jahr 2023 und in der ersten Hälfte des Jahres 2024 zeigte die Grafik steigende Temperaturen. In den letzten Monaten ist jedoch ein signifikanter und unangenehmer Rückgang zu beobachten, und die Alarmisten haben ein amüsantes Maß an „Bewältigung“ desselben gefunden:

Obwohl es sich um ein globales Phänomen handelt, sind die Temperaturen im Atlantischen Ozean am schnellsten gesunken, insbesondere in den zentralen äquatorialen Regionen, die jetzt etwa 1°C unter dem Durchschnitt für diese Jahreszeit liegen.

Die NOAA stellte fest, dass das Jahr mit der stärksten Erwärmung seit 1982 begann, was den raschen Übergang zur Kühle noch beeindruckender macht: „Noch nie zuvor hat der östliche Äquatorialatlantik so schnell von einem Extremereignis zum anderen gewechselt“, schrieb die Behörde in einem aktuellen Bericht.

Die Abkühlung des Atlantiks ist zum Teil auf einen saisonalen Prozess zurückzuführen, den so genannten Auftrieb, bei dem kälteres, tieferes Wasser an die Oberfläche steigt, wenn Südwinde wärmeres Oberflächenwasser vom Äquator wegdrücken. Allerdings fiel der Auftrieb in dieser Saison mit einem Ereignis zusammen, das normalerweise zu wärmeren Anomalien führt, nämlich der Abschwächung der Passatwinde, was das Rätsel noch größer macht.

Wie bereits erwähnt, ist die starke Abkühlung nicht auf den Atlantik beschränkt:

Im Pazifik hat sich ein starkes El-Niño-Ereignis verflüchtigt, das den Ozean auf natürliche Weise erwärmt und die globalen Wettermuster beeinflusst, und die im vergangenen Jahr verzeichneten hohen SST-Anomalien sind stark zurückgegangen.

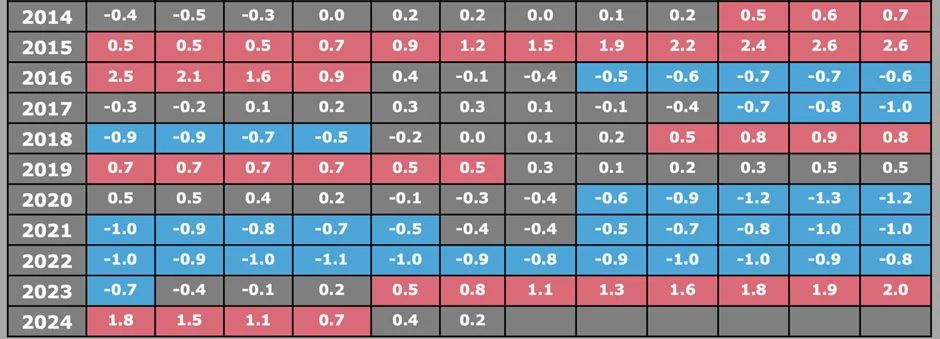

Die neuesten Zahlen der NOAA zeigen eine rollierende Drei-Monats-Anomalie von nur 0,2 °C für Mai, Juni und Juli 2024:

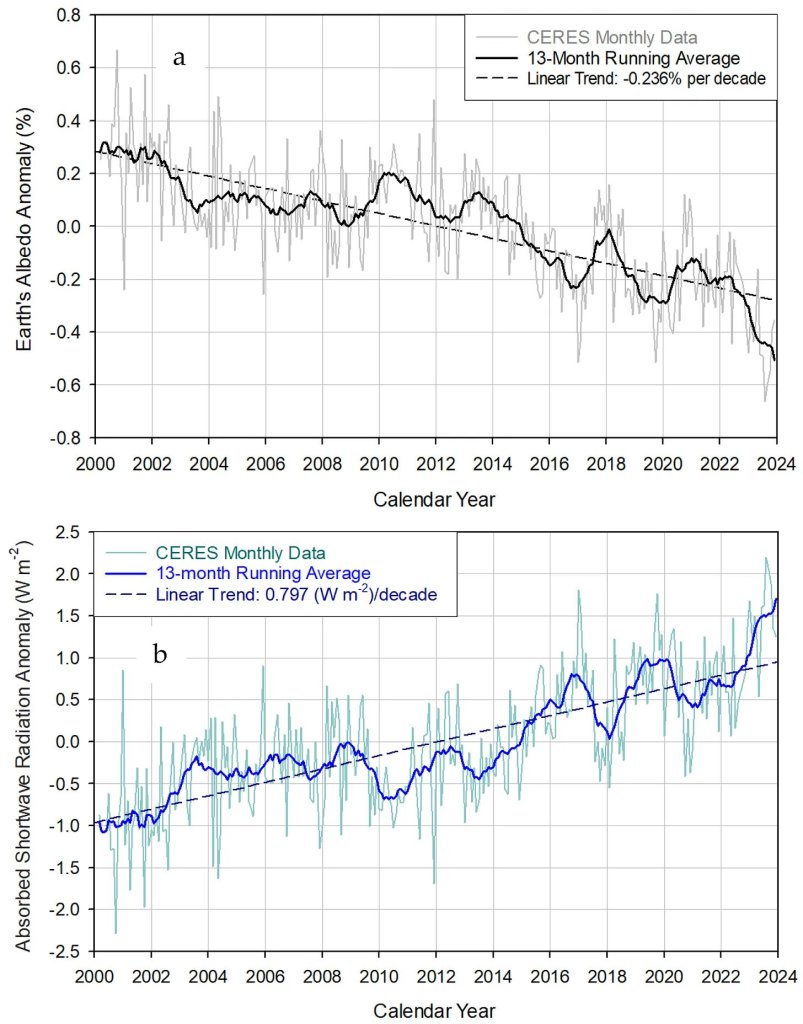

Die NOAA berichtet, dass die SST-Werte in drei der vier Pazifikregionen, die zur Bestimmung des Vorhandenseins eines El Niño herangezogen werden, nun wieder unter dem historischen Trend liegen. Darüber hinaus sind die Temperaturen in vielen Teilen des Pazifiks deutlich bis in 300 Meter Tiefe gesunken, was auf eine breitere Abkühlung hindeutet. Außerdem zeigen die NOAA-Daten, dass in den letzten 25 Jahren alle signifikanten globalen Temperaturspitzen mit starken El-Niño-Ereignissen zusammenfielen, nämlich 1998, 2016 und jetzt 2024. Die Spitzen sind natürlichen Ursprungs, ebenso wie die darauf folgenden Abkühlungsphasen. Die in den letzten Jahrzehnten beobachtete leichte Erwärmung ist natürlich, ebenso wie die darauf folgende Abkühlung. Werden die KALTEN ZEITEN im Jahr 2030 beginnen, wie ich behaupte? Das hängt allein von der Sonne und anderen kosmologischen Kräften ab, nicht von mir und nicht von Herrn Mann.

Die heutige wissenschaftliche Gemeinschaft ist durch Politik, Agenden und Ideologien völlig korrumpiert worden. Sie ist wirklich nicht der Ort für ehrliche Untersuchungen und Debatten. Ihre offensichtliche Verwirrung über die jüngste rasche Abkühlung ist bezeichnend. Ihr Schweigen ist ohrenbetäubend. Wenn die Temperaturen steigen, ist die Erklärung einfach. Wenn die Temperaturen sinken, verkriechen sich die Wissenschaftler wieder in die Hecke. Diese Diskrepanz, diese Verwirrung, ist auf die Grenzen der derzeitigen Modelle zurückzuführen, die der chaotischen und nichtlinearen Natur des Klimasystems nicht Rechnung tragen. Das macht sie jedes Mal fertig.

Link: https://electroverse.substack.com/p/rare-august-snow-clips-montanas-peaks?utm_campaign=email-post&r=320l0n&utm_source=substack&utm_medium=email (Zahlschranke)

Übersetzt von Christian Freuer für das EIKE