Falsch, Washington Post, Hitze macht den „Juni nicht zum neuen Juli“

In ihrem jüngsten Artikel „June is the new July: Why intense summer heat is arriving earlier“ behauptet die Washington Post (WaPo), dass „die Hitzewellen, die in den letzten Tagen über Kanada, die USA und Nordeuropa gezogen sind, Teil eines gefährlichen neuen Klimamusters sind.“ Diese Behauptung ist falsch oder bestenfalls irreführend. Die Daten zeigen keinen signifikanten Trend zu früheren oder intensiveren Hitzewellen auf globaler Ebene. Es gibt Anhaltspunkte dafür, dass ein Großteil der wahrgenommenen Zunahme der Hitze in den frühen Jahreszeiten auf den UHI-Effekt (Urban Heat Island) und Fehlinterpretationen regionaler Schwankungen zurückzuführen ist und nicht auf eine alarmierende globale Veränderung.

„Die Hitzewellen, die in den letzten Tagen über Kanada, den Nordosten der Vereinigten Staaten und Nordeuropa gezogen sind, haben eines gemeinsam: Sie treten recht früh in der Saison auf“, schreibt WaPo und fährt fort: „Dieses Timing spricht für einen umfassenderen Trend, der mit dem vom Menschen verursachten Klimawandel zusammenhängt: Die zehn wärmsten Jahre, die jemals aufgezeichnet wurden, fielen alle in das letzte Jahrzehnt.“

Eines der kritischsten Versäumnisse in dem WaPo-Artikel ist, dass er die Rolle des Urban Heat Island (UHI)-Effekts bei den aufgezeichneten Temperaturen und Trends ignoriert. Der UHI-Effekt ist ein gut dokumentiertes Phänomen, bei dem in Städten aufgrund der konzentrierten Infrastruktur, des Asphalts und der menschlichen Aktivitäten deutlich höhere Temperaturen gemessen werden als in der ländlichen Umgebung, was zu einer Verzerrung der gemessenen Temperaturwerte und Durchschnittswerte führt. Mit der Ausdehnung der Städte reflektieren die zur Temperaturmessung verwendeten lokalen Thermometer zunehmend die städtische Erwärmung und nicht die globalen Trends.

Studien haben gezeigt, dass der UHI die offensichtlichen Erwärmungstrends übertreibt, insbesondere in dicht besiedelten Gebieten. Wenn Toronto, London und Paris rekordverdächtige Frühsommerhitze melden, müssen wir uns fragen, ob diese Aufzeichnungen den globalen Klimawandel zum Ausdruck bringen oder in erster Linie Artefakte der Temperaturmessung in zunehmend urbanisierten Gebieten sind.

Die NASA-Forschung erkennt dieses Problem an und weist darauf hin, dass städtische Gebiete mehrere Grad wärmer sein können als umliegende ländliche Regionen. Auch die von Roy Spencer, Ph.D., veröffentlichte Forschung zeigt, dass der von der NOAA und anderen Behörden verwendete Homogenisierungsprozess dazu neigt, die Erwärmung in den Städten mit der Erwärmung in den umliegenden ländlichen Gebieten zu überlagern und so die scheinbaren Erwärmungstrends künstlich zu verstärken. Dennoch ignorieren die Mainstream-Medien wie die WaPo routinemäßig die Auswirkungen des UHI auf die gemeldeten Temperaturtrends.

In dem Artikel werden Hitzewellen zu Beginn der Saison wiederholt als Beweis für ein „gefährliches neues Klimamuster“ angeführt. Jeder, der ein wenig Ahnung von Meteorologie hat, kann jedoch erklären, dass Wetterschwankungen schon immer dazu geführt haben, dass sommerliche Witterung von Jahr zu Jahr früher oder später beginnt. Das ist nicht neu, das ist normal.

Aus der meteorologischen Geschichte wissen wir, dass der Beginn der sommerlichen Bedingungen seit Jahrhunderten natürlichen Schwankungen unterliegt, die von Jetstream-Mustern, Ozeanschwankungen und anderen großräumigen globalen und regionalen atmosphärischen Faktoren beeinflusst werden. In manchen Jahren scheint der Sommer früh zu kommen, in anderen Jahren kommt er zu spät. Es gibt keinen konsistenten, nachweisbaren Trend, der auf frühere globale Sommer hindeutet. Das Problem besteht darin, dass die WaPo aus einer Handvoll jüngerer Jahre einen gefährlichen Trend extrapoliert, der im Wesentlichen auf einem verrauschten Datensatz beruht und der einen kurzen Zeitraum abdeckt.

Zur weiteren Untermauerung ihrer alarmierenden These, dass die Sommerhitze früher einsetzt und länger anhält, zitiert die WaPo die Behauptung des Climate Change Institute (CCI) der University of Maine, dass die Durchschnittstemperatur der nördlichen Hemisphäre in den letzten Jahren 21°C viel früher überschritten hat als im Zeitraum von 1979 bis 2000. Was WaPo und CCI jedoch ignorieren, sind die Satellitendaten, die weit weniger von UHI beeinflusst werden und eine zuverlässigere globale Messung bieten. Die Satellitenaufzeichnungen haben eine deutlich geringere Erwärmung und kleinere Erwärmungstrends gemessen. Die Satellitendaten der UAH (University of Alabama in Huntsville) zeigen, dass die Behauptung von der „Rekordhitze“ global gesehen einfach nicht stimmt.

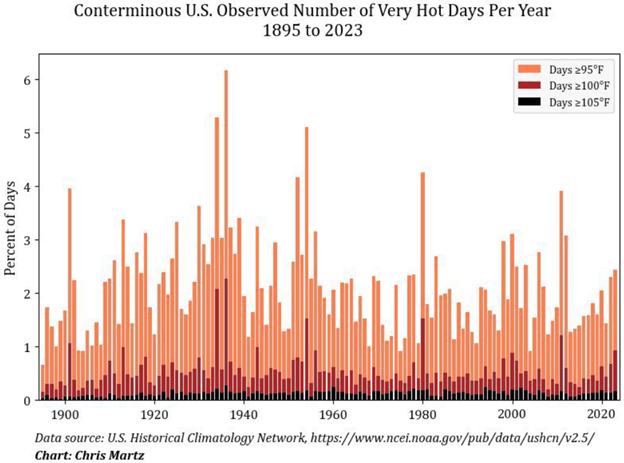

WaPo wiederholt auch die Behauptung der US-Umweltschutzbehörde (EPA), dass Hitzewellen in den letzten sieben Jahrzehnten „länger, häufiger und intensiver geworden sind“. Die Behauptungen der EPA werden jedoch durch die eigenen Daten der Regierung widerlegt. Die Daten des National Centers for Environmental Information zeigen, dass in den 1930er Jahren, insbesondere während der Dust Bowl, einige der schlimmsten Hitzewellen in der Geschichte der USA auftraten, die noch heftiger und extremer waren als die gegenwärtigen.

Climate at a Glance: U.S. Heatwaves (hier) präsentiert historische Daten der National Oceanic and Atmospheric Administration (NOAA), aus denen hervorgeht, dass Hitzewellen in den 1930er Jahren weitaus schlimmer waren als heute. Die Anzahl der Tage mit Temperaturen über 35°C in den 1930er Jahren übertrifft alles, was in den letzten Jahrzehnten beobachtet worden ist, wie in Abbildung 1 unten zu sehen ist:

Abbildung 1. Jährliche durchschnittliche Anzahl von Tagen mit einer Tageshöchsttemperatur ≥35°C, ≥37,8°C und ≥40°C* an 828 NOAA-USHCN-Stationen mit mindestens 100 Jahren täglicher Temperaturmessung zwischen 1895 und 2023. Grafik von Chris Martz aus NOAA-Daten von hier.

[Grad Fahrenheit: 95°, 100° und 105°. Die USA wollen sich einfach nicht umgewöhnen. A. d. Übers.]

So wurde beispielsweise der bisherige Temperaturrekord in Nordamerika – 57°C im Death Valley – im Jahr 1913 aufgestellt, also lange vor dem industriellen CO₂-Anstieg, den die WaPo für die aktuellen Hitzeperioden verantwortlich macht. Tatsächlich war die Häufigkeit von Hitzewellen in der Mitte des 20. Jahrhunderts deutlich höher als heute, wenn man nicht adjustierte, rein ländliche Temperaturaufzeichnungen betrachtet. Die Daten zeigen, dass in dem einzigen Jahrzehnt der 1930er Jahre mehr staatliche Hitzerekorde aufgestellt wurden (23) als alle Rekorde, die in den 55 Jahren seit 1970 aufgestellt oder gebrochen wurden (16), ganz zu schweigen von den sechs Rekorden, die seit dem Jahr 2000 aufgestellt oder gebrochen wurden, also während der angeblich wärmsten zweieinhalb Jahrzehnte seit Beginn der Aufzeichnungen.

Der Artikel führt unweigerlich die Waldbrände in Griechenland und die frühe Gletscherschmelze in den Schweizer Alpen an, als ob diese lokalen Ereignisse ein Beweis für eine planetarische Verschiebung wären. Wie jedoch bei Climate Realism dokumentiert werden Waldbrände stark von forstwirtschaftlichen Aktivitäten, menschlichen Zündquellen und kurzfristigen Wettermustern beeinflusst, weit mehr als von irgendwelchen bescheidenen Veränderungen der globalen Temperatur.

Auch die Gletscherschmelze ist ein komplexer Prozess, der von der Schneeansammlung, der Staubablagerung und sogar von lokalem Ruß aus Fahrzeugen und der Industrie beeinflusst wird. Die pauschale Zuschreibung an die CO₂-Emissionen als Ursache ist eine grobe Vereinfachung, die diese kritischen lokalen Variablen außer Acht lässt.

Diese Geschichte ist ein weiteres Beispiel dafür, dass die WaPo ihre Hausaufgaben nicht gemacht hat, während sie aggressiv das Klimaalarm-Narrativ vorantreibt. Anstatt den gut dokumentierten Einfluss von UHI, natürliche Wetterschwankungen und die Fehler in den Klimamodellprojektionen zu untersuchen, erweist die WaPo ihren Lesern wieder einmal einen Bärendienst, indem sie zu einer unsachgemäßen Berichterstattung übergeht, die davon ausgeht, dass alle Wärme anthropogen ist und dass jede Abweichung von einem willkürlichen Durchschnitt des 20. Jahrhunderts ein Grund zur Panik ist. Diese Art der sensationslüsternen Berichterstattung wurde bereits hier sowie hier und hier angeprangert, doch sie bleibt bestehen, vielleicht weil sich Angst gut verkauft.

Solange Medien wie die Washington Post der Klima-Panikmache Vorrang vor glaubwürdiger Wissenschaft einräumen, werden sie das Vertrauen der Öffentlichkeit weiter untergraben. Das ist der wirkliche gefährliche Trend hier.

Link: https://climaterealism.com/2025/07/false-washington-post-heat-isnt-making-june-the-new-july/

Übersetzt von Christian Freuer für das EIKE