Sommermythen zum Sommerausklang – einfach entzaubert

Nach den heiligen Lehren und meist unsinnigen Apokalypsen der Klima-Alarmisten von IPCC, PIK & Co. sollen die Sommer in Deutschland ja immer trockener werden. Der 2017er Sommer spielte da aber nicht mit- wer sich auf Wanderschaft begab, brauchte eher Gummistiefel als Sandalen. (Siehe Pressemitteilung des DWD vom 31.07.2017 http://www.dwd.de/DE/presse/presseseite_node.html;jsessionid=7E831BC8E375A6DAE9208FE674595E82.live21064). Allein der Juli 2017 gehörte zu den 10 niederschlagsreichsten Monaten seit 1881. Und da die Jahresniederschläge seit 1881 laut DWD in Deutschland um 11% zugenommen haben, kann es nicht am fehlenden Regen liegen, wenn die Waldböden laut Forstämtern immer trockener werden.

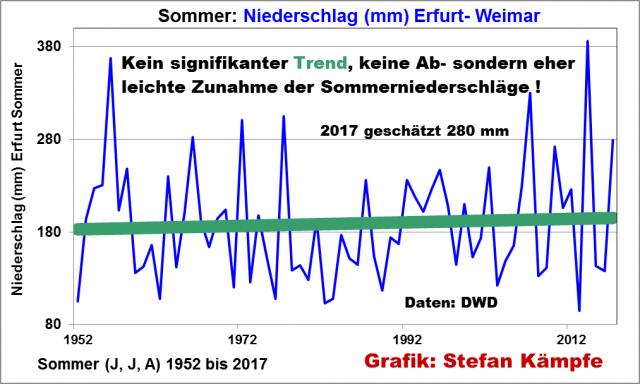

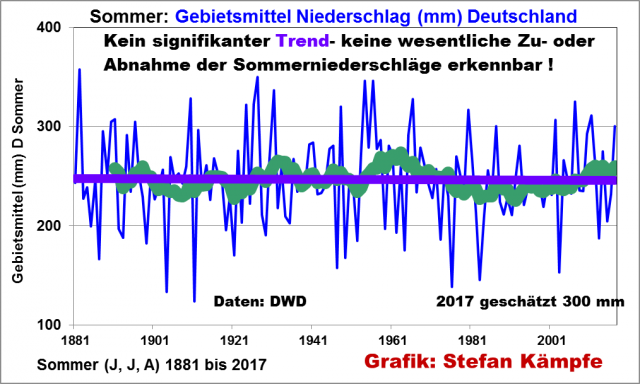

Insgesamt sind im Deutschland- Mittel in diesem Sommer etwa 300mm Regen gefallen; deutlich mehr als das Langfrist-Mittel (1881 bis 2016) von 246mm, aber keinesfalls rekordverdächtig viel. Niederschläge schwanken ohnehin langfristig stark; ein Langzeittrend zu mehr Trockenheit in den drei Sommermonaten ist nicht erkennbar, während die Winterniederschläge (hier nicht gezeigt) eindeutig zugenommen haben:

Abb. 2: Die Sommer weigern sich bislang beharrlich, den Prognosen von IPCC, PIK & Co. zu gehorchen – sie werden einfach nicht trockener.

Aber vielleicht wird es ja wenigstens in den Trockengebieten Deutschlands im Sommer trockener? Die Station Erfurt-Weimar, am Südrand des Thüringer Beckens, liegt im Lee der Mittelgebirge im Mitteldeutschen Trockengebiet. Hier wird leider erst seit 1952 gemessen; seitdem erhöhten sich die Sommerniederschläge unwesentlich:

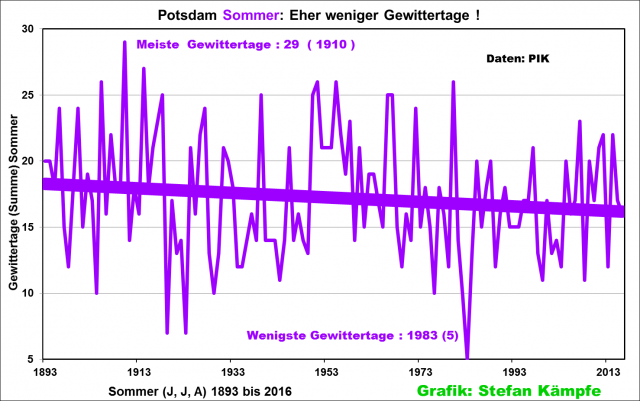

Vom Niederschlag ist es nicht weit zu den „Unwettern, die immer häufiger werden“. Eine exakte Definition, was ein „Unwetter“ ist, gibt es nicht- das hängt sehr stark von den geografischen und gesellschaftlichen Faktoren ab. Mittlerweile wird ja jede Mure, jeder Starkregen, jedes Hagelkorn und jede Gewitterböe medial als Menetekel des Klimawandels gedeutet. Einen groben Anhaltspunkt, ob es mehr Unwetter gibt; liefert die Anzahl der sommerlichen Gewittertage. Sie wird in Potsdam seit 1893 beobachtet; wobei freilich jedes harmlose Grummeln und jedes Unwetter gleichrangig erfasst werden:

Abb. 4: Seit 1893 nahm die Anzahl der sommerlichen Gewittertage in Potsdam etwas ab. 2017 (noch nicht enthalten) wies bis Ende Juli 14 Gewittertage auf, und der August war auch nicht extrem gewitterreich, so dass höchstens um die 20 Tage zu erwarten sind.

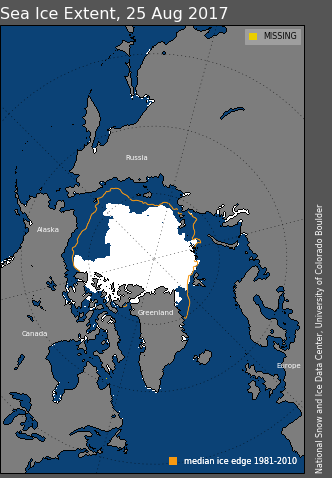

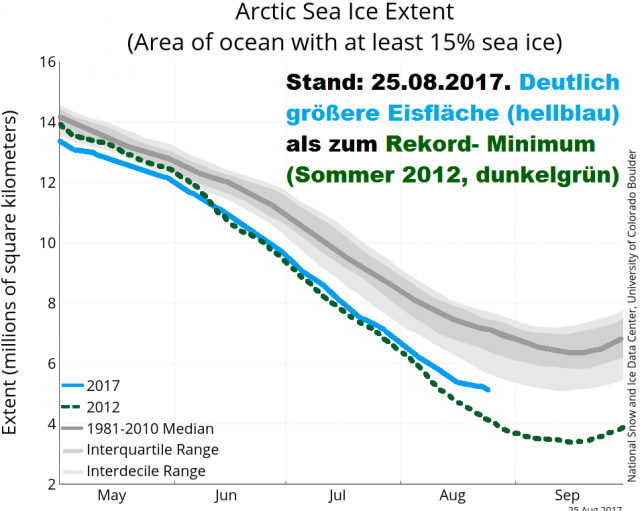

Aber wenn es schon nicht trockener und auch nicht unwetterreicher im deutschen Sommer zugeht- vielleicht ist ja mittlerweile wenigstens das sommerliche Meereis in der Arktis verschwunden? Der gut verdienende Chef- Katastrophist und Märchenerzähler Al Gore hatte sein Verschwinden schon für die Mitte des Jahres 2013 vorhergesagt http://info.kopp-verlag.de/hintergruende/enthuellungen/alex-newman/al-gore-sagte-voraus-2-13-sei-die-arktis-voellig-eisfrei-stattdessen-ist-die-eisschicht-um-die-ha.html. Ein Blick auf den Nordpol 2017 zeigt jedoch- das sommerliche Meereis ist auch Ende August 2017 noch da, und zwar mit über 5 Millionen Km² deutlich mehr, als zum bisherigen Rekord- Minimum 2012:

Abb. 5 und 6: Auch das arktische Meereis trotzt den Vorhersagen und verschwindet nicht. Am 25. August 2017 war das Seegebiet rund um den Nordpol mit Eis bedeckt (obere Abb. 5). Noch im Frühsommer sah Vieles wenigstens nach einem neuen Minimum-Rekord aus; doch im Hochsommer schmolz weniger Eisfläche ab (blaue Kurve); der Rekord von 2012 (dunkelgrün) wurde zum Stand am 25.08.2017 nicht annähernd erreicht, und das Ende der sommerlichen Schmelze steht kurz bevor (untere Abb. 6.). Bildquelle http://nsidc.org/arcticseaicenews/, ergänzt von Stefan Kämpfe

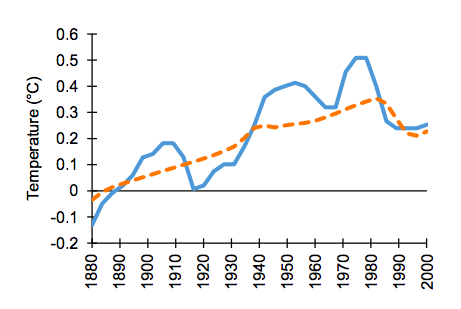

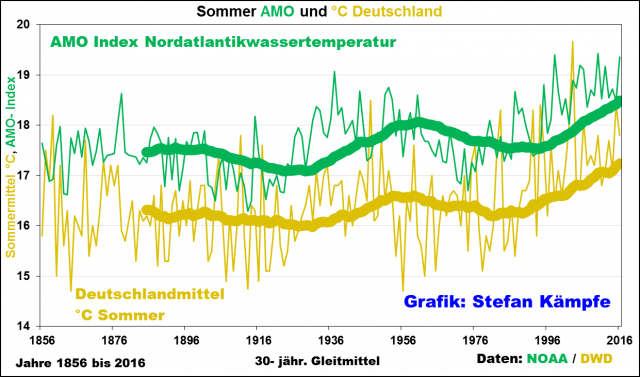

Zur kurz- und langfristigen Arktiseisentwicklung ist auch dieser aktuelle EIKE- Beitrag interessant https://eike.institute/2017/08/22/was-wissen-wir-ueber-die-trends-des-arktischen-meereises/. Um den Alarmisten aber wenigstens ein kleines Erfolgserlebnis zu gönnen, wollen wir nicht unerwähnt lassen, dass die sommerlichen Lufttemperaturen Deutschlands seit Beginn der Aufzeichnungen leicht gestiegen sind, wobei es bislang jedoch immer noch keinen wissenschaftlichen Versuchsnachweis gibt, dass dieser Temperaturanstieg durch CO2 bewirkt wurde:

Abb. 7: Im Gleichklang mit der AMO (grün) wurden die Sommer in Deutschland wärmer. Diese eher angenehme Erwärmung muss freilich nicht ewig andauern- Klimawandel ist keine Einbahnstraße. Schon einmal, nämlich zwischen den 1950er und den 1980er Jahren, wurden die Sommer kühler, obwohl auch damals schon die CO2- Konzentrationen merklich anstiegen.

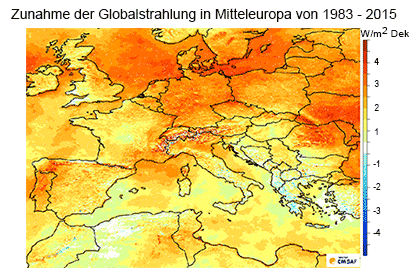

Auch der Sommer 2017 war trotz seiner Unbeständigkeit mit etwa 17,9 °C (DWD- Mittel) etwas zu warm, auch gemessen am CLINO- Wert 1981 bis 2010, der 17,1°C beträgt. Doch ehe jetzt wieder vorschnell der „CO2- bedingte Klimawandel“ dafür verantwortlich gemacht wird, lohnt ein Blick auf drei weitere, wesentliche Ursachen der sommerlichen Erwärmung. Selbst der DWD gab unlängst auf seiner Startseite zu, dass die Globalstrahlung (im Wesentlichen direkte Sonnenstrahlung plus diffuse Einstrahlung) zunahm:

Abb. 8: Zunehmende Globalstrahlung seit 1983, das bedeutet mehr erwärmende Energie von Sonne und Himmel (je mehr die Farben ins Rote gehen, desto stärker war die Zunahme). Quelle: DWD

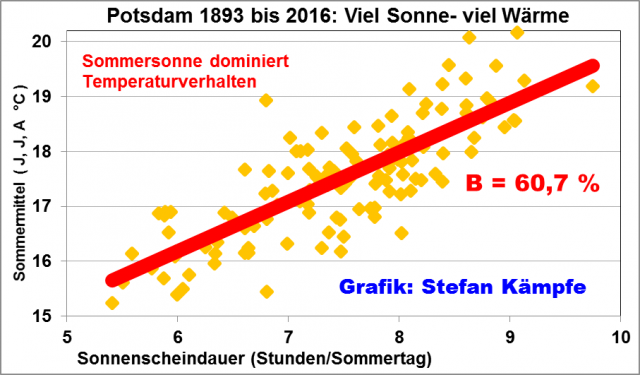

Besonders von April bis September wirkt eine Strahlungszunahme stark erwärmend. Nur die Sonnenscheindauer ist jedoch über viele Jahrzehnte an wenigen Stationen lückenlos aufgezeichnet; in Potsdam immerhin seit 1893. Das entsprechende Streudiagramm zwischen mittlerer Sonnenscheindauer je Sommertag und Sommertemperaturen zeigt eindeutig, wer im meteorologischen Sommer die meiste Wärme erzeugt- die Sonne nämlich:

Abb. 9: Mit einem Bestimmtheitsmaß von gut 60% ist der Zusammenhang zwischen Sonnenscheindauer und Lufttemperaturen im Sommer hoch signifikant. Scheint die Sonne länger als üblich, ist es wärmer.

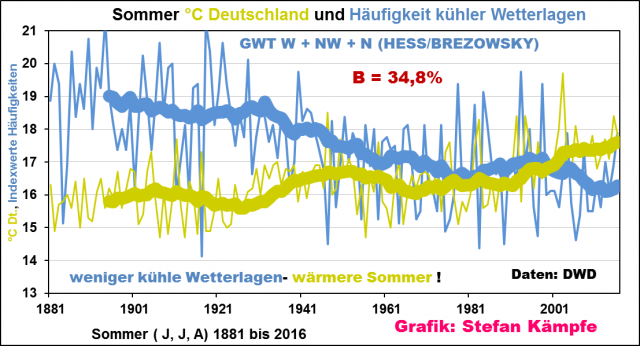

Über die Gründe der verstärkten Insolation kann man nur spekulieren. Neben den Luftreinhaltemaßnahmen, welche ab den späten 1980er Jahren die Luft über Deutschland klarer und ärmer an tiefen Wolken machten, kommen auch weitere Ursachen wie die starke Sonnenaktivität oder die Austrocknung der Landschaft durch Melioration und Versiegelung in Betracht. Weiterhin lohnt ein Blick auf die Häufigkeitsverhältnisse der Großwetterlagen, denn kühlende West-, Nordwest- und Nordlagen wurden seit 1881 deutlich seltener; was immerhin fast 35 % der sommerlichen Temperaturvarianz erklärt:

Abb. 10: Weniger Wetter aus der „kühlen“ Ecke von West bis Nord; auch dieser Zusammenhang ist signifikant, allerdings mit negativem Korrelationskoeffizienten von -0,59 entsprechend B = 34,8%.

Und als dritter Erwärmungsfaktor sind die verschiedensten Wärmeinseleffekte (WI) zu nennen. Sie könnten auch mit zu der höheren Sonnenscheindauer beigetragen haben.

Der zunehmende sommerliche Wärmeinseleffekt dürfte mit eine der Hauptursachen für die steigenden Sommertemperaturen sein.

In den letzten 150 Jahren haben sich Deutschland und viele andere Länder wesentlich verändert, so stark wie nie zuvor in der Menschheitsgeschichte. Und alle Veränderungen führten zu Erwärmungen just dort, wo die Oberfläche der Erde durch Städteerweiterungen, Trockenlegungen und Bebauungen verändert wurde. Diese Landschaftsbetonierungen und Trockenlegungen setzen sich täglich fort, in Deutschland innerhalb und außerhalb der Gemeinden in der Summe mit etwa 100 ha täglich. Wo zuvor kühlende Vegetation und feuchter Boden die Sonnenwärme dämpften, heizen sich heute Beton, Asphalt, Mauern und Dächer tagsüber auf und geben nachts die gespeicherte Wärme wieder ab. Auch die wie Pilze aus dem Boden geschossenen Wind- und Solarparks wirken erwärmend. Zudem sind in den Großstädten die Frischluftschneisen immer mehr verbaut, die eh sich verringernde kühlende Frischluftzufuhr erreicht das Zentrum der Städte nicht mehr und verliert sich in den Außenbezirken. Siehe https://youtu.be/mox5tHQDXt8 .Der ganze Artikel dazu ist abrufbar unter: https://eike.institute/2017/08/03/waermeinsel-und-stadtklimaeffekte-als-erwaermungsverursacher-teil-1-hoehe-des-stadt-stadtrandeffektes-von-zuerich/

Da die Messstationen bevorzugt dort aufgestellt sind, wo der Mensch lebt und arbeitet, nämlich in den Wärmeinseln, hat die Zunahme der Wärmeinseleffekte natürlich einen erheblichen Anteil an den gemessenen Temperaturen.

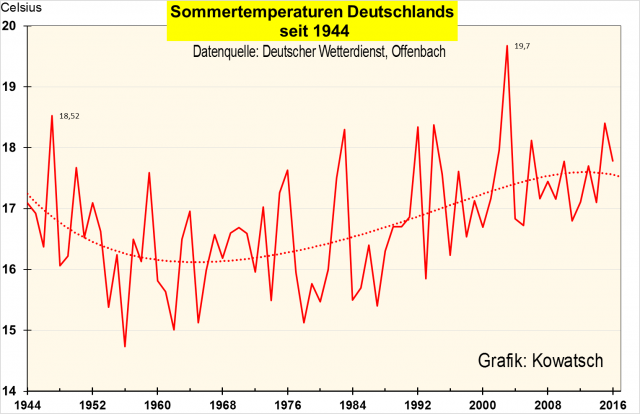

Betrachten wir zunächst die Sommertemperaturen Deutschlands aus der Zeit der bitteren Armut nach dem Kriegsende bis heute.

Abb. 11: Die drei Sommermonate wurden in Deutschland nach Kriegsende zunächst kälter, die erneute Erwärmung setzte dann begünstigt durch den Wiederaufbau und den steigenden Wohlstand mitsamt Energieverbrauch nach 1965 wieder ein, wobei sich ein neues Plateau andeutet. Auch die Sommererwärmung ist trotz weiterer Zunahme der Wärmeinseln in den beiden letzten Jahrzehnten zu einem Ende gekommen, weil möglicherweise Sonnenscheindauer und wärmende Großwetterlagen nicht andauernd zunehmen können.

Wir stellen uns deshalb wieder die Frage: Wie sähe die Temperaturentwicklung der drei Sommermonate ohne den Wärmeinseleffekt bei den Messstationen aus?

Um diese Frage annähernd zu beantworten, gibt es zwei Näherungsmöglichkeiten.

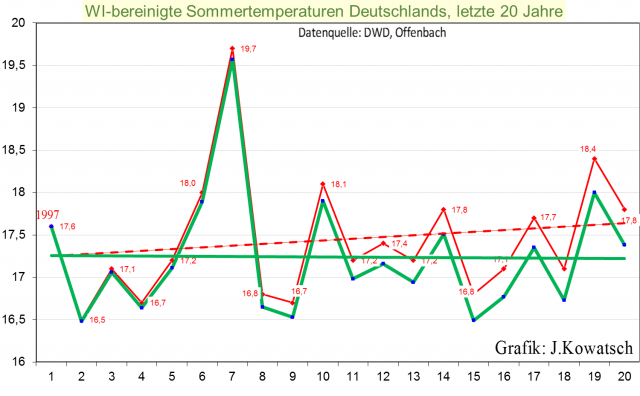

- WI-Korrekturwert: Wir rechnen nach der Methode von Raimund Leistenschneider die WI- Effekt-Erwärmung aus den Daten raus. In den letzten 20 Jahren ergibt sich folgendes Bild.

Abb. 12a: WI-bereinigte Sommertemperaturen Deutschlands in der Gegenwart. Beide Trendlinien zeigen fast Stagnation, wobei die grüne WI-bereinigte bereits eine Abkühlung der Sommermonate in Deutschland andeutet.

- Ländliche Stationen

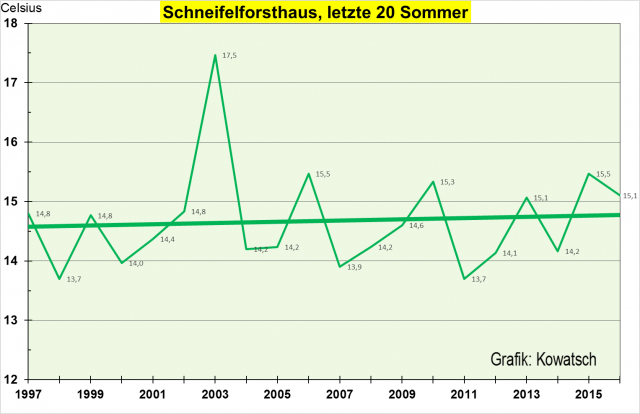

Es gibt in Deutschland natürlich auch Landschaften mit Messstationen, die sich in der Gegenwart weniger wärmend verändert haben. Interessant ist deren Entwicklung der Sommertemperaturen. Beispiel: Schneifelforsthaus an der belgischen Grenze, die Station liegt an der Kreuzung zweier Schnellstraßen, aber sonst in einer ländlichen Umgebung der Eifel:

Abb. 12b: Kaum steigende Sommertemperaturen auf dem Lande, hier Schneifelforsthaus, seit 20 Jahren. Der Trendlinienverlauf unterscheidet sich nicht stark vom Verlauf der WI-bereinigten Deutschlandkurve in Grafik 12a.

Längere Zeitreihen

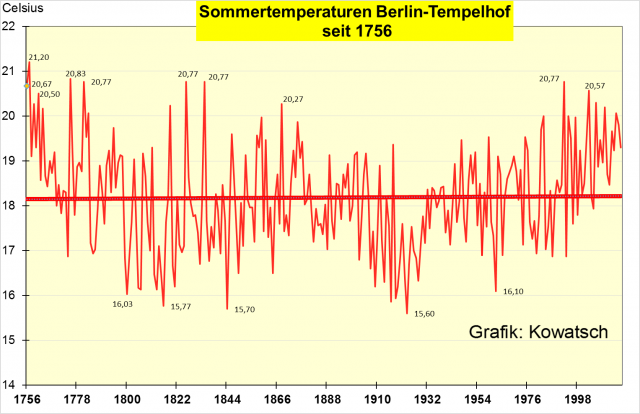

Nur wenige deutsche Stationen gehen weit zurück. Eine davon wäre die Station Berlin-Tempelhof, die allerdings ab 1930 am rasanten Aufstieg des Teilortes mit dem Flughafenbau profitiert hat. Das sieht man auch an der Langzeitkurve. Wir beginnen mit der Reihe ab 1756, weil die 50 Jahre davor als nicht zuverlässig gelten können. Man beobachte auch, 1756 wurde Mozart geboren, Goethe kurz zuvor.

Abb. 13: Keine Sommererwärmung an der Messstation Tempelhof über die letzten 262 Jahre. Die Sommer waren zeitweise wärmer oder kälter als heute. Seit 25 Jahren werden sehr heiße und sehr kühle Sommer gleichermaßen seltener; es dominieren mäßig warme. Der kälteste Sommer in Tempelhof war 1923, der wärmste 1757. Der heißeste Sommermonat war der August 1807, dem allerdings ein kühlerer Juni vorausging.

Die beiden Autoren hoffen, dass die drei Sommermonate auch in den nächsten Jahrzehnten auf dem jetzigen angenehmen Temperatur-Niveau bleiben werden; eine Garantie dafür gibt es nicht. Jedenfalls musste in den Städten 2017 an keinem einzigen Sommertag die Heizung in Betrieb genommen werden.

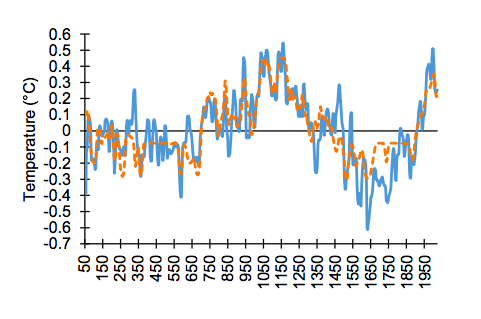

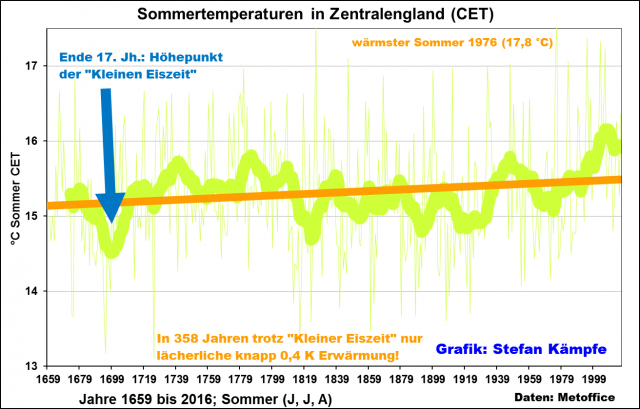

Schauen wir am Ende unserer Betrachtungen über Sommer- Mythen noch nach Zentralengland, wo seit 1659 halbwegs verlässliche Temperaturaufzeichnungen vorliegen und ziemlich am Anfang der Reihe der Höhepunkt der „Kleinen Eiszeit“, die kälteste Phase der letzten gut 1.000 Jahre (vermutlich sogar die kälteste des ganzen Holozäns), mit erfasst wird. Der seitdem erfolgte sommerliche Temperaturanstieg ist mit knapp 0,4K (entspricht 0,4 °C) bescheiden und keinesfalls besorgniserregend:

Abb.14: Über dreieinhalb Jahrhunderte erwärmte sich der Sommer in Zentralengland nur geringfügig. Die gegenwärtige Warmphase scheint dort zu enden; und der absolut wärmste Sommer dieser Reihe (1976) liegt nun auch schon 40 Jahre zurück (der 2017er Sommer fehlt hier noch; er wird mit etwa 16,3°C nicht auffallend warm werden).

Der 2017er Sommer mag so manchen Urlauber, Gärtner und Landwirt wegen seiner Kapriolen genervt haben- doch er war besser als sein Ruf. Es war also ein nur etwas zu warmer, typisch deutscher, wechselhafter Sommer, welcher oft dem Landwirt die Ernte verregnete und dem Eismann die Kundschaft vergraulte, doch es gab auch sonnige Momente und schöne, warme Tage. Von Tag zu Tag, aber auch innerhalb eines Tages, wechselten Witterung und Temperaturniveau häufig abrupt. Manchmal stand man morgens bei Regen auf und suchte Schirm und Jacke- da schien schon wieder die Sonne. Viele Kurzfristprognosen waren deshalb mangelhaft. So wurde für das vierte Juli- Wochenende viel Bewölkung und häufiger Regen in Thüringen erwartet; tatsächlich schien außer kurzen Schauern bei viel Wind oft die Sonne bei warmen Temperaturen. Unangenehm war jedoch die häufige Schwüle. Trotzdem gab besonders im Juni und teilweise im August auch reichlich Sonnenschein. Und wie es momentan aussieht, könnte auch der September noch ein paar Spätsommertage bringen. Den Wildpflanzen bekam die wechselhafte, feucht- warme Witterung ausgezeichnet, so dass auch die Spätblüher auf den Steppenrasen Mitteldeutschlands teilweise reiche Aspekte bildeten:

Abb. 15: Reicher Blühaspekt der Goldhaar-Aster Ende August 2017 am Brembacher Weinberg nördlich von Weimar. In den Sommern 2015 und 2016 war der Steppenhang durch die häufigen Dürren Ende August braun; es blühten nur wenige Goldhaar- Astern. Phänologisch gehört dieser Blühaspekt bereits zum Übergang vom Früh- zum Vollherbst; Wildrosen, Weißdorne und Holunder sind nahezu vollreif. Foto: Stefan Kämpfe

Fazit: Die meisten Sommermythen gehören ins Reich der Fantasie. Weder wurden die deutschen Sommer trockener oder unwetterträchtiger; Unwetter, die nicht einmal genau definiert sind, bilden nun leider einmal die unschöne Begleitmusik eines jeden Sommers. Auch das sommerliche Arktiseis verschwand bislang nicht. Die angenehme, leichte sommerliche Erwärmung der letzten etwa 35 Jahre ist keinesfalls ungewöhnlich und ganz ohne CO2- Mythos mit mehr Sonnenschein, weniger kühlenden Wetterlagen und Wärmeinseleffekten zu erklären. Seit dem späten 17. Jahrhundert gab es schon öfters Phasen mit tendenziell wärmeren oder kälteren Sommern. Der 2017er Sommer war besser als sein Ruf; trotz häufiger Niederschläge war er weder zu kalt, noch extrem sonnenscheinarm oder extrem nass.

Stefan Kämpfe, Diplom- Agraringenieur, unabhängiger Natur- und Klimaforscher

Josef Kowatsch, Naturbeobachter, unabhängiger Natur- und Klimaforscher