Bild 1. Fortschritt: In den 20er Jahren kostete so ein kleiner „Volks-Flitzer“ 1995,- Mark, wog 320 kg und kam 500 km weit. Hypermoderne E-Mobile kosten heute bis zu 100.000,- €, wiegen 2.000+ kg und kommen realistisch gerechnet etwas mehr als 300-350 km weit

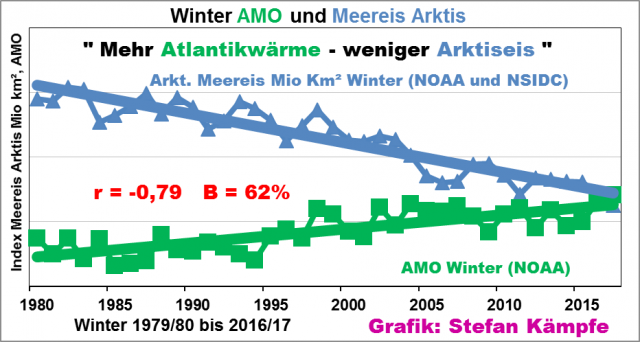

In den bisherigen Teilen dieses Aufsatzes wurde nachgewiesen, dass die NO

2-Belastung der Luft in ganz Deutschland und auch an den sogenannten „Hotspots“ in den Städten auf im Prinzip unbedeutende Werte zurückgegangen ist. Wichtiger Grund hierfür ist die stetige Ablösung älterer durch jüngere Fahrzeuge mit besseren Abgasbehandlungssystemen. Dieser Trend wird sich auch in den nächsten Jahren fortsetzen. Auch wurde aufgedeckt, wie fragwürdig die Messmethoden sind und welche Tricks und Manipulationen zum Einsatz kommen. Im dritten Teil wurden die teils grotesk übertriebenen Behauptungen über die gesundheitlichen Auswirkungen von Stickstoffdioxid sowie die offensichtliche Parteilichkeit sowohl der öffentlich-rechtlichen Medien als auch industriefeindlicher Behörden behandelt. Im vierten Teil wurde festgestellt, dass das Auto auch in der Stadt der Zukunft unverzichtbar bleibt und Elektromobilität zurzeit nicht realisierbar ist. Außerdem wurden Widersprüche in den Aussagen des Umweltbundesamtes beleuchtet und anrüchige Querverbindungen zwischen der Deutschen Umwelthilfe sowie Ministerien und Behörden thematisiert. Im fünften Teil wurde gezeigt, dass an der angeblichen Gesundheitsgefährdung selbst durch geringste NO

2-Konzentrationen nichts dran ist und die Horror-Stories über zigtausende Tote durch Dieselabgase nicht wissenschaftlich fundiert sind. Nicht wenige der Studien, die das behaupten, basieren sogar auf gefälschten Zahlenwerten. Im sechsten Teil wurden grobe Mängel bei den Studien der US-Umweltschutzbehörde EPA und der WHO dargelegt, mit denen behauptete Gesundheitsgefahren von Stickoxiden „belegt“ werden sollen. Im siebten Teil zeigte sich anhand von umfassenden Abgasuntersuchungen in bayrischen Großstädten, dass selbst an den „Brennpunkten“ des Abgasgeschehens keinerlei Gründe für Fahrverbote für Diesel-PKW vorliegen. Im jetzigen achten Teil wird darauf eingegangen, wie winzig die Bereiche nahe der wenigen Hauptstraßen sind, in denen es tatsächlich zu Überschreitungen von Grenzwerten kommt.

„

Das Auspuffrohr des Autos ist 25 Mal tödlicher als das Auto selbst“

Dies behauptete Jon McNeill, Teslas Verantwortlichem für den weltweiten Absatz, am 22. Dezember 2016 in einem

Interview mit Hongkongs TVB Pearl [

TSLA]. Würde man diese Aussage auf Deutschland mit seinen rund 3.500 Verkehrstoten (2015) umrechnen, so wären dies 87.500 Todesfälle durch Autoabgase. Diese groteske Zahl übertrifft selbst die Hetzparolen der DUH noch um fast eine Größenordnung. Sie zeigt vor allem eins: Was DUH und Konsorten bei uns treiben, passt nahtlos in die Marketingstrategie des einen oder anderen „fortschrittlichen“ Konzerns, insbesondere solcher aus den USA und Japan. Sie treibt nicht die Sorge um unsere Gesundheit um, sondern der dringende Wunsch, die zu Schmutzfinken deklarierten Wettbewerber vom Markt zu verdrängen. Umweltfrevel, welche für die Gewinnung der Rohstoffe für die tonnenschweren Batterien begangen werden, fallen ebenso aus der Betrachtung heraus wie die Tatsache, dass aufgrund des hohen Kohleanteils am elektrischen Strom die Emissionen lediglich verlagert werden und dann am Kraftwerksschornstein statt am Kfz-Auspuff entstehen. Mit dieser Schmutzkampagne waren insbesondere die Vertreter US-amerikanischer Interessen besonders erfolgreich. Über von ihnen beeinflusste Organisationen wie das US-Umweltministerium EPA sowie die WHO haben sie es geschafft, der EU und über diese auch Deutschland die absurd niedrigen NO

2-Grenzwerte aufzuschwätzen, mit deren Hilfe Politik und Medien gemeinsam versuchen, unserer Automobilindustrie den Garaus zu machen.

Die Mär von der flächendeckenden Vergiftung der Stadtluft

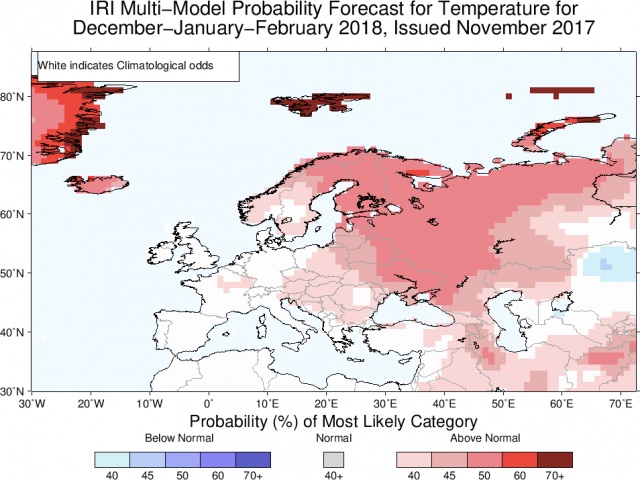

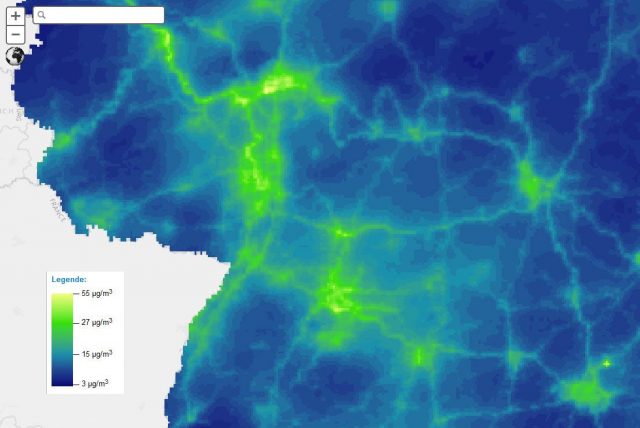

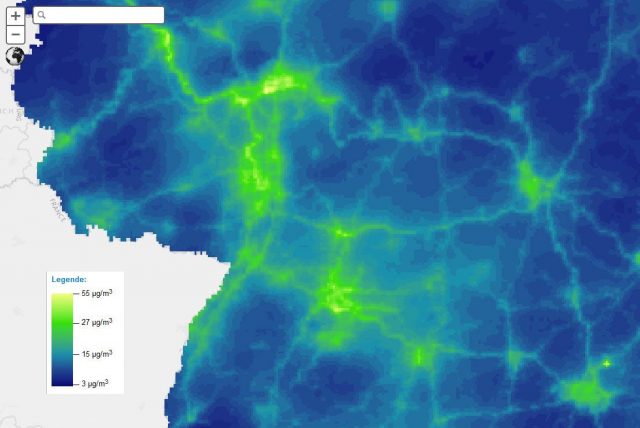

Bei so gut wie allen Meldungen in den Medien wird suggeriert, dass die „zu hohen“ Immissionswerte an einigen wenigen Messstationen einiger Großstädte gleichzusetzen wären mit der breit angelegten Vergiftung so gut wie aller Bewohner dieser Städte. Diese Kampagnen haben eine fatale Breitenwirkung: Zigtausendfach finden sich deshalb in Kommentarspalten und Blogs entsprechende Meinungen wie z.B.: „Fakt ist, daß diese Motoren leider auch schädliche Gase auspusten. An diesen Gasen verrecken allein in Deutschland jedes Jahr bis zu 15 000 Menschen (in Europa sind es rund 400 000). Die Frage lautet also: was verlierst Du lieber, wenn Du zwischen Deinem Arbeitsplatz und Deinem Leben wählen mußt?“ [BLOG]. Befeuert werden solche Meinungen hochamtlich u.a. durch farblich raffiniert gestaltete Grafikdarstellungen, wo die deutschen Ballungszentren von giftgrün-gelblichen Schleiern NO2 belasteter Luft überzogen erscheinen. Die Manipulation wird auch durch eine passende Legende unterstützt, aus der nicht erkennbar wird, wo die Grenzwerte verlaufen, Bild 2.

Bild 2. Angsterzeugend: In dieser UBA-Grafik überziehen großflächige NO2-Schleier in giftgrün-gelblichen Farbtönen die industriellen und städtischen Ballungszentren vom Rhein-Main-Gebiet über Stuttgart bis München (Grafik: UBA)

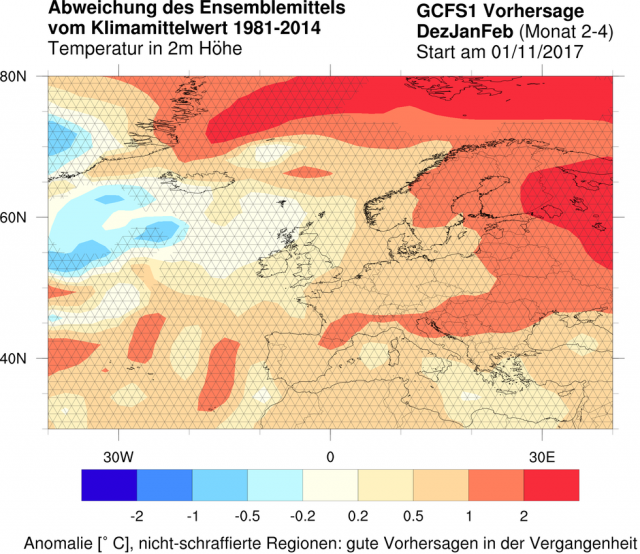

Derartiges Material wird dankbar von der Lückenpresse aufgegriffen und – erforderlichenfalls nach „kreativer Abwandlung“ – zur Angsterzeugung eingesetzt, wie das Beispiel eines Berichts im „SpiegelOnline“ [SPIE] mit dem Titel „Gesundheitsrisiko Stickoxid Wo Luft in Deutschland krank macht“ zeigt. Nach dem Titel geht es in der Einleitung im gleichen Tonfall weiter: „Im Herbst und Winter droht dicke Luft in Deutschlands Städten. Zwar gibt es weniger Feinstaub, doch die Stickoxid-Grenzwerte werden vielerorts überschritten. Der große Überblick”, gefolgt von einer erschreckenden Deutschland-Karte, die in satten roten und gelben Warnfarben geradezu glüht, Bild 3.

Bild 3. Fakten? Wer braucht schon Fakten, wenn man die gewünschte Botschaft viel einfacher durch Farben direkt am Verstand vorbei ins Unterbewusstsein transportieren kann (Grafik: [SPIE])

Zu diesem Bild gibt es weder Bildunterschrift noch Legende noch Quellenangabe, lediglich einen diskreten Vermerk „Bundesumweltamt“. Letzteres ist möglicherweise als Quellenangabe gedacht, nur gibt es dieses Amt in Deutschland nirgendwo, stattdessen ein Umweltbundesamt (UBA). So schlampig geht es dann auch gleich weiter, denn erst wenn man das Video aufruft, erfährt man, dass es um Feinstaub und nicht um Stickoxide geht, wie es die Überschrift ja eigentlich erwarten ließe. Ein weiterer Beweis für die Recherchequalität von Lückenpresse-Berichten zu Umweltthemen. Hauptsache, man hat den Lesern die rechte Stickoxid-Furcht eingejagt.

Das Fatale an solchen Darstellungen, die zigfach überall in den Medien kursieren, ist die hierdurch vermittelte optische Botschaft, die da lautet: Der gesundheitsschädliche Dreck ist überall in unseren Ballungsgebieten in der Luft, wir müssen dringend etwas dagegen unternehmen. Dabei sprechen die Tatsachen eine ganz andere Sprache.

Betroffen sind nur winzige Teilbereiche

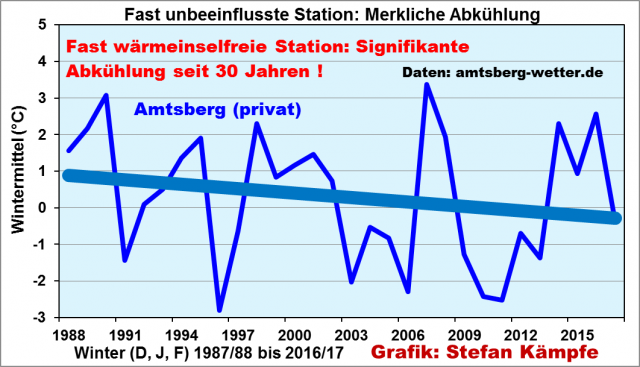

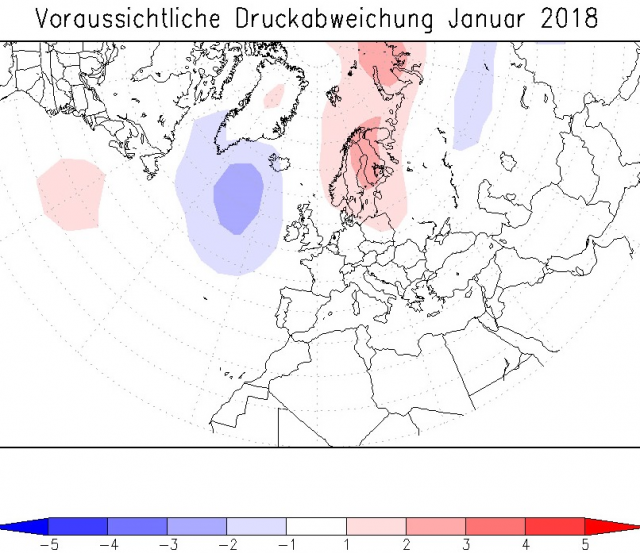

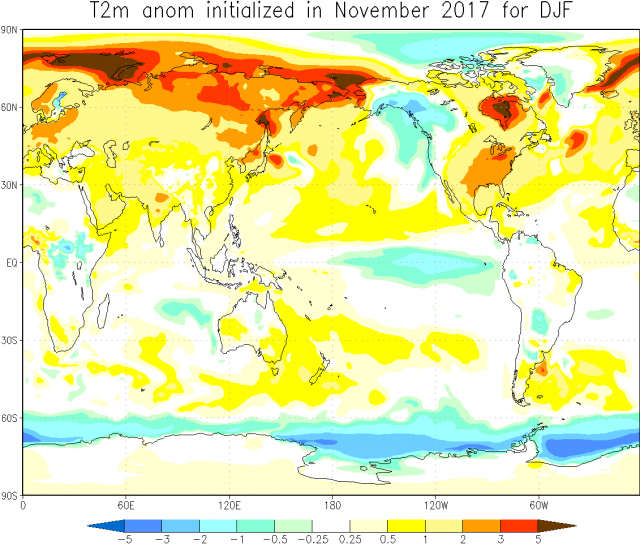

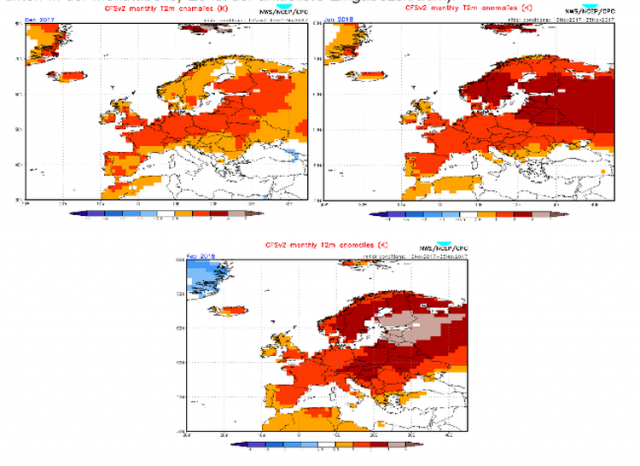

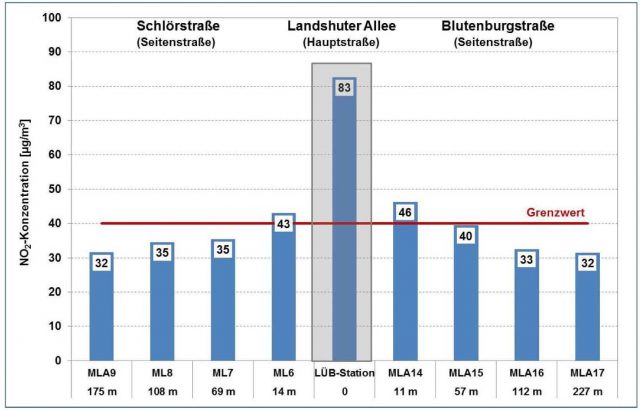

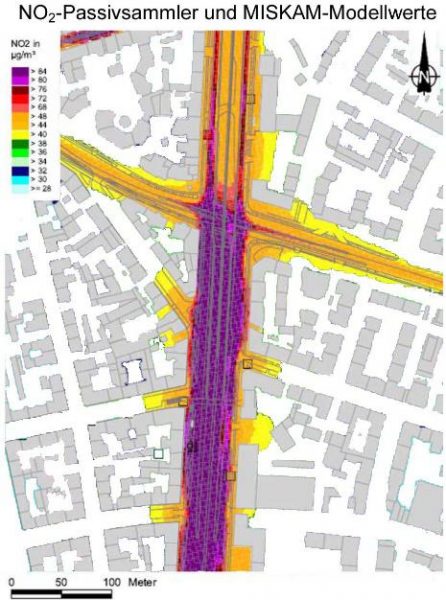

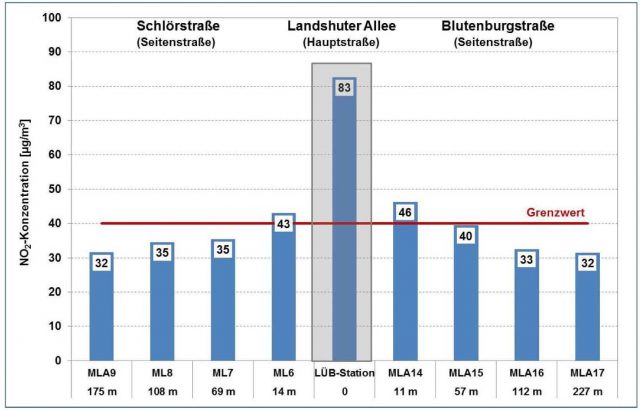

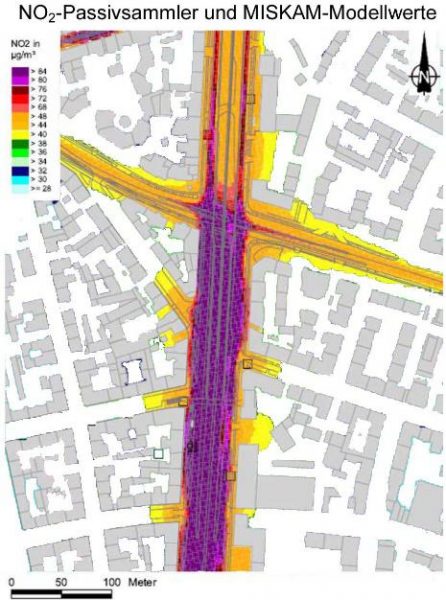

Die Fakten sehen nämlich völlig anders aus. Einen sehr guten Beweis hierfür liefert die bereits im letzten Beitrag angeführte umfassende und mehrjährige Untersuchung des Bayerischen Landesamts für Umwelt über die Abgasemissionen und -immissionen in einer Reihe bayrischer Großstädte [BLFU]. Aus den aufgeführten Beispielen wurde die Landshuter Allee in München ausgewählt, die ein tägliches Verkehrsaufkommen von bis zu 142.000 Fahrzeugen hat, ein Wert, der nur von einigen besonders stark befahrenen Autobahnen übertroffen wird. Aus diesem Grund gehört ein Abschnitt dieser Straße mit weitgehend geschlossener Randbebauung zu den „Hot Spots“ mit den höchsten NO2-Immissionswerten in ganz Deutschland. Allerdings ist dieser Abschnitt insgesamt nur vielleicht einen Kilometer lang. Eine Farbdarstellung der dort gemessenen bzw. aus Messwerten per Computermodell errechneten NO2-Jahresmittelwerte zeigt Bild 4.

Bild 4. Darstellung der Jahresmittelwerte der NO2-Konzentration im Bereich des am stärksten beaufschlagten Abschnitts der Landshuter Allee in München für das Jahr 2011 (Grafik: [BLFU])

Schon auf den ersten Blick ist zu sehen, dass sich die wirklich hohen Grenzwertüberschreitungen auf ein ziemlich schmales Band entlang eines Teils der Landshuter Allee beschränken. Bereits in den Seitenstraßen fallen die Werte sehr schnell unter den Grenzwert von 40 µg/m3 ab. In Hinterhöfen bzw. hinter geschlossenen Gebäudefronten liegen sie grundsätzlich im zulässigen Bereich. Der Maßstab am unteren Bildrand belegt, dass der Bereich, in dem der Grenzwert überschritten wird, selbst in die Seitenstraßen hinein nur an wenigen Stellen mehr als 100 Meter breit ist. Die betroffene Strecke ist insgesamt vielleicht einen Kilometer lang. Mehr nicht. Wie schnell der Abfall der NO2-Konzentration in den Seitenstraßen erfolgt, zeigt Bild 5.

Bild 5. Messungen in den Seitenstraßen belegen, dass die NO2-Befrachtung schon nach wenigen Dutzend Metern unter den gesetzlichen Grenzwert absinkt (Grafik: [BLFU])

Das Gebiet im Bereich der Landshuter Allee, in dem die NO

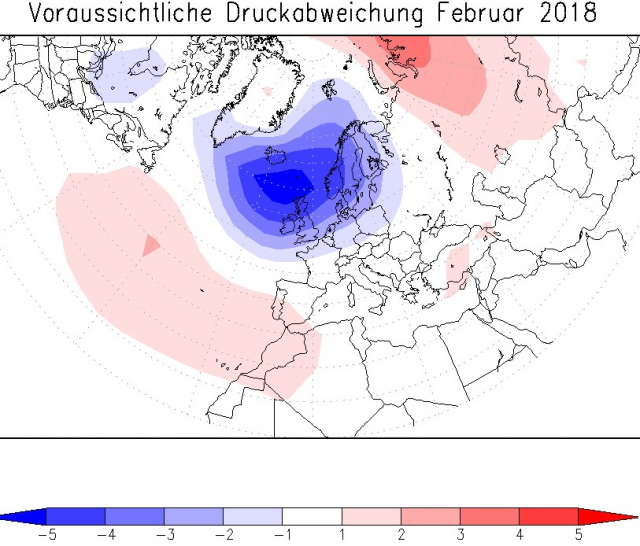

2-Grenzwerte tatsächlich überschritten werden, ist demnach im Vergleich zur Größe der Stadt München geradezu winzig. Um dies auch optisch besser zu verdeutlichen, wurde Bild 4 so überarbeitet, dass nur noch die Bereiche oberhalb des Grenzwerts farblich hervorgehoben sind,

Bild 6.

Bild 6. Bei dieser Kopie des Bildes 4 wurden alle Bereiche, in denen die NO2-Grenzwerte unterhalb des Grenzwerts liegen, entfärbt (Grafik: [BLFU])

Mit Bild 6 wird optisch noch besser verdeutlicht, wie klein das Gebiet im Bereich der Landshuter Allee mit NO

2-Werten über dem Grenzwert tatsächlich ist. Nach Entfärbung der unkritischen Bereiche verbleibt nur noch ein schmales Band mit einigen kurzen Seitenästen. Dessen Größe kann man realistisch mit vielleicht 200 x 1.000 m ansetzen (die Karte in Bild 4 bzw. Bild 6 umfasst nur die nördliche Hälfte des betroffenen Straßensegments). Das wären 0,2 Quadratkilometer. In München gibt es nur noch eine weitere Stelle, an der der Grenzwert überschritten wird, und zwar am Stachus. Wenn wir für das dort betroffene Gebiet eine Fläche von 0,1 km

2 annehmen, so wird der NO

2-Grenzwert in München auf einer Fläche von lediglich 0,3 km

2 überschritten. Da München eine Gesamtfläche von ca. 311 km

2 hat, betrifft dies lediglich ein Tausendstel bzw. 0,1 % des gesamten Stadtgebiets. Schätzen wir aufgrund dieser Flächen die Zahl der betroffenen Anwohner ein, so kann man in Neuhausen (Landshuter Allee) mit seiner Bevölkerungsdichte von rund 7.700 EW/km

2 von etwa 1500 Personen ausgehen. Am Stachus kommt man bei einem Mittelwert von 10.000 EW/km

2 auf weitere etwa 1.000 Anwohner. In der Summe geht es also um 2.500 Münchner, die in Stadtbereichen mit straßenseitigen NO

2-Werten über dem Grenzwert wohnen. Bei einer Einwohnerzahl von rund 1,45 Mio. ist dies ein Anteil von 0,172 %.

In ganz Bayern gibt es insgesamt nur noch vier weitere Hot-Spots, die alle in deutlich kleineren Städten liegen, so dass man hier von weitaus geringeren betroffenen Flächen und Einwohnerdichten ausgehen kann. Es erscheint gerechtfertigt, hier von insgesamt vielleicht weiteren 2.500 Betroffenen auszugehen, so dass die Gesamtzahl für Bayern mit rund 5.000 angesetzt werden kann. Bei einer Gesamt-Einwohnerzahl von ca. 12,9 Mio. geht es also um ganze 0,04 % der Bevölkerung, die überhaupt von NO

2-Grenzwertüberschreitungen betroffen sind. Es darf davon ausgegangen werden, dass diese Zahlen von der Größenordnung her auch für die gesamte Bundesrepublik Deutschland gelten. Vergleicht man dies mit den optischen Botschaften der Bilder 2 und 3, so erkennt man deutlich, in welch geradezu ungeheuerlichem Ausmaß unser Volk und unsere Industrie hier – und das ist noch sehr zurückhaltend formuliert – von den Medien und den Behörden manipuliert und betrogen werden.

Die „übersehene“ Senkrechte

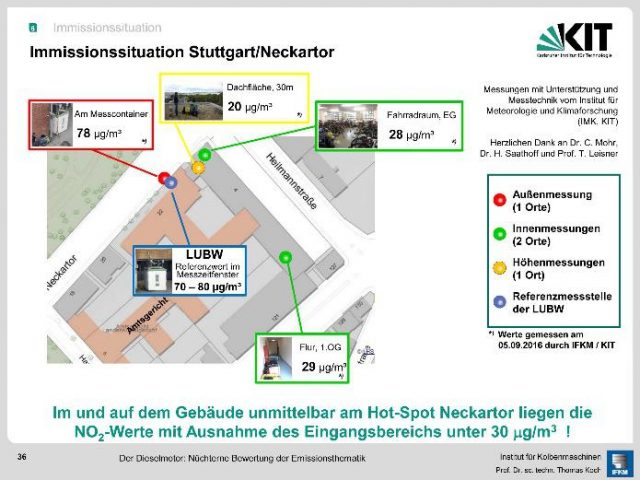

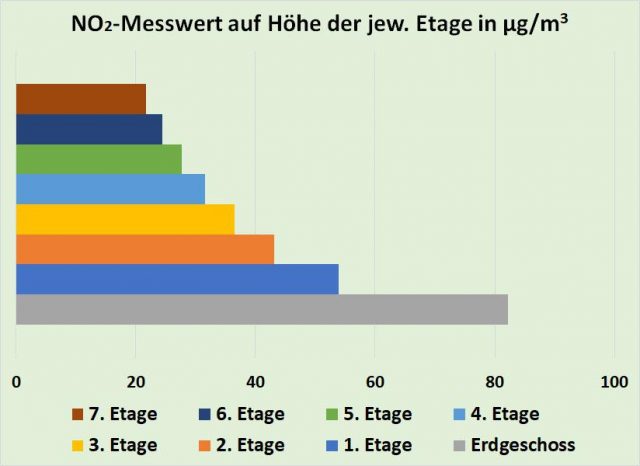

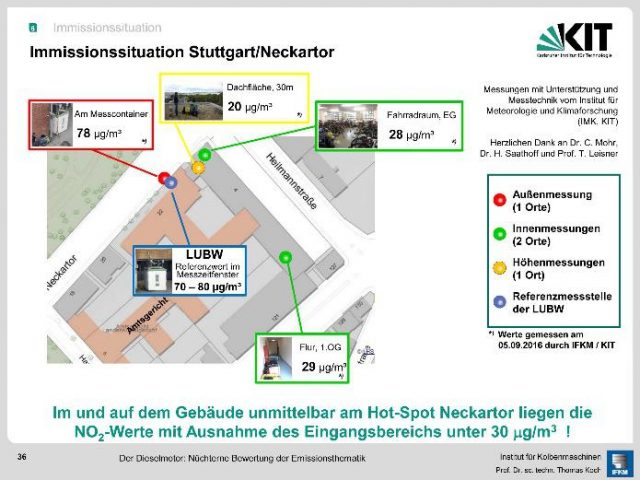

Bei der hier vorgestellten überschlägigen Kalkulation des von Grenzwertüberschreitungen betroffenen Anteils der Bevölkerung wurde ein weiterer wichtiger Aspekt noch ausgespart, obwohl er von erheblicher Bedeutung ist: Die Höhe der Wohnung über dem Erdboden. Obwohl die Häuser in den betroffenen Wohngebieten typischerweise eine fünf- oder sechsgeschossige Bauweise aufweisen, werden Immissionsmesswerte grundsätzlich nur auf Erdgeschossniveau erfasst. Dabei ist doch davon auszugehen, dass die schnelle Verdünnung, die man bereits in der Horizontalen mit zunehmender Entfernung von der Straße feststellen kann, sich auch nach oben hin zur freien Atmosphäre vollzieht. Den entsprechenden Beweis liefert

Bild 7 [

KOCH].

Bild 7. Messstelle Stuttgart am Neckartor. Der Jahresmittelwert für NO2 liegt auf Straßenniveau bei 78 µg/m↑3, auf dem Dach dagegen bei nur noch 20 µg/m↑3 (Grafik: [KOCH])

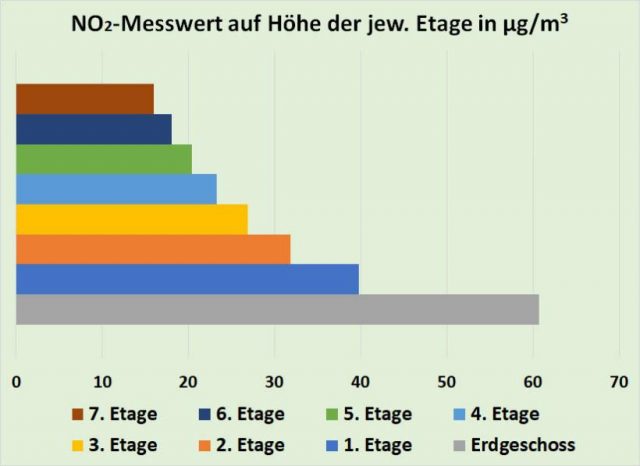

Man kann davon ausgehen, dass die Abnahme der NO

2-Konzentration in vertikaler Richtung in erster Näherung mit dem gleichen mathematischen Ansatz beschrieben werden kann wie diejenige in horizontaler Richtung. Mithilfe einer logarithmischen Funktion kann man nach Anpassung der entsprechenden Parameter den Konzentrationsverlauf entlang der Fassade eines mehrstöckigen Gebäudes in Abhängigkeit von der Konzentration auf dem üblichen Messniveau nachbilden,

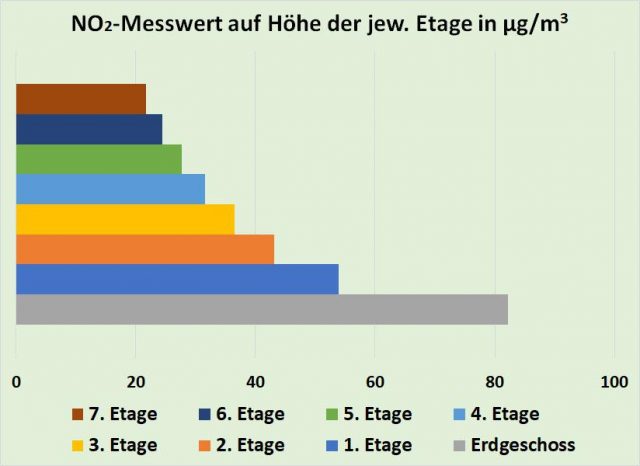

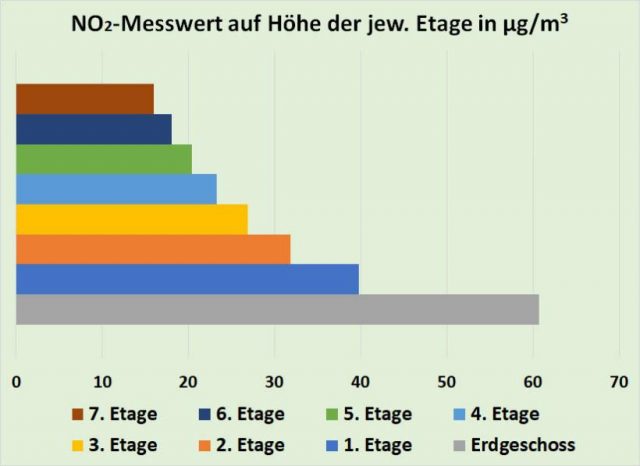

Bild 8 und

Bild 9.

Bild 8. Verlauf der vertikalen NO2-Konzentration entlang der Fassade eines mehrstöckigen Gebäudes bei einem Pegel auf Straßenniveau von ca. 80 µg/m↑3

Bild 9. Verlauf der vertikalen NO2-Konzentration entlang der Fassade eines mehrstöckigen Gebäudes bei einem Pegel auf Straßenniveau von ca. 60 µg/m↑3

Wie aus Bild 8 ersichtlich, sinkt bei einem auf Straßenniveau gemessenen Ausgangswert von etwas über 80 µg/m

3der NO

2-Gehalt bereits bei der 2. Etage auf einen Wert knapp über dem Grenzwert und liegt ab der 3. Etage sicher unterhalb davon. Bei einem Ausgangswert von 60 µg/m

3 wird der Grenzwert sogar schon ab der 1. Etage nicht mehr überschritten. Hierzu ist anzumerken, dass im Jahre 2016 in ganz Deutschland nur an zwei Messstationen Jahresmittelwerte von mehr als 79 µg/m

3 und an lediglich sechs weiteren Stellen Werte von mehr als 59 µg/m

3 registriert wurden [

UBA]. Man kann daher davon ausgehen, dass an den insgesamt 66 Messstellen, an denen der Grenzwert überhaupt „gerissen“ wird, die Bewohner fast aller Etagen ab dem 1. Stock nicht von Grenzwertüberschreitungen der Außenluft betroffen waren. Da die Bebauung gerade der Straßen, in denen die Messwerte über dem Grenzwert liegen, in der Regel fünf- bis sechsgeschossig ausgeführt sein dürfte, kann man unterstellen, dass dort höchstens 30-40 % der Bewohner mit einer Außenluft zu tun haben, die oberhalb des aktuellen Grenzwerts liegt. Somit kann der im vorigen Abschnitt ermittelte Prozentsatz an betroffenen Bewohnern um den Faktor 0,3 bis 0,4 reduziert werden. Es dürfte daher gerechtfertigt sein, von einem Wert zwischen 0,01 % und 0,02 % der Bevölkerung auszugehen.

Warum nur will man mit Atombomben auf Spatzen schießen?

Warum wird wegen einer so überschaubaren Zahl wirklich Betroffener dann ein derartiger Aufstand veranstaltet? Medien und Politik überschlagen sich derzeit geradezu in dem Versuch, in trauter Einheit über die NO

2-Abgasdiskussion den Diesel und danach die gesamte klassische Individualmobilität der Bürger zu vernichten. Deshalb wird so getan, als sei ein Großteil der Bevölkerung in unseren Städten gesundheitlich durch Dieselabgase gefährdet, obwohl die Realität doch völlig anders aussieht. Es geht in ganz Deutschland um vielleicht 15.000 Personen, die in Bereichen leben, in denen die NO

2-Werte der Außenluft dauerhaft über dem (sowieso schon willkürlich viel zu tief angesetzten) Grenzwert von 40 µg/m

3 liegen. Zur „Behebung“ durch Umstellung auf das Etappenziel Elektromobilität werden gigantische volkswirtschaftliche Schäden in Kauf genommen. Allein bei VW summieren sich die Zusatzkosten inzwischen auf ca. 100 Mrd. €, ein Großteil davon für die überhastete und sinnlose Umstellung der Entwicklungsaktivitäten sowie der Produktion auf die Totgeburt Elektromobilität. Die anderen deutschen Kfz-Hersteller dürften zusammen ähnlich hohe Beträge fehlinvestieren. Unsere wichtigste Schlüsselindustrie wird dadurch in ein 200 bis 250 Mrd. teures Abenteuer geprügelt. Niemand scheint zu bedenken, dass unsere Volkswirtschaft vom Export abhängt und dass E-Mobile noch auf Jahrzehnte hinaus in den Ländern der 2. und 3. Welt keine Abnehmer finden werden, weil es dafür keine Infrastruktur und oft noch nicht einmal eine zuverlässige Stromversorgung gibt.

Zweiter Leidtragender ist die Bevölkerung. Die knapp 15 Millionen deutschen Dieselbesitzer werden als Folge der Anti-Diesel-Hysterie durch Wertverlust ihrer Fahrzeuge enteignet. Setzt man den erlittenen Wertverlust auch nur mit 3.000 € an, so werden die Besitzer mit rund 40 Mrd. € für etwas bestraft, was ihnen die gleiche Politik, die jetzt in Bonn über das Ende des Verbrenners streitet, jahrelang als erstrebenswert aufgeschwätzt hat. Der gesamte volkswirtschaftliche Schaden liegt demnach schon allein aufgrund dieser beiden Positionen irgendwo zwischen 240 und 300 Mrd. €. In der Realität ist er sogar noch erheblich höher, wie in einem späteren Kapitel noch ausgeführt wird.

Man schmeißt also mehr als 250 Mrd. € sowie die Zukunft unserer wichtigsten Exportbranche zum Fenster hinaus, nur um die angebliche „Vergiftung“ von vielleicht 15.000 Einwohnern zu verhindern. Es wäre weitaus billiger, allen diese Personen einen Daueraufenthalt in einem Luxushotel ihrer Wahl zu finanzieren. Wesentlich einfacher und effizienter wäre es beispielsweise, die tatsächlich betroffenen Bewohner durch entsprechende Prämien zum Wegzug zu bewegen und den Vermietern die temporären Mietausfälle zu ersetzen. Das Ganze wäre nämlich nur zeitweilig zu sehen, denn in wenigen Jahren wird sich das „Abgasproblem“ dank der neuen Abgastechnologien (EURO 6d) sowieso in Luft aufgelöst haben,

Bild 10.

Bild 10. Bei konsequenter Einführung der neuesten EURO 6d-Abgasreinigungstechnologie würden die NO2-Immissionen an der Messstelle „Am Neckartor“ in Stuttgart von derzeit 82 µg/m↑3 weit unter den Grenzwert absinken (Grafik: [KOCH])

Gerade am Thema Dieselabgase kann man durch kritische Analyse einfach zugänglicher Fakten ganz leicht beweisen, in welchem Ausmaß hier die Realität ignoriert wird, um der Bevölkerung und der Wirtschaft ideologische Dogmen grüner Salonkommunisten aufzuzwingen, statt Existenzvorsorge zu betreiben. Triebkraft hierfür ist die inzwischen alles durchdringende Klimahysterie. Für diese Ideologen in Politik und Medien ist die Individualmobilität nur ein Nebenkriegsschauplatz. Sie verwenden hier jedoch die gleichen Methoden der Manipulation, des Totschweigens kritischer Stimmen und der Verbreitung bewusster Falschaussagen wie bei der CO

2-Diskussion. Nur kann ihnen dies beim Thema Diesel viel einfacher und schneller nachgewiesen werden als beim Klima, weil die Zusammenhänge einfacher sind und man sich nicht so einfach hinter ganzen Gebirgen komplexer mathematischer Gleichungen verstecken kann wie bei Klimamodellen. Die Medien spielen dieses schmutzige Spiel voller Inbrunst mit, die wenigen realistischen Stimmen werden durch Lautstärke und Totschlagsargumente wie „Dieselabgase töten“ einfach übertönt. Neben den öffentlich-rechtlichen Sendern spielen hier auch einige „fortschrittliche“ Publikationen – unter ihnen nicht zuletzt der „Spiegel“ – eine besonders negative Rolle. Deshalb wurden hier deren Manipulationstechniken speziell gewürdigt. Der Anspruch dieser Blätter, besonders kritisch-investigativ zu sein, ist nichts als ein Feigenblatt. Bezüglich ideologischer Verbohrtheit und der Bereitschaft zur Manipulation stehen sie der „Bild-Zeitung“ nicht im Geringsten nach. Sie verwenden nur kleinere Buchstaben bei den Überschriften und schreiben etwas mehr Text.

Fakten und „Faktenfinder“

Die bisherige Analyse der von den „Faktenfindern“ von NDR und Tagesschau sowie ihren Spießgesellen bei den Printmedien präsentierten Aussagen lässt erkennen, dass man sich dort alles andere als kritisch-investigativ mit dem Thema NO

2-Immissionen der Stadtluft beschäftigt hat. Stattdessen übernimmt man einfach die Positionen von Hendricks und dem UBA, als seien deren Ansichten der Weisheit letzter Schluss. Eine eigenständige kritische Wertung von Daten und Hintergründen ist nicht einmal in Ansätzen erkennbar. Dies bestätigt die bereits bisher gemachte Erfahrung, dass die Mehrzahl der Medien – allen voran die Fernsehanstalten ARD, ZDF und ihre Landesdependancen – beim sogenannten „Diesel-Skandal“ einseitig, parteiisch und irreführend berichtet. Statt um Ausgewogenheit und Sorgfalt bemüht man sich offenkundig eher darum, das Thema so darzustellen, wie bestimmte Bundesbehörden sowie die etablierten Parteien es gerne haben möchten. Abweichende Meinungen von Fachleuten, Medien, Journalisten oder Bloggern werden als unglaubwürdig hingestellt. So leistet man dem ideologischen Ziel der Deindustrialisierung Deutschlands durch „Dekarbonisierung der Volkswirtschaft“ Vorschub. Der Diesel ist dabei nur das erste Opfer. Die Vernichtung der deutschen Automobilindustrie wird anschließend auch beim Benziner weitergehen, und zwar alternativlos. Die sich jetzt abzeichnende „Jamaika“-Koalition ist dafür ein sehr schlechtes Omen.

Fred F. Mueller

Demnächst folgt Teil 9

Quellen

[BLFU] https://www.lfu.bayern.de/luft/luftreinhalteplanung_verkehr/nox_projekt/index.htm

[BLOG] https://groups.google.com/forum/#!topic/de.soc.umwelt/7dCudiLAQOc%5B1-25%5D

[FAKT] http://faktenfinder.tagesschau.de/inland/stickstoffdioxid-111.html

[KOCH] https://www.ifkm.kit.edu/downloads/Focus_Antworten_v2.0.pdf

[SPIE] http://www.spiegel.de/wissenschaft/mensch/stickoxid-wo-luft-in-deutschland-krank-macht-a-1120859.html

[TSLA] http://teslamag.de/news/abgasemissionen25-mal-auto-tesla-fuehrungskraft-11242

[UBA] http://www.umweltbundesamt.de/sites/default/files/medien/358/dokumente/no2_2016.pdf