Meeresspiegel – steigen und fallen: Wie man einen Anstieg aus Nichts erzeugt

Wie kommt man zu einem Anstieg des Meeresspiegel durch nichts?

Schauen wir mal, wie R. Steven Nerem von der CU Sea Level Research Group es fertig bringt, diesen Trick durchzuführen. In einem Report bei Nature.com heißt es:

Steve Nerem präsentierte eine bis jetzt unveröffentlichte Analyse auf einer Konferenz in New York City am 13. Juli, gesponsert vom World Climate Research Programme und der International Oceanographic Commission. … Nerems Team berechnete, dass die Rate des Meeresspiegel-Anstiegs von 1,8 mm pro Jahr im Jahre 1993 auf etwa 3,9 mm pro Jahr heute gestiegen ist als eine Folge der globalen Erwärmung.

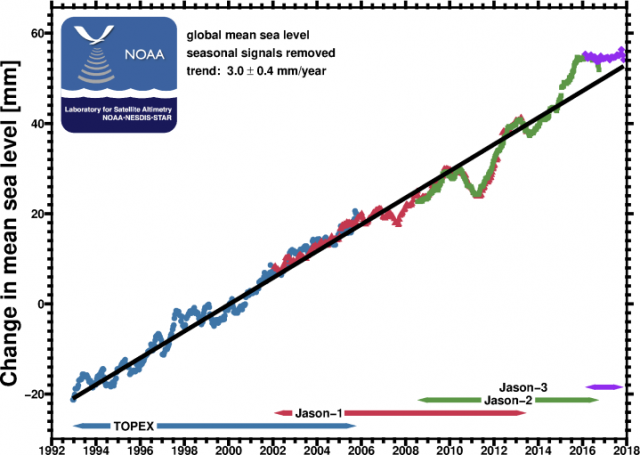

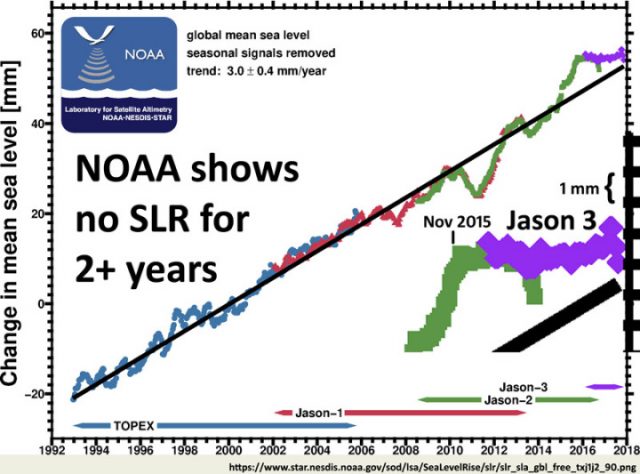

Hmmm … schauen wir mal, was die NOAA dazu sagt, Stand: Januar 2018:

Nun, das ist seltsam. Das NOAA NESDIS-Star (National Environmental Satellite, Data, and Information Service; Center for Satellite Applications and Research) zeigt nicht einmal ansatzweise eine plötzliche Beschleunigung von 1993 (3,0 ± 0,4 mm pro Jahr) bis heute – vielmehr zeigt sich exakt die gleiche Trendlinie, die gleiche Zahl wie im Titel genannt.

Also, Erstes zuerst – wer ist R. Steven Nerem?

Steve Nerem ist ein Alarm-Evangelist* des Meeresspiegel-Anstiegs – es gibt keine andere angemessene Beschreibung. Ich zweifle nicht daran, dass er wirklich an seine Causa glaubt, ist er doch im vorigen Jahr durch die Welt gereist mit immer dem gleichen Vortrag – immer mit identischem Abstract – in San Francisco (Dec 2016), Bologna (Feb 2017), New York (July 2017), Miami (Oct 2017) und New Orleans (Dec 2017). Nerem ist einer der Ko-Autoren des infamen Kommentars im Journal Global and Planetary Change, worin er versucht die Studie aus dem Jahr 2004 von Nils-Axel Mörner im gleichen Journal zu widerlegen. Im 3. Teil von SEA LEVEL: Rise and Fall schrieb ich über den Austausch Mörner/Nerem/Mörner.

[*Man merkt, dass sich der Autor in theologischen Dingen nicht auskennt. Das griechische Wort „Evangelium“ übersetzt sich mit „Frohe Botschaft“. Ein Evangelist ist {kirchlicherseits!} ein „Verkünder der Frohen Botschaft“. Das hat Autor Kip Hansen aber sicher nicht im Sinn gehabt. Nur mal so! Anm. d. Übers.]

Steve Nerem war auch Ko-Autor des schreiend alarmistischen Artikels in der Washington Post im Mai 2016 mit dem Titel „10 things you should know about sea level rise and how bad it could be”, in welchem gesagt wird dass „Wissenschaftler schätzen, dass wenn sich die Welt um 4 bis 5°C erwärmt, was für das Ende des Jahrhunderts projiziert wird, wenn wir keine Maßnahmen gegen den Klimawandel ergreifen, alles Eis wahrscheinlich schmelzen wird. Das würde einen Meeresspiegel-Anstieg um 70 Meter bewirken“.

Dr. Nerems Reise-Theater wird in Nature.com in einem Artikel im Juli 2017 beschrieben mit dem Titel „Satellite snafu masked true sea-level rise for decades” [etwa: Satelliten-Chaos maskierte seit Jahrzehnten den wahren Meeresspiegel-Anstieg]. Im Artikel finden sich dann Details aus Nerems oft zitierter Präsentation, darunter:

Das Schmelzen des grönländischen Eisschildes stützt den Anstieg des Meeresspiegels der Welt.

Die Zahlen spielten jedoch nicht mit. Selbst mit dem wärmer werden der Erde sowie dem Schmelzen von Gletschern und Eisschilden schienen Dekaden mit Satellitendaten zu zeigen, dass die Rate des Meeresspiegel-Anstiegs gleich blieb – oder sogar rückläufig war.

Inzwischen haben Wissenschaftler, nachdem sie sich Jahre lang mit dieser Diskrepanz befasst hatten, die Ursache derselben ausgemacht: Ein Problem mit einem Sensor auf dem ersten von vielen ins All geschossenen Satelliten, welcher die Höhe der Meeresoberfläche mittels Radar messen sollte. Adjustiert man die Daten unter Berücksichtigung dieses Fehlers zeigt sich, dass der Meeresspiegel tatsächlich jedes Jahr schneller steigt.

Nerems Team berechnete, dass die Rate des Anstiegs von etwa 1,8 mm pro Jahr 1993 auf etwa 3,9 mm pro Jahr heutzutage zugenommen hat als eine Folge der globalen Erwärmung. Zusätzlich zum Kalibrierungs-Fehler der Satelliten berücksichtigt seine Analyse auch andere Faktoren, die den Anstieg während der letzten Jahrzehnte beeinflusst haben könnten, als da wären der Ausbruch des Pinatubo 1991 und das jüngste El Nino-Ereignis.

Falls sich der Meeresspiegel-Anstieg mit der gegenwärtigen Rate weiter beschleunigt, sagt Nerem, würden die Ozeane der Welt im Laufe dieses Jahrhunderts um etwa 75 cm steigen. Das liegt auf einer Linie mit den Projektionen des IPCC aus dem Jahr 2013.

Falls dies stark danach klingt, was Nils-Axel Mörner die ganze Zeit gesagt hat, dass nämlich der SLR-Alarm seinen Ursprung in den ad hoc-Adjustierungen und ,Korrekturen‘ – nach den Messungen – hat, ist das wohl richtig.

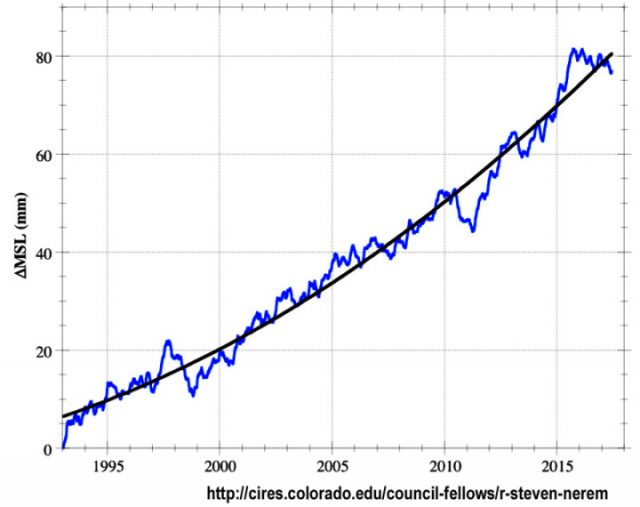

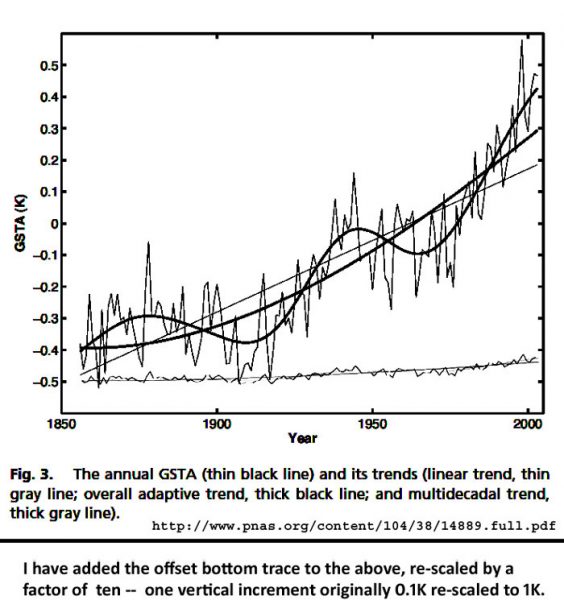

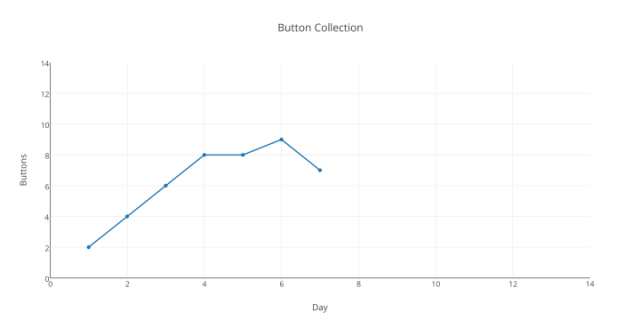

Hier folgt die Graphik von der Nerem’schen CIRES faculty page:

Auf der Site heißt es: „Wir müssen auch sehr sorgfältig die Messfehler abschätzen sowie den Einfluss der dekadischen Variabilität in einer relativ kurzen Zeitreihe von 25 Jahren. Während wir daran immer noch arbeiten, scheint es so, als ob sich der langfristige SLR von etwa 2 mm pro Jahr Mitte der neunziger Jahre auf 4 mm pro Jahr 2017 beschleunigt hat“. Natürlich ist dieses Statement etwas ungenau ausgedrückt – scheint es doch so auszusehen, als ob der Trend im ersten Teil dieser Graphik etwa 2 mm pro Jahr beträgt. In Wirklichkeit meint er aber den langfristigen Trend des 20. Jahrhunderts auf der Grundlage von Tidenmessungen, welcher zu Beginn etwa 1,8 bis 2,0 mm pro Jahr beträgt und „etwa 3,9 mm pro Jahr“ in seiner unveröffentlichten Re-Analyse. Man beachte, dass die Trendlinie hier als ein gekrümmter Beschleunigungstrend daherkommt und nicht als die normale gerade Linie von 1993 bis heute.

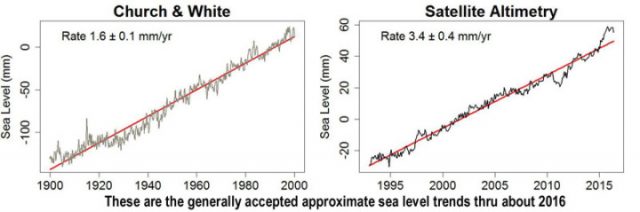

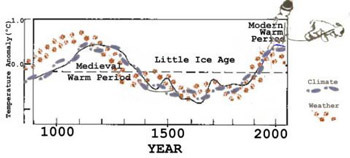

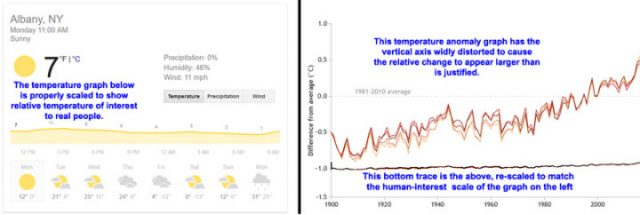

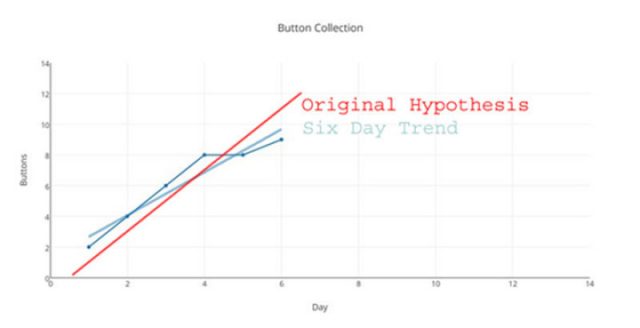

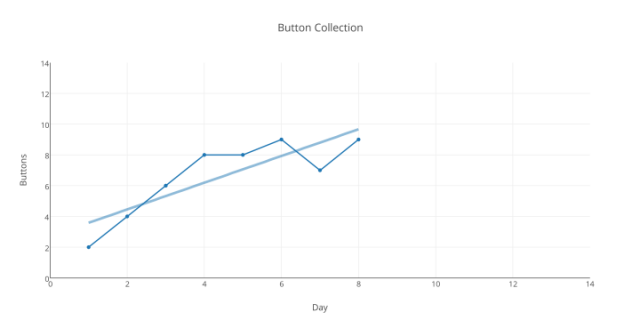

Den allgemein akzeptierte Standpunkt dieser beiden Abbildungen zeigt dieses Bild:

Erst vor zwei Jahren fungierte Nerem als Ko-Autor einer Studie mit dem Titel „Is the detection of accelerated sea level rise imminent?“ (veröffentlicht im August 2016, gerade vier Monate vor seinem Vortrags-Kreuzzug). Das Abstract schließt mit den Worten „…eine erkennbare Beschleunigung wird sich wahrscheinlich im kommenden Jahrzehnt aus dem Rauschen herausschälen“ und weiter „Während der 23 Jahre langen Reihe zeigt sich, dass der globale mittlere Meeresspiegel um 3,3 ± 0,4 mm pro Jahr gestiegen ist, jedoch mit einer deutlichen Variabilität von Jahrzehnt zu Jahrzehnt. Unser gegenwärtiges best estimate der Raten im ersten (1993 bis 2002) und zweiten (2003 bis 2012) Jahrzehnt der Altimeter-Ära beträgt 3,5 und 2,7 mm pro Jahr. Es gibt viele Theorien zur Erklärung dieser Variabilität, aber hier präsentieren wir eine zusätzliche Erklärung mit bedeutenden Implikationen für die erwartete Beschleunigung in naher Zukunft“.

Sie waren wirklich fleißig und fanden jene Beschleunigung dem Report in Nature.com zufolge im Dezember 2016.

Wie haben sie das gemacht?

Offenbar ganz einfach. Im jüngsten Zeitraum der Meeresspiegel-Aufzeichnungen via Satelliten gibt es einfach keinen Spielraum mehr für größere Änderungen – es ist schwierig, die Daten zu ändern oder zu adjustieren – das Adjustierungs-Budget ist bereits ausgeschöpft. Bringt man trotzdem welche an, geht das einfach schief – also (nicht lachen!) haben sie erneut die Vergangenheit adjustiert.

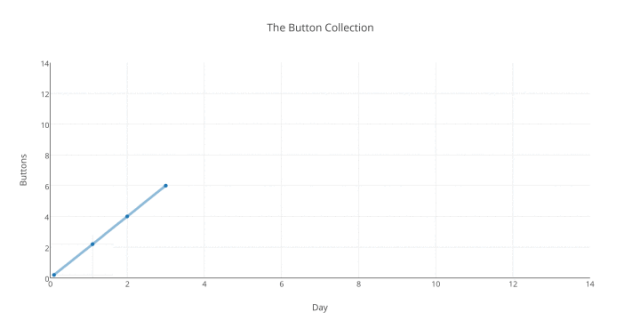

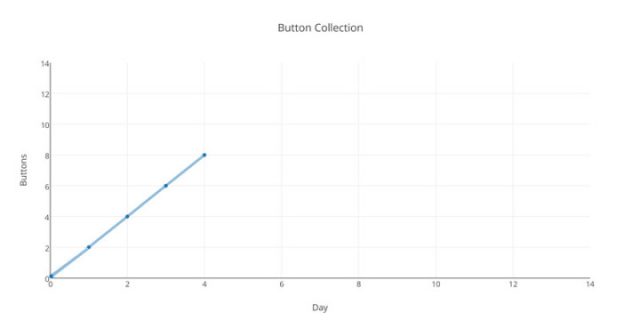

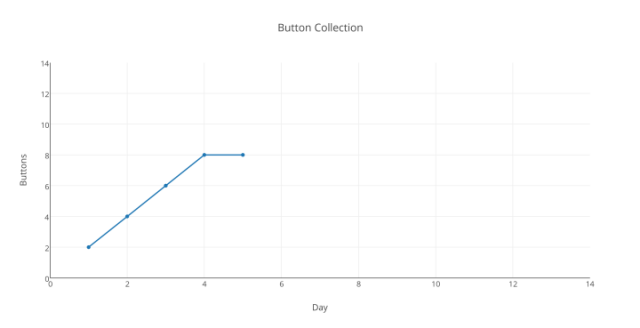

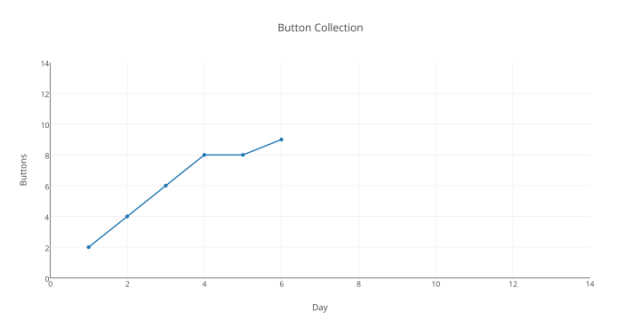

Ich werde die Bilder der NOAA heranziehen, um zu zeigen, wie sie es gemacht haben:

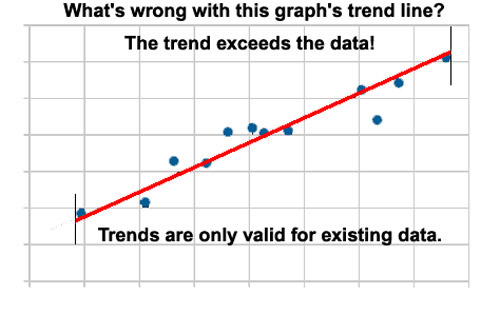

Diese Wechselgraphik zeigt die üblicherweise betrachtete NOAA-NESDIS-STAR satellite SLR record graph bis Ende 2017, farbig dargestellt für die vier Satelliten-Missionen, welche die Daten gesammelt haben. Das zweite, darüber gelegte Bild [in der Einzeldarstellung rechts, Anm. d. Übers.] zeigt die jüngsten Daten des NASA JPL, welche die „Aktualisierungen“ enthält, von denen Nerem spricht. Wir sehen hier, dass er mittels einer Reihe von Adjustierungen das linke Ende der Graphik, die TOPEX Altimeter A-Daten, um etwa 3 bis 5 mm angehoben und die Altimeter-B-Daten geringfügig verändert hat. Das Anheben des linken Endes der Graphik – also im Zeitraum 1993 bis 1999 – gestattet es ihm, die Trendlinie mit einer Steigung von 3,0 mm pro Jahr auf eine solche mit 3,8 mm pro Jahr zu ändern.

Nachdem Nerem diese Art der Adjustierung durchgeführt hatte, benutzte er die gleichen adjustierten Daten, um einen gekrümmten Beschleunigungstrend zu zeichnen, welcher seiner Behauptung nach 3,9 mm pro Jahr zeigt.

Fünf Millimeter der maximalen Änderung jedweden Datenpunktes in der Aktualisierung! Die schreckliche, zu befürchtende Beschleunigung des Meeresspiegel-Anstiegs (SLR) ergibt sich ausschließlich aus zweifelhaften Korrekturen allein der TOPEX Altimeter A-Daten – ganze 5 mm bei sechs Jahren „schlechter Daten“ von 1993 bis 1999. Falls diese Daten wirklich schlecht sind, hätte man sie aussondern müssen, anstatt sie so zu frisieren, dass sie zu einem vorbestimmten Narrativ passen.

Keine wie auch immer gearteten Änderungen gibt es in den zuverlässigeren Daten von 1999 bis Januar 2018. Der NOAA zufolge wurde dies 19-jährige Reihe gar nicht verändert und zeigt immer noch genau den gleichen Trend, den sie immer gezeigt hat – etwa 3,0 ± 0,4 mm pro Jahr. Und nichts ändert die Tatsache, dass die jüngsten Altimeter-Daten des neuen, verbesserten JASON-3-Satelliten seit nunmehr über 2 Jahren überhaupt keinen SLR mehr zeigen – NULL. Wir werden abwarten müssen, was die Enthusiasten tun, um diesen Tatbestand passend für ihr Narrativ zu machen.

Sie haben eine Beschleunigung aus nichts erzeugt.

Anmerkung: Ich denke, ich sollte diese Ausführungen mit dem Jüngsten der NOAA beenden:

WTWT [?]:

Leider muss ich die Leserschaft darüber informieren, dass es schlimmer ist, als wir gedacht haben. Alle obigen Daten und Graphiken zur Bestimmung eines auf Satelliten basierenden SLR zeigen nicht wirklich einen Meeresspiegel-Anstieg. Das heißt, sie repräsentieren nicht (und haben das auch nie) einen tatsächlichen Anstiegs des Niveaus der Meeresoberfläche über das Geoid. Ein wirklicher Meeresspiegel-Anstieg wird reflektiert in der Global Mean Sea Surface Height. Aber ein globaler mittlerer SLR, wie er berechnet ist von der Sea Level Group in Colorado, der NOAA und anderen SLR-Gruppen ist ein Konzept – nicht eine Messung. Ich habe einmal den Terminus „imaginary number“ verwendet, um diese Art einer nicht-physikalischen Messgröße zu beschreiben – eine Zahl, von der man sagt, dass sie irgendetwas in der realen Welt repräsentiert, aber aktuell etwas vollkommen Anderes ist. Mehr dazu schreibe ich in einem Beitrag mit dem Titel „What Are They Really Counting“. SLR Satellitendaten enthalten auch Dinge wie eine „GIA-Adjustierung“ – also die Größe des SLR, welche es gegeben hätte falls das Ozeanbecken nicht an Volumen zugelegt hätte, und durch andere Hinzufügungen und Adjustierungen, die sich nicht manifestieren in jedweder Änderung der physikalischen Meeresoberfläche. Aber das ist eine andere Geschichte.

Unter dem Strich:

1. Alles in allem ist der Meeresspiegel seit dem Ende der letzten Eiszeit gestiegen, langsam und unaufhaltsam, mit einigen Sprüngen dazwischen. Im Allgemeinen wird das in absehbarer Zukunft auch so weitergehen – mit irgendwo zwischen 10 und 30 cm pro Jahrhundert. Diese Rate ist eine unmittelbare Bedrohung für besiedelte Gebiete, welche sich nominell auf der Höhe des heute existierenden Meeresspiegels befinden.

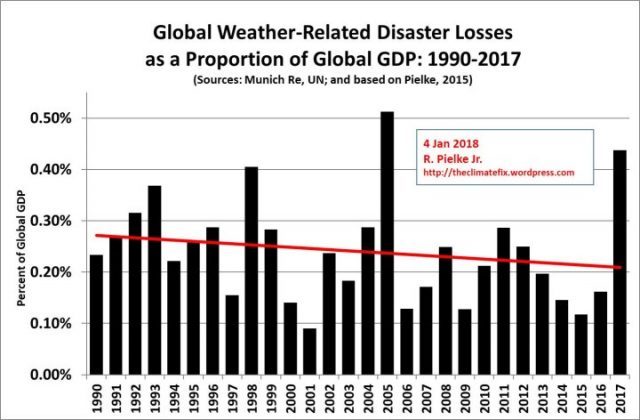

2. Es spricht nichts dafür, dass der Meeresspiegel gefährlich oder rapide steigt. Auch beschleunigt sich der Anstieg im globalen Maßstab nicht – wobei unsere Fähigkeit, globale Änderungen in diesen sehr kleinen Größenordnungen (millimeterweise) zu messen sehr fragwürdig ist.

3. Falls Mörner (und seine 101 Kollegen in der INQUA-Kommission) recht haben, gab es während der letzten 25 Jahre kaum einen tatsächlichen SLR (das ist die Altimeter-Satelliten-Ära).

4. Alles oben Gesagte könnte bedeuten, dass das konstante Trommelfeuer der Untergangs-Szenarien hinsichtlich eines steigenden Meeresspiegels auf der gleichen Art Computer-Hybris beruht, die uns eine „mittlere globale Temperatur-Anomalie“ beschert hat anstelle einer globalen mittleren Temperatur.

5. Die hinaus posaunte „Beschleunigung“ des SLR ist ein alarmistischer Punkt, hervorgebracht aus der Abkopplung zwischen Tidenmessungen, die nicht adjustiert sind hinsichtlich vertikaler Bewegungen der Landmassen an den Messpunkten und den Satelliten-Altimeter-Daten – ein Datensatz, der fast hoffnungslos vermengt ist durch Messungen und physikalische Elemente, welche um Größenordnungen größer sind als das gesuchte Signal selbst.

Schlussbemerkung des Autors:

Der Anstieg des Meeresspiegels ist eine wissenschaftliche Kontroverse, die immer noch im Gange ist. Dies bedeutet, dass man äußerste Sorgfalt walten lassen muss beim Betrachten und Interpretieren der Daten der Vergangenheit, bei neuen Studien und insbesondere der Berichterstattung in den Medien zu diesem Thema (einschließlich dieses Beitrags!). Bias und Verfechten sind zügellos, opponierende Kräfte werden immer wieder in der Presse angegriffen (in diesem Beitrag geht es um die jüngste Salve von Steve Nerem). Der Konsens könnte einfach nichts anderes sein als „eine genaue Maßzahl des vorherrschenden Bias‘ in diesem Bereich“ (h/t John Ioannidis).

Der SLR wird unverhohlen als Taktik der Panikmache herangezogen seitens der Propagandisten einer Katastrophalen Anthropogenen Globalen Erwärmung/Klimawandels. Der Anstieg des Meeresspiegels – von dem die allgemeine Öffentlichkeit inzwischen weiß, dass er weniger als 30 cm pro Jahrhundert beträgt – ist als Diskussionspunkt inzwischen verdrängt worden durch eine gefährliche SLR-Beschleunigung.

Link: https://wattsupwiththat.com/2018/01/09/sea-level-rise-and-fall-part-4-getting-a-rise-out-of-nothing/

Übersetzt von Chris Frey EIKE