Dieser Treibhauseffekt wird vor allem von der Temperatur der Aerosol-Platte, die stellvertretend für Wolken oder Aerosole steht, gesteuert. Dabei muss die Aerosol-Platte mindesten 5 °C kälter als die Erd-Platte sein, um einen messbaren Temperatur-Anstieg zu erreichen. Die Experimente präsentieren eine Fülle von überraschenden und z.T. unbekannten Facetten des Treibhauseffektes. Wenn keine zusätzliche Wärme von außen einwirkt, verursacht CO2 eine Erwärmung der Erd-Platte, ohne den Wärmetransport zur Aerosol-Platte oder die Lufttemperatur zu verändern. Der Treibhauseffekt wird überwiegend durch die natürlichen CO2-Konzentrationen bestimmt, wobei CO2 in unmittelbarer Nähe zur Erd-Platte die größte Wirksamkeit zeigt. Eine möglicherweise vom Menschen verursachte Zunahme der atmosphärischen CO2-Konzentration kann daher nur noch im geringen Umfange zur Erderwärmung beitragen.

Einführung

In der ersten Mitteilung (1) wurde eine neuartige Apparatur vorgestellt, die flexibel einsetzbar ist und unterschiedliche Aspekte des Treibhauseffektes experimentell überprüfen kann. In den ersten beiden Publikationen ging es um die wechselseitige Beeinflussung von Wolken, Aerosolen und Treibhausgasen. Es konnte nachgewiesen werden, dass es einen eigenständigen Treibhauseffekt gar nicht gibt, sondern dass die Auswirkung der Treibhausgase von den sichtbaren und unsichtbaren Aerosolen des Himmels abhängt. Mit den Formeln von Ångström und anderen Forschern wurde errechnet, dass Wasserdampf (als stärkstes Treibhausgas) bei klarem Himmel rund 30 % und bei Bewölkung sogar nur 5 % zum Treibhauseffektes beiträgt (2). Diese Befunde sind eine ernstzunehmende Kritik an der in Deutschland betriebenen CO2-Hysterie und erklären, warum diese Mitteilungsreihe bei EIKE publiziert wird.

Die vorliegende Mitteilung beschäftigt sich mit der Frage, ob die Temperaturerhöhung der Erde durch CO2 experimentell nachweisbar ist und eventuell als Demonstrationsversuch für Schüler oder Studenten verwendet werden kann.

Im Internet findet man eine ganze Reihe von Schülerexperimenten zur Demonstration des Treibhauseffektes. Wozu also noch ein weiterer Vorschlag? Kein vom Autor analysiertes Experiment entsprach den natürlichen Bedingungen einer Erde mit einer Durchschnittstemperatur von 15 °C und Atmosphäre, die von einem Temperatur-Gradienten charakterisiert ist. Vor allem Versuche, den Treibhauseffekt anhand einer Erwärmung der CO2-haltigen Luft zu demonstrieren erwies sich ein Missverständnis, dieses Effektes (3), (4). Auch wurden die Messungen nicht vor einem kalten Hintergrund durchgeführt. So wurde auch nicht die Beeinflussung des Treibhauseffektes durch Wolken und Aerosole erkannt. Die eigene Konzeption, die sich an den natürlichen Temperaturen von Erde und Atmosphäre orientiert, führte zu Labor-Experimenten, die wahrscheinlich zum ersten Mal den wahren, erdnahen CO2-Treibhauseffekt sichtbar und begreifbar macht. Da sich diese Mitteilung an die breite Öffentlichkeit wendet, wird im Folgenden der umgangssprachliche Ausdruck „Wärmestrahlung“ mit infraroter (IR) Strahlung gleichgesetzt.

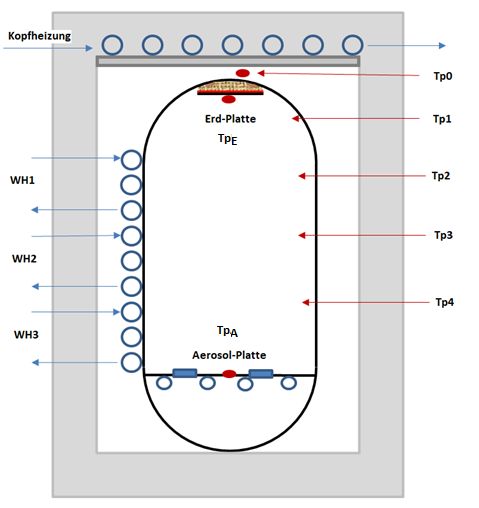

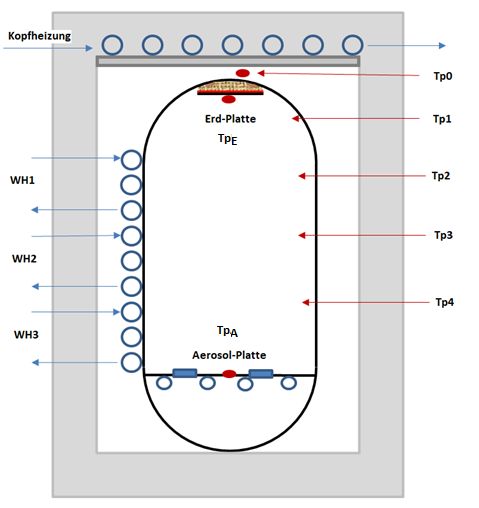

In der ersten Mitteilung (1) wurde eine Apparatur vorgestellt, die die erdnahe Atmosphäre als Modell nachahmt. Sie enthält anstelle der Erdoberfläche eine sogenannte Erd-Platte und in einem großen Abstand eine Aerosol-Platte, die stellvertretend für eine Wolkenschicht unterschiedlicher Temperatur (Höhe) steht. Die wichtigste Erkenntnis war, dass der Treibhauseffekt von der Temperatur der weit entfernten Aerosol-Platte abhängt (2). Es konnte gezeigt werden, dass Treibhausgase und Wolken/Aerosole Strahlungskonkurrenten sind, die sich gegenseitig beim Treibhauseffekt behindern. Diese Zusammenhänge wurden durch schrittweise Abkühlung der Aerosol-Platte gewonnen („Abkühlungs-Modus“).

Um eine mögliche Erwärmung der Erd-Platte nach Zugabe von CO2 zu erkennen, sollten die anderen Flächen der Apparatur (Wand und Aerosol-Platte) während eines Versuches eine möglichst konstante Temperatur haben. Für diese Aufgabe bietet sich der „Konzentrations-Modus“ an, bei dem nur die Konzentration des CO2 variiert wird. Insbesondere ist für eine konstante elektrische Heizung der Erd-Platte (QE) zu sorgen, die durch ein spezielles Labornetzgerät (Korad KA3005D) erreicht wird.

Die Luft-Temperatur zwischen Erd- und Aerosol-Platte ist bei diesen Experimenten von besonderer Bedeutung. Geht es doch um die Frage, ob die grundsätzliche These eines angeblichen „CO2-Treibhauseffektes“ eine Verletzung physikalischer Gesetze ist. Nach den Vorstellungen einiger Fundamental-Skeptiker sollte CO2 nicht zur Erderwärmung beitragen können, da das CO2 der Atmosphäre kälter als die Erdoberfläche ist und Wärme grundsätzlich nur von einem warmen zu einem kalten Körper fließt.

Zur Überprüfung dieser These ist die flexible Einsetzbarkeit der Apparatur von großem Nutzen, da auch solche Szenarien simuliert werden können. Die Lufttemperatur im Inneren der Röhre lässt sich unabhängig von der Temperatur der Erd-Platte durch die thermostatisierte Wasserheizung der Aluminium-Röhre regulieren. Dadurch wird ein Versuchsaufbau realisiert, der durch drei Temperatur-Zonen charakterisiert ist. Die Erd-Platte hat die höchste Temperatur, gefolgt von dem Luftraum für die potentielle CO2-Zugabe, der 0 – 15 °C kälter ist, und am Ende befindet sich als kältester Pol die Aerosol-Platte, 20 °C kälter als die Erd-Platte.

Sollten die Skeptiker Recht behalten, würde die Erd-Platte sich nicht erwärmen, wenn CO2 zu einem Luftraum gegeben wird, der kälter als die Erd-Platte ist. Hierzu wurden zwei Versuchsreihen mit einer 40 °C bzw. 20 °C warmen Erd-Platte durchgeführt, vergleichbar mit einer tropischen bzw. gemäßigten Klimazone der Erde. Bei beiden Versuchsreihen wurde CO2 in 7 bis 10 Schritten (bis maximal 55 Vol.-%) zu der vorher getrockneten und CO2-armen Innenluft der Apparatur zugesetzt. Nach jeder CO2-Zugabe wurde die Temperatur an sieben Stellen der Apparatur abgelesen (Abb. 4) und protokolliert.

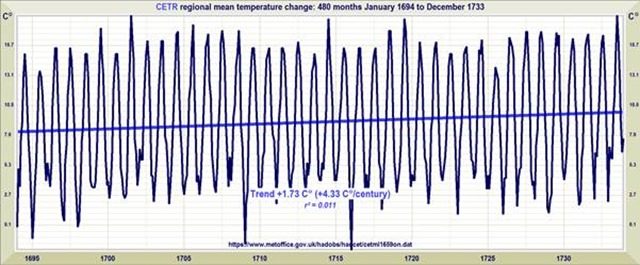

Bei der ersten Versuchsreihe (Erd-Platte = 40 °C) wurde das CO2 bei vier verschiedenen Temperaturen des Luftraumes ≤ 40 °C zugegeben um festzustellen, ob die Erd-Platte auch durch kälteres CO2 erwärmt wird.

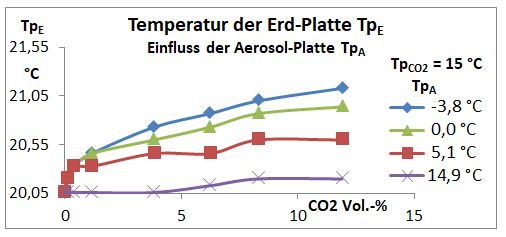

Bei der zweiten Versuchsreihe (Erd-Platte = 20 °C) wurden vier Experimente mit verschiedenen Temperaturen der Aerosol-Platte durchgeführt, um den möglichen Einfluss der Wolken-Temperatur nachzuweisen (In dieser Reihe wurde CO2 bis maximal 12 Vol.-% zugegeben).

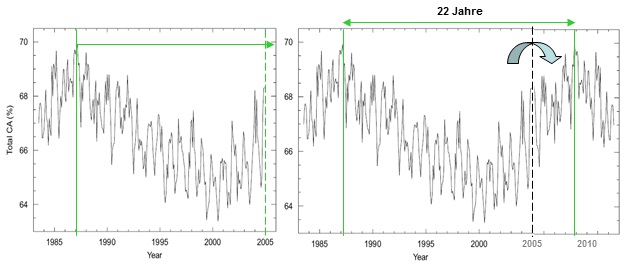

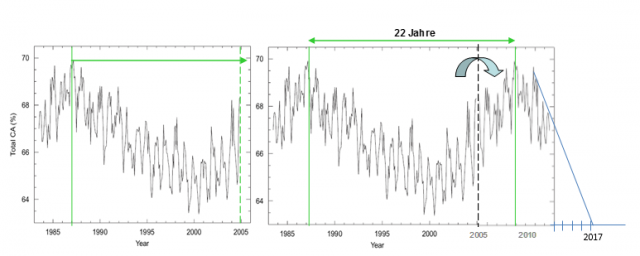

Bei allen acht Experimenten wurde bei schrittweiser Zugabe von CO2 eine fortschreitende Erwärmung der Erd-Platte beobachtet, selbst wenn das CO2 deutlich kälter als die Erd-Platte war (Abb. 1 und 2). Die Experimente zeigen, dass CO2 grundsätzlich, unter bestimmten Voraussetzungen, die Erd-Temperatur erhöhen kann! Der Mechanismus dieses sogenannten Treibhauseffektes wird in Kapitel 2 ausführlich erläutert. Soviel sei bereits verraten, mit einem Wärmefluss vom kalten CO2 zur warmen Erde hat der Treibhauseffekt nichts zu tun.

CO2 und Luft haben unterschiedliche spezifische Wärmeleitfähigkeiten (Kap. 4, Tab. 1). Um auszuschließen, dass die gemessenen Temperatur-Erhöhungen der Erd-Platte tatsächlich durch den Treibhauseffekt und nicht durch Veränderungen der Wärmeleitung verursacht werden, wurden zwei weitere Experimente mit Helium und Argon anstelle von CO2 durchgeführt. Diese Edelgase zeichnen sich ebenfalls durch unterschiedliche Wärmeleitfähigkeiten gegenüber Luft aus. Da sie IR-inaktiv sind, d.h. sie erzeugen keine Wärmestrahlung, beeinflussen sie in der Apparatur nur die Wärmeleitung. Eine denkbare Verfälschung der Ergebnisse der o.g. acht Experimente durch Wärmeleitung lässt sich eindeutig ausschließen, da bei beiden Kontroll-Versuchen die Temperatur der Erd-Platte unverändert blieb. Eine ausführliche Beschreibung dieser Versuche findet sich im Kap. 4.

Abbildung 1: Erwärmung der 40°C warmen Erd-Platte nach Zugabe von CO2 bei unterschiedlichen Lufttemperaturen TpCO2 TpE = Temperatur der Erd-Platte, TpA = Temperatur der Aerosol-Platte, TpCO2 = Temperatur der CO2-haltigen Luft

Abbildung 2: Erwärmung der 20°C warmen Erd-Platte TpE nach Zugabe von CO2 bei unterschiedlichen Temperaturen der Aerosol-Platte TpA

-

Der Mechanismus des erdnahen CO2-Treibhauseffektes

Man kann nicht behaupten, dass der Treibhauseffekt leicht zu verstehen ist. Allein schon der erbitterte Streit gestandener Wissenschaftler zeigt, dass es hier um ein komplexes Thema mit vielen Wendungen und Einflüssen geht.

Die verwendete Apparatur von rund 1 m Länge imitiert nur die ersten rund 3000 m der Atmosphäre. Es wird angenommen, dass sich in dieser Höhe eine geschlossene Wolkendecke befindet. In 3 km Höhe ist die Luft im Durchschnitt 18 °C kälter als die Erdoberfläche (0,6 °C pro 100 m), wonach die Temperatur der Aerosol-Platte ausgewählt wurde. Bezüglich der CO2-Menge ist die imitierte Schichtdicke der Atmosphäre jedoch viel kleiner und hängt von der Konzentration des zugesetzten CO2 ab. Man erhält die imitierte Schichtdicke einer Atmosphäre mit 400 ppm CO2, indem die CO2-Versuchskonzentration (in Vol.-%) durch 0,04 geteilt wird. Bei einer Konzentration von 12 Vol.-% werden demnach 300 m und bei 55 Vol.-% 1375 m einer Atmosphäre mit 400 ppm CO2 nachgebildet.

Sämtliche Betrachtungen zu den Wärmeströmen beim Treibhauseffekt beziehen sich auf den Energietransport ausschließlich durch Wärmestrahlung. Der Treibhauseffekt wird deshalb als ein idealisiertes, abgeschlossenes System behandelt. Beeinflussung des Treibhauseffektes durch andere Energieströme der Atmosphäre würde sich grundsätzlich mit der Apparatur realisieren lassen, war aber kein geplantes Ziel der vorliegenden Untersuchungen.

Im genannten Abschnitt der Atmosphäre wird neben der Wärmestrahlung auch noch Energie durch den Wasserkreislauf und durch Luftbewegungen transportiert. Diese Wärmeströme beeinflussen die Temperatur dieser Luftschichten und damit auch den CO2-Treibhauseffekt. Ein einfaches Schüler-Experiment wird durch diese Komplikationen überfordert. Auch die Relativierung der CO2-Strahlung durch die Wasserdampf-Strahlung kann wegen des hohen Siedepunktes von Wasser nicht untersucht werden.

Um den Treibhauseffekt zu verstehen, muss man sich zunächst klarmachen, dass jeder (feste und flüssige) Körper unserer natürlichen Umgebung (auch die Aerosole der Atmosphäre) ständig Wärmestrahlen, ein unsichtbares Licht, aussendet. Wie auch bei einer Glühlampe wird hierzu Energie benötigt. Im Gegensatz zur Glühlampe ist aber eine äußere Energiequelle nicht zwingend notwendig. Die Energie für die Wärmestrahlung kann auch aus der inneren Energie des Körpers, aus der kinetischen und potentiellen Energie seiner Atome oder Moleküle, ihren inneren Schwingungen und Rotationen entnommen werden. In diesem Falle müsste sich der Körper durch ständigen Verbrauch von Energie abkühlen. Das passiert i.d.R. aber nicht, da der Körper auch Wärmestrahlung aus seiner Umgebung empfängt, so dass (nach einiger Zeit) alle Körper in einem geschlossenen Raum die gleiche Temperatur haben (Gesetz nach Kirchhoff).

Wir können diesen Austausch an Wärmestrahlung nicht sehen, da dieses infrarote Licht (IR-Strahlung) für unsere Augen unsichtbar ist. Die fehlende Wahrnehmung dieser Strahlung ist wahrscheinlich der Grund, dass viele Menschen allein schon mit dem Begriff „Strahlung“ Probleme haben und eher an Fukushima oder Tschernobyl als an ihre natürliche Umwelt denken. Wärmestrahlung lässt sich aber erfahren, wenn man z.B. seine Hand einem sehr heißen Gegenstand nähert oder eine Wärmebild-Kamera nutzt. Die Größe dieser Strahlung (Strahlungsdichte = Energie pro Fläche) wird nach der Gleichung von Stefan und Boltzmann anhand der Temperatur (T hoch 4 Gesetz) für einen idealen, sogenannten „schwarzen“ Körper berechnet. Die warme Erd-Platte erzeugt danach bei 20 °C eine Wärmestrahlung von 419 W/m2 und bei 40 °C sind es 545 W/m2. Wäre die Erd-Platte isoliert im Weltall, weit weg von anderen Himmelskörpern, würde sie sich abkühlen und ihre Temperatur würde sich nach einiger Zeit dem absoluten Nullpunkt (- 273,15 °C) nähern und zwar ausschließlich nur durch Strahlungskühlung (Abgabe von Energie durch Wärmestrahlung).

In der Apparatur ist das anders, da die Erd-Platte auch Empfänger einer Wärmestrahlung ihrer Umgebung ist. Diese sogenannte Gegenstrahlung wird hauptsächlich von der Aerosol-Platte erzeugt. Wegen der geringeren Temperatur der Aerosol-Platte ist die Gegenstrahlung jedoch kleiner als die Wärmestrahlung der Erd-Platte. Unterm Strich bleibt also eine gewisse Differenz von gesendeter und empfangener Strahlung übrig, die den Wärmeverlust (Strahlungskühlung) der Erd-Platte definiert. Genau diese Menge an Wärmeverlust wird im Experiment durch die elektrische Heizung QE geliefert, wodurch Energie-Abgabe und -Aufnahme der Erd-Platte gleich groß sind und ihre Temperatur konstant bleibt.

Im Gegensatz zu festen und flüssigen Körpern können nur bestimmte, sogenannte IR-aktive Gase, wie z.B. CO2, eine Gasstrahlung erzeugen (6). Dabei ist die CO2-Strahlung keine thermische Strahlung (Wärmestrahlung) sondern eine Linien-Strahlung ausgewählter Wellenlängen. Füllt man CO2 in die Apparatur, nimmt das Gas die Temperatur der warmen Aluminiumwand an und erzeugt eine Gasstrahlung, die (im Wellenlängen-Bereich der CO2-Emissionsbanden) größer ist als die der (kälteren) Aerosol-Platte. Die Gegenstrahlung wird dadurch erhöht, wodurch sich die Strahlungskühlung der Erd-Platte verringert. Strahlungskühlung und Heizung der Erd-Platte QE sind nicht mehr im Gleichgewicht, wenn die Heizung QE konstant blieb. Es kommt zu einem Wärmestau, wodurch sich die Erd-Platte erwärmt. Durch die höhere Temperatur kann nun die Erd-Platte (nach dem Gesetz von Stefan-Boltzmann) mehr Wärme ausstrahlen, wodurch auch wieder die Strahlungskühlung ansteigt bis letztendlich Wärmeverlust und Heizung der Erd-Platte wieder gleich sind, d.h. die Strahlungskühlung erreicht wieder ihren alten Wert.

Solange keine äußere Energie in den Austausch von Strahlungswärme eingreift ist der Wärmeverlust der Erd-Platte identisch mit dem Wärmetransport von der Erd- zur Aerosol-Platte. Mit anderen Worten, die Heizwärme QE wird unverändert durch Wärmestrahlung auf die Aerosol-Platte übertragen. Andere denkbare Wärmeströme zwischen Erd- und Aerosol-Platte wie z.B. Konvektion oder Diffusion sind durch die Art der Konstruktion der Apparatur ausgeschlossen (1). Somit lässt sich für den „reinen“ Treibhauseffekt formulieren:

In einem geschlossenen System bewirkt CO2 eine Erwärmung der Erd-Platte ohne den Wärmetransport zur Aerosol-Platte zu verändern.

CO2 verliert zwar Energie durch den Strahlungsaustausch mit der kälteren Aerosol-Platte, aber gewinnt auf der anderen Seite eine gleich große Menge an Energie von der Erd-Platte durch ihre, von CO2 verursachte, gesteigerte Wärmeausstrahlung. In einem geschlossenen System sind Absorption und Emission der CO2-Moleküle gleich groß. Alles andere wäre eine Verletzung des Energieerhaltungssatzes von Julius Robert Mayer. In Übereinstimmung damit wurde bei den oben genannten Experimenten gefunden, dass die Lufttemperatur bei einem konstanten Wärmetransport durch CO2 nicht verändert wird. Somit lässt sich ein weiterer Lehrsatz formulieren:

Die Lufttemperatur zeigt nicht den Treibhauseffekt, sondern Veränderungen des Wärmetransportes an.

Diese Anpassung der Luft-Temperatur an den Wärmestrom wird durch die stärkere Temperatur-Abhängigkeit der CO2-Emission gegenüber seiner Absorption ermöglicht. Für diese These gibt es experimentelle Beweise. Wird z.B. die Erd-Platte durch eine Rotlichtlampe ersetzt, steigt die Luft-Temperatur bei Zugabe von CO2 an, da hier der Wärmestrom zunimmt und CO2 eine höhere Temperatur für eine adäquate Emission benötigt (3). Beispiele für einen konstanten Wärmestrom und konstante Lufttemperaturen sind die hier vorgestellten Experimente, insbesondere Versuch Nr. 5/3 (Tab. 12, ohne Wandheizung). Bei anderen Experimenten, die demnächst publiziert werden sollen, wurde die Heizung QE während eines Versuches gesenkt, um eine konstante Temperatur der Erd-Platte zu bekommen. Hier wurde sogar eine Abkühlung der Luft nach Zugabe von CO2 beobachtet.

Diese Erkenntnis erklärt, dass alle bisherigen, angeblichen Demonstrations-Versuche des Treibhauseffektes den falschen Effekt untersucht haben. Ob sich die Luft-Temperatur nach Zugabe von CO2 ändert, hängt in erste Linie von den Prozessparametern ab. Damit lässt sich erklären, warum beim bekannten Al-Gore-Experiment eine Erwärmung der Luft auftrat, aber bei einer Überprüfung durch Anthony Watts eine Abkühlung gefunden wurde.

Al Gore hatte keine detaillierten Angaben zu den Versuchsbedingungen gemacht, so dass Watts nur auf Vermutungen angewiesen war. Je nach Versuchsbedingungen wurde von Watts entweder keine Erwärmung oder sogar eine Abkühlung festgestellt (4).

-

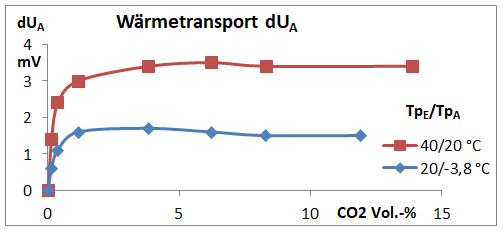

Der von CO2 beeinflusste Wärmetransport

Bei den o.g. Experimenten wird der Wärmetransport in der Apparatur von Peltier-Elementen registriert. Die Peltier-Elemente sind fest mit der Aerosol-Platte verbunden. Sie messen sowohl Wärmestrahlung als auch Wärmeleitung, die auf die Aerosol-Platte einwirken.

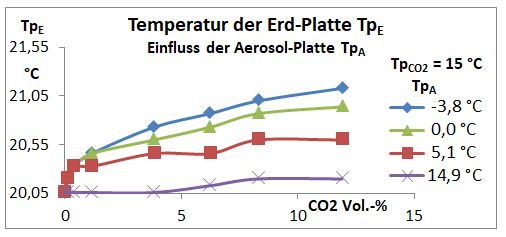

Bei Zugabe von CO2 im Bereich kleiner CO2-Konzentrationen kam es zu einem starken Anstieg des Wärmetransportes, um bei hohen Konzentrationen zu stagnieren (Abb. 3). Ist damit die These eines konstanten Wärmetransportes widerlegt? Nein, diese Regel gilt nur für sehr kleine CO2-Konzentrationen (wie in der Atmosphäre) und für geschlossene Systeme (ohne äußere Energieeinwirkung). Das sind Voraussetzungen, die bei den o.g. Experimenten nicht erfüllt waren, da hohe CO2-Konzentrationen eingesetzt werden müssen, um eine Atmosphäre von rund 1500 m simulieren zu können. Auch durch die Wandheizungen wurde unbeabsichtigt Energie zugeführt, so dass kein geschlossenes System vorlag.

Peltier-Elemente erzeugen eine Spannung im millivolt-Bereich wenn ihre Oberseite wärmer als ihre Unterseite ist. Da ihre Unterseiten fest mit der kalten Aerosol-Platte verbunden sind, zeigen die in Reihe geschalteten Peltier-Elemente bereits vor Zugabe von CO2 den Wärmetransport innerhalb der „leeren“ Apparatur durch eine Spannung bis zu 100 mV an. Setzt man diesen Anfangswert gleich null, lässt sich so der Einfluss von CO2 auf den Wärmetransport anhand der veränderten Spannungen der Peltier-Elemente dUA erkennen. Im Folgenden wird der Einfachheit halber der Wärmetransport mit der Spannungsänderung dUA gleichgesetzt.

Abbildung 3: Zunahme des Wärmetransportes bei den Versuchen Nr. 8/3 und 34/3

Abbildung 4: Schematische Darstellung der Messstellen TpE, TpA, Tp0 bis Tp4, der Kopfheizung und der Wandheizung WH1 bis WH3

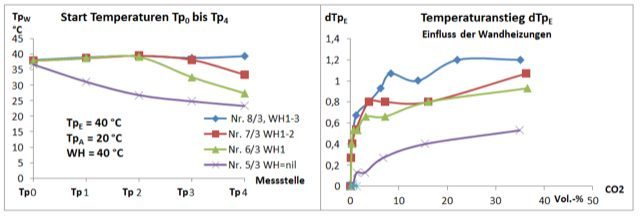

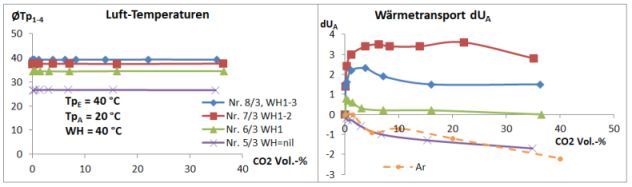

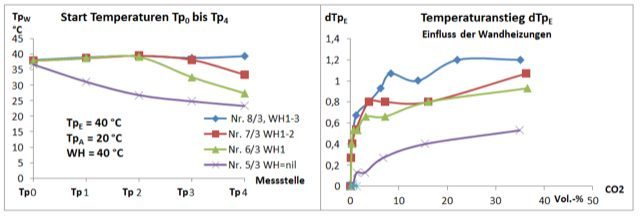

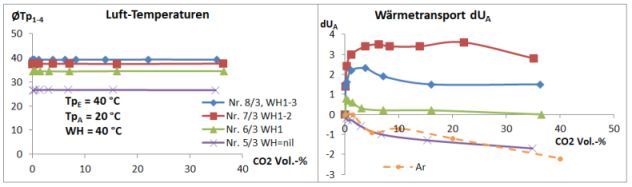

Abbildung 5: Einfluss der Wandheizungen auf die Luft-Temperaturen (Tp0 – Tp4) und Temperaturanstieg der Erd-Platte dTpE

Abbildung 6: Konstante Luft-Temperaturen (Øtp1-4) und Veränderungen des Wärmetransportes dUA in Abhängigkeit von der Wandheizung

-

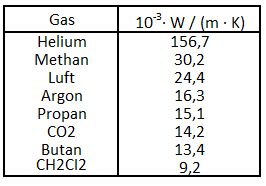

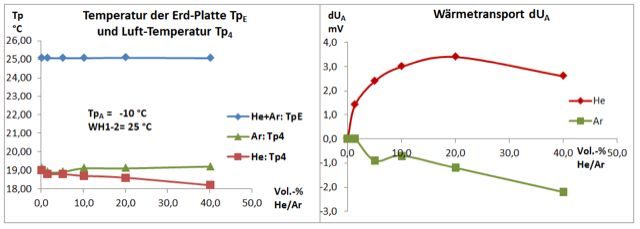

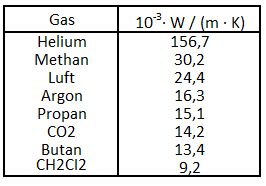

Der Einfluss von Helium und Argon auf die Wärmeleitung

Es sollte festgestellt werden, ob die gefundenen Ergebnisse zum CO2-Treibhauseffekt von der CO2-Wärmeleitfähigkeit beeinflusst wurden. Hierzu wurden, wie im Kap. 1. angeben, zur „leeren“ Apparatur die IR-inaktiven Edelgase Helium und Argon zugesetzt. Diese Edelgase können keine Wärmestrahlung erzeugen, aber zeichnen sich durch sehr unterschiedliche spezifische Wärmeleitfähigkeiten im Vergleich zu Luft aus (Tab. 1).

Tabelle 1: Spezifische Wärmeleitfähigkeit einiger Gase

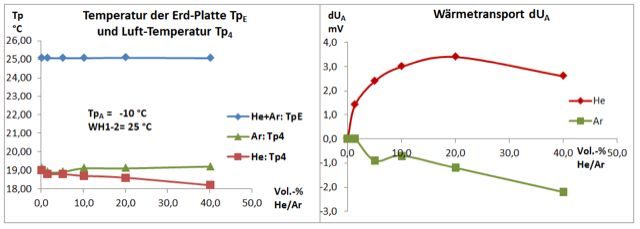

Abbildung 7: Temperatur- und Wärmetransport-Änderungen durch Helium und Argon.

-

Experimenteller Teil

Die äußeren Teile der Apparatur (Wärmeisolierung, Kopfheizung und Kühlaggregat) wurden im Verlauf der Untersuchungen zur experimentellen Verifikation des Treibhauseffektes mehrfach geändert. Bis April 2018 wurden insgesamt 495 Experimenten durchgeführt. Das mag übertrieben sein, aber neue Wege brauchen eben ihre Zeit. Ein umfangreicher Datenvorrat erschien notwendig, Vertrauen aufzubauen, dass die sehr kleinen Treibhauseffekte real sind und ausreichend genau und reproduzierbar bestimmt wurden.

Die in diesem Bericht vorgestellten Experimente stammen hauptsächlich aus dem Jahre 2015. In dieser Zeit befanden sich die Schläuche für die Kopfheizung, anders als in (1) angegeben, auf einer Styroporplatte oberhalb des Doms (Abb. 4).

Um den Einfluss von CO2 studieren zu können, muss vor Beginn eines Experimentes die Treibhausgase Wasserdampf und CO2 aus dem Innenraum der Apparatur fast vollständig entfernt werden, um einen definierten Anfangswert zu bekommen. Hierzu wird die Innenluft der Apparatur mit einer Luftpumpe für Aquarien bis zu 24 Stunden über feste Natronlauge geleitet, bis eine CO2-Konzentration << 100 ppm erreicht ist. Die Heizung QE der Erd-Platte wird solange variiert bis die gewünschte Temperatur dieser Platte erreicht ist. Danach wurde die Spannung für eine konstante Heizung QE nur noch geringfügig verändert (der ohmsche Widerstand der Heizdrähte ist von der Temperatur der Erd-Platte abhängig!). Die Heizleistung QE wird aus dem Produkt der gemessenen Spannung und Stromstärke, bezogen auf eine fiktive Erd-Platte von 1 m2, errechnet.

Die Aerosol-Platte wird an ein Glykol/Wasser Bad angeschossen, das von einem Kühlaggregat auf die entsprechend Temperatur abgekühlt wird. Ein elektrischer Heizstab in diesem Bad erlaubt eine Feinregulierung für eine konstante Temperatur der Aerosol-Platte während eines Versuches. Die Heizung der Seitenwand ist in drei gleichgroße Segmente WH 1 – 3 eingeteilt, die unabhängig voneinander mit temperierten Wasser aus einem Thermostaten bedient werden können (Abb. 4). Unabhängig von der Wandheizung ist die Aluminiumröhre noch mit einer 9,5 cm dicken Schicht aus Styroporkugeln als Isolierung gegenüber dem Versuchsraum umgeben.

Tp0 ist die von außen gemessene Oberflächen-Temperatur des Doms, Tp1 bis Tp4 sind die Lufttemperaturen im Dom bzw. der Aluminiumröhre in rund 25 cm Abständen (Abb. 4) bzw. (1).

Die Temperaturänderungen der Erd-Platte dTpE und die Spannungsveränderungen der Peltier-Elemente dUA sind die Differenz zum jeweils ersten Wert ohne CO2. Sie charakterisieren die Wirkung von CO2 und sind das wichtigste Ergebnis der Experimente.

-

-

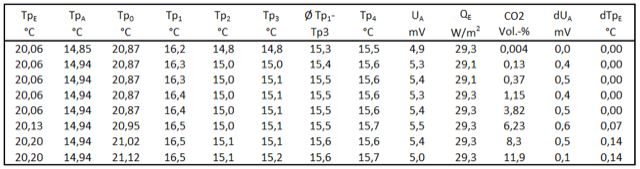

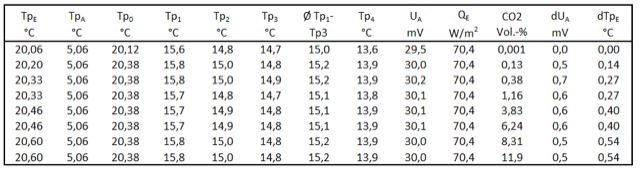

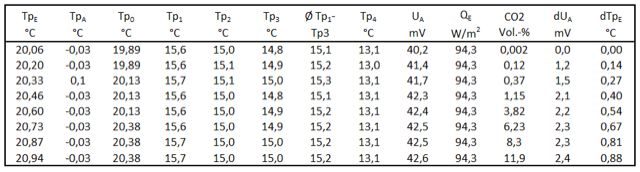

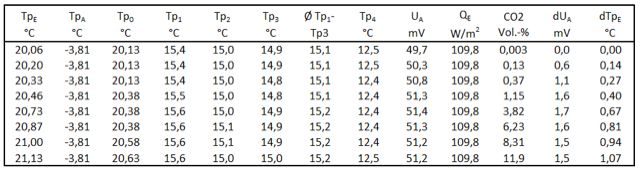

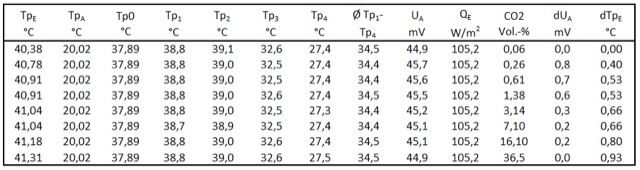

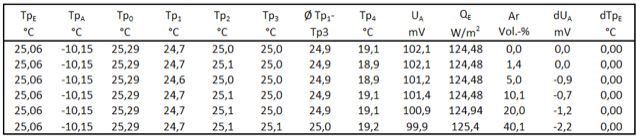

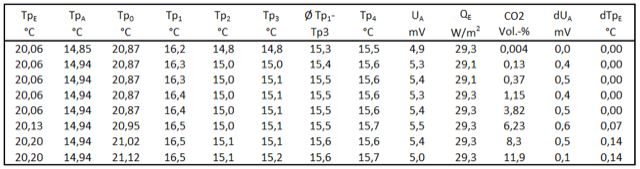

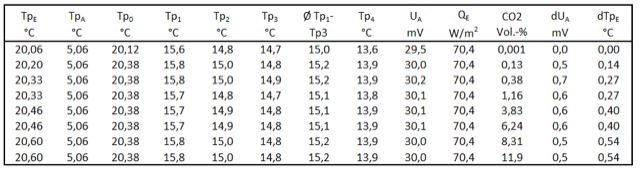

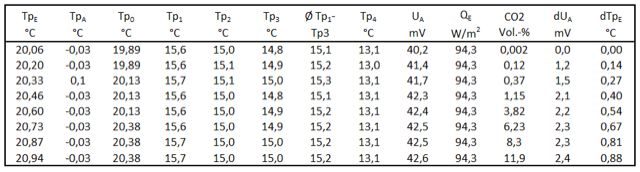

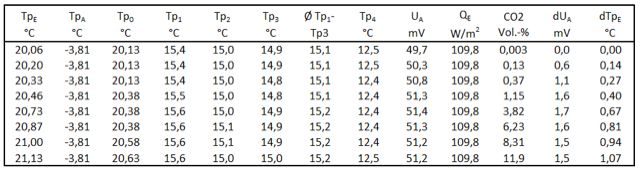

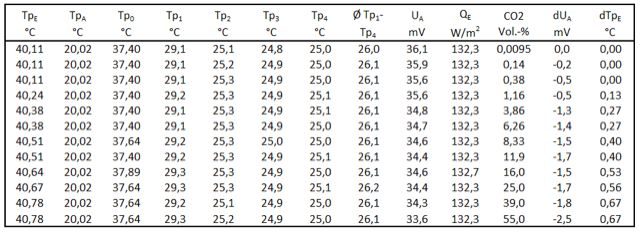

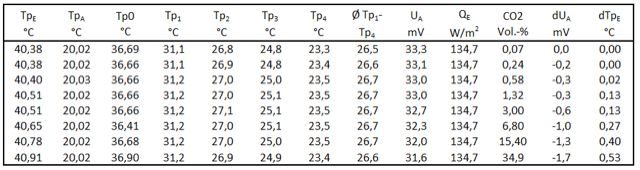

Der Einfluss der Hintergrundstrahlung der Aerosol-Platte

Es wurden vier Versuche bei unterschiedlichen Temperaturen (von + 15 bis – 3,8 °C) der Aerosol-Platte durchgeführt. Die Spannung für die elektrische Heizung der Erd-Platte QE wurde vor CO2-Zugabe solange variiert bis diese Platte eine Temperatur von 20,06 °C hatte. Danach wurde QE nicht mehr verändert und in sieben Schritten die CO2-Konzentration bis auf 11,9 Vol.-% erhöht und nach jeder CO2-Zugabe alle Temperaturen registriert (Tab. 2 bis 5). Die Temperatur-Werte für die Erd-Platte sind in Abb. 2. grafisch dargestellt.

Die Wandsegmente WH1 und WH2 wurden von einem Thermostaten mit 15,0 °C warmen Wasser versorgt. Das dritte Segment WH3, im Messbereich von Tp4, wurde nicht an den Thermostat angeschlossen, um eventuelle Veränderungen der CO2-Temperaturen ohne äußere Beeinflussung erkennen zu können. Es wurden jedoch keine signifikanten Beeinflussungen der Tp4-Daten durch CO2 festgestellt.

Erwartungsgemäß verringerte sich bei den einzelnen Versuchen jedoch die Start-Temperatur von Tp4 von 15,5 °C (Tab. 2) bis auf 12,5 °C (Tab. 5) durchihre Nähe zur Aerosol-Platte und ihre abnehmende Temperatur TpA.

Die Wassertemperatur der Kopfheizung betrug 20 °C. Tp0 zeigte bei Zugabe von CO2 einen ähnlichen Temperatur-Anstieg wie die Erd-Platte, da auch der Dom der ansteigenden Wärmestrahlung des CO2 ausgesetzt ist.

Tabelle 2: Versuch Nr. 36/3, Temperatur der Aerosol-Platte = 15 °C

Tabelle 3: Versuch Nr. 32/3, Temperatur der Aerosol-Platte = 5 °C

Tabelle 4: Versuch Nr. 33/3, Temperatur der Aerosol-Platte = 0 °C

Tabelle 5: Versuch Nr. 34/3, Temperatur der Aerosol-Platte = – 3,8 °C

-

-

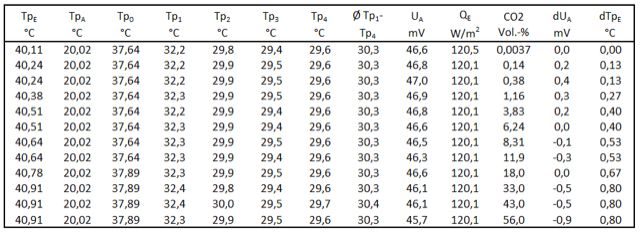

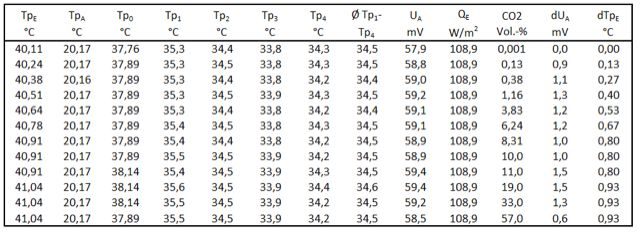

Der Einfluss der CO2-Temperatur

Alle drei Wandsegmente WH1 bis WH3 wurden vom gleichen Thermostaten mit warmem Wasser versorgt. Es wurden vier Versuche bei unterschiedlicher Thermostaten-Temperatur (von 20 bis 40 °C) durchgeführt. Die Temperatur-Messstellen Tp2 bis Tp4 werden von diesen Wandheizungen gesteuert und zeigen annähernd gleiche Werte. Die Messstelle Tp1 befindet sich im oberen Dom und zeigt eine Misch-Temperatur von Dom und Wandheizung an. Die CO2-Temperatur wird als Durchschnitt von Tp1 bis Tp4 definiert. Im Messbereich Tp1 wird ein leichter Temperatur-Anstieg bei hohen CO2-Konzentrationen registriert, der durch die steigenden Temperaturen von Erd-Platte und Dom verursacht wird. Die Durchschnitts-Temperaturen von Tp1 bis Tp4 zeigten keine signifikante Änderung bei Erhöhung der CO2-Konzentration.

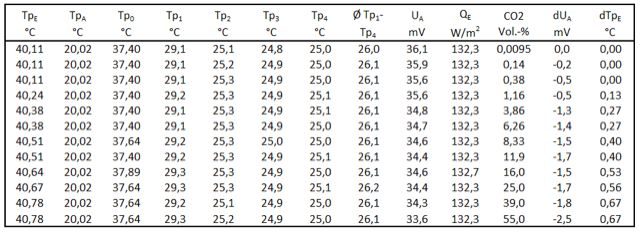

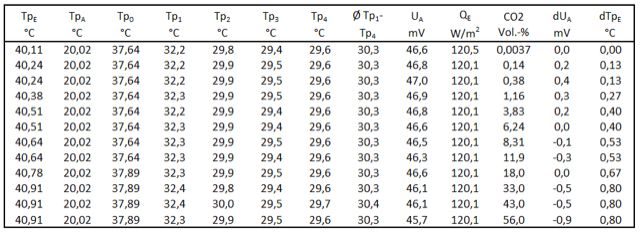

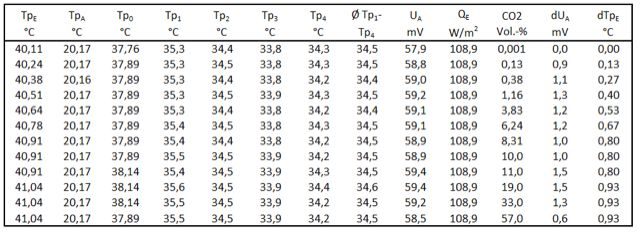

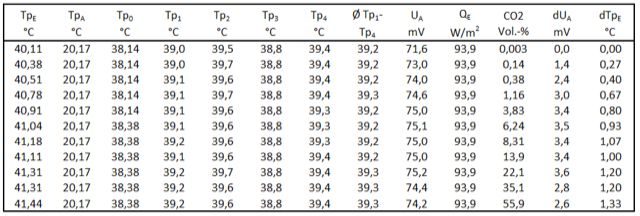

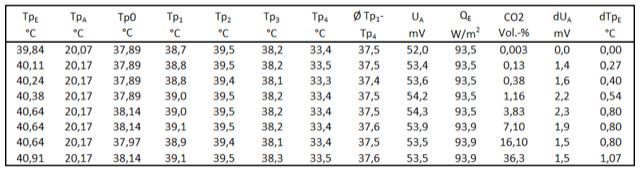

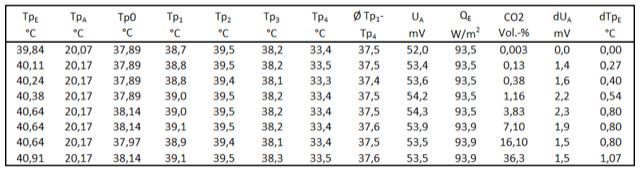

Die Spannung für die elektrische Heizung der Erd-Platte QE wurde vor CO2-Zugabe solange variiert bis diese Platte eine Temperatur von 40,11 °C hatte. Danach wurde QE nicht mehr verändert und in 11 Schritten die CO2-Konzentration bis auf rund 55 Vol.-% erhöht und nach jeder CO2-Zugabe alle Temperaturen registriert (Tab. 6 bis 9). Die Temperaturen der Erd-Platte sind in Abb. 1 grafisch dargestellt. Eine grafische Darstellung für die Veränderungen des Wärmetransportes findet sich in Abb. 3.

Tabelle 6: Versuch Nr. 11/3, Wandheizung WH1 – 3 = 25 °C, CO2-Temperatur (Ø Tp1-Tp4) = 26,1 °C

Tabelle 7: Versuch Nr. 10/3, Wandheizung WH1 – 3 = 30 °C, CO2-Temperatur (Ø Tp1-Tp4) = 30,3 °C

Tabelle 8: Versuch Nr. 9/3, Wandheizung WH1 – 3 = 35 °C, CO2-Temperatur (Ø Tp1-Tp4) = 34,5 °C

Tabelle 9: Versuch Nr. 8/3, Wandheizung WH1 – 3 = 40 °C, CO2-Temperatur (Ø Tp1-Tp4) = 39,2 °C

-

-

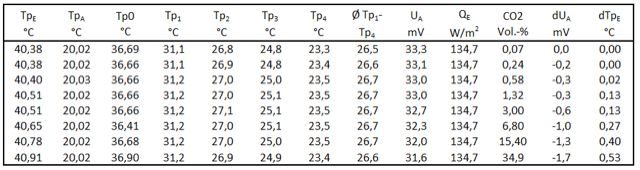

Der Einfluss der Wandheizung

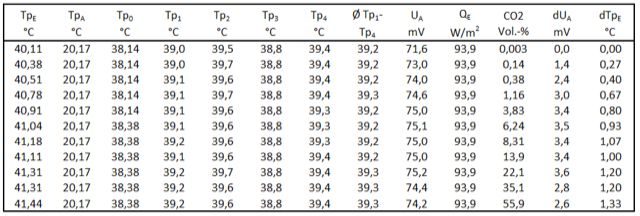

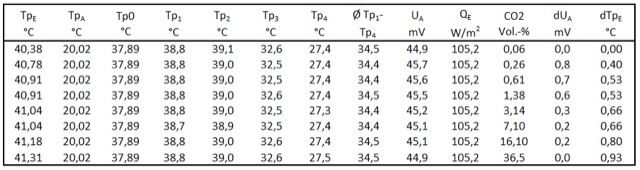

Bei dem Kontrollversuch handelt es sich um eine Wiederholung von Versuch 8/3 (Tab. 9), jedoch wurden die Wandheizungen nacheinander abgeschaltet. Je nach Anzahl der Heizzonen bilden sich unterschiedliche Temperaturen in der Röhre aus.

Tabelle 10: Versuch Nr. 7/3, WH1 + 2 = 40 °C ; Temperaturgradient: Tp1 = 38,9 , Tp2 = 39,5, Tp3 = 38,2, Tp4 = 33,4 °C (Ø)

Tabelle 11: Versuch Nr. 6/3, WH1 = 40 °C ; Temperaturgradient: Tp1 = 38,8 , Tp2 = 39,0, Tp3 = 32,5, Tp4 = 27,4 °C (Ø)

Tabelle 12: Versuch Nr. 5/3, ohne Wandheizung; Temperaturgradient: Tp1 = 31,2 , Tp2 = 27,0, Tp3 = 25,0, Tp4 = 23,4 °C (Ø)

5.4. Der Einfluss der Wärmeleitung

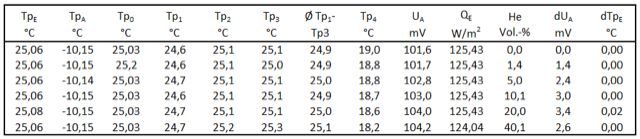

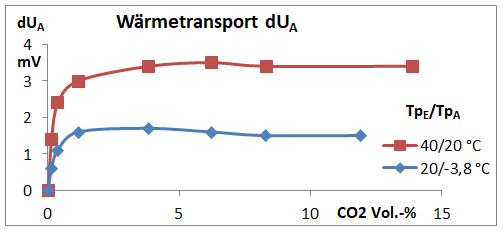

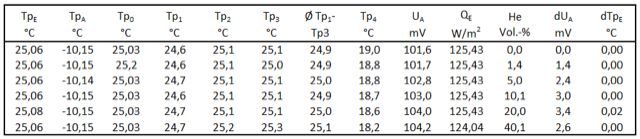

Die Wandsegmente WH1 und WH2 und die Kopfheizung wurden von einem Thermostaten mit 25,0 °C warmen Wasser versorgt. Das dritte Segment WH3, im Messbereich von Tp4, wurde nicht an den Thermostat angeschlossen, um eventuelle Veränderungen durch Zugabe der Edelgase erkennen zu können.

Die Spannung für die elektrische Heizung der Erd-Platte QE wurde vor Zugabe der Edelgase solange variiert bis diese Platte eine Temperatur von 25,06 °C hatte. Danach wurde QE nicht mehr verändert und in 5 Schritten die Konzentration der Edelgase bis auf 40 Vol.-% erhöht und nach jeder Konzentration-Erhöhung alle Temperaturen registriert. Die Veränderungen des Wärmetransportes dUA sind in Abb. 7 grafisch dargestellt.

-

-

-

Der Einfluss von Helium

Helium hat eine extrem hohe spezifische Wärmeleitfähigkeit von 156,7 W/(m ∙ K). Durch die steigende Wärmeleitung bei der Zugabe von Helium steigt auch der Wärmetransport dUA stark an und führt sogar zu einer Abkühlung an der Messstelle Tp4 von anfangs 19,0 bis 18,2 °C. Die Temperatur der Erd-Platte wird durch Helium jedoch nicht beeinflusst (dTpE = 0).

Tabelle 13: Versuch 19/6: Einfluss von Helium auf die Temperatur der Erd-Platte TpE und dem Wärmetransport dUA.

-

-

-

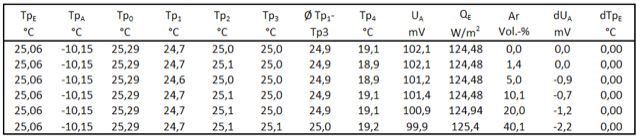

Der Einfluss von Argon

Argon hat mit 0,0163 W/(m ∙ K), ähnlich wie CO2 (0,0142), eine geringere spezifische Wärmeleitfähigkeit als Luft (0,0244). Durch die sinkende Wärmeleitung bei der Zugabe von Argon verringert sich auch der Wärmetransport dUA. Die Wärmeleitung von Gasgemischen ist eine lineare Funktion ihrer Zusammensetzung. Diese Abhängigkeit konnte im Falle von Argon sogar festgestellt werden, da sich in diesem Fall die Temperatur der Messstelle Tp4 kaum änderte. Die Temperatur der Erd-Platte wird durch Argon nicht beeinflusst (dTpE = 0).

Tabelle 14: Versuch 21/6: Einfluss von Argon auf die Temperatur der Erd-Platte TpE und dem Wärmetransport dUA.

Literaturverzeichnis

1. Schnell, Michael. Experimen�telle Verifi�kation des Treibhaus�effektes Teil 1: Die gegen�seitige Beein�flussung von Wolken und Treibhaus�gasen. [Online] 25. März 2018. https://www.eike-klima-energie.eu/2018/03/25/experimentelle-verifikation-des-treibhauseffektes-teil-1-die-gegenseitige-beeinflussung-von-wolken-und-treibhausgasen/.

2. —. 2.Mitteilung: Die Hintergrundstrahlung der Wolken und Aerosole. [Online] https://www.eike-klima-energie.eu/2018/06/03/experimentelle-verifikation-des-treibhauseffektes/.

3. Stephan Sirtl. Absorption thermischer Strahlung durch atmosphärische Gase. [Online] 12. 11 2010. [Zitat vom: 15. 01 2018.] http://hpfr03.physik.uni-freiburg.de/arbeiten/diplomarbeiten/sirtl_staatsexamen_2010.pdf.

4. Anthony Watts. Anthony Watts Thrashes Al Gore’s Climate Change Experiment. [Online] 20. 11 2011. [Zitat vom: 12. 01 2018.] https://shortlittlerebel.com/2011/10/20/anthony-watts-thrashes-al-gores-climate-change/.

5. Naturwissenschaftliche Anmerkungen zu Argumenten der Treibhausdiskussion. Volz, Hans. 9, s.l. : Erdöl-Erdgas-Kohle, 2015, Bd. 116.

6. Gasstrahlung. [Online] 2018. Juni 2018. https://de.wikipedia.org/wiki/Gasstrahlung.

Anmerkung: Dieser Beitrag liegt als PDF auch auf Englisch vor:

3. Communication – Experimental verification of the greenhouse effect_EN

———————————-

Aktualisierung: Reaktion auf Kommentare

Werte Kommentatoren!

Eine pauschale Ablehnung der vorgestellten Ergebnisse ist wenig hilfreich und führt zu keinem Erkenntnisgewinn. Wer sich wirklich konstruktiv an einer Diskussion zur experimentellen Überprüfung des Treibhauseffektes beteiligen möchte, sollte auf konkrete Fehler hinweisen oder sich eventuell über dem Admin meine Email-Adresse geben lassen. Die Schwäche einer Opposition ist ihre Zerstrittenheit und das ist, zur Freude der Klima-Alarmisten, bei Ihren Kommentaren leider auch nicht anders.

Die gefundenen Temperaturen sind Werte, die nur das Experiment charakterisieren. Sie dürfen nicht und schon gar nicht 1:1 auf die reale Erde übertragen werden, da die Temperatur der Erde nicht nur vom CO2-Treibhauseffekt, sondern auch noch von einer Vielzahl anderer Wärmeströme beeinflusst wird. Die Temperatur-Bestimmung der Erde ist eine Aufgabe, die die Apparatur nicht leisten kann und die auch nie geplant war. Die Frage, kann die Temperatur einer warmen Erd-Platte durch eine kältere, CO2-haltige Gasphase erhöht werden, wurde jedoch eindeutig bejaht. Das ist zwar kein endgültiger Beweis des Treibhauseffektes, aber auch keine Widerlegung. Es ist, wie so oft in der Wissenschaft, nur ein kleiner Baustein, der in diesem Falle zeigt, dass von CO2 auch bei den Temperaturen der erdnahen Atmosphäre eine Wärmestrahlung ausgehen kann, die sich in allen Richtungen ausbreitet und zur Erwärmung der Erde einen Beitrag leisten kann.

Es gab zwei fachliche Einwendungen/Fragen, auf die ich eingehen möchte.

Die Apparatur steht auf dem Kopf!

Das Konzept des CO2-Treibhauseffektes beinhaltet ausschließlich die Wirkung der Wärmestrahlungen. (Nicht zu verwechseln mit dem Glashauseffekt, hier spielt auch das sichtbare Licht eine Rolle). Wenn man also den CO2-Effekt überprüfen will, muss man alle anderen Wärmeströme entweder kontrollieren oder ausschalten. In der Apparatur wurde Wärme von der Erd-Platte auf die 1,10 m entfernte Aerosol-Platte durch eine Gasphase übertragen. Dabei gibt es drei Möglichkeiten des Wärmetransportes: 1. Wärmestrahlung, 2. Konvektion, 3. Wärmeleitung bzw. Diffusion. Der 3. Punkt lässt sich nicht verhindern, hat aber zum Glück eine kurze Reichweite. Die Kontrollversuche mit Argon/Helium haben gezeigt, dass die Wärmeleitung keinen Einfluss auf die Temperatur der Erd-Platte hatte. Punkt 3 kann also ignoriert werden. Die Konvektion ist eine ernstzunehmende Konkurrenz zur Wärmestrahlung. Hätte sich die warme Erd-Platte „unten“ befunden, wäre warme Luft, der Gravitation folgend, zur kalten Aerosol-Platte aufgestiegen und man hätte immer zwei Effekte gemessen. Die umgekehrte Anordnung der Platten löst das Problem, da die kalte Luft über der „unten“ befindlichen Aerosol-Platte nicht aufsteigen kann. Für die Wärmestrahlung spielt die Gravitation jedoch keine Rolle. Wärmestrahlung breitet sich in alle Richtungen gleichmäßig aus. Die Apparatur simuliert hinsichtlich der Wärmestrahlung die erdnahe Atmosphäre, auch wenn sie quasi auf dem Kopf steht. Wichtig sind nur die Temperaturen der Erd- und Aerosol-Platte, die die erdnahe Atmosphäre charakterisieren.

Spezifische Wärme der Gasphase

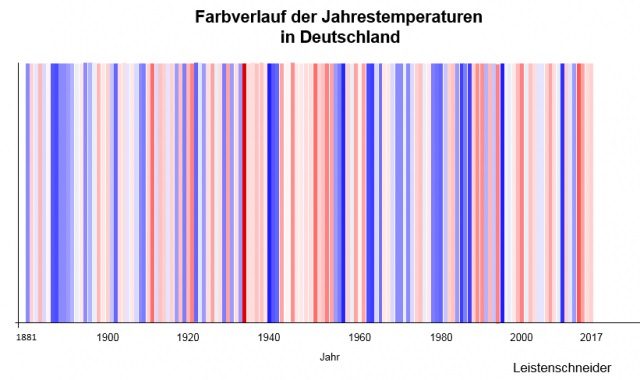

Die spezifische Wärme der Gasphase würde eine Rolle spielen, wenn man eine zeitlich abhängige Erwärmung untersuchen würde. Die Versuche waren aber genau das Gegenteil. Nach jeder CO2-Zugabe wurde solange gewartet, bis sich keine Temperaturänderungen mehr feststellen ließen. In der Regel vergingen zwischen zwei Messungen etwa 1,5 – 2 Stunden.