Wenn etwas schlechter wird, hat die Schuld immer der Klimawandel …

Deutsche Stromversorgung bleibt verlässlich, aber …

Die Pressemitteilung der Bundesnetzagentur [2] dient dem Zweck, den deutschen Untertanen zu vermitteln, dass das EEG ein Segen für unser Energiesystem ist und alle bösen Stimmen, welche Probleme vermitteln wollen, Unrecht haben. Wenn es überhaupt Probleme gibt, dann ist es der Klimawandel mit seinen unerbittlichen Folgen:

BNetzA: [2] Vizepräsident Franke: „Deutsche Stromversorgung bleibt verlässlich“ … Die Energiewende und der steigende Anteil dezentraler Erzeugungsleistung haben weiterhin keine negativen Auswirkungen auf die Versorgungsqualität“, so Franke weiter …

Allerdings wurde auch festgestellt, dass zwischen dem Jahr 2017 und dem Jahr 2016 die Länge der Ausfallzeiten angestiegen ist:

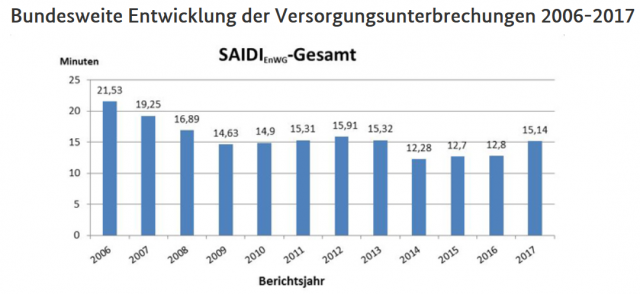

BNetzA: [2] … Im Jahr 2017 lag die durchschnittliche Unterbrechungsdauer je angeschlossenem Letztverbraucher in der Nieder- und Mittelspannung bei 15,14 Minuten. Im Jahr 2016 lag sie bei 12,80 Minuten ...

Doch liegt das selbstverständlich nicht am EEG, sondern dem bekannten Erdzerstörer (AGW-)Klimawandel, der wie allgemein bekannt, auch Deutschland mit zunehmendem Extremwetter „geißelt“ [3]:

BNetzA: [2] … Anstieg wegen extremer Wetterereignisse

… Ausfallzeiten im Verteilnetz, deren Ursache in Wetterereignissen liegen, haben sich gegenüber dem Vorjahr mehr als verdoppelt. Hierunter fallen beispielsweise Stürme, Hochwasser oder Schnee … „Ursache für den Anstieg der Versorgungsunterbrechung in Mittel- und Niederspannungsebene sind vor allem die Zunahme extremer Wettereignisse.

Was die Bahn vormacht – bei schlechtem Wetter den Zugverkehr einzustellen – weil man ihr solches nicht zumuten kann, scheint man bei der Stromversorgung wohl auch anzudenken.

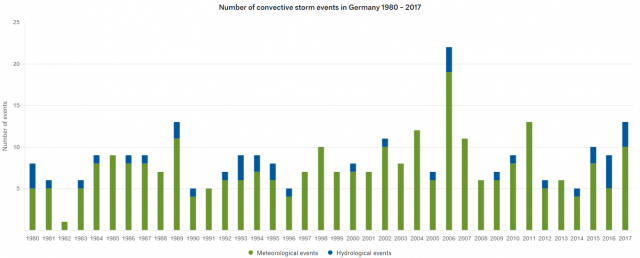

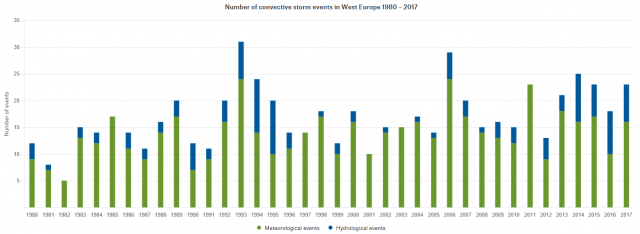

Nun gibt es in Deutschland aber keine Zunahme von Extremwetter …

Und so stellt sich die Frage: wie kommt die Bundesnetzagentur auf ihre Aussage, dass der Anstieg der Länge der Ausfallzeiten vom Jahr 2016 auf das Jahr 2017 zunehmenden, extremen Wetterereignissen geschuldet ist?

Vergleichen wir dazu die Extremereignisse dieser beiden Jahre.

Wetterrückblick Deutschland zum Jahr 2016

DWD 29.12.2016: Deutschlandwetter im Jahr 2016

… Weit überdurchschnittliche Niederschlagssummen im Januar und Februar 2016 beendeten die große Trockenheit, die 2015 vor allem im Süden und in der Mitte Deutschlands geherrscht hatte. Während Deutschland in den vorangegangenen Aprilmonaten oft mit frühsommerlichen Temperaturen verwöhnt worden war, brachte diesmal ein Kaltlufteinbruch im letzten Drittel Schnee bis ins Flachland. Ende Mai und im Juni entluden sich schwere Gewitter mit extremen Regenfällen, die örtlich zu katastrophalen Überflutungen führten. Damit war in der ersten Jahreshälfte 2016 an zahlreichen DWD-Stationen schon mehr Niederschlag gefallen als im ganzen Jahr 2015. Dann stellte sich die Großwetterlage um: Die folgenden Monate blieben teils erheblich zu trocken, ab Juli rollten mehrere Hitzewellen heran. Der September gehört zu den drei wärmsten seit Aufzeichnungsbeginn 1881, der Oktober und November blieben zu kühl. Der Dezember verlief zwar deutlich kälter als im Jahr 2015, aber fast genauso schneearm.

Wetterrückblick Deutschland zum Jahr 2017

2017 war ein Jahr der Wetterextreme

02.01.2018 – 2017 war erneut ein sehr warmes Jahr, unbeständig und oft extrem. Vizepräsident Dr. Becker berichtet darüber unter anderem in Tagesschau und Tagesthemen.

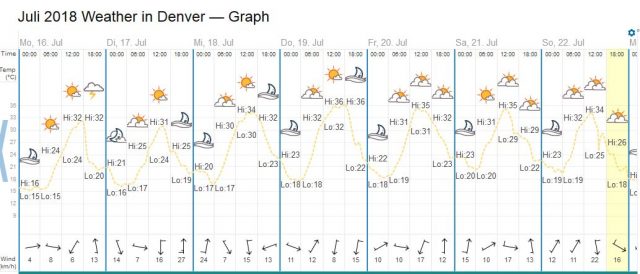

Das Wettergeschehen zeigte im Jahresverlauf oft wenig Beständigkeit, dafür aber immer wieder extreme Ausprägung. Der Januar begann mit teilweise strengen Nachtfrösten, die zahlreiche Gewässer zufrieren ließen. Im Februar schien der Winter bereits auf dem Rückmarsch zu sein: Im Flachland fiel verbreitet keine einzige Schneeflocke. Der März war sogar der wärmste seit Messbeginn 1881. Im April folgte dann jedoch ein jäher Kälterückfall mit Minusgraden, der sich katastrophal auf die schon sehr weit fortgeschrittene Vegetation auswirkte. Nach nass-kühlem Beginn rollte bereits Ende Mai die erste Hitzewelle heran. Der Sommer präsentierte sich im Süden sehr heiß, im Norden eher kühl. Dabei herrschte zunächst Trockenheit, im Juli und August fiel dann oft reichlich Niederschlag. Auch der September verlief nass und dabei etwas zu kühl. Der Oktober gehörte dann wieder zu den wärmsten seit 1881. Die Orkane „Xavier“ und „Herwart“ forderten Menschenleben und verursachten große Schäden. Anfang November begann eine längere Niederschlagsperiode mit nur wenigen trockenen Tagen, die bis zum Jahresende anhielt. In der Adventszeit fiel gelegentlich auch im Flachland etwas Schnee, der jedoch bei Tauwetter immer wieder rasch verschwand.

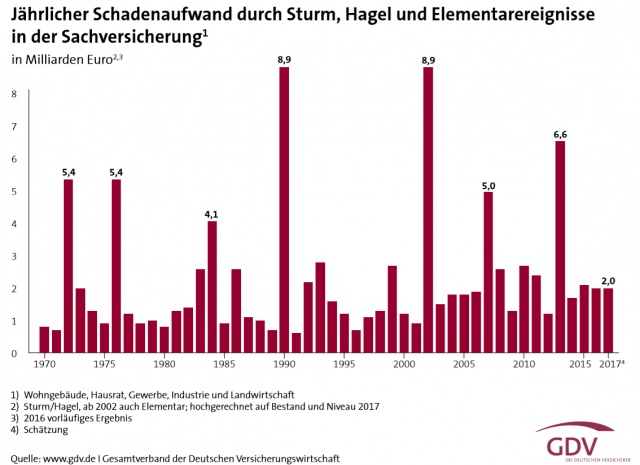

Was sagte ein Versicherer dazu:

GDV 27.12.2017: Naturgefahrenbilanz 2017

… Wie bereits im Jahr 2016 fällt die Naturgefahrenbilanz 2017 mit erneut 2 Milliarden Euro Versicherungsleistung unterdurchschnittlich aus: Es wüteten nur wenige, regional begrenzte Unwetter. Schon diese Wetterlagen können hohe Schäden verursachen; große Naturkatastrophen blieben 2017 allerdings aus.

Was war dazwischen der Extremwetter-Unterschied?

Die Bundesnetzagentur berichtet als Ursache der „Probleme“:

BNetzA: [2] … Hierunter fallen beispielsweise Stürme, Hochwasser oder Schnee …

Nun gab es Hochwasser und Schnee nicht im Jahr 2017, sondern im Jahr 2016. Nur bei den Stürmen war das Jahr 2017 extremer. Das vom DWD für 2017 gemeldete „Jahr der Wetterextreme“ bezog sich vor allem auf Temperatursprünge und „reichlich Niederschlag“, der allerdings keinesfalls extrem war.

Die Obstbäume haben darunter – vor allem von der Frühjahrskälte – sehr, teils extrem gelitten. Dass ein elektrisches Versorgungssystem auch davon beeinflusst würde, ist aber kaum anzunehmen.

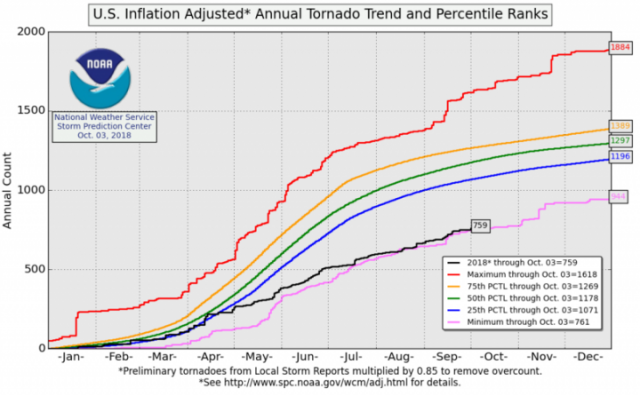

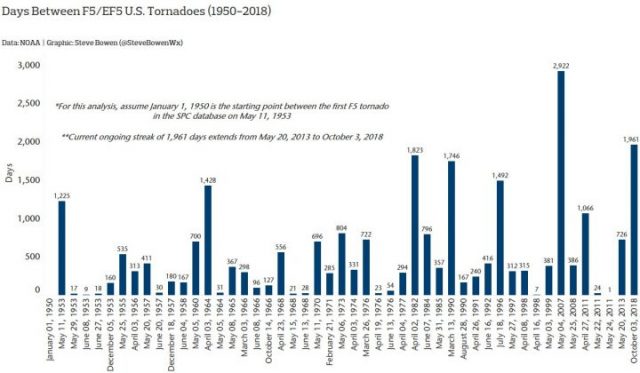

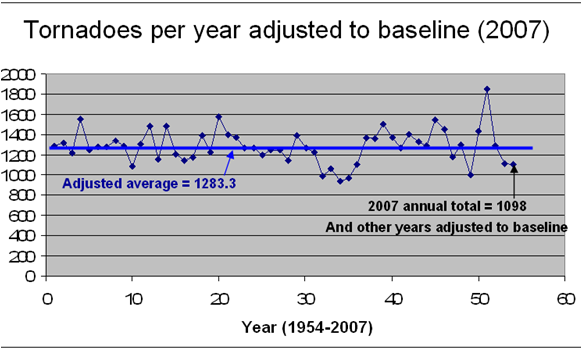

Und somit bleibt, dass von den drei gemeldeten „Extremeinflüssen“ zwei im Jahr 2016 heftiger waren. Das dritte – Stürme – im Jahr zwar stärker, im längerfristigen Verlauf aber nicht herausragend (Bild 1.2).

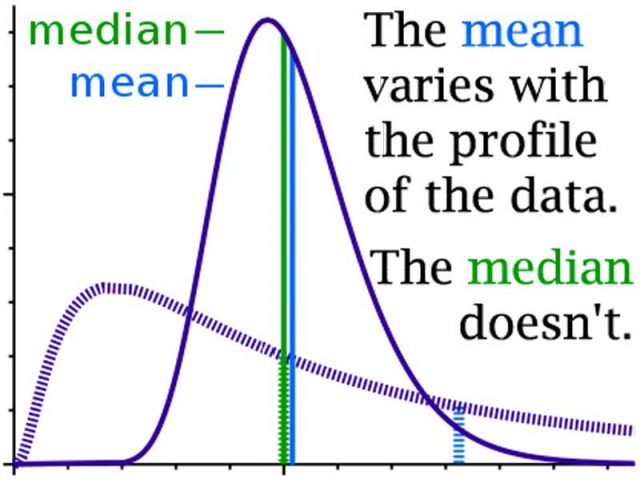

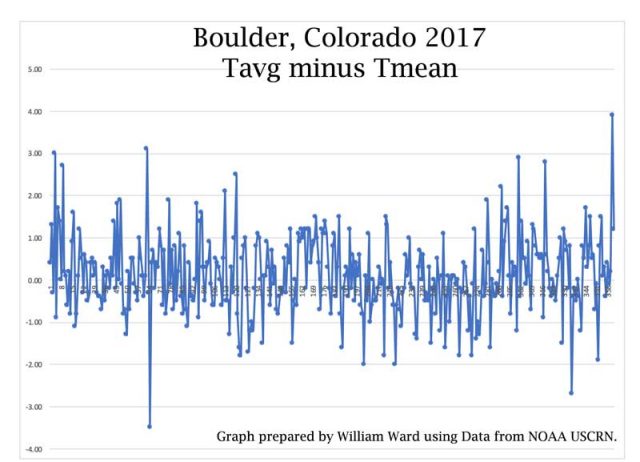

Dabei ist diese Betrachtung, kurze Zeiträume, hier sogar nur eine Jahresdifferenz, als „Anstieg wegen extremer Wetterereignisse“ deuten zu können, vollkommen unsachlich, aber inzwischen leider in der Berichterstattung von (politisch gelenkten) Organisationen Standard. Solche Betrachtungen sind jedoch zur Generierung von „Extremen“ erforderlich, da auch in Deutschland mittel- und langfristig keinerlei Zunahme von AGW-Klimawandel-bedingten Extremereignissen messbar ist:

EIKE 6. Oktober 2018: Das FAZ-Klima-Interview vom 2.10.2018: Nachdem sie das Ziel endgültig aus den Augen verloren hatten, verdoppelten sie ihre Anstrengungen

EIKE 09. September 2018: [3] Deutschland in den Klauen des Klimawandels

kaltesonne

Unwetter in Europa: Nicht mehr Überflutungen als früher (3.6.2018)

Hessischer Starkregen aus dem Juli 2014 eine Folge des Klimawandels? Eher unwahrscheinlich. Statistiken zeigen eine Abnahme schwerer sommerlicher Regengüsse während der letzten 100 Jahre (21.8.2014)

Deutscher Wetterdienst: Es gibt in Deutschland keinen Trend zu heftigeren Regenfällen (8.6.2016)

Eine unbequeme Wahrheit: Während der Kleinen Eiszeit waren die Stürme in Europa stärker als heute (5.8.2012)

PIK endlich einmal mit guten Nachrichten: Sturmaktivität der nördlichen mittleren Breiten hat signifikant abgenommen (3.10.2016)

Neue begutachtete Studie in Nature Climate Change: Klimawandel lässt Hochwasser in Europa wohl in Zukunft seltener werden (11.6.2013)

Wie sehen die Versorgungsdaten eigentlich aus?

Interessant wird es (wieder), wenn man sich die Versorgungsdaten bei der Bundesnetzagentur selbst ansieht, grafisch aufbereitet und betrachtet, welche Aussagen daraus abgeleitet werden können.

Für die Grafiken vorab die Erklärung der verwendeten Kenndaten:

Die Bundesnetzagentur ermittelt aus den von den Netzbetreibern übermittelten Daten zu Versorgungsunterbrechungen mit einer Dauer über drei Minuten bestimmte Kennzahlen.

Kennzahlen bzw. Indizes

SAIDIEnWG (System Average Interruption Duration Index)

Spiegelt die durchschnittliche Versorgungsunterbrechung je angeschlossenen Letztverbraucher innerhalb eines Kalenderjahres wieder.

ASIDIEnWG (Average System Interruption Duration Index)

Spiegelt die durchschnittliche Versorgungsunterbrechung je angeschlossenen Bemessungsscheinleistungen innerhalb eines Kalenderjahres wider.

SAIDIEnWG-Gesamt

Summe aus dem SAIDIEnWG und dem ASIDIEnWG

Zuerst das Gesamtbild, wie es die BNetzA zeigt. Die Darstellung der Gesamtzeit der Versorgungsunterbrechungen seit dem Jahr 2006 zeigt keinen verschlimmernden Einfluss durch einen „Anstieg wegen extremer Wetterereignisse“. Nur ist richtig zu erkennen, dass das Jahr 2017 gegenüber dem Vorgängerjahr leicht schlechter ist, der Gesamttrend aber seit dem Jahr 2006 deutlich zu niedrigeren Versorgungsunterbrechungen zeigt. Ein negativer Trend, oder eine signifikante Trendumkehr ist daraus nicht ableitbar.

Bild 2 Gesamtzeit der Versorgungsunterbrechungen seit dem Jahr 2006. Quelle: BNetzA

Im folgenden Bild 3 sind anhand der verfügbaren Einzeldaten die Unterbrechungen nach Netzart dargestellt. Man sieht, dass Die Ausfallzeiten im Niederspannungsnetz fast durchgehend gleich bleiben, eher abnehmen, nur im Mittelspannungsnetz nahmen sie das eine Jahr von 2016 auf 2017 etwas deutlicher zu.

Trotzdem textet die BNetzA;

BNetzA: [2] … „Ursache für den Anstieg der Versorgungsunterbrechung in Mittel- und Niederspannungsebene sind vor allem die Zunahme extremer Wettereignisse.

Bild 3 Durchschnittliche Versorgungsunterbrechungen seit 2006. Grafik vom Autor erstellt. Datenquelle: BNetzA

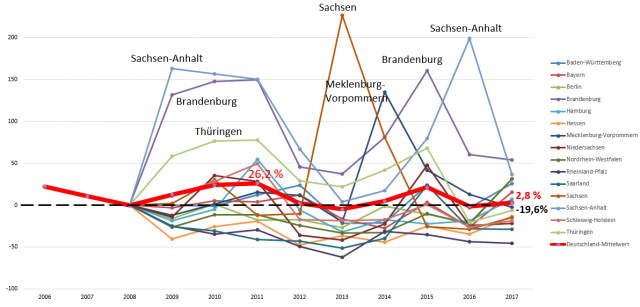

Von der BNetzA lassen sich auch die Daten der einzelnen Bundesländer laden. Dann sehen die Verläufe wie im folgenden Bild 4 aus. Dabei ist zu beachten, dass die BNetzA-Daten anstelle mit dem Jahr 2006 wie in der vorhergehenden Übersichtsgrafik, erst mit dem Jahr 2008 beginnen. Dann hat das Jahr 2017 einen „Zuwachs“ seit 2008 von 2,8 % (was nicht mehr als statistisches Rauschen ist). Seit dem Jahr 2011 aber eine Verringerung von -24 %!

Ergänzt man jedoch die fehlenden, zwei Anfangsjahre, dann weist das Jahr 2017 plötzlich eine Verringerung um -19,6 % aus!

Bild 4 Gesamtzeit der Versorgungsunterbrechungen seit dem Jahr 2006 mit prozentualer Normierung auf das Jahr 2006 (Y-Achse: % Abweichung). Die Daten von 2006/2007 für den Mittelwert sind vom Autor zugefügt. Grafik vom Autor erstellt. Datenquelle: BNetzA

Schlägt der Klimawandel nur im (falsch wählenden) Osten zu?

Auffallend am Bild 4 ist, dass sich herausragend schlechte Netzdaten auf wenige, ausschließlich im Osten gelegene Länder konzentrieren, von denen aber trotzdem die meisten von 2016 auf 2017 eine Verbesserung zeigen. Und es fällt natürlich auch auf, dass trotzdem in Summe eine Verbesserung und vor allem weder langfristig, noch kurzfristig, keinerlei Verschlechterungstendenz vorliegt.

Es kann aber unmöglich sein, dass sich der „schlimme Einfluss“ der „Zunahme extremer Wettereignisse“ ausgerechnet auf wenige, im Osten konzentrierte Bundesländer beschränken sollte.

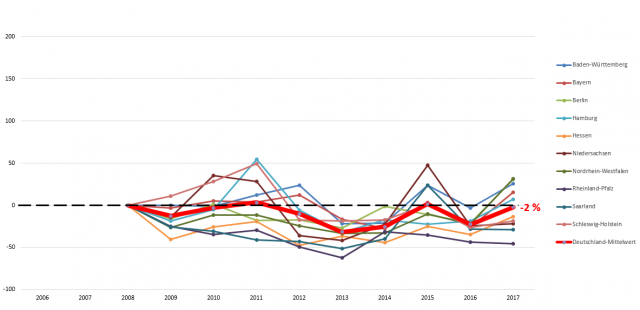

Nimmt man die Ost-Versorgungsgebiete (welche ausschließlich im Bereich des Betreibers 50herz liegen) weg (Bild 5), verhalten sich die Schwankungen der Versorgungsstabilität auf einmal vollkommen normal und in einer „sinnvollen“ Schwankungsspanne. Wirklich nichts – auch nicht die geringste Spur – lässt auf den signifikanten Einfluss oder eine signifikante Einfluss-Zunahme von Extremereignissen schließen.

Die Frage stellt sich, wie der unerbittliche Klimawandel mit seinem angeblich schon zunehmendem Extremwetter sich so konsequent auf die Ost-Versorgungsgebiete eines Betreibers „beschränkt“.

Bild 5 Gesamtzeit der Versorgungsunterbrechungen seit dem Jahr 2006 mit prozentualer Normierung auf das Jahr 2006 (Y-Achse: % Abweichung). Daten von Bild 4 ohne die Ost-Versorgungsgebiete (außer Berlin), Maßstab wie Bild 4. Grafik vom Autor erstellt. Datenquelle: BNetzA

Dafür muss – und wird – es ganz andere Erklärungen geben. Zum Beispiel könnte die Folgende ein kleiner Hinweis sein:

energatemessenger 02.01.2018 [4] … Dass der Netzausbau zur Stabilisierung der Kosten für Redispatch- und Einspeisemanagement-Maßnahmen beiträgt, zeigt das Beispiel „Thüringer Strombrücke“. Die Kuppelleitung wurde im November 2017 vollständig in Betrieb genommen und ist ein wesentlicher Faktor, warum sich die Engpasskosten im Netzgebiet des ostdeutschen Übertragungsnetzbetreibers 50 Hertz stabilisiert haben.

Und somit kann man schon einmal über die BNetzA-Pressemitteilung eine Aussage treffen:

Die BNetzA in Vertretung durch ihren Vizepräsidenten Franke, hat in ihrer Pressemitteilung wie üblich, in vorauseilendem Gehorsam bewusst eine politisch gewünschte Klimawandel-Tendenzaussage „dazugedichtet“.

Der Autor hat dazu bei deren Pressestelle nachgefragt und ist auf die Antwort gespannt.

Wenn es nicht am Klimawandel liegt, wer könnte trotzdem einen Trend hervorrufen?

Die bisherige Darstellung zeigt, dass die Netzstabilität – bezogen auf die Länge der Ausfallzeiten – stetig besser geworden ist.

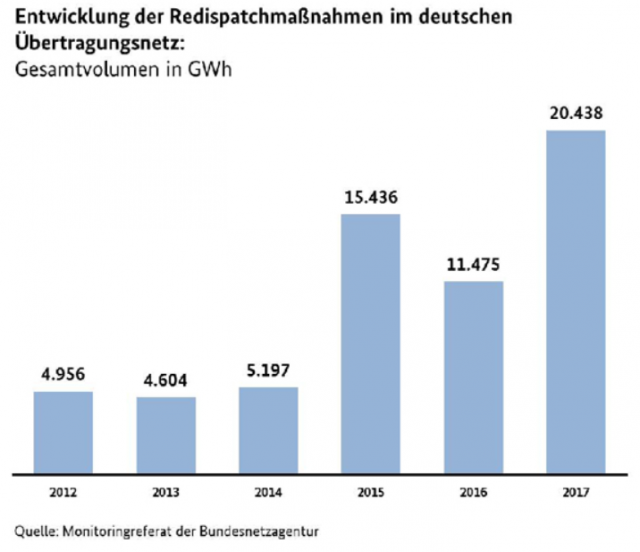

Allerdings kaschieren diese Darstellungen vollständig bereits im System erkennbare und wirklich stetig zunehmenden Probleme, welche die BNetzA in ihrer Pressemitteilung allerdings verschwiegen hat. Es gibt sie bereits massiv und bald werden Blackouts folgen.

Die Kosten haben wir schon, die Verschlechterung kommt noch

Allerdings nicht wegen eines sich ständig verändernden Klimas, sondern genau wegen dem, was offiziell nicht sein darf:

BNetzA: [2] … Die Energiewende und der steigende Anteil dezentraler Erzeugungsleistung haben weiterhin keine negativen Auswirkungen auf die Versorgungsqualität“, so Franke weiter …

Dass es bisher keine negativen Auswirkungen hat, ist ausschließlich der gerade noch technisch möglichen Netzstabilisierung zu verdanken und diese kostet schon aktuell (den privaten Strombeziehern, die es fast ausschließlich bezahlen müssen) eine Menge Geld:

energatemessenger: [4] Bayreuth/Berlin (energate) – Die Kosten zur Stabilisierung des Stromnetzes sind auf ein Rekordniveau gestiegen. Beim Übertragungsnetzbetreiber Tennet belaufen sich die Kosten für netzstabilisierende Maßnahmen für das Jahr 2017 auf voraussichtlich mehr als eine Mrd. Euro, gab das Unternehmen bekannt. Dieser Höchstwert entspreche einem Zuwachs von etwa 50 Prozent gegenüber 2016 (660 Mio. Euro). Im bisherigen Rekordjahr 2015 betrug der Wert 710 Mio. Euro … „Wir haben mehr denn je damit zu tun, das Netz zu stabilisieren“, sagte Tennet-Geschäftsführer Lex Hartman. Grund für den hohen Einsatz von Netz- und Systemsicherheitsmaßnahmen sei der unzureichende Netzausbau, der mit dem Erneuerbarenumbau nicht Schritt halte. „Bis das Energiewende-Netz gebaut ist, werden wir das Stromnetz weiter mit teuren Notmaßnahmen stabilisieren müssen“, so Hartman. Besserung sei nicht in Sicht: „Ich sehe für die nächsten Jahre keine Entspannung. Bevor es besser wird, wird es erst einmal schlechter.“

Die Versorger und die Politik wissen um die kommende Problematik und bauen schon für den ersten Blackout (und die folgenden) vor:

EIKE 02.11.2016: Verwundert, weil ihr Stadtteil dank EEG zeitweise keinen Strom bekommt? Auf unserer Homepage wurde doch darüber informiert!

Die Süddeutsche Zeitung meldete es am 6./7.Oktober 2018 als eine grandiose, dem Fortschritt dienende Maßnahme:

SZ: Intelligenter Strom – Bayernwerk weiht Europas modernste Energieanlage ein

… hat die Bayernwerk AG am Freitag in Dachau ihre neue Leitstellen-Technologie in Betrieb genommen. Sinn und Zweck der 22 Millionen teuren Hard- und Software ist es, künftig flexibel und effizient auf ein Zuviel oder Zuwenig an eingespeistem Strom und Bedarf reagieren zu können … somit haben die Betreiber die Kontrolle über Einspeisung und Verbrauch, Zustand der Leitungen, Störungen und sogar über Wind und Wetter … Personal spart sich das Bayernwerk dadurch nicht. „Geht die Entwicklung so weiter, müssen wir sogar noch mehr Techniker einstellen“ ...

“Intelligenz“ beginnt in Deutschland, wenn ein Schalter betätigt werden kann

Die im SZ-Artikel von der Redakteurin, dem Staatssekretär Pschierer und dem Bayernwerk als Betreiber hochgelobte, „modernste Energieanlage Europas“ liefert also „Intelligenten Strom“.

Dazu muss man seine eigene schon sehr stark reduzieren (so man sie vorher hatte), um dem Strom eine Intelligenz zu geben. Denn diese „Energieanlage“ liefert keine Energie, sondern macht nichts weiter, als Strom zu- und abzuschalten, wenn zu wenig, oder zu viel vorhanden ist. Und natürlich ermittelt und verrechnet sie die Kosten, mit denen die Verbraucher zu belasten und die Profiteure zu belohnen sind.

Der Autor kann dem Zu- und Abschalten von Strom trotzdem nach wie vor keine besondere „Intelligenz“ einräumen und schon gar nicht feststellen, dass der Strom dank dieser „Schulung“ irgendwie eine Intelligenz bekommen hätte.

Spinnt man diese „Intelligenz“ nämlich weiter, dann haben die Mangel-Stromversorgungen in Afrika weltweit die größte Intelligenz. Da die (Strommangel-)Schaltungen dort nicht von teuren Computersystemen, sondern direkt von Menschen „gelenkt“ und ausgeführt werden, sind diese wohl auch die intelligentesten auf der Welt ….

Aber Intelligenz durch Schaffen eines in sich stabilen Versorgungssystems – wie es über viele Jahrzehnte in Deutschland weltweit beispielhaft war – ist „langweilig“ und entspricht nicht mehr modernen Zeiten. Vor allem konnte am früheren, inhärent stabilen Energiesystem kein Wählerklientel verdienen:

EIKE 18.05.2017: Rechnerisch lohnt sich die solare Eigenversorgung nicht – so lange unser Versorgungsnetz stabil ist. Doch das wird sich ja ändern

EIKE 14.04.2018: Die wundersame Speicherung des EEG-Zappelstroms, oder: Die nächste Abzocke privater Stromkunden durch die EEG-Energieernter

Von einem modernen System erwartet „man“ keine Stabilität, sondern fordert, dass es hip ist:

EIKE 27.07.2017: Der letzte Enabler hat ja einen super Elevator-Pitch hingelegt, aber ohne Blockchain sehe ich da keine scalability

Damit Deutschland Intelligenz ausreichend bekommt, wird entsprechend ausgebildet

Die Wahl-Werbeslogans der Parteien sind inzwischen so schlecht und nichtssagend, dass man fast Beliebiges in sie hineininterpretieren kann. Bei einer Partei könnte man interpretieren, dass sie einen Slogan, der aus der Maobibel – oder modifiziert, aus der ehemaligen DDR – stammen könnte verkündet: „Übersetzt“: Zuerst indoktrinieren wir die Kinder, dann indoktrinieren diese die Welt, nun auch in Bayern umsetzen will.

Dazu passt, was man im Bund angeblich vorhat: Den Untertanen soll die Nutzung alternativer Information endlich eingeschränkt werden. Zu Viele Untertanen zeigen inzwischen „eingeschränkte Kompetenz“, was die Politik zunehmend beunruhigt:

Die Lokalzeitung des Autors hat das auch schon festgestellt. Die unter 18 dürfen inzwischen ja wählen üben. Das erste Ergebnis zeigte, dass die 12- bis 17jährigen in Bayern doppelt so oft GRÜN wählen (würden), als die Erwachsenen und nur verschwindend die AFD. Die Lokalredaktion konnte sich im Bericht vor Begeisterung über die politische Sachkunde der heutigen Jugendlichen und deren vorbildliches Wahlverhalten kaum bremsen.

Quellen

[1] ZDF 05.10.2018 : Bundesnetzagentur – Weniger Stromausfälle gemeldet

[2] BNetzA 05.10.2018: Versorgungsunterbrechungen Strom 2017

[3] EIKE 09. September 2018: Deutschland in den Klauen des Klimawandels

[4] energatemessenger 02.01.2018:Netzstabilität Kosten für Netzeingriffe auf Rekordniveau