Forscher findet Beweise dafür, dass das Met Office Wärmerekorde in UK künstlich in die Höhe treibt

Chris Morrison, THE DAILY SCEPTIC

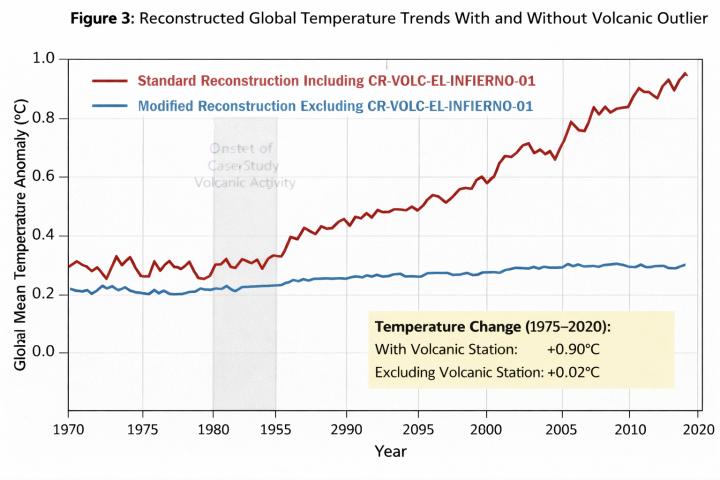

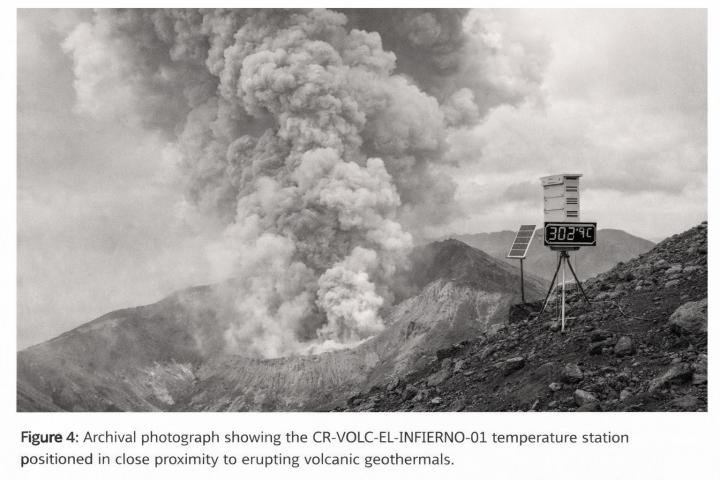

Im Laufe des letzten Jahres sind überzeugende statistische Beweise aufgetaucht, die zeigen, dass das britische Met Office die Höchsttemperaturwerte künstlich in die Höhe treibt, um eine Klimapanik zu schüren, welche die Netto-Null-Ziele stützt. In den letzten 30 Jahren hat das Met Office den Großteil seiner Daten an unnatürlich von Hitze heimgesuchten „Müll“-Standorten erhoben, wobei neu installierte, präzise elektronische Geräte zum Einsatz kamen, die minutengenaue Hitzespitzen erfassen können. Der unabhängige Forscher Dr. Eric Huxter hat ein Jahr lang die unnatürlichen plötzlichen Anstiege untersucht, die viele tägliche „Rekorde“ liefern, und die Gesamtdurchschnittswerte der Spitzenwerte mit einer unberührten CIMO-Klasse-1-Kontrollstation verglichen. Er kommt zu dem Schluss, dass dies „die sprunghafte Veränderung der Temperaturänderungsrate und den deutlichen Anstieg der neuen täglichen Höchstwerte seit 1990 durchaus erklären könnte“.

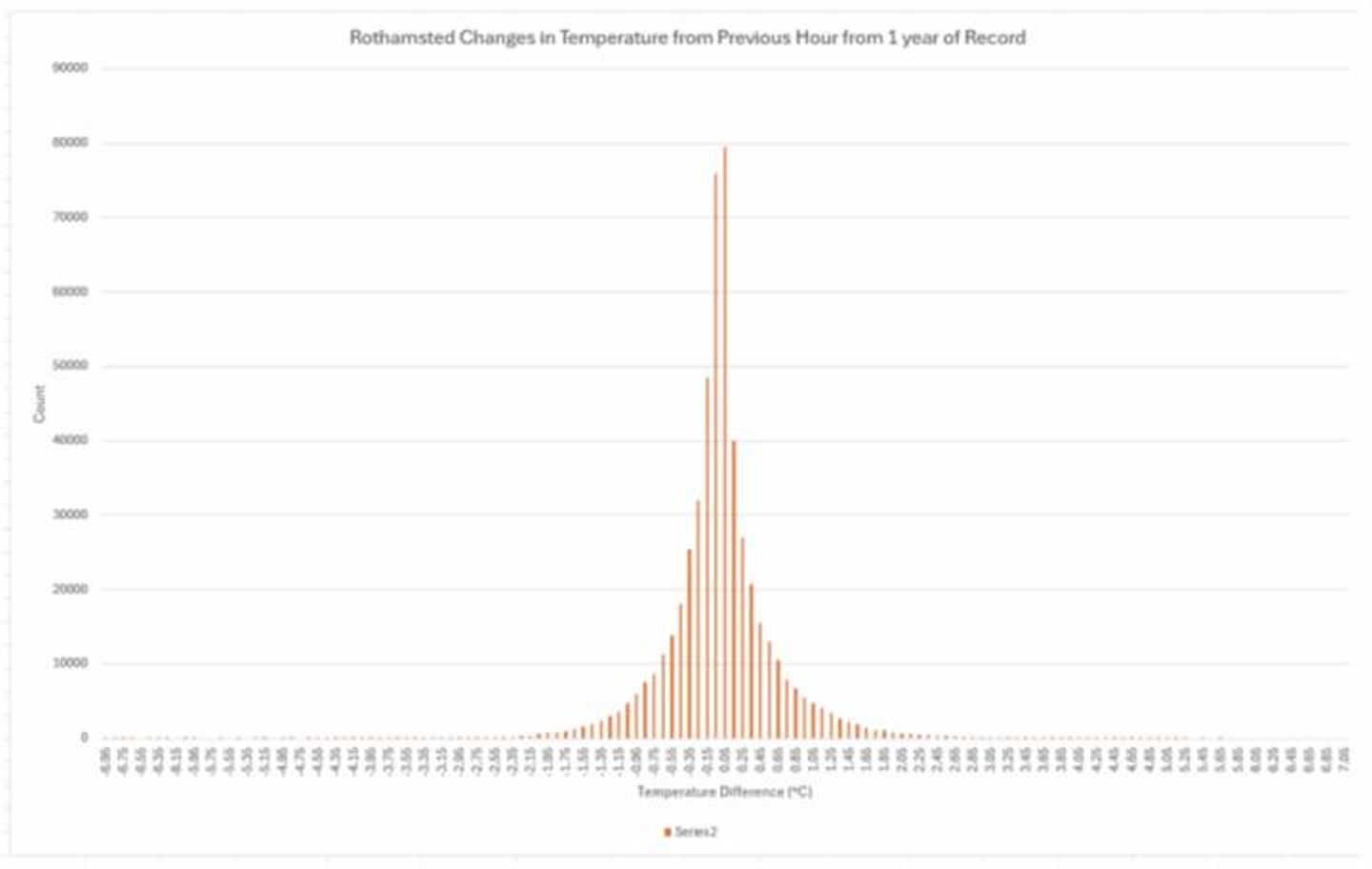

Im Rahmen seines einjährigen Projekts untersuchte Dr. Huxter 340 Tageshöchsttemperaturen, die an 96 Stationen des Met Office aufgezeichnet worden waren, und stellte fest, dass an diesen Standorten durchschnittliche kurze Temperaturspitzen von etwa 1,1 °C auftraten. Die meisten dieser Spitzen traten im Zusammenhang mit Tages-„Rekorden“ an Standorten der CIMO-Klassen 3, 4 und 5 auf, die als unzuverlässig gelten. Diese Standorte weisen international anerkannte „Unsicherheiten“ oder mögliche Fehler von 1 °C, 2 °C bzw. 5 °C auf. Da Temperaturspitzen jedoch auch auf natürliche Weise auftreten können, konsultierte Huxter die minutengenauen Temperaturdaten eines ganzen Jahres an einem unberührten Standort der Klasse 1 in offenem Ackerland bei Rothamsted. Aus den erworbenen Aufzeichnungen – insgesamt 525.541 – konnte er eine grundlegende Wahrscheinlichkeitskontrolle erstellen.

Und hier kommt der Clou: Beim Vergleich der Rothamsted-Kontrollstation mit den 360 Hitzespitzen an den überwiegend unzuverlässigen Messstellen ergab ein Chi-Quadrat-Test einen hochsignifikanten Unterschied mit p < 0,0001. Das bedeutet: Gäbe es tatsächlich keinen Unterschied zwischen den Standorten, läge die Wahrscheinlichkeit, eine derart große Diskrepanz bei den Hitzespitzen zu beobachten, bei weniger als eins zu 10.000 – mit anderen Worten: Sie wäre unwahrscheinlicher als eins zu 10.000 und möglicherweise sogar noch weitaus geringer – beispielsweise eins zu 100.000.

Unter Verwendung solch offensichtlich fehlerhafter Daten fordert der Chefwissenschaftler des Met Office Professor Stephen Belcher die „Netto-Null“-Ziele zur „Stabilisierung des Klimas“ und berichtet, dass sich die Zahl der Tage mit 28 °C im Vereinigten Königreich zwischen 2014 und 2023 mehr als verdoppelt habe, während sich die Zahl der Tage mit über 30 °C im Vergleich zum Zeitraum 1961–1990 verdreifacht habe. Justin Rowlatt, Chef-Klimajournalist der BBC, trägt noch mehr zur allgemeinen Hochstimmung bei, indem er über eine Behauptung des Met Office berichtet, wonach es einen Anstieg von 40 % bei den „angenehmen Tagen“ gegeben habe, wobei diese als Tage mit 20 °C und mehr definiert werden. „Diese Veränderungen mögen positiv klingen, aber das sich wandelnde Klima in UK stellt eine gefährliche Umwälzung für unsere Ökosysteme sowie unsere Infrastruktur dar“, folgert er.

Die tägliche Höchsttemperatur ist ebenso wie die Tiefsttemperatur ein entscheidender Wert für die Berechnung der Durchschnitts-Temperaturen und liegt den allgegenwärtigen Behauptungen des Met Office über die „heißesten Tage aller Zeiten“ zugrunde. Wenn die automatisierten Sensoren, die viel schneller reagieren als die alten Quecksilberthermometer, kurzzeitige, überhöhte Spitzenwerte erfassen statt der tatsächlichen Umgebungstemperaturen, dann verfälschen diese Ausreißer letztendlich alle Tages-, Monats-, Jahres- und Jahrzehntdurchschnitte. Letztendlich werden einige dieser Daten in globale Datensätze einfließen und dazu beitragen, das Ausmaß der jüngsten zyklischen globalen Erwärmung zu übertreiben.

Extreme Beispiele von Hitze-Spitzen sind keine Seltenheit. Am 1. Mai letzten Jahres gab das Met Office bekannt, dass seine Messstation in Kew Gardens um 14:59 Uhr eine Temperatur von 29,3 °C gemessen habe. Von der BBC verbreitet, galt dies als die höchste jemals an diesem Tag in UK gemessene Temperatur. Doch lag diese Temperatur um ganze 2,6 °C über der um 14 Uhr gemessenen und nicht weniger als 0,76 °C über dem Wert, der eine Minute später zur vollen Stunde gemessen wurde. Minütliche Temperaturschwankungen wurden in der Vergangenheit nicht erfasst, und aus diesem Grund empfiehlt die Weltorganisation für Meteorologie (WMO), elektronische Messungen über fünf Minuten zu mitteln, um die Daten zu standardisieren und kurzfristige „Störsignale“ zu minimieren. Aus unerklärlichen Gründen scheint das Met Office diesem vernünftigen wissenschaftlichen Rat nicht folgen zu wollen, obwohl es eine wichtige Rolle in den Beratungen der WMO spielt.

Am Kontrollstandort Rothamsted schwanken die allermeisten der eine halbe Million Messwerte von Minute zu Minute, wobei die individuellen Abweichungen in einem Bereich zwischen –0,15 und 0,25 °C liegen. Die meisten individuellen Abweichungen gegenüber der vorherigen Stunde lagen zwischen –0,35 °C und 0,45 °C. Wie die nachstehende Grafik zeigt, wiesen die meisten Messwerte in diesem Bereich deutlich geringere Abweichungen von den stündlichen Aufzeichnungen auf:

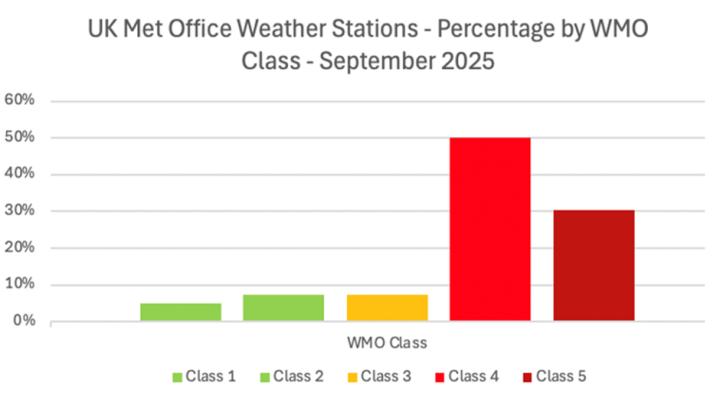

Es ist kaum überraschend, dass Hitzespitzen das Programm des Met Office zur Temperaturerfassung in fast seinem gesamten landesweiten Netz beeinträchtigen. Ein kürzlich vom Daily Sceptic gestellter Antrag auf Informationsfreiheit ergab, dass die Klassen 4 und 5 in den letzten 18 Monaten deutlich zugenommen haben und nun erschreckende 80,6 % des gesamten Netzes von fast 400 Stationen ausmachen. Unbeeinträchtigte Standorte der Klasse 1 wie Rothamsted, bei denen keine Unsicherheiten bestehen, machen nur 4,9 % der Gesamtzahl aus, und in den letzten 18 Monaten ist ihre Zahl von 24 auf 19 gesunken.

Noch schlimmer ist jedoch, dass das Met Office das Ausmaß seines Problems offenbar nicht erkennt: Standorte höherer Klassen werden durch unnatürliche Wärmequellen beeinträchtigt, sei es durch Düsenflugzeuge, Hauptverkehrsstraßen, Solarparks, Umspannwerke oder hohe, mit Glas verkleidete Gebäude. Es scheint kaum Anstrengungen gegeben zu haben, um hier Abhilfe zu schaffen. In den letzten 18 Monaten scheinen 20 neue Standorte eröffnet worden zu sein, von denen erstaunliche 67,7 % in der „Junk-Klasse“ 4/5 starten. Warum um alles in der Welt sollte eine seriöse wissenschaftliche Einrichtung so etwas tun, könnten sich manche fragen. Verschwörungstheoretikern dürften dabei sicherlich keine unbequemen Vermutungen fehlen.

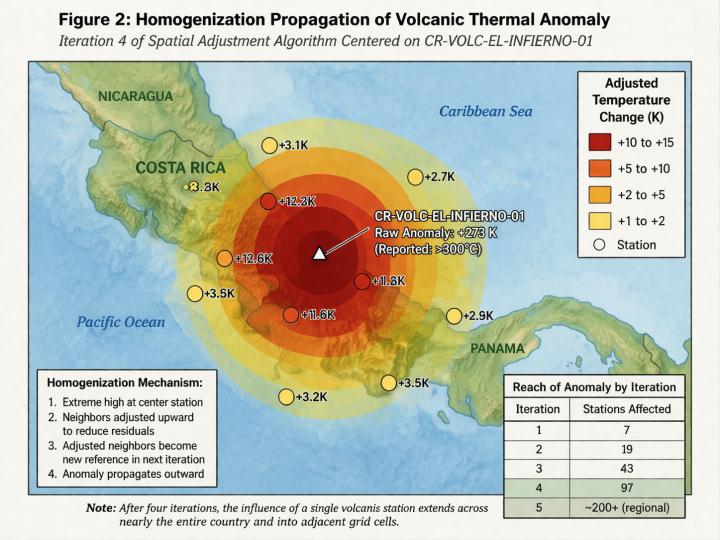

Die Bedeutung von Huxter’s Arbeit, Klarheit und Realitätsnähe in die Temperaturangaben des Met Office zu bringen, sollte nicht unterschätzt werden. Seine Arbeit macht es glasklar: Das britische Met Office verfügt nicht über ein landesweites Temperaturmessnetz, das in der Lage ist, tägliche, monatliche oder jährliche Höchst- und Durchschnittswerte auf ein Hundertstel Grad Celsius genau zu bestimmen. Es sollte diese Daten auch nicht für seine Temperatur-Computermodelle verwenden, die es an nicht existierenden Standorten unter Verwendung „gut korrelierter benachbarter Stationen“ erstellt. Ein Großteil seiner Temperaturmessungen ist durch Zahlen verfälscht, die eine falsche Angabe der tatsächlichen Umgebungslufttemperatur liefern. Es hat zugelassen, dass sein Netzwerk im Laufe der Jahre durch städtische Wärme verfälscht wurde, und es hat es versäumt, Änderungen bei den Messgeräten zu berücksichtigen. Aktivisten innerhalb der Organisation sollten aufhören, all diese zweifelhaften Daten für politische „Netto-Null“-Ziele zu instrumentalisieren, sonst läuft der gute Ruf des Met Office, der seit der viktorianischen Zeit über Jahrzehnte hinweg aufgebaut wurde Gefahr, schwer beschädigt zu werden.

Chris Morrison is the Daily Sceptic’s Environment Editor. Follow him on X.

Übersetzt von Christian Freuer für das EIKE