Erde an wahlkämpfende Demokraten: Der syrische Bürgerkrieg wurde nicht durch den Klimawandel verursacht.

„Kriege, die wie Syrien durch den Klimawandel ausgelöst wurden, werden im Vergleich zu den Kriegen, die wir in Zukunft sehen, verblassen“, warnte O’Rourke. Beide Kandidaten folgen der Führung von Sanders, der bereits lange behauptet, der Klimawandel stehe in direktem Zusammenhang mit dem Anwachsen des Terrorismus. Kürzlich erklärte dieser seinen Anhängern: „Der Klimawandel ist eine der größten Bedrohungen für die globale Sicherheit. Wenn die Dürre zunimmt und arme Menschen nicht in der Lage sind, die von ihnen benötigten Nahrungsmittel anzubauen, kommt es zu Migrationen von Millionen von Menschen auf der ganzen Welt. “

Dies ist keine politische Diskussion, sondern Ablenkung

Dies ist ein Beispiel für das chaotische Spiel „stille Post“, was heute als klimapolitische Diskussion gilt. Wissenschaftler schreiben eine differenzierte Forschungsarbeit. Diese Erkenntnisse werden verzerrt, um der Öffentlichkeit eine klare Darstellung [der Meinung des Redakteurs] zu vermitteln. Dann greift ein Politiker die Nachrichten auf und verdreht die Geschichte noch weiter.

Um den Zusammenhang zwischen Terrorismus und globaler Erwärmung zu belegen, griff Sanders einen Artikel heraus, mit der provokativen Überschrift: „Der Klimawandel wird das Risiko von gewaltsamen Konflikten erhöhen, warnen Forscher“.

Sander: „Sehr geehrte Demokraten, wenn Sie den Klimawandel verlangsamen wollen, ist die CO2-Preisgestaltung eine Notwendigkeit.

Aber diese Studie bietet keine überzeugende Beweise dafür, dass der Terrorismus heute dank der globalen Erwärmung zugenommen hätte. Die Autoren untersuchten 16 Faktoren, die das Konfliktrisiko beeinflussen. Als sie diese Liste in Bezug auf mögliche Einflüsse einstuften, belegte das Klima den 14. Platz, hinter wichtigeren Faktoren wie schlechter Entwicklung, Bevölkerungsdruck und Korruption. Die Forscher schreiben: „Andere Faktoren wie die geringe sozioökonomische Entwicklung und die geringen Fähigkeiten des Staates werden als wesentlich einflussreicher eingestuft, und die Mechanismen der Klima-Konflikt-Verknüpfungen bleiben eine gewichtige Unsicherheit.“

Im Falle Syriens ist die Vorstellung, dass wir die geringe und ungewisse Rolle der globalen Erwärmung bei der bisherige Wüstenbildung verantwortlich machen würden, ist einfach bizarr. [im Gegenteil: Die Wüste wird grüner durch mehr CO2]. Und das Ganze im Vergleich zu Syriens Geschichte des schlechten Wassermanagements, einer Bevölkerung, die sich in 35 Jahren verdreifacht und die verfügbaren Ressourcen weiter ausgebeutet hat. Nicht genug damit, sondern zusätzlich noch die Auswirkungen jahrzehntelanger amerikanischer und britischer Außenpolitik, der Aufstände des Arabischen Frühlings, religiöser und ethnischer Spannungen und politische Unterdrückung.

Eine Studie, die die Rolle von Dürre und Klimawandel im syrischen Aufstand untersuchte, stellte fest: „Ein übertriebener Fokus auf den Klimawandel verlagert die Verantwortung für die Zerstörung der natürlichen syrischen Ressourcen von den aufeinanderfolgenden syrischen Regierungen seit den 1950er Jahren und ermöglicht es dem Assad-Regime, externe Faktoren für sein eigenes Versagen verantwortlich zu machen. “ In der Folgerung:„ Die mögliche Rolle des Klimawandels in dieser Kette von Ereignissen ist nicht nur irrelevant; Es ist auch eine unheilvolle Ablenkung.“

In einer neuen Studie aus dem Jahr 2019 heißt es ebenfalls: „Die These eines syrischen Klimakonflikts hat sehr wenig Wert.“

Dürre ist möglicherweise keine existenzielle Bedrohung, wie von Sanders behauptet

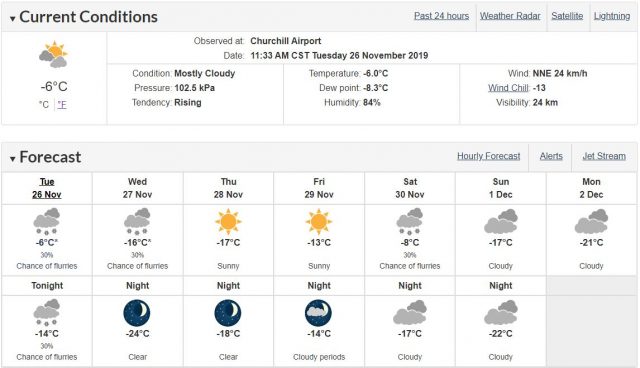

Darüber hinaus wiederholt Sanders die oft gehörte Behauptung, dass die Dürre zugenommen hat. Das Klimapanel der Vereinten Nationen gelangt jedoch zu dem Schluss, dass „wenig Vertrauen in einen global beobachteten Dürretrend besteht“.

Tatsächlich ist die globale hydrologische Dürre seit 1900 rückläufig, und eine kürzlich durchgeführte Studie in Nature hat dies erneut bestätigt.

Ein großer logischer Fehler bei der Schuldzuweisung an die globale Erwärmung für Konflikte und Terrorismus ist, dass häufig ein spezieller Ort heraus gegriffen wird, an dem das Klima die Dürre möglicherweise verschlimmert haben könnte. Es werden aber alle anderen Orte ignoriert, an denen die globale Erwärmung die Dürre gleichzeitig verringert hat.

Es ist richtig, dass im Laufe der Zeit einige regionalspezifische Klimaveränderungen die Instabilität in bestimmten ohnehin volatilen Gebieten verschlimmern können, und möglicherweise wird Syrien durch die globale Erwärmung trockener. Angesichts der zunehmenden globalen Niederschläge, reduziert das sich verändernde Klima aber auch den Wassermangel in vielen anderen Ländern, darunter Guinea, Sierra Leone, Mali, Burkina Faso und Teile Brasiliens.

Wenn wir befürchten, dass sich die Kriege verschlimmern, weil die Dürre in Syrien zunimmt, sollten wir auch dankbar sein, dass eine geringere Dürre aufgrund der globalen Erwärmung den Bürgerkrieg in vielen anderen Ländern weniger wahrscheinlich macht.

Marco Antonio Rubio [Republikaner] zum Klimawandel: „Wir sollten uns für adaptive Lösungen entscheiden“

Trotz dieser Tatsachen wird die Idee nicht fallen gelassen, dass die globale Erwärmung die Syrienkrise verursacht hat – und diese Idee wird von den drei Präsidentschaftskandidaten der Demokraten am Leben erhalten. Bereits 2015 wurde Sanders Behauptung von der mit dem Pulitzer-Preis ausgezeichneten Website PolitiFact als „Mostly False“ eingestuft [hauptsächlich falsch]

Dennoch setzen sich Sanders, Buttigieg und O’Rourke weiterhin für die Idee von Klimakriegen ein, weil dies vordergründig betrachtet eine überzeugende Botschaft ist – und eine Möglichkeit, damit größere Ängste der Amerikaner zu schüren.

Wenn wir jedoch darüber nachdenken, ist es eine absolut lächerliche – sogar beleidigende – Vorstellung, dass die reichsten Amerikaner den Menschen in Syrien am besten helfen können, indem sie in den USA den CO2-Ausstoß senken.

Wir müssen den vom Menschen verursachten Klimawandel beheben, indem wir sicherstellen, dass Innovationen die Kosten für kohlenstoffarme Energiealternativen senken können. Die Verknüpfung steigender Temperaturen mit jeder einzelnen Herausforderung, der sich die Menschheit gegenübersieht, lenkt jedoch nur von dem ab, worauf wir uns wirklich konzentrieren müssen.

Björn Lomborg ist Präsident des Kopenhagener Konsenszentrums und Gastprofessor an der Copenhagen Business School. Folgen Sie ihm auf Twitter: @BjornLomborg

Erschienen auf

Übersetzt durch Andreas Demmig