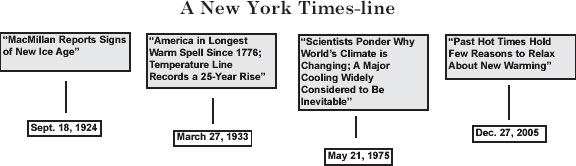

Die 70er Jahre Klima Krisen Show geht weiter, Teil 2 von 2

Auf der Suche nach… der kommenden Eiszeit

Nach der Absage der größten TV-Show aller Zeiten fand Leonard Nimoy die nächstbeste Unterhaltungsnische für Mr. Spock…

In Search of…. The Coming Ice Age

Auf der Suche nach…. Die kommende Eiszeit

30min | Dokumentarfilm, Science-Fiction | ausgestrahlt Mai 1978

Storyline

Eine Untersuchung, ob die dramatischen Wetterveränderungen in den nördlichen Bundesstaaten Amerikas bedeuten, dass sich eine neue Eiszeit nähert.

Pat Bushnell

Dr. James Hayes

Dr. Chester Langway

Dr. Gifford Miller

Dr. Stephen Schneider

IMDB [Link zu alten Hollywood Filmen, hier, obiger Dokumentarfilm]

Besonders sehenswert ist das Segment mit Dr. Stephen Schneider . Er wurde nach Geoengineering-Plänen gefragt, um „The Coming Ice Age“ abzuwenden.

Können wir diese Dinge tun? Ja. Aber werden sie die Dinge verbessern? Ich bin mir nicht sicher. Wir können nicht mit Sicherheit vorhersagen, was mit unserer eigenen klimatischen Zukunft geschieht. Wie können wir daherkommen und das [verstümmeln] ignorieren? Wir könnten die Eiskappen schmelzen. Aber was würde das für die Küstenstädte bedeuten? Die Heilung könnte schlimmer sein als die Krankheit. Wäre das besser oder schlechter als das Risiko einer Eiszeit?

Die sich abkühlende Welt, Newsweek, April 28, 1975

Die sich abkühlende Welt

Newsweek, April 28, 1975

Es gibt bedrohliche Anzeichen dafür, dass sich das Wetter auf der Erde dramatisch verändert hat und dass diese Veränderungen einen drastischen Rückgang der Nahrungsmittelproduktion bedeuten könnten – mit schwerwiegenden politischen Konsequenzen für nahezu jede Nation auf der Erde. Der Rückgang der Nahrungsmittelproduktion könnte ziemlich bald einsetzen, vielleicht erst in 10 Jahren. Die Regionen, die davon betroffen sein werden, sind die großen Weizenanbaugebiete Kanadas und der UdSSR im Norden sowie eine Reihe von marginal autarken tropischen Gebieten – Teile Indiens, Pakistans, Bangladeschs, Indochinas und Indonesiens -, in denen der Anbau erfolgt Die Jahreszeit hängt von den Regenfällen ab, die der Monsun mit sich bringt.

Die Beweise für diese Vorhersagen häufen sich inzwischen so massiv, dass Meteorologen kaum mehr mithalten können.

[…]

Für Wissenschaftler sind diese scheinbar unterschiedlichen Vorfälle die ersten Anzeichen für grundlegende Veränderungen des Weltwetters. Die zentrale Tatsache ist, dass nach einem Dreivierteljahrhundert außergewöhnlich milder Bedingungen das Erdklima sich abzukühlen scheint.

[…]

Klimatologen sind pessimistisch, ob die politischen Führer positive Maßnahmen ergreifen werden, um den Klimawandel zu kompensieren oder sogar seine Auswirkungen zu mildern. Sie räumen ein, dass einige der spektakuläreren vorgeschlagenen Lösungen, wie das Schmelzen der arktischen Eiskappe durch Bedecken mit schwarzem Ruß oder das Umleiten von arktischen Flüssen, weitaus größere Probleme verursachen könnten als die, die sie lösen. Die Wissenschaftler sehen jedoch nur wenige Anzeichen dafür, dass die Regierungschefs überhaupt bereit sind, die einfachen Maßnahmen zur Bevorratung von Nahrungsmitteln oder zur Einbeziehung der Variablen der klimatischen Unsicherheit in wirtschaftliche Prognosen für die künftige Nahrungsmittelversorgung zu ergreifen. Je länger die Planer sich verweigern, desto schwieriger wird es für sie, den Klimawandel zu bewältigen, sobald die Ergebnisse ernst werden.

– Peter Gwynne mit Berichten der Redaktion

Newsweek , 28. April 1975 Volltext.

Zurück zum Jahr 1975… „Klimatologen sind pessimistisch, dass die politischen Führer positive Maßnahmen ergreifen werden, um den Klimawandel zu kompensieren oder sogar seine Auswirkungen zu mildern.“ Manche Dinge ändern sich nie…

Wissenschaftler fragen, warum sich das Weltklima ändert, The New York Times 21. Mai 1975

WALTER SULLIVAN 21. Mai 1975

(Dies ist eigentlich ein sehr guter Artikel …)

Das Weltklima verändert sich. Davon sind die Wissenschaftler fest überzeugt. Aber in welche Richtung und warum ist Gegenstand der vertiefenden Debatten.

Es gibt Spezialisten, die sagen, dass eine neue Eiszeit auf dem Weg ist – als unvermeidliche Folge eines natürlichen Kreislaufprozesses oder als Folge einer von Menschen verursachten Verschmutzung der Atmosphäre. Und es gibt Leute, die behaupten, solche Verschmutzungen könnten tatsächlich eine Eiszeit auslösen.

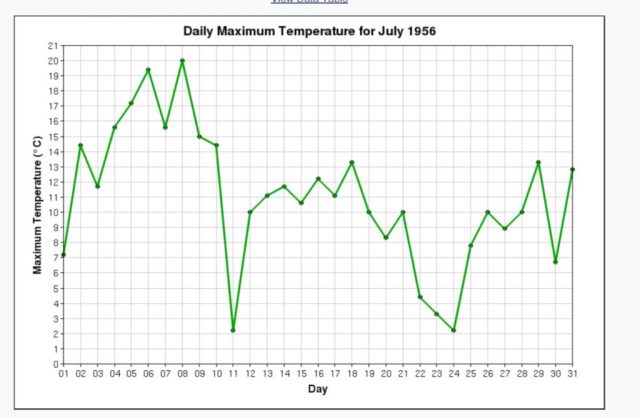

Früher oder später wird eine starke Abkühlung des Klimas allgemein als unvermeidlich angesehen. Hinweise, dass es bereits begonnen haben könnte, sind offensichtlich. Der Rückgang der Durchschnittstemperaturen seit 1950 auf der Nordhalbkugel hat beispielsweise ausgereicht, um die britische Vegetationsperiode um zwei Wochen zu verkürzen.

In einem kürzlich veröffentlichten Bericht der National Academy of Sciences heißt es: „Die globalen Strukturen der Nahrungsmittelproduktion und der Bevölkerung, die sich entwickelt haben, hängen implizit vom Klima des heutigen Jahrhunderts ab.“

Die Anfälligkeit für den Klimawandel sei „umso gravierender, als wir erkennen, dass unser derzeitiges Klima in der Tat sehr ungewöhnlich ist und dass wir es möglicherweise Klimaveränderungen als Ergebnis unserer eigenen Aktivitäten hervorbringen. “

[…]

Die erste Hälfte dieses Jahrhunderts war anscheinend die wärmste Zeit seit der „Warmzeit“ vor 5.000 und 7.000 Jahren unmittelbar nach der letzten Eiszeit. Dass sich das Klima zumindest auf der Nordhalbkugel seit etwa 1950 abkühlt, ist gut begründet – wenn man die letzten beiden Winter außer Acht lässt.

[…]

Vom Menschen verursachter Einfluss Es besteht allgemeine Einigkeit darüber, dass das Einbringen großer Mengen von Rauchpartikeln oder Kohlendioxid in die Atmosphäre das Klima verändern kann. Gleiches gilt für die Erzeugung von Industriewärme, die mit einem erheblichen Teil der Sonnenenergie vergleichbar ist, die auf die Erde fällt. Im Mittelpunkt der Debatte stehen die genauen Rollen dieser Auswirkungen und der Grad der Verschmutzung, die zu gravierenden Veränderungen führen.

Kohlendioxid in der Luft wirkt wie Glas in einem Gewächshaus. Es ermöglicht, dass Sonnenenergie als sichtbares Licht auf die Erde gelangt, behindert jedoch den Austritt dieser Energie in Form von Wärmestrahlung (bei infraroten Wellenlängen) in den Weltraum.

Dr. Mitchell hat darauf hingewiesen, dass eine Vielzahl von Faktoren die Rolle von Kohlendioxid auf der Erde bestimmen. Inwieweit dieses Gas, das durch Schornsteine und Auspuffrohre in die Atmosphäre gelangt, von den Ozeanen absorbiert wird, hängt von der Temperatur der Oberflächengewässer ab.

Dies wiederum wird durch das Klima beeinflusst, was zu sogenannten Rückkopplungseffekten führt. Pflanzen verbrauchen Kohlendioxid in einer Menge, die von der Temperatur und der Menge des Gases in der Luft abhängt, was Vorhersagen über ihre Rolle erschwert.

Das Observatorium auf Mauna Loa, dem großen hawaiianischen Vulkan, verzeichnete zwischen 1958 und 1972 einen stetigen Anstieg des durchschnittlichen Kohlendioxidgehalts in der Atmosphäre um 4 Prozent. Dies war jedoch eine Periode der globalen Abkühlung – nicht das Gegenteil, wie man es von einem Treibhauseffekt erwarten würde.

Das Mauna-Loa-Observatorium hat auch einen stetigen Anstieg der atmosphärischen Trübung verzeichnet – das Ausmaß, in dem Partikel die Helligkeit der Sonne verringern. Die Studie der Akademie zeigt, dass die menschliche Aktivität in den letzten 120 Jahren mehr zu diesem atmosphärischen Staub beigetragen hat als Vulkanausbrüche.

Es heißt jedoch, dass die derzeitige atmosphärische Belastung durch künstlichen Staub vielleicht nur ein Fünftel der Menge beträgt, die durch die Vulkanexplosion von Krakatoa im Jahr 1883 in die Stratosphäre geworfen wurde. Die Rolle von atmosphärischem Staub ist komplex, da er zwar das auf die Erde kommende Sonnenlicht reduziert, aber der Staub wird selbst durch das Licht erwärmt, das die Atmosphäre erwärmt, in der er sich befindet.

Bis vor kurzem war die Vorstellung, dass Eiszeiten durch intensive vulkanische Aktivitäten ausgelöst werden, unpopulär, da keine Beweise für eine solche Aktivität vorliegen. Die Hypothese hat durch die Analyse von Sedimentkernen, die vom Bohrschiff Glomar Challenger aus dem Meeresboden gewonnen wurden, an Glaubwürdigkeit gewonnen.

Laut Wissenschaftlern der University of Rhode Island war Asche weit häufiger in Schichten zu finden, die in den letzten zwei Millionen Jahren gebildet wurden, als in den vorausgegangenen 18 Millionen Jahren.

Wenn der weltweite Energieverbrauch in der jetzigen Größenordnung weiter steigt, hat MI Budyko, ein führender sowjetischer Spezialist, katastrophale Klimaveränderungen prognostiziert. Er sagt, dass das kritische Niveau wahrscheinlich innerhalb eines Jahrhunderts erreicht wird.

Dies werde zu einer „vollständigen Zerstörung der polaren Eisdecke“ führen. Mit dem eisfreien Nordpolarmeer würde nicht nur der Meeresspiegel steigen, sondern auch das gesamte Wettersystem der nördlichen Hemisphäre verändert.

Dr. Mitchell hat jedoch angedeutet, dass die Erwärmung des Klimas aufgrund der Verschmutzung ausreichen könnte, um eine Eiszeit „ganz ungewollt“ auszulösen.

KANN DIE WAHRHEIT ERLERNT WERDEN?

Eine genauere Kenntnis der Vergangenheit wird sicherlich die Wahl zwischen verschiedenen Erklärungen für langfristige Klimaveränderungen erleichtern. Das Greenland Ice Sheet Program mit amerikanischen, dänischen und schweizerischen Teilnehmern bohrt eine Reihe von Löchern in den Kamm des grönländischen Eises in der Hoffnung, letztendlich das Klima der letzten 100.000 Jahre in jahresweisen Aufzeichnungen zu rekonstruieren.

Bisher wurde das Eis bis zu einer Tiefe von 400m durchbohrt, was die untersuchten Zeiträume um 1.420 Jahren verlängert. Die jährlichen Schichten können wie Baumringe in Bezug auf Sommer- und Winterschwankungen in der relativen Häufigkeit von zwei Formen von Sauerstoff (Sauerstoff 16 und Sauerstoff 18) gezählt werden. Ihr Verhältnis gibt die Temperatur zu dem Zeitpunkt an, als der Schnee zur Bildung dieser Eisschicht fiel.

[…]

The New York Times 21. Mai 1975 Vollständiger Text.

Die „Wissenschaft“ steckte damals eindeutig in den Kinderschuhen… Aber, wie schon erwähnt, manche Dinge ändern sich nie…

Wenn der weltweite Energieverbrauch in der jetzigen Größenordnung weiter steigt, hat MI Budyko, ein führender sowjetischer Spezialist, katastrophale Klimaveränderungen prognostiziert. Er sagt, dass das kritische Niveau wahrscheinlich innerhalb eines Jahrhunderts erreicht wird.

Dies werde zu einer „vollständigen Zerstörung der polaren Eisdecke“ führen. Mit dem eisfreien Nordpolarmeer würde nicht nur der Meeresspiegel steigen, sondern auch das gesamte Wettersystem der nördlichen Hemisphäre verändert.

Zumindest waren ihre Vorhersagen damals weniger fälschbar… Die Eiskappen werden bis 2075 geschmolzen sein. Hat jemand eine Referenz für Budykos Vorhersage? Bezog er sich auch auf die Antarktis und Grönland? Oder nur das Meereis? Die Tatsache, dass die aktuelle arktische Meereisbedeckung deutlich über dem holozänen Durchschnitt liegt, führt mich zu einem Alfred E. Neuman-Moment .

„Kommt die Eiszeit?“, Science News, 1. März 1975

Worte sind nicht nötig und das bringt uns zum pièce de résistance …

Wie die gegenwärtige gefälschte Klimakrise uns vor der Klimakrise der 70er gerettet hat

Autor, modifiziert nach IPCC AR4

Nach den heiligen Klimamodellen wäre der Planet ohne die Climate Wrecking Industry kälter als „Die Eiszeit kommt“ …

Dieses stolze Mitglied der Climate Wrecking Industry sagt: „Gern geschehen.“

****

Gefunden auf WUWT vom 24.07.2019

Zusammengestellt und übersetzt durch Andreas Demmig

https://wattsupwiththat.com/2019/07/24/that-70s-climate-crisis-show/