Wird man aus dem Blackout in Spanien lernen?

Sozialisten wollen die heilige Kuh „Erneuerbare“ aus dem Schußfeld nehmen

von Edgar L. Gärtner

Bald begehen wir in Europa einen unrühmlichen Jahrestag. Am 28. April vor einem Jahr ging auf der iberischen Halbinsel um die Mittagszeit fast gar nichts mehr. Aufzüge und Beleuchtungen in Hochhäusern, Klimaanlagen, Operationssäle in Krankenhäusern und andere lebenswichtige Anlagen warn plötzlich ohne Strom. Der Blackout hielt fast zwölf Stunden an und forderte nach seriösen Schätzungen an die 150 Menschenleben, was die sozialistische Regierung Spaniens unter Pedro Sánchez in dieser Höhe nicht bestätigen will. Die Fachleute sprechen vom folgenreichsten Stromausfall in Europa seit 20 Jahren. (Ich habe im vergangenen Jahr hier bei EIKE darüber berichtet.)

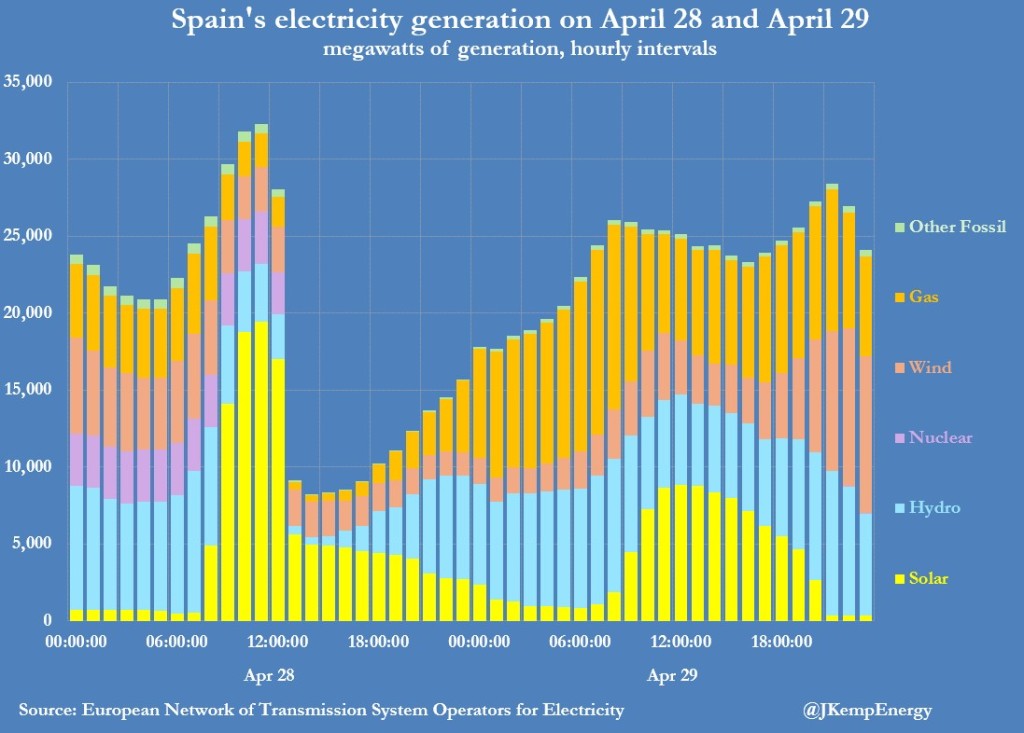

Was war passiert? An diesem sonnenreichen Frühlingstag war die Leistung der inzwischen in Spanien Landschaften prägenden großflächigen Fotovoltaik-Anlagen, die größtenteils nicht regelbar sind, gegen Mittag auf fast 18.000 Megawatt hochgeschnellt. Das waren über 60 Prozent des damaligen gesamten spanischen Strombedarfs. Gleichzeitig trugen dort Windkraftanlagen zu über 12 Prozent zur Elektrizitätsproduktion bei – mehr als die wenigen im Betrieb verbliebenen Kernkraftwerke, deren Anteil nur noch 11,6 Prozent erreichte. Hinzu kamen noch über 5 Prozent thermische Solarenergie und einige Wasser- und Gaskraftwerke. Doch um 12h23 brach das Netz zusammen.

Entscheidend für den Zusammenbruch des Elektrizitätsnetzes war nach Ansicht André Merlins, des Gründungs-Direktors des französischen Netzbetreibers RTE, der übermäßige Anteil ungeregelter Photovoltaik. Denn um im Netz Platz zu schaffen für den kurz vor Mittag exponentiell ansteigenden Solarstrom, regelten die Ingenieure die verbliebenen Gas- und Wasserkraftwerke und möglicherweise auch die Kernkraftwerke maximal herunter. Doch dann kam es im Netz zu heftigen Fluktuationen von Frequenz und Spannung und in deren Folge zu einem plötzlichen Leistungsabfall. Die verbliebenen rotierenden trägen Massen der Generatoren der Kern-, Wasser- und Gaskraftwerke konnten diesen Leistungsausfall der großflächigen Solarkraftwerke nicht abfangen. Das von der Vereinigung der europäischen Elektrizitäts-Transportnetz-Betreiber ENTSO-E erst im März 2026 in einem dicken Bericht mit großer Verspätung publizierte Diagramm zeigt, was am 28. April 2025 passiert ist.

von ENTSO-E

Diese von ENTSO-E gelieferte Grafik zeigt, dass der überproportional hohe Anteil ungeregelter Photovoltaik im spanischen Strommix bei schnellen Leistungsschwankungen nur begrenzt durch regelbare Kraftwerke und rotierende Massen stabilisiert werden kann.

Dieses Diagramm lässt zwei unterschiedliche Interpretationen zu, die aber beide zeigen, dass der übergroße Solaranteil am spanischen Strom-Mix für den Zusammenbruch des Netzes verantwortlich war. Um die „Erneuerbaren“ aus dem Schussfeld zu nehmen, wiesen Pedro Sanchéz und seine Getreuen auf das plötzliche Aufkommen von Wolken und die damit verbundene Frequenz- und Spannungsfluktuation hin. Manche gingen dabei gar so weit, den Klimawandel dafür verantwortlich zu machen. Als Abhilfe hat die sozialistische Regierung folglich Investitionen in Stromspeicher von fast einer Milliarde Euro angekündigt.

Eine Enquête des spanischen Senats bestätigte dagegen zwar den raschen Wechsel von Frequenz und Spannung um die Mittagszeit, wies aber anhand des ENTSO-E-Reports darauf hin, dass das zu geringe Gewichtl der Trägheit rotierender Massen für den Zusammenbruch des spanischen Elektrizitätsversorgungsystems verantwortlich war. Dem könnten nur Investitionen in nukleare und fossile Kraftwerke abhelfen. Das mühsame Wiederhochfahren des spanischen Netzes erfolgte in der Tat mithilfe der Einspeisung französischen Nuklearstroms über die Kopplungsstelle im Baskenland und eine zweite Kopplungsstelle in Katalonien. Auf sich gestellt hätten die Spanier dafür viel länger gebraucht.

Den unbezweifelbaren Beleg für die zweite Erklärung lieferte schließlich die Aufzeichnung der Dialoge zwischen den Dispatchern des spanischen Netzbetreibers Red Electrica de España (REE), die gegen den Widerstand der Sozialisten vom spanischen Parlaments-Magazin Demócrata veröffentlicht und vom spanischen Senat übernommen wurden. Spanien müsste danach wieder zurückkehren zu einem System der Elektrizitätsversorgung, dessen Rückgrat herkömmliche Kraftwerke mit Generatoren bilden.

Am 28. Januar dieses Jahres geriet das spanische Stromnetz schon wieder an den Rand des Zusammenbruchs, als der herannahende Orkan „Kristin“ die rasche Abschaltung aller Windräder notwendig machte. Durch den Vorfall Ende April 2025 vorgewarnt, fuhren die Dispatcher rechtzeitig Gasturbinen und koppelten industrielle Großverbraucher ab. Im Vergleich zur herkömmlichen Elektrizitätsversorgung mithilfe von Großkraftwerken bleibt das System der „Erneuerbaren“ also höchst störanfällig.

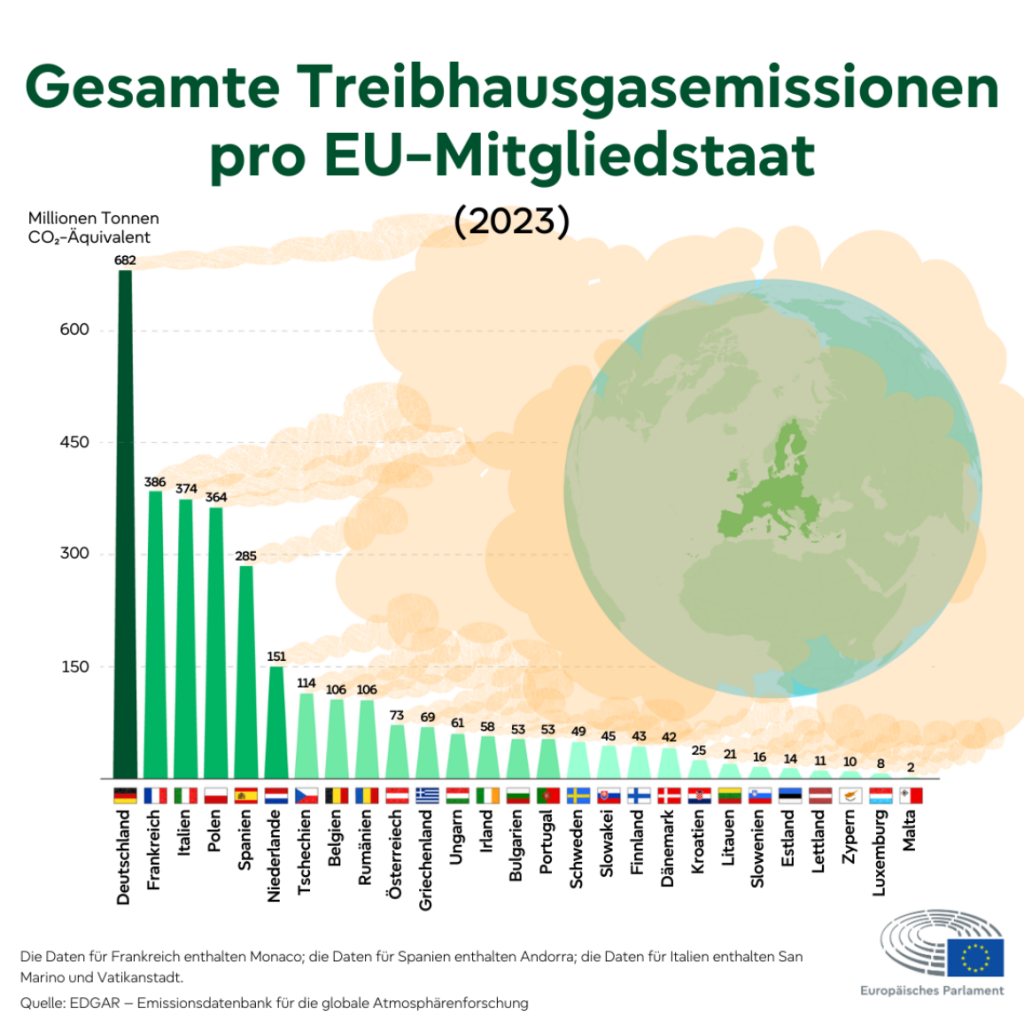

Dennoch setzen die Regierungen von Spanien, Frankreich und Deutschland weiterhin auf den massiven Ausbau der „Erneuerbaren“. Angesichts der durch den Krieg gegen den Iran heraufbeschworenen Energiekrise verbreiten sie mit Nachdruck die Illusion, damit die Abhängigkeit von Öl und Gas aus dem Nahen Osten oder aus Rußland verringern zu können. Zwar hat Ursula von der Leyen als Präsidentin der EU-Kommission vor wenigen Wochen öffentlich den Ausstieg aus der verläßlichen und sauberen Kernenergie bedauert. Aber die EU-Kommission fährt fort, dem französischen Staatskonzern EDF auf Druck der schwarzroten deutschen Bundesregierung bei der Finanzierung des Baus neuer Kernreaktoren Steine in den Weg zu legen. Und sie hat noch immer nicht entschieden, das Fracking der eigenen bedeutenden Schiefergasvorräte zuzulassen. Stattdessen versucht man, den Europäern Gasheizungen zu verbieten. So bleibt es bis auf Weiteres offen, ob Westeuropa aus dem tödlichen Blackout vom 28. April 2025 wirklich etwas lernen wird.