Dr. Jürgen Schulz

„Viele verfolgen den Weg hartnäckig, den sie gewählt haben, aber nur wenige das Ziel“, ist ein berühmtes Zitat von Friedrich Nietzsche. Wirft man nun einen Blick auf die deutsche Energiepolitik, dann kann man hier eine Analogie ziehen. Denn Deutschland marschiert schon seit Jahren konsequent, man kann sagen regelrecht hartnäckig, auf ein und demselben

Pfad, mit dem Ziel, die sogenannte ‚Energiewende‘ als weltweiter Vorreiter erfolgreich zu vollziehen. Doch werden immer mehr Zeichen sichtbar, dass dieses Ziel über den bisher gewählten Pfad kaum erreichbar sein kann. Zumindest nicht ohne große Opfer für Gesellschaft und Wirtschaft. Sichtbar waren viele Erkenntnisse schon seit Jahren, doch wollte niemand von den politischen Entscheidern bisher innehalten und den Pfad sowie das Ziel überprüfen.

Eine Überprüfung dieses Ziels oder zumindest die Betrachtung einer Weggabelung, um einen

anderen Pfad zu wählen oder sogar die Überlegung wieder umzukehren, wurde bisher anscheinend

nicht in Betracht gezogen. Doch was ist, wenn sich Deutschland auf einem gefährlichen Pfad

befindet, der unter anderem aufgrund zu vieler physikalischer und wirtschaftlicher Einflüsse nicht zu dem gewünschten Energiepolitikziel führen kann? Ist Deutschland gefangen in seiner Pfadabhängigkeit? Energiepolitik ist komplex, sehr komplex. Einfache Lösungen gibt es nicht. Deutschland begibt sich trotzdem auf einen Pfad, der immer weniger Navigationsfreiheit zuläßt? Warum ist das so?

Pfadabhängikeiten

„Pfadabhängigkeit ist ein analytisches Konzept zur Beschreibung von (sozialen) Prozessen. Der Grundgedanke ist, dass Prozesse durch jeweils vorgängige Ereignisse oder Ereignissequenzen nachhaltig beeinflusst werden können.”[1]

Im Folgenden ist die zeitliche Reihenfolge (history matters) und die Relevanz von Ereignissen (small events) stichpunktartig nachgezeichnet. Die selbstverstärkenden Tendenzen (self-reinforcement) zur Fortführung sind klar erkennbar:

- 2005: Das Energiewirtschaftsgesetz – EnWG, Paragraph 1 sagt: (1) Zweck des Gesetzes ist eine möglichst sichere, preisgünstige, verbraucherfreundliche, effiziente, umweltverträgliche und treibhausgasneutrale leitungsgebundene Versorgung der Allgemeinheit mit Elektrizität, Gas und Wasserstoff, die zunehmend auf Erneuerbaren Energien beruht.[2]

- 2009: Deutschland verabschiedet das EEG (Erneuerbare Energiegesetz) und begibt sich damit auf den Pfad in Richtung Klimaneutralität.[3] WEAs (Windenergieanlagen) und Solaranlagen werden daraufhin verstärkt ausgebaut.

- 2011: Aufgrund der Nuklearkatastrophe in Fukushima folgte die – aus nachvollziehbaren Gründen – viel applaudierte Verkündung, aus der Kernenergie auszusteigen. Damit verzichtet Deutschland freiwillig auf Verzweigungen (critical junctures) des eingeschlagenen Pfades. Angst ist ein guter Motivator, aber sie ist ein schlechter Ratgeber. Die zukünftig fehlenden und im Betrieb CO2-freien KKWs (Kernkraftwerke) müssen ersetzt werden.

- 2010er Jahre: Der Ausstieg aus Kohle als Energiequelle wird ebenfalls vorbereitet. Für die in Zukunft fehlende Energie aus Kohle und Uran wird verstärkt Erdgas als umweltfreundliche Ersatzquelle auserkoren. Aufgrund tiefer historischer Verflechtungen zwischen Deutschland und Russland steigen Erdgasimporte aus Russland deutlich an (2011: 32,859 Mio. Kubikmeter; 2017: 62,08 Mio. Kubikmeter; 2021: 55,443 Mio. Kubikmeter)[4], und damit die Abhängigkeit von sowohl Erdgas, als auch Russland.[5]

- 2015: Das Pariser Klimaabkommen verschärft den internationalen Druck, aus fossilen Energieträgern auszusteigen. Als Konsequenz verschärfen einzelne Staaten bzw. Staatenblöcke, wie z. B. die EU, ihre Richtlinien und Rechtsprechungen.

- 2020: Die EU beschließt den EGD (European Green Deal), ein Satz von Richtlinien und Gesetzen, die Europas Weg zur Klimaneutralität bis 2050 vorzeichnet.[6] Ein Sachverständigenrat für Umwelt (SRU) berechnete das sogenannte CO2-Budget für Deutschland.[7a] Diese Berechnungen stützen sich auf diverse Szenarien des IPCC (Intergovernmental Panel of Climate Change), die mit Modellen berechnet wurden.

- 2021: Das Bundesverfassungsgerichts meißelt diese Erkenntnisse ins deutsche Gesetzbuch und setzt damit entsprechende Umsetzungsmechanismen in Gang.[8] Deutschland wird per Gerichtsbeschluss ein CO2-Budget zugeschrieben. Konkret: „Für eine Temperaturgrenze von 1,75 °C mit 67 % Wahrscheinlichkeit umfasst das maximale CO2-Budget für Deutschland noch 3,9 Gigatonnen CO2. Würden die Emissionen in diesem Fall ab heute linear auf null reduziert, müsste Deutschland spätestens 2037 CO2-neutral sein.“[7a] Zum Vergleich: 2023 emittierte Deutschland 0,6 Gigatonnen CO2.[7b] Das Ziel ist nun mit Zahlen definiert, es wird dadurch messbar und damit managebar.

- 2022: Russland greift die Ukraine militärisch an. Die Sanktionen gegen Russland rücken die Abhängigkeit von russischem Gas ins deutsche Bewusstsein. Als Ersatz wird Frackinggas aus den USA gekauft; dieses LNG ist teuer, und es ist schmutziger bzgl. CO2-Fussabdruck als Kohle.[9] Deutschland lehnt es ab, eigenes Frackinggas zu fördern.

- 2023: Die letzten 3 noch funktionierenden und im Betrieb CO2-freie KKWs werden abgeschaltet. Diese ‘critical juncture’ ist nun verriegelt. Der fehlende deutsche Atomstrom wird mit französischem Atomstrom ersetzt. Kernenergie gilt zwar weltweit als effiziente und emissionsfreie Technologie, und sie genießt weltweit steigendes Ansehen, aber Deutschland lehnt es für sich ab. Deutschland wird vom Stromexporteur zum Stromimporteur.

- 2024: Das Kraftwerkssicherheitsgesetz soll den Bau zusätzlicher Gaskraftwerke forcieren (ca. 40-50 sind bis 2030 geplant), denn sie sollen als Backup für ‘Erneuerbare Energien’ fungieren.[10] Diese Kraftwerke sollen umrüstbar sind auf Wasserstoff. Es gibt bis heute weltweit nur eine Gasturbine (von Siemens [11]) die mit Wasserstoff kompatibel ist, und kein einziges Kraftwerk befindet sich im Bau.

- 2024: Das Wasserstoffbeschleunigungsgesetz wird verabschiedet.[12] Es forciert die Nutzung von Wasserstoff als Backup und Nutzung als Speicher für ‘Erneuerbare Energien’, falls Wind und Sonne ausfallen. Es besteht jedoch ein globaler Mangel an, insbesondere grünem Wasserstoff, wasserstoff-kompatiblen Gasnetzen und Transportschiffen (es gibt nur eins, die japanische Suiso Frontier [13]).

- seit 2024: Energiekosten, Energiesicherheit und Versorgungssicherheit geraten als kritische Faktoren der Wirtschaft zunehmend in den Blickpunkt.

Unverzeihliche Fehler

„Unverzeihliche Fehler zeichnen sich nicht durch Unachtsamkeit, Irrtum oder das Fehlen besseren Wissens aus. Ihre Besonderheit besteht darin, auch bei Kenntnis aller Umstände keine Alternative zuzulassen“, ist ein Zitat von Juli Zeh, und es beschreibt die Situation der deutschen Energiepolitik sehr gut.

Die obigen Schritte sind bestimmt richtig und gut (gemeint) auf dem Ziel einer Energiewende, wenn nur die Ausrüstung stimmen würde oder wenn Ideologie dabei keine Rolle spielen würde! Was passiert eigentlich, wenn Deutschland und die EU ihr CO2-Budget aufgebraucht haben, ohne ‘klimaneutral’ zu sein?

Die Pfadabhängigkeit, getrieben durch Ideologie, steigt mit jedem weiteren Schritt, die Konsequenzen dieser Abhängigkeit werden immer sichtbarer: der wirtschaftliche Niedergang ist unbestreitbar. Die Schwierigkeit der Abkehr wird mit jedem Schritt größer, und damit die Gefahr des Verharren in diesem suboptimalen Zustand (lock-in).

Wie kommen die vielen Protagonisten dieser Politik ohne Gesichtsverlust aus dieser Sackgasse heraus? Ein radikales Um-Denken, ein Neu-Denken ist dringend erforderlich. Denn wir wissen bereits aus diversen anderen Situationen bzw. Projekten, wie (überlebens-)wichtig ein Innehalten und eine Überprüfung des eingeschlagenen Weges sein kann. Das Verlassen des eingeschlagenen Pfades bedeutet nicht die Aufgabe des Zieles, sondern die Suche nach einem anderen Pfad.

Blei zu Gold verwandeln – ein Traum der Alchemisten

Auf dem Campus des MIT (Massachusetts Institute of Technology) in Cambridge steht eine Skulptur von Jaume Plensa, ‘The Alchemist’. Sie symbolisiert wohl, dass man groß und fantastisch denken soll und muss, um das ‚Unmögliche‘ möglich zu machen. Die alten Alchemisten waren in ihrem Denken ihrer Zeit voraus, denn man kann tatsächlich aus Blei Gold machen. Die Alchemisten hatten aufgrund noch fehlenden Wissens nur den falschen Denkansatz, denn die Lösung des Problems liegt in der Physik und nicht in der Chemie. Es ist sehr energieaufwendig und technologisch sehr herausfordernd, aber es geht: Man muss lediglich Bleiatome in einem Teilchenbeschleuniger mit Elementarteilchen beschießen.

Letztendlich geht vieles im Leben, aber die Frage sollte doch eigentlich auf den praktischen Nutzen gerichtet sein? Was ist der Weg, der zum Ziel führt? Gibt es alternative Wege? Wenn man unbedingt Gold möchte, und es wirklich keinen anderen Zugang gibt, als den über das Bombardement von Bleiatomen in Teilchenbeschleunigern, dann, um Himmels Willen, muss man diesen Weg gehen.

Wenn das Ziel der deutschen Energiepolitik die Senkung von deutschen CO2-Emissionen ist, dann muss man den eingeschlagenen Weg unbedingt weitergehen, denn die Kombination aus Deindustrialisierung und ‚Erneuerbaren Energien’ wird definitiv zum Ziel führen. Wem das dann nützt, steht auf einem anderen Blatt. Gibt es einen anderen Weg ‚Klimaneutralität‘ zu erreichen?

Sobald man also mit dem Bau des ‘Teilchenbeschleunigers’ (also Windenergie- und Solaranlagen) beginnt und gleichzeitig, bzw. vorzeitig, alle anderen Technologien der Energieerzeugung inklusive vorhandener Infrastruktur (also Kernkraftwerke, Kohlekraftwerke, Erdgasnetze) zerstört, hat man bereits die ersten Schritte auf einem schwer zu verlassenden Pfad getan.

Exkurs – Pioniere des Alpinismus

Reinhold Messner ging 1980 neue Wege: er schaffte als erster Mensch die Solo-Besteigung des Mount Everest und das sogar ohne Sauerstoffflasche. Er war Vorreiter einer neuen Form des Hochalpinismus, er hatte eine außergewöhnliche Konstitution, er war ein außerordentlicher Bergsteiger. Nur sehr wenige sind ihm gefolgt, denn das Risiko und der Preis, den man für diesen Weg zahlt, ist einfach zu hoch, Scheitern ist sehr wahrscheinlich. Die Weisen unter den Bergsteigern gehen nicht solo, und sie verzichten nicht auf die Sauerstoffflasche, um den Gipfel zu erreichen.

Eine Seilschaft um Andreas Hinterstoisser ging 1936 neue Wege an der damals noch unbezwungenen Eigernordwand. Es endete mit einer der bekanntesten Tragödien am Eiger. Hinterstoisser überwand eine schwierige Stelle mithilfe eines haarsträubenden Manövers, indem er ein Seil fixierte und es als Pendel benutzte, um auf eine ansonsten schier unmöglich zu erreichende Stelle in der Nordwand zu gelangen; diese Passage ist als ‘Hinterstoisser-Quergang’ in die Geschichte eingegangen. Seine 3 Bergkameraden folgten ihm. Man entschied sich, das Seil wieder einzuziehen. Das war ein fataler Fehler. Die 4 Bergsteiger mussten schließlich den Rückzug antreten, aber sie hatten sich selbst den Rückweg abgeschnitten. Vom anderen Ende des ‘Quergangs‘ war es ohne das fixierte Seil unmöglich ihn zu überwinden. Alle 4 Bergsteiger bezahlten diesen Fehler mit ihrem Leben.

Wann und wo ist der richtige Umkehrpunkt? Wie kehrt man um?

Risikofaktoren von ‘Erneuerbaren Energiequellen’

Die 2030-Ausbauziele von WEAs und Solarenergie werden verfehlt werden.[14] Ein Erreichen der Ausbauziele würde allerdings weniger Probleme lösen, dafür aber neue, größere Probleme und zusätzliche Risikofaktoren erzeugen.

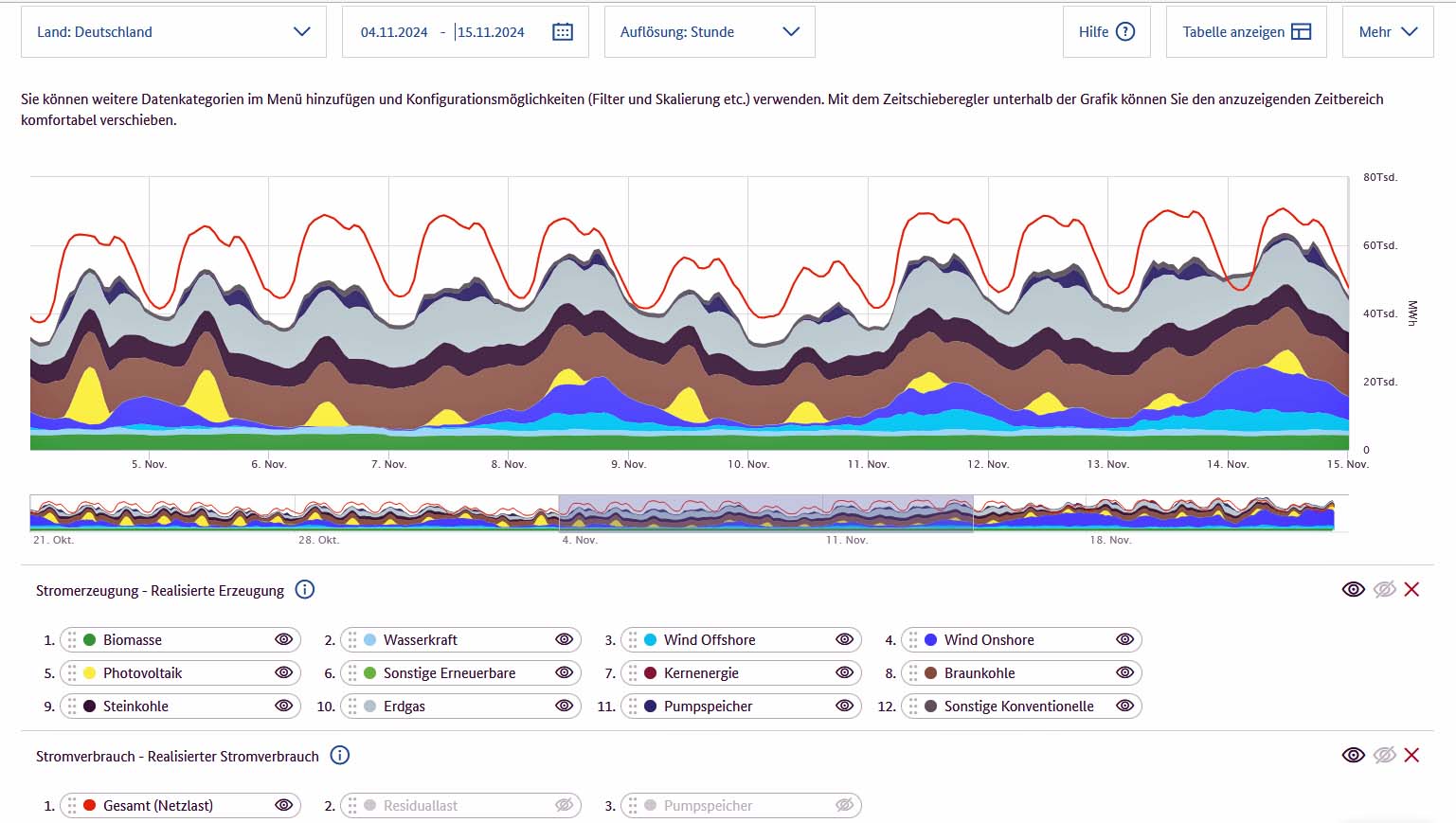

Deutschlands Energieversorgung ist wetterabhängig. Bei schlechtem Wetter (wenig Wind, wenig Sonne) ist Deutschland abhängig davon, für teures Geld Strom von seinen Nachbarn zu kaufen. Am 6.11.2024 wurde das kritisch, wie überhaupt die gesamte erste Novemberhälfte kritisch war: WEAs (ca. 30.000 Anlagen) und Solaranlagen lieferten nahezu Null Strom.

„Die Nachfrage betrug rund 66 GW. Sie wurde gedeckt durch heimische Produktion (rund 53 GW) und durch Importe (rund 13 GW)“, und weiter „das sei mehr als ein Warnschuss“, so RWE-Chef Markus Krebber.[15a] Die fehlenden Kapazitäten wurden durch einheimische Kohle- und Gaskraftwerke und Stromimporte aus dem Ausland gedeckt. Auch Bruno Burger vom ISE (Fraunhofer-Instituts für Solare-Energiesysteme) warnt “Bei tiefen Temperaturen darf nicht mehr viel schiefgehen”.[15b]

Kann sich eine Industrienation wie Deutschland derartige Risiken leisten? Welche ‘Not’ besteht, dass man solche Risiken eingeht?

An wind- und sonnenreichen Tagen wird Überschussstrom erzeugt. Es fehlen Möglichkeiten der Speicherung, und daher muss man zu folgenden Lösungen greifen:

- Strom muss ans Ausland abgegeben werden, und man muss selbstverständlich dafür bezahlen, das sind sogenannte negative Strompreise.[16]

- WEAs werden häufig bei zu viel Wind abgestellt, z. B. um negative Strompreise zu vermeiden. Ein Kraftwerk, das nicht arbeitet, weil es vorübergehend stillgelegt werden muss, verursacht trotzdem Kosten, z. B. müssen Netzentgelte an die Betreiber gezahlt werden.[17]

Grundlastfähige Kraftwerke wie KKWs, Kohle- und Gaskraftwerke laufen dagegen rund um die Uhr, weil sie wetterunabhängig sind. Allerdings müssen auch sie vorübergehend stillgelegt werden, nämlich wenn WEAs und Solaranlagen ausreichend Strom liefern. ‚Erneuerbare Energien‘ haben in Deutschland ‚Vorfahrtsrecht‘; Atomstrom würde z. B. die Leitungen verstopfen, gemäß den Äusserungen namhafter Politiker und Experten. Kraftwerke, egal welcher Art, kosten Geld, wenn sie nicht arbeiten.

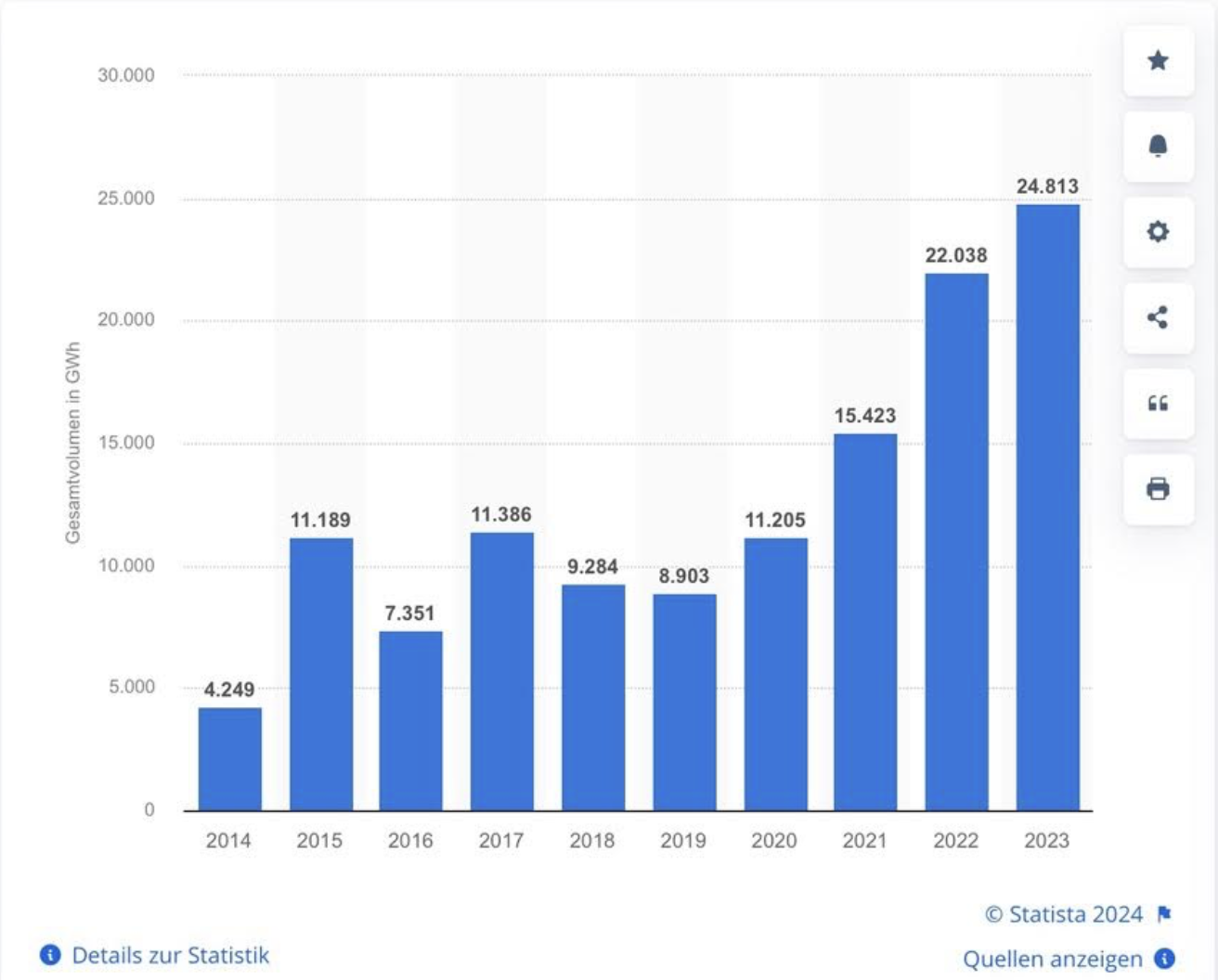

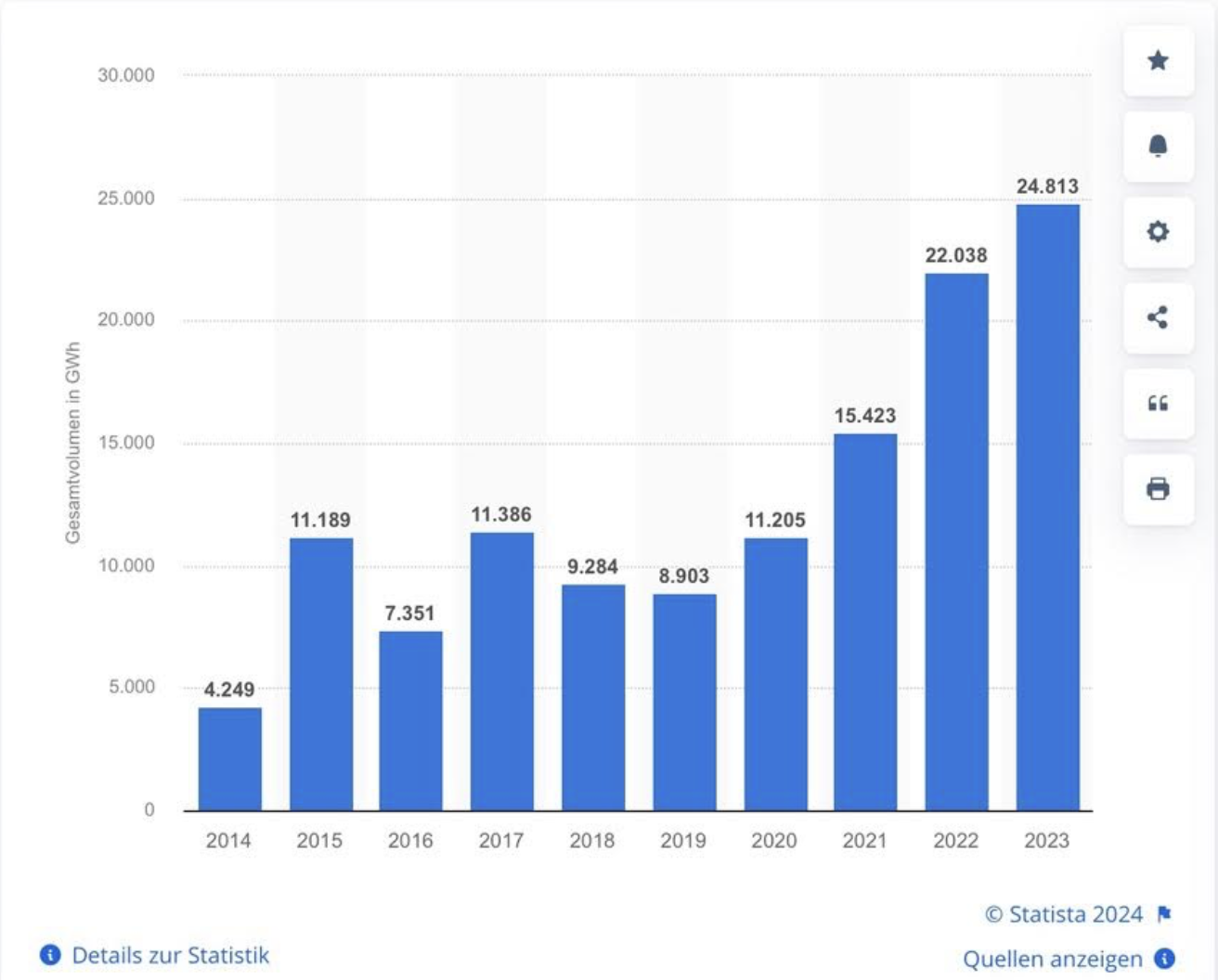

Diese unvermeidbare Komplexität ist einem Naturgesetz geschuldet, dem Kirchhoffschen Gesetz: „An jedem Verzweigungspunkt eines Stromkreises ist die Summe der zufließenden Ströme gleich der Summe der abfließenden Ströme“. Das bedeutet, dass die Frequenz des Stromnetzes immer konstant gehalten werden muss (50Hz), ansonsten bricht das Stromnetz zusammen. Ein direkter Hinweis auf Stabilität, und damit Versorgungssicherheit, ist somit die Zahl der Eingriffe, die nötig sind, die Stabilität des Stromnetzes zu gewährleisten und somit einen Blackout zu verhindern. Die Zahl der Eingriffe (Redispatchmassnahmen [18]) steigt, und korreliert direkt, mit dem Ausbau von WEAs und Solaranlagen.[19]

Diese Risiken haben Konsequenzen: z. B. verursachten diese Eingriffe/Maßnahmen 2023 Kosten in Höhe von €3,086 Mrd.[20] Die eigentlichen Konsequenzen sind jedoch viel essentieller.

Entwicklung des Gesamtvolumens der Redispatchmassnahmen im deutschen Übertragungsnetz in den Jahren 2014 bis 2023

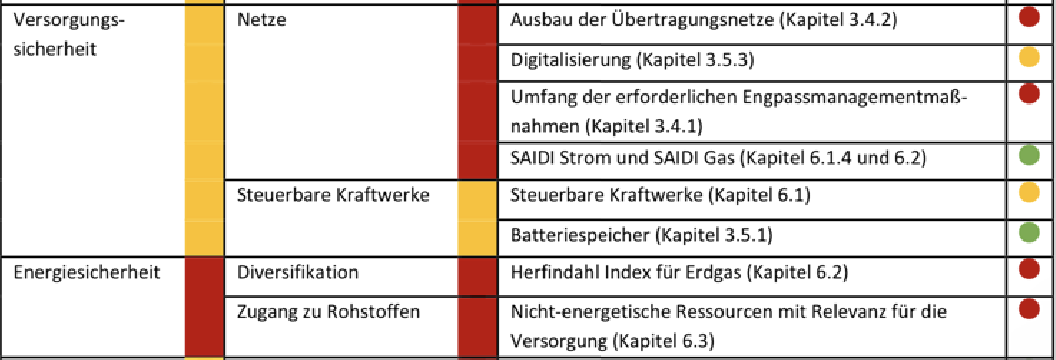

Versorgungssicherheit

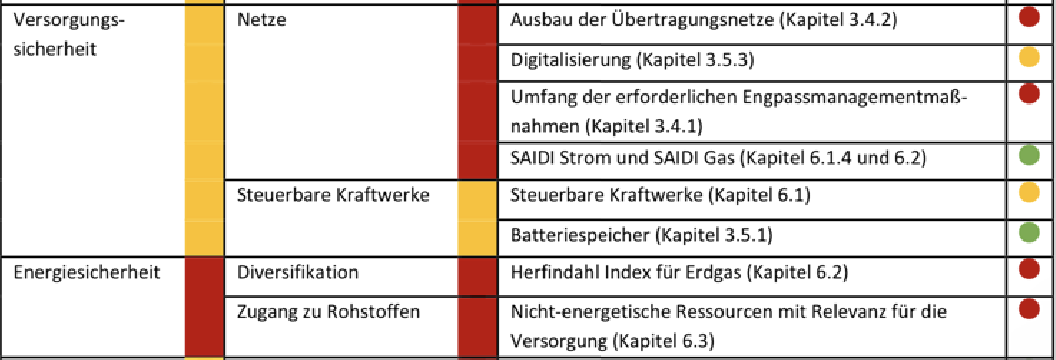

Der Bundesrechnungshof stellt die Versorgungssicherheit stark in Frage.[21] Ein Monitoringbericht von Experten kommt zu demselben Schluss.[22]

Zur Bewertung wurden Ampelfarben genommen: grün = ‘Ziel erreicht oder auf gutem Weg’; gelb = ’Erreichbarkeit aus heutiger Sicht nicht sichergestellt’; rot = ‘Ziel wird wahrscheinlich nicht erreicht’.

Das hindert jedoch die Medien nicht, wie z. B. Focus [23], Kognitive Dissonanz zu exerzieren und diese offiziellen Berichte zu ‚korrigieren’, frei

nach der ‘Palmström-Logik’: ‘Weil nicht sein kann, was nicht sein darf’. Die Leitmedien verschweigen diese Tatbestände gänzlich. Die Realitäten lassen sich zwar wegschreiben oder verschweigen, aber dadurch entflieht man ihnen nicht.

Auf die Probleme, Risiken und Hindernisse wurde bereits im letzten Jahrzehnt hingewiesen. H.-W. Sinn und F. Vahrenholt finden in den Leitmedien kein Gehör. Man tat sie als Unkenrufe ab. Die Corona-Pandemie und der russische Angriffskrieg auf die Ukraine kaschierten die wachsenden Probleme. Die Probleme waren aber immer schon da, die letzte Regierung hat sie jedoch massiv beschleunigt. Es wird aber immer schwieriger, die Krise wegzudiskutieren, denn sie betrifft nur Deutschland. Die Ausreden für die wirtschaftliche Misere werden immer unglaubwürdiger.[24]

Deindustrialisierung

Die wirtschaftliche Lage in Deutschland ist prekär. Während zunächst nur verhalten über Deindustrialisierung gesprochen wurde, so häufen sich die schlechten Nachrichten: Verlagerung der Produktion ins Ausland (BASF, Miele), strauchelnde Automobilhersteller (VW, Ford) und deren Zulieferer (ZF, Bosch), oder die Stahlindustrie (ThyssenKrupp). Die deutsche Wirtschaft wird arg gebeutelt. Plötzlich ‘begreift’ man sprichwörtlich, was es bedeutet, wenn immer weniger Kapital nach Deutschland fließt bzw. immer mehr Kapital aus Deutschland abfließt, denn 1000e verlieren ihren Arbeitsplatz.

Marcello Danieli organisiert mit seiner Firma ‚Harder Logistics‘ Umzüge von Unternehmen. Er sagte vor kurzem in einem Interview mit ‚Welt’: „Jedes Land ist attraktiver“. Viel konkreter ist jedoch diese Bemerkung: “Es fallen, in dieser Reihenfolge, immer dieselben Stichworte: Bürokratie, die zweithöchste Steuerlast innerhalb der OECD nach Belgien, die höchsten Energiekosten weltweit, der Fachkräftemangel. Neuerdings spielt offenbar auch das Thema Energiesicherheit eine wachsende Rolle.”[25] Die neuesten Untersuchungen des IMD (International Institute for Management Development) bzgl. Attraktivität von Wirtschaftsstandorten unterstreichen diese Einschätzung nachdrücklich: 2014 war Deutschland noch auf Platz 3, 2024 auf Platz 24 (von 67).[26]

Fazit

Die Zusammenhänge zwischen dem Ausbau von ‘Erneuerbaren Energien’ und steigenden Energiekosten sowie steigender Energieunsicherheit sind allzu offensichtlich. Die Probleme von WEAs und Solaranlagen sind systeminhärent, unabhängig davon was in Gerichtsurteilen, Zustandsberichten und Zeitungsartikeln steht. Sie sind auch unabhängig davon, was Politiker und Experten sagen oder denken, ob sie sich streiten oder einig sind. Tatsachen sind davon unbeeindruckt.

Das EnWG widerspricht sich inhaltlich selbst, denn die veranschlagten Ziele sind mit ‘Erneuerbaren Energien’ nicht erreichbar. Die verwendete ‚Ausrüstung’ (WEAs, Solaranlagen) ist wetterabhängig, und sie ist nicht bezahlbar (Wasserstoff), und sie ist damit nicht kompatibel mit dem Ziel. ‘Erneuerbare Energien’ wie Wind und Sonne sind außerdem nicht nachhaltig, gemäß den Nachhaltigkeitskriterien der UN [27]: Energie aus Deutschland ist teuer, nicht verlässlich, nicht effizient. Das ergibt sich selbsterklärend aus allen verfügbaren Daten und dem Status Quo der Wirtschaft.[24] Das Thema Energiesicherheit rückt immer stärker in den Vordergrund. Das wird aber (noch) heruntergespielt, wahrscheinlich weil Energiesicherheit an den Kern von ‘Die Energiewende’ geht. Trotzdem wird das alles ignoriert. Wie lange noch? Wird weitergemacht, bis man an den ‘Hinterstoisser-Quergang’ kommt? Oder hofft man auf einen ‘Messner-Augenblick’? Hoffentlich nicht.

„Selbst Irrwege und Seitenstraßen haben eine Bedeutung und einen Zweck, und sei es nur, um uns zu lehren, in welche Richtung der Weg zu uns selbst führt”, dieses Zitat stammt auch von Nietzsche, und es passt auch auf ‚Die Energiewende‘.

Quellenverzeichnis:

[1] https://www.staatslexikon-online.de/Lexikon/Pfadabhängigkeit

[2] https://www.gesetze-im-internet.de/enwg_2005/__1.html

[3] https://www.tuvsud.com/de-de/indust-re/klima-und-energie-info/eeg/eeg-2009

[4] https://de.statista.com/statistik/daten/studie/1302674/umfrage/russischer-anteil-am-deutschen-gasimport/

[5] https://www.bpb.de/themen/wirtschaft/europa-wirtschaft/515221/wie-europa-von-russischer-energie-abhaengig-wurde/

[6] https://www.esdn.eu/fileadmin/ESDN_Reports/ESDN_Report_2_2020.pdf

[7a] https://www.umweltrat.de/SharedDocs/Downloads/DE/04_Stellungnahmen/2020_2024/2022_06_fragen_und_antworten_zum_co2_budget.pdf?__blob=publicationFile&v=30#:~:text=Aktualisiert%20beträgt%20das%20maximale%20Budget,2027%20aufgebraucht; https://www.umweltrat.de/SharedDocs/Pressemitteilungen/DE/2020_2024/2024_03_PM_CO2_Budget.html; [7b] https://www.umweltbundesamt.de/daten/klima/treibhausgas-emissionen-in-deutschland/kohlendioxid-emissionen#kohlendioxid-emissionen-2023

[8] https://www.umweltbundesamt.de/sites/default/files/medien/11850/publikationen/31_2024_cc_co2-budget_hintergrundpapier_v2.pdf

[9] https://www.dersandwirt.de/klimarettung-a-la-habeck/

[10] https://www.bmwk.de/Redaktion/DE/Meldung/2024/20240911 kraftwerkssicherheitsgesetz.html; https://www.focus.de/earth/analyse/reservekraftwerke-fuer-energiewende-fuer-sein-letztes-grosses-energieprojekt-uebergeht-habeck-sogar-scholz_id_260511974.html

[11] https://www.siemens.com/de/de/produkte/gebaeudetechnik/hlk/oem/burner-solutions

[12] https://www.bmwk.de/Redaktion/DE/Pressemitteilungen/2024/05/20240529-bundesregierung-stellt-weichen-fuer-den-beschleunigten-ausbau-von-wasserstoffprojekten.html

[12] https://www.bundesregierung.de/breg-de/aktuelles/wasserstoffausbau-beschleunigen-2289130

[13] https://hydrogencouncil.com/en/toward-a-new-era-of-hydrogen-energy-suiso-frontier-built-by-japans-kawasaki-heavy-industries/

[14] https://www.ageu-die-realisten.com/archives/7650/#more-7650

[15a] https://www.nius.de/energie/news/rwe-chef-warnt-vor-totalem-strom-kollaps-schon-im-januar/892c43a6-29b8-42a0-9ef0-c94d9d53544e; [15b] https://www.n-tv.de/wirtschaft/Dunkelflaute-mit-Bruno-Burger-im-Klima-Labor-Bei-tiefen-Temperaturen-darf-nicht-mehr-viel-schiefgehen-article25354940.html

[16] https://www.next-kraftwerke.de/wissen/negative-strompreise#

[17] https://www.mdr.de/nachrichten/deutschland/wirtschaft/strompreise-netzentgelt-windrad-stromnetz-128.html

[18] https://redispatch.org/

[19] https://de.statista.com/statistik/daten/studie/916903/umfrage/volumen-redispatchmassnahmen-im-deutschen-uebertragungsnetz/

[20] https://www.bundesnetzagentur.de/SharedDocs/Downloads/DE/Sachgebiete/Energie/Unternehmen_Institutionen/Versorgungssicherheit/Engpassmanagement/QuartalszahlenQ4_2023.pdf?__blob=publicationFile&v=2#:~:text=Die%20Gesamtkosten%20setzen%20sich%20wie%20folgt%20zusammen%3A&text=Die%20vorläufigen%20Einsatzkosten%20für%20Redispatchmaßnahmen,um%20rund%2045%20Prozent%20gesunken

[21] https://www.bundesrechnungshof.de/SharedDocs/Kurzmeldungen/DE/2024/energiewende/kurzmeldung.html

[22] https://www.bmwk.de/Redaktion/DE/Publikationen/Energie/monitoringbericht-expertenkommission-zum-energiewende-monitoring.pdf?__blob=publicationFile&v=6

[23] https://www.focus.de/earth/analyse/bericht-des-bundesrechnungshofs-nach-bitterer-energie-schelte-muss-die-ampel-jetzt-drei-probleme-loesen_id_259742761.html

[24] https://www.ageu-die-realisten.com/archives/7691/

[25] https://www.welt.de/wirtschaft/plus254596974/Deutschland-Abwanderung-von-Unternehmen-Jedes-Land-ist-attraktiver.html

[26] https://www.freiheit.org/de/wirtschaft-absteiger-deutschland

[27] https://www.bundesregierung.de/breg-de/themen/nachhaltigkeitspolitik/bezahlbare-und-saubere-energie-1581908

Über den Autor

Dr. Jürgen Schulz. Ist von Beruf Chemiker, seit 2021 im Ruhestand, und seit diesem Jahr der AGEU (Arbeitsgemeinschaft Energie und Umwelt).

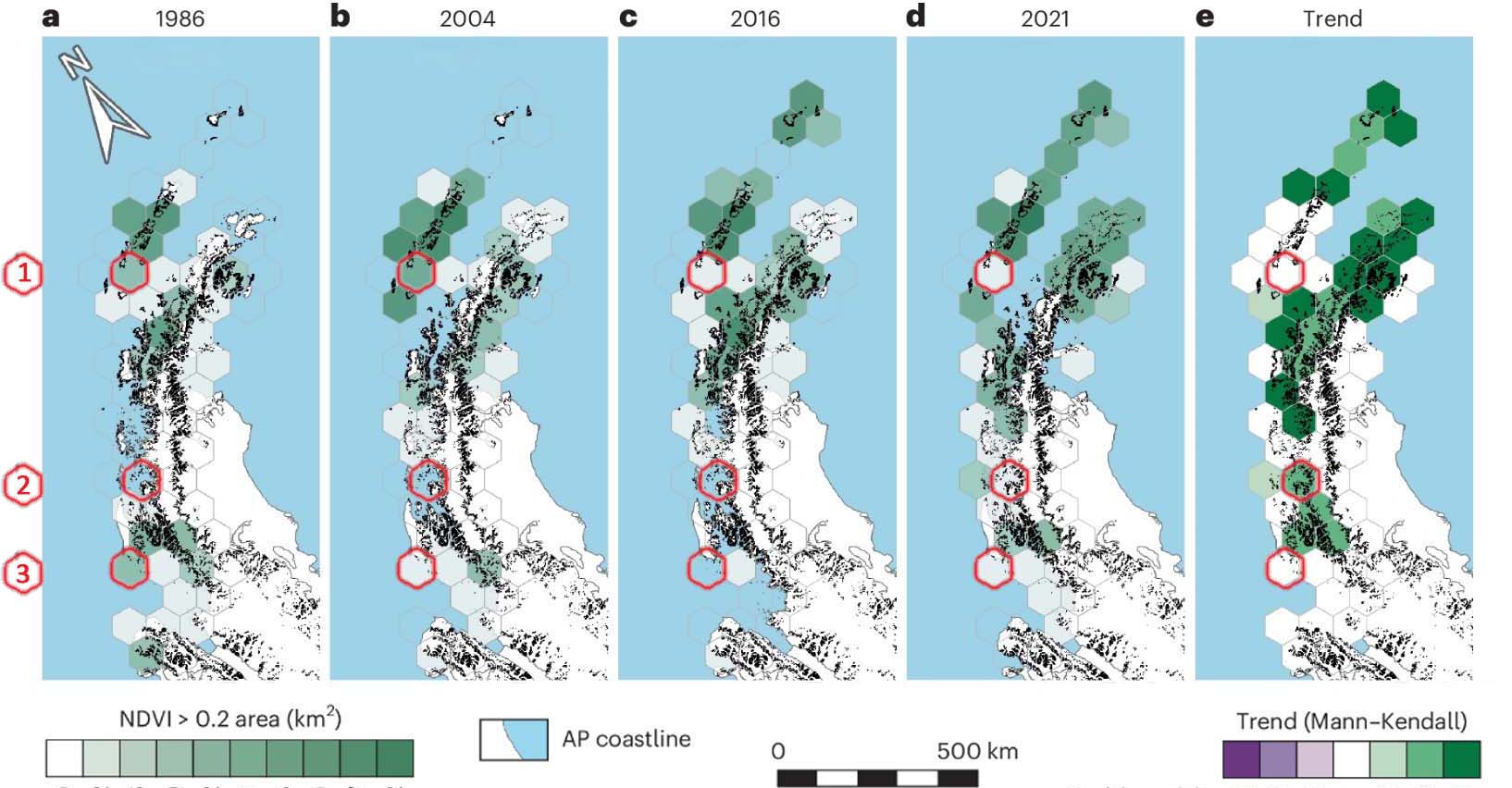

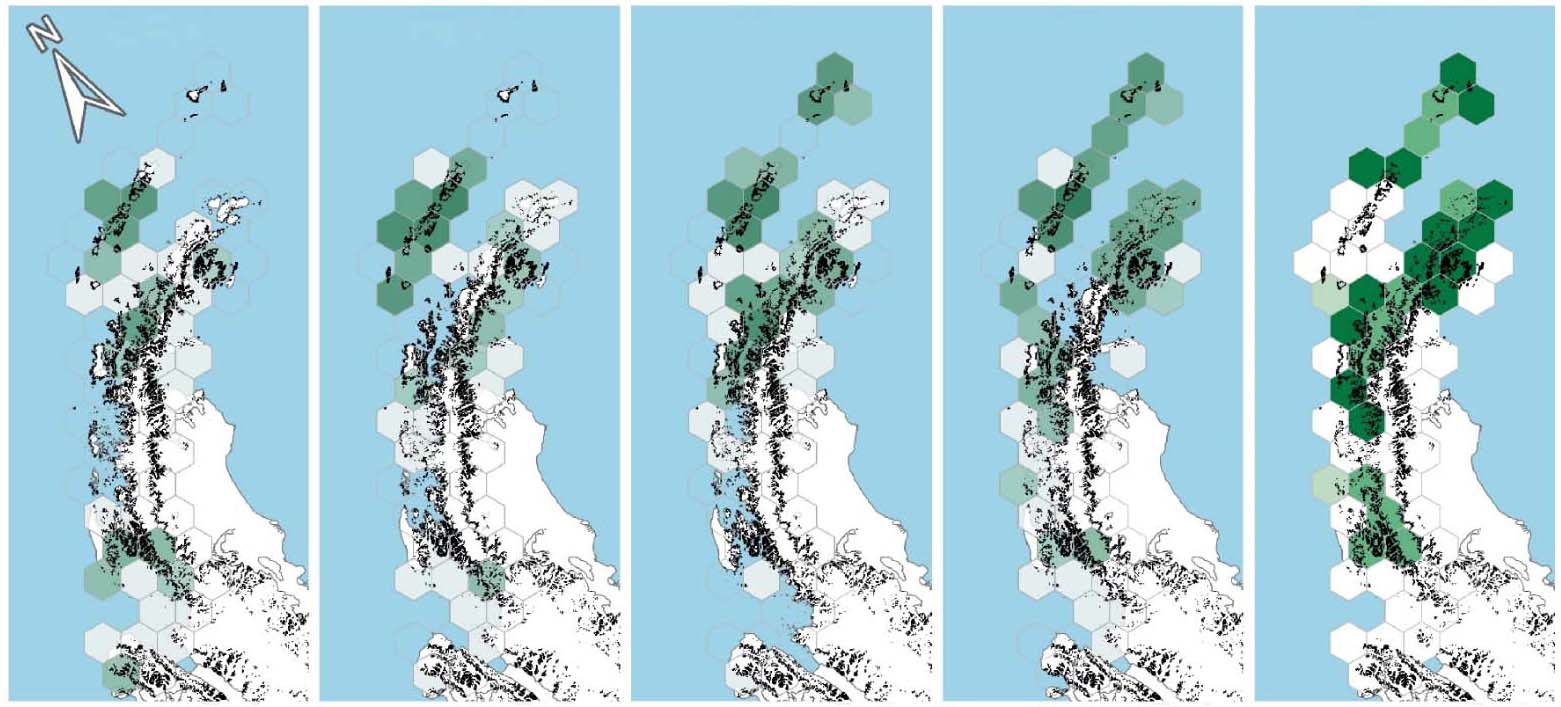

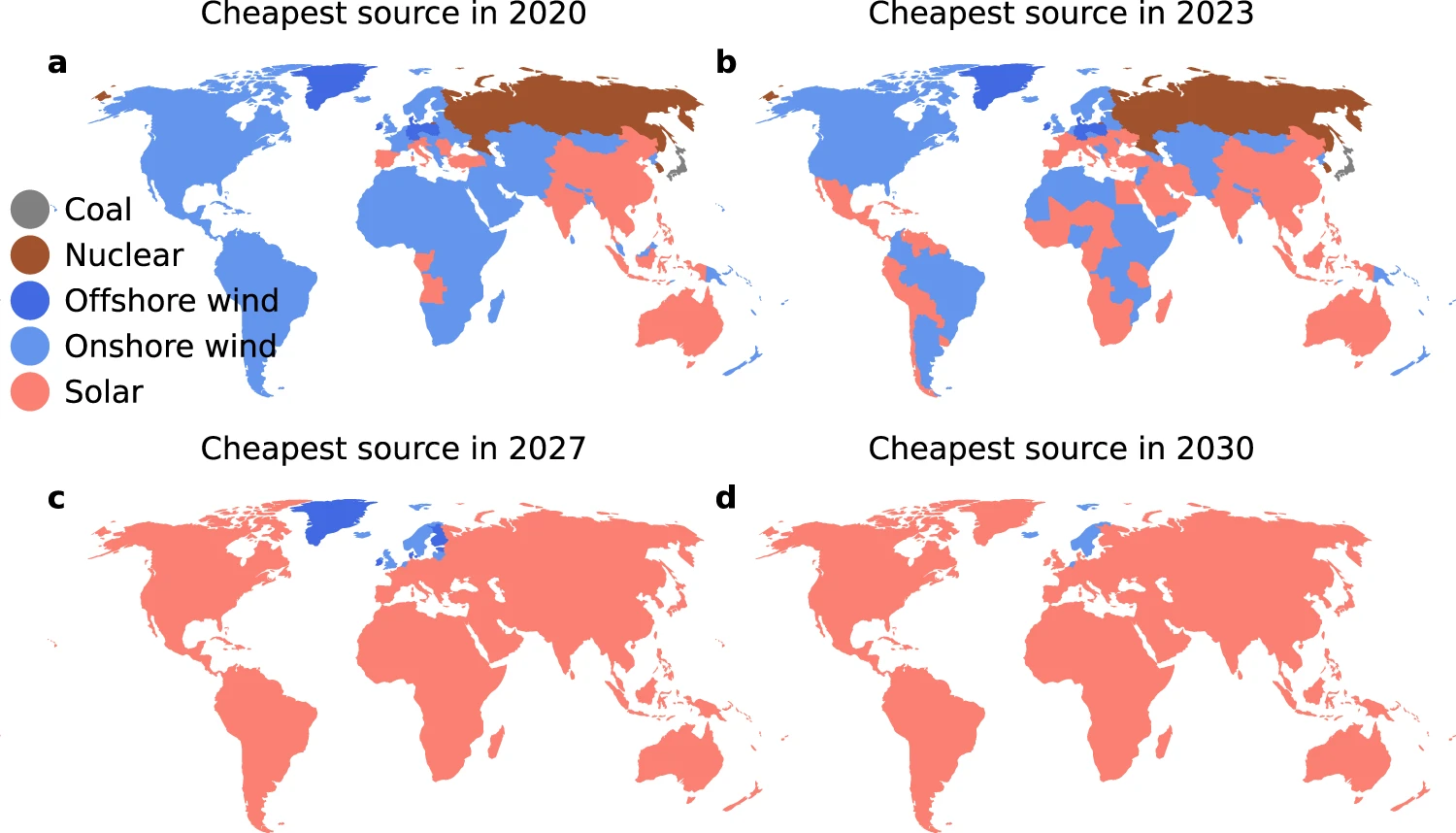

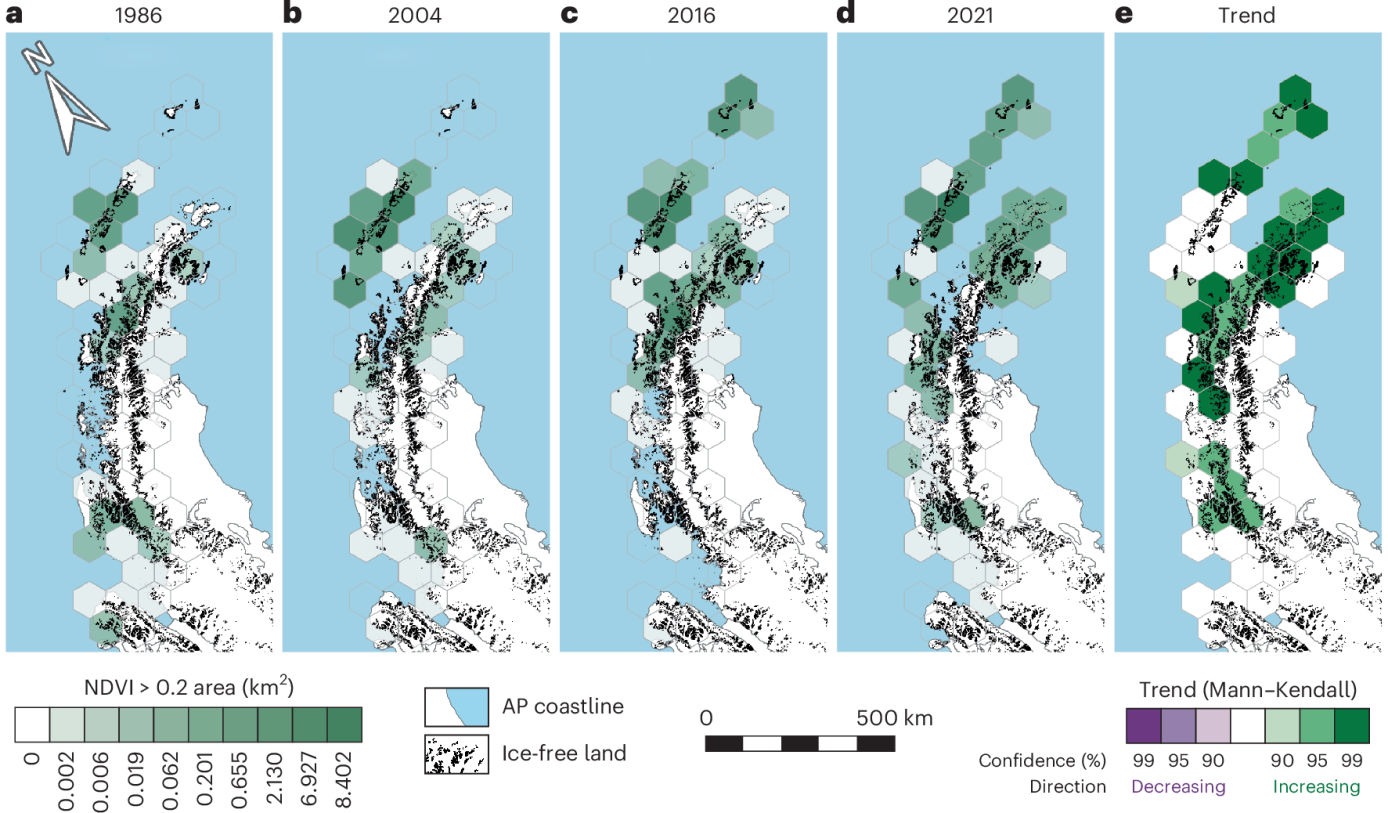

Aber das ist ja noch nicht mal alles. Schau’n Sie Sich das Titelbild mit dem Hinweis auf den FOKUS-Artikel noch mal an und vergleichen Sie das mit der Originalabbildung von Roland et al. (2024):

Aber das ist ja noch nicht mal alles. Schau’n Sie Sich das Titelbild mit dem Hinweis auf den FOKUS-Artikel noch mal an und vergleichen Sie das mit der Originalabbildung von Roland et al. (2024):