Strom zu Wärme: Oder wie man mit dem Schinken nach der Wurst wirft

Gemeint sind die Umwandlung von Elektrizität in Wärme, Gas oder flüssige Treib- oder Kraftstoffe. Diese als Zukunftstechnologien bezeichneten und mit großen Erwartungen belasteten Verfahren haben allesamt zur Grundlage, dass eines Tages billiger Strom im Überfluss vorhanden sein würde, den man in dieser Art dann nutzen kann.

Technologisch gesehen ist P2H (Power-to-Heat) die einfachste Form, Strom in eine andere Energieform zu wandeln. Vermutlich finden sich in jedem Haushalt Tauchsieder oder ähnliche Geräte, die mit einem einfachen ohmschen Widerstand den Strom zu Wärme werden lassen. Der Umwandlungswirkungsgrad ist mit 100 Prozent ideal.

P2G (Power-to-Gas) ist wesentlich komplizierter und vor allem hinsichtlich des niedrigen Wirkungsgrades problematisch. Die besten Elektrolyseure erreichen einen Wirkungsgrad von 72 Prozent wie in der jüngst in Hamburg eingeweihten 1,5-Megawatt-Anlage. Wie bei Versuchsanlagen üblich, stehen Investitionen und Ertrag nicht in einem wirtschaftlich sinnvollen Verhältnis, welches sich bei eventueller Rückverstromung des Wasserstoffs nochmals drastisch verschlechtert und damit jegliche Überlegungen zu großindustriellem Einsatz obsolet werden lässt.

Mehr als ein Dutzend Versuchs- und Pilotanlagen gasen inzwischen im Land vor sich hin. Es fehlen Renditeaussichten und Rahmenbedingungen, die die Stromspeicherung im Vergleich zum Direktverbrauch anreizen. Mithin mangelt es an einer weiteren umfangreichen Subventionierung.

Auch beim Power-to-Liquid (P2L) dürfte die Kostenkalkulation die großtechnische Anwendung verhindern, zumindest solange die Öl- und Gaspreise weltweit nicht einen großen Höhenflug antreten.

Grundsätzlich ist elektrischer Strom die wertvollste Energieform.

Der Aufwand, ihn zu gewinnen, zu transformieren, zu transportieren und zu verteilen, ist aufwändig und teuer. Die Wandlung von Wärme in Strom (Wärmekraftwerke) oder von Gas in Strom (Gaskraftwerk oder Brennstoffzelle) ist ungleich komplizierter.

Ihn in Wärme niedriger Temperatur wie Heizwärme, in Gas oder Kraftstoff zu verwandeln, kommt einer Abwertung oder Degradierung gleich.

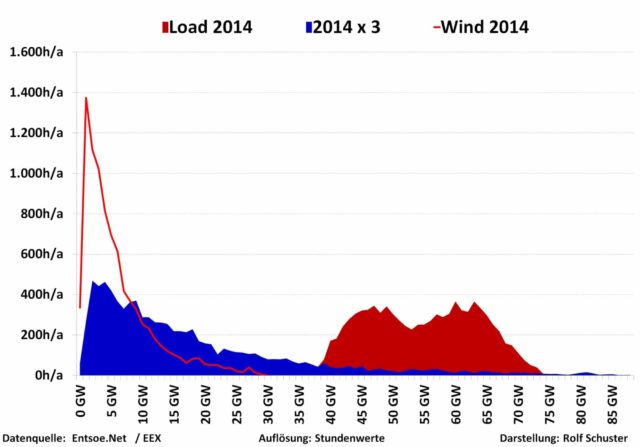

Die unabdingbare Voraussetzung wäre ohnehin, dass hohe wetterbedingte Stromeinspeisung tatsächlich zu sehr niedrigen Preisen führen. Wir erinnern uns an die oft wiederholte These, dass bei weiterem „mutigen“ und „entschlossenem“ Ausbau der Erneuerbaren der Strom dann ganz billig werden würde. Hier habe ich dazu überschlägig berechnet, dass großes Stromaufkommen aus Erneuerbaren den Strom auf Grund der festen Einspeisevergütungen teurer statt billiger macht und geschrieben:

„Auf welcher wirtschaftlichen Grundlage soll ein Versorgungsunternehmen den Kunden zu Zeiten hohen wetterbedingten Stromangebots ein preislich vorteilhaftes Angebot machen? Ursache dieser marktfernen Konstellation ist das EEG mit festen Vergütungen. Nur mit weiteren Subventionen wäre ein „smartes“ Strompreismodell machbar.“

Naturgemäß freut sich jeder Autor, wenn seine Thesen durch die Praxis bestätigt werden. Aber freuen kann sich niemand, wenn Ressourcen durch eine gestümperte Energiewende verschwendet werden. Die Auswirkung dieser politischen Fehlsteuerung zeigt sich aktuell hier (3:12, sehr sehenswert). Kurz zusammengefasst:

Nicht nur heute bleibt der Boiler kalt.

Die vor drei Jahren eingeweihte und von den Stadtwerken Neumünster betreute P2H-Anlage wird nicht betrieben. Grund dafür ist, dass der umzuwandelnde Strom voll bezahlt werden muss, um den Windmüllern ihre gesetzlich verbriefte Einspeisevergütung zu sichern. Diese denken natürlich nicht daran, den Strom billiger abzugeben und wirtschaften besser, wenn sie sich bei Überangebot die Anlagen abschalten lassen und dennoch die fast volle Vergütung kassieren. „Strom zu Wärme“ (und damit könnte erst die beabsichtigte Sektorkopplung auf den Weg gebracht werden), würde erfordern, dass Fernwärmeversorger entsprechend hohe Umlagen zahlen. Dadurch wären sie aber nicht mehr konkurrenzfähig gegenüber den Verbrennungsprozessen anderer Energieträger, die oft den Vorteil der Kraft-Wärme-Kopplung mitbringen.

Wenn selbst eine verhinderte grüne Lichtgestalt in Person des nordischen „Energiewendeministers“ Robert Habeck den Auswirkungen des EEG nahezu hilflos ausgeliefert ist, hält sich das Mitleid in Grenzen. Alle Zukunftsversprechen zu einem Smartgrid, das dazu führt, bei hohem Windaufkommen billigen Strom zu erhalten, scheitern sichtbar an der Marktferne des EEG. Es kann auf seiner Basis keinen Markt geben und damit auch keine Perspektive für eine Sektorkopplung. Dabei haben wir von erforderlichen Stromspeicherkapazitäten und -kosten noch gar nicht gesprochen.

Geht man davon aus, dass das EEG das Kernstück unserer Energiewende ist, dann ist diese nicht nur mit Naturgesetzen, sondern auch mit wirtschaftlicher Logik nicht kompatibel. Ein rigoroser Umbau oder eine Abschaffung des EEG würde aber auch bedeuten, dass generell die Energiewende in dieser Form gescheitert ist.

Die Windstromerzeugung hat strukturell inhärent ein Problem mit Marktbedingungen: Die große Anzahl von Anlagen führt zu geballter Produktion bei entsprechendem Wetter. In logischer Marktreaktion fallen bei hohem Angebot die Preise. Deshalb werden sich Windkraftanlagen auch künftig nicht unter Marktbedingungen rentabel betreiben lassen, da ihre laufenden Kosten durch die dann niedrigen Einnahmen nicht gedeckt werden können. Das EEG ist keine Brücke auf dem Weg in den Markt, sondern der Prellbock, auf den die Energiewende in der vorhandenen Form auflaufen wird.

Wind und Sonne sind unschuldig.

Da keine der jetzigen und künftigen Regierungsparteien den Mut haben wird, dem überlebten EEG den Gnadenstoß zu versetzen, steigt die Dramatik ab dem Jahr 2021, wenn erste Anlagen in großer Zahl aus der Förderung fallen. Wir erinnern uns an das neu geschaffene EEG im Jahr 2000, das die 20-jährige Förderdauer festschrieb und ausdehnte auf Anlagen, die schon in den Neunzigern gebaut wurden und somit für 20 plus X Jahre in den Genuss der garantierten Einspeisevergütung kamen. Dies führt im Jahr 2021 dazu, dass schlagartig etwa 6.000 Anlagen aus der Förderung fallen. Dann müssten sie vom Börsenspotpreis leben, Langfristverträge fallen auf Grund der volatilen Einspeisung aus. Sie stehen dann in ungeschützter Konkurrenz zu noch geförderten neueren Anlagen – wie alle anderen Erzeuger auch.

Dann platzt auch das Märchen von der wirtschaftlichen Windenergie als die mit den niedrigsten Gestehungskosten.

Dass der Einspeisevorrang vermutlich erhalten bleiben wird, ist nur ein schwacher Trost. Wartung und Instandhaltung der gealterten Anlagen, Versicherung und Pachten führen zu laufenden Kosten, die erwirtschaftet werden müssen. Wenn dies nicht gelingt, ist die dauerhafte Abschaltung absehbar. Rückbau- und Entsorgungskosten kommen hinzu. Grüne Realisten befürchten Stagnation beim Windenergieausbau oder sogar sinkende installierte Gesamtleistung, wenn mehr abgeschaltet als zugebaut wird.

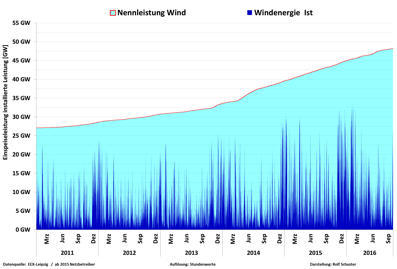

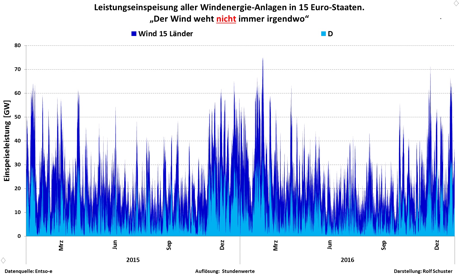

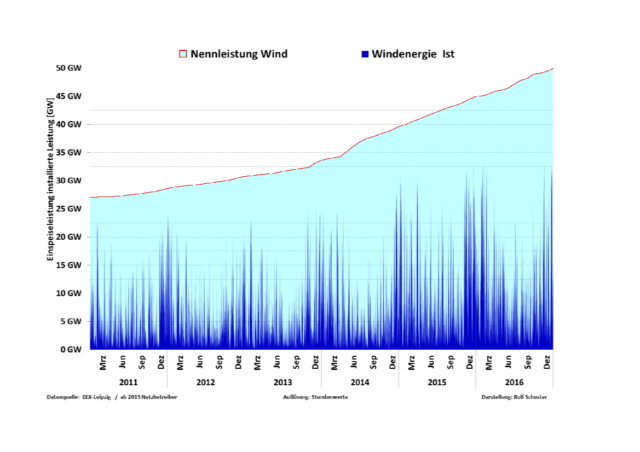

Nach wie vor hält sich regierungsamtlich und in der politischen Wissenschaft (DIW) die Einschätzung von „Experten“, man könne durch den bloßen Zubau an Windkraftanlagen die Energiewende zum Erfolg führen. Man berauscht sich nach wie vor an den Steigerungsraten installierter Leistung, aber Zeitpunkt und Menge der tatsächlichen Produktion werden nicht auf ihre Sinnhaftigkeit bewertet. Das sieht dann so aus:

Windeinspeisung von 2011-2016; Daten EEX, Grafik: Rolf Schuster

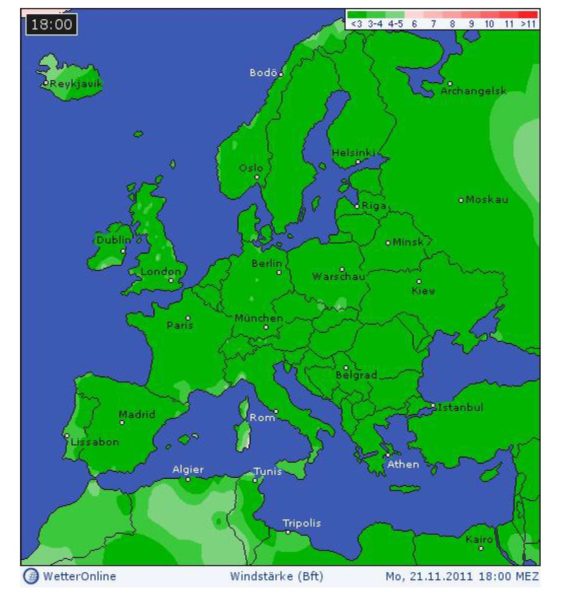

Es ist zu erkennen, dass auch die knappe Verdoppelung der installierten Windleistung in den vergangenen fast fünf Jahren zu keiner Sockelbildung (also Grundlastsicherung) geführt hat. Ist die Windgeschwindigkeit gleich oder nahe Null, ist die Anzahl der WKA irrelevant. Das zweite, konventionelle Energiesystem muss in voller Leistungsfähigkeit erhalten bleiben, so dass ein Ende der Dynamik der Kostensteigerung nicht abzusehen ist.

Andere Länder handeln, wenn die Verwerfungen zu groß werden. Im derzeit für die Investitionen in die Regenerativen gefeierten China wird in sechs windreichen Provinzen auf die Bremse getreten. Zu oft müssen die Anlagen abgeregelt werden auf Grund von Netzengpässen. Die Ballungszentren sind weit entfernt und das Netz ist bei weitem nicht so dicht wie in Mitteleuropa.

Die selbsternannten Denkfabriken der Branche in Deutschland arbeiten mit voller Kraft daran, den Einbruch der Windstromproduktion ab 2021 zu verhindern und alle Überlegungen haben ein Hauptziel, den Profiterhalt der Ökoindustrie. Um eine Wirtschaftlichkeit der regenerativen Anlagen darstellen zu können, müssen die Fossilen verteuert werden. Kohlecent, CO2-Steuern, Umweltabgaben sind angedacht sowie die Verteilung der Kosten auf andere Energieträger wie Benzin, Öl, Gas und Kohle zur Wärmegewinnung. Denkbar wäre auch ein Gebührenmodell in festgelegter Höhe analog der GEZ oder ein EE-Soli, der den „Vorteil“ brächte, dass Geringverdiener entsprechend ihrer Steuerlast weniger oder nichts zahlen.

Aber wirklich zukunftsfähig ist auch das nicht. Wie schon die Brennelementesteuer mangels verfügbarer Kernkraftwerke nicht mehr helfen kann, schmilzt auch die belastbare Basis der Fossilen. Sollten sich die ehrgeizigen Wünsche der Energiewender erfüllen, geht es ziemlich schnell bergab in Richtung der gewünschten Dekarbonisierung. Dann fehlt besteuerbares CO2 als Geldquelle und stofflich für die angedachte Methanisierung des aus P2G gewonnenen Wasserstoffs. Die bis jetzt die Verbraucherpreise dämpfenden niedrigen Börsenstrompreise wären dann Geschichte, da die Preise nur noch aus den zugesagten Einspeisevergütungen und anderweitig festgelegten Abgaben wie den Netzgebühren und Steuern resultieren würden.

Vielleicht könnte man mit all den Unwägbarkeiten noch leben, wenn sich andere Heilsversprechen endlich erfüllen würden, beispielsweise der ständig beschworene Boom an Jobs im Bereich der Erneuerbaren. Aber auch hier meist schlechte Nachrichten. Im aktuellen Energiewende-Report von McKinsey findet sich viel Ungemach: Im vierten Jahr in Folge sinkt Anzahl der Beschäftigten in der Ökobranche, erstmals ist Jobabbau in der energieintensiven Industrie zu verzeichnen, der Netzausbau liegt deutlich hinter dem Plan, der Primärenergieverbrauch steigt, der Stromverbrauch sinkt nur minimal, der Strompreis steigt weiter (gegen den europäischen Trend) ebenso wie die CO2-Emissionen.

Die Energiewende im jetzigen Stand ist das Gegenteil einer Win-Win-Situation.

Sie mutiert zum Verliererthema, bei dem die meisten Beteiligten als Loser vom Platz gehen. Windkraftanlagen-Hersteller Senvion streicht in Deutschland 730 Stellen. Eon vermeldet 7 Milliarden Euro Verlust und kündigt 1.300 Stellenstreichungen an, bei RWE entfallen 1.600 Stellen. Selbst Konzerntochter Innogy verzeichnet trotz hoher Windkraft-Einnahmen ein flaues Ergebnis, weil der Netzausbau viel Geld erfordert. Nach Schätzungen der Gewerkschaft IG BCE sind bisher 20.000 bis 25.000 tarifgebundene und mitbestimmte Arbeitsplätze in der Energiewirtschaft verloren gegangen. „Gute Arbeit geht verloren, weil schlechte Politik gemacht wird“ sagt ihr Vorsitzender Vassiliades dazu und fordert „Alternativen für die Alternativen“. Die Energiewende habe bereits mehr Geld gekostet als 60 Jahre Steinkohlesubventionen. Das kann man natürlich nicht vergleichen, denn die Steinkohlesubventionen haben ein Ende, welches bei den Subventionen für die Erneuerbaren nicht absehbar ist.

Wer sich diese Energiewende in Form eines ökoesoterischen Großversuchs noch schönredet, erkennt die Realitäten nicht oder ist befristete Wirtschaftsministerin i.PE (in Pensionserwartung). Eine Kursänderung ist nicht in Sicht.

Wenn wir abschließend noch einige der Autoren des EEG würdigen, muss unsere Kritik auch den nachfolgenden Regierungen gelten, die nicht die Kraft und den Mut hatten, das EEG rechtzeitig anzupassen. Erwähnung finden sollten also die ErfinderInnen JürgenTrittin, Hans-Josef Fell, Rainer Baake, Michaele Hustedt als ParteifreundInnen von Robert Habeck sowie Solarpapst Hermann Scheer von der SPD. Die Geister, die sie riefen, lassen sich jetzt nicht mehr einfangen. In den Tiefen des Webs sinniert ein User über die Grünen: „Sie suchten den Sinn und fanden den Wahn . . .“.

Die Grünen werden für unser Land generell nicht hilfreich sein, denn sie haben in ihrem politischen Werkzeugkasten nur genau zwei Instrumente: Subventionierung und Verbot. Und Power-to-heiße-Luft. Das reicht nicht für Deutschlands Energiezukunft.