Um Diesel ging es gar nicht

Die kleine Maus hatte keine Chance mehr. Sie bewegte sich unter einer Glasglocke, die, verschlossen, von außen keine Luft mehr hereinließ. Es kam, wie es kommen musste: Schon bald fiel das Versuchstier bewusstlos zu Boden und war tot. Das niedliche kleine Tier verbrauchte all den Sauerstoff, übrig blieb „schädliche Luft“, die weder Verbrennung noch Leben ermöglichte. Das Gleiche geschah mit einer Kerze; die ging im Glasbehälter ebenfalls aus. Daniel Rutherford, schottischer Chemiker, der dieses Experiment ausführte, nannte den Stoff „phlogistische Luft“, heute kennen wir den Stoff als Stickstoff. 78 Prozent, so wissen wir heute, sind in der Atmosphäre enthalten.

Das war 1772. Ein Tierversuch stand also am Anfang des Wissens um einen der wichtigsten Stoffe des Lebens. Es ist immer derselbe Ablauf: Am Anfang steht das Unwissen und macht daher ein Experiment, eine Frage an die Natur. Das beweist dann eine Erkenntnis – oder eben auch nicht. So gewinnt man Wissen, nicht durch Glauben.

Worum geht es heute? Es geht um die (Reiz-) Wirkung von NOx, aber ausdrücklich nicht im Zusammenhang mit dem Dieselskandal. Man weiß zwar grundsätzlich, wie Stickoxide auf den Organismus wirken. Es gibt eine ganze Reihe Stickstoff-Sauerstoff-Verbindungen, je nachdem, mit wieviel Sauerstoff-Atomen sich das Stickstoff-Molekül zu verbinden geruht. Wobei es sich eher nicht binden mag, es ist nicht besonders reaktiv, sagt man. Deswegen benutzt man es bei der Verpackung von Lebensmitteln beispielsweise, um die vor dem schädlichen Sauerstoff zu schützen und länger haltbar zu machen.

Je nachdem, wie sich die atomaren Legosteine zusammensetzen, entstehen vollkommen unterschiedliche Stoffe mit unterschiedlichen Wirkungen.

Eine lustige Wirkung kommt zum Beispiel zustande, wenn zwei Stickstoff-Atome mit einem Sauerstoff-Atom eine innige Beziehung eingehen. N2O heißt das dann, Lachgas. Früher, als die Menschen noch nicht solche Angst vor Chemie hatten, hat man auf Jahrmärkten Menschen Lachgas einatmen lassen und sich über die Reaktion gefreut: Ein zwanghaftes Lachen, eine Euphorie überfiel sie. Ähnliche Belustigungen hat man auch auf gesellschaftlichen Abenden veranstaltet, als vegane Ernährung und ähnliches noch nicht Gesprächsthemen dominiert haben. Üble Menschenversuche würden heute Kenntnisbefreite urteilen und zwar so lautstark, dass es gewiß Verbote hageln würde.

Lachgas wurde früher zur Betäubung beim Zahnarzt und vor Operationen verwendet. Wer sich heute Schlagsahne aus der Sprühdose auf den Kuchen spritzt, verbreitet damit auch Lachgas. Das dient als Treibgas.

Heute steigt der Gehalt an N2O in der Luft ausgerechnet dadurch an, dass Kohlekraftwerke „sauber“ gemacht werden sollen. Nicht nur der Übeltäter Nummer eins, Kohlendioxid, soll verschwinden, sondern auch die Stickoxide. Katalysatoren wurden in die Abgasstränge der Kohlekraftwerke eingebaut; die vermindern zwar die Stickoxide, sorgen aber ausgerechnet dafür, dass der Lachgasanteil ansteigt, und zwar ziemlich stark. Das gilt als viertwichtigstes Treibhausgas.

Die Welt kommt erst „in Ordnung“, wenn alle Kraftwerke abgeschaltet sind. Dann können nur noch Bakterien für erhebliche Stickstoff-Anreicherung der Luft sorgen.

Der menschliche Körper selbst stellt sogar Stickstoffmonoxid oder NO her. Das ebenfalls giftige Gas benutzt er als Botenstoff, als wichtigen Neurotransmitter im menschlichen Körper. Der sorgt dafür, dass sich Muskeln rund um Blutgefäße entspannen und der Blutfluß erhöht wird.

Um 1870 beobachtete man in den Dynamitwerken des Alfred Nobel, dass Arbeiter, die bei körperlicher Anstrengung aufgrund einer Herzkrankheit an Schmerzen in der Brust litten, eine Linderung ihrer Schmerzen erfuhren, wenn sie in der Woche wieder in der Fabrik arbeiteten. Die Fabrikluft enthielt Dämpfe von Nitroglycerin, denn diese Stickstoff-Verbindung ist der eigentliche Explosivstoff des Dynamits.

Diese hochexplosive Chemikalie benutzten dann Ärzte – stark verdünnt natürlich – als Standardarznei bei Angina pectoris. Menschenversuche?

Ganze 100 Jahre vergingen, bis man entdeckte, dass Nitroglycerin in der Muskulatur in NO umgewandelt wird – also in den Wirkstoff, der direkt für die Erweiterung der Blutgefäße verantwortlich ist.

Noch einmal 20 Jahre später erhielten drei Wissenschaftler den Medizin-Nobelpreis für ihre Erkenntnisse, auf welch komplizierte Weise NO die Herzgefäße beeinflußt. Verblüffend wiederum ist, dass sich der Organismus an NO-Gaben gewöhnt. Sie verlieren also ihre Wirkung. Herauszufinden wie genau dieser Prozeß der Desensibilierung verläuft, daran wird geforscht. Aber auch hier fallen die Früchte der Erkenntnis nicht vom Himmel, sondern mit harter detaillierter Arbeit und vielen Versuchen mit keinem brauchbaren Ergebnis. Und ja, mit Versuchen am lebenden Organismus. Anders geht es nicht.

Wenn sich aber – bei genügend Energie, sprich Hitze – zwei Sauerstoffatome mit einem Stickstoffatom verbinden, ergibt das jenes Stickstoffdioxid, NO2, das jetzt das Potential hat, den Schurkenstoff CO2 in der veröffentlichten Empörung abzulösen.

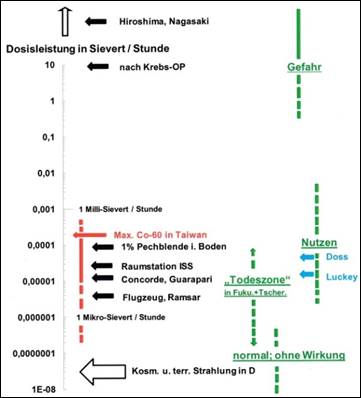

NO2 aus der Stickstoff-Sauerstoff-Connection ist für den Menschen tatsächlich schädlich. Es übt je nach Konzentration eine leicht bis stark ätzende Wirkung auf die Lunge aus, ist also in höheren Konzentrationen gefährlich. Wobei in der Fachwelt über Grenzwerte sehr heftig gestritten wird; sie beruhen selten auf Versuchen, sondern sind von Politik und Interessengruppen ausgehandelte Werte.

Die grün dominierte Weltgesundheitsorganisation WHO übrigens beruft sich auf aktuelle Tierstudien, die Gefahren schon bei niedrigen Dosierungen ergeben hätten. Also auch hier ging es nicht ohne Tierversuch.

Aus solchen Versuchsstudien leiteten Forscher eine Konzentration von 1,5 ppm oder 3000 μg/m3 als nicht gesundheitsschädlich ab. Basierend auf diesen Studien haben das Scientific Committee for Occupational Exposure Limits der Europäischen Kommission, die DFG-Arbeitsstoffkommission (MAK-Kommission) und der Ausschuss für Gefahrstoffe (AGS) für Arbeitsplätze einen noch niedrigeren Grenzwert für NO2, nämlich von nur von 0,5 ppm (950 μg/m3) festgelegt. 40 μg/m3 gelten laut EU für die Außenluft, am Arbeitsplatz 950 μg/m3, in Büroräumen 60 μg/m3. Arbeitenden Menschen wird mehr zugetraut. (Quelle: hier)

NO2 reagiert gern mit Wasser, wird zu „saurem Regen“, der nächste Regen aber wäscht die Luft wieder aus. NO2 entsteht bei vielen natürlichen Prozessen wie Gewittern, bei Verbrennungsprozessen aber auch zum Beispiel bei Betrieb von Elektromotoren und größeren Schweißarbeiten. Darauf hatten es die Aachener Forscher abgesehen. Denn erstaunlicherweise weiß man nicht sonderlich gut über die NO2-Wirkungen am Arbeitsplatz Bescheid. Die Grenzwerte wurden zwar in Deutschland im Gegensatz zu anderen Ländern deutlich abgesenkt, aber rein willkürlich, also ohne sie auf irgendeine Weise zu fundieren. Niemand kann also sagen, ob jene Grenzwerte sinnvoll sind oder nicht.

2013 und 2014, also lange vor dem „Diesel-Desaster“, haben die Aachener Forscher jene ominöse Studie erstellt; den Antrag dazu 2012 gestellt. Anlass war die Diskussion um die Absenkung der ‚Maximalen Arbeitsplatz-Konzentration‘ (MAK) für NO2. Denn wenn man über Grenzwerte redet, sollte man wissen, wie viel ist denn zu viel. Die Aachener wollten für neue Definitionen der maximalen Arbeitsplatzkonzentrationen mehr darüber herausfinden, wie NO2 wirkt. Die Versuche liefen nach den üblichen Prozeduren ab, also prüfen, ob Versuche notwendig sind, vorherige Ethikberatung, genaue medizinische Betreuung der Probanden.Soweit so normal. Grundlagenforschung, wie sie üblich und wichtig ist, um über neue Grenzwerte sinnvoll diskutieren zu können. Wer sie ablehnt, sorgt im Grunde für ein höheres Risiko für Menschen. Dass Menschen dabei bösen Diesel-Abgasen ausgesetzt oder gar „begast“ wurden ist, falsch. Es wurden die Aufnahmen von NO2 in verschiedenen geringen Konzentrationen gemessen, also nur von einem Bestandteil von Diesel-Abgasen.

Hier erklärt der Studienleiter der RWTH Aachen kurz gut verständlich seine Versuche:

Interview Prof. Dr. Thomas Kraus zur Aachener NO2 Studie

Die Ergebnisse wurden 2016 veröffentlicht, außer der Fachwelt nahm niemand Kenntnis. Nichts Geheimnisvolles, schon gleich gar nicht grausame Menschenversuche. Forschung über die Wirkung von Diesel-Abgasen gibt es schon länger. Dabei wurde gemessen, wie und was Menschen von Diesel-Abgasen aufnehmen. Auch die amerikanischen National Academies of Science betonen ausdrücklich, dass kontrollierte Experimente mit Freiwilligen, die Schadstoffen in der Luft ausgesetzt werden, berechtigt sind.

Kurz vor der Veröffentlichung der Aachener Geschichte hatte der Frankfurter Wirtschaftskorrespondent der New York Times über einen Versuch berichtet, Auswirkungen von Diesel-Abgasen auf einen Organismus zu erforschen, in diesem Fall an Affen. Diese Arbeiten haben nichts mit den Versuchen in Aachen zu tun.

2014, also auch bevor die Diesel-Affäre begann, sollen Wissenschaftler in einem Labor in Albuquerque als Beweis für die schädlichen Auswirkungen von Dieselabgasen auf die menschliche Gesundheit ein ungewöhnliches Experiment durchgeführt haben. Danach seien zehn Affen in luftdichte Kammern gesetzt worden. Sie hätten Abgase eines Diesel-VW-Käfers einatmen müssen, und durften dabei zur Unterhaltung Zeichentrickfilme anschauen.

Belege oder Quellen dafür werden nicht genannt, es wird lediglich auf Gerichtsakten und Regierungsdokumente Bezug genommen. Die Studie, um die es geht, liegt öffentlich nicht vor. Man kann daher nicht seriös Ziel und Arbeit der Forscher beurteilen. Das Labor Lovelace Respiratory Research Institute (LRRI) jedenfalls arbeitet seit langem in der Erforschung von Atemwegserkrankungen und untersucht Auswirkungen von Stoffen in der Luft auf die Atemwege und wird von der mächtigen Food and Drug Behörde (FDA) kontrolliert. Man darf davon ausgehen, dass keine Frankenstein-Scharlatane am Werk waren. Nur was genau geschah, ist nach außen hin nicht bekannt.

Automobilabgase haben wie Abgase bei allen Verbrennungsvorgängen zum Beispiel bei Heizungen bedenkliche Wirkungen. Nur würde niemand auf die Idee kommen, deswegen zu frieren. Die Autoabgase sind in den vergangenen Jahrzehnten erheblich „sauberer“ geworden. Doch die Absenkung eines Wertes zieht häufig die Erhöhung eines anderen Wertes mit sich. Erhöhen die Motorenbauer etwa die Verbrennungstemperaturen, so sinken zwar Verbrauch und CO2-Ausstoß, gleichzeitig steigt aber der NO2-Ausstoß an. Denn die höheren Temperaturen wiederum bewirken, dass sich Stickstoff und Sauerstoff besser verbinden.

Die Luft in den Städten wird immer sauberer. Stickoxid-Emissionen zum Beispiel wurden in Deutschland in den letzten Jahren mehr als halbiert. Sie sind von 1990 bis 2015 deutlich um immerhin 59 Prozent zurückgegangen. Diesel-PKW wiederum tragen zu den Stickoxiden in der Luft nur zu einem sehr geringen Anteil bei. Ein Verbot hätte also nur sehr geringe Auswirkungen. Von immer schlimmer verschmutzter Luft in den Städten zu reden, ist falsch.

Der Begriff „Schadstoff“ ist immer problematisch. Jeder Mensch gibt zum Beispiel mit den Darmgasen das faulig riechende Schwefelwasserstoffgas in die Luft ab. Es ist etwa so giftig wie Blausäure, nur riecht man es schon in weit kleineren, ungefährlichen Konzentrationen. Nur deshalb hat man nicht längst das Furzen verboten oder Gasfilter vorgeschrieben. Entscheidend sind immer die Konzentrationen etwaiger Schadstoffe. Daher will man Zahlen erfahren und wissen, vor allem, wenn man über Grenzwerte redet. Das geht nicht ohne Versuche. Sie sind Alltag. Dafür gibt es ausgefeilte Regularien, wie damit umgegangen werden muss. Sie wurden alle eingehalten.

Übrigens: Zu den nachweislich gefährlichsten Schadstoffquellen im Alltag zählt das Rauchen, worunter auch Passivraucher leiden. Hier ist die nachgewiesene Zahl an Toten (121.000 im Jahr 2013 allein in Deutschland) bei weitem höher als die den Diesel-Abgasen nachgesagte Opferzahl. Dazu gehört auch das immer beliebtere Shisha-Rauchen.

Die „Enthüllungen“ über angeblich grausamen Tierversuch kommen selbstverständlich nicht zufällig vor wichtigen Gerichtsentscheidungen. So steht am 22. Februar die Entscheidung des Bundesverwaltungsgerichtes über mögliche Fahrverbote von Dieselfahrzeugen an. Geklagt hatte der von Toyota unterstützte Abmahnverein Deutsche Umwelthilfe mit Vielflieger Jürgen Resch an der Spitze.

Der Beitrag erschien zuerst bei Tichys Einblick hier