Brennstäbe unterm Bett

Als Lilli drei Jahre alt war, bat sie mich jeden Abend, nachzusehen, ob unter ihrem Bett auch wirklich kein Krokodil sitzt. Was wir nicht sehen können, ist halt immer am unheimlichsten, besonders, wenn wir uns sicher sind, dass „es“ da ist. Alle Kinder durchlaufen eine Phase magischen Denkens. Sie meinen dann zum Beispiel, dass ihr Denken oder Tun Einfluss auf unzusammenhängende Ereignisse hat. Erwachsene sind auch nicht frei davon. Manche stecken Nadeln in Puppen, um den in Wolle nachempfundenen Unglückswurm nach Voodoo-Art zu verwünschen, andere konzentrieren sich auf Löffel und Gabeln, um sie zur Unbrauchbarkeit zu verbiegen und aufgeschlossene Innenarchitekten stimmen die Geister der Luft und des Wassers mit Hilfe von Feng Shui gewogen.

Magie gibt es auch als religiöse Wunder-Edition: Jesus hatte seinerzeit Wasser in Wein verwandelt, während Mohammed bekanntlich auf seinem geflügelten Pferd Buraq gen Himmel geflogen ist. Auch der Alltag von uns aufgeklärten Weltbürgern ist nicht frei von Magie. Allerorten lauert die unsichtbare Gefahr. Mir zum Beispiel ist unser Mikrowellenofen nicht geheuer. Andere fürchten sich vor Handystrahlen. Und dann ist da noch der eine Zauber, der uns alle bange macht [Soundeffekt: „Psycho“-Geigen unter der Dusche]: das Atom!

Magie und Strahlung

Man kann es nicht sehen, hören, tasten, schmecken oder riechen, es ist sinnlich schlichtweg nicht zu erfassen. Der britische Science-Fiction-Autor Arthur C. Clarke formulierte drei Gesetze, von denen das letzte lautet: „Jede hinreichend fortschrittliche Technologie ist von Magie nicht zu unterscheiden.“ Weil sie sich unseren Sinnen entzieht, ist die Atomenergie ein solches Hexenwerk. Kein Wunder, dass sie uns genauso ängstigt wie die kleine Lilli ihr Krokodil unter dem Bett.

„Die lachende Atomkraft-Nein-Danke-Sonne auf dem VW-Bus erfüllt einen ähnlichen Zweck wie der Knoblauch gegen Vampire.“

1917 teilte Ernest Rutherford in Manchester das „Atom“ (altgriechisch für unteilbar) zum ersten Mal. Fortan legte es eine steile Kariere hin und nach 28 Jahren war aus einem obskuren Winzling die denkbar schrecklichste Waffe geworden. Nach dem Schock von Hiroshima und Nagasaki rückte die zivile Nutzung der Irrsinns-Energie in den Vordergrund. In der Euphorie der Nachkriegsjahre fand die Zaubertechnik zunächst einmal Bewunderer. 1946 wurde gar ein neuartiges, zweiteiliges Badekostüm nach jenem Atoll benannt, in dem versuchsweise Atombomben gezündet wurden (Slogan: „Der Bikini, die erste an-atomische Bombe“).

Landauf, landab wurden fortan Kernkraftwerke gebaut und lieferten Unmengen an Strom. Dass sie dabei kein CO2 oder sonstige Abgase freisetzen, spielte in den Sechzigern noch keine Rolle, umso mehr jedoch, dass sie aus natürlichem Uran waffenfähiges Plutonium erbrüteten. Im Kalten Krieg war das nicht nur ein schöner Zusatznutzen, sondern der Kern des Pudels. Ein weiterentwickelter Reaktortyp, der Thorium-Flüssigsalzreaktor, wurde deshalb schnell wieder eingemottet. Er war zwar in mehrerlei Hinsicht sicherer, aber leider nicht geeignet zur Herstellung von Bombenrohstoff. In den 1980er-Jahren hat dann Deutschland die Idee weiterentwickelt. In Hamm-Uentrop stand ein Thorium-Testreaktor mit silbernem Designer-Kühlturm. Nach Tschernobyl wurde er gleich wieder stillgelegt. Wir hätten Vorreiter sein können.

Es kam anders, weil in unseren Köpfen hängengeblieben ist, dass alles, was „Atom“ im Namen trägt, nicht nur der Gesundheit abträglich ist, sondern grundsätzlich finstere Ziele verfolgt. Atomenergie, Atommüll, Atomwaffen – alles eine Soße. Kein Wunder, dass die ganze Begriffswelt unwiderruflich verstrahlt ist: Reaktor, Störfall, Kernspaltung, Wiederaufbereitung, Schneller Brüter – bei der bloßen Erwähnung solcher Unworte schüttelt’s einen. Dazu kommen die Bilder: Das gelb-schwarze Strahlungswarndreieck, die betongrauen Riesenkühltürme, die hochgerüstete Staatsmacht. Im Angesicht dieser magischen Superpower geht es nicht mehr um bloßes Für und Wider, sondern um Leben und Tod. Die lachende Atomkraft-Nein-Danke-Sonne auf dem VW-Bus erfüllt einen ähnlichen Zweck wie der Knoblauch gegen Vampire (neben dem Virtue Signalling).

„Die Castoren enthalten nutzbare Energie für hunderte von Jahren.“

Flucht- und Angriffsreflexe in potenziellen Gefahrensituationen sind uns allen mitgegebene Überlebensmechanismen. Ob das jeweilige Angstszenario durch Erfahrung begründet ist, ein Produkt unserer magischen Intuitionen ist oder einfach nur durch vielfachen Vortrag ausgeformt wurde, spielt in Demokratien keine Rolle. Jede Stimme zählt und die Politik hat das zu berücksichtigen. Überhaupt, vage Bauchgefühle bilden die Zukunft im Zweifel nicht schlechter ab als handverlesene Statistiken und wir alle haben noch klar vor Augen, wie ein Atompilz aussieht und was er anrichtet. Im Übrigen hat die angeblich so sichere Reaktortechnik nicht nur einmal versagt. Doch wie schlimm war’s wirklich? Und gilt das immer noch für die zivil genutzte Kernenergie der nächsten Generation?

Thorium-Flüssigsalzreaktor

Jede Technik, die irgendetwas bewirkt, kommt mit Nebenwirkungen. Die regenerativen Energien sind da keine Ausnahme. Anders als zum Beispiel Windräder, ein Konzept aus dem 14. Jahrhundert, ist Kernkraft eine junge Technik mit viel Spielraum zur Optimierung. Und wer hätte es gedacht, unbemerkt von uns germanischen Umweltfreunden tut sich hier gerade wieder eine ganze Menge. Zumindest in den Industriestaaten gibt es kein Interesse mehr an weiterem Plutonium. Im Gegenteil, das Zeug muss weg, am besten gleich zusammen mit dem restlichen Atommüll. Und so wenden sich alle Augen jetzt wieder dem Thorium-Flüssigsalzreaktor zu, denn der vereint geradezu magisch viele Eigenschaften der guten Sorte:

- GAUs, also Kernschmelzen verbunden mit austretender radioaktiver Strahlung, sind konstruktionsbedingt unmöglich.

- Der Brennstoff wird bis zu 99 Prozent genutzt, es bleibt kaum Restmüll übrig. Bisher lag die Energieausnutzung unter 5 Prozent. Carlo Rubbia, Nobelpreisträger in Physik, sagt, mit einem Kilo Thorium können wir so viel Energie produzieren wie mit 200 Kilo Uran.

- Es entstehen rund tausendmal weniger radioaktive Abfälle als bei den üblichen Leichtwasserreaktoren. Fünf Sechstel davon sind schon nach 10 Jahren stabil, der Rest nach 300 Jahren.

- Unsere radioaktiven Müllberge einschließlich Plutonium können Stück für Stück mitverbrannt werden, statt hunderttausende Jahre im Endlager zu verrotten. Die Castoren enthalten nutzbare Energie für hunderte von Jahren.

- Es ist nicht möglich, im Betrieb Uran oder Plutonium für den Bau von Atombomben abzuzweigen.

- Thorium ist günstiger und kommt viermal häufiger vor als Uran. Thorium-Strom ist kostengünstiger als der billigste Strom aus Kohlekraftwerken.

- Flüssigsalzkraftwerke können sehr viel kleiner gebaut werden als herkömmliche KKWs. Sie sind in Modulbauweise in Serie herzustellen und dezentral einsetzbar.

- Es ist denkbar, die Reaktoren unterirdisch zu bauen. Das erschwert Terroranschläge.

- Sie sind schnell an- und abschaltbar und können so die systembedingte Sprunghaftigkeit erneuerbarer Energiequellen perfekt ausgleichen.

- Wie alle anderen Kernkraftwerktypen stoßen auch Flüssigsalzreaktoren kein CO2 aus.

Die ersten neuen Thorium-Flüssigsalzreaktoren laufen gerade an, der Betrieb in großem Maßstab ist allerdings noch Jahre entfernt. Wenn wir am Ball bleiben, lösen wir mit ihrer Hilfe eine ganze Reihe der Probleme im Zusammenhang mit unserem Energiebedarf und der alten Kernenergie. Das sehen weltweit auch immer mehr Umweltexperten so. Deutsche Ökos, die starrsinnigsten aller Pessimisten, erkennen darin nichts weiter als böse Gaukelei der „internationalen Atomlobby“. (Wenn es darum geht, den armen Mitbürgern zum Zweck der Profitmaximierung Schaden zuzufügen, werden leider selbst die reaktionärsten Industriellen grundsätzlich zu Internationalisten.)

„Erneuerbare Energien liefern bei Weitem nicht die benötigten Strommengen, grundlasttauglich sind sie ohnehin nicht.“

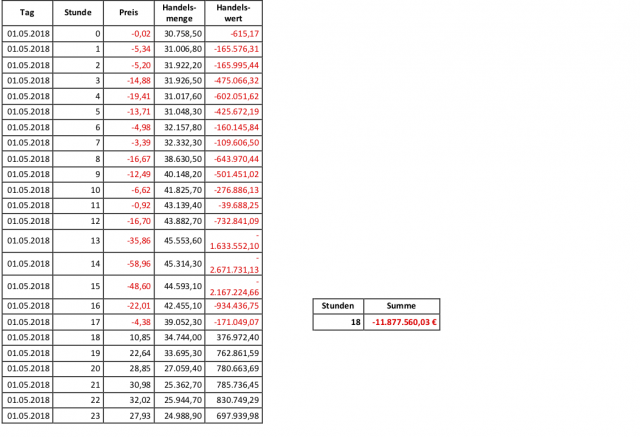

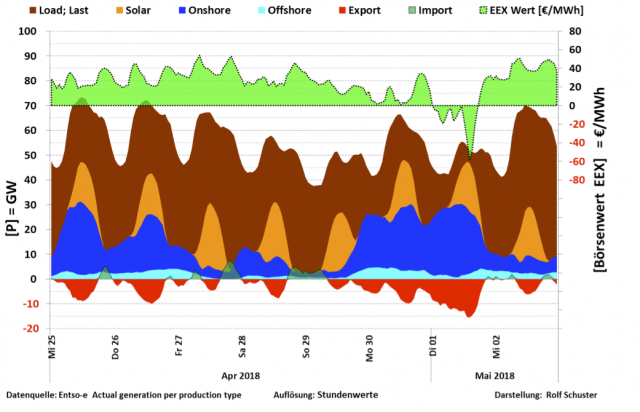

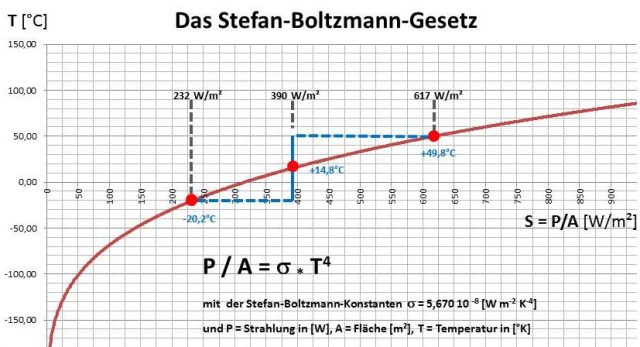

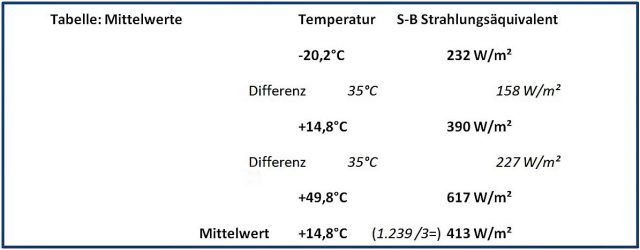

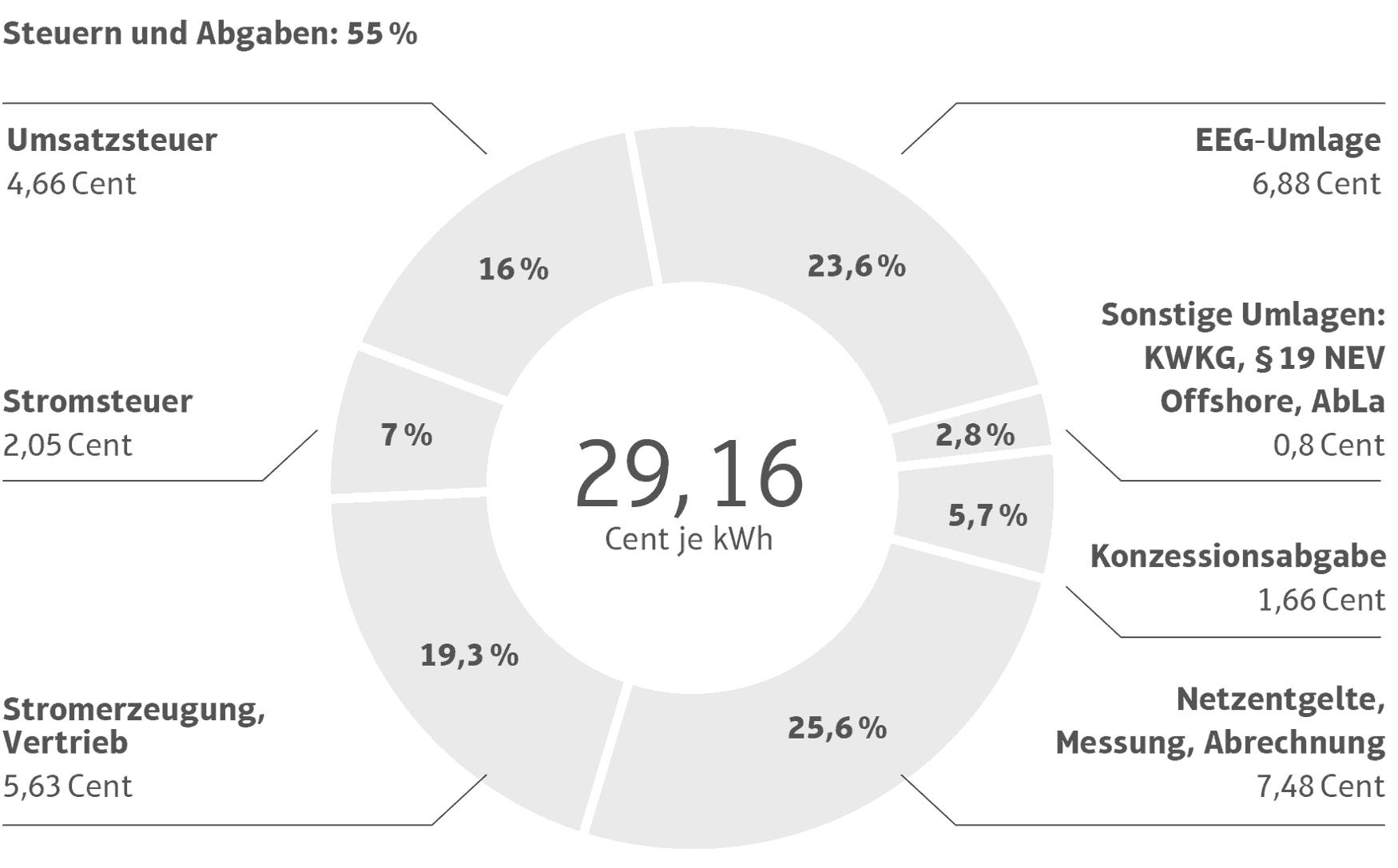

Auf unserer Wohlstandsinsel haben wir nicht im Blick, was die Entwicklungsländer wirklich brauchen. Wir hier in der schönen ersten Welt haben zwar hohe Energiepreise, aber alles in allem gut lachen. Für drei Milliarden Menschen in der dritten Welt hingegen ist das größte Problem ein fehlendes Stromnetz. Keine verlässliche Energieversorgung zu haben, heißt, dass nichts von dem, was wir als selbstverständlich voraussetzen, funktioniert. Gekühlte Medikamente im Landkrankenhaus? Nur, wenn das Licht ausbleibt, denn Strom für beides gibt die eine Solarzelle auf dem Dach nicht her. Nachts wird es erst recht schwierig. Der Weg aus der Armut ist ein grundlastfähiges Stromnetz für eigene Industrien und Infrastrukturen. Für uns ist Strom eine Selbstverständlichkeit, in Afrika brächte er mit dem dadurch wachsenden Wohlstand Nahrung, Gesundheit und Frieden. Kohle- und Gaskraftwerke und Sprit schluckende Autos soll Afrika nicht haben dürfen, weil der Weltklimarat das CO2 fürchtet. Erneuerbare Energien liefern bei Weitem nicht die benötigten Strommengen, grundlasttauglich sind sie ohnehin nicht. Da bleibt nur eine Technik übrig – die gute alte Kernkraft, die aber weltweit abnimmt. Doch wie ist das mit den Risiken der Nukleartechnik? Thorium hin oder her, was ist bisher geschehen? Hier kommen Daten:

- Ist jede kleine Strahlendosis schädlich?

Gemäß der „Linear No Threshold“-Hypothese (LNT) steigt das Krebsrisiko mit jeder jemals erhaltenen Dosis linear an. „Je weniger Strahlung, desto besser“ ist die übliche Sprachregelung, auf der die Risikohochrechnungen beruhen. Manche Institute sind anderer Ansicht, nämlich, dass der Körper mit geringer Strahlung gut klarkommt und dass sich die Wirkung von Strahlung nicht lebenslänglich im Körper kumuliert.

- Wie hoch ist die Strahlenbelastung, wenn man eine Banane isst?

- Wie hoch ist die Höchstdosis der Bevölkerung Deutschlands durch laufende Kernkraftwerke?

Zehn Bananen – 0,01 Millisievert pro Jahr – bei großzügiger Berechnung. Tatsächlich ist es meist weniger. Ein Flug nach Japan liegt zehnfach höher, eine Computertomografie hundert- bis dreihundertfach.

- Wie hoch war die durchschnittliche Strahlenbelastung innerhalb eines 16-km-Radius bei der Three-Mile-Island-Kernschmelze (bei Harrisburg, 1979)?

80 Bananen oder 0,08 Millisievert.

- Gibt es eine natürliche Strahlung auf der Erde?

Die durchschnittliche Jahresdosis durch Hintergrundstrahlung beträgt 2,4 mSv (Millisievert), das 240-Fache der maximalen Belastung durch KKWs in Deutschland. Hierzulande liegt sie im Schnitt bei 2,1 mSV, mancherortsvielfach höher. Die Stadt Ramsar im Iran bestrahlt ihre Bewohner an jedem einzelnen Tag mit dem Äquivalent von zwölf Röntgenbildern, ohne dass dort die Sterblichkeit ansteigt, ganz im Gegenteil, die Leute werden bei guter Gesundheit uralt.

- Ist eine geringe Menge an Radioaktivität womöglich sogar gesund?

Es wäre unmoralisch, das zu testen, indem man Menschen im Großversuch bestrahlt. Doch genau das ist in Taiwan passiert. Was war da los in Taipeh? Um 1982 herum wurde versehentlich ein Container mit strahlendem Kobalt-60 zusammen mit regulären Stahlresten verschmolzen und zu Stahlträgern verarbeitet. Diese wurden in 180 Neubauten eingesetzt. Etwa zehntausend Menschen zogen für 9 bis 20 Jahre ein. Erst 1992 begann man, die harte Gammastrahlung der Häuser zu bemerken. 2003 betrug die kumulierte Kobalt-Strahlendosis der Bewohner 600 mSv, bei manchen bis zu 4000 mSv, das ist 1600 Mal höher als die durchschnittliche Hintergrundstrahlung der Erde.

„Studien zeigen, dass geringe und mittlere Dosen von Strahlung gesundheitsfördernd sein könnten.“

In diesen 20 Jahren hätte man statistisch 232 Krebstote durch natürliche Ursachen, also ohne das Kobalt-60 in der Wand, erwarten können. Gemäß den LNT-Datenmodellen müssten weitere 70 durch die erhöhte Strahlung hinzukommen, zusammen 302. Tatsächlich starben aber nur sieben Menschen an Krebs. Die Bewohner dieser kontaminierten Gebäude hatten ein um beispiellose 97 Prozent gemindertes Krebsrisiko. Zufall? Oder eine Nebenwirkung der Kobalt-60-Radioaktivität? Ohne die eingebaute Strahlungsquelle wären 46 Neugeborene mit einer Form von genetischer Missbildung wie Down-Syndrom oder Kinderlähmung zu erwarten gewesen. Doch es kamen nur drei solche Babys zur Welt (alle drei mit Herzfehlern, die später verheilten), das ist eine Verringerung von Gendefekten bei Neugeborenen um 93 Prozent. Die Bewohner waren im Schnitt jünger als die Gesamtbevölkerung, das erklärt einen Teil der geringeren Krebshäufigkeit. Spätere Untersuchungen konnten auch noch weitere Störeinflüsse berücksichtigen, etwa die lange Zeitspanne von der Entstehung einer Krebskrankheit bis zur Diagnose und die variierende Wirkung der Kobaltstrahlung auf unterschiedliches Gewebe. Übrig bleibt eine um 40 Prozent niedrigere Krebsrate. All dies deutet auf eine positive Wirkung von Strahlung in geringer und mittlerer Höhe hin, man nennt das Hormesis.

- Was ist Hormesis?

Seit Jahrmillionen sind Lebewesen radioaktiver Strahlung ausgesetzt, in der Frühzeit stärker als heute. Durch Adaption entstanden Mechanismen, die molekulare Strahlungsschäden umgehend reparieren – und zwar so übereffizient, dass nicht nur akute, sondern auch bereits vorhandene Zellschäden gleich mit repariert werden. Studien zeigen, dass geringe und mittlere Dosen von Strahlung (aber auch anderer Stressfaktoren wie Gifte), durch diesen Trainingseffekt gesundheitsfördernd sein könnten – selbst noch in einer Höhe, die der maximal erlaubten Dosis für Kernkraftwerksarbeiter entspricht. In Gegenden mit höherer Hintergrundstrahlung gibt es weniger Krebsfälle. Britischen Radiologen wurde eine überdurchschnittliche Lebenserwartung attestiert. In amerikanischen Bundesstaaten, in denen Atomtests stattfanden, ist die Lungenkrebsrate deutlich niedriger als in den anderen.

- Löst Strahlung Genmutationen aus, die weitervererbt werden?

Ionisierende Strahlung kann zu Mutationen im Zellkern führen. Dass es in der Folge zu Gendefekten bei den Nachkommen kommt, ist aber offenbar höchst selten. Die Radiation Effects Research Foundation, eine japanisch-amerikanische Organisation, die seit Ende der 1940er-Jahre gesundheitliche, genetische und umweltbezogene Langzeiteffekte der radioaktiven Strahlung der Atombombenopfer von Hiroshima und Nagasaki untersucht, findet keinen Anstieg von Gendefekten bei den Kindern der Betroffenen, selbst wenn ihre Eltern extrem hohen Dosen ausgesetzt waren.

- Wie viele Menschen hat die zivile Nukleartechnik bisher insgesamt auf dem Gewissen?

Unumstritten sind insgesamt und weltweit 209 Tote seit 1945. Bei einem Unfall in Kyshtym 1957 schwanken die Schätzungen zwischen 49 und 8015 Toten als Spätfolgen. Damit kollidieren sie jedoch mit der bis zu 39 Prozent niedrigeren Krebsrate gegenüber einer nicht kontaminierten Vergleichsgruppe aus der Gegend.

- Und Tschernobyl?

Neben den 45 Mitarbeitern, die bereits oben eingerechnet sind, kursieren unterschiedliche Schätzungen zu den Langzeitfolgen von Tschernobyl, gemäß UN sind bislang 58 weitere Strahlenopfer zu beklagen. Die Spätfolgen beziffert die Weltgesundheitsorganisation auf bis zu weitere 4000 Krebstote. Greenpeace behauptet, es werden 200.000 oder mehr werden. Das International Journal of Cancer wiederum schreibt in einer Studie, es sei unwahrscheinlich, dass die Folgen des bislang größten Strahlungsunfalls in den Krebsstatistiken Europas überhaupt erkennbar werden und auch bislang gebe es in Europa keinen daraus resultierenden Anstieg.

- Fukushima?

Null Tote durch den (größten anzunehmenden) Reaktorunfall. Was 18.000 Menschenleben kostete, war eines der schwersten jemals gemessenen Erdbeben und der darauffolgende Tsunami, nicht aber die dreifache Kernschmelze. Gemäß UN-Report waren die Arbeiter im havarierten Kernkraftwerk im Schnitt nur 140 mSv ausgesetzt, daher besteht für sie kein erhöhtes Krebsrisiko. Ein zweiwöchiger Aufenthalt innerhalb der Sperrzone bedeutete typischerweise 1 mSv, das ist wenig (vgl. Taipeh). Für die Bevölkerung war das größere Gesundheitsrisiko die Überreaktion der Behörden, ausnahmslos alle zu evakuieren.

- Welche Energiequelle ist die tödlichste?

Kohle. Wenn man mal CO2 außen vor lässt, liegt die Sterblichkeit im weltweiten Schnitt bei 100.000 pro Billiarde Kilowattstunden. Öl: 36.000, Biomasse: 24.000, Solarzellen: 440, Windräder: 150 (Vögel nicht mitgezählt). Kernkraft schneidet mit weitem Abstand am besten ab: 90.

„Was außerhalb unseres Einflusses liegt, macht uns panisch.“

Um all dem Geraune von Mutationen, Strahlung und Toten noch zwei weitere Kennziffern hinzuzufügen: Jährlich sterben 3.000.000 Menschen durch Luftverschmutzung und weitere 4.300.000, weil sie mangels Strom in ihren vier Wänden Holz und Dung (in den weltweiten Statistiken subsumiert unter „Erneuerbare Energien“) zum Kochen und Heizen verbrennen. Das bekommen wir nur nicht so mit.

Was wir mitbekommen und was wir uns merken, ist das Spektakuläre, das Visuelle und das, worüber die Medien berichten und unsere Freunde reden: Schweinegrippe, kalbende Eisberge, Flugzeugabstürze. Und natürlich Hiroshima, Fukushima, Tschernobyl. Zerstörung läuft plötzlich ab, Aufbau nur langsam. Langsam hat keinen Nachrichtenwert, deshalb besteht die mediale Ausgabe der Welt zu großen Teilen aus Kurseinbrüchen, Superstürmen und Unfällen aller Art. Dazu kommt, dass wir Risiken, die wir nicht selbst beeinflussen können, maßlos überschätzen. Hausgemachte Gefahren hingegen ereilen gefühlt immer nur die anderen, zum Beispiel der ganz gewöhnliche Tabakgenuss, welcher für Raucher das mit Abstand größte Lebensrisiko darstellt. Was wir vermeintlich selbst kontrollieren könnten, lässt uns kalt (gähn, Reiseverkehr …). Was außerhalb unseres Einflusses liegt, macht uns panisch (OMG, Turbulenzen!).

Als kleiner Junge konnte ich eine Weile lang nicht einschlafen. Ich war überzeugt, die RAF würde mich holen kommen. Sie kam nicht. Und was das Atom betrifft: Vielleicht wäre es mal an der Zeit, nachzusehen, ob da wirklich ein Krokodil unter dem Bett lauert.

Der Beitrag erschien zuerst bei NOVO Argumente