Die Nachtspeicherheizung

Elektrisch heizen ist eine bequeme Sache. Man spart den Schornstein, den Öltank, den Platz für die Gastherme oder das Wärmepumpenaggregat. Ein Knopfdruck oder ein Befehl der Automatik sorgen völlig geräusch-, wartungs- und emissionsfrei für angenehme Wärme.

In den 1960er Jahren verbreitete sich die Nachtspeicherheizung als moderne Heizungsvariante und verdrängte einen Teil der Kohleöfen, später nach der Ölkrise 1973 zunehmend auch Ölkessel. Der Ausbau der Kernenergie schien zu garantieren, dass es dauerhaft billigen Strom geben werde. Zudem existierte im alten Energieversorgungssystem ein deutlicher Verbrauchsunterschied von Tag und Nacht. Im Vergleich zu heute arbeitete ein geringerer Teil der Industrie im 24/7-Betrieb. Zudem waren die Kraftwerke schlechter regelfähig als heute.

Das Prinzip der Elektroheizung ist denkbar einfach. Gewendelte Heizdrähte bilden einen ohmschen Widerstand, der den Strom zu 100 Prozent in Wärme umsetzt. Diese heizt einen oft aus Keramik bestehenden Speicherkörper auf und sorgt für eine Wärmespeicherung über die Zeiten, in denen kein preisgünstiger Heizstrom zur Verfügung steht. Eine andere Variante sind Infrarot-Heizgeräte. Moderne Elektroheizungen haben mitdenkende Automatiken. Sie merken sich den Verbrauch vom Vortag und speichern nach Abfrage des Außentemperaturgebers nur so viel Wärme ein, wie vermutlich gebraucht werden wird. Reicht das nicht aus, wird kurzfristig zum Lichtstromtarif zugeheizt.

In den Anfangszeiten der sechziger und siebziger Jahre war die Nachtspeicherheizung auch preislich konkurrenzfähig. Den Strom gab es nachts schön billig und CO2war halt Lebensbaustein, Löschmittel und in Getränken drin. Heute zahlt man 18 bis 22 Cent für die Kilowattstunde Heizstrom, es gibt nur wenige überregionale Anbieter. Die Umrüstung auf kostengünstigere Wärmequellen ist eher schwierig, denn viele Häuser wurden mit der E-Heizung projektiert und haben keine Schornsteine und Wasserumlaufsysteme mit Heizkörpern. Speziell bei Mehrfamilienhäusern fällt die Umrüstung aus Kostengründen meist aus.

Nicht nur durch die heftig gestiegenen Strompreise bekam die Nachtspeicherheizung einen schlechten Ruf. In der heutigen CO2-zentrierten Weltsicht erweist sich der energetische Umweg Brennstoff -> Wärme -> Strom -> Wärme gegenüber Brennstoff -> Wärme nicht nur als teurer, sondern vor allem als emissionsreicher. Zudem richtete sich die öffentliche Diskussion zunehmend darauf, dass die Nachtspeicherheizungen vor allem für die Erzeuger, also die großen und bösen Stromkonzerne, von Vorteil sind.

So trat am 1. Oktober 2009 die Energieeinsparverordnung (EnEV 2009) in Kraft, die eine schrittweise Außerbetriebnahme von elektrischen Speicherheizsystemen vorsah. Danach durften Nachtstromspeicherheizungen, die vor 1990 in Wohngebäude mit mehr als fünf Wohneinheiten eingebaut wurden, nur noch bis Ende 2019 betrieben werden. Später eingebaute Nachtstromspeicherheizungen durften noch bis zum Ablauf von 30 Jahren nach Einbau betrieben werden. Die Pflicht zur Umstellung entfiel, wenn das Gebäude die Anforderungen der Wärmeschutzverordnung vom August 1994 einhält.

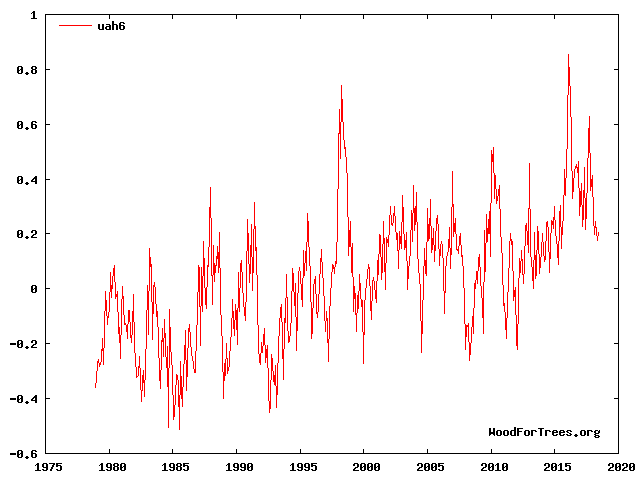

Vorwärts zurück

Obwohl das Verbot der EnEV 2009 nur einen kleinen Teil der Nachtspeicherheizungen betraf, beschloss der Bundestag im Jahr 2013, es wieder außer Kraft zu setzen. Der betreffende § 10a EnEV, der die Außerbetriebnahme von Nachtspeicherheizungen regelte, wurde wieder aufgehoben. Spielen die höheren Emissionen plötzlich keine Rolle mehr? Immerhin steht eine Elektroheizung für etwa 600 Gramm CO2pro Kilowattstunde, entsprechend dem deutschen Strommix. Ein erdgasgefeuerter Brennwertkessel emittiert weniger als die Hälfte. Aus klimapolitischer Sicht ist „Power to heat“ (P2H) also kontraproduktiv. Die als Sektorkopplung bezeichnete Ausweitung der Elektrizität auf Wärme und Verkehr dürfte den jetzigen Strombedarf verdoppeln bis verdreifachen.

Genau das ist das Ziel der Ökolobby. Die jetzige Stromversorgung und die Möglichkeiten der verbraucherfernen Einspeisung geraten an Grenzen. Indem neue Stromverbraucher planwirtschaftlich generiert werden, zum Beispiel eine Million E-Mobile, verdrängt man die bisher für Transport und zur Wärmegewinnung genutzten Brennstoffe. Das sorgt das für die Absatzsicherung Zufallsstrom erzeugender Anlagen.

Diese mit Vehemenz betriebene Initiative zur Sektorkopplung indoktrinierte die Politik erfolgreich. Es herrscht der Aberglaube, die Umstellung von Wärme- und Verkehrssektor auf Elektrizität sei kostengünstig möglich, da künftig Unmengen von Strom fast zum Nulltarif aus Wind und Sonne zu erhalten seien. Insbesondere Erzeugungsspitzen, die heute zum Abregeln auch der regenerativen Anlagen führen, seien damit gut nutzbar.

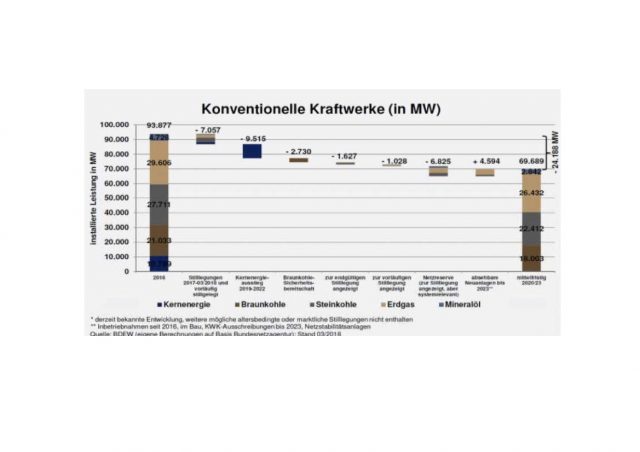

Das ist ein Holzweg. Die These vom reichlich verfügbaren billigen Strom ist Wunschdenken und von keinerlei Fakten gedeckt. Zeitweise Erzeugungsspitzen durch atlantische Tiefausläufer können keine Versorgung mit Strom, Wärme und Mobilität sichern. Der Rückgang der gesicherten Stromproduktion stellt sich nach Erhebungen des BDEW (Bundesverband der Energie- und Wasserwirtschaft e.V.) so dar:

Eine Jahreshöchstlast von über 80 Gigawatt wird schon ab 2023 schwerlich ohne Importe abgesichert werden können. Das Maß erwarteter Überschüsse aus Wind- und Sonnenkraft ist unklar und in jedem Fall nur temporär. Heizen und Fahren erfordert aber Energie zu jeder Zeit. Damit bleiben nur zwei Optionen:

Eine Jahreshöchstlast von über 80 Gigawatt wird schon ab 2023 schwerlich ohne Importe abgesichert werden können. Das Maß erwarteter Überschüsse aus Wind- und Sonnenkraft ist unklar und in jedem Fall nur temporär. Heizen und Fahren erfordert aber Energie zu jeder Zeit. Damit bleiben nur zwei Optionen:

Entweder die P2H-Anlagen haben nur begrenzte Betriebsstunden und müssen durch andere, herkömmliche Systeme ergänzt werden oder sie beziehen ihren Strom auch aus konventionellen Quellen. Die erste Variante wäre teuer, die zweite würde die konventionelle Erzeugung stabilisieren und sogar seinen Ausbau auf bis zu 100 Gigawatt erfordern (siehe hier).

P2H würde Sinn machen bei einem hohen Anteil CO2-armer, stabiler und kostengünstiger Erzeugung, die aber durch den weiteren Zubau volatiler Anlagen nicht erreichbar ist.

Während Deutschland seinen Strombedarf zum völlig falschen Zeitpunkt hochtreibt, bemüht sich die EU, ihn zu senken. Dabei dreht sie am ganz großen Rad und kümmert sich – um Staubsauger. Seit September 2017 gilt die Öko-Design-Verordnung 666/2014. Danach darf die Stromaufnahme von neuen Geräten 900 Watt nicht mehr überschreiten. In einem Normalhaushalt ist vermutlich eine halbe Stunde Staubsaugen pro Woche (zweimal „Tagesschau“ hintereinander!) schon reichlich angesetzt. Die Einsparung gegenüber einem Altgerät mit 1600 Watt übers Jahr ist lächerlich angesichts der Strommengen, die in Deutschland durch P2H verbraten werden sollen.

Die Verordnung schuf zunächst Arbeit für den Europäischen Gerichtshof (EuGH). Strittig war die Frage, ob die zulässige Stromaufnahme nur bei sauberem Staubfangbeutel erreicht werden muss und dann mit weiterem Beutelfüllstand ansteigen darf und damit die Vorgabe dennoch erfüllt wird. Die Firma Dyson bietet hingegen beutellose Geräte an, deren Leistungsaufnahme weitgehend konstant ist. Dyson prozessierte gegen die vermeintliche Bevorteilung der herkömmlichen Geräte mit Staubbeutel wie bei den Produkten von BSH (Bosch-Siemens-Hausgeräte) – und verlor.

Mit Spannung sehen wir den nächsten Öko-Design-Richtlinien entgegen.

So sparen wir Strom beim Staubsaugen und verschwenden ihn beim Heizen. Elektrizität ist die edelste Form der Energie. Sie ist universell einsetzbar und die unverzichtbare Grundlage von Digitalisierung und Industrie 4.0. Wenn sie auf Niedertemperaturwärme reduziert wird, kommt das einer Degradierung gleich. Stefan Fassbinder formuliert es so: „Mit Strom heizen ist, wie Möbel verbrennen, die man nicht verkaufen kann. Aber warum stellt man dann die Möbel erst her?“