Dr.-Ing. Erhard Beppler

Fazit

Nach den Vorstellungen der neuen Regierung soll das „Pariser Abkommen“ befolgt werden, d. h. Klimaneutralität in 2045.

An den bisher gemachten Kostenabschätzungen im Billionenbereich für die Einstellung der Klimaneutralität wird sich wenig ändern können. Wohl aber werden die Strompreise für die Betriebe, etc. abgesenkt, d.h. die Kosten werden von den Stromkunden zu den Steuerzahlern verschoben, wo doch die Staatsquote schon bei 49,5% liegt.

Der Weg Deutschlands bis 2045 wird im Folgenden beschrieben.

Ausgehend von 2024 mit installierten 163 GW über die „alternativen Energien“ Wind und Sonne wurden im Mittel 24 GW Stromleistung erzeugt, 26 GW über die Energieträger Braunkohle, Steinkohle und Erdgas, in Summe also etwa 50 GW.

Um in 2024 50 GW nur über Wind und Sonne zu erzeugen, wäre die Installation von

163 X 50/24 = 340 GW erforderlich.

Da über die Stromerzeugung nur über Wind und Sonne die Stromerzeugung nicht zielgerecht an den Strombedarf angepasst werden kann, muss Wasserstoff erzeugt werden über H2-Elektrolyseure. Wasserstoff wird als Schlüssel für die Klimaneutralität in Europa gesehen.

Um 1 GW über Wind und Sonne zu erzeugen, müssen zunächst ½ GW für die Erzeugung von Wasserstoff aufgebracht werden mit einem Wirkungsgrad von 40% für die Herstellung (47 KWh/kg H2), Speicherung (5 KWh/kg H2) und Verstromung (35 KWh/kg H2) – in Summe 87KWh/kg H2.

Für die Erzeugung einer Stromleistung von 1 GW über Wind und Sonne einschließlich der Erzeugung von Wasserstoff müssen dann

1 GW = ½ GW + ½ GW/0,4 oder 1 GW = ½ GW + 1,25 GW = 1,75 GW (Gleichung 1)

aufgebracht werden.

Für die Erzeugung von 50 GW in 2024 oder in 2045 (bei gleichem Strombedarf) über Wind, Sonne und Wasserstoff wären dann 50 X 1,75 = 87,5 GW erforderlich , oder 37,5 GW nur für Wasserstoffdarstellung.

Für die Erzeugung von 87,5 GW sind dann einschließlich der Wasserstoffherstellung

163 X 87,5/24 (s.o.) = 594 GW (Gleichung 2)

zu installieren.

Von den 37,5 GW für die Herstellung, Speicherung und Verstromung des Wasserstoffes sind dann 47/87 X 100 = 54% (s.o.) nur für die H2-Darstellung erforderlich oder

37,5 GW X 24 h X 0,54 = 487 GWh/Tag . (Gleichung 3)

Daraus errechnet sich ein täglicher Wasserstoffverbrauch über

487 GWh/Tag und 47 KWh/kg H2 von 10 360 Tonnen H2/ Tag

nur für die Erzeugung von 50 GW.

Aber die Zielsetzung ist die Klimaneutralität der gesamten Energien in 2045, also die ausschließliche Stromerzeugung über Wind, Sonne und Wasserstoff.

In 2024 liegt der Primärenergieverbrauch über die Energieträger Braunkohle, Steinkohle, Mineralöl, Erdgas bei 255 GW, der im Folgenden im Sinne der Klimaneutralität auf 2045 übertragen wird.

Von den 255 GW müssen zunächst die bereits berücksichtigten 26 GW für die Stromerzeugung über Braunkohle, Steinkohle und Erdgas abgezogen werden.

Es gilt dann für die Stromerzeugung in 2045 nach Gleichung 1 für den Primärenergiebedarf:

GW = (255-24) GW X 1,75 = 404 GW, nur für die H2-Darstellung: 404 – (255-24)= 173 GW.

Gemäß Gleichung 2 errechnet sich dann für die Erzeugung von 404 GW für den Primärenergiebedarf eine Installation von

163 X 404/24 = 2743 GW.

Nach Gleichung 3 sind dann für die 173 GW nur für die Herstellung, Speicherung und Verstromung des Wasserstoffes

173 X 24 h X 0,54 = 2242 GWh/Tag erforderlich. Daraus errechnet sich ein täglicher H2-Verbrauch über 2242 GWh/Tag und 47 KWh/kg H2 von 47 700 Tonnen H2/Tag.

Das ergibt dann einen erforderlichen H2-Verbrauch einschließlich des Verbrauches für die Stromerzeugung in 2045 von 10 360 + 47 700 = 58 000 Tonnen, was einem Wasserbedarf von 464 000 Tonnen/Tag entspricht – wo auch immer diese Mengen aufgebracht werden können.

Bereits in 2024 zeigten sich im Winter durch den zunehmenden Zubau von Wind- und Solaranlagen vermehrt Dunkelflauten, d.h. die Stromleistungen über Wind und Sonne fielen ab auf etwa 10 GW über mehrere Tage bei sonstigen „alternativen Energien“ von etwa 7 GW bei einem Strombedarf zwischen 40 und 70 GW. Es fehlen dann zwischen 20 und 50 GW. Hilfe kommt zur Zeit von Nachbarländern mit Stromimporten bis über 15 GW.

Es ist müßig, bei einer erforderlichen Stromleistung in 2045 von 404 GW + 87,5 GW (Strom) über dieses Thema zu diskutieren.

Die Solarstromspitzen um die Mittagszeit lagen bereits in 2023 bei einer installierten Solarstromleistung von 70 GW bei 40 GW bei einer mittleren Stromnachfrage von etwa 50 GW – z.Z. liegen die installierten Solaranlagen bei 102 GW oder möglichen 40/70 X 102 = 58 GW in der Mittagszeit.

Auch hier erübrigt sich eine Diskussion für 2045 bei einer Stromleistung von 404 GW + 87,5 GW (Strom).

Erinnert sei an den kürzlichen Stromausfall in Spanien, wo bei einer Gesamtstromleistung von etwa 30 GW 19 GW nur über Solarstrom plötzlich ausfielen.

Dieser deutsche Weg ins Mittelalter soll nun vollzogen werden bei einem anthropogenen CO2-Eintrag in die Atmosphäre von etwa 4,7 ppm/a (0,000 47%), knapp 2% von Deutschland oder 0,09 ppm (0,000 009%) – nicht messbar.

Diesen einsamen Weg geht Deutschland wohl wissend, dass die großen Verursacher der anthropogenen CO2-Emissionen wie China, Russland, USA, etc. von den abstrusen Vorstellungen Deutschlands weit entfernt sind.

1.Einleitung

Die neue Bundesregierung bekennt sich zum „Pariser Abkommen“ sowie zu den europäischen und deutschen Klimazielen, d.h. Klimaneutralität in 2045.

Zudem werden eine Reihe von Maßnahmen aufgeführt, um die Strompreise abzusenken, insbesondere in der Industrie.

Die konventionelle Gasförderung in Deutschland soll vorangetrieben werden. Bis 2030 sollen Gaskraftwerke mit 20 GW Leistung entstehen, die als Rückgrat für den volatilen Solar- und Windstrom gelten.

Die CO2-Abscheidung, – Verbesserung oder – Nutzung soll für schwer vermeidbare Emissionen sowie Gaskraftwerke genutzt werden (CCS und CCU).

Der Wiederbetrieb von Kernkraftwerken ist nicht in Sicht.

Ein „Monitoring“ soll bis zur Sommerpause klären, wieviel Strom in Zukunft erforderlich ist und welchen Ausbau die „Erneuerbaren“ wie die Netze, und nicht zuletzt der Wasserstoffhochlauf erfahren soll.

Festgehalten wird am System der CO2-Bepreisung als zentraler Baustein. Man will den Emissionshandel europäisch und international vorantreiben, d.h. Benzin, Diesel. Heizöl, etc. werden schrittweise nicht unerheblich teurer.

Das Bekenntnis zum „Pariser Abkommen“ bedeutet, dass die Klimaneutralität bis 2045 oberstes Ziel mit all den damit verknüpften Problemen erhalten bleibt wie insbesondere die Zurverfügungstellung der erheblichen H2-Mengen sowie das Problem der sicheren Anpassung der Stromerzeugung an den Strombedarf.

Im Folgenden wird in einem ersten Schritt das Problem der Wasserstoffversorgung am Beispiel der z.Z. erforderlichen Stromleistung von 50 GW aufgezeigt mit dem Problem der Dunkelflauten wie der Solarstromspitzen in der Mittagszeit, um anschließend auf die Hoffnungslosigkeit der Einstellung der Klimaneutralität für den gesamten Primärenergiebedarf in 2045 einzugehen.

2. Eine technische Wegbeschreibung von der Erzeugung von CO2-freiem Strom zunächst nur für eine Stromleistung von 50 GW

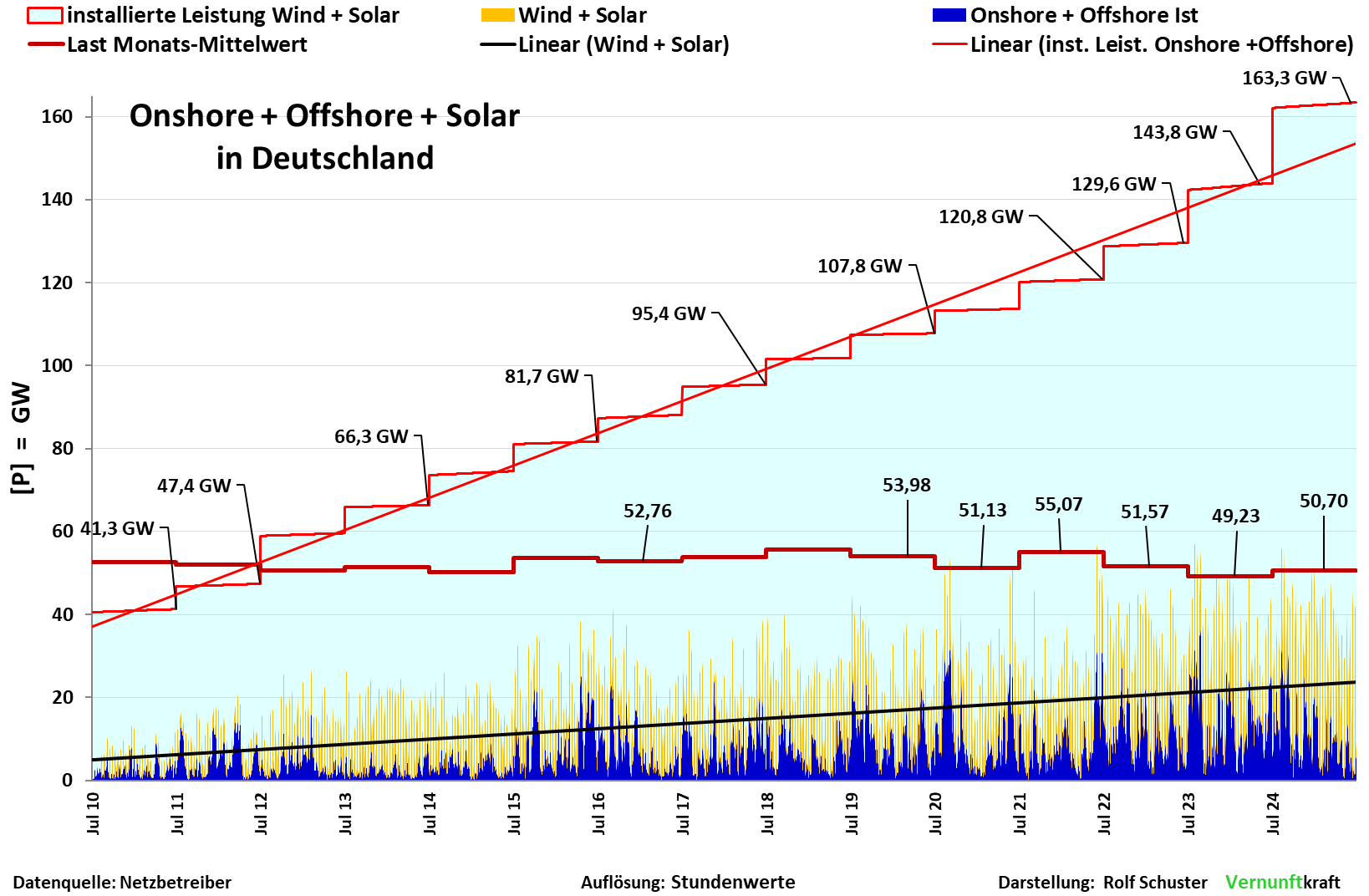

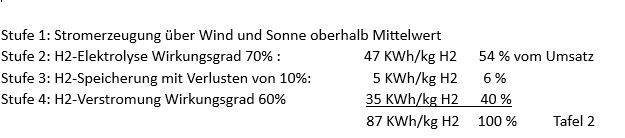

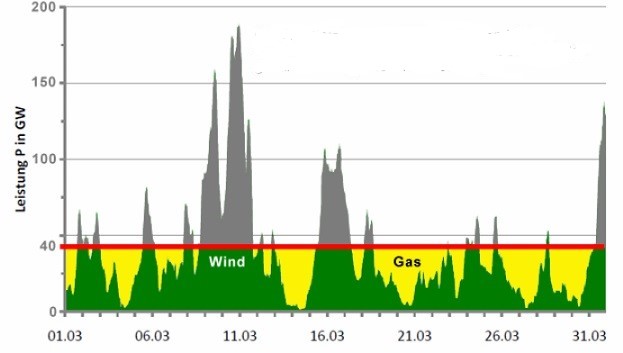

Zunächst ein kurzer Rückblick auf den Ausbau der Stromerzeugung über die Wind- und Solaranlagen von 2010 bis 2024. (Bild 1) (1)

Bild 1: Ausbau der Wind- und Solaranlagen

Die installierte Wind- und Solarleistung stieg von 41 GW in 2010 auf 163 GW in 2024 an, der erforderliche Strombedarf lag um 50 GW. Die Schwankungsbreite der Stromversorgung über Wind und Sonne wird in Bild 1 und Tafel 1 sichtbar (vgl. auch später). Die mittlere Stromerzeugung über Wind und Sonne liegt in 2024 bei etwa 24 GW. Etwa 26 GW werden über die Energieträger Braunkohle, Kohle und Erdgas beigesteuert.

Im Einzelnen schwanken die Leistungen der Wind- und Solaranlagen in 2024 wie folgt (Tafel 1): (2)

Tafel 1

Um die Stromleistung nur über Wind und Sonne von 24 GW auf 50 GW anzuheben, müsste dann bei gleichem Verhältnis von Wind- zu Solarstrom 163 X 50/24 = 340 GW installiert werden.

Damit würde zwar in Summe eine für 50 GW angepasste Stromerzeugung dargestellt werden, aber diese Stromleistung würde zwischen null und etwa 340 GW schwanken können, d.h. eine zielgerechte Anpassung der Stromleistung an den geforderten Strombedarf wäre nicht möglich, wie am folgenden Beispiel erläutert wird. (Bild 2)

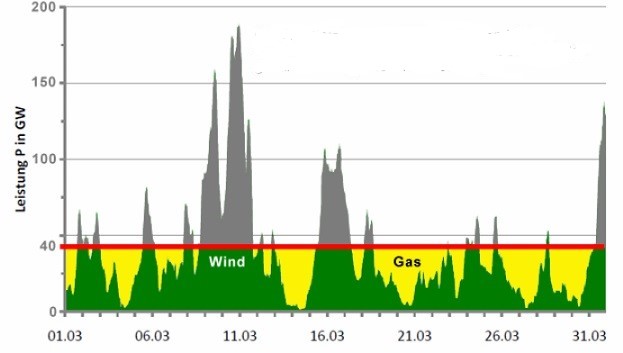

Bild 2: Beispiel für die Schwankungsbreite der Windstromerzeugung

Um 40 GW gezielt über Wind (und Sonne) darzustellen, müssen für den über 40 GW anfallenden Strom von 20 GW H2-Elektrolyseure her, um mit den 20 GW Wasserstoff zu erzeugen, zu speichern und über die H2-Verstromung wieder in Strom zurückzuführen.

Das ist dann nicht umsonst zu haben. (Kapitel 2.3)

2.1 Das Problem der Dunkelflauten

Im Winter 2024/2025 hat die Entstehung von Dunkelflauten (niedrige Stromerzeugung über Wind- und Solaranlagen über längere Zeiten) vermehrt zugenommen.

Die Ausbildung von Dunkelflauten nimmt naturgemäß im Winter durch die zurückgehende Solarstromerzeugung zu, natürlich auch durch den zunehmenden Ausbau von Wind- und Solaranlagen.

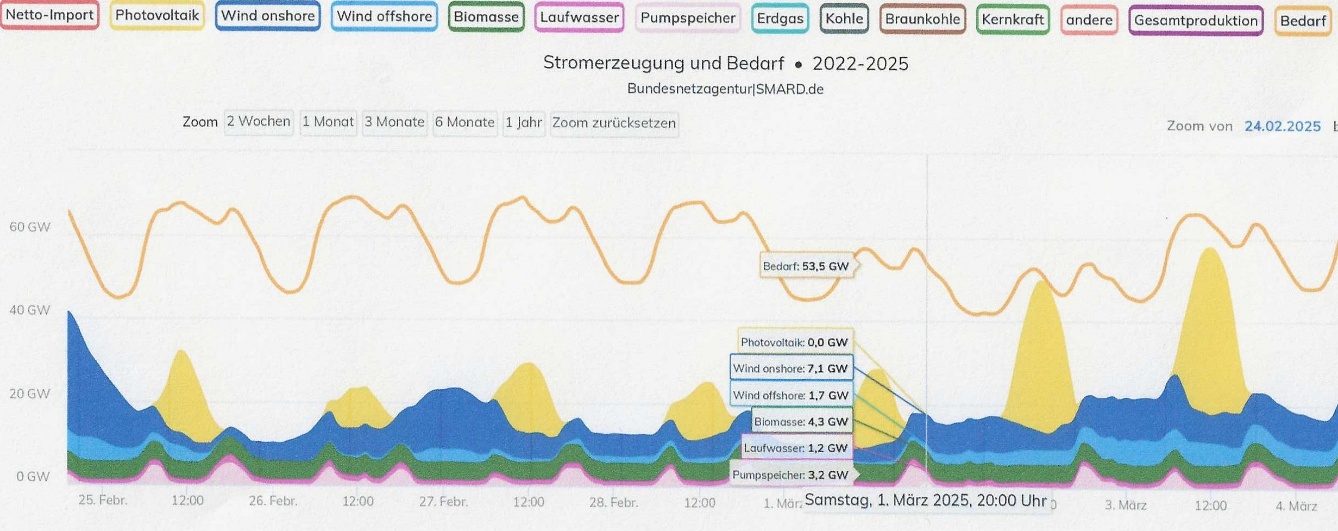

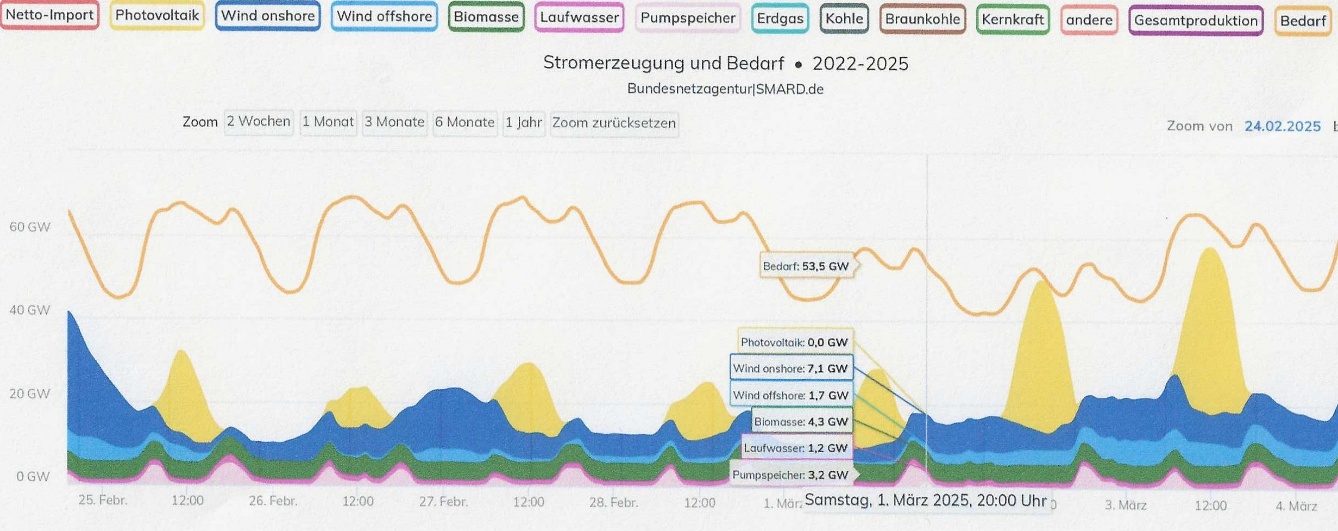

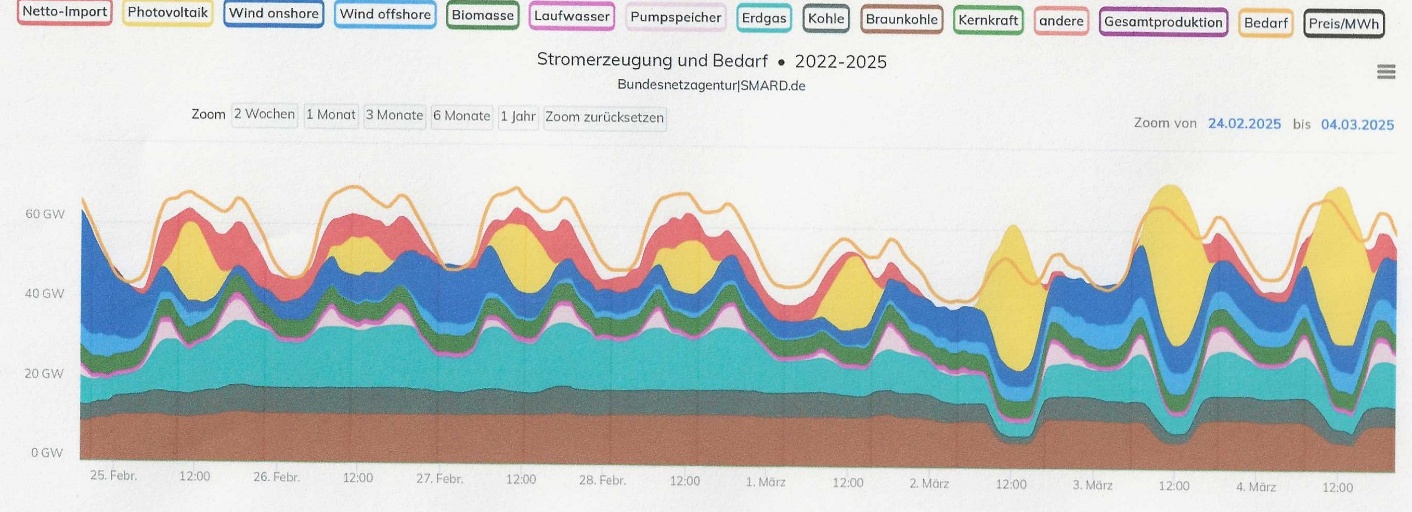

Im Folgenden wird an einem Beispiel (25.02. – 02.03.2025) das Problem der Dunkelflauten aufgezeigt. (Bild 3) (3)

Bild 3: Stromerzeugung der „alternativen Stromerzeuger“ und Strombedarf in Dunkelflauten

Im genannten Zeitraum werden zunächst nur die „alternativen Energien“ Laufwasser, Biomasse, Wind offshore, Wind onshore und Solarstrom dargestellt – ebenso der Strombedarf von etwa 50 GW, der jedoch tagsüber an 70 GW heranreicht, nachts bis 40 GW absinkt.

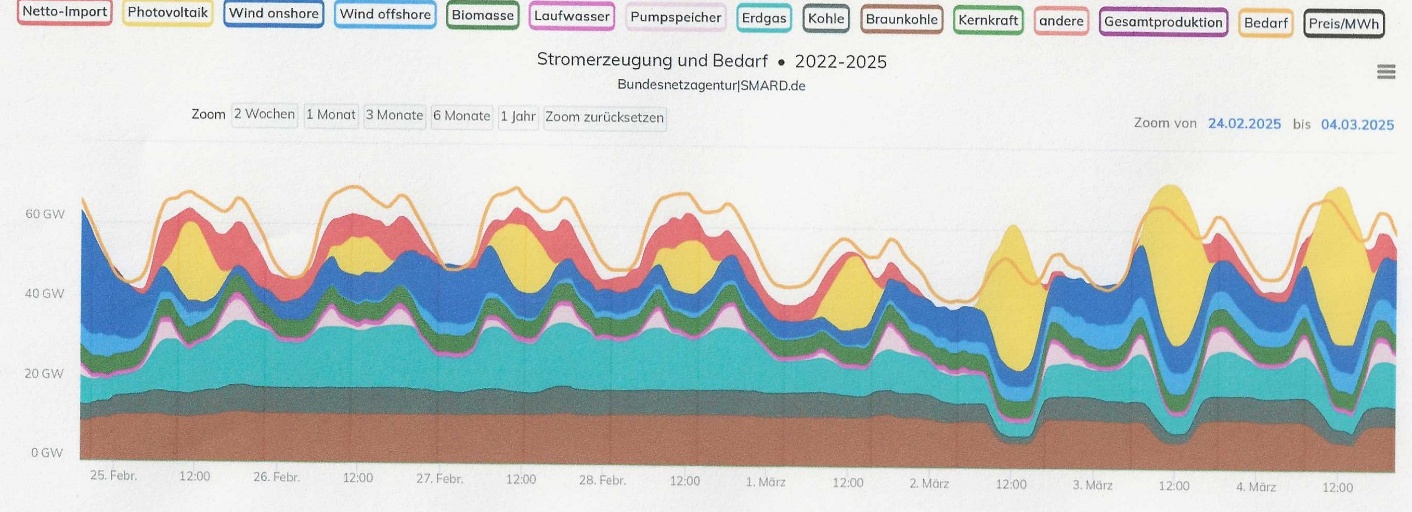

Die Stromerzeugung über Laufwasser und Biomasse schwanken um 7 GW, Wind onshore und offshore sowie Solarstrom um 10 GW – d.h. die Lücken bis zum Strombedarf nehmen Werte zwischen 20 und 50 GW an, die über Braunkohle, Kohle, Erdgas sowie Nettostromimporte bis 11 GW ausgeglichen werden müssen. (Bild 4) Die Stromimporte über Nachbarländer können zeitweise Werte über 15 GW annehmen.

Bild 4: Ausgleich der diversen Stromlücken durch unterschiedliche Energieträger einschließlich Nettostromimporte (rot) in Dunkelflauten

Großkraftwerke haben Kapazitäten um 1 GW, Gaskraftwerke eher um 0,5 GW. Ohne die Hilfe der Nachbarländer wäre eine höhere Anzahl an Großkraftwerken erforderlich.

Zu den Stromlieferanten aus dem Ausland zählen Österreich, Belgien, Schweiz, Tschechoslowakei, Niederlande, Norwegen, Polen, Schweden.

Deutschland bewegt sich in einer Komfort-Zone, solange diese Länder Strom liefern können. Aber erster Unmut wird laut.

Natürlich steigen die Strompreise bei einer Stromverknappung gehörig an.

Nun gelten die o.g. Zahlen nur für eine Wind- und Solarleistung von 24 GW. (s.o.) Alleine eine Umstellung auf 50 GW würde die Stromlücke von 20- 50 GW mehr als verdoppeln – ganz zu schweigen von den in 2045 erforderlichen Stromleistungen über Wind, Sonne und H2 alleine für den gesamten Primärenergieverbrauch von 404 GW. (vgl. Kapitel 3)

Wenn die Bundesregierung bis 2030 eine Kapazität für Gaskraftwerke von 20 GW als Rückgrat für die volatilen Wind- und Solaranlagen plant, ist das nur ein Tropfen auf einen heißen Stein und entspricht nicht der Zielsetzung der Klimaneutralität in 2045.

2.2 Das Problem der Solarstromspitzen um die Mittagszeit

In einer früheren Arbeit (4) war bereits darauf hingewiesen worden, dass bei einer installierten Solarleistung von 70 GW in 2023 im Sommer um die Mittagszeit Solarstromspitzen von 40 GW entstehen bei stündlichen Zu- bzw. Abnahmen bis zu 8,5 GW/h. Ausgeglichen wurden diese schnellen Veränderungen über Braunkohle (3 GW), Kohle (2 GW), Erdgas (4,1 GW), Pumpspeicher (5 GW) und wieder insbesondere über Nettostromimporte (15,4 GW).

Inzwischen sind die installierten Solaranlagen auf 102 GW ausgebaut, davon 63 GW oder 475 000 Anlagen fernsteuerbar und 39 GW oder 4 388 000 Anlagen nicht fernsteuerbar. (5)

Wird in 2023 von einem Verhältnis von Höhe der Solarstromspitzen zu installierter Solarleistung von 40:70 ausgegangen, werden in diesem Sommer bereits Solarstromspitzen von 40/70 X 102 = 58 GW zu erwarten sein, wenn nicht gegengesteuert werden kann.

Entsprechend wird sich die stündliche Veränderung der Solarstromspitzen beim Auf- und Abbau von 8,5 GW/h in 2023 entsprechend erhöhen, was zu einer massiven Gefährdung der Stromversorgung führen wird.

Zudem wird die Stromversorgung vermehrt gefährdet, wenn zusätzlich zu den Solarspitzen sog. „Hellbrisen“ hinzukommen, plötzlicher zusätzlicher Windstrom.

Erinnert sei an den kürzlichen Stromausfall in Spanien, wo bei einer Gesamtstromleistung von etwa 30 GW 19,1 GW nur über Solarstrom plötzlich ausfielen.

Auch hier darf bereits auf die in 2045 zu erwartenden Stromleistungen von 404 GW nur für den gesamten Primärenergiebedarf hingewiesen werden, (vgl. Kapitel 3)

2.3 Der erforderliche Aufwand für die Herstellung, Speicherung und Verstromung von Wasserstoff nur für eine Stromleistung von 50 GW

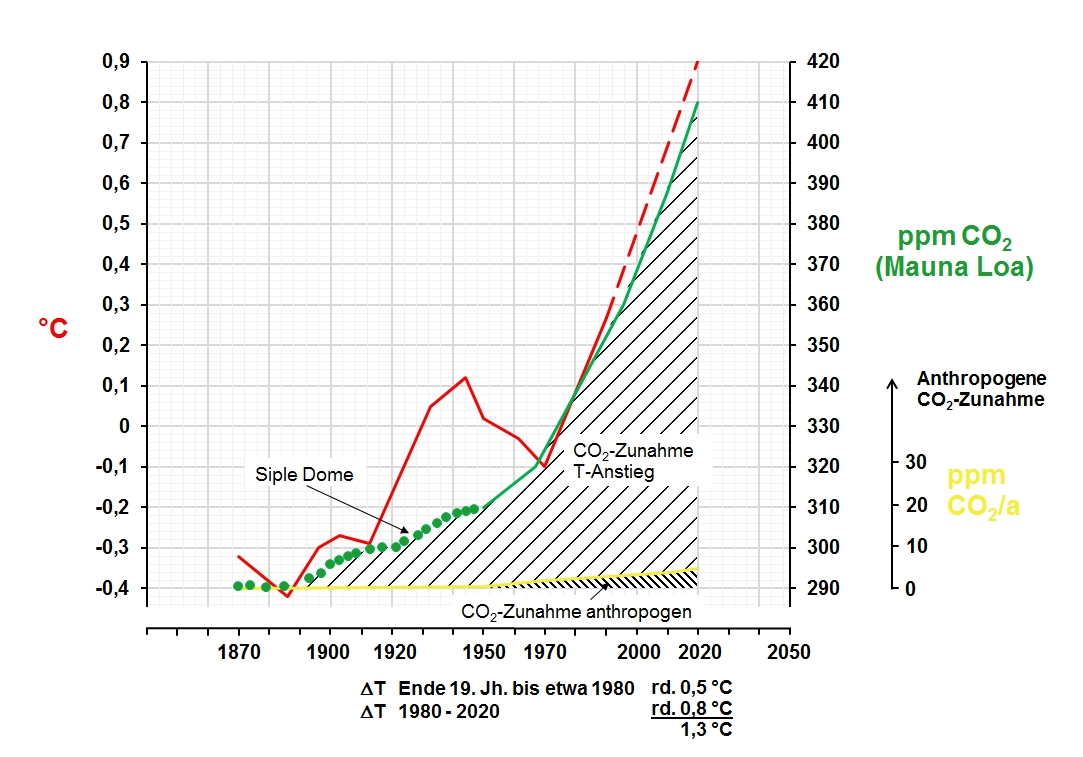

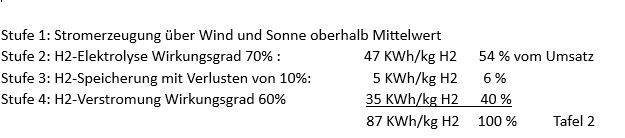

Der energetische Aufwand für die Herstellung von Wasserstoff in Elektrolyseuren, die Speicherung sowie die Verstromung setzt sich im Wesentlichen wie folgt zusammen: (6)

Der sich daraus ergebende Wirkungsgrad von 40% ist bewusst hoch angesetzt worden.

Es gilt dann für einen Leistungsbedarf von 50 GW einschließlich der Herstellung und Verarbeitung des Wasserstoffes:

a) Nach Bild 2 errechnet sich die Stromleistung unterhalb und oberhalb des Mittelwertes einschließlich des Energieaufwandes für die H2-Herstellung wie folgt:

GW = GW/2 + GW/2/0,4 = 50/2 + 50/2/0,4 = 25 + 25/2/0,4 = 87,5 GW oder allgemein

1 GW = ½ GW + ½ GW/0,4 oder 1 GW = ½ GW + 1,25 GW = 1,75 GW (Gleichung 1)

b) In 2024 wurden bei einer mittleren Stromleistung von 50 GW etwa 24 GW über Wind und Sonne beigestellt, wofür 163 GW über Wind- und Solaranlagen diese Leistung beisteuerten (Bild 1, Tafel 1), 26 GW über Braunkohle, Kohle, Erdgas.

Für die Erzeugung von 50 GW in 2024 oder 2045 über Wind, Sonne und Wasserstoff wären dann 50 X 1,75 = 87,5 GW erforderlich , oder 37,5 GW nur für Wasserstoffdarstellung.

Für die Erzeugung von 87,5 GW sind dann einschließlich der Wasserstoffherstellung

163 X 87,5/24 (s.o.) = 594 GW (Gleichung 2)

zu installieren.

Von den 37,5 GW für die Herstellung, Speicherung und Verstromung des Wasserstoffes sind dann 47/87 X 100 = 54% (s.o.) nur für die H2-Darstellung erforderlich oder

37,5 GW X 24 h X 0,54 = 487 GWh/Tag (Gleichung 3)

Daraus errechnet sich ein täglicher Wasserstoffverbrauch über

487 GWh/Tag und 47 KWh/kg H2 von 10 360 Tonnen H2/ Tag

nur für die Erzeugung von 50 GW.

Aber zur Einstellung der Klimaneutralität in 2045 gehört nicht nur die hier diskutierte Stromerzeugung.

3. Der Weg der kompletten Umstellung aller in Deutschland eingesetzten Energien wie Braunkohle, Kohle, Erdgas, Mineralöl auf Wind, Sonne und Wasserstoff

Die Zielsetzung Deutschlands ist die Klimaneutralität Deutschlands in 2045.

Der Primärenergieverbrauch in Deutschland lag 1990 bei 14 905 Petajoule oder 473 GW, in 2023 bei 10 735 Petajoule oder 338 GW. Nach ersten Schätzungen des bdew liegt der Primärenergieverbrauch in 2024 bei 10 487 Petajoule oder 330 GW.

Dabei lag der Anteil der „Erneuerbaren Energien“ in 1990 bei 1,3%, in 2023 bei 19,6%, in 2024 bei 20%. (bdew)

2023 2024 2045 (bei gleichbleibender

Erzeugung)

% GW % GW GW

Steinkohle 8,7 29,4 7,2 23,7 23,7

Braunkohle 8,3 28,1 7,6 25,1 25,1

Mineralöl 33,6 120,3 36,6 120,8 120,8

Erdgas 24,7 83,5 25,9 85,5 85,5

Kernenergie 0,7 2,4 – – –

„Erneu. Energien“ 19,6 66,2 20,0 66

Sonstige 2,3 7,8 2,7 8,9

Summe 338 330 255 Tafel 3

Der Zielsetzung der neuen Regierung folgend muss zur Einstellung der Klimaneutralität in 2045 auf die Energieträger Braunkohle, Steinkohle Erdgas, Mineralöl verzichtet werden zugunsten der ausschließlichen Stromerzeugung über Wind, Sonne und Wasserstoff – rechnerisch zunächst von 255 GW. (Tafel 3)

Dazu muss die für die Stromerzeugung aus Wind und Sonne bereits umgesetzten 24 GW abgezogen werden: 255 – 24 = 231 GW (vgl. Kapitel 2.3)

Es gilt dann der gleiche Rechengang wie bei der Umstellung der Stromerzeugung von 50 GW.

Gleichung 1 für die erforderliche Stromleistung:

GW = (255-24) GW X 1,75 = 404 GW, nur für die H2-Darstellung: 404 – (255-24)= 173 GW.

Gemäß Gleichung 2 errechnet sich dann für die Erzeugung von 404 GW eine Installation von

163 X 404/24 = 2743 GW.

Nach Gleichung 3 sind dann für die 173 GW nur für die Herstellung, Speicherung und Verstromung des Wasserstoffes

173 X 24 h X 0,54 = 2242 GWh/Tag erforderlich. Daraus errechnet sich ein täglicher H2-Verbrauch 2242 GWh/Tag und 47 KWh/kg H2 von 47 700 Tonnen H2/Tag.

Damit liegt der erforderliche H2-Verbrauch einschließlich des Verbrauches für die Stromerzeugung in 2045 bei 10 360 + 47 700 = 58 000 Tonnen, was einem Wasserbedarf von 464 000 Tonnen/Tag entspricht – wo auch immer diese Mengen aufgebracht werden sollen.

Bei diesen Berechnungen wird davon ausgegangen, dass das Verhältnis von Stromerzeugung von Wind zu Sonne gleichbleibt.

Sicher wird die Stromerzeugung in 2045 höher liegen als in 2024 – aber das prüft die Bundesregierung in ihrem „Monitoring“.

Nach ersten Kostenbetrachtungen für den Einsatz von importiertem Wasserstoff mit dem Trägermedium Ammoniak liegt der Strompreis unter Berücksichtigung des Importes, der Aufspaltung in H2 (Cracken), die Kosten des Crackers sowie die Verluste bei der Stromerzeugung bei 49 ct/KWh, damit 5 mal höher als der heutige Börsenpreis von 9 ct/KWh. (Strompreis USA 3,5 ct/KWh). (11)

4. Schlussbetrachtung

Der mit der Einstellung der Klimaneutralität in 2045 verbundene erforderliche Zubau an Wind- und Solaranlagen einschließlich der für die Klimaneutralität unabdingbaren H2-Mengen muss nicht zuletzt auch vor dem Hintergrund betrachtet werden, welchen Anteil eigentlich die Menschen weltweit sowie Deutschland für den Anstieg der CO2-Gehalte der Atmosphäre beitragen.

Nach der Aussage des IPCC wird der Anstieg der CO2-Gehalte der Atmosphäre ausschließlich durch den CO2-Ausstoß der Menschen bestimmt als Ursache für den Temperaturanstieg bis zum Verglühen der Erde.

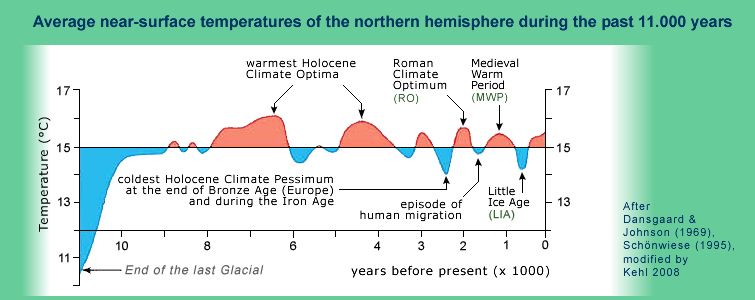

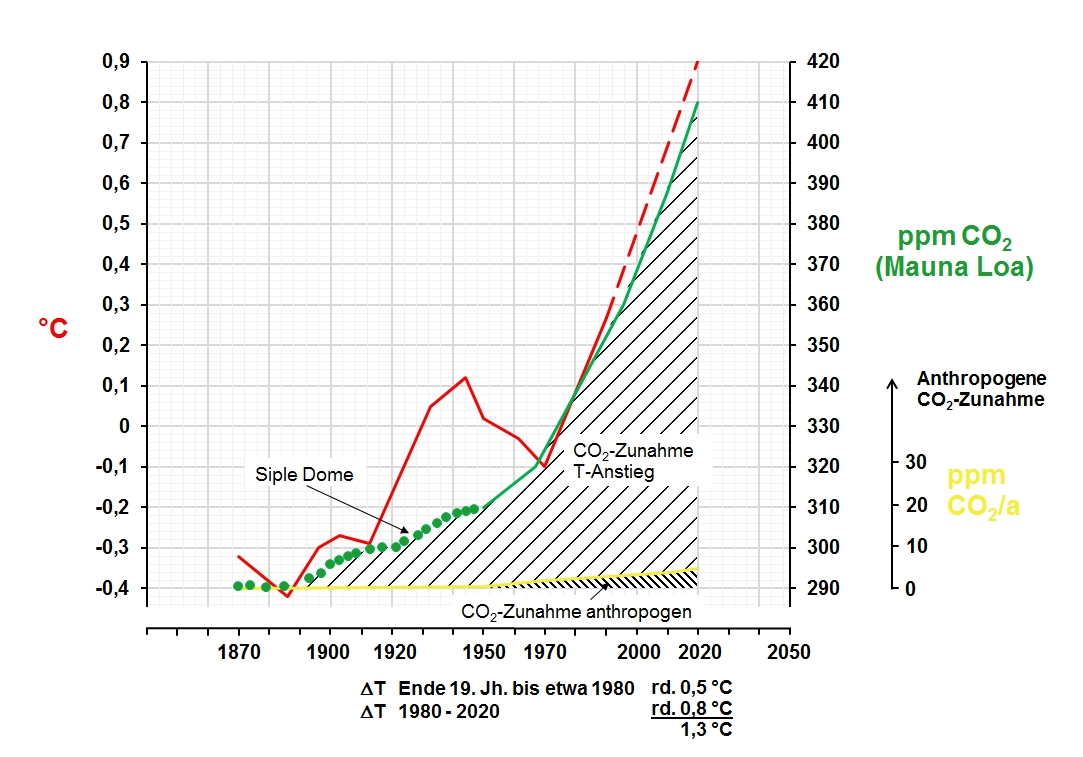

Nach früheren Arbeiten steigt der CO2-Gehalt der Atmosphäre von 1870 (Ende der „Kleinen Eiszeit“ mit großen Hungersnöten) bis 2020 von 290 ppm auf 410 ppm an. (Bild 5) (9)

Bild 5: CO2-Gehalt der Atmosphäre sowie ihr anthropogener Anteil

Dieser Anstieg wird durch den anthropogenen CO2-Eintrag in die Atmosphäre von nur 4,7 ppm/a (2020) verursacht, der Rest von rund 115 ppm durch andere Einflüsse (Temperaturanstieg Meere (10), Vulkane, etc.). Diese Aussagen beziehen sich auf Messungen und Stoffbilanzen, nicht auf Modellbetrachtungen. Bei diesem CO2-Anstieg ist zu bedenken, dass durch die gemessene Begrünung der Erde ein nicht unerheblicher Anteil des CO2-Gehaltes der Atmosphäre bereits abgebaut worden ist.

Der deutsche Anteil an den 4,7 ppm/a (0 000 47%) in 2020 liegt bei kleiner 2%, also 0,09 ppm/a (0,000 009%), nicht messbar.

Zudem hat eine Darstellung der weltweiten anthropogenen CO2-Emissionen aller Länder von 1960 bis 2023 gezeigt, dass dieser Ausstoß ab etwa 2011 eine deutliche Abflachung erfährt bis hin zu einem leichte Abfall. Aber die gemessenen CO2-Gehalte der Atmosphäre zeigen nicht die geringsten Veränderungen. (8)

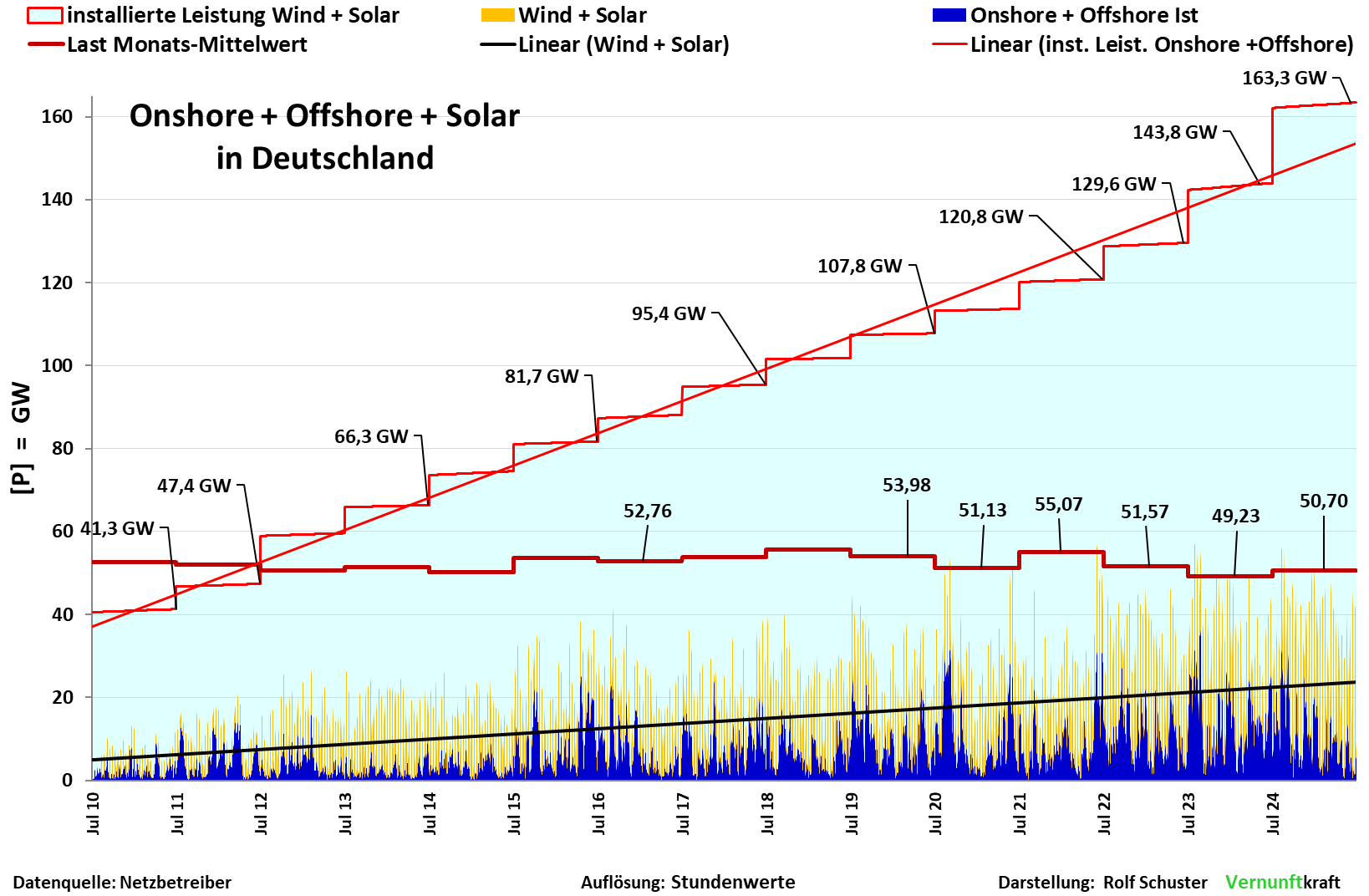

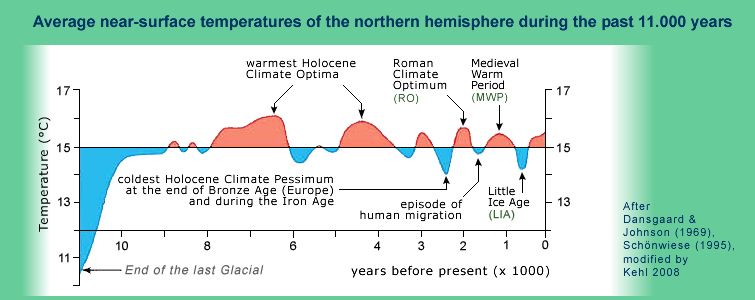

Schließlich muss sich das IPCC auch die Frage gefallen lassen, wieso nach der letzten Eiszeit ohne menschlichen Einfluss derartige Temperaturanstiege zustande kamen wie in Bild 6 aufgezeigt.

Bild 6: Warm- und Kaltphasen nach der letzten Eiszeit

Im Übrigen macht die Anwendung des CCS-Verfahrens zum Abbau der CO2-Gehalte der Atmosphäre keinen Sinn, da die CO2-Gehalte der Atmosphäre mit denen der Meere im Gleichgewicht stehen. (10)

Bei der geplanten Einstellung der Klimaneutralität in 2045 durch die Bundesregierung wird sich an den bisher gemachten Kostenabschätzungen für die Energiewende von bis zu 10 Billionen EURO wenig ändern. (7)

Vor diesem Hintergrund ist eine Rückbesinnung auf die Stromerzeugung über Braunkohle für 3-4 ct/KWh, etc. dringend geboten, das Gleiche gilt für die Kernenergie.

Nun sind wegen der hohen Energiepreise schon viele Industrien abgewandert und der Trend hält an.

Sollte Deutschland dem Weg der Einstellung der Klimaneutralität über Wasserstoff bis 2045 folgen – und das auch noch bei einem nicht messbarem Beitrag des deutschen CO2-Anteiles in der Atmosphäre – so wird die Abwanderung der Industrie aus Deutschland zu mittelalterlichen Verhältnissen führen. Die großen Verursacher der anthropogenen CO2-Emissionen wie China, Russland, USA, etc. sind von den abstrusen Vorstellungen der Deutschen weit entfernt.

Ungeachtet aller Fakten predigen die Ökoideologen und der Kommerz ihre Weltuntergangszenarien unverändert weiter – sie wissen um die Macht der Angst.

Quellen

1.Schuster, R.: Mitteilung vom 07.08.2024

2. Beppler, E.: „Eine Diskussion der zahlreichen Unzulänglichkeiten der Energiewende offenbart ein hoffnungsloses Debakel in Deutschland“; EIKE, 23.09.2024

3. www.Stromdaten.info

4. Beppler, E.: „Der vorgesehene Ausbau der alternativen Energien zur Absenkung der…“; EIKE, 21.10.2023

5. Schuster, R.: Mitteilung 01.03.2025

6. Beppler, E.: „Wieviel Wasserstoff erfordert die Klimaneutralität in 2045 auf dem Wege über 2030 und welche Energieverbräuche sind damit verknüpft“; EIKE, 30.06 2023

7. Prof. Andre Thess, Universität Stuttgart

8. Beppler, E.: „Die energiepolitische Geisterfahrt Deutschlands“; EIKE, 27.04.2024

9. Beppler, E.: „Quantifizierung der marginalen anthropogenen CO2-Gehalte der Atmosphäre – ein seit Jahrzehnten überfälliger Schritt“; EIKE, 16.12.2020

10. Beppler, E.: „Über allen Fakten zur Energiewende thronen Ideologie und der Kommerz, ungeachtet des beschleunigten Niederganges Deutschlands“; EIKE, 15.01 2025

11.Das Deindustrialisierungskonzept des Herrn Robert H., von F.Vahrenholt: EIKE,10.08.2024