Bericht zur Coronalage vom 22.04.2020 – worauf wartet die Politik?

Risikoanalyse

Ansteckungsgefahr

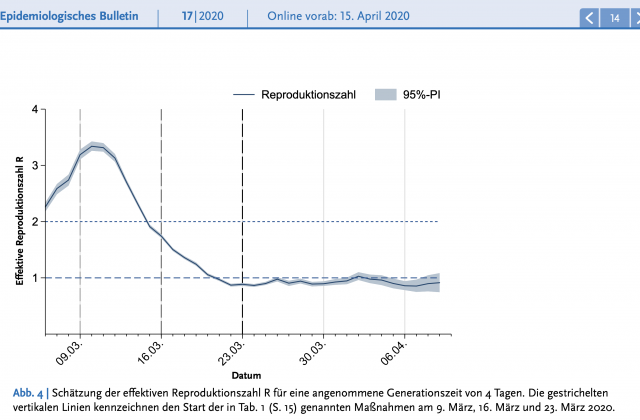

Nun ist es offiziell, der Reproduktionsfaktor R sank schon vor dem Shutdown unter 1. Das ist der Zeitpunkt, ab dem ein an Corona-Covid-19 Erkrankter durchschnittlich weniger als eine andere Person ansteckt. Laut einer Veröffentlichung des Robert-Koch-Instituts vom 15.4.2020 sank der R-Höchstwert bereits ab dem 11.3.2020 und liegt unter 1 seit dem 20.3.2020. Ab diesem Zeitpunkt, also drei Tage vor dem Shutdown, ist Covid-19 bereits im Abklingen. Damit hat der Shutdown keinen messbaren Einfluss auf die Infektionseindämmung. In diesem Beitrag werden jedoch jedoch noch weitere, brisante Erkenntnisse thematisiert.

Noch nicht offiziell ist die Zahl der Opfer des Shutdowns infolge des massiven Absinkens der Wirtschaftsleistung, des Anstieges der Arbeitslosenzahl, von häuslicher Gewalt, der eingeschränkten medizinischen Versorgung, der Belastung für die internationalen Beziehungen sowie der Beschädigung des Rechtsstaates. Sie werden jedoch – die Prognose sei erlaubt – gewaltig sein. Niemand wird die Zahl messen an Opfern des Shutdowns in den Entwicklungsländern, die aufgrund ausbleibenden Tourismus und Wirtschaftsaufträge buchstäblich vor dem Nichts stehen, nichts zu essen haben und die kein Sozialnetz auffängt.

Doch der Reihe nach. Heute geht es um die Entwicklung und die Versäumnisse bezüglich des epidemiologischen Wissens seit Beginn der Coronakrise. In einem Folgebeitrag erkläre ich Ihnen etwas später, warum wir jetzt, da es genügend Erfahrung in Deutschland mit der Krankheit selbst gibt, auf erfahrene Praktiker hören sollten. In komplexen Situationen ist deren reflektierte Gefühlseinschätzung reiner Statistik oft sogar überlegen. Deshalb kommen in einem Folgebeitrag vor allem führende Lungenärzte und Pathologen zu Wort. Erst beides zusammen, Daten und Erfahrung, ergeben ein belastbares Gesamtbild.

Was wir in dieser langsam wirklich dramatischen Situation ganz bestimmt nicht mehr brauchen, sind Modellberechner wie den Briten Neil Ferguson, die an einem Zahlenrädchen drehen und die wahrscheinliche Totenzahl eines Landes mal eben von 500.000 auf 20.000 herunterrechnen und immer noch in Talkshows Panik schüren. Das ist inzwischen nur noch lächerlich.

Ab wann ist eine Krankheit gefährlich für die Gesamtbevölkerung?

Jede schwere Krankheit, an der wir erkranken, ist für den Betroffenen gefährlich oder gar tödlich. Um die Gefährlichkeit in Bezug auf die Gesamtbevölkerung zu beurteilen, müssen zuvor zwei Fragenkomplexe geklärt werden:

- Wie schwer ist die Krankheit, wer ist davon betroffen, hinterlässt sie Folgeschäden und kann man daran sterben?

- Wie bekommt man diese Krankheit und wie viele Menschen können daran erkranken?

Der erste Fragenkomplex wird am besten beantwortet von den zur Krankheit passenden Fachtherapeuten und Pathologen, die damit Erfahrung sammeln konnten.

Der zweite Fragekomplex fällt in das Gebiet der Epidemiologie und im Falle einer Infektion auch der Immunologie. Primär nicht in das Fachgebiet der Virologen. Eine Ausnahme sind die Forschungen von Prof. Hendrik Streeck, der sich vor allem mit Ansteckungswegen eines Virus befasst. Professor Christian Drosten ist dagegen Spezialist für die Beschaffenheit des Virus selbst, woraus sich Nachweistests oder auch Impfstoffe ableiten lassen. Für die Beurteilung der Gefährlichkeit eines Virus ist er, rein fachlich gesehen, gar nicht zuständig.

Erst nach Klärung dieser zwei Fragenkomplexe, kann man eine belastbare Risikoeinschätzung vornehmen und die Gegenmaßnahmen gegenüber ihren Nebenwirkungen in ihrer Verhältnismäßigkeit beurteilen. Dabei gilt: Je belastbarer die Daten- und die Erfahrungslage, desto sicherer kann man sich dabei sein.

Wahlumfrage, Wahlprognose und erste Hochrechnungen

Fangen wir mit dem zweiten Fragekomplex an, der Domäne der Epidemiologie, also der Statistik und Zahlendeutung. Die meisten von Ihnen kennen das Spiel vor Wahlen. Wochen vor der Wahl werden Umfragen veröffentlicht, die oft, aber nicht immer, dem tatsächlichen Ergebnis nahekommen. Am Wahltag gibt es um 18 Uhr die Wahlprognose, sie beruht auf Befragung von Wählern, nachdem sie tatsächlich gewählt haben. Aber auch hier kommt es immer wieder vor, dass die Prognose vom späteren Ergebnis abweicht. Erst die Hochrechnung beruht auf der tatsächlichen Auszählung von Wählerstimmen, und sie stimmt meist mit dem späteren Gesamtergebnis bis auf wenige Zehntel überein.

Am Anfang herrschte Unklarheit

Seit dem 12. März schreibe ich auf Achgut.com regelmäßige Beiträge zur Coronalage, dies hier ist der zwölfte. Am Anfang vor allem noch unter dem emotionalen Eindruck der schrecklichen Berichte aus Italien und aus mangelnder Erfahrung mit dieser Erkrankung in Deutschland selbst (zu diesem Zeitpunkt 1.656 Fälle mit 3 Toten) schrieb ich, dass man aufgrund der unklaren Lage das Verbieten von Großveranstaltungen nicht kritisieren sollte, jedoch der folgenden Prämisse „Wenn es Grund zu einer Entwarnung gibt, sollte jedoch nicht damit gezögert werden. Auch wirtschaftliche Notzeiten fordern Todesopfer.“

Doch sehr schnell wurde deutlich, es gibt eine klare Risikogruppe, die jedoch in den Altersheimen und der ambulanten Pflege nicht professionell vor Ansteckung geschützt wird. Damit war die Marschrichtung eines verantwortungsethischen Vorgehens vorgegeben, kein kompletter Shutdown für alle, sondern Konzentration auf die Risikogruppe, aber das mit allen Registern, finanziell, professionell und fantasievoll human. Alle Einwände dagegen verblassen bei näherer Betrachtung. Es kam anders.

Außerdem beschrieb ich am 17. März die ersten Einschätzungen von führenden Epidemiologien, die zwar das Fehlen repräsentativer Daten bemängelten, aber erste Rückschlüsse beispielsweise vom Krankheitsverlauf auf dem Kreuzfahrschiff Diamant Princess zogen und damit die hohen Sterblichkeitsprognosen doch deutlich niedriger einstufen konnten.

Erste Prognosen

Gleichzeitig gab es in anderen Ländern erste repräsentative Studien zur Krankheitsverteilung, die dem Virus etwas von seinem Schrecken nahmen, gut zusammengefasst hier. Auffallend war zu diesem Zeitpunkt die Passivität des Robert-Koch-Instituts (RKI), welches überhaupt keine Anstrengungen erkennen ließ, eigene repräsentative Studien mit Tests durchzuführen. Sowie Verlautbarungen überpräsenter Virologen, die weiter Horrorzahlen prognostizierten, aber eben nicht auf dieses unverzeihliche Versäumnis des RKI hinwiesen.

Lediglich in Nordrhein-Westfallen, als das neben Bayern am meisten betroffene Bundesland, ergriff endlich ein junger Virologe namens Hendrik Streeck die Initiative, um erste belastbare Studien durchzuführen, unter ausdrücklicher Unterstützung der Landesregierung. Während die obigen Arbeitsverweigerer in wohlfeiler Weise nichts anderes zu tun hatten, diese Anstrengungen mit teils fadenscheinigen Argumenten zu kritisieren(was die Regierung nicht davon abhält, deren Verhalten mit enormen Forschungsgeldern zu belohnen, unter Auslassung der üblichen Antragswege). Mit den Ergebnissen von Hendrik Streeck ergab sich sicherer Spielraum, den Shutdown nicht durchzuführen, weil er als Erster anhand Messungen in Deutschland klar auf eine viel geringere Sterblichkeit durch Covid-19, als ursprünglich angenommen, hinweisen konnte und gleichzeitig die Risikogruppe der Schwervorerkrankten, meist alten Menschen, bestätigte. Damit befanden wir uns bezüglich Prognosesicherheit quasi schon auf dem Niveau von Wahlprognosen.

Hochrechnungen

Doch nun liegen belastbare Auswirkungen bezüglich der Gesamtlage in Deutschland vor, veröffentlicht in der Fachzeitschrift des RKI Epidemiologisches Bulletin am 15. April 2020. Das RKI berechnet, ausgehend vom Datum des Eingangs positiver Testergebnisse, das tatsächliche Infektionsdatum und schließt so auf die Zahl der gerade frisch Infizierten pro Datum. Außerdem finden sich Berechnungen des eingangs beschriebenen Reproduktionsfaktors R. Jetzt befinden wir uns auf dem Niveau einer Hochrechnung. Sie können sich sicher sein, dass nun Heerscharen von PR-Spezialisten versuchen werden, die Deutungshoheit über diese wissenschaftliche Veröffentlichung zu erlangen. Denn sie ist brisant, hochbrisant. Als Kritiker und Autor medizinischer Leitlinien habe ich über 20 Jahre lang Erfahrung darin, Studien so zu lesen, dass man die Absicht oder den Druck, dem Auftraggeber zu gefallen, erkennt und dann den tatsächlichen Erkenntnisgewinn, oft erst auf den zweiten Blick, identifiziert.

Auf den ersten Blick scheint der Beitrag im Epidemiologischen Bulletin des RKI den Nutzen des Regierungshandelns zu bestätigen. Punktgenau, meiner Erfahrung nach zu punktgenau, ergeben sich Verbesserungen der Infektionszahlen genau ab dem Zeitpunkt der von der Regierung veranlassten Einschränkungen (Seite 13, Abbildung 3). Meiner Meinung nach wirkt dies geschönt, zum Beispiel sehe ich nicht, dass die Zeitspanne berücksichtigt wurde, in der vom Auftreten ernster Symptome bis zum Test oft mehrere Tage vergingen.

Quelle: Epidemiologisches Bulletin 17 | 2020 Online vorab: 15. April 2020

Doch das ist gar nicht die entscheidende Kurve. Die findet sich auf Seite 14 in Abbildung 4. Sie zeigt das Absinken der Zahl R ab dem 10. März und das Fallen unter 1 ab dem 20. März, drei Tage vor dem Shutdown. Danach bleibt er konstant unter 1, ohne weiter zu fallen. Diese Konstanz wird inzwischen als Begründung benutzt, den Shutdown weiter aufrechtzuerhalten, weil R sonst wieder ansteigen könnte, so die Bundeskanzlerin Angela Merkel. Doch lesen Sie nun, was das RKI als eigentliche Ursache dafür ansieht, warum der R-Wert konstant bleibt und nicht noch weiter fällt:

„Ein Grund dafür, dass der Rückgang der Neuerkrankungen trotz der gravierenden Maßnahmen nur relativ langsam passiert, ist, dass sich das Virus nach dem 18. März stärker auch unter älteren Menschen ausbreitet und wir zunehmend auch Ausbrüche in Pflegeheimen und Krankenhäusern beobachten. Ein weiterer Aspekt ist aber auch, dass in Deutschland die Testkapazitäten deutlich erhöht worden sind und durch stärkeres Testen ein insgesamt größerer Teil der Infektionen sichtbar wird. Dieser strukturelle Effekt und der dadurch bedingte Anstieg der Meldezahlen, kann dazu führen, dass der aktuelle R-Wert das reale Geschehen etwas überschätzt“

Nein, nicht etwas, sondern ganz sicher deutlich. Das Zitat besagt schwarz auf weiß: Die Regierung hat es versäumt, die Risikogruppen in den Altersheimen (und im Rahmen der ambulante Pflegeversorgung) professionell zu schützen und zwar so. Zweitens wird hier in aller Klarheit die Aussage gemacht, dass viel zu spät damit begonnen wurde, umfangreich und repräsentativ zu testen. Hätte man es gemacht, dann würde man hochwahrscheinlich jetzt eine viel niedrigere Zahl R errechnen können.

Analog zu einer Schulnote würde damit die Regierung für ihr Handeln die Note 5–6 erhalten. Denn in frühen, vernünftigen Prognosen und späteren belastbaren Hinweisen wurde genau das bestätigt, was schon ganz zu Anfang als der beste Weg vorgegeben war. Es fällt mir wirklich schwer, sachlich zu bleiben, wenn ich mein Unverständnis darüber ausdrücke, warum aufgrund dieser Erkenntnisse der Shutdown nicht umgehend beendet wird und die Anstrengungen zum Schutz der Risikogruppen endlich professionell durchgeführt werden.

Studie aus Israel

Professor Yitzhak Ben-Israel ist Mathematiker und Physiker von der Universität Tel Aviv und kennt sich gut aus mit sicherheitspolitischen Studien. Er hat sich den Verlauf der gemeldeten Covid-19-Fälle in verschiedenen Ländern vorgenommen (USA, Grossbritannien, Schweden, Italien, Israel, Schweiz, Frankreich, Deutschland und Spanien) und eine erstaunliche Parallele festgestellt. Die Erkrankungszahl steigt in jedem Land exponentiell bis zum 40. Tag an, um dann steil abzufallen. Nach 8 Wochen ist sie dann am Abklingen. Und zwar völlig unabhängig ohne, während oder, wie in Deutschland, vor einem Shutdown. Ob Shutdown oder nicht, oder wie konsequent die Quarantäne – all dies hatte keinen Einfluss auf den Ausbreitungsverlauf und dessen Abklingen. Eine Erklärung dafür hat er nicht, es könnte beispielsweise an der Jahreszeit liegen oder in der Natur des Virus selbst.

Hier die Arbeit auf der Webseite der Times of Israel mit den Kurvengrafiken. Und hier ein übersetztes Interview auf Englisch.

Natürlich wird man auch diese Arbeit kritisieren. Natürlich rechnet auch Professor Ben-Israel nur mit den gemeldeten Fällen und nicht der tatsächlichen Zahl der Infizierten, die ja keiner kennt. Der entscheidende Punkt ist jedoch die auffallende Parallelität der Beobachtung, die man nicht einfach wegdiskutieren kann. Das bedeutet, er kann keine Aussage zu der Zahl der Erkrankungen machen, aber sehr wohl bezüglich ihrer Dynamik.

Auf was warten die Verantwortlichen des Shutdowns eigentlich, um ihn zu beenden? Die Absolution durch die Göttin der totalen Wahrheit. Die gibt es nicht. Es gibt nur eine verantwortungsethische Risikoabwägung, und die besagt epidemiologisch schon längst, dass die Aufhebung mit weniger Risiken verbunden ist, als es das Fortführen in der Gesamtbetrachtung ist. Ganz davon abgesehen, dass der Shutdown das Risiko einer zweiten Welle erhöht, weil sich beispielsweise die Schulkinder nicht immunisieren können. Jedoch ist die unzweifelhafte Basis aller guten Strategien der professionelle Schutz der Risikogruppen, der immer noch im Argen liegt.

Zwischenfazit:

Nach Auswertung der zur Verfügung stehenden Daten ist Corona-Covid-19 eine sich epidemisch ausbreitende Infektion, die den Höhepunkt ihres exponentiellen Wachstums in Deutschland um den 10. März herum erreichte. Seitdem ging das exponentielle Wachstum zurück (Abflachung der Kurve), um ab dem 20. März unter den Wert R 1 zu fallen. Damit ist die Epidemie am Abklingen. Die Zahlen lassen ziemlich eindeutig erkennen, dass das Abflachen und Abklingen nichts mit den vor der Regierung beschlossenen Maßnahmen zu tun hatten. Im Gegenteil wurde es versäumt, genau die Maßnahmen einzuleiten, die es tatsächlich geschafft hätten, die Zahl R viel früher und viel stärker unter 1 sinken zu lassen. Dazu gehört in erster Linie der professionelle Schutz der Risikogruppen sowie frühe, repräsentative Testungen.

Damit sind wir aber erst bei der Hälfte einer aktuellen, umfassenden und kompetenten Risikoeinschätzung angelangt. Der zweite Teil dieses Beitrages folgt in wenigen Tagen. Dann sprechen die Praktiker.