Windenergie in der Krise – Teil 1: In Deutschland stockt der Ausbau

von Alex Reichmuth; Nebelspalter

Die deutsche Windkraftbranche muss Rückschlag um Rückschlag hinnehmen. Es werden kaum mehr neue Turbinen gebaut, und immer mehr alte Windräder fallen aus der Förderung. Jetzt fordern Windenergie-Lobbyisten, die Regeln für Neubauten zu lockern.

Im Freistaat Bayern läuft fast gar nichts mehr in Sachen Windkraft. Gemäss einem Bericht des bayerischen Wirtschaftsministeriums ist der Ausbau seit einigen Jahren nahezu null. Der Anteil der Windenergie an der Stromproduktion ist inzwischen sogar rückläufig. «Die Windkraft ist in Bayern mausetot«» beklagte sich der Grünen-Politiker Martin Stümpfig.

Der bayerische Ministerpräsident Markus Söder hatte 2019 noch versprochen, in den Staatswäldern hundert neue Windräder aufstellen zu lassen. Aber laut dem Wirtschaftsministerium ist bisher noch kein einziger Antrag für ein solches Windrad eingegangen. Die Grünen fordern darum, die sogenannte 10H-Regel abzuschaffen, wonach der× Abstand zwischen neuen Windrädern und der nächsten Wohnsiedlung das Zehnfache der Anlagenhöhe betragen muss. Moderne Windräder sind 200 Meter hoch, was einen Abstand von zwei Kilometern nötig macht. Das verunmöglicht viele Projekte.

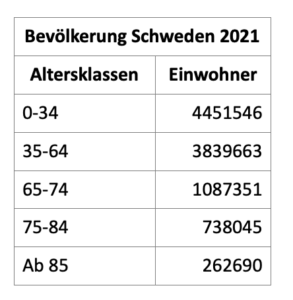

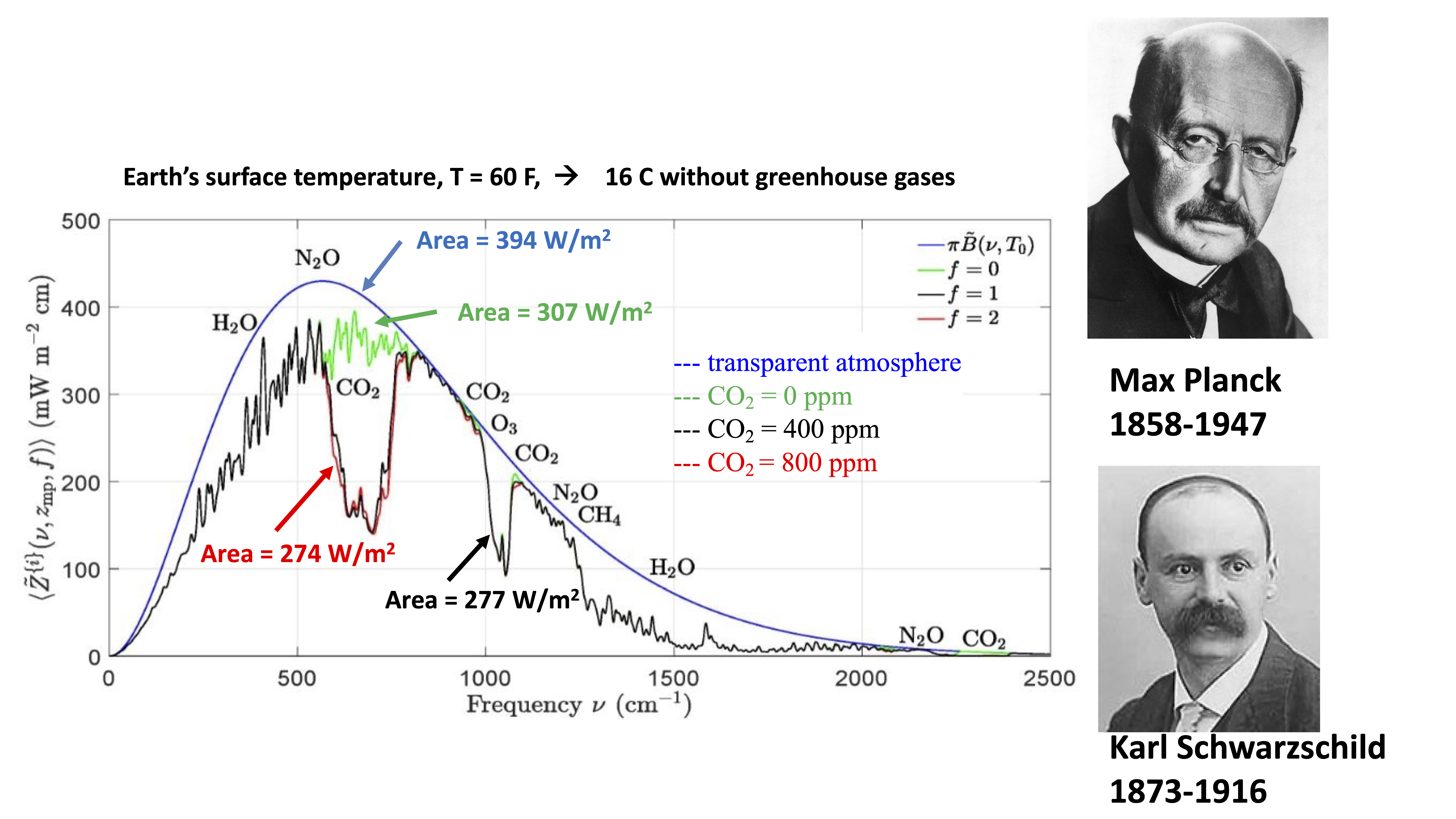

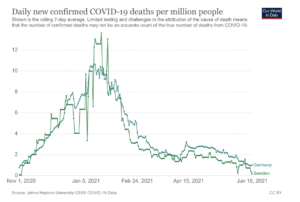

Die installierte Windenergieleistung in Deutschland ist zuletzt kaum mehr gestiegen. Quelle: Windguard

Windenergie Deutschland Zuwachs. Quelle Windguard.PNG

Auch bundesweit ist der Ausbau der Windenergie ins Stocken geraten. 2016 wurden in Deutschland 4625 Megawatt (MW) an neuen Windkraft-Kapazitäten installiert, 2017 sogar 5334 MW. Das entspricht vier bis fünf grossen Kohlekraftwerken. 2018 fiel der Ausbau auf 2402 MW, 2019 sogar auf nur noch 1078 MW. Auch letztes Jahr lag die neu installierte Leistung mit 1431 MW weit unter dem Ziel der Bundesregierung von jährlich 2800 MW neuer Windkraft-Leistung (siehe Grafik).

Enorme Gegenwehr der Bevölkerung

Langwierige Planungs- und Genehmigungsverfahren stehen dem Ausbau der Windenergie im Weg. Es gibt zu wenig ausgewiesene Flächen für mögliche Standorte und zu viele Klagen gegen Projekte. Der Widerstand gegen den Bau von Windkraftanlagen ist an vielen Orten enorm. Unzählige Naturschutzgruppierungen und Bürgerinitiativen sehen die Landschaft× beeinträchtigt, die Gesundheit bedroht oder seltene Vögel in Gefahr und kämpfen mit allen Mitteln gegen neue Windräder. Oft sind auch die politischen Spitzen von Kommunen und Ländern gegen Lockerungen bei der Ausscheidung von Windkraft-Standorten.

Erschwerend für die Zukunft der Windenergie kommt dazu, dass vielen Anlagen die Abschaltung droht. Denn das deutsche Erneuerbare-Energien-Gesetz, das seit 2000 in Kraft ist, sichert den Betreibern von Windanlagen während zwanzig Jahren eine sichere Vergütung zu. Für tausende Anlagen läuft diese Frist in den nächsten Jahren aus. Dann sind sie nicht mehr profitabel. Bis 2025 drohen darum 15’000 MW Leistung wegzufallen, was über einem Viertel der in Deutschland installierten Windleistung an Land entspricht.

Bis 2025 drohen 15’000 MW Leistung wegzufallen, was über einem Viertel der in Deutschland

installierten Windleistung an Land entspricht.

Technisch wäre ein Weiterbetrieb zwar auch nach 20 Jahren möglich. Aber ohne gesicherte Entschädigung fällt es vielen Anlagebetreibern schwer, sich am Markt zu behaupten. Beim derzeit niedrigen Preisniveau für Strom sind sie kaum wettbewerbsfähig. Schon gibt es Appelle an die Bundesregierung, finanzielle Mittel zu sprechen, um die Anlagen weiter laufen zu lassen.

«Wir steuern auf eine Katastrophe zu»

Im Bundesland Niedersachsen stehen besonders viele Windräder. Olaf Lies, der Energie- und Umweltminister, hat ermitteln lassen, in welchem Umfang Windkraft-Kapazitäten in Niedersachsen ersatzlos vom Netz gehen könnten, weil die Einspeisevergütung für Strom nach 20 Jahren Betrieb endet. Es sind bis 2025 etwa 3500 Windräder mit einer totalen Leistung von 4300 MW. «Wir steuern auf eine Katastrophe zu», sagte Lies gegenüber dem «Handelsblatt».

Er appellierte an Bundeswirtschaftsminister Peter Altmaier, sich intensiver um die erneuerbaren Energien zu kümmern. «Wenn der Bund nicht die Reissleine zieht, steht Deutschland vor einem gigantischen Rückbau von Windenergie mit allen Folgen für eine beseitigen. Repowering bedeutet, alte Anlagen durch neue, leistungsstärkere zu ersetzen.× CO2-freie Stromerzeugung», so Lies. Er möchte insbesondere die Hürden für das Repowering verringern.

Dieses Repowering scheitert heute oft an Höhenbegrenzungen für neue Anlagen, sowie an Vorgaben des Arten- und des Immissionsschutzes. «Wir fordern eine nationale Repoweringstrategie, die die dringend benötigten Bestandsflächen sichert und erhält sowie Genehmigungen für Vorhaben vereinfacht und beschleunigt», sagte Hermann Albers, Präsident des Bundesverbands Windenergie, gegenüber dem «Handelsblatt».

«Wenn der Bund nicht die Reissleine zieht, steht Deutschland vor einem gigantischen Rückbau von Windenergie mit allen Folgen für eine CO2-freie Stromerzeugung.»

Olaf Lies, Energie- und Umweltminster Niedersachsen

Generell verlangt die Windkraft-Lobby Lockerungen bei den Vorschriften für den Bau neuer Anlagen. So sollen mehr Zonen für Windkraftanlagen ausgeschieden werden, auch im Wald. Unter Beschuss sind zudem die Regeln, wie weit Anlagen von bewohntem Gebiet entfernt sein müssen.

Kampf um Mindestabstände

So plant die Regierung des Bundeslandes Hessen, zwei Prozent der Landesfläche zu Windvorranggebieten zu erklären. Das hätte gravierende Folgen für die letzten ungestörten Wälder und das Landschaftsbild, heisst es beim hessischen Verband Naturschutz-Initiative. Vor allem die Errichtung von Windkraftanlagen im weitläufigen Pfälzerwald bedeute «einen weiteren Tabubruch der rot-grün-gelben Koalition zugunsten der Windkraftindustrie».

Im Bundesland Nordrhein-Westfalen tobt ein Kampf um Abstandsregeln. Eine von der Landesregierung vorgesehene Regelung sieht einen Mindestabstand von tausend Metern zu Wohngebieten vor. Die Kommunen könnten aber einen geringeren Abstand zu Windrädern zulassen. Die tausend Meter seien viel zu restriktiv, monieren grüne Politiker. Es sei «absehbar, dass viele Kommunen unter dem Druck einer lauten Minderheit den Mindestabstand auch zu Splittersiedlungen» nicht unterschreiten wollten, so die Grünen. Ob× die Landesregierung nachgibt, bleibt abzuwarten. Immerhin hat sie verkündet, die Kapazität der installierten Windkraftanlagen in Nordrhein-Westfalen bis 2030 auf 10’500 Megawatt verdoppeln zu wollen.

Wegen eines «windarmen Frühjahrs» haben die fast

30.000 deutschen Windräder im ersten Quartal 2021 fast ein Drittel weniger Energie erzeugt als letztes Jahr.

Zu allem Ungemach für die Windkraft-Branche kommen jetzt auch noch schlechte Zahlen, was die Stromproduktion angeht. Wegen einem «windarmen Frühjahr» haben die fast 30’000 deutschen Windräder im ersten Quartal 2021 fast ein Drittel weniger Energie erzeugt als letztes Jahr, teilte das Statistische Amt mit. Es resultierte der niedrigste Wert seit 2018. Gefüllt wurde die Lücke durch eine höhere Stromerzeugung aus Kohle- und Erdgaskraftwerken. Kritiker der Energiewende, die vor der schwankenden Produktion erneuerbarer Energie warnen, sehen sich bestätigt.

Der Beitrag erschien zuerst im Nebelspalter hier

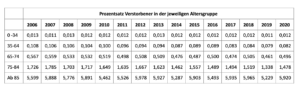

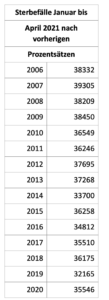

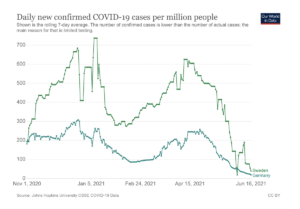

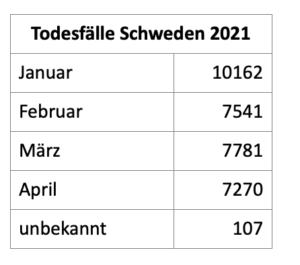

Einschließlich der 107 Todesfälle, die man keinem Monat zuordnen kann, sind insgesamt 32.861 Sterbefälle für die Zeit von Januar bis April zu verzeichnen. Für sich genommen, besagt diese Zahl wenig, solange man sie nicht vergleicht mit den Daten der schwedischen Sterbestatistiken vergangener Jahre. Das statistische Amt stellt

Einschließlich der 107 Todesfälle, die man keinem Monat zuordnen kann, sind insgesamt 32.861 Sterbefälle für die Zeit von Januar bis April zu verzeichnen. Für sich genommen, besagt diese Zahl wenig, solange man sie nicht vergleicht mit den Daten der schwedischen Sterbestatistiken vergangener Jahre. Das statistische Amt stellt