Wie Wohlstand und Zugriff auf billige jederzeit verfügbare Energie zusammenhängen

von Dr. Lutz Niemann

Unser Wohlstand wird begründet durch billige Energie zu jeder Zeit. Wir brauchen

1) täglich Nahrung, dazu

2) Wärme im Winter,

3) Arbeit zum Geldverdienen, um Pkt. 1 und 2 bezahlen zu können,

4) vieles anderes wie Mobilität, einige Wochen Urlaub,

5) …

In dieser Reihenfolge sind die Dinge nach ihrer Wichtigkeit einzuordnen. Punkt 1 ist zum Leben unersetzlich, das war schon immer so. Ohne Wärme im Winter wird es bei uns recht ungemütlich. Hoch droben im Himalaya gibt es auch heute noch Menschen, die den Winter ohne Heizung überstehen müssen.

Zu allem ist eine Energiequelle erforderlich. Mit Entdeckung der fossilen Energien und deren Nutzung durch Maschinen begann der Wohlstand auf der Welt. Die menschliche Arbeitskraft und die Kraft von Arbeitstieren in der Landwirtschaft wurden durch Maschinen ersetzt.

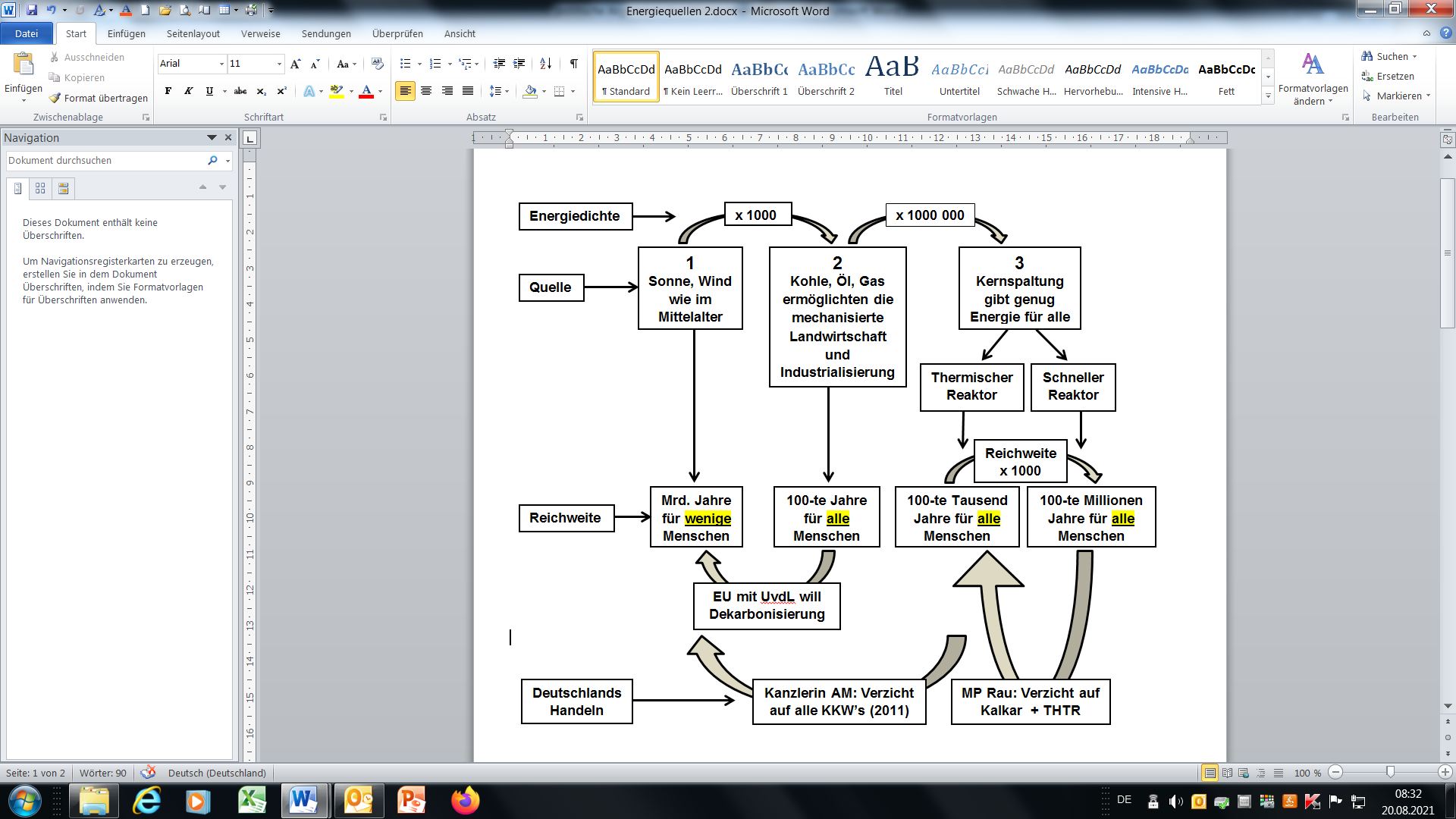

Es gibt grundsätzlich nur 3 Energiequellen, die zu unterscheiden sind:

- Die Sonne, sie wärmt uns direkt, deren Energie treibt die Windräder und Wasserkraftwerke an, Brennholz ist in kurzer Zeit gespeicherte Sonnenenergie. Dieses waren die Quellen im Mittelalter. Aber die Energiedichte ist gering. Es konnten in Deutschland nur wenige Millionen Menschen leben, es war ein ständiger Kampf unter körperlichem Einsatz fürs Essen und Wärme in Winter. Die einzige Maschine in der Landwirtschaft war der „Hafermotor“, sein Betrieb verbrauchte ein Großteil der Ernte.

- Die fossilen Quellen Kohle, Öl, Gas sind Sonnenenergie, die über Jahrmillionen gespeichert worden ist. Die Entdeckung dieser Quellen brachte die Industrialisierung, es wurden Maschinen erfunden, angefangen von der ersten Dampfmaschine in England bis zum Dieselmotor für den Pkw in Deutschland. Quälende körperliche Arbeit wurde verdrängt durch Maschinen, ein beachtlicher Schritt zu unserem heutigen Wohlstand. Aber die Lagerstätten für die fossilen Energien sind begrenzt. Beim Nordseeöl ist es heute längst zu sehen.

- Ein riesiger Schritt zu unbegrenzter Energie brachte die Entdeckung der Kernspaltung. Die im Atomkern gespeicherte Energie hat eine millionenfach höhere Dichte im Vergleich zu der in der Elektronenhülle der Atome gespeicherten chemischen Energie. Die Reichweite nimmt gigantisch zu.

Die wichtigsten Zusammenhänge sind hier dargestellt:

Deutschland rühmt sich, als einziges Land der Erde zunächst auf die Energie der Kernspaltung zu verzichten. Als nächstes treibt Deutschland über die EU mit dem Schlagwort „Dekarbonisierung“ den Ausstieg aus Kohle, Öl und Gas voran. Ist das alles mit einsichtigen Argumenten zu begründen???

Nein – dieser Schritt zurück ins Mittelalter durch die Politik mit seinen Folgen wird in deutschen Medien wie Zeitungen und öffentlich rechtlichen elektronischen Medien nicht diskutiert, nur in privaten Medien wie (hier).

Das wichtigste ist die Ernährung

Die Ernährung des Menschen ist nun einmal unverzichtbar. Ohne dieselbetriebene landwirtschaftliche Maschinen muß der Hafermotor wieder eingesetzt werden, wie es in der „guten alten Zeit“ war. Der Hafermotor verbraucht zu seinem Antrieb den größten Teil der erzeugten Nahrung, für den Menschen bleibt nur wenig übrig. E-Mobilität ist in der Landwirtschaft nicht möglich, denn mit batteriebetriebenen Traktoren kommt der Landwirt von seinem Hof gerade bis zu seinem Acker, dann ist die Batterie leer – und was dann??? Ohne die fossilen Energien ist die heutige Menschheit nicht zu ernähren. Der deutsche Schritt zurück ins Mittelalter erfordert die Rückführung der Wohnbevölkerung von 83 Millionen auf wenige Millionen Menschen (und Menschinnen). Wie soll das erreicht werden??? Die deutsche Politik schweigt dazu.

Exkurs zu den Möglichkeiten der Kernspaltungsenergie

Als durch die Arbeiten von Otto Hahn, Fritz Strassmann, Lise Meitner die Kernspaltung an Uran-235 entdeckt wurde, geschah die Spaltung mit thermischen Neutronen. Uran-235 ist nur mit einem geringen Anteil von 0,7% im Natururan enthalten, dadurch wird die Energieerzeugung aus Uran begrenzt. In den USA wurde sehr früh erkannt, daß sich mit schnellen Neutronen (1MeV) auch Uran-238 spalten lässt. Der Spaltquerschnitt ist zwar viel geringer, aber das lässt sich durch andere Maßnahmen beim Reaktorbau ausgleichen. Durch Schnelle Reaktoren kann 200-mal mehr Energie gewonnen werden und Thorium erweitert die Möglichkeiten nochmals.

Sehr wichtig: Wenn man die Möglichkeit von Schnellen Reaktoren berücksichtigt und auch die Nutzung von Thorium einbezieht, lässt sich die Reichweite der Energieversorgung durch Kernspaltung um den Faktor 1000 erhöhen: Aus Tausend Jahren werden dann Millionen Jahre.

Was macht die Politik aus diesen Möglichkeiten?

Die Möglichkeiten von Schnellen Reaktoren wurden natürlich auch in Deutschland und weiteren Industrieländern erkannt. In Deutschland wurden der Brüter SNR-300 in Kalkar (und der THTR in Hamm-Uentrop) erbaut. Beide wegweisenden Prototypen wurden von der Politik gekillt.

Heute ist Rußland bei Schnellen Reaktoren weltweit führend. Ein Reaktor doppelt so groß wie in Kalkar (der wieder abgerissen wurde) läuft in Rußland schon über 40 Jahre. China hat einen Vertrag mit Rußland, um die Schnelle-Reaktor-Technologie zu kaufen. Indien betreibt eigene Entwicklung.

Die USA haben im Oktober unter Trump ein Forschungsprogramm zum Einstieg in die Schnelle-Reaktor-Technik gestartet. Es bleibt abzuwarten, was die neue Führung unter den Demokraten daraus macht.

Wie sieht es mit den Reichweiten der Energiequellen aus?

Es ist absehbar, daß die fossilen Energien eines Tages zu Ende sind. Der peak-oil in der Nordsee ist längst überschritten worden. In den Niederlanden kommt das Ende der Gasvorräte in Sicht, daher beginnen die Niederländer mit der Diskussion zum Neubau von 10 Kernkraftwerken. Das Land könnte damit vollständig mit Strom und Heizwärme versorgt werden. Irgendwann wird es auch mit den riesigen Vorräten im Nahen Osten, Rußland, USA, Venezuela bergab gehen.

Kluge Länder sorgen vor, daher geht es mit dem Ausbau der Kernenergie weltweit bergauf (siehe hier, hier).

Deutschlands Führungsposition

Deutschland hatte sich nach dem 2-ten Weltkrieg aus den Ruinen in eine Führungsposition hinauf gearbeitet, indem es die sichersten Kernkraftwerke gebaut hat. Das wurde von der IAEA bestätigt.

Das Kernkraftwerk Grohnde hatte in diesem Jahre den Weltrekord von erzeugten 400 Milliarden kWh Strom erreicht, und es hatte 8 mal die Spitzenposition bei den top-ten der besten KKW’s bezüglich der Strommenge erreicht. Am Ende dieses Jahres soll es für immer abgeschaltet werden und nach politischer Vorgabe sofort für alle Zeiten unbrauchbar gemacht werden.

Ende des Jahres 2022 soll das Kernkraftwerk Isar 2 folgen, es war 9 mal Weltmeister und wird vielleicht auch die Marke von 400 Milliarden kWh Strom erreichen.

Diese Führungsposition in moderner Energiebereitstellung hat Deutschland aufgegeben. Heute ist es führend bei der Technik von Windmühlen, das ist Mittelalter.

Deutschland will tiefer hinein in die Sackgasse der Energiewende: Peter Altmaier (CDU) will Wind ausbauen auf 70GW (+10%) und Sonne ausbauen auf 100GW (+50%). Dazu kommen weitere unmögliche Pläne:

- E-Mobilität: Woher soll der Strom kommen? Bei Minusgraden funktionieren Batterien kaum noch.

- Wasserstoffwirtschaft: Welche der 3 oben genannten Quellen soll den Explosivstoff H2 liefern?

- Stromspeicherung funktioniert nur für Kleinanwendungen, nie für die großen erforderlichen Mengen.

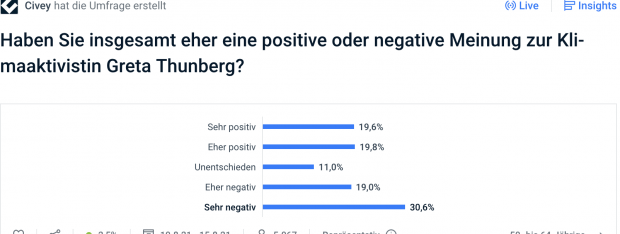

Die Wahlergebnisse zeigen, daß die Mehrheit der Deutschen die technischen Zusammenhänge nicht versteht.

Was ist zu tun?

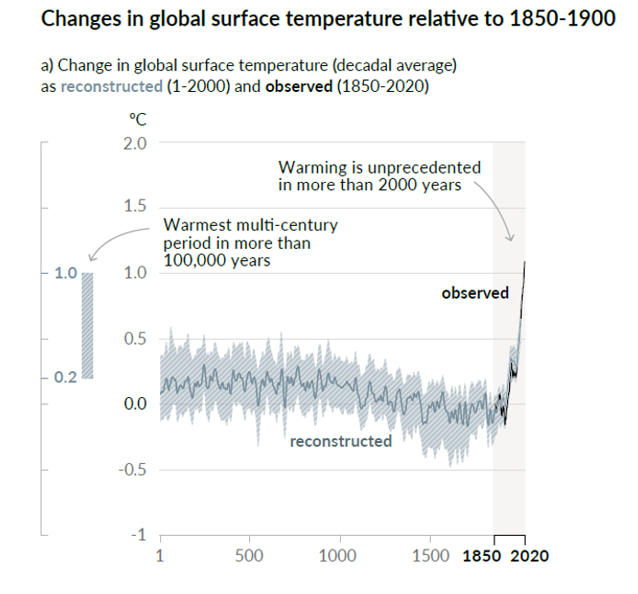

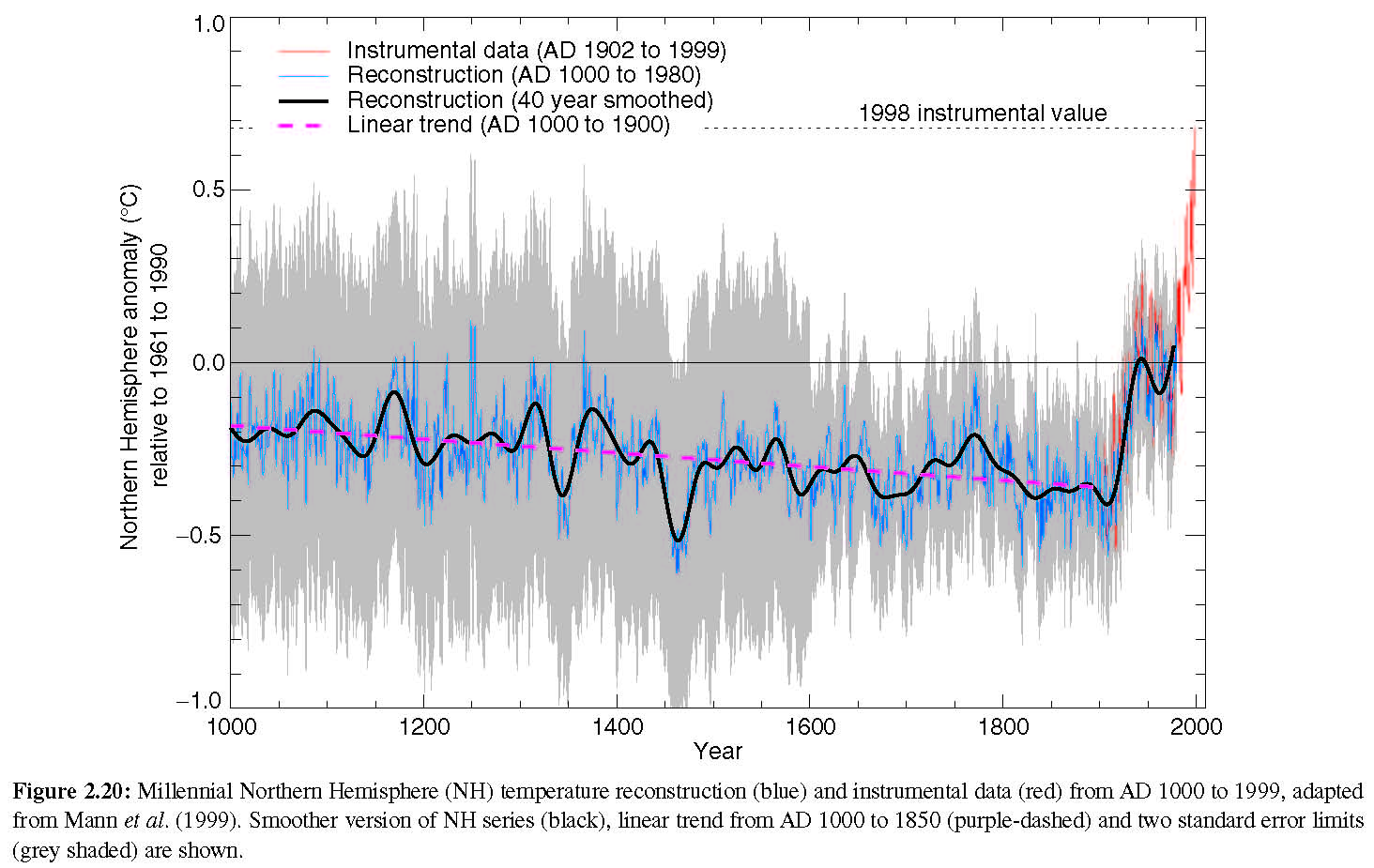

Es ist sinnvoll, fossile Energien zu sparen. Allerdings nicht wegen CO2 und Klima, weil CO2 keinen Einfluß auf die Wetterphänomene in der Atmosphäre hat. Fossile Energien sind unersetzlich für die Ernährung der Menschheit. Und sie sind unersetzlich für die Mobilität an Land und in der Luft. Für den Warenverkehr auf den Weltmeeren sind Kernreaktoren die beste Möglichkeit, das sollte genutzt werde. Im Winter können Häuser mit Kernstrom geheizt werden.

„Kernkraft ist eine der großartigsten Erfindungen der Menschheit“, das ignoriert Deutschland.

Erst wenn in Deutschland das Licht ausgeht — wird den Deutschen ein Licht aufgehen.