Klimarettung Plan A: Nichtstun, im Zweifel anpassen Teil 4

Mein verhindertes Video-Gespräch mit Prof. Gerd Ganteför

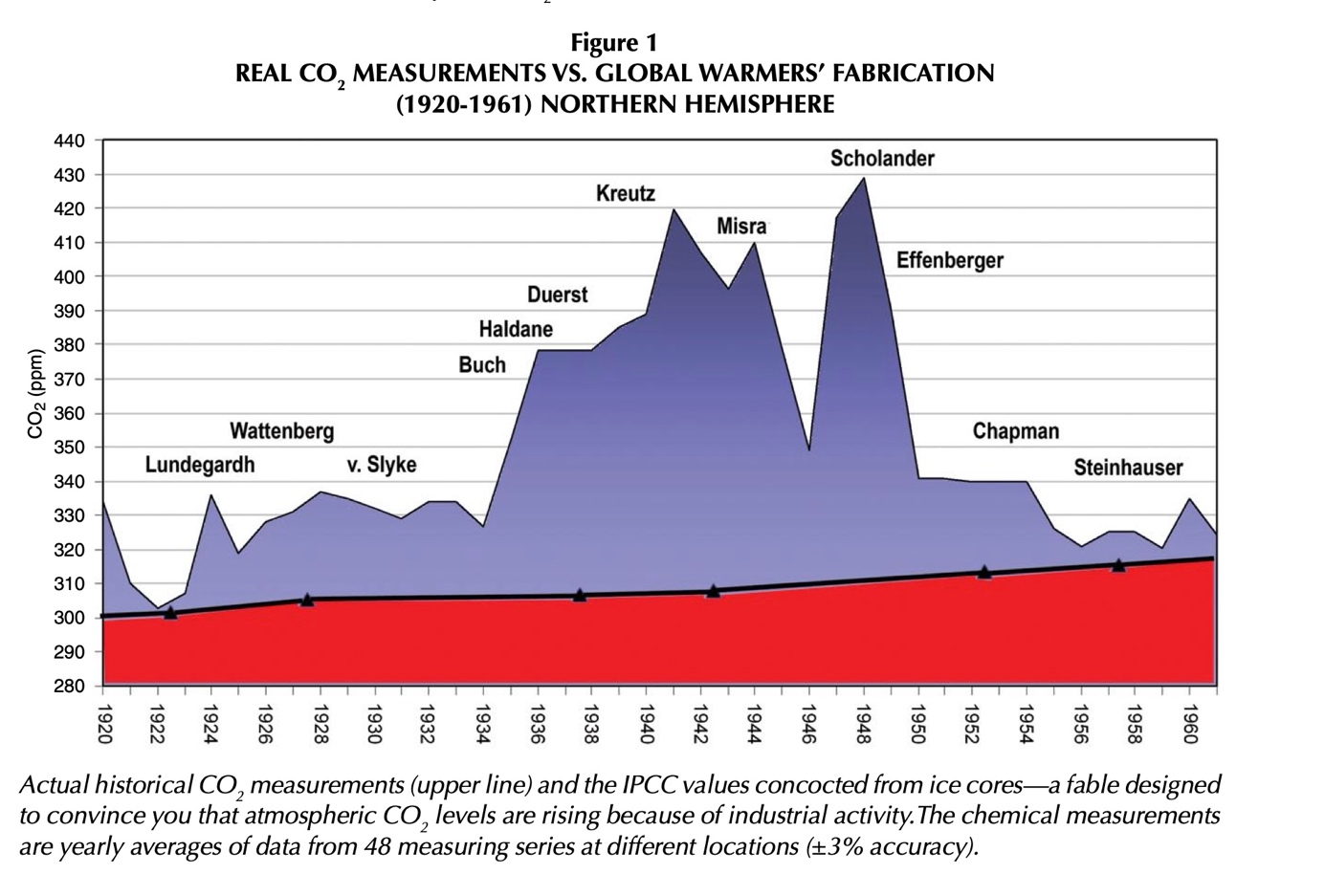

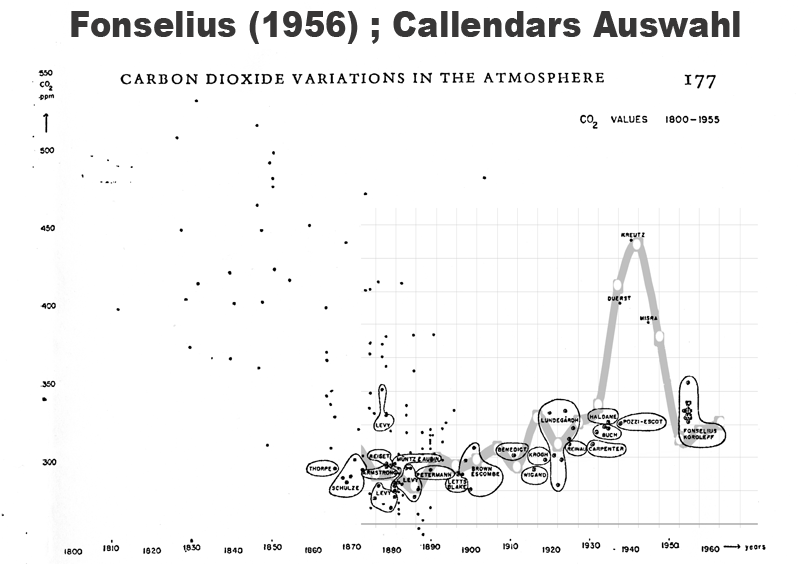

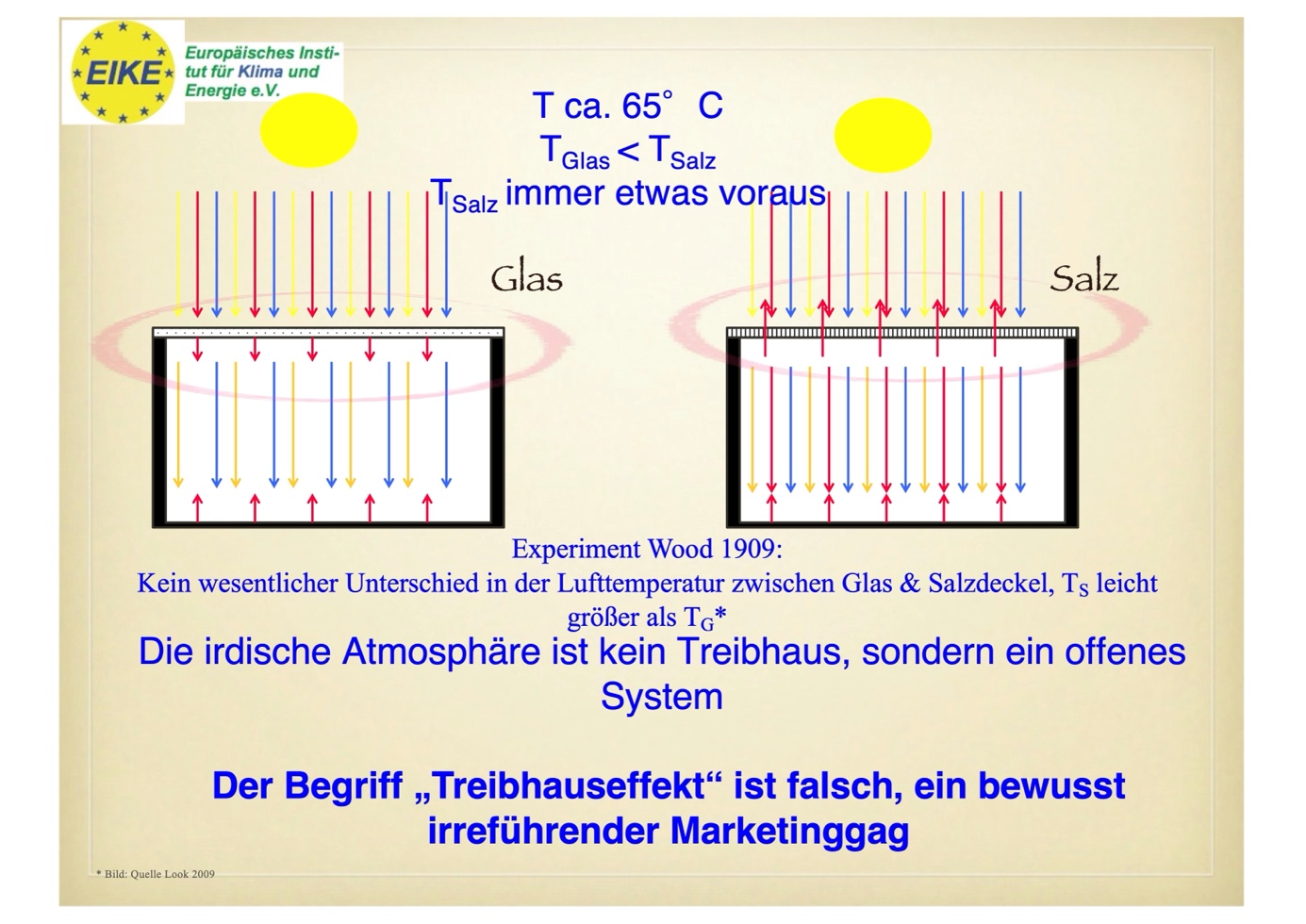

Die Treibhaushypothese wird Stück für Stück mit Beweisen, Fakten und Logik widerlegt. Das mag nicht jedem gefallen, ist aber, bis zum Gegenbeweis, korrekt. Es wird nachgewiesen, dass dieses nur hypothetische Gebäude – bildlich gesprochen- ein Fundament hat, was auf Sand ruht, der seinerseits im Sumpf liegt.

Von Michael Limburg

Videoausschnitt ca. 3 Minuten lang, aus dem Gespräch mit Herrn Model mit Prof. Gerd Ganteför, zum Thema Klimawandel und Treibhauseffekt. Von Herrn Model vorgestellt mit den Worten: „In dieser Folge im Modelhof begrüßen wir Prof. Dr. Gerd Ganteför – Physiker, Autor und einer der unbequemsten Stimmen in der Klimadebatte“. ALLE ZEITANGABEN IM FOLGENDEN BEZIEHEN SICH DAS HIESIGE VIDEO, FALLS DAS GELÖSCHT WERDEN SOLLTE IN KLAMMERN, AUF DAS ORIGINAL.

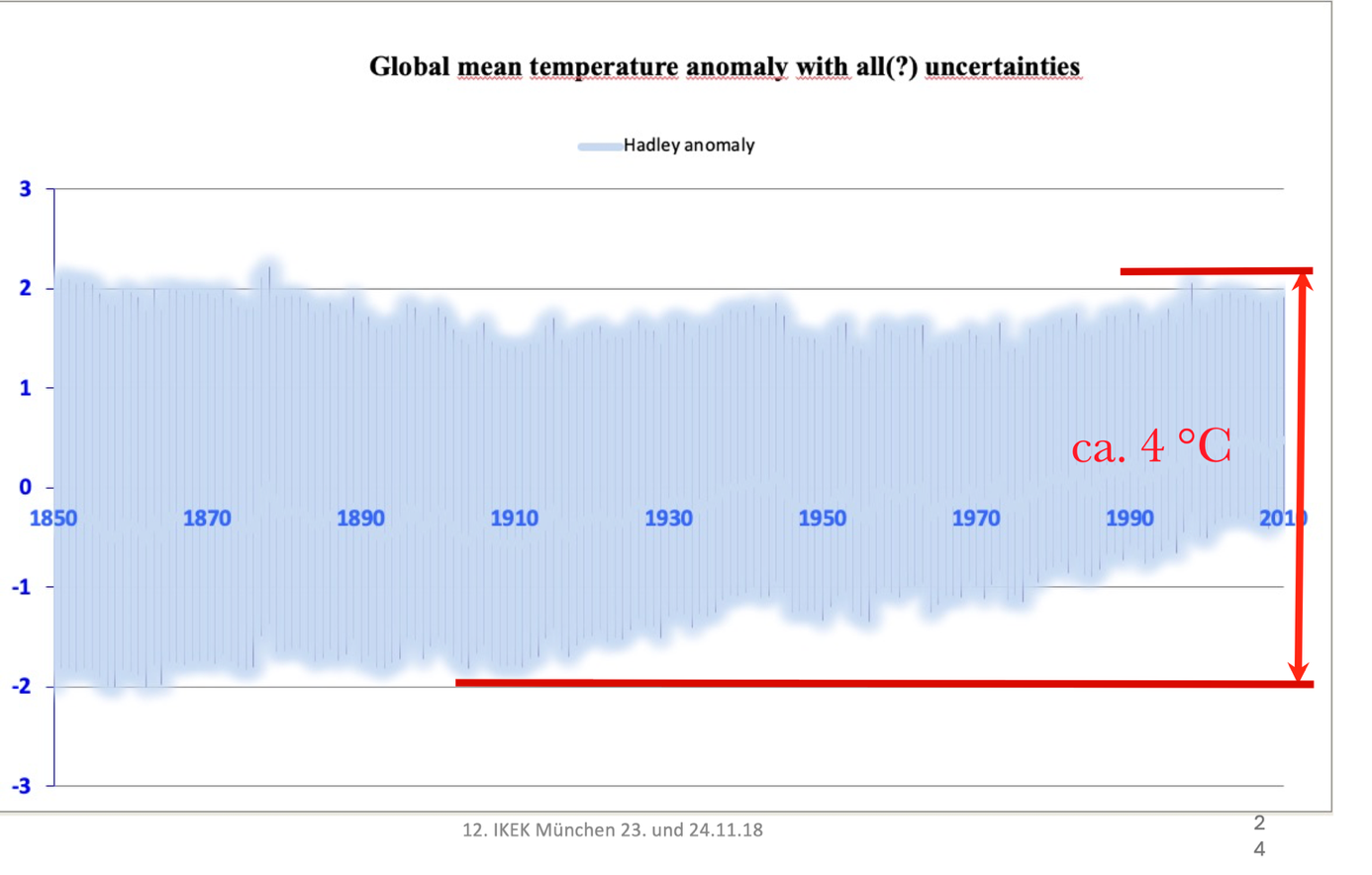

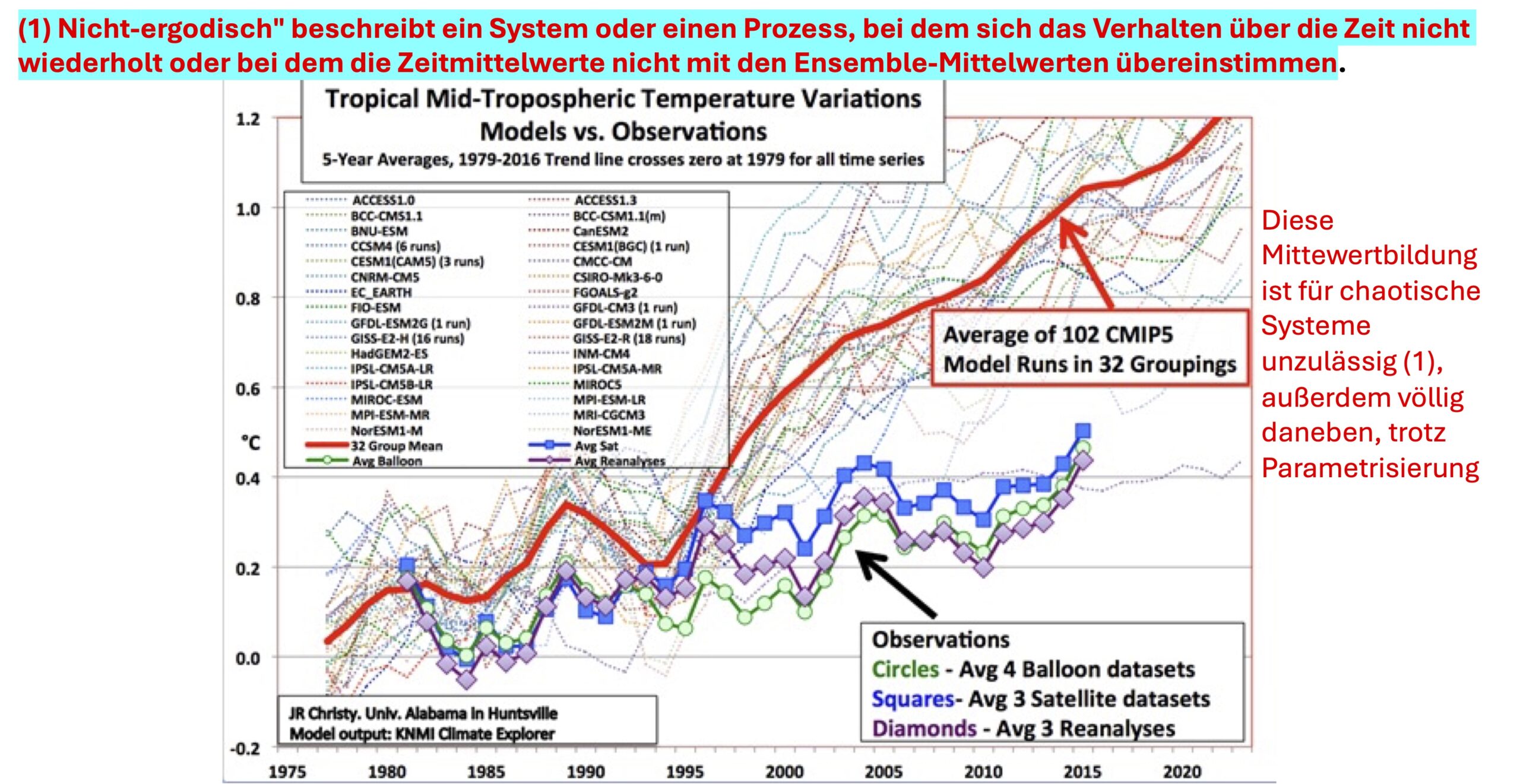

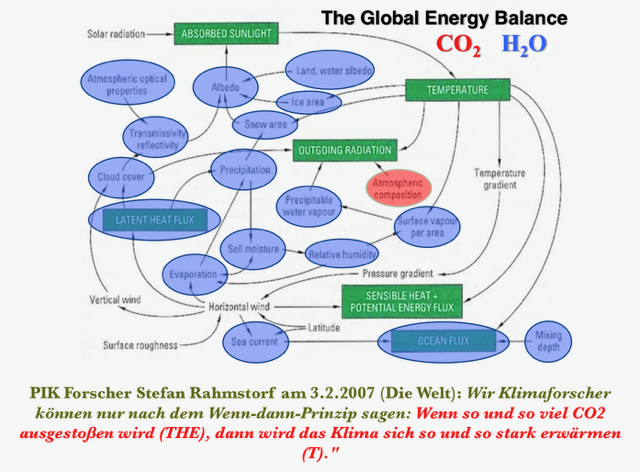

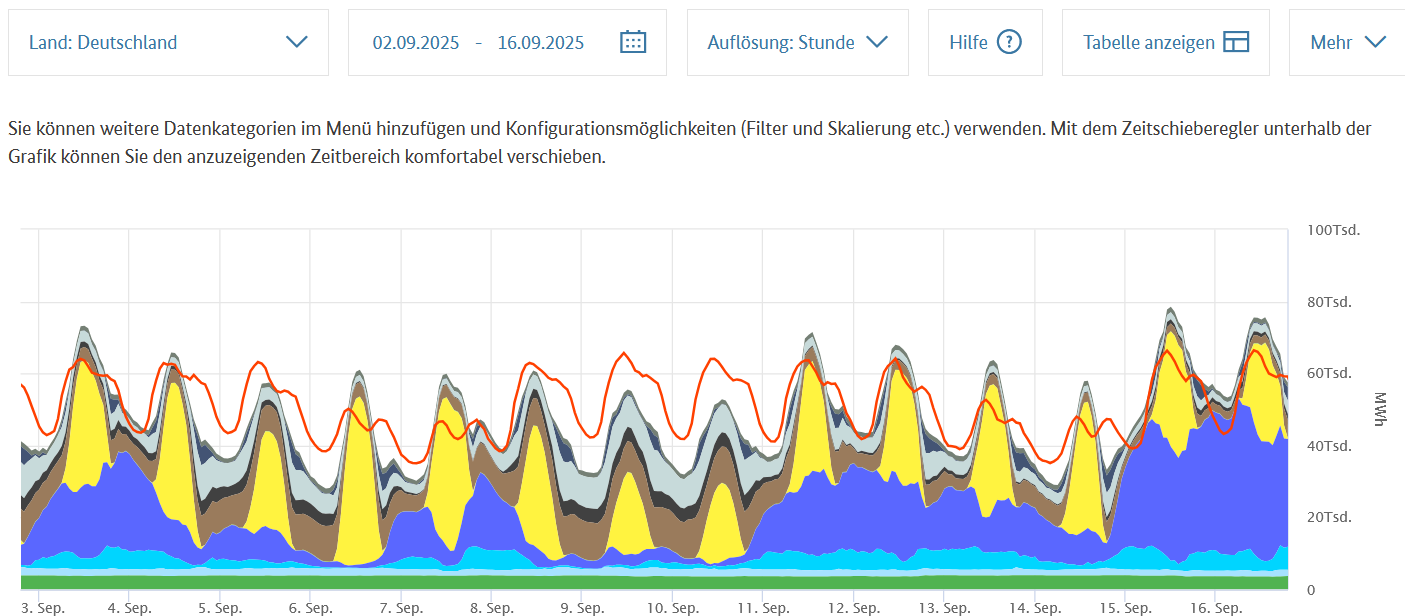

Anmerkung. Alle Klimamodelle bedienen sich der Gleichungen, die man zur Berechnung des Wetters verwendet. Im Normalfall läuft ein System über alle oder einen Teil der Gitterboxen der Erde über 20 Minuten. Damit die nicht „in den Wald laufen“, werden Parametrisierungen (so nennt man den Eingriff von Hand der Programmierer) vorgegeben, Das zwingt das Programm innerhalb bestimmter vorgegebener Grenzen zu bleiben. Niemand weiß, warum das Modell, das tut, aber es ist so.

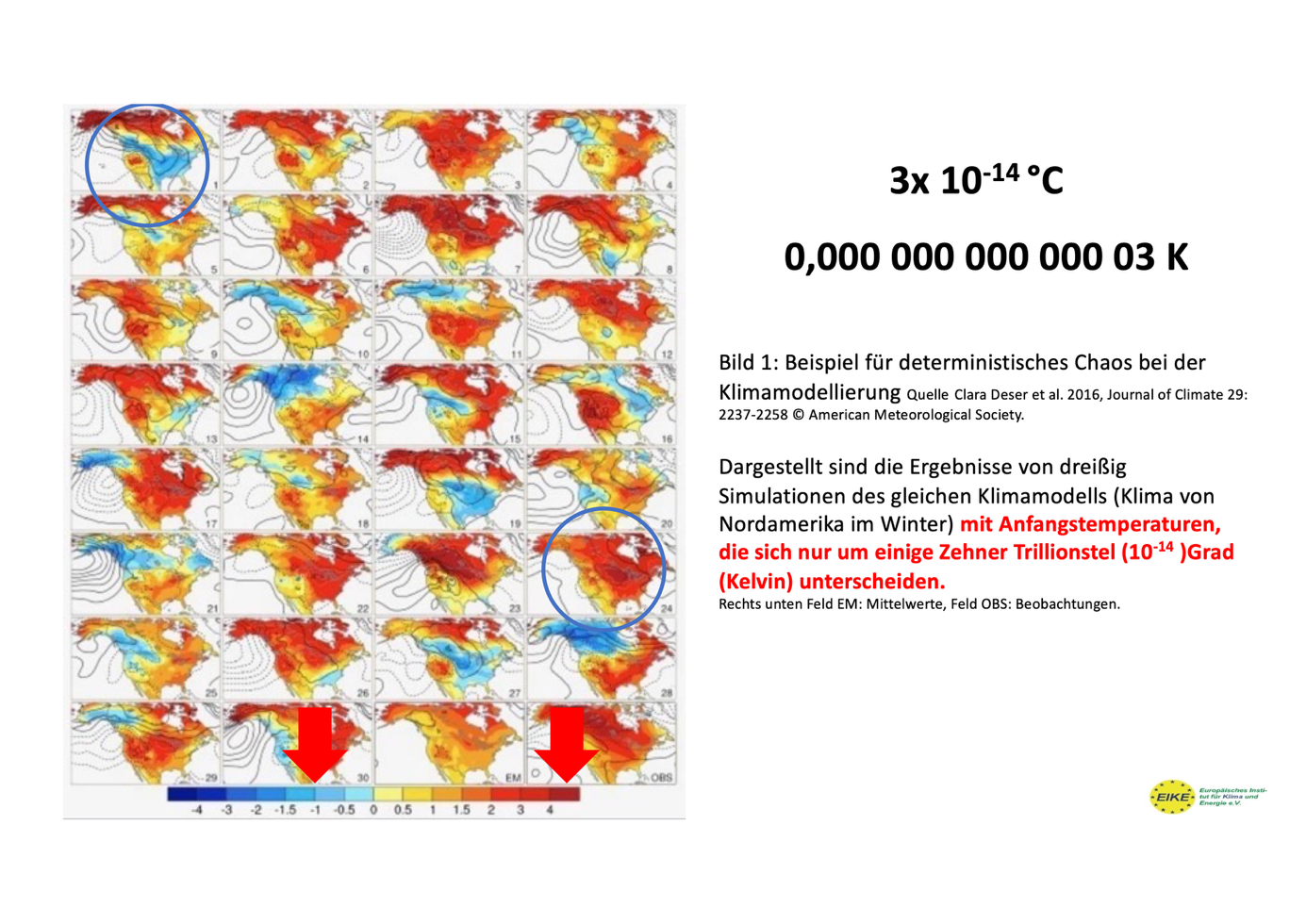

Um also zu verhindern, dass das Modell eine zu hohe oder zu niedrige Temperatur auf Grund dieser oder jener CO2 Vorgabe errechnet, werden viele der Vorgaben berechnet und deren Ergebnis dann einer Mittelwertbildung unterzogen. Die folgende Grafik zeigt, was dabei herauskommt, und – nicht vergessen – niemand weiß warum!

Abbildung 12: Darstellung der Ausgabe eines Klimamodells für die Berechnung der Wintermonate der USA, die sich mit einer Eingabe deren Starttemperatur um 3 x 10-14 K unterscheiden. Die Ausgabe schwankt dann von + 5 K bis zu + 1 K. Die Eingangstemperatur wäre vergleichbar mit dem Durchmesser eines Atomkerne (z. B. von Uran). Die haben einen Durchmesser bis zu Metern.

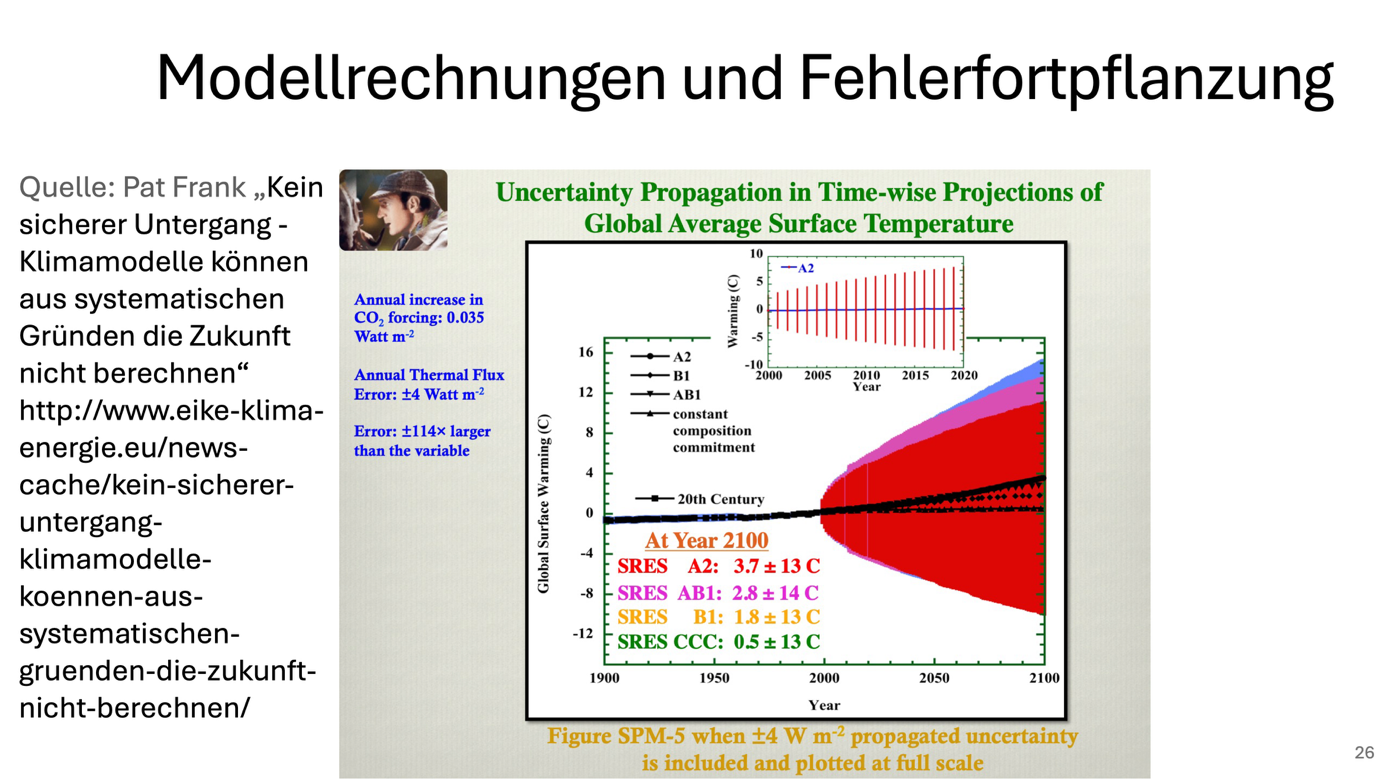

Doch das ist noch längst nicht alles. Wir sprachen vorhin über die systematischen Fehler. Die sind natürlich auch bei diesen Modellrechnungen vorhanden, und bauen sich dann alle 20 Minuten weiter auf. Nehmern wir also an, dass die bisherige „Mitteltemperatur“ hinreichend fehlerfrei (also mit der dem ca. ± 0,1 bis ± 0,2 Unsicherheitsband versehen) als Eingabe in dieses Modell vorgesehen ist. Jede 20 Minuten kommen weitere systematische Fehler dazu. Am Tage dann 72 x, im Monat dann 2.160 mal (bei 30 Tagen) und im Jahr sind das dann schon 25.920 mal.

Das Ergebnis sähe dann so aus.

Abbildung 13, Je nach IPCC Modell A1 bis AB1 und den angegebenen Werten für CO2 Forcing, würde das Ergebnis irgendwo in den roten bis blauen Fehlerbereich liegen. Der Gesamtfehler ist dann 114 x größer als die Eingangsvariable.

Das kann es also nicht sein. Und trotzdem wird es so gemacht, selbst gestandene Wissenschaftler wie Ganteför, Peitgen und viele andere mehr, springen auf diesen Zug auf und fahren damit ab. Wie soll man so etwas nennen?

Doch eine Sache möchte ich auch noch beleuchten. Es ist die Aussage von Ganteför mit dem äußerst geringen Anteil des CO2 in der Atmosphäre mit der Promillegrenze von Alkohol. Er sagte in Minute 2:12 (YT 17:43)

..part per millions, also knapp das doppelte, das sind 0,5 Promille. So und jetzt gibt es die Leute, die sagen, das ist doch Quatsch, CO2 kann doch jetzt nicht so eine Erwärmung erzeugen. Dann sage ich immer, okay Leute, aber 0,5 Promille Alkohol im Blut bedeutet, ich sollte besser nicht mehr Auto Auto fahren, obwohl ja immer noch 99,9% meines Blutes Blut sind und nicht Alkohol. Aber das bisschen Alkohol macht für unser Gehirn eben einen großen Unterschied…

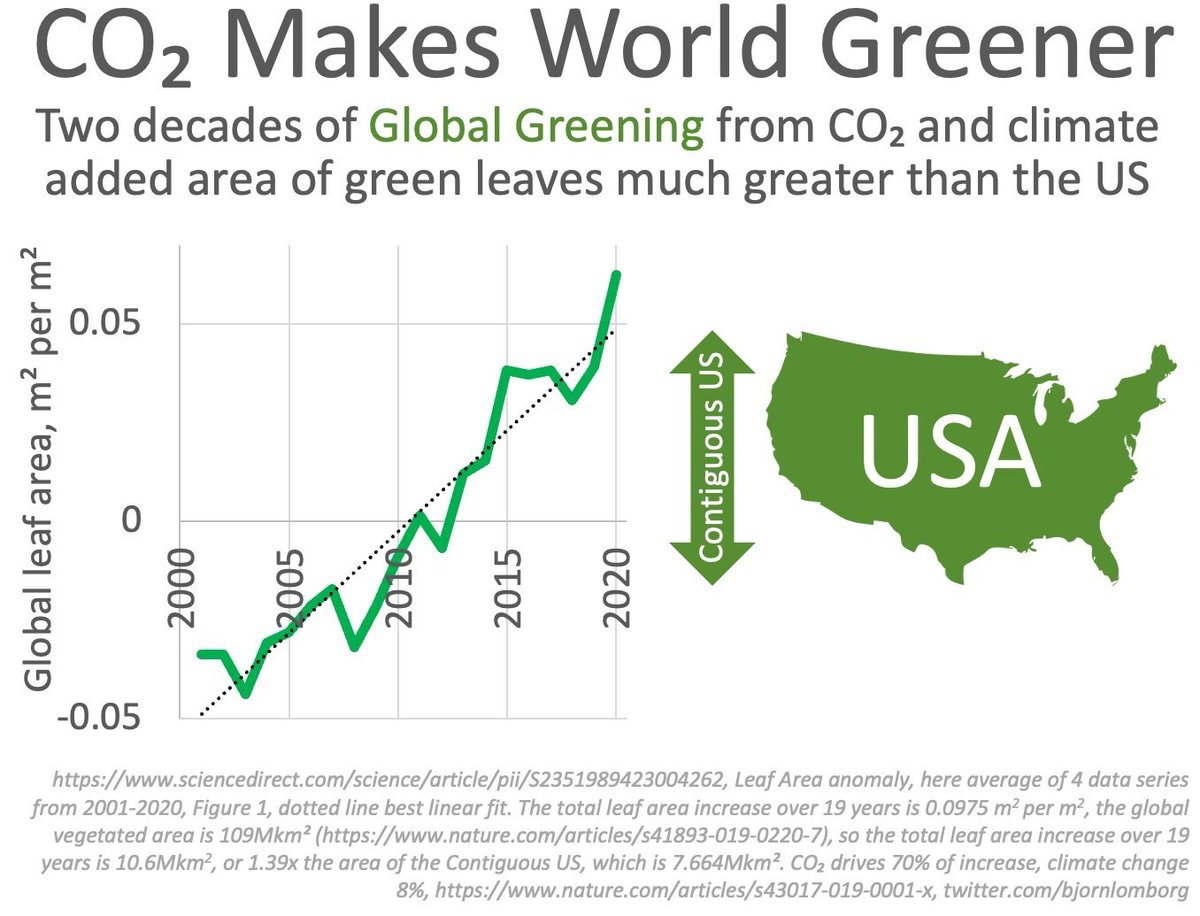

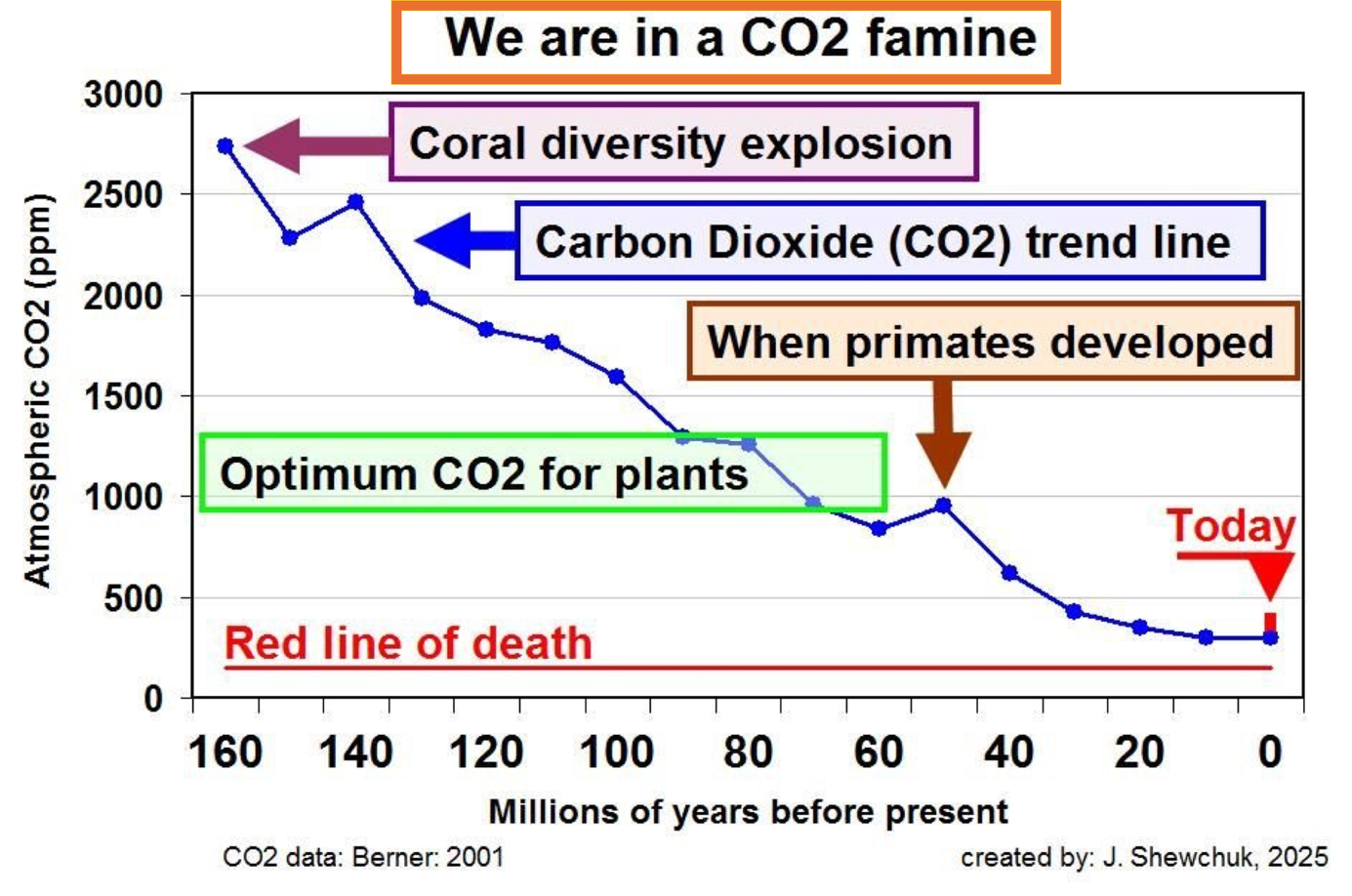

Nun ist nicht alles, was hinkt, ist ein Vergleich, aber dieser Vergleich hinkt besonders. Denn CO2 ist kein Nervengift wie Alkohol, der schon in ganz geringen Mengen auf das Gehirn Einfluss ausübt, sondern ein Gas, dass sich fast wie ein Edelgas verhält. Also fast inert ist, wie man in der Chemie dazu sagt. Es kann sich nur mit hohem Energieeinsatz, so wie ihn die Sonnenstrahlen liefern, mit anderen Stoffen verbinden. Man nennt das Photosynthese, und das ist die Grundlage allen Lebens auf diesem Planeten. Weil viel CO2 schon in den Gesteinen und im Ozean gebunden ist, in sehr viel früheren Zeiten war es nicht nur warm auf der Erde, sondern der CO2 Gehalt war auch bei mehreren 1000 ppm. Das Ergebnis war, das Leben quoll über. So gesehen haben wir auf dieser Erde viel zu wenig CO2, Und die Natur gleicht das mit steter Zunahme aus. Politisch gesehen, sollten daher all jene die CO2 erzeugen und damit die CO2 Zunahme antreiben einen Bonus bekommen, statt eines vielfältigen Malus, wie bspw. einen decarbonisierten Kontinent zu haben, wie es ihn der Green Deal ohne Rücksicht auf (unsere) Verluste vorschreibt. Wer also der Dekarbonisierung das Wort redet, tut genau das.

Alle C3 und auch C4 Gräser wachsen mit mehr CO2 besser, und zu diesen Gräsern gehören sämtliche Getreide und auch alle Reissorten. Tatsache ist, wir brauchen mehr CO2, deutlich mehr.

Abbildung 14: Ab ca, 180 ppm bis 200 ppm an CO2 sind alle Pflanzen in dieser Welt verhungert. Und mit ihnen alles Leben. Das sollte keiner wollen, oder?

7. Weiter Unstimmigkeiten in der „Klimaforschung“

Die Mitteltemperatur wurde gesenkt.

Auch bei der normalen Klimaforschung ist nicht alles Gold was glänzt. Da ist zum Beispiel die wichtige Frage, wie hoch denn die Idealtemperatur, dank des Treibhauseffektes sei? Bis Anfang 2000 war man sich einig, dass das 15 ° C sind. Sven Plöger, bekannter ARD Wettermoderator, sagte noch am 22.10.2011 den erstaunten Zuschauern, dass es 15° C seien, und ein paar Jahre später (11.04.2019) in einer Sendung vom wdr, mit Frau Böttiger und anderen Frauen wie Luisa Neubauer, sagte er mit gleicher Überzeugung, dass es nun 14 ° seien. Er hat mit voller Inbrunst und Überzeugung, die gesamte Erwärmung des vorigen Jahrhunderts ausradiert.

Die Gründe dafür hat mir der Leser Marcus Portius genannt. Und sie sprechen für sich:

In der NASA Veröffentlichung: GISS Surface Temperature Analysis: The Elusive Absolute Surface Air Temperature (SAT) steht: „There are indeed many historical reports that discuss the annual mean temperature results in terms of the absolute temperature. Pre-2000, these reports generally took the anomalies and added them to a baseline temperature of 15°C, which was a commonly used average. After 2000, they often used a baseline of about 14°C (following Jones et al, 1999). However, these baselines were only approximate, as evidenced by the fact that they were changed by a degree Celsius after further research!“

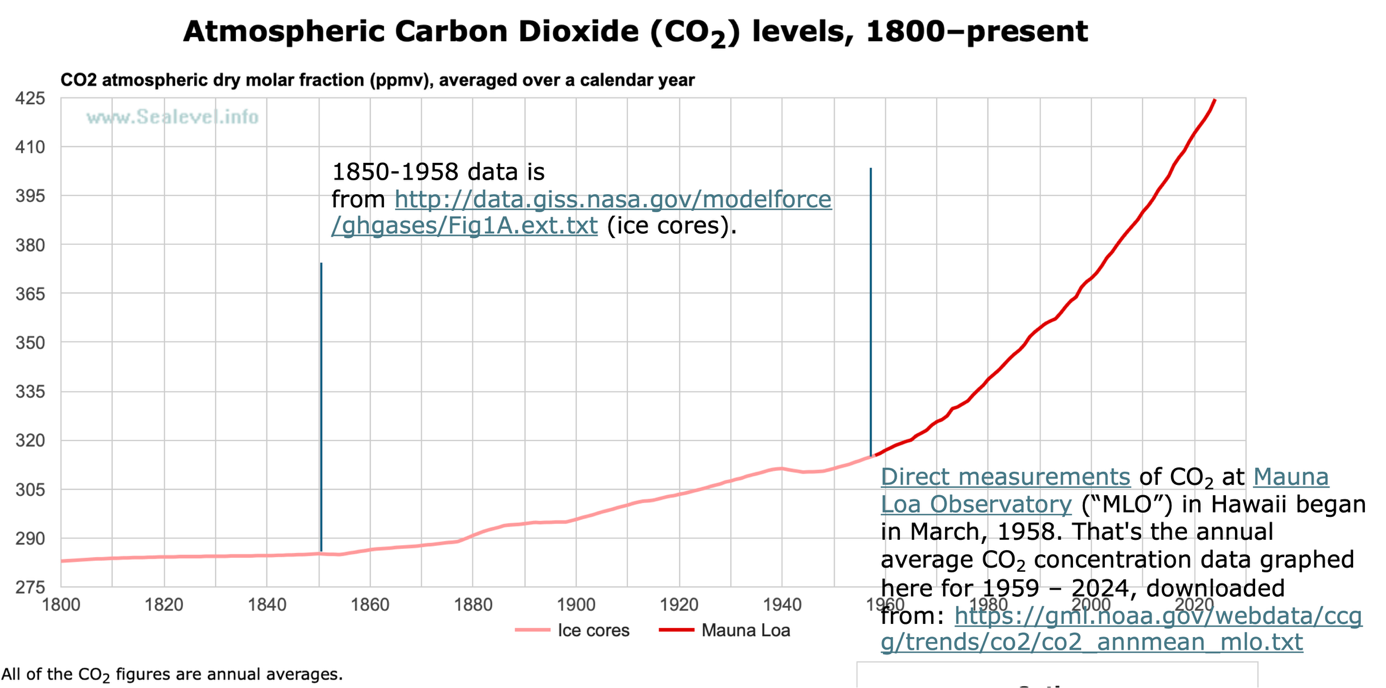

zu Deutsch: „“Es gibt tatsächlich viele historische Berichte, die die Ergebnisse der jährlichen Durchschnittstemperatur in Bezug auf die absolute Temperatur diskutieren. Vor dem Jahr 2000 berücksichtigten diese Berichte im Allgemeinen die Anomalien und addierten sie zu einer Basistemperatur von 15 °C, einem häufig verwendeten Durchschnitt. Nach dem Jahr 2000 verwendeten sie oft eine Basislinie von etwa 14 °C (in Anlehnung an Jones et al., 1999). Diese Basislinien waren jedoch nur ungefähre Angaben, wie die Tatsache zeigt, dass sie nach weiteren Untersuchungen um ein Grad Celsius geändert wurden!“. Und besagter Jones ist der später unrühmlich bekannt gewordene Phil Jones, damals Leiter der Climate Research Unit von der Universität East Anglia, der auf Grund des Climate-Gate Skandals bekannt wurde. Er war der, welcher Mike´s Hockeystik Nature Trick (gemeint ist Michel Mann, dem Erfinder des weltberühmten Hockeystick Skandals) so toll fand, dass er ihn seinem eMail Empänger zur Nachahmung empfahl. Der Trick bestand darin, zwei Kurven verschiedener Herkunft, und grundverschiedener Mess- und Zeitverhalten (Baumringdaten und moderne Thermometerdaten) aneinander zu „spleißen“, ohne den Leser darauf hinzuweisen was da gemacht wurde. Das erinnert stark an das CO2 Diagramm (Abbildung 8), das ebenfalls von zwei verschiedenen Messdaten und Messorten produziert wurde. Phil Jones war auch der derjenige der an Michael Mann am 8 Juli 2004 schrieb:“ ‘can’t see either of these papers being in the next IPCC report. Kevin and I will keep them out somehow – even if we have to redefine what the peer-review literature is!’. Doch die Wettermoderatoren sprechen mit gleicher Inbrunst dann vom „wärmsten Jahr“ das „seit Beginn der Wetteraufzeichnung“ gemessen wurde und sagen dann es seien 14,8 °C gewesen. So Benjamin Stöwe am 19.1.2017, zum Jahr 2016, was die WMO uns so erklärt hatte. Doch bei Ganteför und vielen anderen ist das bisher angekommen.

Die Temperaturen der Vergangenheit wurden weltweit gesenkt, um die Gegenwart wärmer zu erscheinen zu lassen.

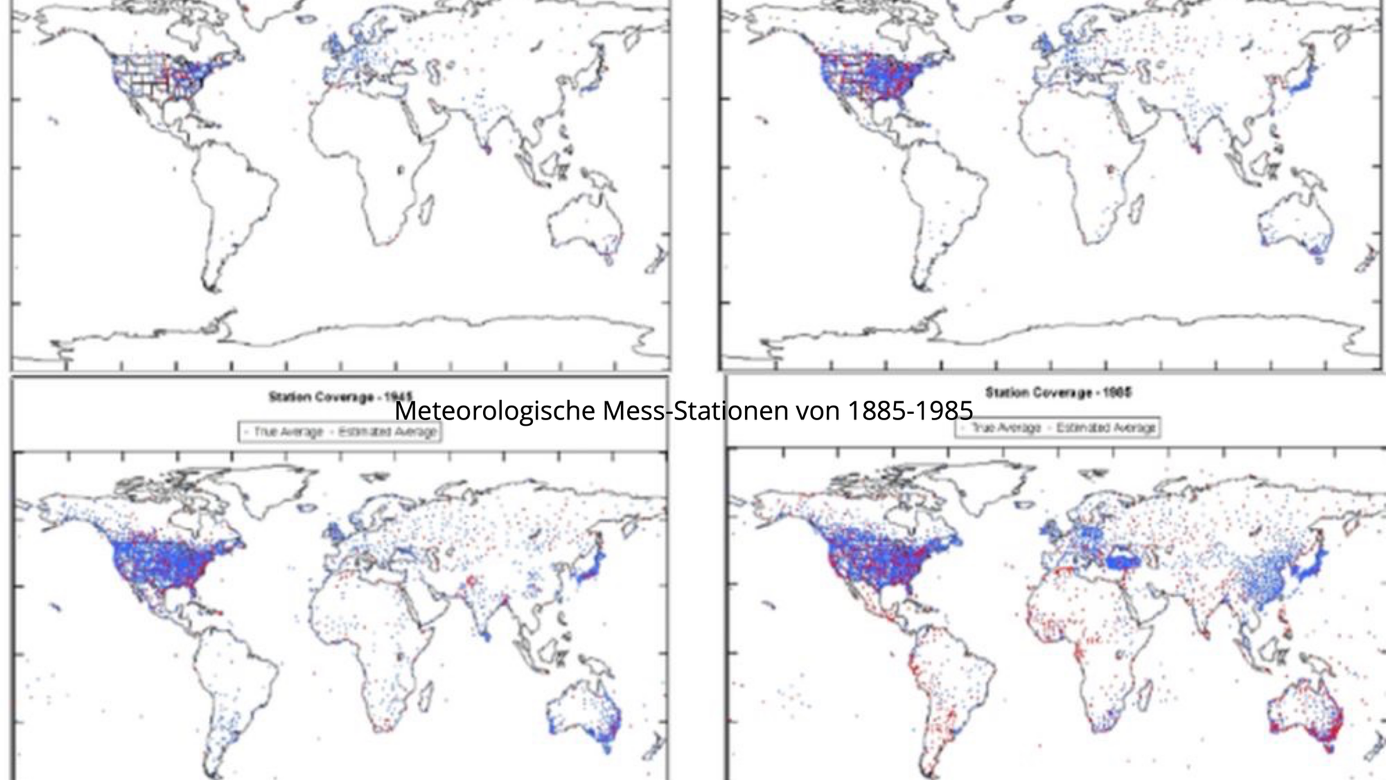

Es ist das unsterbliche Verdienst meines Freundes und Kollegen, des Prof. und Geologen Friedrich-Karl Ewert, leider inzwischen verstorben, der sich mit den Global Historical Temperature Network beschäftigte. Dabei fiel ihm auf, dass etwa ab 2010 alle Daten dieses Netzwerkes einer gründlichen Überarbeitung unterzogen wurde. Offziell nannte man das Homogenisierung, aber es war weit mehr als das. So gut wie sämtlichen Wetterstationen, wurde die Vergangenheit kühler gemacht, um die Gegenwart wärmer erscheinen zu lassen. Besonders fiel ihm dabei die Station Mallorca auf, bei dem eine Abkühlung von -1 K bis 2010 vorhanden war, dies aber nach der „Homogenisierung“ + 1 K waren. In den USA ist es u.a. Tony Heller der sich damit beschäftigte. Von ihm stammte die folgende Grafik

Abbildung 15. Grafik von Tony Heller die zeigt die wie Daten der USA (die plötzlich zu Rohdaten geändert wurden) von einer Abkühlung zu einer Erwärmung wurden. Quelle Website „Real Climate Science“ https://realclimatescience.com/data-tampering-at-ushcngiss/#gsc.tab=0

Climate Gate Files

Vielleicht erinnert man sich noch an die Climate Gate Files, die im Jahr 2009 für Aufsehen sorgte. Ein unbekannter Hacker hat viel 1000 eMails der Universität von East Anglia der dortigen Climate Research Unit.

Hier ein Ausschnitt aus einer Bericht von EIKE

Im November 2009 gelangte eine große Zahl von eMails aus der Climate Research Unit (CRU)der University of East Anglia an die Öffentlichkeit. Die kompletten Climategate eMails können hier nachgelesen werden. Wer in die Abgründe wissenschaftlicher Korruption eintauchen will, dem sei der Link empfohlen.

Die eMails haben in einer Weise das Bild einer korrupten, konspirativen Gruppe von Wissenschaftlern gezeichnet, die mit gefälschten und manipulierten Daten, mit Modellen, die erstellt werden, um ein bestimmtes Ergebnis zu produzieren, nicht, um etwas vorherzusagen, der Welt vorgaukeln wollen, es gebe eine auf menschliche Aktivitäten zurückführbare globale Erwärmung.

Christopher Booker hat am 28. November 2009 in Telegraph vom schlimmsten Wissenschaftsskandal unserer Generation gesprochen. Selbst linke Kommentatoren befänden sich im totalen Schock, und zwar deshalb, weil die Wissenschaftler, die bis zum Haaransatz im Sumpf aus Korruption und Fälschung stecken, nicht irgendwelche Wissenschaftler sind, sondern

“the small group of scientists who have for years been more influential in driving the worldwide alarm over global warming than any others, not least throuh the role they play at the heart of the UN’s Intergovernmental Panel of Climate Change”.

Und es geht immer weiter..

Klimawandel durch Datenlöschen, -manipulieren, -fälschen: Jahrzehnte des Lügens – Climategate-Files

Daraus: Im August letzten Jahres machte der Daily Sceptic darauf aufmerksam, dass das britische Wetteramt Temperaturdaten an seiner fiktiven „offenen“ Wetterstation in Lowestoft erfunden hatte. Die Zahlen sollten angeblich von „gut korrelierten Nachbarstationen” zusammengestellt worden sein, aber Recherchen des Bürgerdetektivs Ray Sanders ergaben, dass es im Umkreis von 60 km keine solchen Stationen gab. Damals bezeichnete der Daily Sceptic die Angelegenheit als „rauchende Pistole” und erklärte, dass, sofern das Met Office nicht endlich seine Berechnungen offenlegen würde, „die einzige realistische Schlussfolgerung lautet, dass die Daten erfunden sind”. Es wurde keine Erklärung abgegeben, aber in einer überraschenden, unangekündigten Maßnahme hat das Met Office nun alle Daten aus Lowestoft aus seinen historischen Aufzeichnungen zurück bis zur Schließung des Standorts im Jahr 2010 entfernt. Ähnliche Datenentfernungen gab es auch bei den Stationen in Nairm Druim und Paisley.

und

„Das britische Wetteramt löscht große Teile historischer Temperaturdaten nach Vorwürfen der Fälschung

Daraus.

Ray Sanders, ein Citizen Journalist, hat herausgefunden, dass eine von der MET Office gerne verwendete und wegen ihrer Höchstwerte zitierte Messstation „Lowestoft“, gar nicht existiert, bereits 2010 geschlossen wurde. Angesprochen darauf, dass Daten einer Messstation berichtet werden, die es gar nicht gibt, hat man sich bei der MET Office darauf zurückgezogen, die Daten würden von nahegelegenen gut korrelierten Messstationen interpoliert. Interpolieren ist ein anderes Wort für das Erfinden von Daten. Sanders, mit dieser Angabe nicht zufrieden, hat weiter gegraben und herausgefunden, dass im Umkreis von 40 Meilen um die ehemalige Messstation „Lowestoft“ KEINE weitere Messstation zu finden ist, die nützliche Daten zum Înterpolieren bereitstellt, und dass die Messstation, die sich in geringster Entfernung zu Lowestoft befinden, nach den eigenen Kriterien der MET OFFICE Junk Daten liefert, auf die man sich nicht verlassen kann:

„… Cromer, a Class 4 junk site with possible unnatural errors up to 2°C at 35 miles distance, and Class 2 Weybourne, 41 miles away. Well-correlated except for the fact they are too far away to provide a monthly estimate for Lowestoft to one tenth of a degree centigrade

… Es ließe sich endlos fortsetzen. Damit wird einmal mehr die kluge Lebenserfahrung eines der größten Physikers des letzten Jahrhunderts perpetuiert »Egal, wie bedeutend der Mensch ist, der eine Theorie vorstellt, egal, wie elegant sie ist, egal wie plausibel sie klingt, egal wer sie unterstützt, wenn sie nicht durch Beobachtungen bewiesen wird, dann ist sie falsch.« Physik-Nobelpreisträger Richard Feynman.

Die Treibhaustheorie ist falsch. Freispruch für CO2

Wer also leider aktuell bleiben möchte sei auf unserer Webseite verwiesen, Sie finden sie hier

Wer sich den ganzen Bericht herunterladen möchte kann das hier tun Limburg Mein verhindertes Video 4

Teil 1 finden Sie hier

Teil 2 finden Sie hier

Teil 3 finden Sie hier

Und hier ein etwas älteres Buch von mir zum Thema, dass Teile des oben genannten, aber noch viel mehr aus anderen Bereichen dazu erzählt.