Der hohe Weizenpreis verheißt nichts Gutes

Green Deal bedeutet Hungersnot

von Edgar L. Gärtner

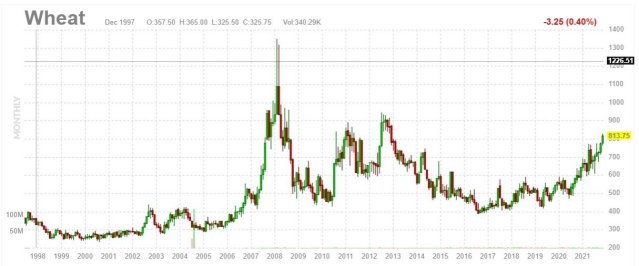

Seit etwa zehn Wochen kennt der Weizenpreis an den Leitbörsen von Paris und Chicago nur eine Richtung. Er hat nun wohl „nachhaltig“ die wichtige Widerstandslinie von 300 Euro je Tonne durchbrochen. Der stark steigende Weizenpreis schlägt mit einer nur geringen Zeitverzögerung in vielen Ländern auf den Brotpreis durch. Das bedeutet für viele Arme schon jetzt Hunger. Doch abgelenkt vom Corona-Wahn machte aus dieser Nachricht kaum eines unserer regierungsfrommen Massenmedien eine Schlagzeile. Immerhin brachte die FAZ am 18. November 2021 hinter einer Bezahlschranke den almarmierenden Beitrag des Bad Homburger Analysten Wieland Staud. Dieser weist zu Recht darauf hin, dass Missernten und in deren Gefolge steigende Brotpreise die Große Französische Revolution auslösen halfen.

Der Einfluss von Unbilden der Witterung erklärt die Teuerung aktuell allerdings nur zum geringen Teil. So gab es in den USA, Kanada und Russland zwar gewichtige Ernteausfälle wegen Trockenheit sowie in der chinesischen Getreideanbau-Region Henan wegen einer katastrophalen Überschwemmung. Doch ausschlaggebend für den Preissprung für Getreide war die Verfünffachung des Gaspreises. Hinter dieser wiederum steht letzten Endes die lebensfeindliche Politik der Ächtung des Pflanzennährstoffs Kohlenstoffdioxid (CO2) durch die „Net Zero“-Pläne in Europa und Nordamerika. Denn etwa 70 Prozent der weltweit eingesetzten Düngemittel fußen auf der Ammoniaksynthese nach dem Haber-Bosch-Verfahren mithilfe von Luftstickstoff und Erdgas als Wasserstoffquelle. Dieses katalytische Verfahren arbeitet mit hohem Druck und hoher Temperatur, wobei unweigerlich CO2 frei wird (das man allerdings auffangen könnte). Nur durch die Verbreitung dieses schon vor dem Ersten Weltkrieg in Deutschland von der BASF entwickelten großtechnischen Syntheseverfahrens konnte nach dem Zweiten Weltkrieg der Hunger in der Welt (fast) besiegt werden. Da die Produktionskosten der Stickstoffdünger aber zu 80 Prozent vom Gaspreis bestimmt werden, wird die Rentabilitätsschwelle beim Steigen des Rohstoffpreises rasch unterschritten. Da die Ernährung von etwa der Hälfte der Weltbevölkerung von Stickstoffdünger abhängt, ist das beunruhigend.

Schon als im August 2021 der Orkan „Ida“ in den US-Südstaaten wütete, musste die weltweit größte Ammoniak-Anlage von CF-Industries in Louisiana aus Sicherheitsgründen für zehn Tage heruntergefahren werden. Doch kurze Zeit später schloss CF-Industries auch zwei große Anlagen in England. Das hatte mit dem Wetter nichts zu tun, sondern mit dem rasch steigenden Gaspreis. Anfang Oktober schloss die BASF ihre Ammoniak-Anlagen in Ludwigshafen und Antwerpen auf unbestimmte Zeit. SKW Piesteritz, der größte deutsche Ammoniak-Hersteller, fuhr seine Produktion teilweise herunter. Borealis in Österreich, OPZ in der Ukraine und Fertiliberia in Spanien schlossen ihre Anlagen ganz. Achema in Litauen und OCI in den Niederlanden sind dabei, ihre Anlagen herunterzufahren. Yara International reduziert die Produktion von Stickstoffdünger EU-weit um 40 Prozent. Die Volksrepublik China, bislang der größte Exporteur von Stickstoffdünger auf Harnstoff-Basis auf dem Weltmarkt, hat im September einen Exportstopp für Stickstoff- und Phosphatdünger bis Juni 2022 verhängt. Und das alles bei einer rasch wachsenden Nachfrage nach Stickstoffdünger nach dem Ende der „Lockdowns“. So finden die Preissprünge auf dem Kunstdüngermarkt eine einleuchtende Erklärung.

Vor zwei Jahren konnte ich hier noch auf Rekord-Getreideernten hinweisen, die offenbar mit dem gestiegenen CO2-Gehalt der Atmosphäre zusammenhingen. Inzwischen sind die Getreidevorräte weltweit auf ein Minimum geschrumpft. Verschärft wird die Lage dadurch, dass diese Entwicklung einflussreichen Entscheidern in Politik und Finanzindustrie offenbar gelegen kommt. Auf der Klima-Konferenz von Glasgow (COP 26) haben die Delegationen von hundert Staaten eine Absichtserklärung unterzeichnet, die eine Reduktion der Methan-Emissionen von 30 Prozent bis zum Jahr 2030 vorsieht. Das betrifft sowohl die Haltung von Rindern, in deren Pansen Methan entsteht, als auch Lecks in Erdgasleitungen und Produktionsanlagen. Mehr oder weniger obskure NGOs, die in Glasgow eifrig Lobby-Arbeit betrieben, kämpfen seit längerem dafür, den Menschen den Fleischkonsum abzugewöhnen. Sie finden damit in Regierungskreisen und internationalen Konzernen immer mehr offene Ohren, sofern sie nicht ohnehin Ideen verbreiten, die ursprünglich in Think Tanks ausgebrütet wurden, die von Finanzmagnaten gesponsert werden. Zu erwähnen ist hier vor allem das World Economic Forum (WEF) von Davos und dessen Programm eines „Great Reset“. Auch die von der Vollversammlung der UNO angenommene „Agenda 2030“ sieht den Übergang zu einer „nachhaltigen“ Landwirtschaft ohne oder mit nur minimalem Kunstdünger-Einsatz vor. Beide Programme fordern eine starke Verminderung des Fleischkonsums und dessen Ersatz durch Kunstfleisch aus dem Labor. Da kommt die Verteuerung von Stickstoffdünger wie gerufen.

Ohnehin ist heute infolge der Anwendung strenger Nitrat-Grenzwerte für das Grundwasser entsprechend der novellierten Düngeverordnung nach Meinung betroffener Landwirte mancherorts schon keine optimale Stickstoff-Düngung mehr möglich. In der fruchtbaren Wetterau, einer der Kornkammern Deutschlands, sei es nun schon schwierig, noch Weizen in Brotqualität zu produzieren, klagen alteingessene Bauern. Ich habe hier schon vor Jahren darauf hingewiesen, dass Stickstoffverbindungen (mit Ausnahme von Proteinen) seit dem politischen Aufstieg der Grünen bei uns generell eine schlechte Presse haben. Wohltuende Wirkungen von Stickstoffmonoxid werden dabei verdrängt. Maßgebliche Teile der Finanzindustrie, die der „Glasgow Financial Alliance for Net Zero“ beigetreten sind, wollen die Verteufelung von Stickstoff und Kohlenstoffdioxid nutzen, um ihnen anvertraute Gelder von Sparern in Billionenhöhe in Netto-Null-Projekte zu lenken bzw. dort zu versenken. Millionen von Hungertoten werden dabei wohl in Kauf genommen. (Immerhin gehört Hunger zu den natürlichen Todesursachen.)