Die Klimaschutzmaßnahmen im Koalitionsvertrag von November 2021 im Lichte der Fakten und Folgen für Deutschland

Die unzureichende Betrachtungsweise des Weltklimarates (IPCC) zur Wirkung von CO2 auf das Klima machen die Klimaschutzmaßnahmen obsolet

von Dr.- Ing. Erhard Beppler

1. Übersicht

Nach der Aussage des IPCC ist der CO2-Anstieg in der Atmosphäre seit dem Beginn der Industrialisierung ausschließlich auf die anthropogenen CO2-Emissionen zurückzuführen. Der anthropogene in die Atmosphäre eingetragene CO2-Anteil liegt jedoch seit dem Beginn der Industrialisierung nur bei etwa 4%, 96% sind natürlichen Einflüssen zuzuordnen.

Die Modelle des IPCC zur Bestimmung der Temperaturentwicklung berücksichtigen ausschließlich den Gesamt-CO2-Gehalt der Atmosphäre und nicht den anthropogenen Anteil und sind daher wertlos. Damit sind auch alle Klimagipfel (COP´s) wie in Glasgow sinnlos, die Klimamaßnahmen im Koalitionsvertrag von November 2021 zur Verminderung des CO2-Ausstoßes obsolet.

Die im Koalitionsvertrag festgelegten Klimaschutzmaßnahmen zum Abbau der CO2-Emissionen wären nur über die praktisch ausschließliche Stromerzeugung über die in ihrer Erzeugung stark schwankenden alternativen Energien möglich, d.h. um auch nachts bei Windstille (oder in Dunkelflauten) ausreichend Strom erzeugen zu können, müsste eine hohe Stromspeicherkapazität über die Wasserstofftechnologie aufgebaut werden.

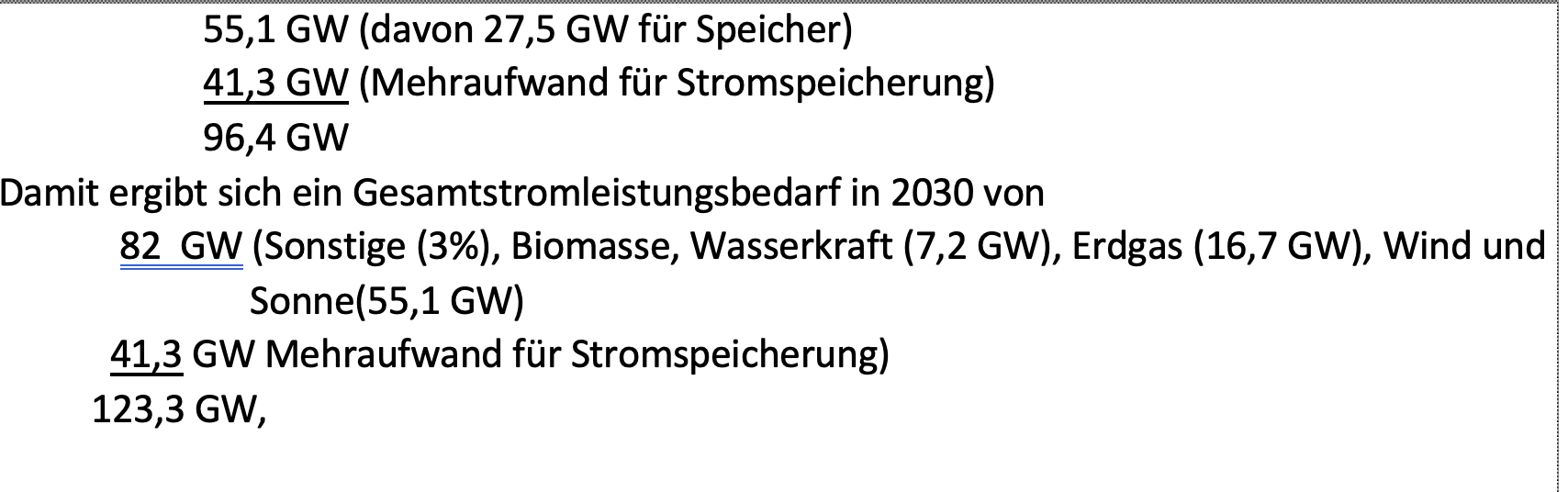

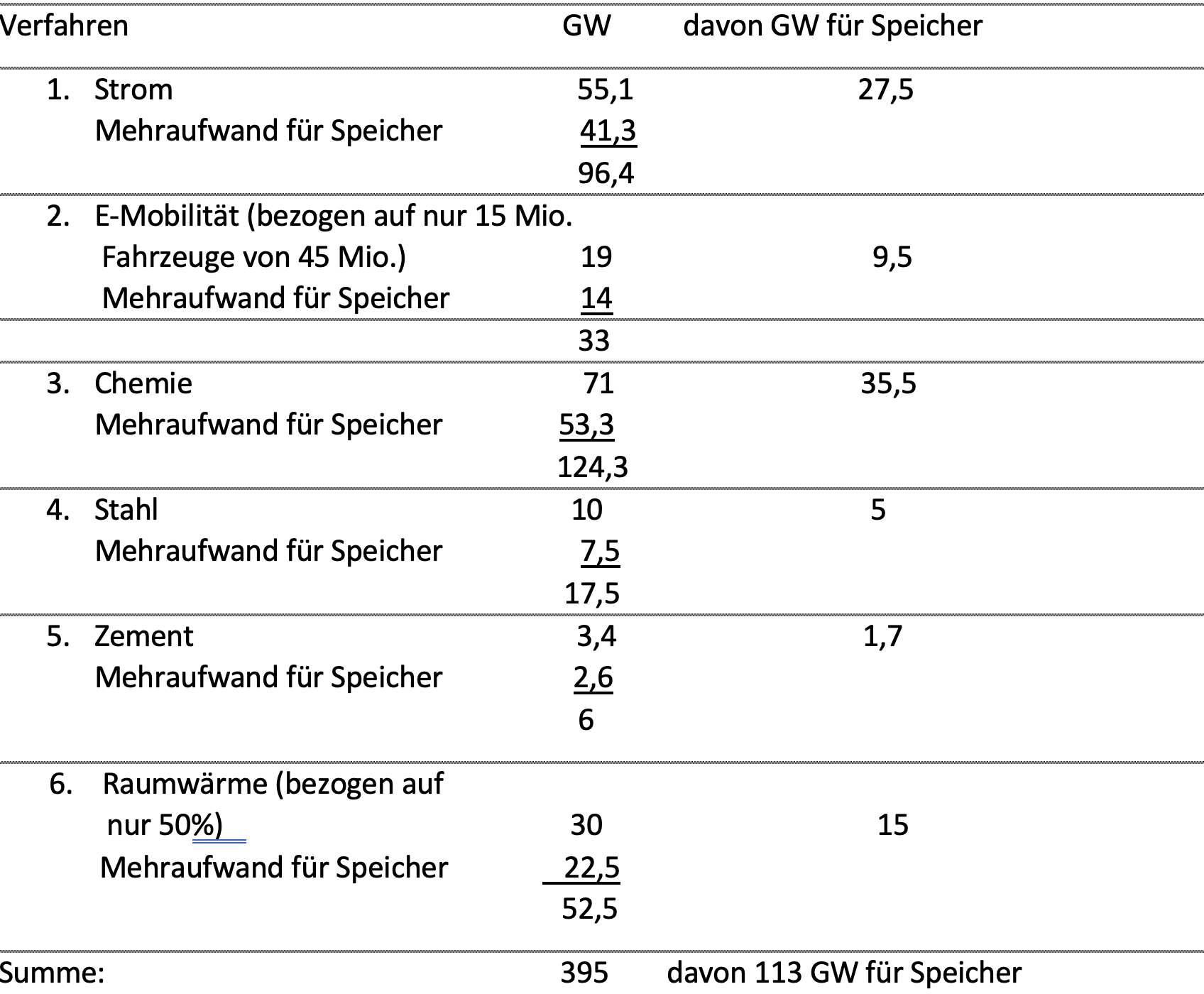

Die Stromerzeugung in 2030 ist im Koalitionsvertrag ausgerichtet auf 680-750 TWh (im Mittel 82 GW), wobei 80% der Energieträger über alternative Energien beigesteuert werden sollen.

Für die einzelnen Sektoren wären dann nach den Vorgaben des Koalitionsvertrages bis 2030 folgende Stromerzeugungskapazitäten über Wind und Sonne und einschließlich der erforderlichen Stromspeicherkapazitäten aufzubauen (ohne die Stromerzeugung über Biomasse, Wasserkraft, Erdgas): Stromleistung (Basis 2019) 55 GW plus erforderliche Speicher von 41 GW = 96 GW, E-Mobilität 33 GW (bezogen auf nur 15 Mio. PKW von 45 Mio.), Chemie 124 GW, Stahl 18 GW, Zement 6 GW, Raumwärme 53 GW (bezogen nur auf 50%).

Insgesamt wäre eine Stromerzeugungskapazität über Wind und Sonne von 395 GW aufzubauen, darin sind 113 GW für Stromspeicher enthalten, die über die Wasserstofftechnologie betrieben werden müssten.

Im Koalitionsvertrag sind jedoch nur 10 GW über die Wasserstofferzeugung bis 2030 vorgesehen.

Von den 395 GW sollen 200 GW über Solaranlagen beigestellt werden, somit 195 über Windanlagen. Der Bau der Windanlagen erfordert 48% der Fläche Deutschlands.

Diese Kapazitäten müssten bis 2030 zum überwiegenden Teil im Ausland aufgebaut werden.

Selbst über Gaskraftwerke kann das Stromspeicherproblem bis 2030 nicht gelöst werden.

Quo vadis Deutschland?

- Einleitung

In den 1970er Jahren wurde von den Klimawissenschaftlern eine bevorstehende Eiszeit mit hunderttausenden Toten ausgerufen.

Seit den 1980er Jahren beherrscht der politische Weltklimarat (IPCC) die Klimascene.

Seit dieser Zeit verbreitet das IPCC die Aussage, dass ausschließlich die menschlichen CO2-Emissionen für die Klimaerwärmung seit Beginn der Industrialisierung im 19.Jahrhundert verantwortlich zeichnen mit dem Hinweis auf eine unerträgliche Wärmeentwicklung, einen enormen Meeresspiegelanstieg, etc.

Die damit inszenierte CO2-Angst wird von keinem Volk derart geteilt wie von den Deutschen. Bereits im Jahre 1986 setzte das bekannte Magazin „Der Spiegel“ den Kölner Dom in seinem Titelbild unter Wasser.

Norbert Bolz vergleicht in seinem Buch „Kinder der Angst“ das Fegefeuer des Mittelalters mit der Angst heute vor der Wirkung des CO2 auf das Klima.

Bereits im Jahre 2000 startete die damalige Regierung die Energiewende – basierend auf den Aussagen des IPCC zum Einfluss von CO2 auf das Klima – und erkannte erst im Jahre 2021, dass die Energiewende ohne eine ausreichende Stromspeicherkapazität nicht funktionieren kann.

In jüngster Zeit beherrschen Endzeitsekten wie „Friday for Future“ , „Extinktion Rebellion“, etc. die Klima-Scene und treiben die politischen Parteien, die gesellschaftlichen Gruppen wie Arbeitgeberverbände, Gewerkschaften, Kirchen, Medien, etc. vor sich her.

Der Bieterwettstreit der Parteien zur Absenkung des CO2-Gehaltes in der Atmosphäre vor der Wahl 2021 spricht eine eigene Sprache.

Ziel dieser Ausarbeitung wird es sein, insbesondere die Aussagen des IPCC zum Einfluss des CO2 auf das Klima kritisch zu sichten, ebenso wie die obsoleten Maßnahmen der neuen Bundesregierung zum Abbau der CO2-Emissionen zu hinterfragen.

3.Zu den wichtigsten Aussagen zur Energieversorgung im Koalitionsvertrag vom November 2021

Der Ausstieg aus der Kohleverstromung wird „idealerweise“ vom bisher geplanten Jahr 2038 auf das Jahr 2030 vorgezogen.

Alle Sektoren werden einen Beitrag leisten müssen: Verkehr, Bauen und Wohnen, Stromversorgung, Industrie und Landwirtschaft.

Der Ausbau der Erneuerbaren Energien wird ausgerichtet auf eine Bruttostromerzeugung von 680-750 TWh im Jahre 2030. Davon sollen 80% aus Erneuerbaren Energien stammen.

Alle geeigneten Dächer sollen zukünftig für die Solarenergie genutzt werden.

Ziel ist der Ausbau der Photovoltaik auf ca. 200 GW bis 2030. Für die Windenergie an Land sollen 2% der Landflächen ausgewiesen werden.

Die Kapazitäten der Windenergie auf See werden mindestens 30 GW 2030, 40 GW 2035, und 70 GW 2045 betragen.

Die Bioenergie in Deutschland soll eine neue Zukunft haben.

Das Potential der Geothermie für die Energieversorgung soll stärker genutzt werden.

Es wird ein sehr hoher Anteil an Erneuerbarer Energie bei der Wärme genutzt werden: bis 2030 50%.

Die bis zur Versorgungssicherheit durch Erneuerbare Energien notwendigen Gaskraftwerke sollen zur Nutzung der vorhandenen (Netz-)-Infrastrukturen und zur Sicherung von Zukunftsperspektiven auch an bisherigen Kraftwerksstandorten gebaut werden. Sie müssen auf klimaneutrale Gase (H2-ready) umgestellt werden können.

Eine Energieinfrastruktur für Erneuerbaren Strom und H2 ist eine Voraussetzung für die europäische Handlungsfähigkeit und Wettbewerbsfähigkeit im 21.Jahrhundert.

Für einen schnellen Hochlauf und bis zu einer günstigen Versorgung mit grünem Wasserstoff wird auf eine technologieoffene Ausgestaltung der H2- Regulatorik gesetzt.

Der Aufbau einer leistungsfähigen H2-Wirtschaft und die dafür notwendigen Import- und Transportinfrastrukturen sollen möglichst schnell vorangetrieben werden.

Es soll eine Elektrolysekapazität von 10 GW in 2030 erreicht werden, u.a. durch den Zubau von Offshore-Windanlagen.

Die Atomkraft wird weiter ausgeschlossen.

Die Planung und Realisierung von Strom- und H2-Netzen soll beschleunigt werden.

Speicher als eigenständige Säule des Energiesystems soll rechtlich definiert werden.

Rahmenbedingungen und Fördermaßnahmen werden darauf ausgerichtet, dass Deutschland Leitmarkt für E-Mobilität mit mindestens 15 Mio. Elektro-PKW im Jahre 2030 ist. Gemäß der Vorschläge der EU werden ab 2035 nur noch CO2-freie Fahrzeuge zugelassen. Der Markthochlauf von synthetischen Kraftstoffen wird unterstützt.

Die Energieversorgung wird über das Jahr 2045 nur mit nicht-fossilen Brennstoffen fortgesetzt werden.

4. Zu den abenteuerlichen Vorstellungen des IPCC zur Wirkung von CO2 auf das Klima

Die Rolle wie die Aussagen des IPCC werden weitgehend wie folgt gesehen:

„Das IPCC ist weder eine wissenschaftliche Organisation noch ein weiser Klimarat sondern ein Steigbügel, das Trittbrett für die Umverteilung des Weltvermögens…. mit dem „Paris Agreement 2015“ als derzeitiges Hauptwerk“. (1)

Seit den 1980er Jahren hat der IPCC sechs Sachstandsberichte herausgegeben.

Bei der Erstellung dieser Berichte ist zu unterscheiden zwischen Working Group I („The Physical Science Basis“), Working Group II („Impacts, Adaption, Vulnerability“) und Working Group III („Mitigation of Climate Change“).

Die Working Group I umfasste für die Erstellung des 5. Sachzustandsberichtes rd. 1870 Personen aus 102 Ländern, die Working Group II rd. 2230 Personen aus 103 Ländern und die Working Group III rd. 2040 Personen aus 159 Ländern. (1)

Die Beiträge des IPCC werden zudem von den Regierungen kritisch gesichtet und zensiert.

Ziel des IPCC ist die Untersuchung des ausschließlich menschlichen Einflusses auf die Klimaerwärmung, nicht die Untersuchung anderer natürlicher Ursachen auf den Klimawandel.

Am 04.08.2021 wurde nun der 6. IPCC-Sachstandsbericht der Arbeitsgruppe I über den Zustand des Weltklimas herausgegeben.

Die Wirkung des CO2 auf das Klima ist wieder einmal dramatisch, so wie die jeweils folgenden Berichte stets dramatischer waren als ihre Vorgänger.

Zu den Kernaussagen des 6. Zustandsberichtes:

1. Menschliche Aktivitäten haben Ozeane, Atmosphäre und Landflächen erwärmt. Zwischen 1850 bis 1900 und 2010-2020 hat die global gemittelte Oberflächentemperatur um 1,07 °C zugenommen.

2. Mit einer Wahrscheinlichkeit von 90-100% waren gut durchmischte Treibhausgase der Hauptgrund für die Erwärmung der Troposphäre, während der Beitrag von natürlichen Faktoren bei -0,1°C bis +0,1°C lag.

3. Der menschliche Einfluss ist mit mehr als 90% der Hauptantrieb für den Rückgang der Gletscher seit den 1990er Jahren sowie für den Rückgang des arktischen Meereises.

4. Es ist zu erwarten, dass die global gemittelte Oberflächentemperatur im Vergleich zum Zeitraum 1850-1900 um mehr als 1,5 °C ansteigen wird (Teil des Pariser Abkommens).

5. Vom IPCC wurden zahlreiche Modellrechnungen vorgenommen zur Berechnung der Temperaturentwicklung bei Verdopplung des CO2-Gehaltes in der Atmosphäre, ausgehend von 280 ppm in der vorindustriellen Zeit.

Bisher wurde der Bereich des Temperaturanstieges über die IPCC-Modelle mit 1,5-4,5 °C angegeben (5. Sachzustandsbericht), nun mit 2-5°C.

Im 6. Sachzustandsbericht werden also alle natürlichen Einflussgrößen als nicht existent betrachtet, obwohl insbesondere der Wasserdampf als das bei weitem dominierende Treibhausgas ebenso wie die Wolken enorme Auswirkungen auf die Oberflächentemperatur ausüben, ganz zu schweigen von der Wirkung der kosmischen Strahlen, die durch die Schwankungen der Einflüsse der Sonne wie der Wolkenbedeckung die Temperaturen bestimmen.

Zur Wirkung von CO2

Die Erdatmosphäre enthielt im Jahre 2020 410 ppm (0,0410%) CO2, die Atmosphäre enthält damit eine Kohlenstoffmenge von etwa 870 Gt. (3)

1 ppm CO2 entspricht bei vollkommener Durchmischung der Atmosphäre (vgl. später Bild 2) bilanzmäßig also 2,12 GtC.

In 2020 lagen die anthropogenen CO2-Emissionen bei etwa 37 Mrd. t CO2/a oder 37 Gt CO2/a bzw. 10 Gt Kohlenstoff/a.

Daraus errechnet sich der anthropogene CO2-Eintrag in die Atmosphäre zu 4,7 ppm (0,000 47%)/a bei einem Gesamt-CO2-Gehalt der Atmosphäre von 410 ppm (Bild 1). (2)

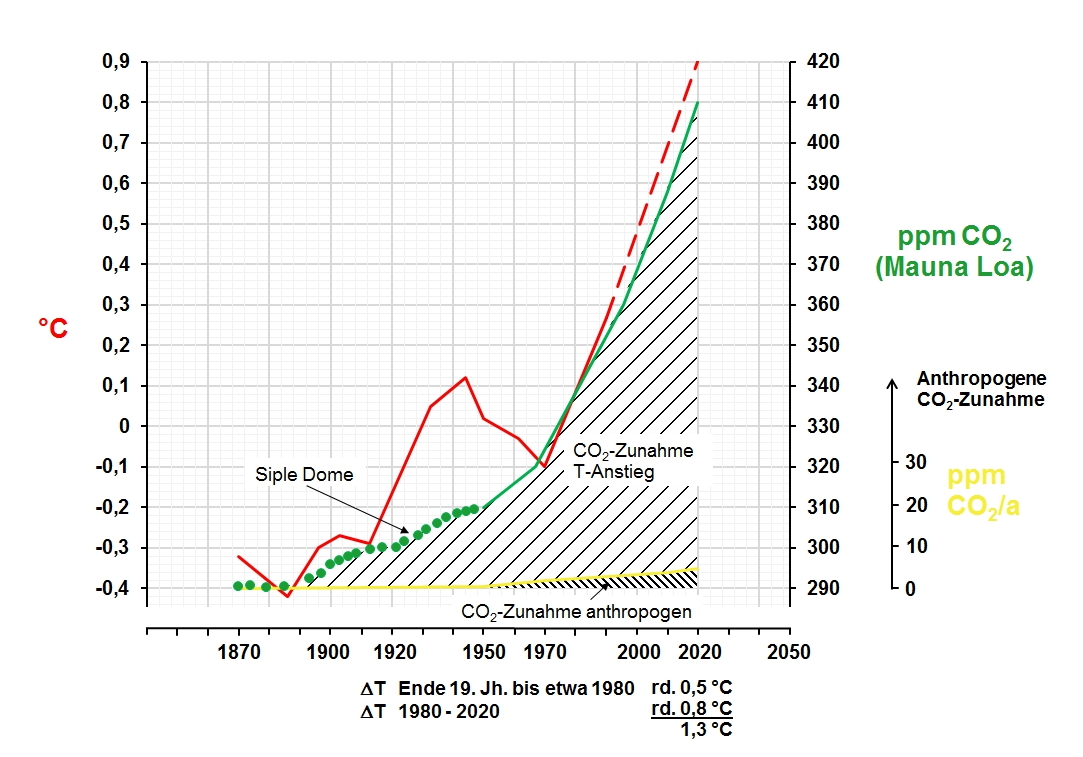

Bild 1: Anteil des anthropogenen CO2-Gehaltes in der Atmosphäre

Bild 1: Anteil des anthropogenen CO2-Gehaltes in der Atmosphäre

Bild 1 zeigt neben dem Temperaturanstieg eine Zunahme des CO2-Gehaltes der Atmosphäre von 1870 bis 2020 von 290 auf 410 ppm sowie eine Zunahme des anthropogenen Anteiles von 0 auf 4,7 ppm (ab 1959 Basis für die CO2-Messergebnisse Vulkan Mauna Loa auf Hawaii – vgl. Bild 2).

Damit steigt der

– Gesamt-CO2-Anteil von 1870 bis 2020 an um 410-290 = 120 ppm,

– der Anteil durch natürliche Einflussgrößen um 410-290-4,7 = rd. 115 ppm.

Die vom IPCC negierten natürlichen Einflussgrößen auf die CO2-Gehalte sind also deutlich zu erkennen, im Wesentlichen aus den Temperaturerhöhungen der Meere (Abnahme der CO2-Löslichkeit), Vulkane, etc.

Ausgerechnet der hier dargestellte geringe anthropogene CO2-Anstieg in der Atmosphäre von 0,05 ppm/a soll nun nach Aussage des IPCC 2 ppm/a betragen, wobei der restliche Anteil von 4,7 -2 = 2,7 ppm vom Land (Biosphäre) und den Ozeanen absorbiert werden soll.

Wo bleibt bei den Ausführungen des IPCC die Diskussion der natürlichen Einflussgrößen von 115 ppm seit Beginn der Industrialisierung?

Insgesamt wurden nach 1850 etwa 2000 Gt CO2 anthropogen in die Atmosphäre eingetragen oder 257 ppm, über natürliche Einflüsse etwa 4650 ppm. Das entspricht einem Anteil über anthropogene Quellen von nur 4,3%. (3)

Da das IPCC bei seinen Modellrechnungen zum Einfluss von CO2 auf die Temperaturerhöhung bei Verdopplung der CO2-Gehalte von 280 ppm in vorindustrieller Zeit auf 560 ppm nicht die anthropogenen CO2-Anteile berücksichtigt sondern von einer Gesamt-CO2-Menge ausgeht, sind seine Aussagen über seine Modellrechnungen zur Ermittlung eines Temperaturanstieges durch CO2 völlig wertlos.

Die in Bild 1 dargestellten gemessenen CO2-Gehalte der Atmosphäre (Mauna Loa) wie die gemessenen anthropogenen CO2-Gehalte können naturgemäß keine Aussagen zu den CO2-Quellen und CO2-Senken (CO2-Kreislauf) machen.

Die physikalischen, chemischen und biologischen Prozesse dieses CO2-Kreislaufes sind jedoch äußerst komplex und nicht messbar und daher nur unsicher zu quantifizieren. (3)

Vom „Global Carbon Project“ (GCP) sind zu den CO2-Quellen und CO2- Senken für 2020 folgende Aussagen gemacht worden:

a)Auf der CO2-Eintragseite wurden neben den CO2-Emissionen aus den fossilen Brennstoffen zusätzlich geringe Emissionen durch Änderung der Landnutzung z.B. Waldrodung angegeben

b) Die Ozeane sollen von dem anthropogen in die Atmosphäre eingetragenen CO2 10,3 Milliarden t CO2 aufgenommen haben

c) Ebenso soll durch die CO2-Pflanzenaufnahme ein Betrag von 11,4 Milliarden t CO2 von dem anthropogen eingetragenen Anteil entzogen worden sein (von den Satelliten wurde eine starke Zunahme der Begrünung der Erde (Photosynthese) festgestellt)

d) Damit verbleibt eine CO2-Zunahme für die Atmosphäre von etwa 2 ppm

Die unter b) genannte CO2-Aufnahme der Ozeane ist wegen des Temperaturanstieges der Meere nicht möglich, außerdem ist die damit verbundene CO2-Abnahme der Atmosphäre mit 1,3 ppm gering (1 ppm entspricht 2,12 GtC).

Ähnliches gilt für den CO2-Abbau der Atmosphäre durch die Zunahme der Begrünung der Erde mit 1,5 ppm.

Die unter b) und c) errechnete CO2-Verminderung des CO2-Gehaltes des anthropogen eingebrachten Anteiles errechnet sich dann zu 4,7- 1,3-1,5 = 1,9 ppm, der nach der Vorstellung des GCP in der Atmosphäre verbleibt.

Zur näheren Quantifizierung des CO2-Anstieges der Atmosphäre

Zum besseren Verständnis der mit Hilfe von Bild 1 vorgenommenen Aussagen und der genannten Fragestellung werden zunächst

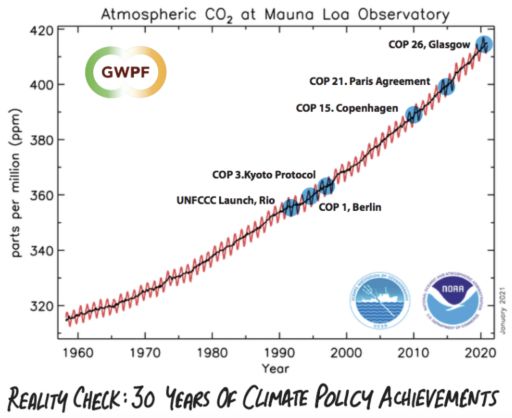

a) die gemessenen CO2-Gehalte der Atmosphäre auf dem Vulkan Mauna Loa auf Hawaii seit 1958 (Bild 2) mit den diversen Klimagipfeln (Conference of the Parties – COP) dargestellt (4)

Bild 2: CO2-Messungen auf Mauna Loa Hawaii und die Klimagipfel

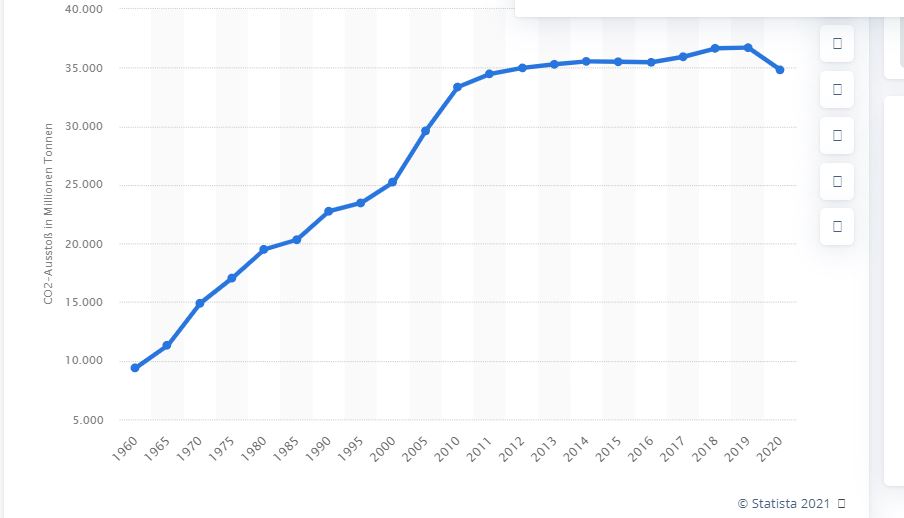

b) ebenso die gemessenen weltweiten CO2-Emissionen der letzten Jahre (Bild 3). (5)

Bild 3. Anstieg der gemessenen weltweiten CO2-Emissionen

Die Sägezähne der gemessenen Daten in Bild 2 verdeutlichen den Einfluss der Biosphäre (Photosynthese, etc.) auf die jährlichen Schwankungen der CO2-Gehalte mit Maxima jeweils im Mai und Minima im September. Diese kurzzeitigen Schwankungen weisen auf eine unmittelbare schnelle Durchmischung des CO2 mit der gesamten Atmosphäre hin.

Der Anstieg der CO2-Gehalte in der Atmosphäre liegt nach dem Jahre 2000 bei etwa 2 ppm/a, wie er vom IPCC/GCP in ihren Überlegungen angesetzt wird.

Bild 2 zeigt weiterhin, dass die in den letzten 30 Jahren auf den Klimagipfeln vorgenommenen Maßnahmen zur Absenkung des CO2-Gehaltes der Atmosphäre wirkungslos geblieben sind, nicht einmal eine Verringerung des Anstieges ist zu erkennen.

Dagegen zeigt der Anstieg der weltweiten gemessenen CO2-Emissionen in Bild 3 deutlich, dass die Maßnahmen der Klimagipfel sehr wohl eine deutliche Verminderung des Anstieges des anthropogenen Eintrages gebracht haben, der aber nicht in Bild 2 zu erkennen ist.

Der Anstieg der weltweiten CO2- Emissionen nimmt nach Bild 3 in den letzten 10 Jahren (2010-2020) nur von etwa 33 auf 37 Milliarden Tonnen zu bzw. 33 auf 37 Gt CO2.

Nun soll der CO2-Anstieg der Atmosphäre nach den Aussagen des IPCC/GCP bei 2 ppm/a ausschließlich über die anthropogenen CO2-Einträge erfolgen.

Wenn dies zuträfe, müssten anthropogen C02-Emissionen jährlich von

2 ppm CO2 x 2,12 Gt C = 4,24 Gt C oder 15,5 Gt CO2

in die Atmosphäre eingebracht worden sein oder 155 Gt CO2 bzw. 155 Milliarden t CO2 in 10 Jahren. Eingebracht wurden jedoch in 10 Jahren nur 4 Milliarden CO2 (Bild 3).

Die Vorstellung des IPCC/GCP zum CO2-Anstieg aus anthropogenen Quellen von 2 ppm/a ist also erschreckend weit von der Faktenlage entfernt, d.h. auch hier wird unmissverständlich anhand der gemessenen Originaldaten sichtbar, dass der CO2-Anstieg der Atmosphäre praktisch ausschließlich den natürlichen CO2-Quellen folgt.

Diese Aussage ist ein Offenbarungseid für die seit den 1980er Jahren verbreiteten Angst-einflößenden Modell- Vorstellungen des IPCC zum Verhalten von CO2 auf die Temperaturerhöhung, für alle COP`s, etc. ebenso wie für die deutschen Organisationen wie PIK und die zuständigen MaxPlanck- Institute. Peinlich sind auch die jüngsten Entscheidungen des Bundesverfassungsgerichtes zur Verschärfung der Maßnahmen zum schnelleren Abbau der CO2-Emissionen in Deutschland.

Alle CO2-Minderungsüberlegungen national wie international laufen daher hoffnungslos ins Leere.

Der vernachlässigbare Einfluss des anthropogenen CO2-Anteiles auf den Temperaturanstieg hatte sich bereits auch im Corona-Jahr 2020 gezeigt, als trotz der Absenkung des anthropogenen CO2-Eintrages von 17% in die Atmosphäre eine Verminderung des Temperaturanstieges nicht gefunden werden konnte. (2)

Interessant sind nun auch die Aussagen des WMO (World Meteorlogical Organisation): „Wegen der Pandemie emittierte die Weltwirtschaft 2020 etwas weniger Treibhausgase als in den Jahren zuvor. Die Konzentration von CO2 stieg dennoch bedrohlich weiter“…..“Der Anstieg im Vergleich zum Vorjahr sei sogar noch höher ausgefallen.“ (6)

Zur gleichen Aussage kommt die CLINTEL (Climate Intelligence Foundation) in Zusammenarbeit mit dem ICSF (Irish Climate Science Forum): „Der durch COVID verursachte Rückgang der Treibhausgasemissionen macht sich im atmosphärischen CO2 nicht bemerkbar“. (7)

Die Vorstellung des IPCC zu den über hunderte von Jahren in der Atmosphäre verbleibenden weltweiten CO2-Emissionen aus der Verbrennung von Kohlenstoff ist nicht nachvollziehbar, da

a) die Durchmischung des C02 in der Atmosphäre komplett ist, sogar die monatlichen unterschiedlichen Reaktivitäten der Biosphäre sind deutlich sichtbar (Bild 2)

b) bei einem CO2-Eintrag von nur etwa 4,3% über menschliche Emissionen bezogen auf den Gesamt-CO2-Eintrag seit dem Beginn der Industrialisierung fehlt es schlicht an anthropogener CO2-Masse, um die vom IPCC vorgegebenen Angst-verbreitenden CO2-Anstiege zu begründen

c) das physikalisch-chemische Verhalten von CO2 ist unabhängig von seiner Entstehungsgeschichte, ob aus der Kohlenstoffverbrennung, der Freisetzung aus den Meeren, etc.

5. Die Klimaschutzmaßnahmen im Koalitionsvertrag vom November 2021 im Lichte der Fakten

Um nach dem Desaster des Einflusses von anthropogenem CO2 auf das Klima (Kapitel 4) nun die Folgen der Klimaschutzmaßnahmen nach dem Beschluss des Koalitionsvertrages dennoch beurteilen zu können, wird in der folgenden Diskussion von den im Jahre 2019 angefallenen Stromkennzahlen ausgegangen, da die Kennzahlen von 2020 durch Corona nicht als repräsentativ angesehen werden können (Tafel 1). (8)

| 2019 | ||||

| TWh | % | GWeff. | GWinst. | |

| Braunkohle | 113 | 18,7 | 12,9 | |

| Steinkohle | 56 | 9,2 | 6,4 | |

| Kern | 74 | 12,2 | 8,4 | |

| Erdgas | 91 | 15 | 10,4 | |

| Öl | 5 | 0,8 | 0,6 | |

| Summe konv. | 339 | 55,6 | 38,7 | |

| Wind offshore | 102 | 16,8 | ||

| Wind onshore | 24 | 4 | ||

| Solar | 46 | 7,6 | ||

| Summe fluk. | 172 | 28,4 | 19,6 | 110 |

| Biomasse | 44 | 7,3 | ||

| Wasserkraft | 19 | 3,1 | ||

| Sonstige | 26 | 4,3 | ||

| Hausmüll | 6 | 1 | ||

| Summe nicht fluk. | 95 | 15,7 | 10,8 | |

| Summe gesamt | 606 | 100 | 69,1 | |

| Stromexport | 75 | |||

| Stromimport | 38 | |||

| Stromexportsaldo | -37 | -4,2 | ||

| 569 | 64,9 |

Tafel 1

Nach dem Beschluss des Koalitionsvertrages soll der Ausstieg aus der Kohle zu 80% bis 2030 über den Einsatz von alternative Energien erfolgen bei einer Stromerzeugung von 680-750 GWh oder 82 GW (als Mittelwert), wohlwissend, dass der Schwankungsbreite des Strombedarfes z.Z. bei einer mittleren Leistung von etwa 70 GW etwa zwischen 40 und 85 GW pendelt.

Damit liegt die Sollleistung über Wind und Sonne bei 82×0,8 = 65,6 GW.

Da aber gleichzeitig 10 GW über Wasserstoff in 2030 nach dem Koalitionsvertrages beigestellt werden sollen, außerdem in 2019 7,2 GW über Biomasse und Wasserkraft bereits beigesteuert werden (Tafel 1), errechnet sich eine aufzubringende Leistung über Wind und Sonne für 2030 zunächst zu

65,6-10-7,2 = 48,4 GW.

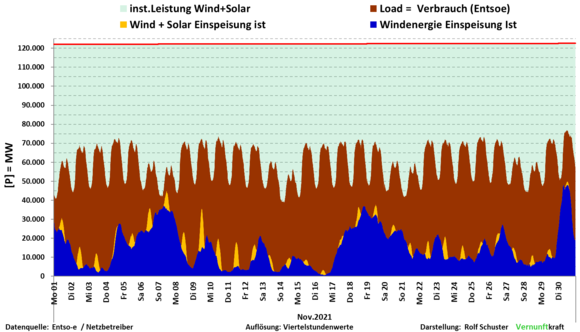

Nun sind die Stromerzeuger Wind und Sonne extrem fluktuierend. Sie können im Extremfall zwischen praktisch null und ihrer installierten Leistung schwanken, von Dunkelflauten im Winter abgesehen.

Das bedeutet – um eine mittlere Stromleistung über Wind und Sonne von 48,4 GW in 2030 aufrecht zu erhalten -, dass stets die Hälfte der zitierten 48,4 GW, also 24,2 GW, mit Hilfe von Wasserstoff gespeichert werden muss, um sie bei Stromerzeugungsleistungen der Wind- und Solaranlagen unter 24,2 GW (entsprechend der Leistung von 24 Großkraftwerken) wieder einspeisen zu können (vgl. später Bild 4).

Hierbei wird vernachlässigt, dass Stromspitzen teilweise weit über die hier geforderten 48,4 GW hinausschießen können.

Zu keinem Zeitpunkt kann also ausschließlich nur über Wind und Sonne die von den Verbrauchern geforderte Stromleistung dargestellt werden. Allgemein gilt dann für die Stromspeicherung:

Stromspeicherleistung = GW aus Wind+Sonne/2 (Gleichung 1) (8)

Ziel der H2-Technologie ist es, die ausgewiesene erforderliche Stromspeicherleistung über Wasserstoff zu decken.

Der Energieaufwand für die Wasserelektrolyse ist gewaltig. (nähere Angaben unter (8))

Für die Erzeugung von H2 mit anschließender Verstromung für die Lösung des Speicherproblems muss ein 4-Stufen-Plan angewandt werden:

– Stufe 1: Stromerzeugung über Wind und Sonne

– Stufe 2: H2O-Elektrolyse mit Wirkungsgrad 70%

– Stufe 3: H2-Speicherung in einem Netz mit Verlusten von 10%.

– Stufe 4: H2-Verbrennung mit Rückverstromung, Wirkungsgrad 60%

Damit sind die aus dem Schrifttum bekannten Wirkungsgrade bewusst günstig angesetzt.

Bei den angesetzten Wirkungsgraden ergeben sich folgende Verluste:

– Stufe 2: 33/0,7 = 47 KWh/kg H2

– Stufe 3: 1×0,9 = 0,9 kg H2. Bedeutung für Stufe 2: 47/0,9 = 52 KWh/kg H2

– Stufe 4: 52 KWh/kg H2/0,6 = 87 KWh/kg H2

Wirkungsgrad der Stufen 1-4 damit: 33/87 bzw. 40 %, der Stufen 1-3: 33/52 = 63%.

Die Verlustbetrachtungen für dieses 4-Stufen-Verfahren von 40% bedeuten für die Berechnung der Energieaufwendungen für die Lösung des Stromspeicherproblems die Erweiterung der Gleichung 1 zunächst wie folgt:

Stromspeicherleistung = GW aus (Wind + Sonne)/2/0,4

oder = GW aus (Wind + Sonne)/2 x2,5 (8)

Diese Stromleistung muss nun bewegt werden zur Lösung des Speicherproblems. Da aber die Leistung aus (Wind + Sonne)/2 bereits eingebracht worden ist, errechnet sich die zusätzlich aufzubringende Leistung zur Lösung des Speicherproblems nach

GW aus (Wind + Sonne)/2 x 1,5 (Gleichung 2 ) (8)

oder für 2030 zu Stromspeicherleistung = 48,4/2 x 1,5 = 36,7 GW,

d.h. für die Speicherung von 1 GW sind 1,5 GW über Wasserstoff aufzubringen.

Wenn nun nach den Koalitionsbeschluss in 2030 10 GW über Wasserstoff beigestellt werden sollen, dann können mit 10 GW über Wasserstoff nur 10/1,5 = 6,7 GW für die Stromspeicherung geliefert werden.

Dieser Betrag muss dann – um ein komplettes Bild für den Energieaufwand über Wind und Sonne für die Speicherung zu erhalten -, zu den 48,4 Gw addiert werden:

48,4 + 6,7 = 55,1 GW

Damit erhöhen sich die geforderten Stromerzeugungsleistungen über Wind und Sonne auf 55,1 GW mit einem erforderlichen Speichervolumen von 27,5 GW.

Damit liegt nach Gleichung 2 die aufzubringende Leistung zur Lösung des Speicherproblemes in 2030 nun bei

Stromspeicherleistung = 55,1/2 x 1,5 = 41,3 GW

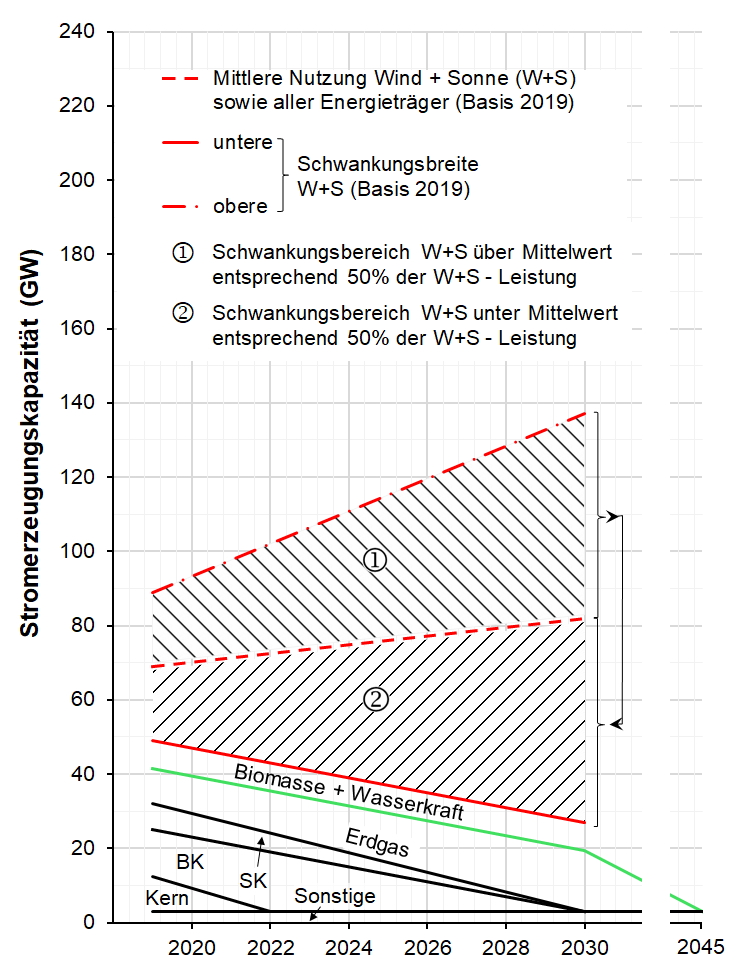

Bild 4: Energieverbrauch Strom mit Stromspeicherung über Umstellung auf Wasserstoff

In Bild 4 sind nun neben den bis 2030 abzubauenden Kohlenstoffträgern wie Braunkohle und Steinkohle (die letzten Kernkraftwerke schließen in 2022) die zunehmenden alternativen Energien Wind und Sonne dargestellt (die Stromleistungen von Biomasse und Wasserkraft wurden wie in 2019 belassen).

Durch den in 2030 auf 80% begrenzten Anteil aus alternativen Energien kommt dem Erdgas eine besondere Rolle zu:

Der Erdgasanteil muss von 10,4 GW in 2019 auf 16,7 GW in 2030 zur Deckung des begrenzten Anteiles der Stromerzeugung über Wind und Sonne angehoben werden.

In Bild 4 wird deutlich sichtbar, dass zur Deckung des erforderlichen Speichervolumens von 27,5 GW in 2030 (die Stromleistung von etwa 27 Großkraftwerken) der zwischen den Stromleistungen von Wind und Sonne von 82 bis 136,9 GW anfallende schwankende Strom von 27,5 GW gespeichert werden muss, um ihn im Stromschwankungsbereich von 27,1 und 82 GW wieder einzuspeisen, um in 2030 im Mittel neben Erdgas, Biomasse und Wasserkraft eine Stromleistung von insgesamt 82 GW sicher zu stellen.

Klimaneutralität soll in 2045 erreicht werden durch Zurückfahren des Erdgasanteiles (Bild 4).

Was für ein hoffnungsloses Konstrukt! Wie sollen unter diesen Bedingungen die geforderten ständig schwankenden Stromleistungen der Verbraucher gezielt angepasst werden? Und das in einem Industrieland wie Deutschland, in dem eine gesicherte und dem Verbrauch strikt angepasste Stromversorgung unabdingbar ist.

Die insgesamt in 2030 auszubringende Stromleistung über Wind und Sonne einschließlich für die Umstellung auf die Wasserstofftechnologie beträgt dann:

der aus Gründen der Übersichtlichkeit nicht in Bild 4 eingetragen wurde.

der aus Gründen der Übersichtlichkeit nicht in Bild 4 eingetragen wurde.

Da durch den Ausstieg aus der Kohle in 2030 neben der Stromherstellung alle Sektoren auf die ausschließliche Stromerzeugung über Wind und Sonne einschließlich der notwendigen Stromspeicherung über Wasserstoff umgestellt werden sollen, ist das gleiche Verfahren auch für die übrigen Sektoren (die Landwirtschaft wurde nicht einbezogen) angewandt worden mit folgenden Ergebnissen (vgl. (8)):

Ausgehend von der Stromleistungsbereitstellung von etwa 69 GW in 2019 bedeutet die Umstellung der Sektoren auf Elektrizität über Wasserstoff als Speichermedium eine Vermehrung des Stromleistungsbedarfes um das etwa 6-Fache mit den hier nicht behandelten Problemen mit den Netzen sowohl für Strom als auch für Wasserstoff.

Nun werden für die Beschaffung derartiger Stromleistungen über Wind und Sonne enorme Flächen benötigt. Werden die im Koalitionsvertrag zitierten 200 GW über Solaranlagen erzeugt, verbleiben für Wind 395-200 = 195 GW.

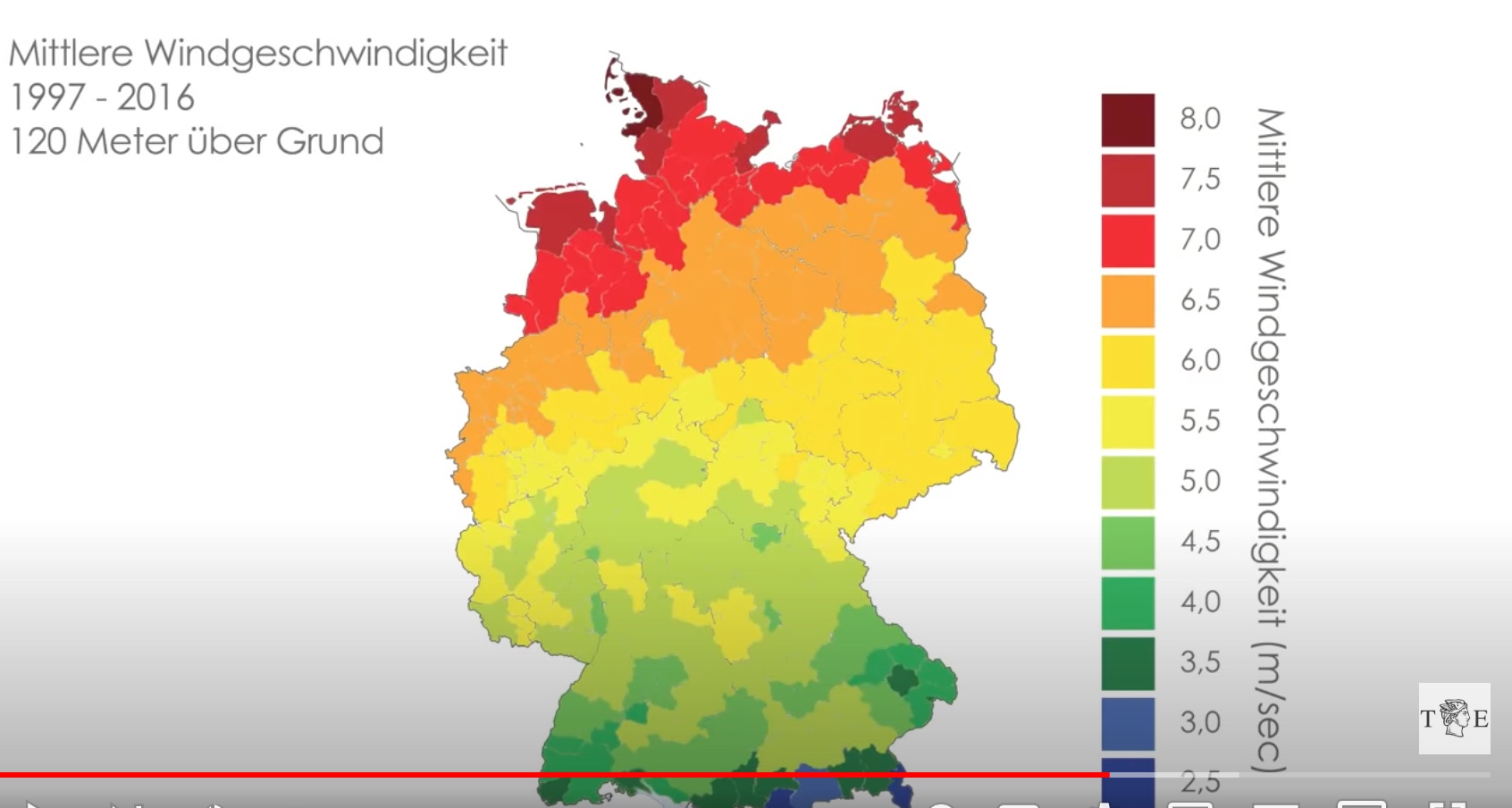

Die mittleren Nutzungsgrade der Windanlagen nach den neuesten Stromkennzahlen von November 2021 liegen bei 22%. (9) Der Flächenbedarf für die Solaranlagen wurde nicht weiterverfolgt.

Für den Flächenbedarf für Windanlagen kann für 5 MW-Anlagen von einem km2 ausgegangen werden (Zufahrtswege nicht eingerechnet).

Wird bei der Umstellung auf die H2-Technologie zur Lösung des Speicherproblems von 195 GW über Windanlagen ausgegangen, errechnet sich der Flächenbedarf für die diskutierten Sektoren zu

195 000/0,22/5 = 170 000 km2.

Die Fläche Deutschlands beträgt 357 000 km2, davon 182 000 km2 für Landwirtschaft, 111 000 für Wald, 50 000 für Siedlung und Verkehrsfläche.

Damit läge der Flächenbedarf alleine über die Windanlagen bezogen auf die Fläche Deutschlands bei etwa 48%.

Deutschland könnte also flächenmäßig nur mit einem Bruchteil zu dieser H2- Technologie beitragen (in der Regierungserklärung wird von einem Flächenbedarf von 2% ausgegangen), d.h. Deutschland wäre bei der für das Funktionieren der deutschen Industrie wichtigen Stromversorgungssicherheit praktisch ausschließlich vom Ausland abhängig. Im Übrigen planen 35 Staaten bereits die H2-Technologie.

Um in 2030 eine ausreichende Stromversorgung über Wind, Sonne und Wasserstoff für das Stromspeicherproblem bewerkstelligen zu können, müssten in 8 Jahren eine unvorstellbare Kapazität an Anlagen aufgebaut werden – zum überwiegenden Anteil im Ausland.

Erinnert sei nebenbei an das bedauerliche Ende des Gemeinschaftsunternehmens Desertec mit Marokko.

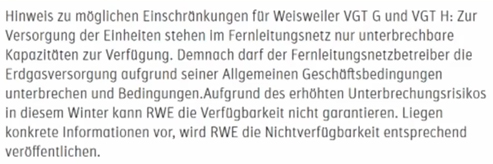

Wenn die hier beschriebene komplizierte Herleitung der Stromspeicherung über Wasserstoff nicht funktioniert – wovon auszugehen ist -, müsste das geforderte Stromspeichervolumen von 27,5 GW in 2030 über Erdgaskraftwerke beigestellt werden.

GuD-Gaskraftwerke haben Wirkungsgrade von etwa 60%.

Die übliche Leistung von GuD-Anlagen liegt bei etwa 0.6 GW, erforderlich wären dann 27,5/0,6 = 46 Anlagen.

Der Preis der Anlagen liegt bei etwa 0,5-1,0 Mrd. Euro/Anlage, die frühestens in 5-6 Jahren ans Netz gehen könnten. (11)

Abgesehen davon, dass dies nicht der Weg zur sog. Klimaneutralität wäre, wäre für das Betreiben dieser Gaskraftwerke die gesamte Einspeiseleistung der Pipeline Nordstream 2 erforderlich. (12)

Die in Deutschland derzeit verfügbaren Gasspeicher sind nicht für hohe Ausspeiseleistungen gebaut.

Stromversorgungssicherheit

Es ist ein hohes Ziel, mit Hilfe von Stromspeichern über Wasserstoff stets das sensible Gleichgewicht zwischen Stromleistungsangebot und -verbrauch aufrecht zu erhalten.

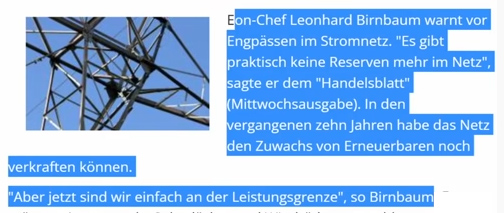

Die jüngste Vergangenheit hat bereits gezeigt, dass Deutschland bei dem jetzigen Ausbau der Wind- und Solaranlagen durch ihre stark fluktuierenden Leistungen bereits stündlich bis deutlich über 15 GW unter- oder überversorgt sein kann (8) (entsprechend der Leistung von 15 Atomkraftwerken), wofür das Ausland freundlicherweise noch aushilft, solange die Nachbarn dazu in der Lage sind.

Bereits in 2018 mussten Stromgroßverbraucher wie Aluminiumhütten, Walzwerke, etc. zur Aufrechterhaltung der Stabilität des deutschen Stromnetzes 78mal abgeschaltet werden.

Auch der Stromausfall in Texas im Januar 2021 mit zahlreichen Toten darf nicht unerwähnt bleiben.

Nachdem im Januar und Juli dieses Jahres ein Blackout im europäischen Stromnetz gerade noch abgewendet werden konnte, setzte der plötzliche Rückgang der Solarleistung in Deutschland am 14.08 2021 durch den Sonnenuntergang um 30 GW (installierte Solarkapazität 57 GW) auf null dem Stromnetz ordentlich zu.

Zahlreiche Kohlekraftwerke mussten angeworfen werden, stromintensive Industrien still gesetzt werden, das Gleiche gilt für andere Großverbraucher quer durch die Republik, schließlich musste das Ausland ordentlich aushelfen.

Nun soll die Stromkapazität der Erneuerbaren weiter ausgebaut werden: nach den Berechnungen der „Denkfabrik Agora“ um das 3-fache.

Dann würde bei gleichen Wetterverhältnissen die plötzlich fehlende Solarkapazität um 3 x 30 = 90 GW ansteigen.

Auch hier sind erhebliche Zweifel angebracht, ob eine derartig schnelle Abweichung der Stromerzeugung über Stromspeicher aufgefangen werden könnte.

Kosten

Um das Desaster der vorgesehenen Dekarbonisierung Deutschlands komplett zu machen, hier Aussagen zu den zu erwartenden Kosten.

Die bisher durchgeführten Maßnahmen zur Absenkung des CO2-Ausstoßes haben bereits jetzt zu einer starken allgemeinen Verteuerung geführt. Deutschland ist bereits jetzt das Land mit den höchsten Strompreisen.

In ganz Europa werden bereits Rufe nach einer Deckelung der Energiekosten laut.

Die Bundesregierung hat bereits als erste Maßnahme die EEG-Umlage auf 6,5ct/KWh abgesenkt, die ansonsten auf 9,7 ct/KWh angestiegen wäre.

Welche Kosten sind nun bis zur Klimaneutralität zu erwarten?

Die Förderbank KfW berichtet, dass 5 Billionen € an Investitionen nötig wären, um Deutschland in allen Sektoren klimaneutral zu machen. (FAZ, 08.10.2021)

Nach einer Studie von McKinsey kostet die Dekarbonisierung der deutschen Wirtschaft 6 Billionen €, 240 Milliarden/a über 25 Jahre bis 2045. (10)

Die „Glasgow Financial Alliance for Net Zero (GFANZ)“ meldet die kaum vorstellbare Summe von 130 Billionen Dollar als Beitrag zur Senkung der CO2-Emissionen bis auf Netto-Null in 2050, das 9-fache BIP der EU-Länder. (FAZ, 04.11.2021)

- Schlussbetrachtung

Ungeachtet dieser mit fundamentalen Fehlern behafteten IPCC-Vorstellungen zum Verhalten des CO2 auf das Klima folgt Deutschland wie die Lemminge dem teuersten „Missverständnis“ in der jüngeren Geschichte, wohlgemerkt bei einem nicht messbaren CO2-Eintrag Deutschlands in die Atmosphäre von nicht messbaren 0,09 ppm (0,000 009%). (2)

Ein Rückblick in die Klimageschichte der Erde zeigt 10-fach höhere CO2-Gehalte der Atmosphäre, die der Erde bestens bekommen sind.

Dennoch steigt Deutschland sowohl aus der Kernkraft wie aus der Kohle aus wie kein anderes Land auf dieser Erde und bestimmt damit freiwillig sein technologisches und damit wirtschaftliches Ende.

Andere Länder öffnen sich wieder der Kernenergie als eine gesicherte Stromerzeugung. Frankreich plant 6 neue Kernkraftwerke. Zudem will das Land in großem Stil in neue Reaktoren mit geringer Leistung („Small Modular Reactor“) investieren, ebenso Länder wie USA, Großbritannien, China, Russland.

Weltweit werden z.Z. 444 Kernkraftwerke betrieben, weitere 52 befinden sich im Bau.

Der Dual-Fluid-Reaktor ist das Konzept eines Kernkraftwerkes der 4.Generation, das mit flüssigen Kernbrennstoffen betrieben wird, der auch den bereits angefallenen Atommüll verarbeiten kann.

Das IPCC sieht seine Rolle und Aufgabe einseitig ausschließlich in der Erforschung des anthropogenen Einflusses von CO2 auf das Klima, natürliche Einflüsse werden ausgeblendet, wohlwissend, dass die Kenntnis anderer natürlicher Einflüsse auf das Klima die notwendige Panik für das Fließen der Gelder für die Klimaforscher beenden würde.

So bleiben Fragen z.B. zum Einfluss der Sonne auf die Erderwärmung völlig ausgeblendet.

Schade um unsere geradezu religiös verblendete Jugend, die sich ahnungslos dieser CO2-Angst-Vorstellung hingibt und noch nicht erkannt hat, dass sie bald Opfer ihrer eigenen Umtriebe sein wird.

Wie sagten schon die Römer:“ Quidquid agis, prudenter agas et respice finem““ (was immer du tust, handele klug und bedenke das Ende).

7. Quellen

1.Jankowiak, H.: „Das IPCC – das „Intergovernmental Panel on Climate Change” – der “Weltklimarat” – im Dienste der Politik, nicht der Wissenschaft; EIKE 04.10.2021

2. Beppler, E.: „Zur Fragwürdigkeit der Gründe für den angeblichen anthropogenen CO2-Anstieg in der Atmosphäre und seinem möglichen Einfluss auf das Klima“; EIKE, 18.10 2020

3. Beppler, E.: „Quantifizierung des marginalen anthropogenen CO2-Gehaltes in de Atmosphäre – ein seit Jahren überfälliger Schritt“; EIKE, 26.12,2020

4. Global Warming Policy Forum: „IPCC-Report bestätigt, dass die Klimapolitik gescheitert ist: es ist Zeit, etwas anderes zu tun“; EIKE, 10.08.2021

5. Statista

6. Limburg, M.: „Weltweite COVID 19 begründete Lockdowns ändern am Anstieg der CO2- Konzentration nichts – WMO fordert trotzdem CO2-Reduktiom zu verstärken“; EIKE, 30.10 2021

7. Wojick, D.: „CLINTEL listet die Fehler des IPCC für COP 26 auf“; EIKE, 02.11.2021

8. Beppler, E.: „Die Anwendung der H2-Technologie in allen Sektoren verschlingt unlösbare Mengen an Energie und Flächen“; EIKE, 11.07 2021

9. Schuster, R.: Mitteilung 01.12.2021

10. www.mckinsey.de/news/presse

11. Willenbuecher, R.: Es riecht nach Gas und spät dämmert die Erkenntnis“; EIKE, 15.11.2021

12. „Wer liefert soviel Gas um Deutschland zu versorgen? Und womit soll es transportiert werden?“, EIKE,11.10.2021