Der konventionelle Treibhausansatz unterstellt einen fehlerhaften 24h-Tagbogen der Sonne

von Uli Weber

Vorwort: Es wäre sehr schön, wenn sich die Diskussion im Kommentarbereich diesmal auf den Beitrag selbst fokussieren würde. Denn eine physikalische Interaktion zwischen Sonneneinstrahlung und Materie (Erwärmung dieser Materie durch Bestrahlung) kann nur dann stattfinden, wenn beides physikalisch auch tatsächlich aufeinander trifft. Und das ist für jede Ortslage ausschließlich innerhalb des Tagbogens der Sonne der Fall, ganz egal, was rein mathematische 24h-Tag+Nacht-Mittelwerte auch immer aussagen mögen…

Der astronomische Tagbogen wird auf Wikipedia folgendermaßen beschrieben, Zitat:

„Als Tagbogen, seltener auch Tagesbogen, wird in der Astronomie jener Teil der scheinbaren Sternbahn bezeichnet, der für einen bestimmten (geographischen) Ort und ein gewisses Datum berechnet über dem mathematischen Horizont liegt. Seine Länge entspricht damit idealisiert der Zeitspanne zwischen Aufgang und Untergang eines Gestirns – jedoch ohne die astronomische Refraktion zu berücksichtigen, weshalb die tatsächliche Dauer einige Minuten länger ist. Der ‚wahre Tagbogen‘ zieht darüber hinaus die jeweiligen topographischen Verhältnisse in Betracht, also die Höhe des Standorts und den Verlauf des Landschaftshorizonts bzw. auf dem Meer die Kimmtiefe.“

Der konventionelle Faktor4-Tag=Nacht-Ansatz betrachtet die Erde über den 24h-Tag aus der Perspektive der Sonne. Dazu wird aus der täglich einfallenden solaren Energiemenge der Tag+Nacht-Mittelwert einer imaginären 24h-Durchschnittsstrahlungsleistung für die gesamte Erde berechnet. Es dürfte aber für Jedermann, Jedefrau und Jedengender einsichtig sein, dass eine physikalische Interaktion zwischen der spezifischen solaren Strahlungsleistung und der Materie einer Ortslage auf der Erde (Erwärmung) nur zwischen Sonnenaufgang und Sonnenuntergang möglich ist. Folglich muss anstelle einer mathematischen 24h-Durchschnittsstrahlungsleistung die tatsächliche Interaktion während des Tagbogens der Sonne zwischen Auf- und Untergang für jede individuelle Ortslage betrachtet werden.

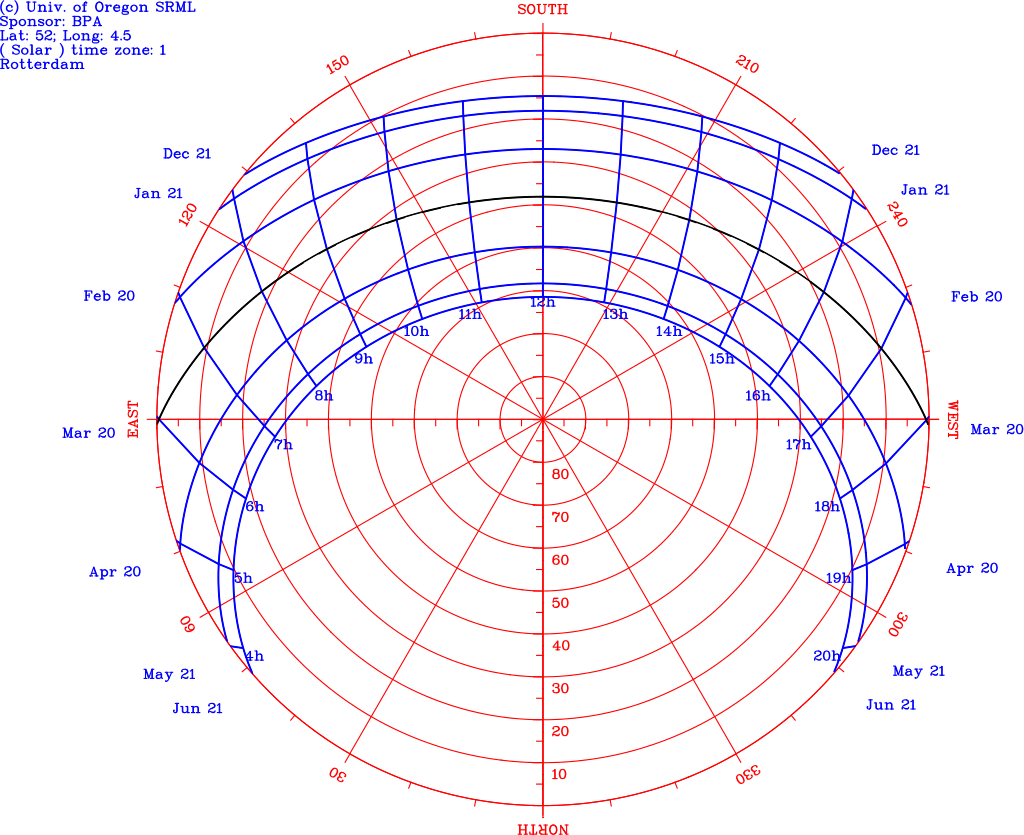

Abbildung 1: Die Variation des Tagbogens der Sonne in Mitteleuropa @ 52°N

Abbildung 1: Die Variation des Tagbogens der Sonne in Mitteleuropa @ 52°N

Quelle: Wikipedia – University of Oregon GNU General Public License

Zur Taglänge heißt es auf Wikipedia, Zitat:

„In nördlichen mittleren Breiten variieren die Tagbögen der Sonne im Jahreslauf ungefähr zwischen 8 Stunden (um die Wintersonnenwende: Dezember/ Januar) und 16 Stunden (um die Sommersonnenwende: Juni/ Juli), und dementsprechend die Tageslänge. Zum Datum der Tag-Nacht-Gleiche hat der Tagesbogen 12 Stunden, dann beträgt die Differenz zwischen dem Azimut des Sonnenaufgangs exakt im Osten und dem des Sonnenuntergangs exakt im Westen genau 180°.“

Wenn wir also für eine Ortslage in Mitteleuropa @ 52°N einmal die über den Tag X eingestrahlte Energiemenge mit EX@52 [Ws/m²] bezeichnen, dann ergibt sich folgende Ungleichung:

SmaxX@52 [W/m²] > EX@52/Stunden@x des Tagbogens [W/m²] >= EX@52/24h [W/m²]

mit SmaxX@52 = maximale spezifische Strahlungsleistung der Sonne zur Mittagszeit am Tag X

Der Durchschnitt der solaren Strahlstärke über den Tagbogen ist also kleiner als das mittägliche solare Maximum. Und der Durchschnitt über den astronomischen 24h-Tag ist wiederum kleiner als der solare Durchschnitt über den realen Tagbogen. Lediglich am geographischen Pol der Sommerhemisphäre herrscht ein 24h-Tag mit einem konstanten solaren Zenitwinkel. Schon zwischen Pol und Polarkreis ist der Zenitwinkel dagegen nicht mehr konstant, auch wenn dort zeitweise die Sonne über 24h scheint. Nur am Sommerpol entsprechen sich daher das Maximum der solaren Strahlungsleistung über den Tagbogen und das solare 24h-Mittel; für den Pol der Winterhemisphäre ist das Ergebnis dagegen null (=Nacht). Der Tagbogen der Sonne darf also nicht generell mit dem 24h-Tag gleichgesetzt werden, wie das beim 24h-Faktor4-Tag=Nacht-Ansatz fälschlicherweise geschieht.

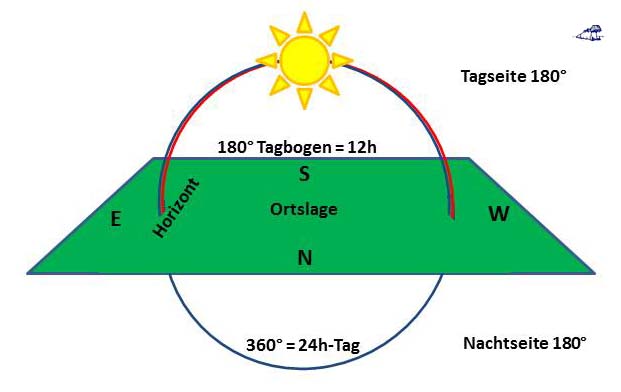

Zum besseren Verständnis stellt die nachfolgende Abbildung 2 eine vereinfachte Prinzipskizze für das Verhältnis zwischen dem Tagbogen der Sonne und dem 24h-Tag im Äquinoktium dar:

Abbildung 2: Schematische Prinzipskizze mit dem Vergleich zwischen dem Tagbogen der Sonne (rot=180°) und dem astronomischen 24h-Tag (blau=360°) im Äquinoktium (stark vereinfacht, nicht winkeltreu)

Eine einfache Abschätzung für die Äquinoktien: Die maximale spezifische Strahlungsleistung der Sonne zur Mittagszeit ist auf jeden Fall größer als das Mittel der spezifischen Strahlungsleistung über den 12h-Tagbogen (180°), in das ja auch die Minima nach Sonnenaufgang und vor Sonnenuntergang eingehen. Und dieses Mittel ist wiederum genau doppelt so groß wie das 24h-Tagesmittel (360°). Eine Erweiterung des Tagbogens auf 24h reduziert somit rein mathematisch die durchschnittlich einfallende örtliche Bestrahlungsleistung der Sonne auf die Hälfte und damit wiederum das daraus abgeleitete S-B-Temperaturäquivalent. Es bleibt darauf hinzuweisen, dass S-B-Gesetz und S-B-Inversion nicht auf rein mathematische Mittelwerte angewendet werden dürfen.

In seiner E-Mail vom 29.01.2021 um 09:58 Uhr* an mich und den üblichen Skeptiker-Email-Verteiler hatte ein Dr. Gerhard Kramm ein PDF-Dokument „kramm_bemerkungen_weber_v3.pdf“ (wird in der Folge als „Kramm 2021“ bezeichnet) mit einem direkten Temperaturvergleich zwischen meinem hemisphärischen S-B-Modell und seiner „Erde ohne Atmosphaere“ verschickt. Die beiden nachfolgenden Abbildungen entstammen diesem PDF:

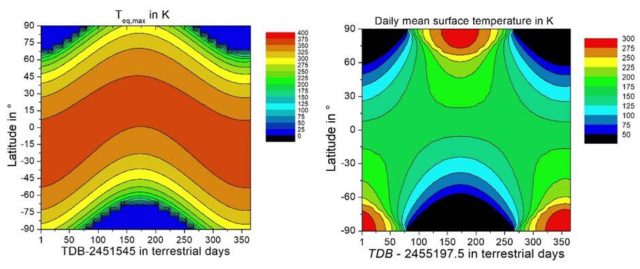

Abbildungen 3 a* und b*: Berechnete Oberflächentemperaturen aus dem PDF-Dokument „kramm_bemerkungen_weber_v3.pdf“ von Dr. Gerhard Kramm, Fairbanks, Alaska*

Originalbeschreibung: „Abbildung 15. Wie in Abbildung 12, jedoch für die auf dem lokalen Strahlungsgleichgewicht nach Gleichung (3) beruhende Oberflächentemperatur.“

Dazu der Text zu Abbildung 12: „Berechnete solare Einstrahlung für alle Tage des Jahres und alle geographischen Breiten:

(a [links]) Maxima nach Weber, beginnend mit dem 1. Januar 2000, 12:00 Uhr (JD = 2451545)

(b [rechts]) Tägliche Mittelwerte nach Kramm et al. (2017), beginnend mit 1.Januar 2010, 00:00 Uhr (JD =2455197,5)“

In Abbildung 3b erscheint der Pol der Sommerhemisphäre nach Kramm (2021) realitätswidrig als absoluter Temperatur-Hotspot mit einer Signatur zwischen 275-300 Kelvin, um den Äquator herrschen dagegen Temperaturen zwischen 150 und 175 Kelvin. Die „Maxima nach Weber“ in der Abbildung 3a, abgeleitet mit einer S-B-Inversion aus dem Maximum der örtlichen solaren LEISTUNG [W/m²] ohne Albedo, schwanken dagegen mit dem jahreszeitlichen Sonnenstand um den Äquator („Latitude 0°“) mit bis zu 394 Kelvin. Die Temperaturen reduzieren sich dann zum Pol der Winterhemisphäre gegen null Kelvin. In der Realität werden die theoretischen Maximalwerte aber aufgrund von Albedo, Verdunstung und Konvektion nicht erreicht; die Minimalwerte werden dagegen durch Advektion und Kondensation gestützt. Das Stefan-Boltzmann-Gesetz (S-B-Gesetz) beschreibt das Verhältnis zwischen der momentanen Temperatur und der zeitgleichen spezifischen Strahlungsleistung eines Schwarzen Körpers, Zitat aus Wikipedia:

„Das Stefan-Boltzmann-Gesetz ist ein physikalisches Gesetz, das die thermisch abgestrahlte Leistung eines idealen Schwarzen Körpers in Abhängigkeit von seiner Temperatur angibt. Es ist benannt nach den Physikern Josef Stefan und Ludwig Boltzmann.“

Man kann eine Inversion des S-B-Gesetzes über die spezifische solare Strahlungsleistung für eine Ortslage demnach dann und nur dann durchführen, wenn die Sonne dort gerade scheint, also im Tagbogen zwischen Sonnenauf- und -untergang. Wenn wir jetzt in der nachfolgenden Abbildung noch einmal die beiden Modell-Temperaturverläufe mit den Beleuchtungsklimazonen unserer Erde vergleichen, dann finden wir das hemisphärische S-B-Modell voll bestätigt:

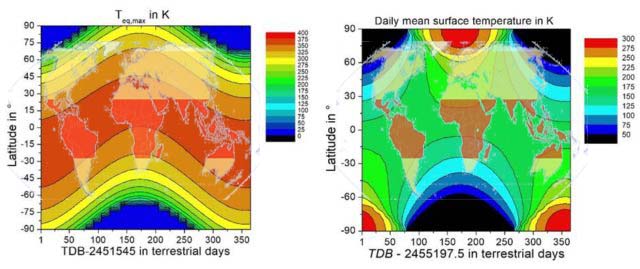

Abbildung 4: Vergleich konkurrierender Modelle für die globale Verteilung der Temperatur.

Links mein hemisphärisches S-B-Modell: Oberflächentemperatur für die täglichen solaren Strahlungsmaxima nach Weber aus Kramm (2021)*.

Mitte: Die Beleuchtungsklimazonen der Erde: von oben/unten zur Mitte: Polarzonen, Mittelbreiten, Tropenzone – (Quelle: Wikipedia, Autor: Fährtenleser, Lizenz: GNU Free Documentation License).

Rechts ein breitenabhängiges 24h-Temperaturmittel: Oberflächentemperatur für die solaren tägliche Mittelwerte nach Kramm et al. (2017) aus Kramm (2021)*

Ergebnis: Wie erwartet spiegeln die Beleuchtungsklimazonen (Definition) unserer Erde (Abbildung 4 Mitte) den Verlauf der maximalen örtlichen solaren Strahlungsleistung und zeigen keinerlei Hotspot am Pol der Sommerhemisphäre (Abbildung 5):

Abbildungen 5 a* und b*: Der Modellvergleich aus dem PDF-Dokument von Kramm (2021)* mit jeweils einem Overlay der Beleuchtungsklimazonen (Quelle: Wikipedia, Autor: Fährtenleser, Lizenz: GNU Free Documentation License)

(a [links]) Maxima nach Weber, beginnend mit dem 1. Januar 2000, 12:00 Uhr (JD = 2451545)

(b [rechts]) Tägliche Mittelwerte nach Kramm et al. (2017), beginnend mit 1.Januar 2010, 00:00 Uhr (JD =2455197,5)“

Anmerkung: Die Overlays der Beleuchtungsklimazonen sind gegenüber den Modellen a und b nicht flächentreu

Bekanntermaßen ist die spezifische solare Strahlungsleistung in den Tropen nun einmal am höchsten und fällt dann zu den Polarregionen kontinuierlich ab (Vergleich hier: Leistung vs. Arbeit in Abb.3b), wie es auch die Overlays in Abbildung 5 prinzipiell zeigen. Von den beiden konkurrierenden theoretischen Klimamodellen in den Abbildungen 3 bis 5 wird dieser natürliche Verlauf lediglich von meinem hemisphärischen S-B-Modell sinnstiftend abgebildet. Mein hemisphärisches S-B-Modell ersetzt als realistisches Modell unserer Erde ohne THE also den konventionellen Faktor4-Tag=Nacht-THE-Ansatz der real existierenden Klimawissenschaft mit einem fehlerhaft konstruierten globalen „natürlichen atmosphärischen Treibhauseffekt“ von konstant 33°C.

Wir können also abschließend festhalten:

Der konventionelle 24h-Faktor4-Tag=Nacht-Ansatz arbeitet mit einem gemittelten 24h-Leistungsdurchschnitt der Strahlungsmenge (Energie) über einen imaginären 24h-Tagbogen der Sonne und berechnet aus diesem 24h-Tag+Nacht-Mittel der solaren Strahlstärke eine viel zu geringe theoretische globale Durchschnittstemperatur von (-18°C). Das Modell von Kramm (2021, Abb. 3b, sowie Abbildungen 4 rechts und 5b) stellt zudem die Beleuchtungsklimazonen der Erde (Abb. 4 Mitte und Overlays in Abb. 5) und damit auch den Antrieb der globalen Zirkulationen (Atmosphäre/Ozeane) auf den Kopf. Im Ergebnis ist das Modell einer „Erde ohne Atmosphaere“, das die zugrunde liegende physikalische Realität auf unserer Erde mit einer sogenannten „gemessenen globalen Durchschnittstemperatur“ (NST) von ca. 15°C nicht wenigstens prinzipiell abbilden kann, also gar kein gültiges Modell dieser Realität und damit zu verwerfen.

Das hemisphärische S-B-Modell stützt sich dagegen auf die maximale spezifische Strahlungsleistung der Sonne im Zenit des realen Tagbogens und ermittelt daraus die nach dem S-B-Gesetz maximal mögliche Ortstemperatur. Denn eine Interaktion zwischen Sonneneinstrahlung und Materie (also die Erwärmung selbiger Materie) kann nur dann stattfinden, wenn beides tatsächlich physikalisch aufeinander trifft – und das ist nur innerhalb des Tagbogens der Sonne der Fall. Das aus der maximalen spezifischen Strahlungsleistung der Sonne abgeleitete Temperaturmittel für die sonnenbeschienene Tageshemisphäre der Erde beträgt ca. 15°C und stimmt mit der sogenannten „gemessenen globalen Durchschnittstemperatur“ (NST) überein.

Es kann also keinen vernünftigen Zweifel daran geben, dass eine Inversion des S-B-Gesetzes (Bestrahlungsstärke->Temperatur) nur innerhalb des Tagbogens der Sonne physikalisch korrekt ist. Der konventionelle 24h-Faktor4-Tag=Nacht-Ansatz ist damit zugunsten meines hemisphärischen S-B-Modells zu verwerfen. Damit ist das 24h-Tag=Nacht-THE-Flacherdemodell endgültig Geschichte, es sei denn, irgendjemand führt den wissenschaftlichen Nachweis, dass die Sonne außerhalb ihres Tagbogens die Erdoberfläche direkt zu erwärmen vermag.

*) Nachtrag: Um jedweden Beschwerden vorzubeugen, bestätige ich hiermit, ein direkter „An“-Adressat der o. g. E-Mail vom 29. Januar 2021 um 09:58 Uhr mit Kramms PDF-Dokument „kramm_bemerkungen_weber_v3.pdf“ und den dort enthaltenen Abbildungen 15 a und b (hier Abbildungen 3 a und b und 5 a und b sowie Abb. 4 links und rechts) zu sein, ebenso, wie u. a. auch die Herren Lüdecke, Limburg und Kirstein. Ich beweise nachfolgend mit der „Confidentiality Warning“ des Dr. Gerhard Kramm die rechtmäßige Nutzung dieser Graphiken in meinem Artikel „Der Faktor4-Tag=Nacht-Ansatz unterstellt einen fehlerhaften 24h-Tagbogen der Sonne“, Zitat:

“CONFIDENTIALITY WARNING: The information transmitted is intended only for the person or entity to which it is addressed and may contain confidential and/or privileged material. Any review, retransmission, dissemination or other use of, or taking any action in reliance upon, this information by persons or entities other than the intended recipient is prohibited. If you receive this in error, please contact the sender and delete the material from any computer.”

Der unbestechliche Google-Übersetzer bestätigt mir ausdrücklich, die Inhalte der besagten E-Mail Kramm vom 29. Januar 2021 um 09:58 Uhr rechtmäßig zitiert zu haben:

„VERTRAULICHKEITSWARNUNG: Die übermittelten Informationen sind nur für die Person oder Organisation bestimmt, an die sie gerichtet sind, und können vertrauliches und / oder privilegiertes Material enthalten. Jegliche Überprüfung, Weiterverbreitung, Verbreitung oder sonstige Verwendung oder Ergreifung dieser Informationen durch andere Personen oder Organisationen als den beabsichtigten Empfänger ist untersagt. Wenn Sie dies irrtümlich erhalten, wenden Sie sich bitte an den Absender und löschen Sie das Material von einem beliebigen Computer.“

ERGO: Es verbleiben für eine erlaubte „Überprüfung, Weiterverbreitung, Verbreitung oder sonstige Verwendung oder Ergreifung dieser Informationen“ ausschließlich die von Dr. Kramm „beabsichtigten Empfänger“, und ich bin definitiv der ERSTE „AN“-EMPFÄNGER dieser E-Mail.