Die Hütchenspieler des Stromnetzes

Inmitten der größten Energiekrise wird im besten Deutschland aller Zeiten munter weiter eine alternativlose Energiewende ins Nichts betrieben, koste es, was es wolle.

von Manfred Haferburg

Schon die Wortfindungen zeigen die fachliche Unbedarftheit der grünen Wende-Protagonisten. Energiewende hin zur erneuerbaren Energie? Energie lässt sich weder wenden, noch erneuern. Energie lässt sich bestenfalls von einer Form in die andere umwandeln. Der erste Hauptsatz der Thermodynamik sagt, dass Energien ineinander umwandelbar sind, aber nicht gebildet, bzw. vernichtet – also auch nicht erneuert oder gewendet werden können.

Im Resultat dieses Unfugs hat Deutschland schon heute die höchsten Strompreise der Welt, und sie kennen nur eine Richtung: nach oben. Die Industrie verabschiedet sich nach und nach. Familien können die Energiekosten nicht mehr stemmen. Die Regierung macht mit einem „Wumms“ und einem „Doppelwumms“ neue Milliardenschulden und bezeichnet sie als „Sondervermögen“. Geht es noch irrer? Ja!

Entgegen aller Ratschläge und Warnungen von Fachleuten setzt die Politik unbeirrbar den Kurs der Kraftwerksverschrottung fort. Mietwissenschaftler liefern den Politikern die gern gehörten Begründungen für ihr Tun, und echte Experten werden entweder nicht gehört oder verunglimpft und mundtot gemacht. Ich weiß, wovon ich spreche.

Das Analogon zu „Die Rente ist sicher“

Die Hauptstrommedien berichten einhellig und im Einklang mit der Regierung, dass es auch künftig keine Probleme mit der Energiewende geben wird, so als gäbe es nicht schon heute genug Probleme damit. Ossis kennen das schon, in der DDR gab es auch keine Probleme beim Aufbau des Sozialismus, der 1989 endlich siegte.

Am Mittwoch verabschiedete das Bundeskabinett einen Bericht des Bundesministeriums für Wirtschaft und Klimaschutz:

„Die Versorgung mit Strom ist mit den aktuellen Planungen der Bundesregierung auch im Zeitraum 2025 bis 2031 auf weiterhin hohem Niveau gewährleistet… Die Versorgung mit Strom ist dabei auch bei einem Kohleausstieg 2030 sicher.“

Bundeswirtschaftsminister Habeck wird wie folgt zitiert:

„Es ist zentral, dass die Verbraucher und Verbraucherinnen jederzeit sicher mit Strom versorgt werden. Diese Stromversorgungssicherheit werden wir auch beim Umbau unseres Stromsystems auf 100 Prozent erneuerbaren Strom gewährleisten. Daher monitort die Bundesnetzagentur die einzelnen Schritte und Etappen sehr genau. Der heute im Kabinett verabschiedete Bericht der Bundesnetzagentur zeigt, dass die Stromnachfrage im Zeitraum von 2025 bis 2031 jederzeit sicher gedeckt werden kann. Dies gilt auch, wenn der Stromverbrauch durch neue Verbraucher wie Elektromobile und Wärmepumpen deutlich steigt und der Kohleausstieg bis 2030 erfolgt. Wir sehen: Wir sind auf dem richtigen Weg…“

Überzeugungstäter: „Unser Weg ist richtig“

Ich als Ossi habe da ein „deja vue“. Am 2.5.1969 prangte auf Seite 1 des „Neuen Deutschland“, dem Organ des Zentralkomitees der Sozialistischen Einheitspartei Deutschlands, eine Überschrift: Die Erbauer des neuen Berlin: „Friede, Demokratie, Sozialismus – unser Weg ist richtig. Dieses Bewusstsein, dass wir auf dem richtigen Wege sind, ist ein gewaltiger Kraftquell – für neue große Leistungen bei der Gestaltung des entwickelten gesellschaftlichen Systems des Sozialismus und für die Entschlossenheit, das Errungene zu verteidigen…“ Die absolut realitätsresistenten DDR-Bonzen sahen sich 1969 genauso auf dem richtigen Weg wie der schon vor Jahren falsch abgebogene Wirtschaftsminister Robert Habeck und sein: „Wir sind auf dem richtigen Weg“.

Ich frage mich als Fachmann: „Wie wollen die das machen? Alle Kernkraftwerke und Kohlekraftwerke, die heute noch mehr als die Hälfte der Stromproduktion stemmen – oft auch mehr als zwei Drittel – verschrotten und trotzdem das Land jederzeit sicher mit 100 Prozent Strom versorgen? Wie soll das gehen, wenn sich der Bruttostromverbrauch laut Bericht auch noch von rund 565 TWh in 2021 auf 750 TWh erhöht? Wie soll das gehen, wenn es weder eine großtechnisch bezahlbare Speichertechnologie gibt, noch billigers Gas fûr nicht vorhandene Gaskraftwerke, noch konstanten Wind und Sonnenschein nachts?

Die Hütchenspieler von der Bundesnetzagentur

Wer sind diese Leute, die von Amts wegen Energie wenden und erneuern wollen und immer neue Durchhalteparolen raushauen? Es ist die Bundesnetzagentur. Sie hat den Bericht zum Monitoring der Versorgungssicherheit mit Strom vorgelegt, gemäß §§ 51 Abs. 3, 63 Abs. 2 Nr. 2 EnWG. Der Bericht untersucht die Versorgungssicherheit vorausschauend für den Mittelfristhorizont 2025 bis 2031.

Bundesnetzagentur (BNetzA) hört sich seriös an, wie eine Art Hüter der Stromnetze der Bundesrepublik Deutschland.

In Wirklichkeit ist die Bundesnetzagentur eine Behörde unter der Leitung des grünen Philosophen und Bundeswirtschaftsministers Habeck. Die Bundesnetzagentur hat ihren Sitz in Bonn und ist eine „obere deutsche Bundesbehörde im Geschäftsbereich des Bundeswirtschaftsministeriums“. Ihr Chef ist seit 1. März 2022 der Diplomvolkswirt Klaus Müller von den Grünen, er hat auch den Bericht unterzeichnet. Das ist der selbe Mann, der immer vor Stromengpässen durch E-Autos und Wärmepumpen warnte und noch größere Einsparungen von der Bevölkerung verlangte.

Der Bericht der Bundesnetzagentur zum Monitoring der Versorgungssicherheit Strom ist 111 Seiten lang. Die dazugehörigen Handlungsempfehlungen sind 27 Seiten lang, das dazugehörige Erläuterungspapier noch mal 5 Seiten. Ich frage mich schon, welches Kabinettsmitglied sich durch die 143 Seiten Fachchinesisch gekämpft hat? Verstanden hat den Text mit Sicherheit keines der Regierungsmitglieder.

Unter welchem Becherchen ist denn die Versorgungssicherheit?

Hütchenspieler verwirren ihre Opfer mit ständigem Verschieben der Becherchen, bis sie den Überblick verlieren. Der Hütchentrick der Netzagentur funktioniert ähnlich. Sie weisen nämlich jede Verantwortung für ihre unseriöse Aussage von der sicheren Versorgung mit Strom im Jahre 2030 von sich, indem sie festlegen, dass diese Aussage nur unter der Prämisse gilt, dass die Regierungsziele der Energiewende eingehalten werden.

„Damit die sichere Versorgung mit Elektrizität gewährleistet ist, müssen eine Reihe von erzeugungs- und netzseitigen Entwicklungen realisiert und die entsprechenden Anstrengungen weitergeführt werden“.

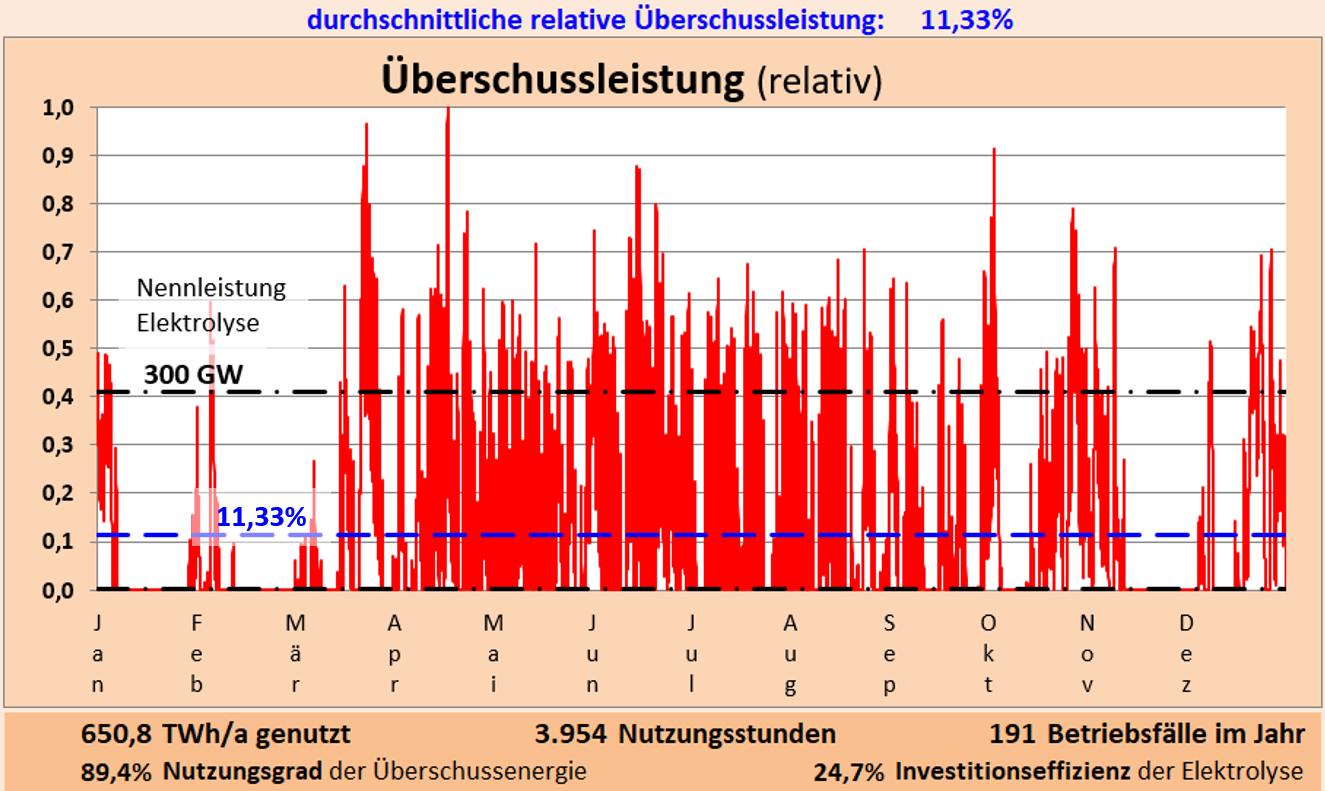

Ein kurzer Blick auf diese Ziele zeigt, dass dies völlig unrealistisch ist. (Bei meinen Kommentierungen klammere ich das ganze grüne Wasserstoffmärchen aus, weil darauf im Bericht kaum eingegangen wird.) Ich zitiere einige Eckpunkte des Berichtes und füge kurze Kommentare hinzu:

- „Als Ausgangspunkt hat die Bundesnetzagentur den deutlichen Ausbau der erneuerbaren Energien (Wind Onshore, Wind Offshore und Photovoltaik) in Deutschland von ca. 123 GW (2021) auf 360 GW (2030) bzw. 386 GW (2031) gemäß Osterpaket unterstellt. Die nötige Ausbaugeschwindigkeit ist damit mehr als dreimal so hoch wie in den Vorjahren.“

Dies würde bedeuten, dass ab sofort bis 2030 arbeitstäglich (!) fünf (!) neue Windräder der modernsten 5 MW-Klasse in Betrieb gehen. Dass ab sofort 1.200 Betonmischer täglich zu den Windrad-Fundamenten dieseln. Dass ab sofort 375 Sondertransporte mit den 80 Meter langen Windrad-Flügeln pro Monat über deutsche Straßen geleitet werden müssen. Das sind nur ein paar Beispiele, um die Unmöglichkeit der Lösung der Aufgabe zu illustrieren.

- „Für steuerbare Kapazitäten zeigt dieser Bericht, dass bei Beibehaltung des heutigen Marktdesigns ein Zubau von Gaskraftwerken (H2-ready), … bis 2030 bzw. 2031 in Deutschland die Versorgungssicherheit zu den geringsten Kosten gewährleisten würde… (Investitionen in neue Gaskraftwerke werden in den Berechnungen in relevantem Umfang von 17-21 GW bis 2030/2031 erwartet) … Es ist darauf zu achten, dass die Anlagen rechtzeitig bis Ende des Jahrzehnts einsatzbereit sind, um einen Beitrag zur Versorgungssicherheit leisten zu können.“

Das würde bedeuten, dass bis 2030 etwa 50 neue Gaskraftwerke der 300-MW-Klasse gebaut werden müssen, die noch nicht einmal entwickelt wurden, da sie ja Wasserstoff-fertig sein sollen. Der Bau eines Gaskraftwerkes dauert mindestens fünf Jahre. Es müssten Investoren gefunden werden, die in Gaskraftwerke investieren, die mit dem teuersten fossilen Brennstoff auf dem Markt – dessen Vorhandensein zudem unsicher ist – weit unter ihrer Rentabilitätsgrenze betrieben werden müssen, da Wind- und Sonneneinspeisung immer Vorrang haben. Es müssen Standorte gefunden und erschlossen werden. Es müssen Lieferanten gefunden, Ausschreibungen getätigt und Lieferverträge abgeschlossen werden…

- „Um die Lastmanagementpotentiale zur Lastreduktion in Knappheitssituationen leichter zu erschließen, überarbeitet die Bundesnetzagentur zudem die Regelungen für die individuellen Netzentgelte. Die Entwicklung der im Stromsystem nutzbaren Flexibilität u. a. von Elektromobilität sowie Wärmepumpen im gewerblichen und privaten Bereich ist kontinuierlich zu monitoren und bei Bedarf hierzu bestehende Hemmnisse zu beseitigen.“

Die Abschaltung industrieller und privater Verbraucher ist das einzige Ziel, dessen Erreichung ich nicht in Zweifel ziehen möchte. Mit der Einschränkung, dass man auf die Digitalisierung der Steuerung der SmartMeter vielleicht noch ein Jahrzehnt warten muss und bis dahin die Abschaltung der E-Auto-Ladestationen und Wärmepumpen eher manuell erfolgen muss – also geregelt über den Preis, den die Nutzer dann zahlen müssen. „Regelungen für die individuellen Netzentgelte“ bedeutet, dass die E-Autobesitzer die Ladestation und die Wärmepumpenbesitzer ihre Heizung von ganz allein abschalten, da sie sonst für unbezahlbare Stromkosten aufkommen müssen.

- „Der europäische Binnenmarkt eröffnet wichtige Ausgleichseffekte für das Stromsystem. Die beiden Analysen in diesem Bericht gehen von einem funktionierenden Elektrizitätsbinnenmarkt aus. Sie setzen „offene Grenzen“ beim grenzüberschreitenden Handel und Austausch mit Strom voraus… Die Berechnungen zeigen, dass Deutschland auch zu einem Stromnettoimporteur werden kann.“

Dies ist an grüner Heuchelei nicht zu übertreffen. Deutschland steigt aus eigener Kernenergie und Kohle aus, um dann zu fordern, dass polnischer Kohlestrom, französischer Atomstrom es richten sollen, wenn kein Wind weht und keine Sonne scheint. Und was, wenn die europäischen Nachbarn ihren Strom selber brauchen? Wird dann die Kavallerie geschickt, um offene Grenzen beim grenzüberschreitenden Handel und Austausch mit Strom zu sichern, oder reicht ein gezücktes Scheckbuch?

- „Netzseitig ist es zudem notwendig, dass Netzoptimierung und Netzausbau entsprechend vorankommen, um die durch einen schnelleren Kohleausstieg und steigende Erneuerbare-Energien-Erzeugung größer werdenden Transportbedarfe zu ermöglichen.“

Beim Netzausbau helfen ein paar simple Zahlen dem Verständnis nach. Das klägliche Scheitern aller Zeitpläne für die berühmten Stromautobahnen spricht Bände. Von 7.700 Kilometern sind in fünf Jahren ganze 1.300 km gebaut, im letzten Jahr hat man ganze 200 km geschafft. Wenn es in dem Tempo weitergeht, dann sind die Stromtrassen in 30 Jahren fertig.

Wer soll das bezahlen?

Der Bericht der Bundesnetzagentur stammt aus dem tiefsten Bullerbü, wurde verfasst von den Gebrüdern Grimm der Energiewende und ist bestimmt für gläubige Philosophen, windige Anwälte und ein paar Ungelernte, die sowieso von Energie nur Bahnhof verstehen. Er vermittelt die Botschaft von vermeintlichen Fachleuten an diese unbedarften Entscheider: „Alles Paletti für die nächsten zwei Wahlperioden. Ihr könnt ruhig weiter gut funktionierende Kraftwerke verschrotten. Ihr könnt ruhig weiter das Geld der Leute zum Fenster rauswerfen. Der Strom kommt weiter aus der Steckdose.“ Was sie nicht herauslesen ist, aber doch drin steht: „Und wenn er nicht mehr aus der Steckdose kommt, dann ist es nicht unsere Schuld. Ihr habt eure eigenen Pläne nicht eingehalten. Jetzt guckt ihr dumm aus der Wäsche“.

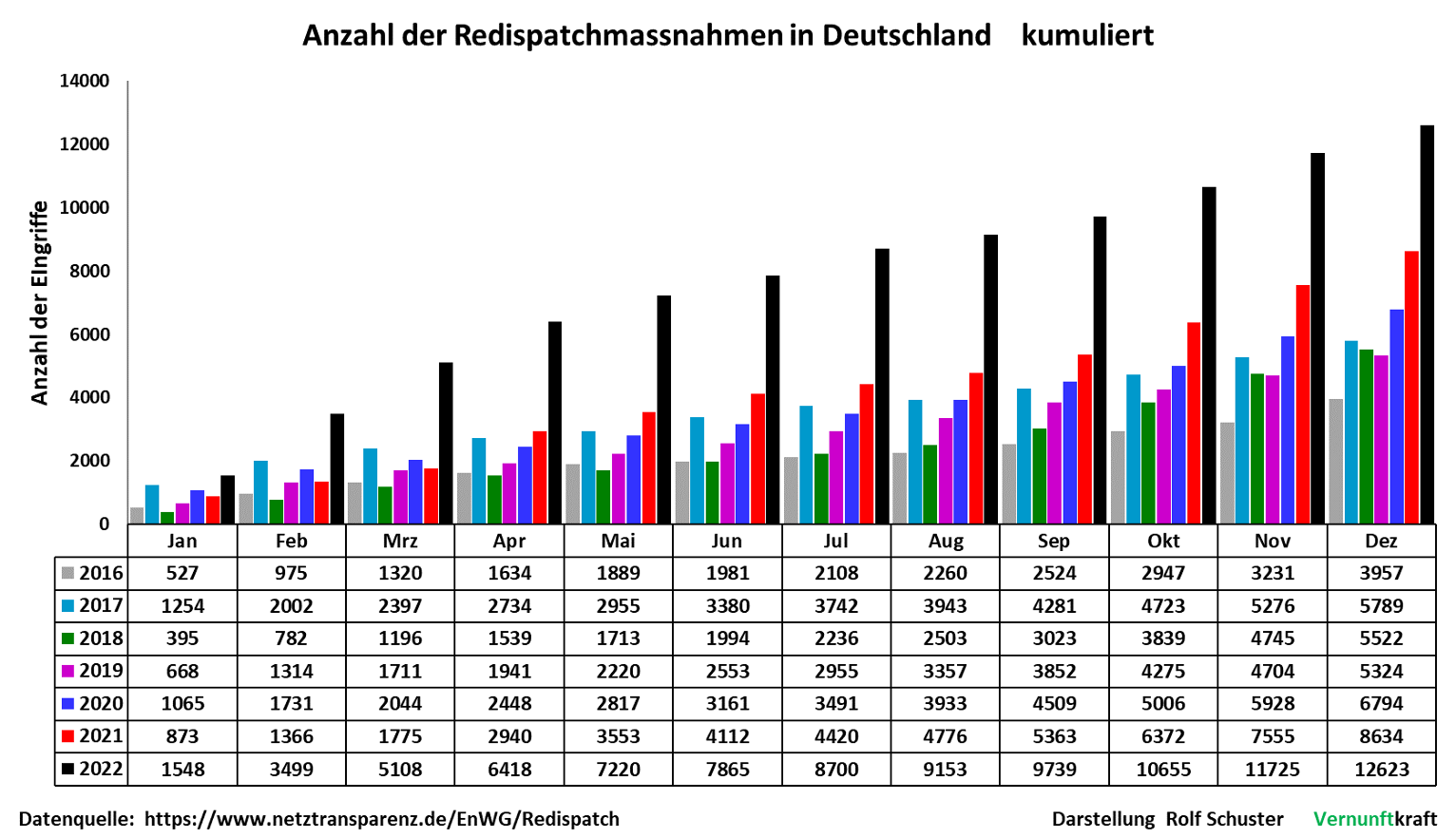

Zahl der Redispatch Maßnahmen von 2016- 2022

Die utopischen Pläne der Regierung scheitern zwangsläufig schon allein an dem nicht in genügendem Umfang an Vorhandensein der benötigten Ressourcen. Und darüber hinaus: Hat die Bundesnetzagentur schon einmal etwas vom Fachkräftemangel gehört? Wenn solche Dokumente zur Grundlage von Regierungsentscheidungen werden, kann einem nur angst und bange werden. Wie Deutschland nach der Umsetzung der Pläne aussehen würde, mag man sich gar nicht vorstellen. Ein einst blühendes Land, umgewandelt in eine Industriebrache voller Propellerungeheuer und blauschimmernder Glaswüsten.

Eine Frage wird in dem Bericht mit gutem Grund nicht gestellt: „Wer soll das bezahlen?“ Weil es auch so klar ist, wer für die immensen Kosten aufkommen muss. Nur denjenigen, welche es bezahlen müssen, werden von den Hütchenspielern der Bundesnetzagentur und ihren angeschlossenen Medien durch 143 Seiten intensives Becherchen-Verschieben die Sinne vernebelt.

Es dauert viele Jahre, um ein Kraftwerk zu bauen, aber nur ein paar Stunden, um es zu verschrotten und zu sprengen. Abgewanderte Industrie kommt nicht freudestrahlend zurück, wenn der grüne Albtraum vorbei ist. Ausgewanderte Leistungsträger auch nicht. Das ist schade, denn die von den Hütchenspielern Geprellten werden erst in ihrem neuen europäischen Venezuela namens Deutschland erwachen, wenn es zu spät ist. Das Tal der Tränen wird tief und lang sein.

versorgungssicherheitsbericht-strom Kopie

Manfred Haferburg ist Autor des autobiografischen Romans „Wohn-Haft“ (4,8 von 5 Sternen bei 221 Bewertungen), der heute einen erschreckenden gesellschaftlichen Wiedererkennungswert hat. Leser Sille scheibt in seiner Bewertung: „Das Buch ist – trotz aller grauenvollen, beängstigenden, bedrückenden und deprimierenden Details – sehr flüssig geschrieben und ich habe es quasi auf einen Zug durchgelesen. Es ist ein Stück DDR-Zeitgeschichte, und ich kann es jedem nur empfehlen, der meint, Sozialismus solle man nochmal probieren.“

Der Beitrag erschien zuerst bei ACHGUT hier