von Uli Weber

Als Modell gilt in der Wissenschaft eine mehr oder minder umfangreiche Abbildung der Wirklichkeit (Zitat Wikipedia). Wenn wir diese Definition einmal umkehren, dann kann ein Etwas, das nicht irgendwie in der Wirklichkeit verankert ist, kein Modell der selbigen sein, sondern beispielsweise Science Fiction. Nun hatte sich in der Kommentarfunktion zu dem EIKE-Artikel „Neue Studie: Ein ‚Denkmodell‘, das von einem ‚natürlichen Treibhauseffekt‘ von 33 K ausgeht, ist eine ‚wertlose‘ Behauptung“ der Lead-Autor selbiger Studie bitterlich über meinen Modellvergleich „Verbesserungswürdig: Über fehlerhafte Ansätze für eine breitenabhängige Globaltemperatur“ auf EIKE (nachfolgend = Weber 2020) beklagt, Zitat Kramm am 5. Januar 2023 um 21:13 Uhr:

„Wenn Sie glauben, nach dem Motto „Calumniare audacter, semper aliquid haeret“ eine Vielzahl von frei erfundenen Behauptungen und Falschaussagen zu den Arbeiten verbreiten zu koennen, die ich zusammen mit Fachkollegen angefertigt habe, um Zweifel an meiner Kompetenz zu schueren, dann nehme ich das nicht hin.“

(Alle Kramm-Zitate in diesem Artikel aus der Kommentarfunktion von „Neue Studie: …“)

Um zunächst einmal der Freiheit von Meinung und Information Genüge zu tun, finden Sie meinen knapp 8-seitigen EIKE-Artikel „Weber (2020)“ unter dem obigen Link und Kramms 35-seitige Entgegnung hier.

Dem Angebot des EIKE-Admins vom 5. Januar 2023 um 22:08 Uhr, eine Widerlegung meiner Ergebnisse auf diesem Blog zu veröffentlichen, ist Kramm bisher nicht nachgekommen. Vielmehr hatte Kramm diesen Vorschlag bereits am 6. Januar 2023 um 12:45 Uhr mit einem Kommentar @Admin zurückgewiesen. Daher stelle ich mich jetzt umgekehrt Kramms Kritik und werde nachfolgend die Richtigkeit meines Modells und meiner Analysen gegenüber dessen Zitaten nachweisen. Zur Diskussion stehen damit folgende Modelle:

- Das herkömmliche globale Faktor4-Tag=Nacht-THE-Modell mit seinem globalen [-18°C]-Ansatz aus einer physikalischen Fehlanwendung des Stefan-Boltzmann-Gesetzes.

- Das breitenabhängige Temperaturmodell von Kramm et al. (2017), in dem sich Kramm mit einem Faktor4-Tag=Nacht-Ansatz für eine „Erde ohne Atmosphäre“ auf die Arbeiten von hochrangigen Physik-Koryphäen aus dem 19. und 20. Jahrhundert stützt.

- Mein hemisphärisches Stefan-Boltzmann-Modell für die Temperaturgenese auf unserer realen Erde, bei dem ich mich auf die zwingende Gleichzeitigkeit von Temperatur und Strahlung im Stefan-Boltzmann-Gesetz sowie die jahrtausendealten Kenntnisse der Landbevölkerung über die Existenz von Tag und Nacht berufe.

Modell (A): Am 5. Januar 2023 um 21:13 Uhr behauptet Gerhard Kramm unter Punkt 1, Zitat mit Hervorhebungen:

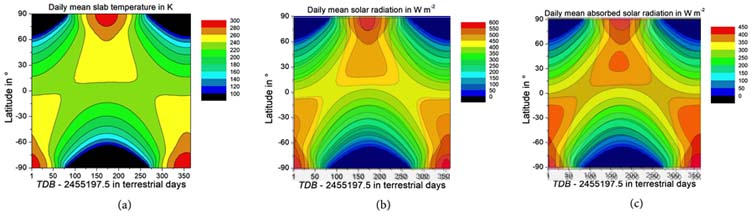

„Es ist also in der Fachliteratur ueblich, entweder die ortsabhanegige taegliche solare Einstrahlung oder die ortsabhaengige mittlere taegliche solare Einstrahlung zu veranschaulichen. In den beiden obigen Diagramm sind jeweis die geographische und jahreszeitliche Verteilung der mittleren taeglichen solaren Einstrahlung dargestellt. Die zugehoerige taegliche solare Einstrahlung liefert das gleiche Muster der Verteilung, denn alle Werte der mittleren taeglichen solaren Einstrahlung muessen nur mit 86400 s. multipliziert werden. Sie streiten diese Verteilung der taeglichen solaren Einstrahlung ab.

Die globale Mittelung ueber diese geographische und jahreszeitliche Verteilung der solaren Einstrahlung liefert das seit Meech (1857) und Wiener (1877, 1879) bekannte Ergebnis, dass das globale Mittel der solaren Einstrahlung dem vierten Teil der Solarkonstanten entspricht. Die numerischen Simulationen von Kramm et al. (2017) lieferten fuer das Jahr 2010 ein globales Mittel von 340,2 W/m². Die verwendete Solarkonstante betrug 1361 W/m². Der Quotient 340,2/1361 betraegt 0.24996.“

Ich kann mich zwar nicht auf Meech (1857) und Wiener (1877, 1879) -(sowie Milanković (1920, 1941) bei Kramm et al. (2022))- berufen, habe aber den herkömmlichen Faktor4-Ansatz mit einer globalen Durchschnittstemperatur von [-18°C] zuletzt in meinem EIKE-Beitrag „Schwarzschild und die Lösung der Strahlungstransfergleichung – ein physikalischer Hütchentrick?“ ausführlich widerlegt.

Die Situation beim herkömmlichen Faktor4-Ansatz stellt sich folgendermaßen dar:

Der Faktor4-Ansatz benötigt einen sogenannten „natürlichen atmosphärischen Treibhauseffekt“, um die sogenannte „gemessene globale Durchschnittstemperatur“ zu erklären. Dazu ist wiederum eine sogenannte „atmosphärische Gegenstrahlung“ erforderlich, zu deren Entstehung sie selber beitragen muss. Dieser Mechanismus ist vergleichbar mit dem Chuck-Norris-Paradoxon, der in einem Blockhaus geboren worden sein soll, das er selber erbaut hatte. Denn selbst die THE-Anhänger wissen es besser, was die nachstehende Abbildung beweist:

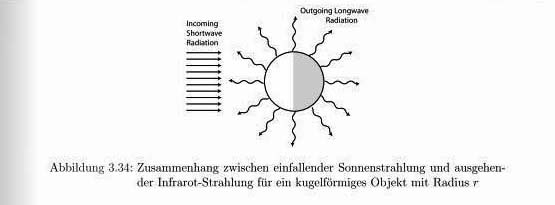

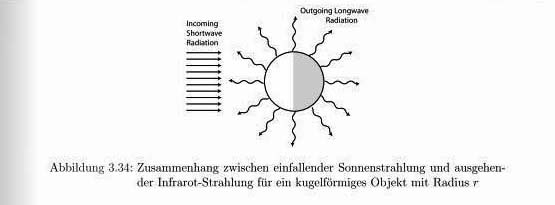

Abbildung 3.34 von Seite 51 aus „Physik der Atmosphäre“ von Niklaus Kämpfer

Abbildung 3.34 von Seite 51 aus „Physik der Atmosphäre“ von Niklaus Kämpfer

Zwischen der „einfallenden Sonnenstrahlung“ und der „ausgehenden Infrarot-Strahlung“ liegt nämlich die terrestrische Temperaturgenese. Denn ein Vektor ändert nicht freiwillig seine Richtung. Es wird hier ganz deutlich, dass sich das Strahlenbündel der einfallenden Solarstrahlung auf eine Kreisfläche (PiR²) mit dem Erdradius R beschränkt. Die Abstrahlung erfolgt dann über die gesamte Erdoberfläche (4PiR²). Aber die Temperaturgenese, bei der sich die Richtung des Poynting-Vektors vom solaren Einfall zur terrestrischen Abstrahlung umkehrt, findet ausschließlich auf der Taghemisphäre (2PiR²) unserer Erde statt. Die Abbildung 3.34 entspricht also prinzipiell meinem hemisphärischen Stefan-Boltzmann-Modell.

Ergebnis für Modell (A): Selbstverständlich bestreite ich, dass die Sonne hier auf der Erde Tag und Nacht mit gemittelter halber Strahlstärke scheint. Denn für das, was am Ende nach Anwendung der Strahlungstransfergleichung ‘rauskommt (Abstrahlung) ist entscheidend, was da vorher auf der Tagseite als Eingangsgröße überhaupt an Sonnenstrahlung ‘reingegangen (Einstrahlung) ist. Und da ist der globale Faktor4-Ansatz halt ungenügend, denn wenn nur die Hälfte ‘reingeht (Faktor4 anstatt Faktor2), kann dabei auch nur die Hälfte ‘rauskommen (235W/m² anstatt 470W/m²).

Anmerkung: Auch hier wird wieder mit den in der Klimawissenschaft offenbar üblichen Durchschnittswerten argumentiert, was bei einer T-hoch-4-Funktion physikalisch nicht korrekt ist. Für detaillierte Angaben sei auf meinen Artikel „Anmerkungen zur hemisphärischen Mittelwertbildung mit dem Stefan-Boltzmann-Gesetz“ verwiesen.

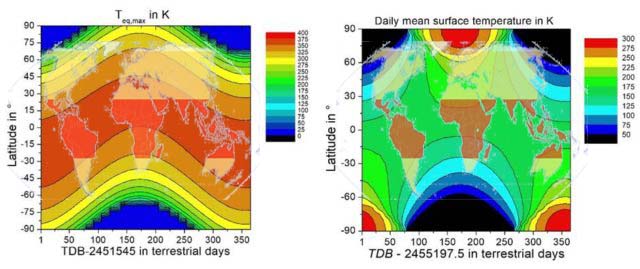

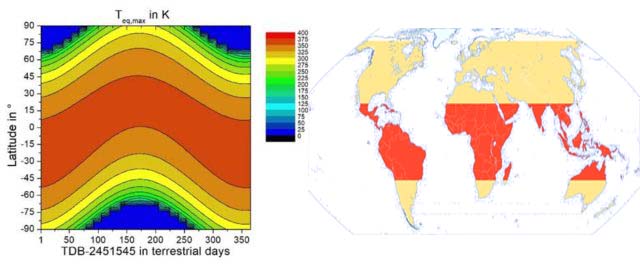

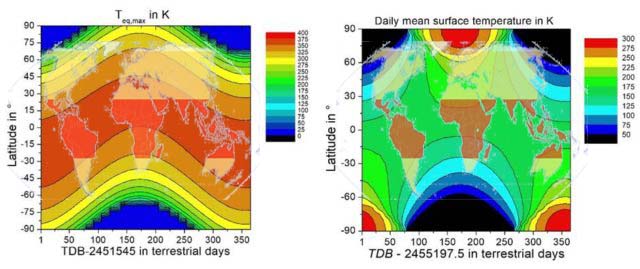

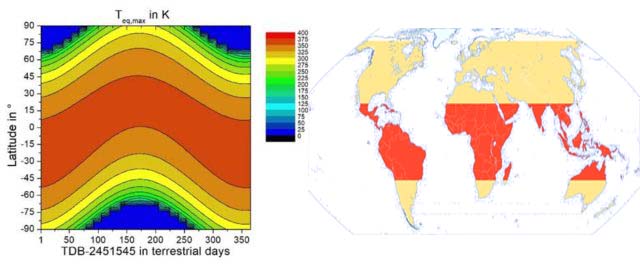

Modell (B): Weiter geht es nun mit Kramm et al. (2017), die einem verfeinerten Faktor4-Ansatz folgen (Quotient = 0,24996 anstelle von 0,25), aus dem sich eine breitenabhängige Temperaturverteilung mit den Maxima am Pol der jeweiligen Sommerhemisphäre herleitet. In seiner E-Mail vom 29.01.2021 um 09:58 Uhr* an mich und den üblichen Skeptiker-Email-Verteiler hatte Dr. Gerhard Kramm ein PDF-Dokument „kramm_bemerkungen_weber_v3.pdf“ (in der Folge „Kramm (2021)“) mit einem direkten Temperaturvergleich zwischen meinem hemisphärischen S-B-Modell und seiner „Erde ohne Atmosphaere“ verschickt. Wie erwartet spiegeln die Beleuchtungsklimazonen (Definition) unserer Erde den Verlauf der maximalen örtlichen solaren Strahlungsleistung und zeigen keinerlei Hotspot am Pol der Sommerhemisphäre. Diese Beleuchtungsklimazonen sind in der nachfolgenden Abbildung (hier finden Sie die Originaldarstellung) als Overlay über die beiden genannten Modelle projiziert worden:

Abbildungen a* und b* aus Kramm (2021): Der Modellvergleich aus dem PDF-Dokument von Kramm (2021)* mit jeweils einem Overlay der Beleuchtungsklimazonen (Quelle: Wikipedia, Autor: Fährtenleser, Lizenz: GNU Free Documentation License)

Abbildungen a* und b* aus Kramm (2021): Der Modellvergleich aus dem PDF-Dokument von Kramm (2021)* mit jeweils einem Overlay der Beleuchtungsklimazonen (Quelle: Wikipedia, Autor: Fährtenleser, Lizenz: GNU Free Documentation License)

(a [links]) Maxima nach Weber, beginnend mit dem 1. Januar 2000, 12:00 Uhr (JD = 2451545)

(b [rechts]) Tägliche Mittelwerte nach Kramm et al. (2017), beginnend mit 1.Januar 2010, 00:00 Uhr (JD =2455197,5)“

Anmerkung: Die Overlays der Beleuchtungsklimazonen sind gegenüber den Modellen a und b nicht flächentreu

Vorläufiges Ergebnis: Bekanntermaßen ist die temperaturbestimmende spezifische solare Strahlungsleistung in den Tropen nun einmal am höchsten (Abbildung a*) und fällt dann zu den Polarregionen kontinuierlich ab, wie es auch die Overlays der Beleuchtungsklimazonen in den Abbildungen a* und b* prinzipiell zeigen. Es ist demnach unschwer zu erkennen, welche Grafik ein physikalisches Modell unserer Erde darstellt (mein hemisphärisches S-B-Modell) und welche Grafik mit einem Wärmepol auf der Sommerhemisphäre (Kramm et al. 2017) reine Science-Fiction ist.

Komplikation: Kramm hält der Analyse in meinem Artikel „Verbesserungswürdig: Über fehlerhafte Ansätze für eine breitenabhängige Globaltemperatur“ (Weber 2020) nun entgegen, Zitat aus seinem Kommentar vom 6. Januar 2023 um 17:53 Uhr mit Hervorhebungen:

„Zur Bewertung der geographischen und jahreszeitlichen Verteilung der „slab“-Temperatur im Falle einer Erde ohne Atmosphaere nach Abbildung 22 (a) vonKramm et al. (2017) war nicht die Verteilung der solaren Einstrahlung nach Abbildung 22 (b) erforderlich, auf die Sie sich berufen haben, sondern die entsprechende Verteilung der absorbierten solaren Strahlung in Abbildung 22 (c), die Sie durch Vertuemmeln der Abbildung 22 weggelassen haben. Da Sie auch die Bildunterschrift verstuemmelt haben, darf man wohl vorsaetzliches Faelschen unterstellen. Und nun wollen Sie sich damit rausreden, dass Sie ja gar nicht die Abbildungen 22 (c) – (e) erwaehnt haetten. Fuer wie dumm halten Sie eigentlich die Foristen?“

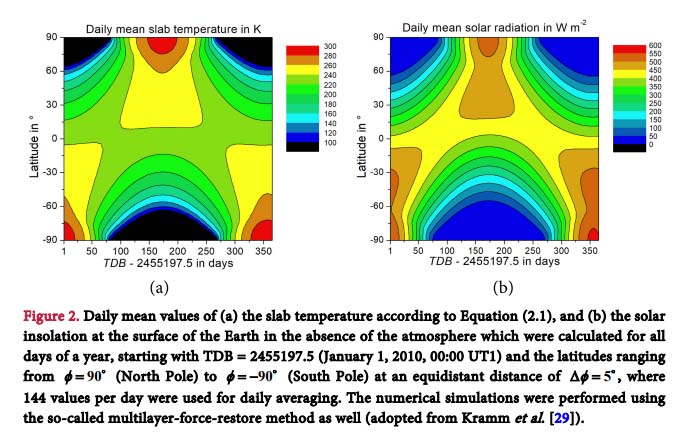

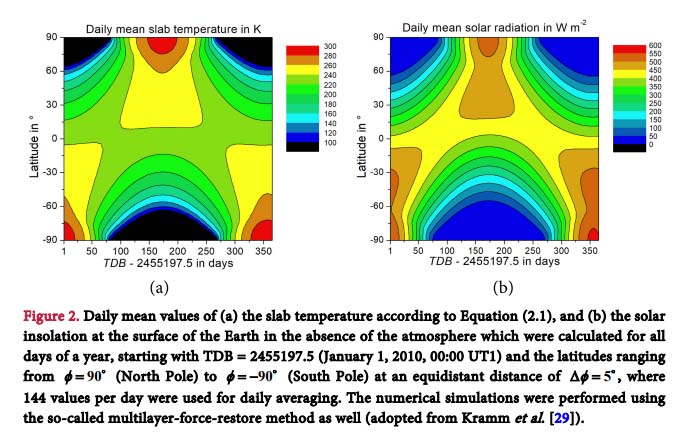

Naja, zumindest die MEISTEN halte ich für schlau genug, um nicht JEDEM ALLES zu glauben: Sehr erstaunlich ist nämlich, dass die Abbildung 22 (a) bis (e) von Kramm et al. (2017) jetzt von Kramm et al. (2022) als Abb. 2 (a) und (b) „verstuemmelt“ wiederverwendet wurde, und zwar ohne die konkreten Aussagen des verantwortlichen Lead-Autors in der oben zitierten Kommentierung bezüglich der Verbindung zwischen den Abb. 22 (a) und 22 (c) berücksichtigt zu haben. Im Gegenteil wird dort ohne eine dahingehend erforderliche Erklärung die Abb. 22 (a) direkt und eindeutig der Abb. 22 (b) gegenübergestellt:

“Copyright ⓒ 2022 by author(s) and Scientific Research Publishing Inc.

This work is licensed under the Creative Commons Attribution International License (CC BY 4.0).”

Anmerkung: Diese Abbildung 2 aus Kramm et al. (2022) zeigt, bis auf eine etwas ausführlichere Bildunterschrift, exakt die von Kramm kritisierte Abbildung 22 (a) und 22 (b) aus Weber (2020), die ebenfalls aus Kramm et al. (2017) stammt.

In meinem Artikel „Verbesserungswürdig: Über fehlerhafte Ansätze für eine breitenabhängige Globaltemperatur“ (Weber 2020) hatte ich mich folgendermaßen über die Abbildungen [22 (a) und (b) von Kramm et al. (2017) = 2 (a) und (b) von Kramm et al. (2022)] geäußert, Zitat:

„In der Abbildung 22a von Kramm et al. (2017) weist die rote Farbgebung nun eine Maximaltemperatur zwischen 280K und 300K für den jeweiligen Pol der Sommerhemisphäre aus. Diese Temperaturspanne entspricht jedoch nicht der entsprechenden spezifischen Strahlungsleistung aus Abbildung 22b mit mehr als 500W/m² (Nordpol) respektive mehr als 550W/m² (Südpol). Denn damit müssten die Ortstemperaturen an den Polen der Sommerhemisphäre in Abbildung 22a deutlich mehr als 300K betragen. Daher können die Temperaturen in Abbildung 22a eindeutig nicht aus den Strahlungswerten von Abbildung 22b hergeleitet worden sein. Sicherlich wird der verantwortliche Lead-Autor diesen Widerspruch mit dem ihm eigenen Charme durch eine plausible physikalische Erklärung auflösen können, die seinen hohen wissenschaftlichen Ansprüchen gerecht wird. Bis dahin bleibt nur der hinreichende Verdacht, dass beim Datensatz für die Strahlungsleistung in Abbildung 22b eine Verwechslung mit den Grunddaten @TOA vorliegen muss.“

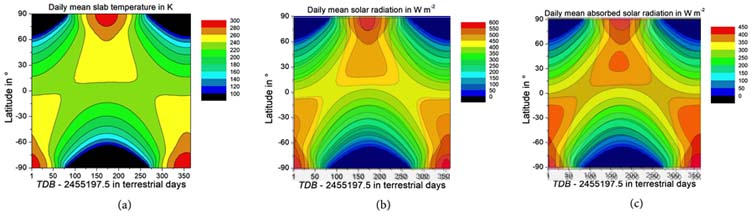

Die Temperatur in Abb. 22 (a) hat ihr Maximum um den jeweiligen Sommerpol, genauso wie die solare Einstrahlung in Abbildung 22 (b), während die Grafik 22 (c) ihre Maxima auf der Nordhemisphäre zwischen ca. 30°N und 50°N hat. Im Sommer der Südhemisphäre reicht das Maxima der Grafik 22 (c) sogar vom Südpol bis in die Tropen. Die nachfolgende Abbildung 22 (a) bis (c) mit einem Overlay der Temperatur-Grafik 22 (a) verdeutlicht diese Situation:

Kramm et al. (2017): “Figure 22. Daily mean values of (a) slab temperature; (b) solar radiation reaching the Earth’s surface; (c) absorbed solar radiation, where the local solar albedo has been predicted by Equation (6.3); as predicted for one year starting with TDB = 2,455,197.5 (January 1, 2010, 00:00 UT1)”

Grafiken (b), und (c) mit einem Overlay von Grafik 22(a) mit dem Faktor4-Temperaturmodell

“This work is licensed under the Creative Commons Attribution International License (CC BY 4.0).”

Das Maximum der Absorption (c) verschiebt sich also vom polaren Maximum der mittleren täglichen solaren Einstrahlung (b) weg in Richtung auf die Tropen. Bei der Berechnung der Temperatur (a) wäre nach Kramms Kommentar also ein zu (c) kongruentes Temperaturmuster zu erwarten. Stattdessen soll dann bei der Temperaturberechnung ausgerechnet eine gegensinnige Rückverschiebung der entsprechenden Temperaturmaxima aus (c) kongruent zu (b) in Richtung auf die Pole erfolgt sein? – Ja, wer glaubt denn sowas! Der vom verantwortlichen Lead-Autor vorgegebene Zusammenhang zwischen der spezifischen Strahlungsleistung der absorbierten Strahlung und der Temperatur [(c) => (a)] in der Abbildung 22 von Kramm et al. (2017) kann also nicht sinnhaft nachvollzogen werden.

Der Schluss, dass die Grafik 2 (a) aus der tagesdurchschnittlichen solaren Strahlungsleistung 2 (b) abgeleitet worden sein muss, ist jetzt also durch das Fehlen der 2017er-Grafik 22 (c) bei Kramm et al. (2022) zwingend geworden.

Jedenfalls lassen die Autoren diesen klaren Eindruck für den Betrachter so stehen, obwohl die Temperaturen in Abb. 2 (a) und die zugehörigen Strahlungsleistungen in Abb. 2 (b) vom Betrag her einfach nicht zueinander passen. Trotzdem bestätigen Kramm et al. (2022) eine Ableitung der Temperaturen 2 (a) aus der tagesdurchschnittlichen Einstrahlung 2 (b) ausdrücklich, indem sie zu ihren Abbildungen 1 bis 3 angeben, Zitat von Seite 388 (unten) mit Hervorhebungen:

“As illustrated in Figures 1-3, the distribution of the surface temperature on a planet or a natural satellite (like Earth’s Moon or Jupiter’s Galilean moon Io) in the absence of an atmosphere is non-uniform. As outlined by von Hann, this distribution of the surface temperature is mainly governed by the solar insolation defined as the flux of solar radiation per unit of horizontal area for a given location [8].”

Dieser klaren Aussage aus Kramm et al. (2022) widerspricht nun Kramm selbst in seinem aktuellen Kommentar diametral. Zur Erinnerung noch einmal Kramms Zitat aus seinem Kommentar vom 6. Januar 2023 um 17:53 Uhr mit Hervorhebungen:

„Zur Bewertung der geographischen und jahreszeitlichen Verteilung der „slab“-Temperatur im Falle einer Erde ohne Atmosphaere nach Abbildung 22 (a) vonKramm et al. (2017) war nicht die Verteilung der solaren Einstrahlung nach Abbildung 22 (b) erforderlich, auf die Sie sich berufen haben, sondern die entsprechende Verteilung der absorbierten solaren Strahlung in Abbildung 22 (c), die Sie durch Vertuemmeln der Abbildung 22 weggelassen haben.“

Es liegen von Kramm et al. (2022) und Kramm selbst also diametral gegenteilige Erklärungen darüber vor, wie und aus welchen Strahlungswerten die in Abbildung 22 (a) / 2 (a) dargestellten Temperaturen tatsächlich berechnet worden sind. Offenbar sind aber beide Aussagen falsch, weil die Temperaturwerte in Abb. 22 (a) / 2 (a) nach der hier dargelegten Indizienlage aus dem Datensatz der Abb. 22 (b) / 2 (b) durch Reduzierung um eine konstante Albedo entstanden sein müssen.

Wenn also bisher noch kein Korrigendum für die Abbildung 22 aus Kramm et al. (2017) erfolgt sein sollte, dann ist es jetzt mit der Abbildung 2 aus Kramm et al. (2022) aber wirklich allerhöchste Zeit. Die Indizienlage gegen das Temperaturmodell von Kramm et al. (2017) ist erdrückend, aber trotzdem gilt selbstverständlich weiterhin die Unschuldsvermutung dahingehend, dass die Aussagen des verantwortlichen Lead-Autors bezüglich der Temperaturberechnung [22 (c) => 22 (a)] aus Kramm et al. (2017) trotz des Widerspruchs [2 (b) => 2 (a)] aus Kramm et al. (2022) beweisbar sein könnten. Dieser möge daher die vorliegenden Indizien einfach durch einen qualifizierten Kommentar zu dem Widerspruch

[22(c)=>22(a)@Kramm] # [2(b)=>2(a)@Kramm et al. (2022)] = beides falsch (Weber)

ausräumen – aber bitte höflich, sachlich, allgemeinverständlich und nicht überschäumend länglich.

Ergebnis für Modell (B): Die Klimarealisten sollten aufpassen, mit welchen Temperaturmodellen sie in der Diskussion um unsere industrielle Zukunft auftreten. Das Kramm’sche Modell ist dafür gänzlich ungeeignet, weil es eine inverse Welt darstellt. Abgesehen davon ist mir bisher keine bestätigende breitenabhängige Temperaturverteilung mit einem Hotspot auf dem jeweiligen Sommerpol bekannt geworden. Und dieses Modell von Kramm et al. (2017) wird dadurch auch nicht besser, dass man es immer wieder neu veröffentlicht.

Modell (C): Von den konkurrierenden theoretischen Temperaturmodellen für unsere reale Erde wird der natürliche Verlauf der Beleuchtungsklimazonen also lediglich von meinem hemisphärischen S-B-Modell (Abb. a*) sinnstiftend abgebildet:

Abbildung: Vergleich des hemisphärischen S-B-Modells mit den Beleuchtungsklimazonen der Erde

Abbildung: Vergleich des hemisphärischen S-B-Modells mit den Beleuchtungsklimazonen der Erde

Links: Das hemisphärische S-B-Modell aus dem Modellvergleich von Kramm (2021)*

Text: Maxima nach Weber, beginnend mit dem 1. Januar 2000, 12:00 Uhr (JD = 2451545)

Rechts: Beleuchtungsklimazonen der Erde (N-S gestreckt)

Quelle: Wikipedia, Autor: Fährtenleser, Lizenz: GNU Free Documentation License)

Ergebnis für Modell (C): Allein mein hemisphärisches Stefan-Boltzmann-Modell ist in der Lage, die terrestrische Temperaturgenese räumlich und zeitlich korrekt abzubilden, und zwar ohne auf einen sogenannten „natürlichen atmosphärischen Treibhauseffekt“ zurückgreifen zu müssen. Dieses Modell kann sowohl die „gemessene“ globale Temperatur auf der Tagseite unserer Erde über eine korrekte S-B-Berechnung erklären, als auch die Nachttemperatur über die S-B-Umgebungsgleichung und den Wärmeinhalt der globalen Zirkulationen.

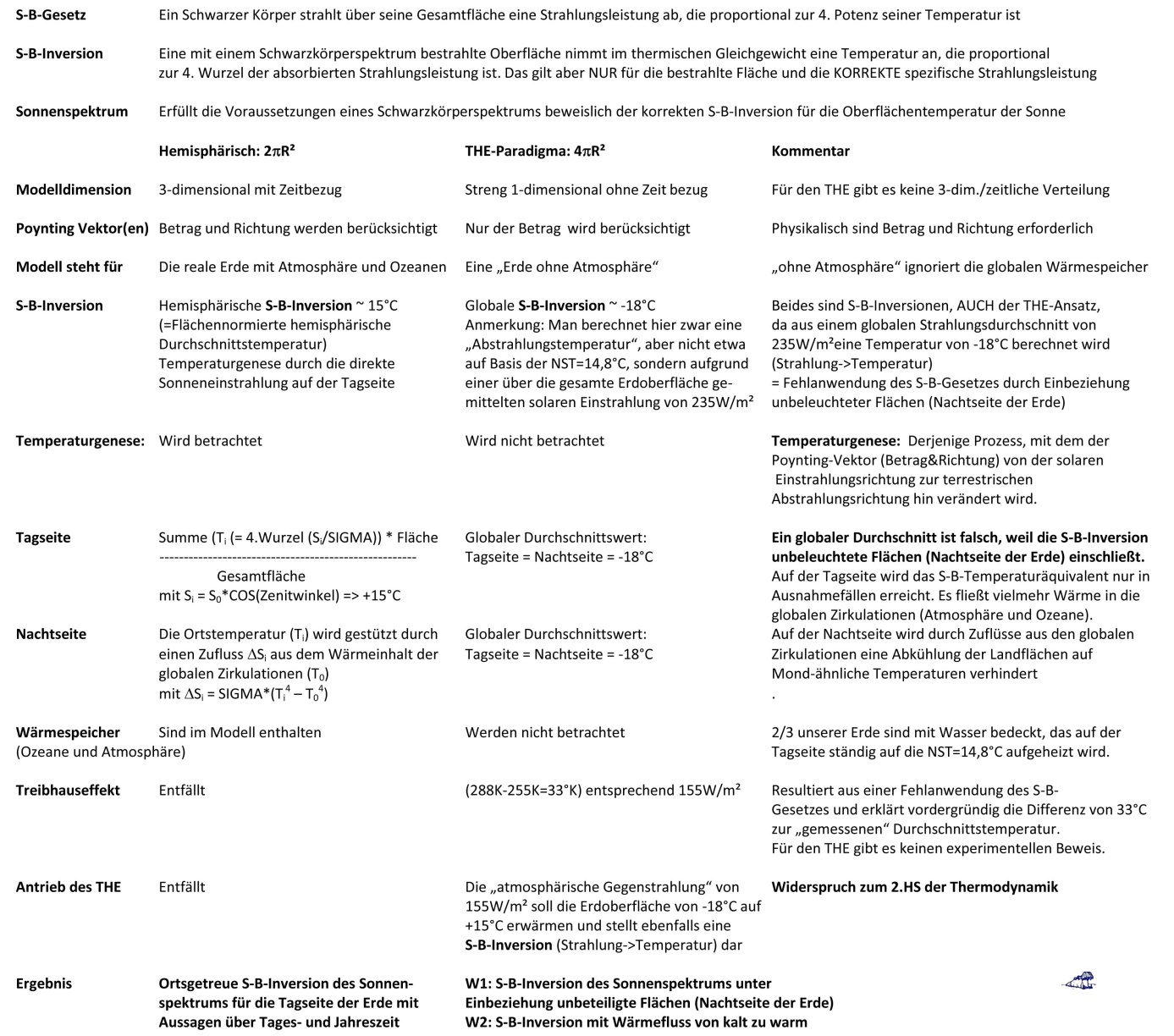

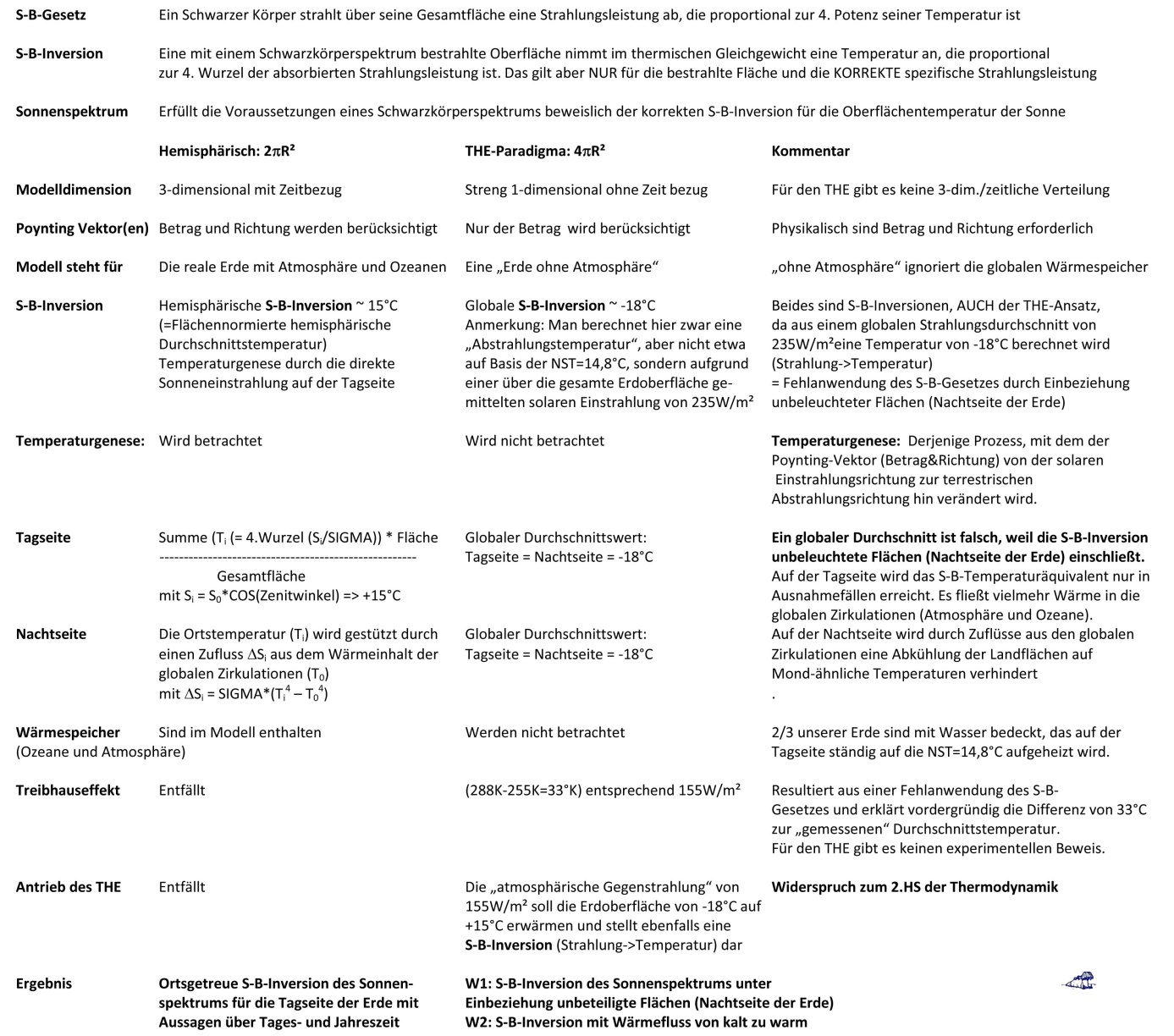

Fazit dieses Faktenchecks: Der Faktor4-Ansatz für die Sonneneinstrahlung auf unserer Erde ist falsch, denn darauf beruht die Sage vom „natürlichen atmosphärischen Treibhauseffekt“. Mein hemisphärisches S-B-Modell ersetzt als realistisches Modell unserer Erde ohne THE sowohl den konventionellen Faktor4-Tag=Nacht -Ansatz der real existierenden Klimawissenschaft mit einem fehlerhaft konstruierten globalen „natürlichen atmosphärischen Treibhauseffekt“ von konstant 33°C, als auch das Modell einer jahreszeitlich variablen breitenabhängigen Durchschnittstemperatur von Kramm et al. (2017) / Kramm et al. (2022) mit seinem polar beheizten inversen Temperaturmodell für unsere Erde, wie die nachfolgende Tabelle beweist:

Tabelle: Vergleich zwischen meinem hemisphärischen S-B-Modell und dem herkömmlichen Faktor4-Tag=Nacht-THE-Ansatz, womit sich Letzterer erledigt hat. Eine Diskussion dieser und weiterer Ansätze ist in „Eine Analyse der Thesen/Antithesen für einen ‚natürlichen atmosphärischen Treibhauseffekt‘“ – Teil-1 – Teil-2 – Teil-3 – nachzulesen.

Tabelle: Vergleich zwischen meinem hemisphärischen S-B-Modell und dem herkömmlichen Faktor4-Tag=Nacht-THE-Ansatz, womit sich Letzterer erledigt hat. Eine Diskussion dieser und weiterer Ansätze ist in „Eine Analyse der Thesen/Antithesen für einen ‚natürlichen atmosphärischen Treibhauseffekt‘“ – Teil-1 – Teil-2 – Teil-3 – nachzulesen.

*) Erklärung: Um jedweden Beschwerden vorzubeugen, bestätige ich hiermit, ein direkter „An“-Adressat der o. g. E-Mail vom 29. Januar 2021 um 09:58 Uhr mit Kramms PDF-Dokument „kramm_bemerkungen_weber_v3.pdf“ und den dort enthaltenen Abbildungen 15 a und b (hier Abbildungen a und b aus Kramm (2021)) zu sein, ebenso, wie u. a. auch die Herren Lüdecke, Limburg und Kirstein. Ich beweise nachfolgend mit der „Confidentiality Warning“ des Dr. Gerhard Kramm die rechtmäßige Nutzung dieser Graphiken, Zitat:

“CONFIDENTIALITY WARNING: The information transmitted is intended only for the person or entity to which it is addressed and may contain confidential and/or privileged material. Any review, retransmission, dissemination or other use of, or taking any action in reliance upon, this information by persons or entities other than the intended recipient is prohibited. If you receive this in error, please contact the sender and delete the material from any computer.”

Der unbestechliche Google-Übersetzer bestätigt mir ausdrücklich, die Inhalte der besagten E-Mail Kramm vom 29. Januar 2021 um 09:58 Uhr rechtmäßig zitiert zu haben:

„VERTRAULICHKEITSWARNUNG: Die übermittelten Informationen sind nur für die Person oder Organisation bestimmt, an die sie gerichtet sind, und können vertrauliches und / oder privilegiertes Material enthalten. Jegliche Überprüfung, Weiterverbreitung, Verbreitung oder sonstige Verwendung oder Ergreifung dieser Informationen durch andere Personen oder Organisationen als den beabsichtigten Empfänger ist untersagt. Wenn Sie dies irrtümlich erhalten, wenden Sie sich bitte an den Absender und löschen Sie das Material von einem beliebigen Computer.“

ERGO: Es verbleiben für eine erlaubte „Überprüfung, Weiterverbreitung, Verbreitung oder sonstige Verwendung oder Ergreifung dieser Informationen“ ausschließlich die von Dr. Kramm „beabsichtigten Empfänger“, und ich bin definitiv der ERSTE „AN“-EMPFÄNGER dieser E-Mail.

Abbildung 3.34 von Seite 51 aus „

Abbildung 3.34 von Seite 51 aus „ Abbildungen a* und b* aus Kramm (2021): Der Modellvergleich aus dem PDF-Dokument von Kramm (2021)* mit jeweils einem Overlay der Beleuchtungsklimazonen (Quelle:

Abbildungen a* und b* aus Kramm (2021): Der Modellvergleich aus dem PDF-Dokument von Kramm (2021)* mit jeweils einem Overlay der Beleuchtungsklimazonen (Quelle:

Abbildung: Vergleich des hemisphärischen S-B-Modells mit den Beleuchtungsklimazonen der Erde

Abbildung: Vergleich des hemisphärischen S-B-Modells mit den Beleuchtungsklimazonen der Erde Tabelle: Vergleich zwischen meinem hemisphärischen S-B-Modell und dem herkömmlichen Faktor4-Tag=Nacht-THE-Ansatz, womit sich Letzterer erledigt hat. Eine Diskussion dieser und weiterer Ansätze ist in „Eine Analyse der Thesen/Antithesen für einen ‚natürlichen atmosphärischen Treibhauseffekt‘“ –

Tabelle: Vergleich zwischen meinem hemisphärischen S-B-Modell und dem herkömmlichen Faktor4-Tag=Nacht-THE-Ansatz, womit sich Letzterer erledigt hat. Eine Diskussion dieser und weiterer Ansätze ist in „Eine Analyse der Thesen/Antithesen für einen ‚natürlichen atmosphärischen Treibhauseffekt‘“ –