Kritische Bewertung des jüngsten Syntheseberichts des UN-Klimagremiums

Vom Irish Climate Science Forum (ICSF).

ICSF-Kritik des IPCC Sixth Assessment Synthesis Report , Executive Summary for Policymakers (AR6 SYR SPM), und des 2023 Climate Action Plan der irischen Regierung (CAP23)

1. Zusammenfassung der ICSF-Position

Das Irish Climate Science Forum (ICSF) ist der Ansicht, dass der kürzlich veröffentlichte AR6-Synthesebericht des IPCC, Zusammenfassung für politische Entscheidungsträger (SPM), schwerwiegende Mängel aufweist, da er die neuesten objektiven Klimawissenschaften und -beobachtungen ignoriert. Dieses neueste SPM ist eine Synthese aus mehreren früheren IPCC-Berichten, die die ICSF bereits als fehlerhaft kritisiert hatte. Es ist schwer vorstellbar, dass das IPCC nach sechs Bewertungsberichten über 35 Jahre immer noch nicht in der Lage ist, das zukünftige Klima mit Gewissheit vorherzusagen, wenn reale Beobachtungen nur auf eine bescheidene weitere Erwärmung von 1 °C bis 2100 hinweisen. Das ICSF schlägt daher vor, dies zu tun Abschaffung des IPCC jetzt.

Der ICSF lehnt daher diesen neuesten IPCC- Synthesebericht SPM als geeignete Grundlage für eine wirklich nachhaltige Politikgestaltung durch die irische Regierung ab und fordert eine grundlegende Überprüfung ihres Klimaschutzplans 2023 (CAP23) im Lichte objektiver Klimawissenschaft, der Erfordernisse von Energie und Ernährungssicherheit und wirtschaftliche Erschwinglichkeit.

Leider hat die fehlerhafte IPCC-Wissenschaft zu einer absurden, auf Minderung basierenden Politik geführt, die nur der Wirtschaft schadet und praktisch keine Auswirkungen auf das Klima hat. Eine gezielte Anpassung an eine moderate Erwärmung ist der Weg in die Zukunft in den kommenden Jahrzehnten.

Das ICSF geht weiter unten auf seine Position ein und verweist auf seine hochrelevanten Vorträge von renommierten Wissenschaftlern (basierend auf detaillierten Recherchen).

2. Der IPCC-Synthesebericht SPM weist schwerwiegende Mängel auf

Die ICSF stellt die folgenden schwerwiegenden Mängel im IPCC-Synthesebericht SPM fest:

o Der SPM präsentiert fünf sehr unterschiedliche Modelle für zukünftige Klimaszenarien, was darauf hinweist, dass das IPCC immer noch nicht in der Lage ist, den Klimawandel bis 2100 mit irgendeiner Sicherheit vorherzusagen, ein unglaubliches Scheitern nach sechs Bewertungsberichten über 35 Jahre. Laufende Temperaturbeobachtungen liefern sehr klare Beweise dafür, dass der Durchschnitt der IPCC-Modelle die Erwärmung deutlich übertreibt und insbesondere, dass die höchsten Szenarien (die Szenarien SSP3-7.0 und SSP5-8.5, wobei letzteres eine Erwärmung von fast 5°C bis 2100 zeigt) sehr unglaubwürdig sind .

o Die SPM impliziert eine sehr wahrscheinliche Gleichgewichtsklimasensitivität von 3 °C (ECS, definiert als globaler Temperaturanstieg aufgrund einer Verdopplung der CO2-Konzentration), trotz mehrerer unabhängiger ECS-Schätzungen von weniger als 1,5 °C.

Neueste wissenschaftliche Erkenntnisse weisen auf eine Klimasensitivität von nur 1°C hin. Das IPCC hat unerklärlicherweise Beweise für niedrige ECS ignoriert.

o In der Praxis stellt die aktuelle Erwärmung daher keine nennenswerte Bedrohung dar; Glücklicherweise erholen sich die globalen Temperaturen allmählich von denen der Kleinen Eiszeit (jetzt etwa 1,1 °C über dem Minimum von 1850), einer der kältesten Perioden der letzten 2.000 Jahre. Und der Planet hat von diesem Temperaturanstieg profitiert.

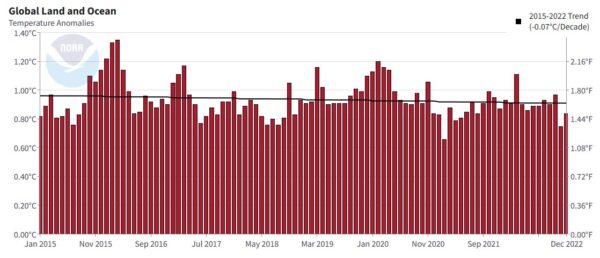

o Kontinuierliche Satellitentemperaturdaten, die umfassendsten und genauesten verfügbaren, bestätigen einen durchschnittlichen globalen Temperaturanstieg von etwa 0,13 °C pro Jahrzehnt in den letzten 40 Jahren.

Dies deutet auf einen weiteren Anstieg um etwa 1°C bis 2100 hin und erreicht eine ähnliche Temperatur wie in den minoischen, römischen und mittelalterlichen Erwärmungsperioden (die das IPCC mit seiner suggestiven „Hockeyschläger“-Grafik zu verschleiern versucht hat).

o Die SPM-Modelle berücksichtigen nicht den logarithmisch abnehmenden THG-Effekt (Treibhausgase) von CO2, wenn die atmosphärische Konzentration weiter zunimmt. Die ersten 100 ppm CO2 verursachen etwa 80 % des THG-Effekts (die Erde glücklich bewohnbar machen), jeder Schritt danach sukzessive weniger, und auf dem aktuellen Niveau von 410 ppm ist es bereits gesättigt. Das Hinzufügen von mehr anthropogenem CO2 wird also wirklich nur eine sehr bescheidene treibhausgasinduzierte weitere Erwärmung verursachen, an die sich die Welt allmählich anpassen kann.

o Unter Berücksichtigung der Tatsache, dass das globale CO2-Niveau von 410 ppm fast 50 % über dem vorindustriellen Niveau von 280 ppm liegt, wird die wahrscheinliche Verdopplung der Treibhausgasemissionen auf 560 ppm bis 2100 einen weiteren Anstieg von weniger als 0,5 °C implizieren Der anthropogene Einfluss. Beobachtungen aus der realen Welt widerlegen die IPCC-Modelle erneut kategorisch.

o Betrachtet man die umgekehrte Situation, so wird die Reduzierung zukünftiger Emissionen durch Minderung einen kaum wahrnehmbaren Einfluss auf das Klima haben. Sogar das IPCC selbst erkennt – wenn auch verschleiert – den minimalen Effekt der Minderung über Jahrzehnte an, da anthropogenes CO2 nur ein kleiner Teil des globalen jahrhundertelangen Kohlenstoffkreislaufs ist.

o Als Realitätsprüfung der mangelnden Wirksamkeit der Minderung kann auf die COVID-Pandemie verwiesen werden. Dies reduzierte die globalen Treibhausgasemissionen bis 2020 um etwa 6 % und hatte eine vernachlässigbare Auswirkung auf die globale CO2-Konzentration in der Atmosphäre und folglich auf eine vernachlässigbare Auswirkung auf das Klima.

o Die SPM behauptet fälschlicherweise, dass die Anstiegsrate der globalen Temperatur nach 1970 beispiellos sei, obwohl sie in den Jahren 1910-1945 gleich schnell war, wobei die globale Abkühlung zwischen 1945 und 1978 stattfand. Diese Abkühlung selbst steht in krassem Widerspruch zu der Behauptung des IPCC Die gesamte moderne Erwärmung hängt mit Treibhausgasen zusammen.

o Paläoklimaaufzeichnungen zeigen ähnliche Temperaturanstiegsraten in früheren Erwärmungsperioden. Diese früheren Erwärmungsperioden wurden offenbar nicht durch die damals vorherrschenden Treibhausgaskonzentrationen angetrieben. Das IPCC ignoriert diese Entkopplung zwischen weit voneinander abweichenden Treibhausgasen und planetaren Temperaturschwankungen über vergangene geologische Perioden. Im Allgemeinen entscheidet sich das IPCC dafür, Beweise für natürliche Klimavariabilität zu ignorieren – ein weiterer schwerwiegender Fehler.

o Insbesondere im Hinblick auf landwirtschaftliche Emissionen ignoriert der SPM die neuesten Forschungsergebnisse unabhängiger Wissenschaftler, insbesondere der Professoren William Happer und William van Wijngaarden, die bewiesen haben, dass die Erwärmung durch Lachgas und Methan unbedeutend sein wird (weniger als 0,1 °C/ Jahrhundert).

o Der SPM bezieht sich auf den angeblich katastrophalen globalen Anstieg des mittleren Meeresspiegels aufgrund des „Kirschenpflückens“. Einhundert Jahre Gezeitenmessungen weisen auf einen linearen Anstieg von nur 1-2 mm/Jahr hin, während etwa 30 Jahre Satellitenmessungen auf einen Anstieg von etwa 3 mm/Jahr hindeuten, und keiner der Datensätze weist Hinweise auf eine Beschleunigung auf.

Selbst wenn man die höhere Zahl annimmt, bedeutet dies nur einen weiteren Anstieg von 25 cm bis 2100. IPCC-Modelle von bis zu 90 cm Meeresspiegelanstieg bis 2100 sind stark übertrieben.

o Angebliche Trends bei sogenannten „extremen Wetterereignissen“ werden oft im SPM erwähnt, ebenso wie im SPM des Berichts der Arbeitsgruppe 1. Aber eine rigorose Datenanalyse in den detaillierten Kapiteln dieses Berichts der WG1 liefert keine Hinweise auf zunehmende Trends bei Überschwemmungen, Dürren (meteorologisch oder hydrologisch), Waldbränden, tropischen Wirbelstürmen, Winterstürmen, Gewittern, Tornados, Hagel, Blitzschlag oder extremen Winden, während es Hinweise auf zunehmende Hitzewellen, starke Niederschläge und Dürren (ökologisch und landwirtschaftlich) gibt

. Das ist angesichts einer leichten Erwärmung nicht verwunderlich. Diese Daten unterminieren auch die SPM-These, dass sich diese Ereignisse verschlimmern werden, wenn eine weitere Erwärmung eintritt. Die SPM des Syntheseberichts ist in beiden Punkten falsch.

o Als weitere verwandte Anmerkung wurde nun gezeigt, dass die „ Fingerabdruck-Zuordnungsstudien “ des IPCC von sogenannten Extremwetterereignissen aus statistischer Sicht systematisch fehlerhaft sind, ein Punkt, den das IPCC nie verstanden hat.

o Was SPM-Kommentare zur Kryosphäre anbelangt, bei denen es sich um Beobachtungen aus der realen Welt handelt, dient das Folgende. Das Eis in der Arktis ist seit 1979 zurückgegangen, aber in den letzten 15 Jahren im Durchschnitt stabil geblieben.

Der Zustand des grönländischen Eisschildes ähnelt dem von 1880. Sowohl die Arktis als auch Grönland waren in den letzten Jahrhunderten wärmer, haben sich aber erholt. Die Antarktis hat jetzt Rekordkalttemperaturen erlebt. Natürlich vorkommende Gletscher ziehen sich regelmäßig zurück und geben Vegetation und historische Artefakte aus vergangenen Wärmeperioden frei.

o Obwohl im SPM nicht ausdrücklich darauf eingegangen wird, verschwinden die kleinen Inseln im Pazifischen Ozean nicht. Es gibt keine nennenswerten Probleme mit Ozeanerwärmung oder Säuregehalt. Die Korallenriffe erholen sich und die Eisbären gedeihen prächtig. Dem SPM mangelt es an wissenschaftlichem Gleichgewicht.

o Schließlich versäumt es das IPCC zu erklären, dass die leicht erhöhten globalen CO2-Werte tatsächlich zu einer Verbesserung der Photosynthese und der globalen Ernteerträge geführt haben, was wiederum zur Bekämpfung der in Entwicklungsregionen leider immer noch weit verbreiteten Mangelernährung beiträgt.

Zusammenfassend lässt sich sagen, dass die vom SPM implizierte Botschaft, dass es eine „Klimakrise“ gibt, durch die vielen oben genannten Argumente überhaupt nicht gestützt wird. Vielmehr deuten Beobachtungen aus der realen Welt nur auf eine bescheidene weitere Erwärmung von etwa 1 °C bis 2100 hin. Das SPM-Mantra für „tiefe, schnelle und nachhaltige Emissionsreduzierung“ ist stark übertrieben. Anpassung ist der Weg nach vorn. Es scheint, dass die wissenschaftliche Objektivität des IPCC durch Gruppendenken und Geopolitik beeinträchtigt wird.

3. Auswirkungen auf Irlands Klimaschutzplan 2023 (CAP23)

Irlands CAP23 unterstützt die Ansicht, dass Minderung bis 2050 Net-Zero nicht irgendwie „den Planeten retten“ wird. Im Gegenteil, es wird das Klima nicht spürbar belasten.

Spezifisch:

o Der „ Carbon Budget and Technical Report “ des Irish Climate Change Advisory Councilmodellierte Irlands vorgeschlagene Treibhausgasminderungspfade bis 2050 und stellte fest, dass sie, wenn sie erreicht würden, die globalen Temperaturen um nur wenige Tausendstel Grad senken könnten .

o Die Kosten für Irlands illusorische Reduzierung der Treibhausgasemissionen um 51 % bis 2030 wurden vom IWF auf 200 Milliarden Euro bis 2030 geschätzt, was bis dahin etwa 100.000 Euro pro Haushalt entspricht.

Ein solches Vorgehen ist angesichts der explodierenden Staatsverschuldung und des Finanzierungsbedarfs für Wohnen, Gesundheit und andere soziale Belange kaum zu rechtfertigen.

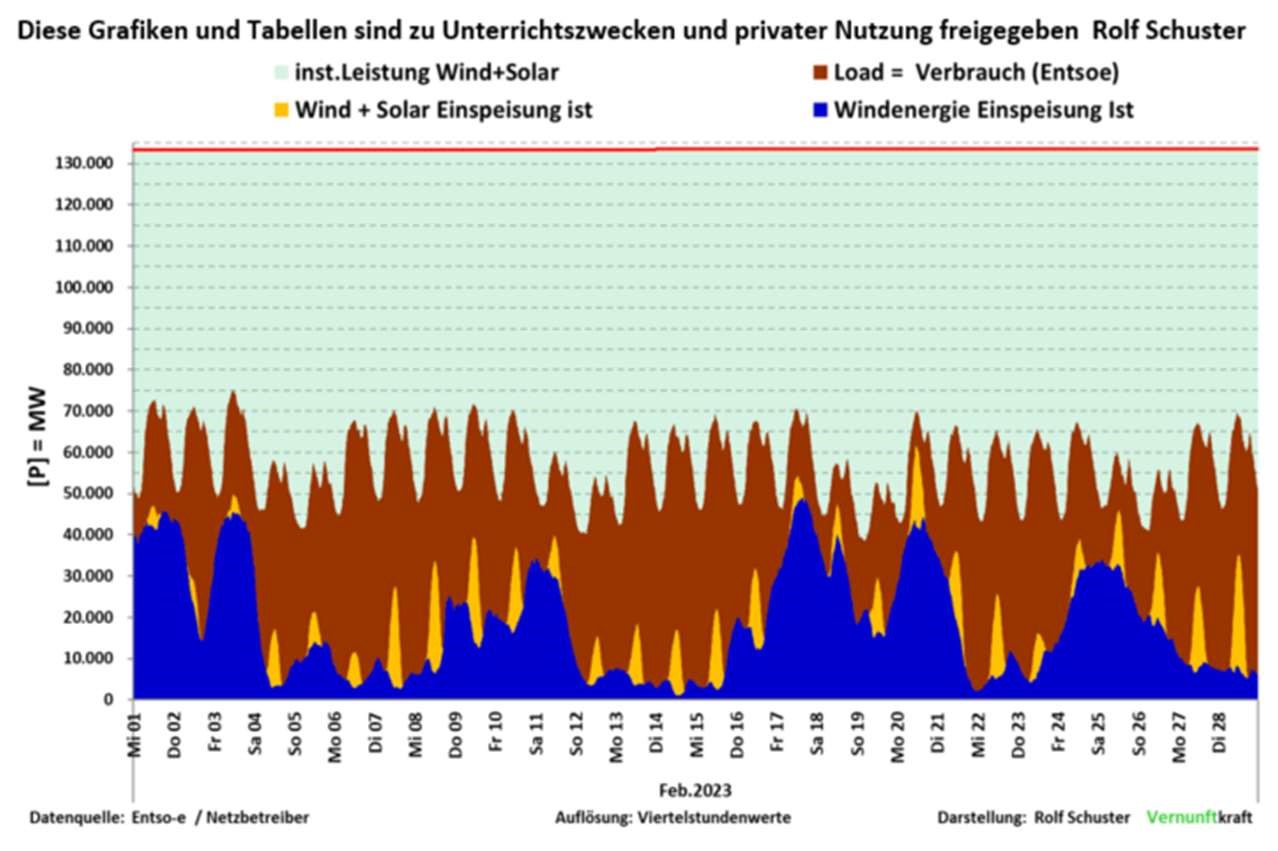

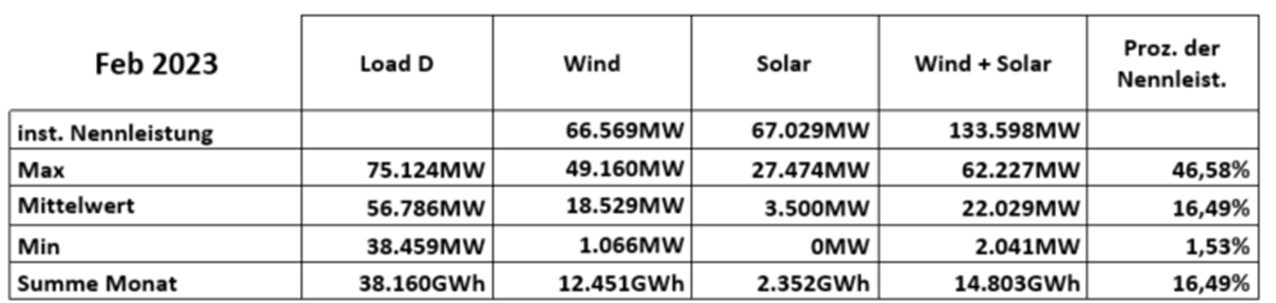

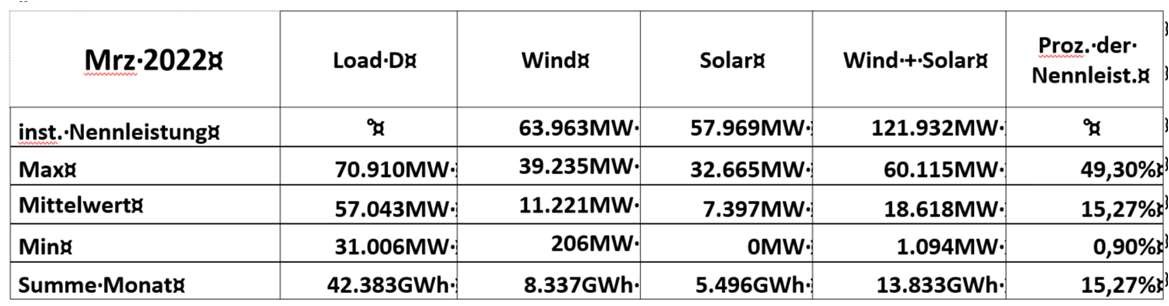

o Das Ziel von 80 % erneuerbarer Energie ist illusorisch, ebenso wie groß angelegte Energiespeicheroptionen nicht vor 2030 realisierbar sein werden. Wind- und Solarenergie sind nicht nur intermittierend, stören die Netzstabilität, sondern sind auch ineffizient in der Nutzung von Energie, Raum und Materialien , insbesondere Edelmetalle. Es gibt wenig Verständnis für die großen Umstrukturierungen von Übertragungs- und Verteilungsnetzen, die erforderlich sind, um erneuerbare Energiequellen aufzunehmen und gleichzeitig die wahrscheinliche Verdoppelung der Netzlast zu bewältigen, die sich aus der angenommenen Elektrifizierung von Übertragung und Wärme ergibt.

o Es gibt eine alarmierende Erosion der nationalen Energiesicherheit im Zusammenhang mit dem Niedergang des Corrib-Gasfelds, Irlands einziger einheimischer Ressource. Es ist unfassbar naiv, den Bau eines LNG-Importterminals zu verschieben. Irlands übermäßige Abhängigkeit von britischen Gasverbindungsleitungen ist bereits problematisch und wird wahrscheinlich vor 2030 zu Stromengpässen und Stromausfällen führen . Irland benötigt wie alle Länder eine erschwingliche, zuverlässige und sichere Energieversorgung für eine nachhaltige Zukunft.

o Wie bereits erwähnt, verfügt das IPCC in Bezug auf landwirtschaftliche Emissionen über die neueste Klimawissenschaft zu Methan und Lachgas. Es gibt also absolut keine wissenschaftliche Grundlage für die Einschränkung der Landwirtschaft in Irland, insbesondere im Kontext des idealen gemäßigten landwirtschaftlichen Klimas in Irland und der wachsenden globalen Ernährungsunsicherheit.

o Schrittweise Anpassung an den bescheidenen Klimawandel der nächsten Jahrzehnte, was pragmatisch wirtschaftlich, technisch und gesellschaftlich sinnvoll wäre. Im irischen Kontext sollte dies am besten für ausgewählte Projekte geeignet sein, die möglicherweise für den Hochwasserschutz, die Küstenerosion, die Wasserversorgung und die Widerstandsfähigkeit der Infrastruktur erforderlich sind.

ICSF fordert die Regierung insbesondere dringend auf, den Bau eines LNG-Importterminals zu genehmigen, um die lebenswichtige und erschwingliche irische Energiesicherheit zu gewährleisten. Es fordert die Regierung außerdem dringend auf, den landwirtschaftlichen Sektor Irlands im Zusammenhang mit der globalen Ernährungssicherheit zu erweitern, anstatt ihn einzuschränken. Die ICSF wünscht Irland eine wirklich nachhaltige Zukunft.

4. Fazit

Zusammenfassend lehnt die ICSF diesen fehlerhaften IPCC-Synthesebericht als Grundlage für die öffentliche Ordnung ab und drängt auf eine dringende Überprüfung des Klimaschutzplans 2023. Die nationale Politik sollte auf objektiver Klimawissenschaft beruhen, mit hochselektiver Minderung, basierend auf einem soliden wirtschaftlichen, technologischen und sozialen Pragmatismus, ergänzt durch eine gezielte Anpassung an möglicherweise moderate Klimatrends in den kommenden Jahrzehnten.

***

Über die ICSF

Das 2016 gegründete Irish Climate Science Forum (www.ICSF.ie) fördert Realismus in der Klimawissenschaft und Vorsicht in der Klima-/Energiepolitik. Die ICSF sieht die Notwendigkeit von Klima-/Energieerziehung und Politikgestaltung im besten langfristigen nationalen Interesse, ohne jeglichen Einfluss von Interessengruppen. Um die Objektivität zu gewährleisten, ist das ICSF vollständig eigenfinanziert und erhält keine Mittel von bestimmten Unternehmen oder Sektoren. Die ICSF ist politisch neutral.

Das ICSF arbeitet mit weltweit führenden multidisziplinären Fachleuten in mehr als 30 Ländern über den in den Niederlanden ansässigen Think Tank CLINTEL (www.CLINTEL.org) zusammen und hat mit ihnen eine Vortragsreihe von führenden internationalen Wissenschaftlern organisiert, siehe https://www. icsf.ie/Vortragsreihe.

Kritische beoordeling van het recente syntheserapport van het VN-klimaatpanel