Energiepolitik: Deutschland und die EU katapultieren sich ins geopolitische „Aus“

Von Edgar L. Gärtner

Mein Brüsseler Freund Samuel Furfari, ehemaliger Top-Beamter der EU-Generaldirektion Energie und heute Professor für Geopolitik, macht angesichts aktueller Entwicklungen noch einmal darauf aufmerksam, dass die europäische Einigung nach dem Zweiten Weltkrieg mit der Gründung der Europäischen Gemeinschaft für Kohle und Stahl (Montanunion) im Jahre 1952 begann. Deren Ziel war die Bereitstellung preiswerter Energie im Überfluss, um das Wirtschaftswachstum und den materiellen Wohlstand der breiten Bevölkerung zu fördern. Das gilt noch mehr für den Euratom-Vertrag, der im März 1957 in Rom unterzeichnet wurde. Die Gründerväter der EU hatten begriffen, dass „Wohlstand für alle“ (so der Titel eines Bestsellers des Vaters des deutschen Wirtschaftswunders) ohne allzeit verfügbare preiswerte Energie illusorisch bleiben muss. Nach Ansicht Furfaris ist der Euratom-Vertrag so gut konzipiert, dass er bis heute nicht revidiert werden musste.

Er bewährte sich insbesondere in den 1970er Jahren, als die Organisation Erdöl exportierender Länder (OPEC) versuchte, Westeuropa durch einen Förder- und Lieferstopp zur Aufgabe der Unterstützung Israels zu zwingen. Die „Ölkrise“ von 1973 gab den Anstoß für ehrgeizige Atomprogramme bei mehreren Gründungsmitgliedern der Europäischen Gemeinschaft. Ihr primäres Ziel bestand darin, die Geopolitik der OPEC zu durchkreuzen. Nach dem Plan des linken deutschen Sozialdemokraten Hans Matthöfer, von 1974 bis 1978 Bundesminister für Forschung und Technologie, sollten in Westdeutschland ähnlich wie im Nachbarland Frankreich nicht weniger als 50 neue Kernkraftwerke gebaut werden. Während sich in Westdeutschland sofort Widerstand gegen dieses Vorhaben regte, konnte das Atomprogramm im technokratisch regierten Frankreich über längere Zeit ungestört umgesetzt werden. Dort wurden bis zu fünf Kernreaktoren in einem einzigen Jahr fertiggestellt. Heute beruht die französische Primärenergie-Versorgung zu über 40 Prozent auf der Kernenergie. Frankreich gehört damit zu den wenigen Ländern der Erde, dessen Primärenergie-Mix nicht vom Rohöl dominiert wird. Das geostrategische Ziel, Israel vor seinen feindlichen Nachbarn zu schützen, wurde dennoch erreicht, aber nur zu einem geringen Teil durch den Ausbau der Kernenergie.

Die aktuelle EU-Kommission pfeift auf Verträge

Die EU ist keine Nation, sondern ein durch Verträge zusammenhaltener Staatenbund, ein Gebilde unklaren Charakters. Die nicht gewählte EU-Kommission hat im Prinzip die Aufgabe, die Einhaltung der Verträge zu überwachen. Seit ihrer Eroberung durch grüne Ideologen kommt die Kommission dieser Aufgabe aber nur noch lückenhaft nach. Die aktuelle Kommissionspräsidentin Ursula von der Leyen und ihr Stellvertreter Frans Timmermans tun heute alles, um der weiteren Entwicklung der Kernenergie Steine in den Weg zu legen. Den Euratom-Vertrag, einen der Grundlagen-Verträge der EU, möchten sie am liebsten vergessen machen. So war es keine Überraschung, dass sich am 16. Mai 2023 die Vertreter von 15 EU-Ländern und Großbritanniens auf Einladung der französischen Energiewende-Ministerin Agnès Pannier-Runacher in Paris zu einer Allianz zur Förderung der Kernenergie zusammenschlossen. Nach der Vorstellung dieser Allianz soll die Kapazität der Kernkraftwerke in der EU durch den Bau von 30 bis 45 großen Reaktoren und die Entwicklung modularer Kleinreaktoren (SMR) bis zum Jahre 2050 von derzeit 110 auf 150 Gigawatt gesteigert werden, wobei Hunderttausende von neuen Arbeitsplätzen entstünden. Schon haben die zuständigen französischen Minister für die kommenden 10 Jahre die Schaffung von 100.000 neuen Arbeitsplätzen in der Nuklearindustrie angekündigt. Die französische Bildungs- und Forschungsministerin Sylvie Retailleau verkündete kürzlich im nordfranzösischen Caen zusammen mit zwei weiteren Ministerkollegen einen „Mashallplan“ für die Ausbildung und Rekrutierung von Fachkräften der Nuklearwirtschaft. Nach „30 Jahren Deindustrialisierung“ sei es an der Zeit, einen Neubeginn einzuleiten. Nach Ansicht Samuel Furfaris könnte die Pariser Allianz für die Entwicklung der Kernenergie den von Brüssel nicht mehr respektierten Euratom-Vertrag ersetzen.

Während sich die Pro-Atom-Allianz, nur mäßig beachtet, in Paris konstituierte, fand in den Brüsseler Räumen des Europa-Parlaments die mit großem Tam-Tam angekündigte Konferenz „Beyond Growth“ statt, zu der 20 Mitglieder des Parlaments unterschiedlicher Herkunft eingeladen hatten. Durch die Mitwirkung der Parlamentspräsidentin erhielt diese Konferenz ein offiziöses Gepräge. Ursula von der Leyen erklärte dort in einer Grußadresse, das auf dem Einsatz fossiler Energien beruhende Wachstums-Modell sei obsolet. Damit bekannte sich die Kommissionspräsidentin zum Leitbild „Degrowth“ (Schrumpfung), das geopolitisch nicht begründbar ist. Die Energiepolitik ist damit neben den konterproduktiven Effekten der Sanktionen gegen Russland vom einigenden Prinzip zum Spaltpilz der EU geworden. Den von Deutschland und Österreich angeführten Selbstmord-Kandidaten steht in der EU nun eine Allianz mit positiven Zielen gegenüber.

Wiederentdeckung der Geopolitik als Gespenst

Anders als in Frankreich konnte man in Deutschland den Begriff „Geopolitik“ bis vor kurzem kaum in den Mund nehmen, ohne gleich als „rechtsradikal“ oder „archaisch“ ausgegrenzt zu werden. Dabei hat Deutschland mit Carl Schmitt einen der bekanntesten und international anerkannten Theoretiker der Geopolitik hervorgebracht. Dieser gilt allerdings im eigenen Land als höchst „umstritten“ – wegen seines zeitweiligen Zusammengehens mit den Nazis auch zu recht. (Bei Wikipedia wird die dunkle Seite Schmitts ausführlich abgehandelt. Dort wird aber auch klar, warum Rechte und Linke sich gleichermaßen auf Schmitt berufen können.) Ich selbst hatte zwar an der Uni einiges über Carl Schmitt gehört und gelesen, wurde aber erst durch ein langes Gespräch mit dem inzwischen verstorbenen französischen Öko-Vordenker Bruno Latour zu einer eingehenderen Beschäftigung mit den Schriften Carl Schmitts angeregt. Angesichts des ebenfalls „umstrittenen“, weil kaum demokratisch legitimierten Engagements Deutschlands und der EU an der Seite der Ukraine kommt die westeuropäische Politik nun allerdings nicht mehr um eine geopolitische Begründung herum. Dafür bietet sich die Großraum-Theorie Carl Schmitts geradezu an.

Darauf machte Ende Mai Jochen Buchsteiner, politischer Korrespondent der „Frankfurter Allgemeinen Sonntagszeitung“, aufmerksam, indem er sich auf den britischen Historiker und Geopolitik-Theoretiker Brendan Simms beruft. Dieser geht, so Buchsteiner, davon aus, dass Schmitts Großraumtheorie, die durchaus auch im Sinne der Blut-und-Boden-Ideologie und der darauf fußenden Expansionspläne der Nazis ausgelegt werden konnte, „im Grunde nicht imperialistisch angelegt war, sondern eine Art multipolaren Weltfrieden im Blick hatte: große, kulturell halbwegs homogene Räume, die sich gegenseitig tolerieren sollten.“ Schmitt entwickelte seine Großraumtheorie gegen Ende der 1930er Jahre, als er bei den Nazis schon in Ungnade gefallen war. Er sah in seinem Ansatz eine Alternative zum System des Westfälischen Friedens von 1648, bei dem alle Staaten als gleichwertig gelten. Dieses System sei aber mit der Umsetzung der Monroe-Doktrin der USA von 1823 obsolet geworden. Einen wichtigen Vorteil von Großräumen sah Schmitt darin, dass darin Konflikte zwischen gleichartigen, sich verstehenden Gegnern ausgetragen und gelöst werden können, während man kulturell andersartige Großräume einfach in Ruhe lässt. Wegen des universalistischen Anspruchs eines maßgeblichen Teils der US-Elite wurde dieser Grundsatz im 20. und 21. Jahrhundert allerdings nicht immer und in jüngerer Zeit nur noch selten befolgt. Der westliche Universalismus mit den US-Neocons als Speerspitze zeigte sich als unduldsam gegenüber anderen Ordnungsmodellen. Einmischungen in die inneren Angelegenheiten fremder Staaten unter Berufung auf gefühlige „Werte“ waren an der Tagesordnung, führten aber so gut wie nie zum Ziel.

Jochen Buchsteiner beginnt seinen Beitrag in der FAS vom 29. Mai 2023 mit dem Satz: „Ein Gespenst geht um in Europa – das Gespenst der Geopolitik.“ Eine Effekthaschende Anspielung auf den Beginn des „Kommunistischen Manifests“ von Karl Marx und Friedrich Engels? Als Gespenst gilt die Geopolitik wohl deshalb, weil es in der EU schon länger Überlegungen gibt, das kaum definierbare Gebilde als eigenständigen Großraum im Sinne Carl Schmitts zu definieren und, darauf aufbauend, ein tragfähiges Konzept einer europäischen Sicherheitsarchitektur zu entwickeln. Es ginge also darum, die EU zu einem Kraftpol in einer multipolaren Weltordnung auszubauen. Tatsächlich ist inzwischen auch bei den europäischen Eliten viel von Multipolarität die Rede. De facto ist die EU aber noch lange kein eigenständiger Großraum mit einer Strategie, um den größten wirtschaftlichen und politischen Nutzen aus den geografischen und kulturellen Gegebenheiten zu ziehen, sondern lediglich ein Element des politischen und militärischen Sicherheitssystems der von den USA dominierten NATO. Denkt wirklich jemand, Nordamerika und Westeuropa könnten in Bezug auf die Energieversorgung die gleichen geostrategischen Interessen haben?

Während in Brüssel und Straßburg, Paris und Berlin noch darüber diskutiert wird, ob und inwieweit die EU sich als geopolitischen Großraum definieren soll, schafft Recep Erdogan im östlichen Mittelmeer vollendete Tatsachen, indem er die geografische Lage der Türkei zum Aufbau eines Erdgas-Hubs für die Versorgung ganz Süd- und Nordeuropas ausbaut. Davon profitiert zurzeit in erster Linie das mit der Türkei verbündete Aserbaidschan. Seit September 2018 ist Energy Exchange Istanbul (EPIAS), ein elektronischer Großmarkt für Erdgas und Elektrizität, operationell. Dort wird täglich ein Referenzpreis für Erdgas ermittelt. Istanbul steht damit bis auf weiteres in der Region allein da.

Seit April 2023 produziert die Türkei selbst im Schwarzen Meer Offshore-Erdgas. Größere Erdgas-Vorkommen gibt es im östlichen Mittelmeer. Doch an die kommen die Türken vorläufig nicht ran wegen der griechischen Inseln mit ihren exklusiven Wirtschaftszonen entsprechend dem geltenden Seerechts-Abkommen der UN. Die Türkei hat dieses Abkommen nicht ratifiziert. Bis auf Weiteres bleiben die Türken dort auf Lauerstellung.

Bei Erdogans jüngster Wiederwahl gaben eindeutig Anti-EU-Motive den Ausschlag. Gerade säkular, d.h. kemalistisch orientierte Türken gaben dem muslimischen Fundamentalisten in Deutschland ihre Stimme, weil sie verhindern wollen, dass ihr Land auf den suizidären Kurs der EU-Kommission einschwenkt, der von Erdogans sozialdemokratischem Gegenkandidaten unterstützt wurde. Der von Brüssel seit langem zumindest theoretisch in Aussicht gestellte EU-Beitritt der Türkei ist damit in weite Ferne gerückt. So geht die Türkei in der Energiepolitik ihre eigenen Wege. Ein „Kohle-Ausstieg“ ist dort kein Thema. Gleichzeitig baut die Türkei in Zusammenarbeit mit dem russischen Staatskonzern Rosatom bei Akkuyu ein modernes Kernkraftwerk. Ob das Ursula von der Leyen und Frans Timmermans zum Nachdenken bringt?

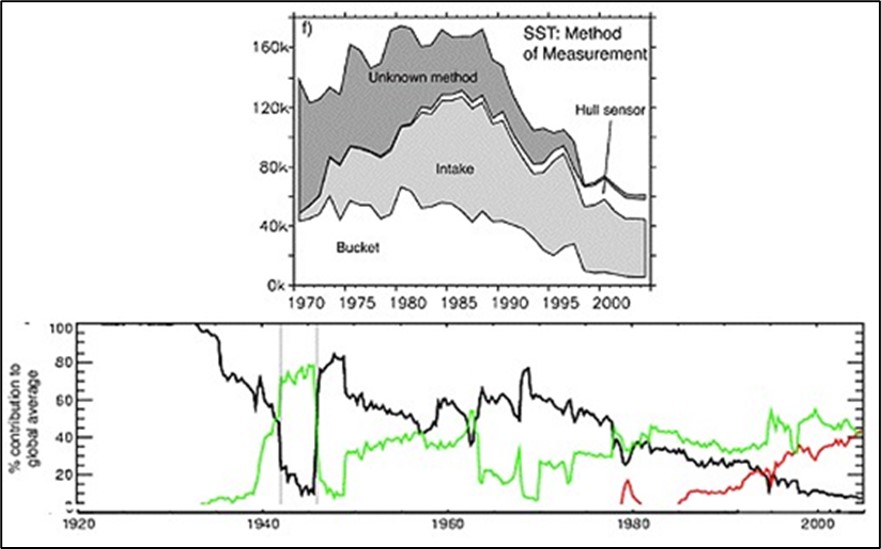

Abbildung 18: Verfahren zur Messung der Wassertemperatur in Abhängigkeit von der Zeit. Die vertikale Achse stellt die Anzahl der Messungen in der oberen Abbildung dar, und die Prozentsätze in der unteren Abbildung, wobei die rote Linie den Prozentsatz der Messungen durch Bojen darstellt, die grüne Linie die Anzahl der Messungen am Einlass des Motorkühlsystems (ERI), und die schwarze Linie die Messungen durch Tanks.

Abbildung 18: Verfahren zur Messung der Wassertemperatur in Abhängigkeit von der Zeit. Die vertikale Achse stellt die Anzahl der Messungen in der oberen Abbildung dar, und die Prozentsätze in der unteren Abbildung, wobei die rote Linie den Prozentsatz der Messungen durch Bojen darstellt, die grüne Linie die Anzahl der Messungen am Einlass des Motorkühlsystems (ERI), und die schwarze Linie die Messungen durch Tanks.

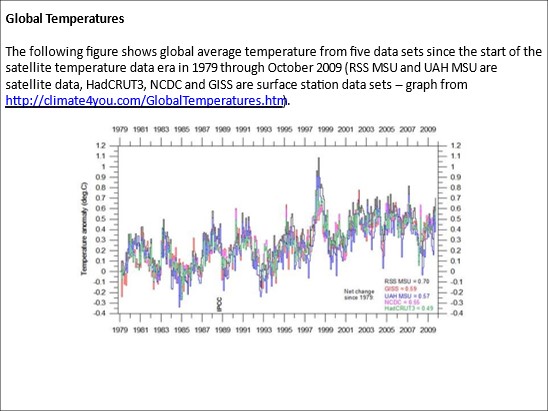

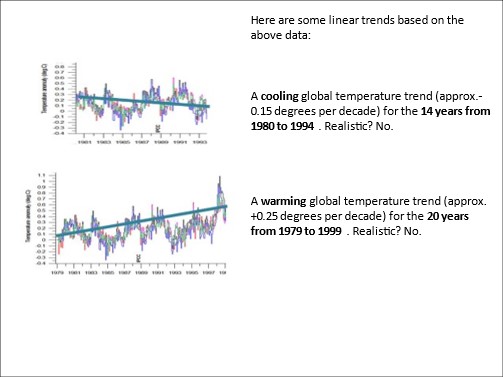

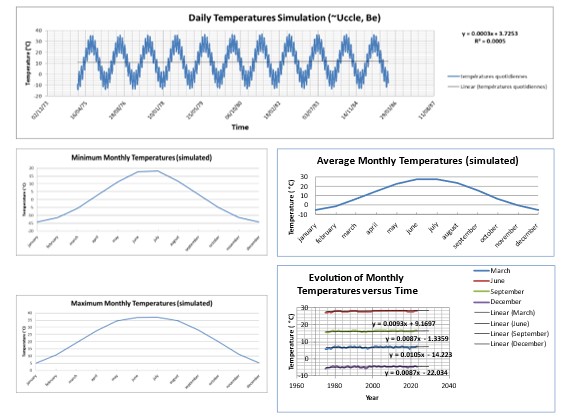

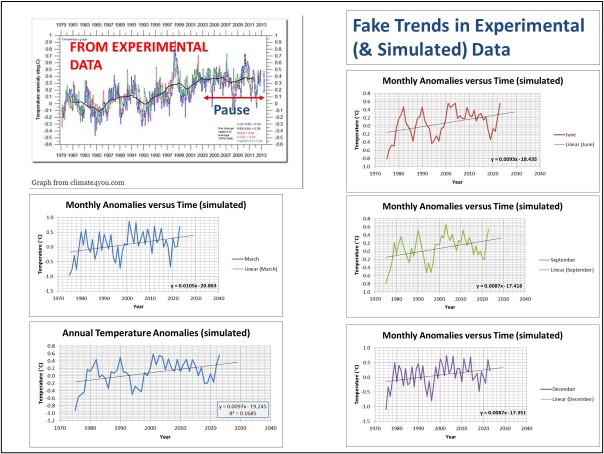

Abbildung 20: Daten zur Veranschaulichung der Auswirkungen der Länge des Messfensters und seiner Anfangszeit.

Abbildung 20: Daten zur Veranschaulichung der Auswirkungen der Länge des Messfensters und seiner Anfangszeit.

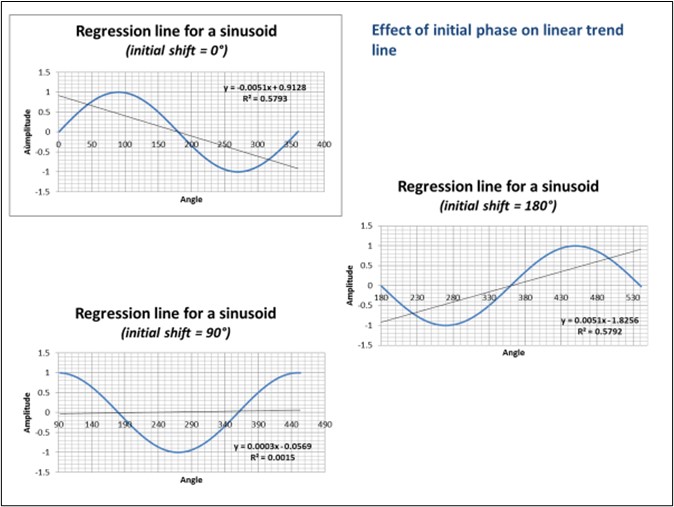

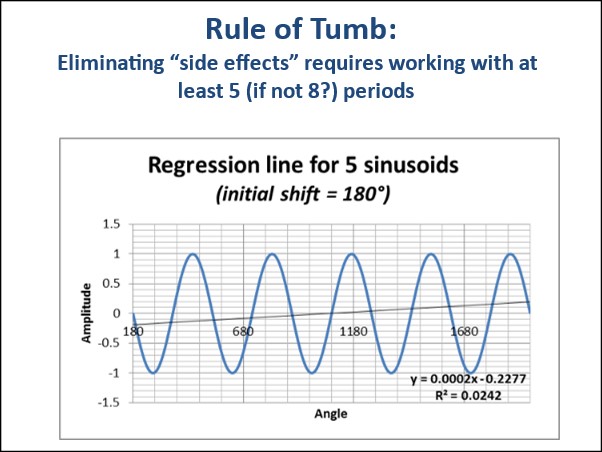

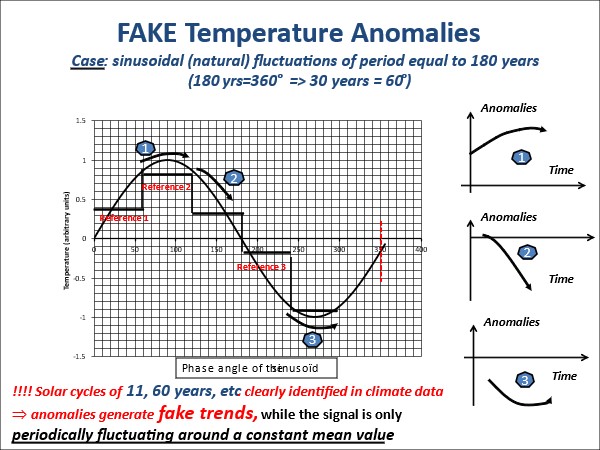

Abbildung 22: Sinuskurven und Regressionsgeraden. 22a: Auswirkung der Anfangsposition des Messfensters (mit einer Länge, die der Periode der Sinuskurve entspricht); die Steigung variiert von +1 bis -1 je nach der Position des Anfangszeitpunkts des Messfensters im Verhältnis zur Sinuskurve. 22b: Regressionslinie über mehrere Sinuswellenperioden. Die Steigung wird sehr gering.

Abbildung 22: Sinuskurven und Regressionsgeraden. 22a: Auswirkung der Anfangsposition des Messfensters (mit einer Länge, die der Periode der Sinuskurve entspricht); die Steigung variiert von +1 bis -1 je nach der Position des Anfangszeitpunkts des Messfensters im Verhältnis zur Sinuskurve. 22b: Regressionslinie über mehrere Sinuswellenperioden. Die Steigung wird sehr gering.

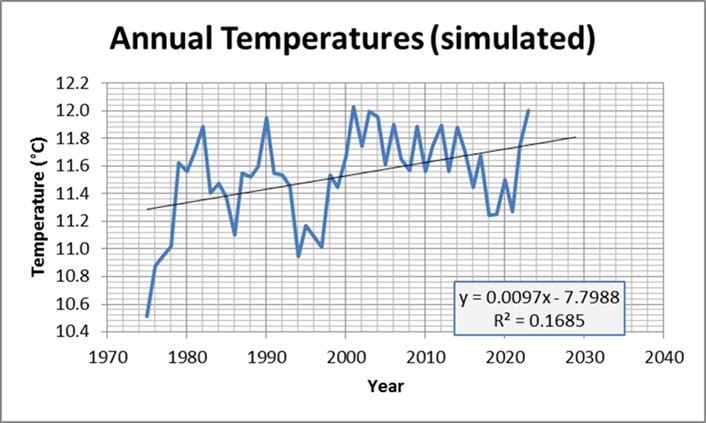

Abbildung 25: Anpassung der Temperaturanomalien über einen Zeitraum von zwei Jahrhunderten durch Regressionslinien. Das Erscheinungsbild in Form eines aufsteigenden Sinuszweiges (mit einer Periode von etwa 360 Jahren) ist in dieser Abbildung, die mit dem Dalton-Minimum beginnt, deutlicher zu erkennen. Die über immer kürzere Zeiträume berechneten Regressionslinien (mit Anfangszeitpunkten, die immer näher am heutigen Zeitpunkt liegen) weisen immer stärkere Steigungen auf, was auf eine Beschleunigung der globalen Erwärmung hindeutet, während wir diese Abbildung genauso gut als aufsteigenden Zweig einer Sinuskurve interpretieren können, die bald ihr Maximum durchlaufen wird (tatsächlich endet diese Grafik im Jahr 2000, und seither wurde das Maximum erreicht), bevor sie wieder abnimmt.

Abbildung 25: Anpassung der Temperaturanomalien über einen Zeitraum von zwei Jahrhunderten durch Regressionslinien. Das Erscheinungsbild in Form eines aufsteigenden Sinuszweiges (mit einer Periode von etwa 360 Jahren) ist in dieser Abbildung, die mit dem Dalton-Minimum beginnt, deutlicher zu erkennen. Die über immer kürzere Zeiträume berechneten Regressionslinien (mit Anfangszeitpunkten, die immer näher am heutigen Zeitpunkt liegen) weisen immer stärkere Steigungen auf, was auf eine Beschleunigung der globalen Erwärmung hindeutet, während wir diese Abbildung genauso gut als aufsteigenden Zweig einer Sinuskurve interpretieren können, die bald ihr Maximum durchlaufen wird (tatsächlich endet diese Grafik im Jahr 2000, und seither wurde das Maximum erreicht), bevor sie wieder abnimmt.

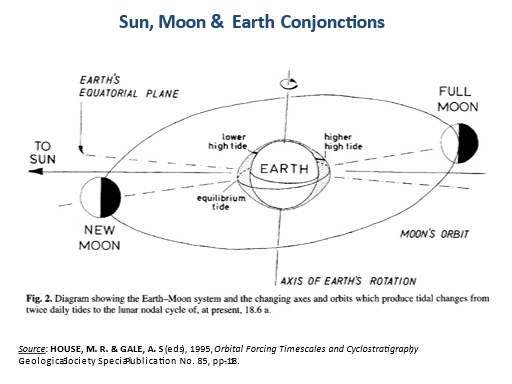

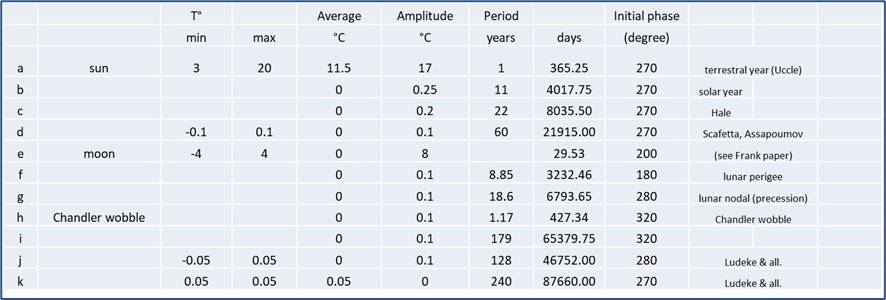

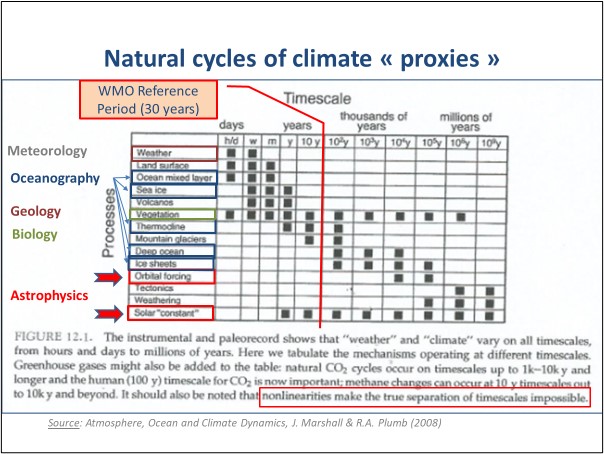

Tabelle 2: Einige natürliche Zyklen im Vergleich zu dem für die Berechnung der Temperaturanomalien verwendeten Bezugszeitraum.

Tabelle 2: Einige natürliche Zyklen im Vergleich zu dem für die Berechnung der Temperaturanomalien verwendeten Bezugszeitraum.

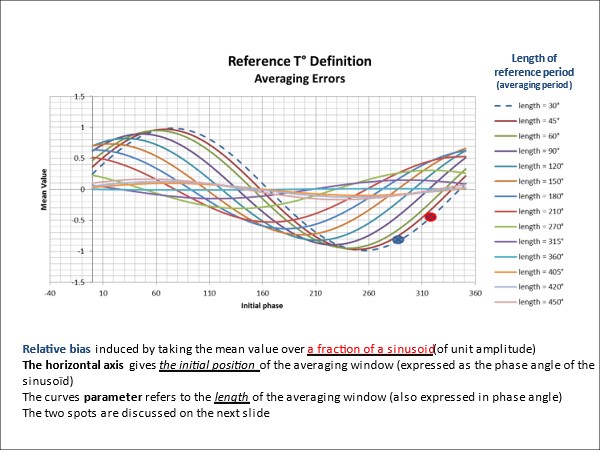

Abbildung 13: Verzerrung des zur Berechnung der Anomalien verwendeten Basiswerts nach Länge der Referenzperiode. Die Periode der Sinuskurve mit Einheitsamplitude wird in Grad (360°) ausgedrückt. Die Kurven stellen die Länge der Referenzperioden dar, die für die Berechnung der Anomalien verwendet wurden. Sie sind ebenfalls in Grad angegeben (die Bruchteile der Periode darstellen). Die Punkte der verschiedenen Kurven entsprechen dem anfänglichen Offset der Referenzperiode. Diese Verzerrungen sind sehr variabel und können bis zur Amplitude der Sinuskurve reichen. In dieser Abbildung wird auch das Problem der „gestuften Verbindung“ deutlich, wenn man von einer Referenzperiode zu einer anderen wechselt, wobei sich die Verzerrung je nach Position auf der Sinuskurve in die eine oder andere Richtung ändert. Die beiden Punkte, die den Kurven hinzugefügt wurden, veranschaulichen dieses Problem.

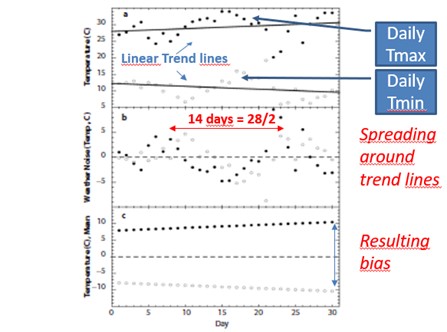

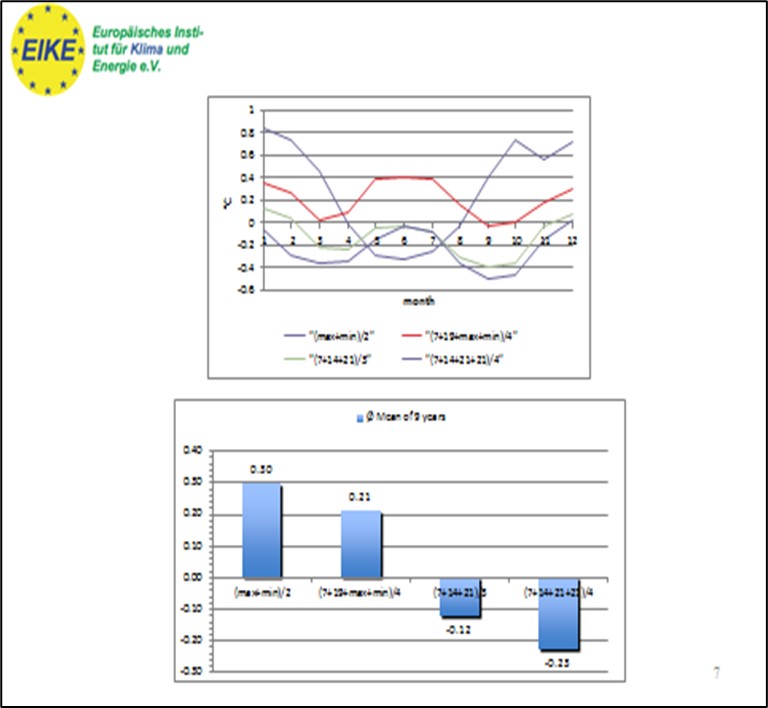

Abbildung 13: Verzerrung des zur Berechnung der Anomalien verwendeten Basiswerts nach Länge der Referenzperiode. Die Periode der Sinuskurve mit Einheitsamplitude wird in Grad (360°) ausgedrückt. Die Kurven stellen die Länge der Referenzperioden dar, die für die Berechnung der Anomalien verwendet wurden. Sie sind ebenfalls in Grad angegeben (die Bruchteile der Periode darstellen). Die Punkte der verschiedenen Kurven entsprechen dem anfänglichen Offset der Referenzperiode. Diese Verzerrungen sind sehr variabel und können bis zur Amplitude der Sinuskurve reichen. In dieser Abbildung wird auch das Problem der „gestuften Verbindung“ deutlich, wenn man von einer Referenzperiode zu einer anderen wechselt, wobei sich die Verzerrung je nach Position auf der Sinuskurve in die eine oder andere Richtung ändert. Die beiden Punkte, die den Kurven hinzugefügt wurden, veranschaulichen dieses Problem. Abbildung 14: Algorithmen zur Bestimmung der Tagestemperatur und Fehler im Vergleich zur tatsächlichen Durchschnittstemperatur, die durch die Integration kontinuierlicher Temperaturmessungen über die gesamten 24 Stunden eines Tages abgeleitet wird. Der Fehler liegt in der Größenordnung von +- 0,6°C

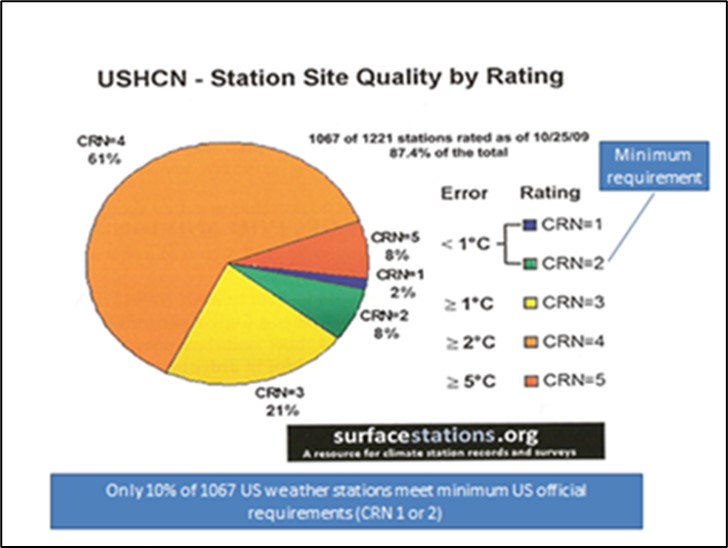

Abbildung 14: Algorithmen zur Bestimmung der Tagestemperatur und Fehler im Vergleich zur tatsächlichen Durchschnittstemperatur, die durch die Integration kontinuierlicher Temperaturmessungen über die gesamten 24 Stunden eines Tages abgeleitet wird. Der Fehler liegt in der Größenordnung von +- 0,6°C Abbildung 15. Genauigkeit der Messungen an terrestrischen Wetterstationen in den USA. Weniger als 10% der 1221 untersuchten Stationen haben einen Fehler von weniger als 1°C.

Abbildung 15. Genauigkeit der Messungen an terrestrischen Wetterstationen in den USA. Weniger als 10% der 1221 untersuchten Stationen haben einen Fehler von weniger als 1°C.

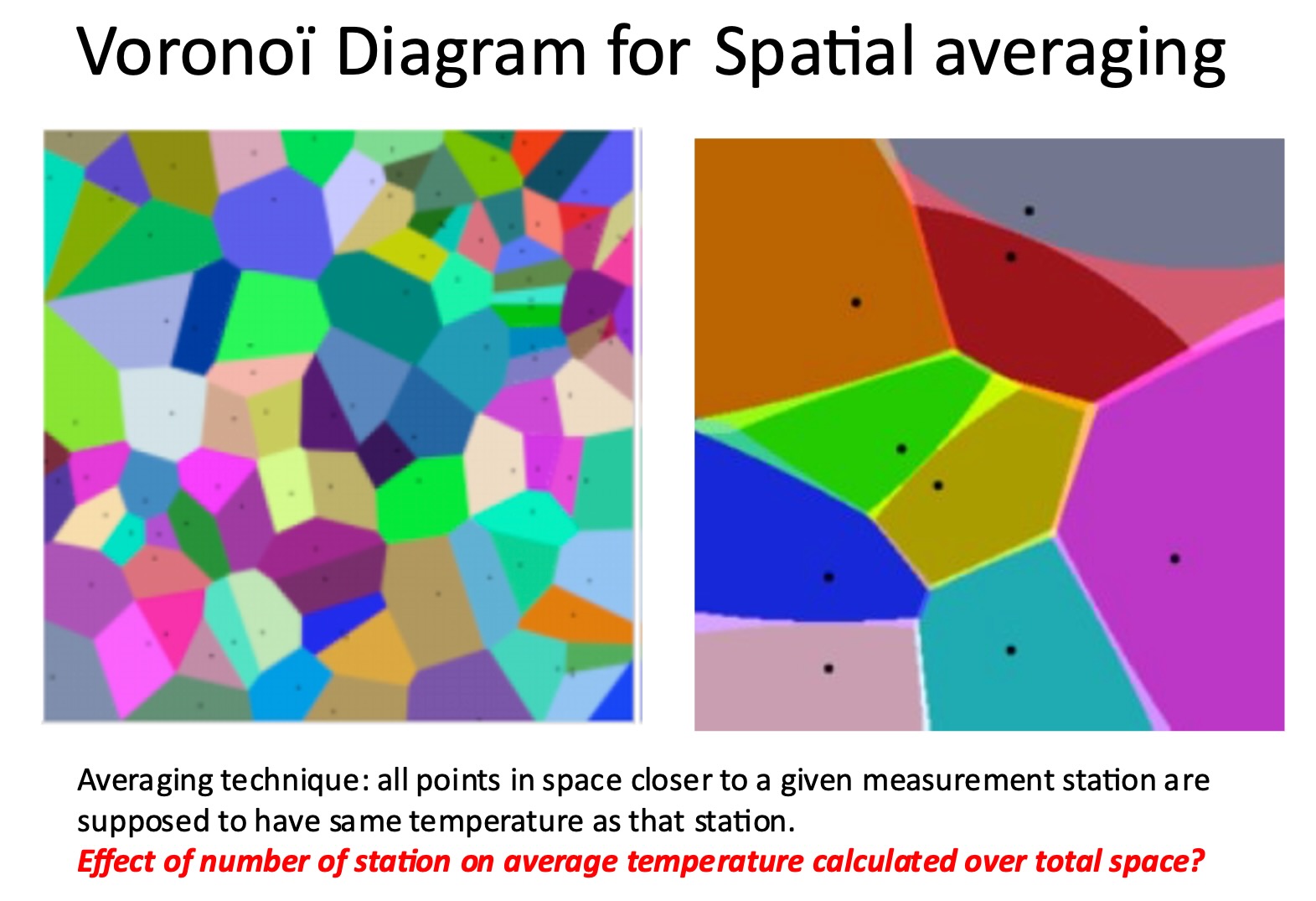

Abbildung 6: Illustration des VoronoÏ-Algorithmus. Die Kontrollbereiche sind durch unterschiedliche Farben gekennzeichnet. Wenn die Anzahl der Stationen (dargestellt durch schwarze Punkte) abnimmt, vergrößern sich deren Kontrollbereiche.

Abbildung 6: Illustration des VoronoÏ-Algorithmus. Die Kontrollbereiche sind durch unterschiedliche Farben gekennzeichnet. Wenn die Anzahl der Stationen (dargestellt durch schwarze Punkte) abnimmt, vergrößern sich deren Kontrollbereiche.