Sprechen wir mal über wissenschaftliche Paradigmen und deren Wechsel

von Uli Weber

Zunächst einmal müssen wir den Begriff „Paradigma“ klären, und dabei hilft uns die GOOGLE-KI des Browsers, Zitat:

„Ein Paradigma ist ein allgemein anerkanntes Muster, Denkweise oder Modell, das als Grundlage zur Orientierung und Problemlösung in Wissenschaft, Gesellschaft oder Technik dient. Es prägt Überzeugungen, Methoden und Sichtweisen. Synonyme sind Modell, Vorbild, Denkmuster oder Leitbild. Bei einem grundlegenden Wandel dieser Sichtweise spricht man von einem Paradigmenwechsel.“

Ein Paradigma ist also ein allgemein anerkanntes Modell für irgendein Phänomen, und von dem kann es nach dem Highlander-Prinzip jeweils nur ein einziges geben. Ein Modell beschreibt üblicherweise ein solches Phänomen auf der Grundlage von gesicherten Lehrsätzen und stellt damit ein mehr oder minder zutreffendes Abbild der Realität dar:

Phänomen => Gesicherte Lehrsätze => Modell => Übereinstimmung mit der Realität

Festhalten können wir hier also schon einmal, dass ein Modell nicht die Realität ersetzt, sondern sich an dieser Realität beweisen muss. Und in die Zukunft gerichtete Modelle müssen dann zumindest die Vergangenheit durch ein historisches Backtesting korrekt darstellen können. Denn es kommt ausschließlich auf die Widerspruchsfreiheit eines Modells gegenüber den zugrunde liegenden gesicherten Lehrsätzen und der Realität an. Jedenfalls kann kein Modell ein konkurrierendes Modell aus sich selbst heraus widerlegen. Vielmehr ist eine solche Widerlegung nur durch die beiden Modellen zugrunde liegenden gesicherten Lehrsätze möglich.

Im besten Fall entsteht aus einem solchen Modell also ein allgemein anerkanntes Paradigma für das beschriebene Phänomen. Wenn wir nun ein gültiges Paradigma mit konkurrierenden wissenschaftlichen Ansätzen für dasselbe zugrunde liegende Phänomen vergleichen wollen, dann müssen wir uns auf die Ebene der Modelle und deren Einzelschritte begeben. Und wenn es über irgendein Phänomen noch gar kein herrschendes Paradigma gibt, dann wehrt sich der wissenschaftliche Mainstream üblicherweise trotzdem. Denn schließlich existiert auch dann irgendeine Mehrheitsmeinung, mit deren Hilfe bessere Erkenntnisse eingehegt werden können, um eine Veränderung des sicher geglaubten Weltbildes zu vermeiden. Dazu drei Beispiele aus unserem Kulturkreis:

Johann Carl Fuhlrott (1803 – 1877) https://de.wikipedia.org/wiki/Johann_Carl_Fuhlrott, Zitat:

„Fuhlrott hatte die besonderen Merkmale der ihm von einem Steinbruchbesitzer übergebenen Knochen (Überaugenwülste, ungewöhnlich dicke Grate und Leisten als Ansatzpunkte überaus kräftiger Muskeln) auf Anhieb einem Individuum „aus der vorhistorischen Zeit“ zugeschrieben, zwei Jahre vor Darwins bedeutender Schrift Über die Entstehung der Arten. Als er seine Deutung 1857 auf einer Versammlung von Naturforschern zur Diskussion stellte, wurde er von den Gelehrten jedoch nicht ernstgenommen; mehr noch, deren Reaktion empfand Fuhlrott als extrem entmutigend. Seinen ersten schriftlichen Bericht versah er mit dem resignierten Schluss, dass er ‚auf jeden Versuch einer Propaganda für meine Überzeugung gern verzichte‘.“

Ignaz Philipp Semmelweis (1818- 1865) https://de.wikipedia.org/wiki/Ignaz_Semmelweis , Zitat:

„Semmelweis führte das häufigere Auftreten von Kindbettfieber in öffentlichen Kliniken im Vergleich zur privaten Entbindung auf mangelnde Hygiene bei Ärzten und Krankenhauspersonal zurück und bemühte sich, Hygienevorschriften einzuführen. Später wurde er ‚Retter der Mütter‘ genannt. Seine Studie von 1847/48 gilt heute als erster praktischer Fall von evidenzbasierter Medizin (auf empirische Belege gestützte Heilkunde) in Österreich und als Musterbeispiel für eine methodisch korrekte Überprüfung wissenschaftlicher Hypothesen. Zu seinen Lebzeiten wurden seine Erkenntnisse, von ihm 1861 publiziert, nicht anerkannt und von Kollegen als ‚spekulativer Unfug‘ abgelehnt. Nur wenige Ärzte unterstützten ihn, da Hygiene als Zeitverschwendung und unvereinbar mit den damals geltenden Theorien über Krankheitsursachen angesehen wurde.“

Alfred Lothar Wegener (1880 – 1930) https://de.wikipedia.org/wiki/Alfred_Wegener, Zitat:

„Wegeners Theorie von der Verschiebung der Kontinente blieb zu seinen Lebzeiten immer umstritten und geriet nach seinem Tod rasch in Vergessenheit. Nur wenige Wissenschaftler, wie der Paläogeograph Edgar Dacqué oder der Belgrader Astronom Milutin Milanković, unterstützten Wegener von Anfang an. Andere Kollegen sprachen eher von ‚Gedankenspielerei‘, ‚Phantasiegebilden‘ oder gar von ‚Fieberfantasien der von Krustendrehkrankheit und Polschubseuche schwer Befallenen‘. Max Semper schrieb eine Kritik an der Theorie, die in folgende Verspottung der Person Wegeners mündet: ‚[…] so kann man nur um Innehaltung der nötigen Distanz ersuchen und die Bitte daran anschließen, doch künftig die Geologie nicht weiter zu beehren, sondern Fachgebiete aufzusuchen, die bisher noch vergaßen, über ihr Tor zu schreiben: ‚O heiliger Sankt Florian, verschon’ dies Haus, zünd’ andere an!‘ – Max Semper: (1917)“

Alle drei genannten Wissenschaftler haben den Triumph ihrer Erkenntnis nicht mehr erlebt. Es ist nämlich völlig gleichgültig, ob lediglich Lücken in Grundlagenwissen oder Phantasie des tonangebenden Mainstreams vorherrschen, oder ob die herrschende Lehrmeinung gar aus religiösen Glaubenssätzen besteht. Es kann jedenfalls Jahrzehnte dauern, bis ein alternatives Modell schließlich doch noch zum wissenschaftlichen Paradigma wird – und manchmal sogar noch viel länger, bis auch der verursachende Querdenker eine persönliche Rehabilitierung durch das inquisitorische Religionsgericht erfährt:

Galileo Galilei (1564 – 1641/1642) https://de.wikipedia.org/wiki/Galileo_Galilei

Galileo Galilei hatte einen bedeutenden Beitrag zur Kopernikanischen Wende vom Mittelalter zur Neuzeit – und damit zur Abendländischen Aufklärung – geleistet. Am 22. Juni 1633 fand sein Inquisitionsprozess statt, und am 2. November 1992 wurde Galilei von der Heiligen Römischen Kirche formal rehabilitiert – also: Liebet Eure Feinde!

Ein Endlosbeispiel für die Auseinandersetzung über Modelle ist der Dissens zwischen meinem hemisphärischen Konvektionsmodell und der selbst von Klimarealisten verteidigten IPCC- Sage vom sogenannten „natürlichen atmosphärischen THE“. Beide konkurrierenden physikalischen Modelle nehmen in Anspruch, die terrestrische Temperaturgenese abzubilden, also schaunmermal:

Phänomen: Die Sonne als Zentralgestirn des Sonnensystems beleuchtet die ihr zugekehrte Seite der um ihre eigene Achse rotierenden Erde und bestimmt deren Temperatur.

Gesicherte Lehrsätze: Für dieses Phänomen gibt es keinen einzeln umfassenden Lehrsatz. Vielmehr muss man den beschriebenen Prozess in physikalische Einzelschritte aufdröseln, die dann konkreten Lehrsätzen zugeordnet werden können.

Modell: Die lückenlose und widerspruchsfreie Abfolge der beweisbaren physikalischen Einzelschritte vom Phänomen zur Realität ergibt dann ein Modell.

Übereinstimmung mit der Realität: Das jeweilige Modell muss zwingend und nachvollziehbar die konkreten Einzelschritte vom Anfangszustand bis zum Endzustand in der Realität abbilden.

Schauen wir uns also beide konkurrierenden Modelle daraufhin noch einmal genauer an:

Das THE-Paradigma: Der auf der Erde einfallende solare HF-Strahlungsfluss (ΦS) wird mit dem abgestrahlten IR-Strahlungsfluss der Erde (ΦE) gleichgesetzt, also:

Φ(Sonne) = Φ(Erde)

Grundlage für das THE-Paradigma ist ein Flächenverhältnis von 1:4 zwischen den einfallenden Sonnenstrahlen auf einer Kreisfläche mit dem Erdradius und der Kugeloberfläche der Erde. Man benutzt nun dieses Flächenverhältnis tatsächlich, um mittels einer Inversion des Stefan-Boltzmann-Gesetzes aus einem Viertel der Solarkonstanten – abzüglich des Albedoanteils von 30% – eine „natürliche Temperatur“ von minus 18 Grad Celsius für unsere Erde zu berechnen.

WIDERSPRUCH: Die Gleichsetzung der Strahlungsflüsse eines aktiven Sterns und eines hemisphärisch beleuchteten passiven Planeten überspringt als physikalischer Apfel&Birnen-Vergleich die terrestrische Temperaturgenese [solare HF-Strahlung => Materie => terrestrische IR-Strahlung].

Dieses Ergebnis ist aber auch deshalb völlig falsch, weil das zur Berechnung missbrauchte physikalische S-B-Gesetz, und somit auch seine Inversion, auf einer strengen Gleichzeitigkeit von Temperatur und Strahlung basieren. Eine global einheitliche solare Einstrahlungsleistung ist daher eine rein mathematische Chimäre und kann in der physikalischen Realität unserer immer hälftig bestrahlten Erde niemals beobachtet werden. Dabei können Sie anhand des S-B-Gesetzes selbst leicht feststellen, dass bei einer T^4-Funktion allein schon die Mittelwertbildung physikalischer Unfug ist:

Die „globale Durchschnittstemperatur“ von 288 Kelvin entspricht einer Abstrahlung von 390W/m².

Im absoluten Nullpunkt von 0 Kelvin beträgt die Abstrahlung 0 W/m².

Der Durchschnitt zwischen beiden Wertepaaren beträgt 144 Kelvin und 195 W/m².

WIDERSPRUCH: 144 K entspricht 25 W/m² Abstrahlung und 195 W/m² entsprechen 242 K Temperatur. Bei Gerlich und Tscheuschner (2009) heißt es dazu auf Seite 63, Zitat:

“Such a calculation, though standard in global climatology, is plainly wrong. Namely, if one

wants to calculate the average temperature, one has to draw the fourth root first and then

determine the average, …“

Die aus dem THE-Paradigma hergeleitete „natürliche Temperatur“ unserer Erde von minus 18 °C ist 33 Kelvin niedriger als die sogenannte „gemessene globale Durchschnittstemperatur“, für die es allerdings kein physikalisch zwingendes Kochrezept gibt. Jedenfalls wird diese Differenz von 33 Kelvin einem „natürlichen atmosphärischen Treibhauseffekt“ zugeschrieben, der auf der Gleichsetzung der Strahlungsflüsse von Sonne (ΦS ) und Erde (ΦE) beruht, und auf dessen experimentellen Nachweis der allwissende Vatikan der Klimareligion seit mehr als 3 Jahrzehnten verzichtet.

WIDERSPRUCH: Wenn die zum sogenannten „natürlichen atmosphärischen Treibhauseffekt“ führende S-B-Inversion tatsächlich physikalisch korrekt und dieser THE exakt berechenbar wäre, dann könnte man damit die sogenannte „gemessene globale Durchschnittstemperatur“ verifizieren. Bis heute existiert aber lediglich die ominöse global einheitliche Temperaturdifferenz von 33 Kelvin.

Das Treibhaus-Paradigma klammert also ausgerechnet den Einzelschritt der natürlichen Temperaturgenese auf unserer Erde als zentralen Prozess der solaren Einstrahlung aus. Stattdessen verspringt sie sofort zur terrestrischen Abstrahlung, die es ohne die solar induzierte Temperaturgenese gar nicht geben würde. Die Lücke von 33 Kelvin zwischen Model und Realität wird dann durch ein experimentell unbewiesenes Phänomen geschlossen, das auf der mathematischen Verschlimmbesserung eines physikalischen Gesetzes beruht.

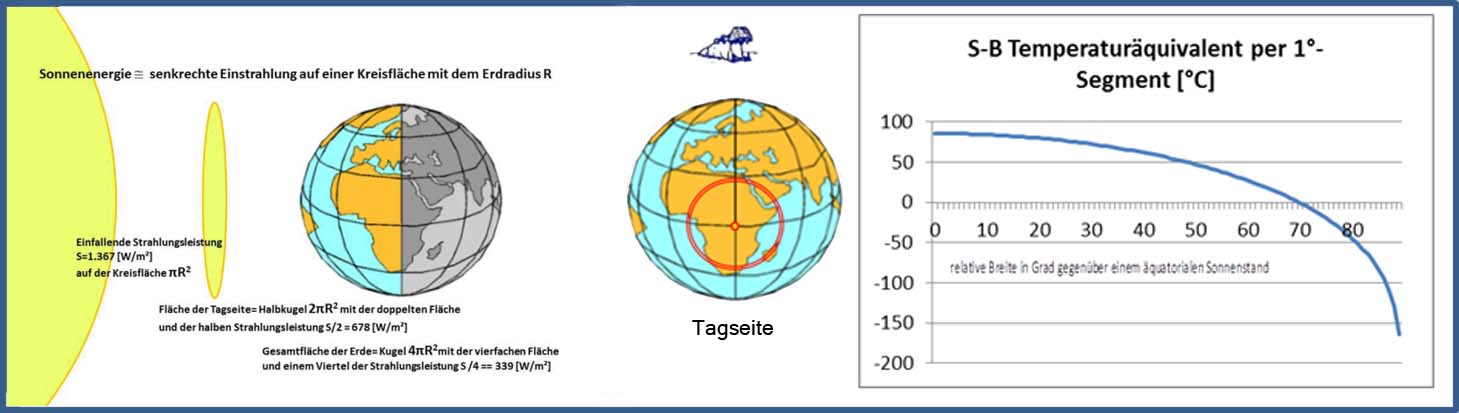

Das hemisphärische: Konvektionsmodell: Die hemisphärische Temperaturberechnung für die Tagseite unserer Erde beruht auf dem S-B-Temperaturäquivalent aus einer ortsgetreuen S-B-Inversion der hemisphärisch eingestrahlten spezifischen Strahlungsleistung der Sonne für konzentrische Kreissegmente um den Subsolarpunkt im Äquinoktium.

Abbildung: Das hemisphärische: Konvektionsmodell

Links: Geometrie der solaren Einstrahlung im Äquinoktium

Mitte: Berechnungsschema für das S-B-Temperaturäquivalent in 1° Segmenten

Rechts: Das S-B-Temperaturäquivalent in Abhängigkeit vom Zenitwinkel der Sonne.

Das flächennormierte Temperaturmittel aus dieser 1-Grad-Approximation beträgt 14,03°C und wird durch eine Verdoppelung der G&T-Integrallösung mit 288 Kelvin (15 °C) bestätigt. Dieses berechnete S-B-Temperaturäquivalent wird jedoch nirgendwo auf der Erde erreicht. Vielmehr finden mit der morgendlichen Erwärmung der Oberfläche sofort auch Verdunstung und Konvektion statt, durch die wesentliche Mengen der örtlich eingestrahlten Energie in die globalen Zirkulationen übergehen und global verfrachtet werden. Und die Nachttemperatur auf unserem Wasserplaneten wird durch die in den Meeren gespeicherte Energie gestützt, deren oberflächennahe Durchschnittstemperatur dauerhaft bei etwa 20 °Celsius liegt. Entgegen dem obigen Rechenschema, das auf 0 Kelvin für die Ausgangstemperatur aufsetzt, unterscheiden sich die Ortstemperaturen im Tagesverlauf üblicherweise nur um einige 10er-Grad.

Im hemisphärischen Konvektionsmodell wird die gesamte tagseitige Sonneneinstrahlung eben nicht zur Aufrechterhaltung der Tagestemperatur benötigt. Vielmehr kann die solare Einstrahlung deshalb auch noch die terrestrische Abstrahlung auf der Nachtseite kompensieren, die vom Wärmeinhalt der Ozeane getragen wird. Damit ist die Konstanz der sogenannten „globalen Durchschnittstemperatur“, die in der Klimakirche ja das Maß aller Dinge ist, im hemisphärischen Konvektionsmodell dauerhaft gewährleistet.

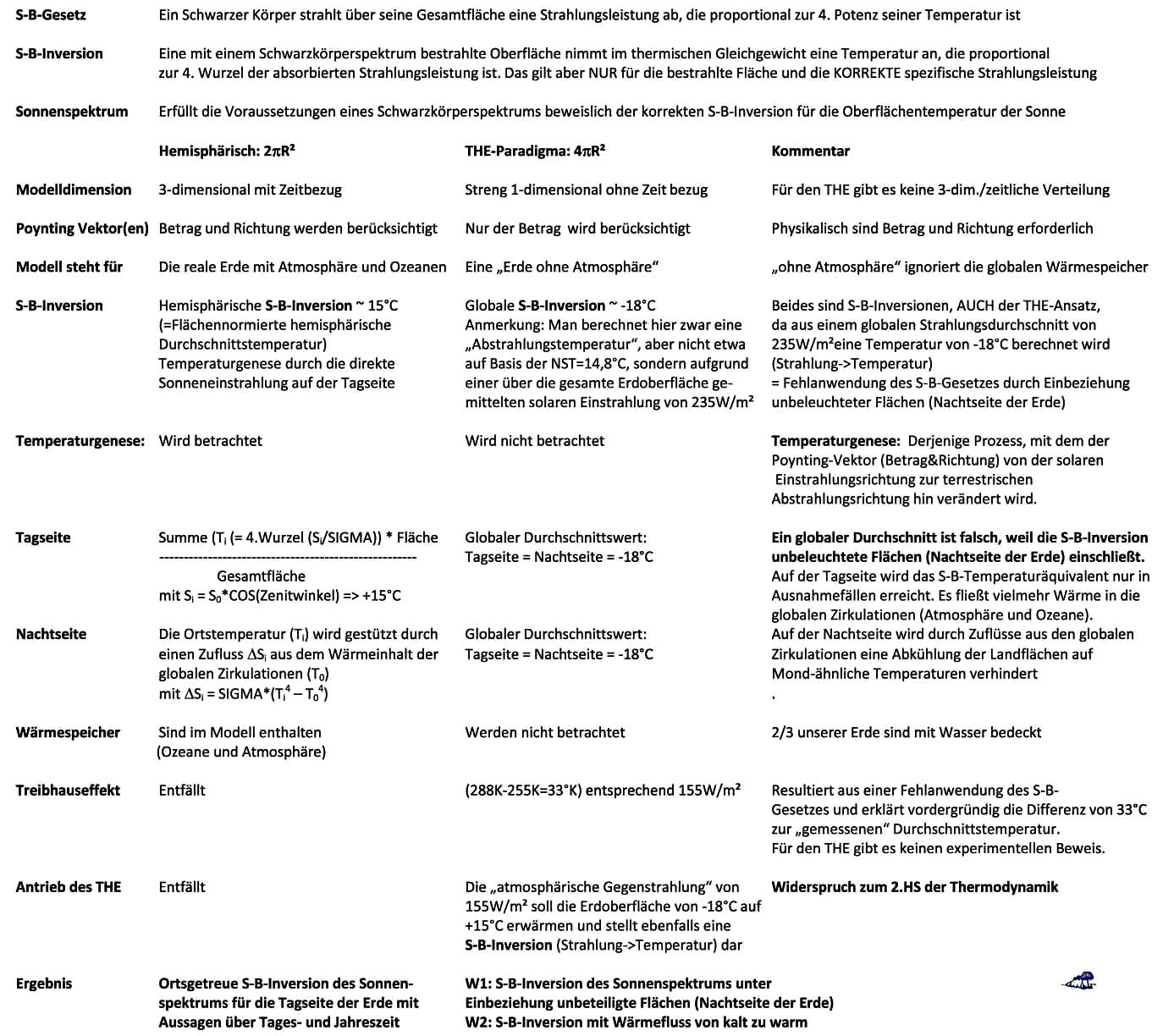

Modellvergleich zwischen dem hemisphärischen Konvektionsmodell und der THE Erzählung:

Postskriptum: Der „natürliche atmosphärische Treibhauseffekt“ ist sozusagen der Heilige Geist der Klimakirche. Denn die globaldämmerungsbeflissene Klimakirche scheitert nicht nur an der Inversion des Stefan-Boltzmann-Gesetzes und meinem hemisphärischen Konvektionsmodell. Es liegt vielmehr eine tiefe Ironie in der Tatsache, dass die CO2-Panik verbreitende Klimakirche mit ihrem globalen Faktor4-Tag=Nacht-Dämmerungsmodell weit hinter die vorschulischen Alltagskenntnisse ihrer antiken Vorgängerorganisation zurückfällt. Denn schon die frühen Autoren der Bibel stützten sich bei ihrer Erzählung ganz konkret auf den Unterschied zwischen Tag und Nacht, Zitat aus dem Buch Genesis 1,3 bis 1,5:

1,3: Gott sprach: Es werde Licht. Und es wurde Licht.

1,4: Gott sah, dass das Licht gut war. Und Gott schied das Licht von der Finsternis.

1,5: Und Gott nannte das Licht Tag und die Finsternis nannte er Nacht. Es wurde Abend und es wurde Morgen: erster Tag.