[*OLR = Outgoing longwave radiation = langwellige Ausstrahlung)

Andy May

Der IPCC und der Klima-„Konsens“ glauben, dass im Wesentlichen die gesamte Erwärmung seit 1750 auf die menschlichen Emissionen von CO₂ und anderen Treibhausgasen zurückzuführen ist, wie in Abbildung 1 hier oder in (IPCC, 2021, S. 961) dargestellt. Dies hat zu einer 45-jährigen Suche nach dem Wert der Gleichgewichts-Klimasensitivität [ECS] für die Verdoppelung von CO₂ („ECS“ in °C pro 2xCO₂) geführt. Nachdem 45 Jahre lang versucht wurde, die Empfindlichkeit des Klimas gegenüber vom Menschen verursachten Treibhausgasen zu berechnen, war der „Konsens“ jedoch nicht in der Lage, die Unsicherheit in seinen Schätzungen zu verringern, und wenn überhaupt, ist die Unsicherheit der Klimamodelle jetzt größer als in früheren Berichten (IPCC, 2021, S. 927). Es ist nun klar, zumindest für mich, dass moderne Klimamodelle viele wesentliche Annahmen treffen, die schlecht gestützt sind und manchmal im Widerspruch zu den Beobachtungen stehen. Dies ist ein Versuch, einige dieser Probleme zu erklären und wie sie sich im Laufe der Zeit entwickelt haben. Es ist längst an der Zeit, dass der „Konsens“ aufhört, die offensichtlichen Schwächen in seinem 60 Jahre alten konzeptionellen Klimamodell zu ignorieren.

Die ersten Modelle

Syukuro Manabe entwickelte in den 1960er Jahren mit mehreren Kollegen das erste allgemeine Zirkulationsklimamodell (Manabe & Bryan, 1969) und (Manabe & Wetherald, 1967). Er begann mit einem eindimensionalen Strahlungsgleichgewichtsmodell der horizontal gemittelten Temperatur, stellte aber fest, dass die Troposphäre aufgrund der Konvektion nicht im Strahlungsgleichgewicht war. Die untere Atmosphäre ist wegen der Treibhausgase für den größten Teil der von der Oberfläche emittierten Infrarotstrahlung oder ausgehenden langwelligen Strahlung (OLR) nahezu undurchlässig. Infolgedessen wird die Erdoberfläche nur wenig durch Strahlung gekühlt, sondern hauptsächlich durch die Verdunstung von Oberflächenwasser, das die Oberflächenwärme als latente Wärme im Wasserdampf in die Atmosphäre trägt. Wasserdampf hat eine geringere Dichte als trockene Luft und steigt daher nach oben. Sobald der Wasserdampf hoch genug ist, kühlt er sich ab, da der Luftdruck in der Umgebung sinkt und sich die Luftpakete ausdehnen können, wodurch der Wasserdampf kondensiert und seine latente Wärme freisetzt. Wenn dies in ausreichender Höhe geschieht, kann ein Teil der latenten Wärme als Strahlung in den Weltraum gelangen oder an die umgebenden Treibhausgasmoleküle weiter oben in der Atmosphäre abgegeben werden. Der Rest der freigesetzten Wärme erwärmt einfach die Umgebung. Dieser Vorgang wird als „feuchtadiabatische Abkühlung“ bezeichnet.

Dieser Prozess funktioniert, weil die Temperatur in der Troposphäre mit der Höhe mehr oder weniger stark abnimmt. Dieser vertikale Gradiernt [„lapse rate“] variiert stark um die Erde herum, aber der durchschnittliche Gradient liegt zwischen 0,6°C/100 m in feuchtgesättigter und 1,0°C/100 m in trockener Atmosphäre. Die Lapse Rate wird in der Regel als positive Zahl angegeben, aber sie ist die Abnahme der Temperatur mit der Höhe.

Der tatsächliche vertikale Temperaturgradient an einem bestimmten Ort und zu einer bestimmten Tageszeit ist sehr unterschiedlich, sie hängt auch von der Luftfeuchtigkeit und der Jahreszeit ab. Die Stornorate kann negativ sein, d. h. die Temperatur nimmt mit der Höhe zu – ein Zustand, der als Temperaturinversion bezeichnet wird.

Bei Manabes frühen Modellen fügte er eine Beschränkung für die Konversionsrate hinzu, so dass sie nicht über einen festen und angenommenen Wert steigen konnte, damit das Modell die Position der Tropopause korrekt vorhersagen konnte. Die Tropopause ist die Höhe der Schicht, an welcher der Temperaturgradient etwa null wird. In der Stratosphäre, der Schicht oberhalb der Tropopause, nähert sich die Atmosphäre dem thermischen Gleichgewicht, und die Temperatur nimmt mit der Höhe zu. In Manabes frühen Modellen wurde der stratosphärische Temperaturgradient als linear und fest angenommen (Held & Soden, 2000).

Manabe ging auch von einer festen relativen Luftfeuchtigkeit und einer festen Wolkenbedeckung aus. Wie Held schreibt, ist die Annahme, wonach sich die Lapse Rate nicht mit der Temperatur ändert, eine zu starke Vereinfachung, aber es war eine bequeme Annahme (Held & Soden, 2000). Die Annahme einer festen relativen Luftfeuchtigkeit führt zu einer unplausibel hohen Empfindlichkeit gegenüber CO₂. In den Tropen folgt der vertikale Temperaturgradient eher einem feuchtadiatatischen Gradienten (siehe oben). Die Kondensation von Wasserdampf in der Höhe ist der Prozess, der Wolken bildet (Held & Soden, 2000). Klimamodelle haben große Schwierigkeiten, das troposphärische Temperaturprofil in den entscheidenden tropischen Regionen zu reproduzieren, da sie eine zu starke Erwärmung aufgrund von Treibhausgasen vorhersagen (IPCC, 2021, S. 443).

In den höheren Breiten funktioniert dieser Ansatz nicht, da der horizontale Transport fühlbarer und latenter Wärme durch Stürme in mittleren und hohen Breiten eine wichtige Rolle für das Gesamtklima spielt (Held & Soden, 2000).

[Dieser Abschnitt ist nicht wörtlich übersetzt, sondern von mir durch eine „synoptische Brille“ ein wenig überarbeitet worden. Es ist nämlich nicht klar, ob der Autor das mit den „adiabatischen vertikalen Temperaturgradienten“ bis zur Tropopause wirklich verstanden hat. Der Begriff „Lapse Rate“ für dieses Phänomen wird im Folgenden aus dem Original übernommen. A. d. Übers.]

Die Annahme eines festen vertikalen Temperaturgradienten

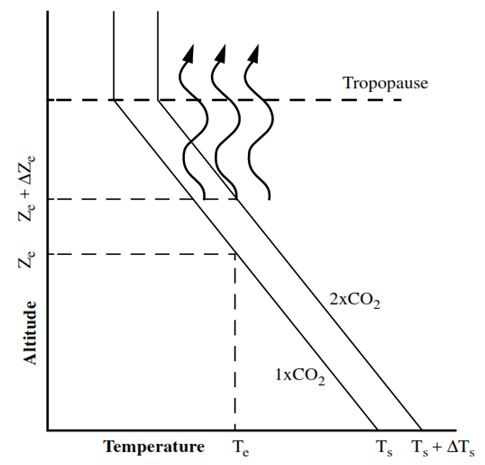

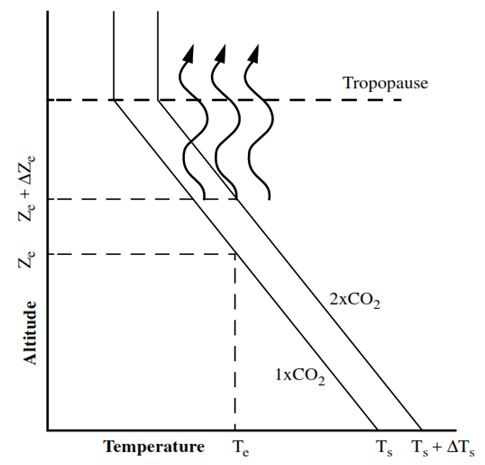

Eine feste Lapse Rate bedeutet, dass sich die globale durchschnittliche Emissionstemperatur nie ändert, so dass sich auch die ausgehende langwellige Strahlung nicht ändert, außer kurzzeitig, wenn sich die Oberflächentemperatur ändert. Eine gängige Beschreibung des Treibhauseffekts (GHE) enthält ein Diagramm der Lapse Rate, das in Abbildung 1 aus (Held & Soden, 2000) dargestellt ist:

Abbildung 1. Das Modell des Treibhauseffekts von Held und Soden. Man beachte, dass sich die effektive Emissionstemperatur nicht ändert, so dass sich auch der Betrag der OLR nicht ändert.

Abbildung 1 veranschaulicht, was eine Verdopplung des CO₂ bei einer festen und linearen Lapse Rate in Helds vereinfachtem Modell bewirkt. Das zusätzliche CO₂ erwärmt die Oberfläche mit zusätzlicher Rückstrahlung, dann tritt die Annahme einer festen Lapse-Rate in Kraft und zwingt das Emissionsniveau auf ein höheres Niveau, was bedeutet, dass es eine niedrigere Temperatur hat, wodurch es weniger in den Weltraum emittiert. Da es weniger Strahlung (auch „Wärme“ genannt) abgibt, erwärmt sich das neue Emissionsniveau nach kurzer Zeit auf die Temperatur des alten Emissionsniveaus und die effektive Emissionstemperatur bleibt unverändert, ebenso wie die OLR (Held & Soden, 2000).

Dieses einfache Modell des GHE hat viele Probleme. Es ist wirklich nur unter perfekten Bedingungen in den Tropen geeignet, und selbst dort unterscheidet sich die nächtliche Lapse-Rate von der Lapse-Rate während des Tages. Darüber hinaus sagt das Modell eine viel zu starke Erwärmung in den Tropen voraus. In den mittleren Breiten, mit anhaltender horizontaler Zirkulation und vielen Stürmen, macht es überhaupt keinen Sinn. In den Polarregionen, vor allem in den langen dunklen Wintern, ist die Atmosphäre häufig wärmer als die Oberfläche, was das Modell völlig ungültig macht. Außerdem nimmt die durchschnittliche globale OLR mit der Erwärmung der Erde zu. Sie bleibt nicht gleich, wie vom Modell vorhergesagt, obwohl sich die gesamte einfallende Sonnenstrahlung nur sehr wenig verändert hat.

Die langwellige Ausstrahlung OLG nimmt zu

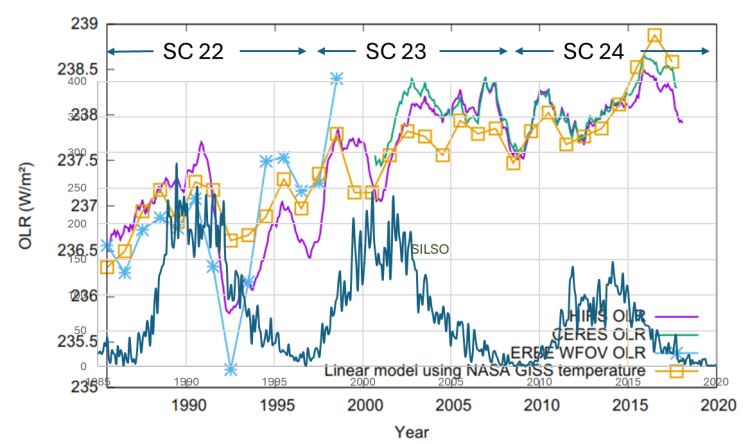

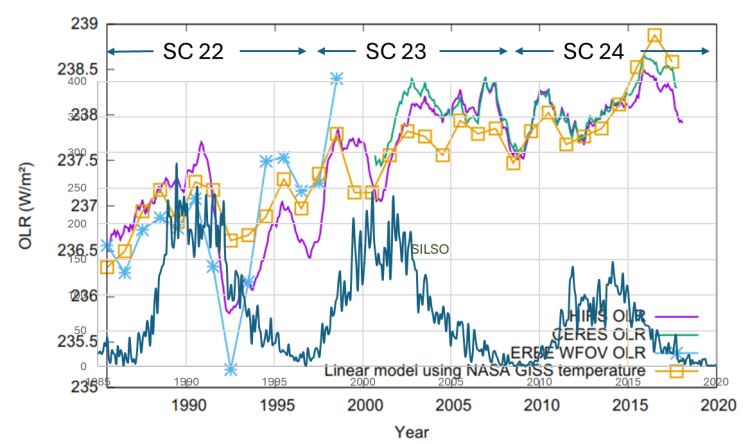

Abbildung 2. Darstellung von HIRS (violette Linie, das hochauflösende Infrarot-Strahlungsmessgerät auf den Satelliten der NOAA und EUMETSAT), CERES (grüne Linie, Instrumente für Wolken und das Strahlungssystem der Erde) und ERBE (hellblaue Linie, Earth Radiation Budget Satellite) OLR am oberen Rand der Atmosphäre. Die globale durchschnittliche Temperatur des GISS ist in gelb dargestellt. Die Sonnenzyklen (SC) während dieses Zeitraums sind ebenso vermerkt wie die SILSO-Sonnenfleckenzahl in Dunkelgrün. Nach (Dewitte & Clerbaux, 2018).

Abbildung 2 deutet darauf hin, dass das Modell von Held und Soden zur Funktionsweise des Treibhauseffekts falsch ist oder dass CO₂ nicht der Grund für die jüngste Erwärmung ist, wie Javier Vinós hier erklärt. Das qualitative Muster der OLR entspricht in der Form jedem Sonnenzyklus. Dies legt nahe, dass die Sonnenzyklen zum OLR-Muster beitragen. Während also der Anstieg von CO₂ die jüngste Erwärmung beeinflussen könnte, tragen die Schwankungen während eines Sonnenzyklus‘ wahrscheinlich ebenfalls dazu bei.

ENSO und die AMO

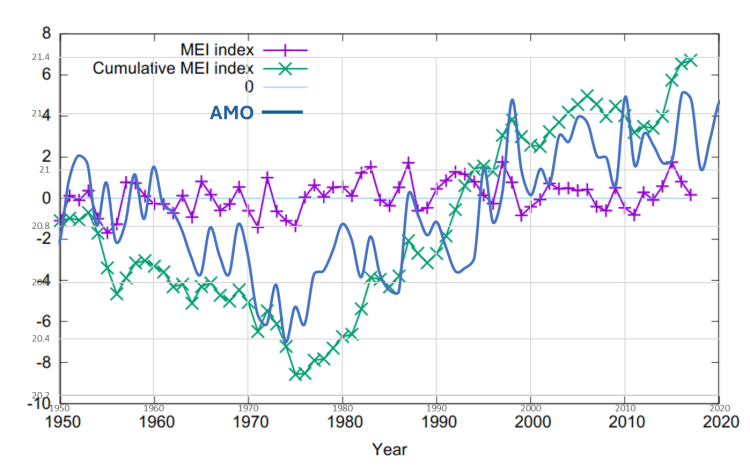

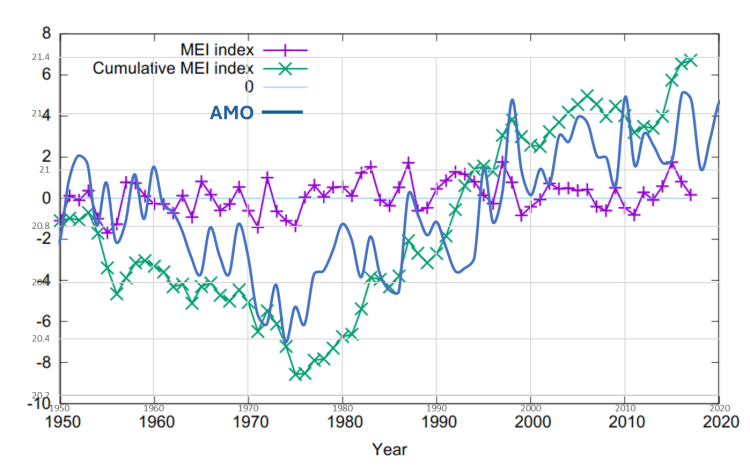

Von 1950 bis 1975 war der kumulative MEI (der Multivariate ENSO-Index) von Dewitte rückläufig, was auf eine Periode starker Las Niñas hindeutet. Von 1975 bis 1998 stieg er, was auf eine Periode starker El Niños hindeutet. Von 1998 bis 2014 war er flach und El Niños und La Niñas waren mehr oder weniger gleich. Dies ist in Abbildung 3 dargestellt:

Abbildung 3. Kumulativer MEI-Index, MEI und AMO. Nach: (Dewitte & Clerbaux, 2018).

Die tiefblaue Linie in Abbildung 3 ohne Markierungen repräsentiert die AMO oder Atlantische Multidekadische Oszillation. Man beachte, dass sie in etwa mit dem kumulativen MEI-Index übereinstimmt. Dies deutet darauf hin, dass die Meerestemperaturen des Nordatlantiks in irgendeiner Weise mit der Häufigkeit von El Ninos und La Ninas zusammenhängen (An, Wu, Zhou, & Liu, 2021), oder beide folgen einem anderen Einfluss wie der Sonnenvariabilität. Wiederum scheint es weniger wahrscheinlich, dass CO₂ der „Klima-Kontrollknopf“ ist (IPCC, 2021, S. 179) [in deutscher Übersetzung hier]

Wolken und ECS

Aus Loeb, et al., 2021:

„Das Klima wird dadurch bestimmt, wie viel Sonnenenergie die Erde absorbiert und wie viel Energie die Erde durch die Emission von thermischer Infrarotstrahlung abgibt. Ihre Summe bestimmt, ob sich die Erde erwärmt oder abkühlt.“

Dies ist eine starke Vereinfachung, da sie die Auswirkungen der ständig variierenden Energieverweilzeit ignoriert. Die Energieverweildauer variiert in Abhängigkeit von den Trends der atmosphärischen und ozeanischen Zirkulation, die wiederum von der Sonnenvariabilität beeinflusst werden (siehe Abbildungen 5.3, 5.4 und 5.5 hier).

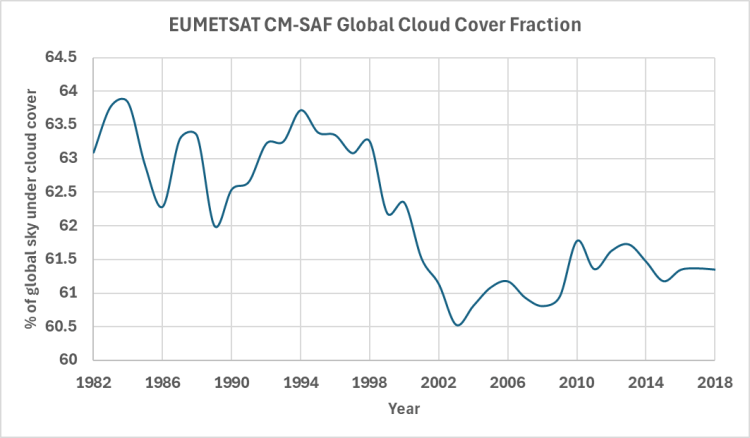

Loeb, 2021 stellt fest, dass die Zunahme der von der Erde absorbierten Energie von 2005 bis 2019 mit einer Abnahme der Wolkenbedeckung einhergeht (siehe Abbildung 4). Die Abnahme der Wolkenbedeckung verringert die Reflexion der einfallenden Sonnenenergie, aber auch die Absorption der von der Oberfläche ausgehenden IR-Strahlung durch Wolken. Dewitte (siehe oben) berichtet von einer Zunahme der ausgehenden langwelligen Strahlung zur gleichen Zeit.

Kauppinen & Malmi (2019) berichten, dass die Bedeckung mit tiefen Wolken abgenommen hat, wie in ihrer Abbildung 2 dargestellt.

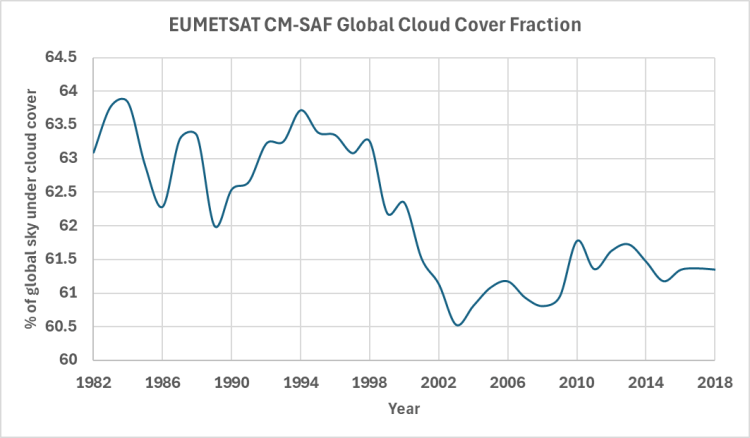

Abbildung 4. Globale Gesamtbewölkung in Prozent des Himmels. Daten von EUMETSAT CM-SAF.

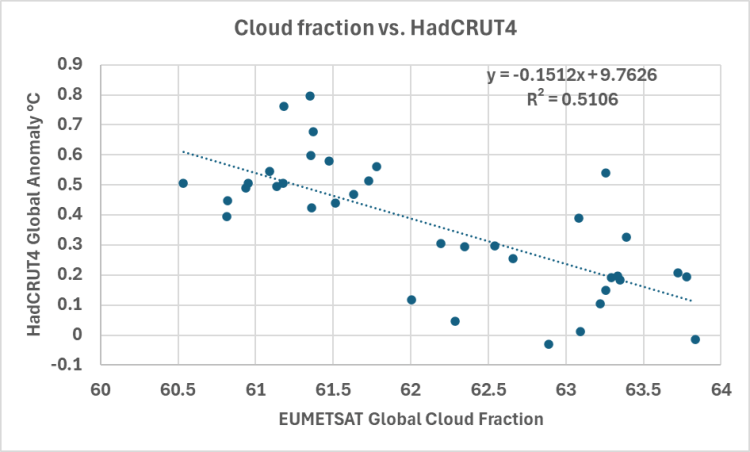

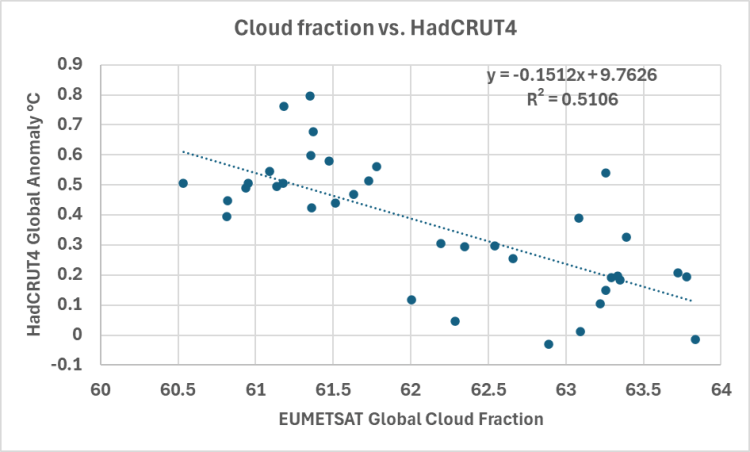

Wie in Kauppinen & Malmi, 2019 erläutert, nehmen tiefe Wolken (wie auch die Gesamtbewölkung) ab mit Beginn der „Pause“ in der globalen Erwärmung um das Jahr 2000 herum. Wenn die niedrige Bewölkung um 1 % zunimmt, sinkt die globale durchschnittliche Temperatur im Durchschnitt um 0,11 °C. Als Funktion des globalen EUMETSAT-Wolkenanteils sinkt die globale HadCRUT4-Temperatur um 0,15°C pro ein Prozent Gesamtbewölkung, wie in Abbildung 5 dargestellt:

Abbildung 5. EUMETSAT-Wolkenbedeckung im Vergleich zur globalen durchschnittlichen HadCRUT4-Temperatur. Daten vom UK Met Office und EUMETSAT CM-SAF.

Die in den Abbildungen 2 bis 5 dargestellten Daten lassen sich nicht als Funktion des monoton ansteigenden atmosphärischen CO₂ und anderer Treibhausgase und ihren so genannten „Wärmeeinfang“- oder „OLR-Verzögerungs“-Fähigkeiten erklären. Obwohl zusätzliche Treibhausgase einen gewissen Einfluss auf den Anstieg der Temperaturen haben könnten, können wir in diesen Daten keinen Hinweis auf diesen Einfluss erkennen.

Ceppi & Nowack (2021) versuchen zu zeigen, dass die Bewölkung auf die Temperatur reagiert, und Abbildung 5 scheint diesen Gedanken zu stützen. Sie und der IPCC sind jedoch der Meinung, dass Veränderungen der Wolkenbedeckung aufgrund einer sich erwärmenden Oberfläche die Erwärmung per Saldo verstärken, d. h. Veränderungen der Wolkenbedeckung aufgrund der Erwärmung sind eine positive Netto-Rückkopplung (IPCC, 2021, S. 95). Sie sind in ihrer Sprache vage und behaupten nicht, dass zunehmende Bewölkung die Erwärmung verstärkt, sondern dass die Nettoveränderung der Wolkenbedeckung aufgrund der Erwärmung eine positive Rückkopplung darstellt. Sie unterteilen also die Wolken in verschiedene Typen, von denen einige eine Nettoerwärmung und andere eine Nettoabkühlung bewirken, wobei die Gesamtveränderung positiv ist.

Die Abbildungen 4 und 5 sowie die Arbeit von Kauppinen & Malmi legen nahe, dass eine Zunahme der Wolken bei Erwärmung der Erde die Erwärmung verringert. Abbildung 2 deutet darauf hin, dass die OLR zunimmt, wenn sich die Welt erwärmt und die Wolkenbedeckung abnimmt, was nicht zu erwarten wäre, wenn Veränderungen der Wolkenbedeckung eine positive Rückkopplung auf die Erwärmung darstellen. Die beiden Ansätze sind jedoch nicht unbedingt unvereinbar, da weder der IPCC noch Ceppi & Nowack sagen, dass eine zunehmende Bewölkung die Erwärmung verstärkt, sondern dass „Veränderungen der Bewölkung“ die Erwärmung insgesamt verstärken. Die Zeit wird zeigen, ob ihre komplexe Hypothese richtig ist.

Ceppi & Nowack gehen ausdrücklich davon aus, dass Treibhausgase die globale Erwärmung gemäß dem RCP4.5-Szenario verursachen. Sie berücksichtigen nicht die Möglichkeit, dass Schwankungen der Sonnenaktivität (Abbildung 2) oder Ozeanschwankungen (wie die in Abbildung 3 dargestellte AMO) einen Einfluss haben. Loeb, 2021 diskutiert zwar Veränderungen der PDO, aber nicht als treibende Kraft des Klimawandels, sondern nur als eine Art interner natürlicher Variabilität.

Wie Ceppi & Nowak berichten, korreliert die ECS sehr gut mit der Wolkenbedeckung, siehe Abbildung 2 hier. Es stimmt auch, dass die Wolkenbedeckung die unsicherste Rückkopplung in Treibhausgas-Klimamodellen ist, und Klimamodellierer haben berichtet, dass sie mit ihren Wolkenparametern herumgespielt haben (Koonin, 2021, S. 93), um eine vorher festgelegte ECS zu erreichen. Es schmälert unser Vertrauen in Klimamodelle, wenn die unsicherste und am schlechtesten verstandene Komponente (Wolken) verwendet wird, um ein gewünschtes Ergebnis zu erzielen. Wie die AR6 WGI auf Seite 927 berichtet, wird die von den Klimamodellen berechnete ECS immer unsicherer, was damit begründet wird, dass die Modellierer immer mehr an ihren Wolkenparametern herumbasteln, um zu versuchen, die Wolkenbeobachtungen abzugleichen. Irgendetwas stimmt mit den modernen Klimamodellen eindeutig nicht, und das Problem wird mit der Zeit immer größer.

EEI (Earth Energy Imbalance [Energie-Ungleichgewicht der Erde])

Die Nettostrahlung nach innen oder außen ist das Energiegleichgewicht der Erde (EEI). Wenn sie positiv ist, erwärmt sich die Erde und sammelt Wärme, wenn sie negativ ist, kühlt sie sich ab. Da die meiste an der Erdoberfläche absorbierte Sonnenenergie in den Ozeanen gespeichert wird (~90 %), ist der Wärmeinhalt der Ozeane ein empfindlicher Indikator für das langfristige EEI und kann als Prüf- und Kalibrierungspunkt für Satelliten-Strahlungsmessungen verwendet werden, die allein nicht genau genug sind, um das EEI direkt zu messen (Loeb, et al., 2022).

Tabelle 1 in (Loeb, et al., 2022) listet die absorbierte Sonnenstrahlung (ASR), die ausgehende langwellige Strahlung (OLR) und die Nettostrahlung nach innen (positiv) und nach außen (negativ) für verschiedene Analysen von Satelliteninstrumenten auf. Die Trends variieren von 0,026 bis 0,42 W/m²/Dekade ±~0,24. Dies ist ein ziemlich großer und unsicherer Unterschied. Die Zahlen sind positiv, da sich die Welt erwärmt.

Das tatsächliche EEI und der Trend des EEI sind nicht bekannt, aber Schätzungen des Wärmeinhalts des Ozeans von 2005 bis 2019 deuten darauf hin, dass er gering ist und zwischen 0,24 und 0,98 (±~0,7) W/m²/Dekade liegt, wie Tabelle 4 in (Loeb, et al., 2022) zeigt. ARGO hat unser Wissen über die Temperatur des Ozeans bis zu einer Tiefe von 2000 Metern erheblich erweitert, aber die Trends der Temperatur unterhalb von 2000 Metern und unter dem Meereis sind noch weitgehend unbekannt. Es scheint sicher zu sein, dass der Trend seit dem Jahr 2000 irgendwo zwischen ~-0,7 und ~1,5 W/m²/Dekade liegt und eher positiv als negativ ist, weil sich die Erde erwärmt, aber darüber hinaus ist es schwer zu sagen. Die gesamte eingehende Sonnenstrahlung und die gesamte ausgehende langwellige Strahlung sind große Zahlen mit großer Unsicherheit, und der Unterschied zwischen den beiden ist sehr gering und liegt unterhalb der Genauigkeit der derzeitigen Messungen.

Die Veränderung des Wärmeinhalts der Ozeane ist eine nützliche Kontrolle, aber wir haben keinen guten Überblick über die Temperaturen der Ozeane, weder in der Luft noch in der Tiefe. ARGO verbessert die Situation, aber die Abdeckung ist immer noch schlecht. Bei der Messung der ein- und ausgehenden Strahlung gibt es Probleme im östlichen Pazifik, in der Arktis und in vielen anderen Gebieten. Für eine vollständige Diskussion der Probleme bei der Schätzung des EEI-Trends wird der interessierte Leser auf Loeb, et al., 2022 verwiesen.

Schlussfolgerungen

Wie ich schon früher geschrieben habe, sind die aktuellen IPCC/CMIP-Klimamodelle nicht gut mit den Beobachtungen vergleichbar, und leider schneiden sie in den Tropen besser ab, wenn der vom Menschen verursachte Teil des verstärkten Treibhauseffekts herausgerechnet wird. Es scheint, dass das seit 1990 (dem ersten IPCC-Bericht) verfolgte konzeptionelle Modell fehlerhaft ist, wonach CO₂ der „Kontrollknopf“ für die globale Erwärmung ist. Es gibt zahlreiche Belege dafür, dass das Klima von vielen Faktoren beeinflusst wird, und das vom Menschen verursachte CO₂ ist nur einer davon, und dieser ist möglicherweise nicht so bedeutend. Es ist längst an der Zeit, dass das IPCC aufhört, die These vom menschengemachten Klimawandel voranzutreiben, und zurück ans Zeichenbrett geht, um ein neues konzeptionelles Modell zu entwickeln, das mit den in diesem Beitrag vorgestellten Daten Sinn macht.

Download the bibliography here.

Link: https://andymaypetrophysicist.com/2024/12/17/climate-models-clouds-olr-and-ecs/

Übersetzt von Christian Freuer für das EIKE