„Nachsteuern reicht nicht, zum Umsteuern fehlt der Mut“

Einführung von Christian Freuer: In diesem Beitrag geht es um das neueste Urteil des Bundesrechnungshofes (BRH) zur Energiewende. Diese stehen hier. Der Dipl.-Phys. Peter Würdig hat sich darauf an den BRH gewandt und tatsächlich auch eine Antwort erhalten. Dieser Austausch wird hier dokumentiert. Oben steht der Brief von Herrn Würdig, gefolgt vom PDF der Antwort des BRH. Dann folgt noch ein Kommentar von Herrn Würdig. – Ende Einführung.

Der Bericht des Bundesrechnungshofes „zur Umsetzung der Energiewende im Hinblick auf die Versorgungssicherheit und Bezahlbarkeit bei Elektrizität“ …

… und mein Bericht dazu.

Peter Würdig

Tatsächlich muss ich, bei mancher Kritik, dem Bundesrechnungshof (BRH) auch einiges an Lob aussprechen, denn immerhin einiges von Mängeln ist erkannt worden und auch klar ausgesprochen, wenn man auch feststellen muss, dass die grundsätzlichen und nicht behebbaren Fehler der Energiewende nicht angesprochen werden.

Beginnen wir mit den positiven Seiten.

Sehr zu loben ist, dass der Bundesrechnungshof jetzt das Vorhaben der Regierung kritisiert, Teile der Kosten der Energiewende durch den Bundeshaushalt zu finanzieren, um dadurch den Bürgern niedrigere Kosten vorzutäuschen als sie tatsächlich sind. Das ist so gut gesagt, dass ich das hier im Original zitieren will:

„Die geplante Entlastung der EEG-Umlage aus den Einnahmen des Zertifikatehandels und aus Haushaltsmitteln sieht der Bundesrechnungshof kritisch. Er sieht darin eine zusätzliche Belastung aller Steuerzahler. Damit können die Auswirkungen des nicht funktionierenden Preissystems aber lediglich kaschiert werden. Die Bundesregierung bekämpft also lediglich Symptome der derzeitigen Schwächen des Energiepreissystems und schafft weitere Nachteile.“

Der Bundesrechnungshof sagt ganz zu Recht, dass damit nur eine Entlastung vorgetäuscht wird, denn die Mittel sind letztlich eben doch von den „Letztverbrauchern“ aufzubringen (und auch von den „Letztverbraucherinnen“, loben muss man auch hier, dass der BRH auf die jetzt in Mode gekommene Sprachverdopplung verzichtet). Außerdem weist der Bundesrechnungshof an dieser Stelle auch darauf hin, und auch das ist richtig, dass durch eine „künstliche“ Verbilligung der Anreiz konterkariert wird, Energie sparsam einzusetzen.

Auch an einer weiteren Stelle muss ich loben, denn der Bundesrechnungshof weist klar darauf hin, „…..Der Trend der weiter steigenden Strompreise muss durchbrochen werden, um die Wettbewerbsfähigkeit des Wirtschaftsstandortes Deutschland zu sichern…“ Auch an einer anderen Stelle sagt der BRH „Damit soll es (das BWMi( auch einen Beitrag leisten, um die nachhaltige Wettbewerbsfähigkeit deutscher Unternehmen im internationalen Wettbewerb zu sichern.“ In dieser Hinsicht wirklich etwas zu tun wäre eine politische Entscheidung, dafür fehlt aber im Moment der politische Wille total. Das wurde jetzt ganz deutlich bei der Anhörung im Bundestags-Ausschuss „Wirtschaft und Energie“ klar, alle politischen Fraktionen (ausgenommen natürlich die AfD) schoben ihre Lobbys vor, damit diese jeweils ein möglichst großes Stück vom EEG-Kuchen einfordern durften, was dann natürlich den Preis insgesamt nur in die Höhe treibt. Die Fragen, ob das Sinn macht und ob man das verantworten kann, diese Fragen wurden gar nicht erst gestellt.

Die stärkste Kritik am Bericht des BRH muss ich deswegen üben, weil der BRH nicht ein klar durchgerechnetes Programm für die Energiewende fordert, ohne ein solches Programm hätte man die erste Windmühle nicht aufstellen dürfen. Wir wissen nach 20 Jahren EEG nicht, was es am Ende kosten soll und was man damit konkret denn erreichen will. Stattdessen setzt man sich „Ziele“ und werkelt munter drauf los (und gibt das Geld der Letztverbraucher mit vollen Händen aus), ein solcher Vorgang ist im hohen Maße verantwortungslos.

Zur Versorgungssicherheit sagt der BRH „Durch den Kohleausstieg entsteht eine Lücke von bis zu 4,5 Gigawatt gesicherter Leistung, die das BMWi noch nicht bei der Bewertung der Versorgungssicherheit berücksichtigt hat.“ Diese Zahl entstammt der Betrachtung von Planungsvorgaben, sie hat jedoch mit der Realität im Strom-System nichts zu tun, insbesondere macht es keinen Sinn, hier nur den Kohleausstieg im Auge zu haben während gleichzeitig bzw. schon vorher auch der Ausstieg aus der Versorgung durch Kernenergie durchgeführt wird, mit dem ja auch schon ein großer Teil der gesicherten Leistung wegfällt.

Die tatsächlichen Zahlen erhält man leicht aus dem Agora-Meter, und dieses mal für einen so typischen Tag, wie er in jedem Jahr auftreten kann, nämlich am 25.Januar 2019 um 24 Uhr:

Energieverbrauch (elektrisch) : 67,3 GW

Wind on-shore: 0,4 GW

Wind off-shore: 0,0 GW,

Solar: 0,0 GW

Wasser 2,5 GW

Bio-Energie 5,3 GW

Die gesamten „Erneuerbaren“ brachten also eine Leistung auf von 8,2 GW, der Fehlbedarf betrug also 59,1 GW. Um diesen Fehlbedarf allein durch Windkraft auszugleichen (was ja in der Diskussion ist), hätte man die Windkraft um den Faktor 148 verstärken müssen, das allein zeigt schon den ganzen Irrsinn einer Energiewende, die sich allein auf die sog. „Erneuerbaren“ stützen will. (Diagramm „Jan 2019.jpg“).

Für die Entwicklung des Strompreises führt der BRH zunächst ganz richtig aus:

„Es gibt viele Faktoren, die sich teils erheblich auf das Preisniveau von Strom auswirken. Dazu gehören insbesondere der weitere Ausbau erneuerbarer Energien, die Leistungsfähigkeit des Stromnetzes, die CO2-Bepreisung und das derzeitige System von Entgelten, Steuern, Abgaben und Umlagen.“ Der BRH deutet hier zumindest an, dass einer der Faktoren der „weitere Ausbau erneuerbarer Energien“ ist, das hätte man deutlicher ausdrücken können, und man hätte dann auch ausführen müssen, dass der „weitere Ausbau erneuerbarer Energien“ zu stoppen ist, da er zu nichts führt als zu einem weiteren Anstieg des Preisniveaus..

Hierzu habe ich mal ein Beispiel näher untersucht, an dem man den Einfluss des weiteren Ausbaues der erneuerbaren Energien auf die Gestaltung des Preisniveaus erkennen kann. Dazu schauen wir jetzt erst einmal auf das Diagramm „Feb 2020.jpg“, in dem man, vom Agora-Meter übernommen, die Tage vom 21. bis zum 25. Februar 2020 erkennen kann. Dazu habe ich zunächst einen von Hand einen „Bereich A“ grün markiert. Eine vergrößerte Version dieses Bereiches findet man im Diagramm „22 Feb 2020.jpg“, es geht um die Stunden von 11 Uhr bis 13 Uhr dieses Tages. Wenn man bedenkt, dass im Netz der Energie-Zufluss innerhalb von Millisekunden gesteuert werden muss, um die Frequenz innerhalb des zulässigen Intervalls von 0,2 Hz konstant zu halten, dann sind 2 Stunden eine sehr lange Zeit. Man erkennt zu diesem Zeitpunkt, dass zwischen der höchsten eingespeisten Leistung der sog. „Erneuerbaren“, das ist der höchste Punkt im gelben Bereich (Solar) und dem tatsächlichen Verbrauch in diesem Zeitraum, der durch die rote Linie markiert ist, nur noch eine Differenz von 1 GW oder weniger besteht. Die von den konventionellen Kraftwerken geliefert Leistung (grau) ragt erheblich (ca. 15 GW) über den im Netz angeforderten Bereich hinaus. Das bedeutet, dass zu diesem Zeitraum elektrische Leistung im Ausland entsorgt werden muss, was üblicherweise zu negativen Preisen führt. Diese negativen Preise bezahlt der Letztverbraucher über die Regelung im EEG, und das führt zu einem erheblichen Anstieg des Preisniveaus. Diese Situation ist dem Umstand geschuldet, dass die konventionellen Kraftwerke nur eine begrenzte Regelfähigkeit haben, da sie ja in jedem Moment auch bereit sein müssen, ihre Höchstwert einzuspeisen um einen Blackout zu vermeiden. Die konventionellen Kraftwerke können die starke (und unplanbare) Fluktuation der sog. „Erneuerbaren“ nicht soweit ausgleichen, dass sie ihre Leistung bis auf nahezu null zurückfahren.

Das ist schon eine unangenehme Situation. Weit entscheidender ist aber etwas anderes, jeder weitere Ausbau von sog. „erneuerbaren Energien“ führt dazu, dass diese gerade in diesem Moment auch ihren höchsten Beitrag liefern, mit der Folge, dass dann der Energiefluss, der im Ausland verklappt werden muss, einerseits zwar nicht zu mehr „Klimaschutz“ führt, falls man überhaupt im Klimaschutz einen Sinn sieht, für den es einen wissenschaftlichen Nachweis nicht gibt, und andererseits zu einer noch weiteren Steigerung des Preisniveaus führt.

Eine nahezu entgegengesetzte Situation findet man zwei Tage später, im Bereich „B“, vergrößert dargestellt im Diagramm „24 Feb 2021.jpg“. Die solare Einspeisung früh am Morgen ist fast null, und die Einspeisung von Wind nimmt gerade rapide ab. Die konventionellen Anlagen können den Bedarf nun nicht mehr vollständig ausgleichen, und dieser Fehlbedarf muss durch Lieferung vom Ausland ausgeglichen werden. Der Blackout kann nur noch vermieden werden, falls das Ausland überhaupt liefern kann und liefern will (bei einer Mangelsituation im europäischen Bereich ist jeder sich selbst der nächste), und andererseits müssen nun erhebliche Überpreise bezahlt werden, in der Spitze wurde dazu schon der 340-fache Preis des Normalen bezahlt. Auch das wiederum führt zu einer spürbaren Steigerung des Preisniveaus.

Der weitere Ausbau der sog. „erneuerbaren Energien“ hilft hier nicht, im Gegenteil, denn einerseits haben diese Energien jetzt auch ihr Liefer-Minimum und tragen kaum etwas bei, und anderseits werden durch den weiteren Ausbau die konventionellen Energien zurückgedrängt (sie verlieren an Wirtschaftlichkeit), was ja das offizielle politische Ziel ist, und das heißt, die Lücken im Versorgungssystem werden immer größer, und der Zwang, die Nachbarn im Lieferung anzubetteln, zu welchem Preis auch immer, steigt weiterhin. Kurz gesagt, der weitere Ausbau der sog. „erneuerbaren Energien“ steigert unweigerlich die Diskrepanz im Versorgungssystem.

Der einzige Ausweg aus dieser Kalamität wäre, Speicher aufzubauen, die den Strom aufnehmen, der zur falschen Zeit geliefert wird, damit man dann, wenn Unterdeckung da ist, ausgleichen kann. Leider kann man dazu nur im Konjunktiv „wäre“ sagen, denn brauchbare Speicher in der Größenordnung, wie sie benötigt würden, sind noch nicht einmal im Ansatz erkennbar (und werden zur Zeit auch nicht in nennenswertem Maße aufgebaut).

Der BRH äußert sich dazu u.a. so:

Wie hoch die benötigten Speicherkapazitäten sind und inwieweit diese zur Verfügung stehen oder zukünftig verfügbar sein werden, lässt das BMWi offen.

Diese Feststellung ist zwar einerseits richtig, aber der BRH müsste eigentlich wissen, dass es für diese Speicher in absehbarer Zeit keine Möglichkeit gibt, denn nach immerhin 20 Jahren des EEG hat man da nahezu nicht das Geringste unternommen.

Der BRH äußert sich dazu auch so:

„Außerdem muss es (das BMWi) ein „Worst-Case“-Szenario untersuchen, …“

Diese Forderung ist richtig, aber der BRH geht an keiner Stelle darauf ein, dass man immerhin ein „Best-Case-Szenario“ untersucht hat, eigentlich in drei Fällen, auf drei verschiedenen Inseln in drei verschiedenen Ländern, und da war dann die deutsche Insel Pellworm mit der „Smart Region Pellworm“ dabei. Für diesen Versuch sind immerhin Forschungsgelder in Höhe von 12 Millionen ausgegeben worden, um nachzuweisen, dass man auf dieser Insel die „Strom-Wende“ erreicht (von Energiewende ist man davon noch weit entfernt). Nach zwei Jahren, als die Fördermillionen verbraucht waren, hat man alle Anlagen wieder abgebaut, auf der Fläche der ehemaligen Speichereinheiten befindet sich jetzt ein Hundespielplatz. Der Ablauf dieser Verfahren ist fast immer derselbe, bei der feierlichen Eröffnung ist politische Prominenz dabei und verspricht den grandiosen Einstieg in die schöne neue Öko-Welt, in diesem Falle war es der damalige Ministerpräsident Thorsten Albig. Und wenn dann sang- und klanglos alles wieder abgebaut ist, dann wollen die beteiligten Firmen nichts mit dem Experiment zu tun gehabt haben. Immerhin, da öffentliche Gelder mit im Spiel waren, hätte man wenigstens einen Abschlussbericht anfordern müssen, das hat nach meiner Kenntnis der BRH bisher unterlassen. Der Versuch in Pellworm ist insofern vom „Worst-Case“-Szenario weit entfernt, als die Bevölkerungsdichte etwa 100 mal kleiner ist als in einer Großstadt wie in Berlin. Wenn unter diesen so günstigsten Umständen schon die Strom-Wende scheitert, dann hätte der BRH die notwendige Schlussfolgerung erheben müssen, nämlich das Experiment Energiewende endgültig zu beenden und für die dazu im Lande aufgestellten Anlagen eine Rückrufaktion durchzuführen. Dazu konnte sich der BRH nicht entschließen, dass muss man kritisieren.

Es gab zu den Versuchen mit der Speicherung noch zwei weitere Versuche, nämlich auf der norwegischen Insel Utsira (unter Leitung der deutschen Firma Enercon) und auf der spanischen Insel El Hierro, auch diese Versuche sind gescheitert. In Utsira, wo man das mit Wasserstoff versucht hat, sind alle Anlagen abgebaut worden. In El Hierro gibt es den Speichersee noch (also ein Pumpspeicherkraftwerk), aber die Anlage ist viel zu klein, und die Insel muss nach wie vor mit Strom auf der Basis von mit Schiffen herangeschafftem Diesel versorgt werden. Zu diesen Versuchen habe ich einen Film gestaltet, der trägt den Titel „Drei Inseln / drei Pleiten“. Bei Interesse kann der BRH eine Kopie anfordern, kostenlos..

Zum Abschluss kann man sagen, dass der BRH immerhin aussagt:

„Der Bundesrechnungshof bekräftigt deshalb seine Auffassung, dass es nicht vorrangig Ziel sein kann, die Energiewende „um jeden Preis“ umzusetzen.“

Das ist ja schon etwas, aber der BRH hätte erkennen können und müssen, dass es eben überhaupt keinen Preis gibt, unter dem man die Energiewende gestalten kann, und dann hätte man dieses Experiment endgültig absagen müssen.

Die Antwort des BRH steht hier in diesem PDF. Herr Würdig schreibt dazu:

Bundesrechnungshof

Postfach 12 05 03

53048 Bonn

auch per eMail: poststelle@brh.bund.de

Ihr Zeichen: II 1 – 05 20 35

Sehr geehrte Damen und Herren,

sehr geehrte Frau Peters,

anlässlich des neuen Berichts „Energiewende nicht auf Kurs: Nachsteuern dringend erforderlich“ komme ich auf mein Schreiben vom 17. April 2021 zurück und darf mich auch bedanken, dass Sie damals ausführlich geantwortet haben.

Es ist ja schon einmal anzuerkennen, dass Sie erneut auf Mängel in der Arbeit des Ministeriums hinweisen und auch deutlich aussagen: „Nachsteuern dringend erforderlich“, aber die Kritik, die ich damals schon geäußert habe, nämlich „wenn man auch feststellen muss, dass die grundsätzlichen und nicht behebbaren Fehler der Energiewende nicht angesprochen werden.“, wohl weiterhin bestehen bleibt.

Sie schrieben in Ihrem Brief damals schon ganz zu Recht:

„Das BMWi hatte keinen Überblick über die finanziellen Auswirkungen der Energiewende.

Das BMWi berücksichtigte die Ziele Versorgungssicherheit, Bezahlbarkeit und Umweltver#träglichkeit nicht gleichrangig.“,

und man muss heute, nach drei Jahren, leider sagen, die Situation und das Verfahren haben sich nicht wirklich geändert.

Auch damals schrieben Sie ganz zu Recht:

„Der Trend der weiter steigenden Strompreise muss durchbrochen werden, um die Wettbewerbsfähigkeit des Wirtschaftsstandortes Deutschland zu sichern…“,

auch an diese Warnung hat sich das Ministerium (und die weiteren Organe der Regierung) nicht gehalten, und auch Warnungen von vielen anderen Seiten (Beispiel: Peter Adrian: „Es drohen Wohlstandsverluste in unvorstellbarem Ausmaß“) wurden praktisch nicht zur Kenntnis genommen. Die Abwanderung wichtiger Teile de deutschen Industrie ist in vollem Gange, man nimmt das achselzuckend zur Kenntnis, und die entscheidenden Funktionsträger sind überwiegend geprägt von ideologischen Vorstellungen und meinen, dass man grundlegende Gesetze der Naturwissenschaften und insbesondere der Physik nicht berücksichtigen muss. Man ist nicht bereit, einzugestehen, dass im Bereich der Energiepolitik (und nicht nur dort) schwerwiegende Fehler gemacht worden sind, die immense Schäden für die Volkswirtschaft zur Folge haben.

Und nun hat man auf Grund von wissenschaftlichen Studien festgestellt, nachts ist es dunkel, und das kann man politisch nicht ändern, und wenn dann auch kein Wind weht, dann ist es nichts mit den sog. „Erneuerbaren“. Der tatsächlich vorgesehene Ausweg, es sollen PV-Felder in Deutsch-Südwest (das heißt jetzt Namibia) angelegt werden, mit dem Strom macht man Wasserstoff, und der wird dann direkt (oder über Umwandlungen) nach Deutschland geschippert. Da auch nur im Ansatz die Kosten auszurechnen weigert man sich permanent, darauf hat schon Prof. Sinn mit seinen Vorträgen hingewiesen mit der Frage „Haben die denn keinen Taschenrechner ?“. Es gibt nur ein Land auf der Welt, das gleichzeitig aus „Kohle“ (fossile Energien) und „Atom“ (Kernenergie) aussteigt, das ist Deutschland, die Folge ist, dass sich der Preis für Energie um den Faktor fünf bis zehn erhöht (kann auch mehr als zehn werden, wir wissen ja nicht, was der Wasserstoff aus Namibia kosten wird). Diese Entwicklung, von der im Moment auch nicht der Ansatz eines Umsteuern zu erkennen ist, wird den Wirtschaftsstandort Deutschland gründlich ruinieren mit der Folge auch von sozialen Unruhen.

Ich sehe in dieser Frage eigentlich nur zwei Auswege.

A) Klimahysterie aufgeben.

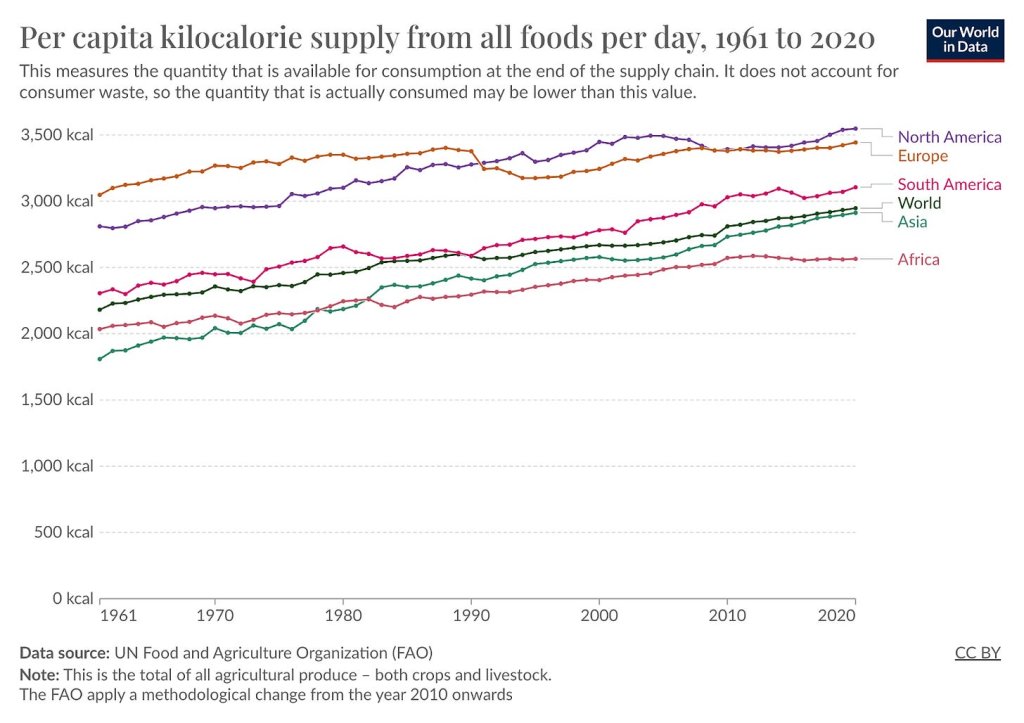

Dazu muss man dem Volk die Wahrheit sagen, CO2 ist kein Schadstoff sondern wegen der Fotosynthese die Voraussetzung für das Leben auf der Erde (eigentlich auch Unterrichtsstoff in der Schule). Die optimale Konzentration von CO2 haben wir noch lange nicht erreicht, deshalb hat eine weitere Steigerung überwiegend positive Wirkungen (die Erde „ergrünt“, die Welternährung wird unterstützt). Das bedeutet, Ausstieg aus dem Kohle-Ausstieg, Beendigung der ökosozialistischen Planwirtschaft und energie-offener Wettbewerb mit sozialer Marktwirtschaft. CO2-Steuern beenden, stattdessen über Prämien nachdenken. Mit Braunkohle allein haben wir in Deutschland einen sicheren Vorrat für die Versorgung mit Energie für etwa 300 Jahre, in diesem Zeitraum wird man voraussichtlich auch die Kernfusion marktfähig machen können.

B) Klimahysterie nicht aufgeben

Man muss berücksichtigen, dass viele Menschen im Lande die einmal erlernte Hysterie nicht aufgeben wollen, obwohl es bis heute nicht einen einzigen Nachweis gibt, das vermehrter Anteil von CO2 zu schlechterem Wetter führt (die Grundlagen der Physik sprechen klar dagegen). Dann muss man sich klarmachen, dass ein weiterer Ausbau der sog. „Erneuerbaren“ hoffnungslos ist und nur eine weitere Preissteigerung für Energie zur Folge hat. Der Grund ist sehr einfach, die neu errichteten Anlagen (für Wind und Sonne) haben denselben Fehler wie die schon bestehenden, sie liefern den Strom zur falschen Zeit. Da es Speicher ausreichender Kapazität nicht gibt (und eine Entwicklung auch im Ansatz nicht zu erkennen ist), führt das dazu, dass zu manchen Zeiten Strom im Überfluss produziert wird, den kann keiner gebrauchen, und dieser Weg-werf-Strom wird auch noch mit hohen Kosten den Betreibern der Anlagen vergütet, während die Lücken zu anderen Zeiten bleiben, die sollen ja dann mit Wasserstoff aus Namibia gefüllt werden.

Der entscheidende Zustand ist schon vor einiger Zeit erreicht worden, als die „Erneuerbaren“ in der Spitze etwa 80% des elektrischen Bedarfes erreicht haben, denn die konventionellen Anlagen können nicht auf Null zurückgefahren werden (und sie können auch nicht rückwärts laufen, um überflüssigen Strom wieder in Kohle oder Uran zu verwandeln). Die konventionellen Anlagen müssen ja stets bereit sein, auch den vollen Bedarf sofort zu liefern, sonst käme ein Black-out.

Man muss sich klar machen, wir haben über 20 Jahre die „Erneuerbaren“ mit massiven Beträgen subventioniert, es sollte ja eine Anschub-Subventionierung sein, so wurde uns das versprochen, allerdings ist der Anschub nicht gelungen. Es gibt bis heute in Deutschland nicht einen einzigen Haushalt, der mit Erneuerbaren versorgt wird, sie hängen alle am Netz. Auch die Versuche, auch nur eine kleine Insel mit Erneuerbaren zu versorgen, sind alle kläglich gescheitert, ich habe dazu den Film gemacht: „Drei Inseln / drei Pleiten“.

Man muss also doch feststellen, „nachsteuern“ (also auf demselben Wege weitermachen, oder wie es die Junge Freiheit mal tituliert hat, „In Sackgassen Vollgas geben“) wird es nicht bringen, wir müssen „umsteuern“.

Die einzige Lösung, die dann noch bleibt, ist die Umstellung auf Kernenergie. Das ist im Prinzip möglich, Frankreich macht das vor (und andere Länder auch), es braucht allerdings einige Zeit, bis wir das erfolgreich geschafft haben. Der Thorium-Brüter hat Vorrat für etwa 60 Millionen Jahre, das reicht erst mal, neuere Typen von Kernreaktoren können auch den sog. „Atommüll“ verwerten. Andere Möglichkeiten kann ich nicht erkennen.

Mit freundlichen Grüßen

Peter Würdig