Dr. Alan Welch FBIS FRAS

Wir sind nun in das vierte Jahrzehnt der Messung des Meeresspiegelanstiegs mit Hilfe des Satellitenquartetts Topex und Jason 1, 2 und 3 eingetreten. Über die ersten drei Jahrzehnte wurde in den drei Veröffentlichungen (Ref 1), (Ref 2) und (Ref 3) berichtet. Diese kamen zu folgenden Schlüssen:

1. Die wahrgenommenen „Beschleunigungen“ sind mathematische Beschleunigungen, die aufgrund der Berechnungsmethoden auftreten, d. h. der quadratischen Kurvenanpassung, wie sie von Nerem et al [pdf] (Ref 4) in ihrer Studie von 2018 verwendet wird. Auch das Startdatum von Januar 1993 spielt eine wichtige Rolle bei der Entwicklung der „Beschleunigungen“.

2. Die „Beschleunigungen“ nehmen nun im Allgemeinen von Jahr zu Jahr ab und werden voraussichtlich in den nächsten ein oder zwei Jahrzehnten Werte erreichen, die mit den langfristigen (über 100 Jahre) Gezeitenmesswerten kompatibel sind, bevor sie sich in den nächsten Jahrzehnten stabilisieren.

3. Eine Zeitspanne von 30 Jahren ist ein viel zu kurzer Zeitraum, um die tatsächlichen Beschleunigungen zu berechnen; es wird das Drei- oder Mehrfache dieses Zeitraums benötigt.

In diesem Dokument wird der Begriff „Beschleunigung“ verwendet, um darauf hinzuweisen, dass diese Werte mathematisch mit dem doppelten quadratischen Koeffizienten berechnet werden. Allerdings haben sich die Trends bei den Werten seit etwa 2012 hinreichend stabilisiert, um tatsächliche Urteile über langfristige Schwankungen und Trends abzugeben.

Die Daten für das Jahr 2023 werden nun analysiert, wobei der Schwerpunkt auf zwei Aspekten liegt, nämlich dem vorhergesagten großen El Niño und den Ungereimtheiten in Bezug auf die Daten für Oktober und November, als sich fast jeder Datenwert änderte, wobei einige Änderungen mit über 8 mm im Vergleich zu den jährlichen Zunahmen von 3 bis 4 mm recht erheblich waren.

Über die NASA-Website Global Climate Change/Vital-Signs/Sea Level Rise wurden im Jahr 2023 Daten für Januar, Februar, April, Juni, Oktober, November und Dezember veröffentlicht, aber obwohl alle analysiert wurden, wird nicht über alle berichtet. Seit Februar 2018 erfolgt die Analyse der Daten jedes Mal auf standardmäßige Weise, wenn ein neuer Datensatz veröffentlicht wird. Wenn es als interessant erachtet wurde, wurden auch zusätzliche Daten verarbeitet. Im Januar 2023 fügte die NASA-Website den Daten eine zusätzliche Spalte (Spalte 13) hinzu, die der Spalte 12 entsprach, jedoch ohne Anwendung des GIA* [siehe Spaltendefinitionen weiter unten]. Die den Anstieg des Meeresspiegels zeigenden Diagramme auf der NASA-Website wurden zu diesem Zeitpunkt ebenfalls geändert, indem Spalte 13 anstelle von Spalte 12 verwendet wurde. Die Einbeziehung des GIA wirkt sich nur auf die Änderungsrate und nicht auf die „Beschleunigung“ aus, da sie auf eine konstante Änderung von etwa 0,24 mm/Jahr festgelegt ist. In allen Analysen für diese und frühere Arbeiten wurden die Ergebnisse der Spalte 12 verwendet.

[*Leider ließ sich nicht feststellen, für was die Abkürzung GIA steht. A. d. Übers.]

Die vollständigen Definitionen dieser 2 Spalten lauten:

Spalte 12 geglättete (60-Tage-Gauß-Filter) GMSL (GIA angewendet) Variation (mm); jährliches und halbjährliches Signal entfernt.

Spalte 13 geglättete (60-Tage-Gauß-Filter) GMSL (GIA nicht angewandt) Variation (mm); jährliches und halbjährliches Signal entfernt.

An dieser Stelle möchte ich Kip Hansen für seine Geduld danken, mit der er meine ständigen E-Mails gelesen und beantwortet hat, und dessen Kommentare mir geholfen haben, meine Ideen zu formulieren. Kip war nicht mit allen meinen Erkenntnissen und Ideen einverstanden, aber es hat sich eine freundschaftliche Beziehung zwischen uns entwickelt.

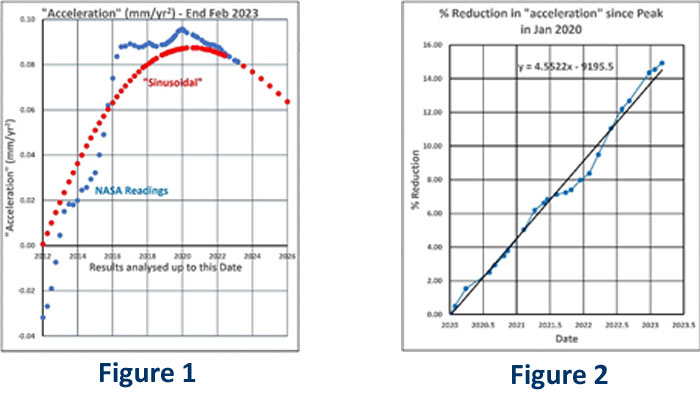

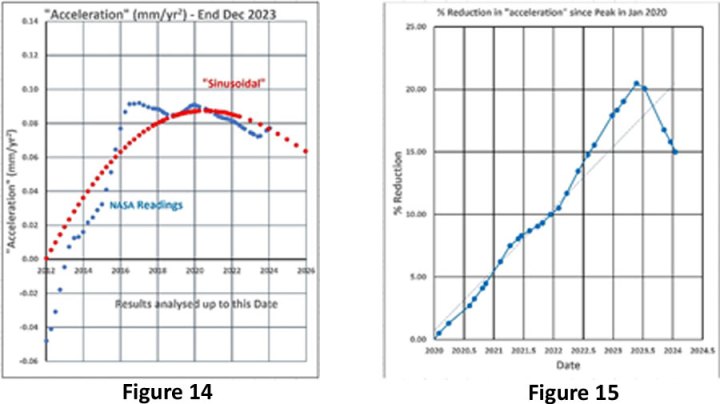

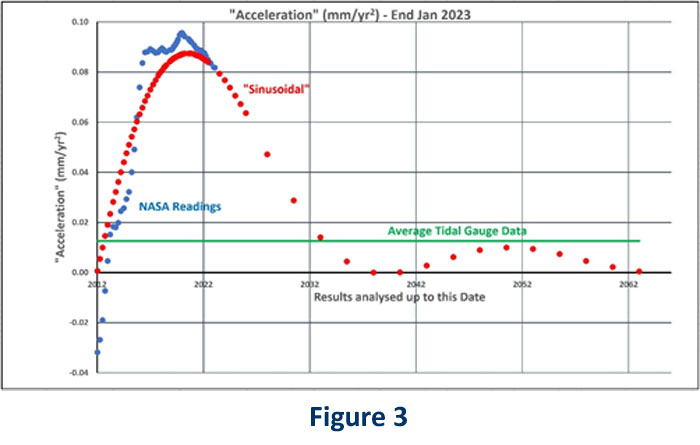

Beginnend mit den Februardaten wurden die „Beschleunigungen“ für zunehmende Zeiträume berechnet, die den Zeitraum von Januar 1993 bis zum Zeitpunkt der Berechnung umfassen. Die Ergebnisse sind in den Abbildungen 1 und 2 dargestellt:

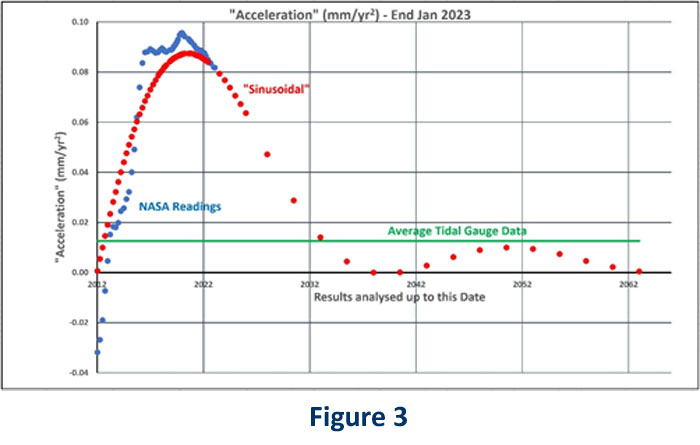

In Abbildung 1 wird der Trend der „Beschleunigung“ mit demjenigen verglichen, der sich ergibt, wenn man annimmt, dass der Meeresspiegel von einer geraden Linie sinusförmig mit einer Periode von 26 Jahren, einer Amplitude von +/-4,2 mm und einer geeigneten Phasenverschiebung abweicht. Die sich daraus ergebende Kurve der „Beschleunigungen“ ist in Abbildung 1 als „Sinuskurve“ bezeichnet. Bei dieser Kurve handelt es sich nicht um eine Sinuskurve, sondern um einen Teil einer „gedämpften“ Sinuskurve, deren Ableitung im Anhang zu Studie 1 (Ref. 1) dargestellt ist. Ihr langfristiger Verlauf ist in Abbildung 3 zusammen mit dem Durchschnittswert des Gezeitenpegels dargestellt. Darin konvergiert die Sinuskurve gegen Null, aber in Wirklichkeit könnte es einen kleinen Langzeitwert geben, der dem Gezeitenpegelwert entspricht.

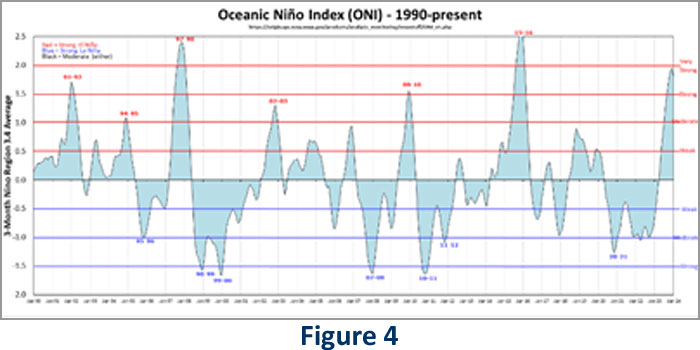

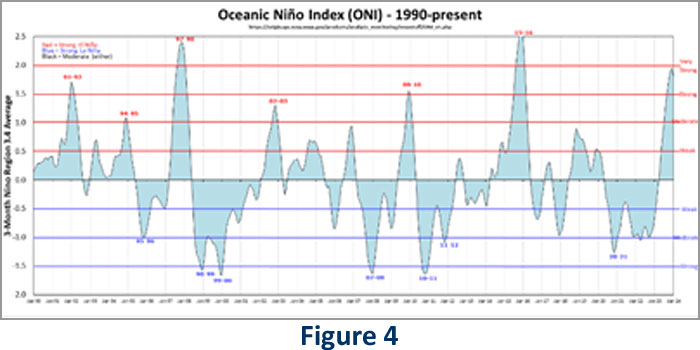

Zu diesem Zeitpunkt wurde festgestellt, dass sich ein signifikanter El Niño anbahnen könnte. Abbildung 4 unten zeigt eine Darstellung des El-Niño-Index. Es handelt sich um eine neuere Darstellung von Ende 2023, aber die Daten vom Februar 2023 stimmen genau mit dem Zeitpunkt überein, als der Index bei Null lag, aber anstieg.

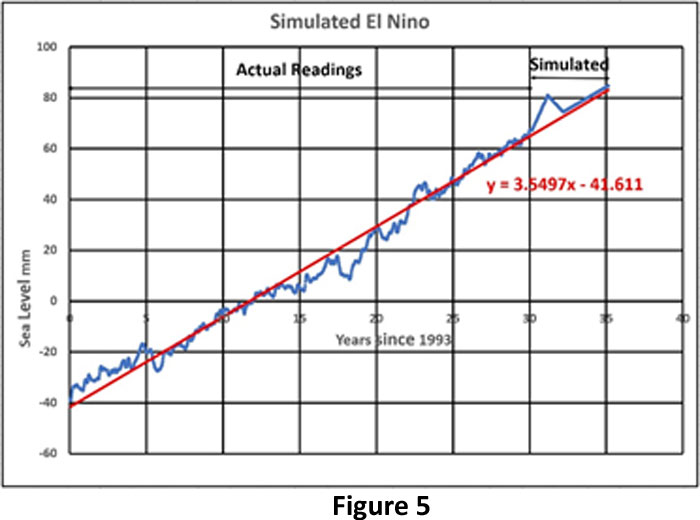

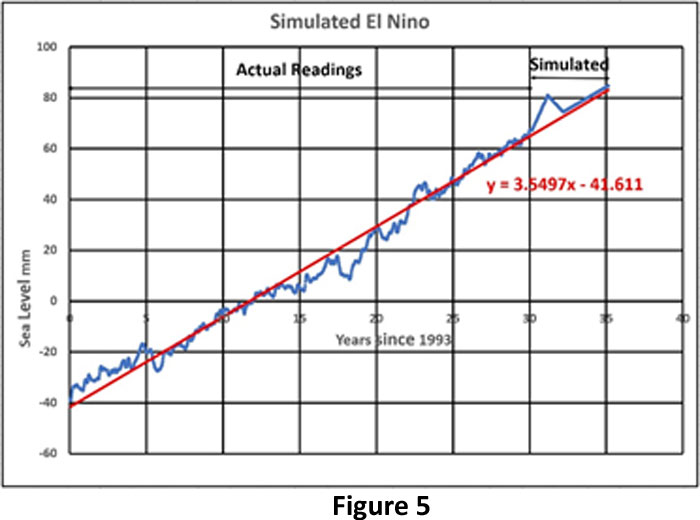

Es wurde beschlossen, die Auswirkungen eines El Niño zu simulieren, indem man die Daten vom Februar 2023 nahm, die im Mai 2023 verfügbar waren, und den linearen Trend um etwa 5 Jahre verlängerte. In den ersten beiden Jahren wurde ein starker El-Niño-Effekt erzielt, der den Anstieg des Meeresspiegels um etwa 10 mm erhöhte. Im nächsten Jahr fällt der Meeresspiegel wieder auf die lineare Trendlinie zurück. Der simulierte El Niño ist in Abbildung 5 zusammen mit dem linearen Trend dargestellt.

Ein Hinweis für die Puristen. Jeden Monat, wenn ein neuer Monat analysiert wird, variiert die Steigung der linearen Anpassung geringfügig, so dass jeder tatsächliche Restwasserstand (tatsächlicher Wert minus linearer Wert) oder sinusförmige Schwankungen an einer leicht modifizierten linearen Linie gemessen werden. Da die Steigungen im Allgemeinen im Bereich von 3,2 bis 3,5 mm/Jahr liegen, wird dies als akzeptabel angesehen, da es innerhalb der „technischen Toleranz“ liegt, und als Ingenieur im Ruhestand kann ich mit dieser Situation nachts schlafen.

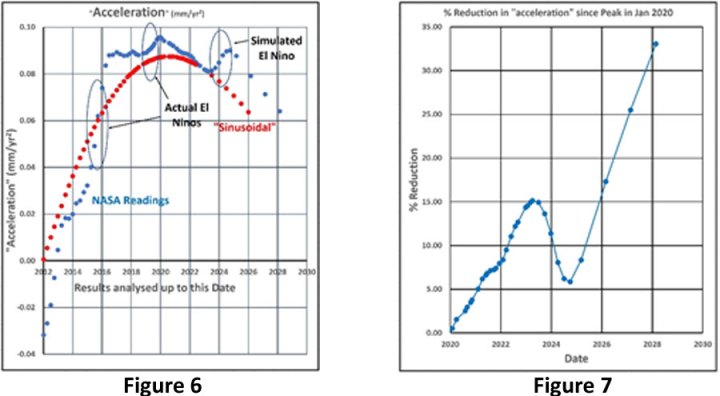

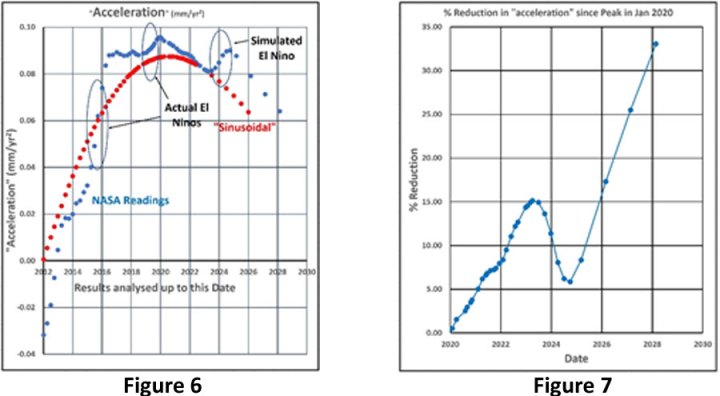

Die modifizierten Daten wurden analysiert und die „Beschleunigungen“ bestimmt. Die Ergebnisse sind in Abbildung 6 dargestellt. Die Auswirkung des El Niño besteht darin, dass sich die „Beschleunigung“ in den nächsten 12 Monaten vorübergehend um etwa 0,01 mm/Jahr² erhöht und dann wieder ein Abwärtstrend einsetzt. Interessanterweise zeigen sich zwei frühere El Niños in den Jahren 2015/16 (stark) und 2018/19 (moderat) als Wackler auf der blauen Kurve. Die damit verbundene Abnahme der „Beschleunigung“ seit 2020 ist ebenfalls in Abbildung 7 dargestellt:

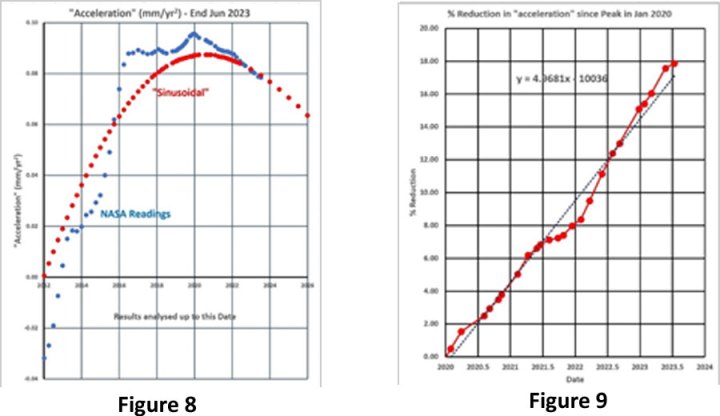

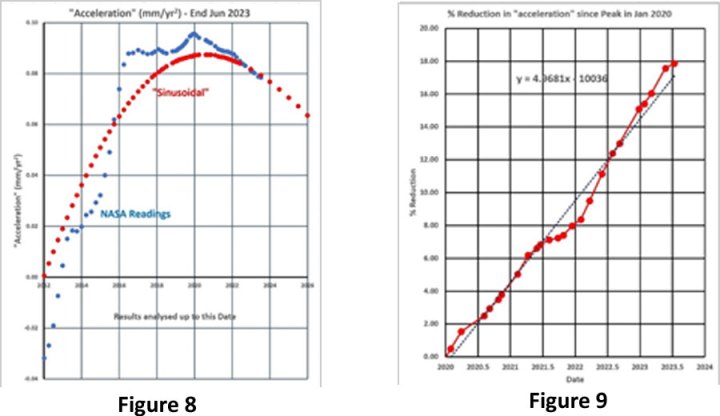

Der nächste zu analysierende Datensatz bezieht sich auf den Juni 2023 und ergibt die Abbildungen 8 und 9, die einen geringen Einfluss des beginnenden El Niño zeigen:

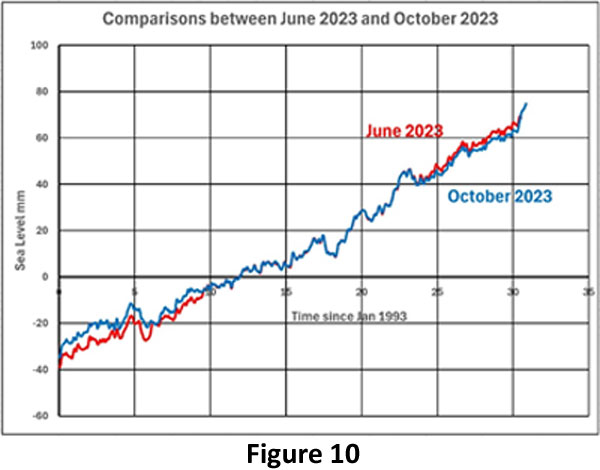

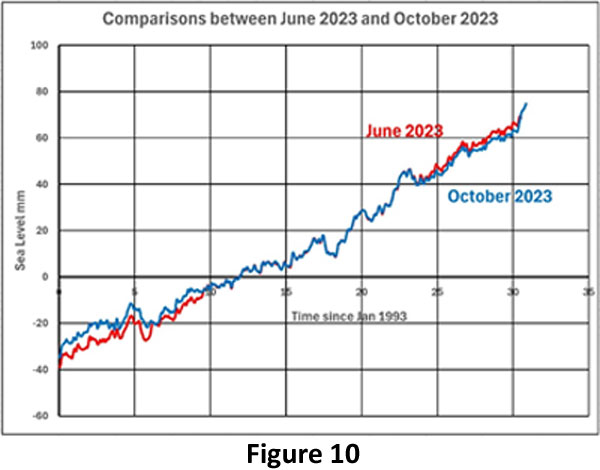

Bei der Analyse der Oktoberdaten wurde deutlich, dass sich die Messwerte dramatisch verändert hatten, wie in Abbildung 10 dargestellt:

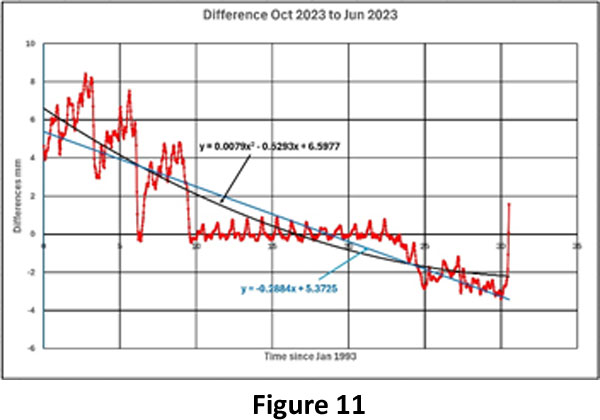

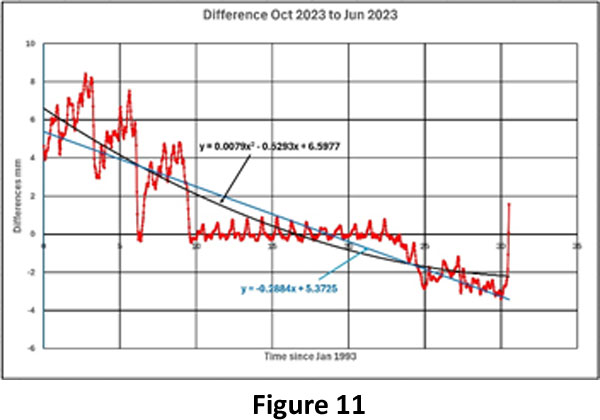

Abbildung 11 unten zeigt die Unterschiede zwischen den Daten vom Oktober 2023 und den Daten vom Juni 2023. In den ersten 10 Jahren gab es bei den Oktoberdaten einen Anstieg bis über 8 mm. In den nächsten 13 Jahren blieben die Werte ungefähr gleich, mit einem Rückgang von etwa 2 mm in den letzten 7 Jahren. Der sprunghafte Anstieg am Ende ist hauptsächlich auf den El Niño zurückzuführen. Die Folgen dieser Veränderungen waren eine Verringerung der Neigung um etwa 0,3 mm/Jahr und eine Erhöhung der „Beschleunigung“ um etwa 0,008 mm/Jahr². Bislang wurde noch keine Erklärung für diese Veränderungen gefunden. Das letzte Mal wurden im August 2021 Änderungen vorgenommen, die zwischen -2,5 mm und 0,5 mm schwankten, was zu einer geringen Änderung der Neigung und einer Verringerung der „Beschleunigung“ um 0,004 mm/Jahr² führte.

Die Veröffentlichung der Daten für November und Dezember wurde mit einer gewissen Nervosität erwartet und dann analysiert. Die Änderungen von Juni 2023 bis November 2023 waren geringer, wie in Abbildung 12 dargestellt, wobei die maximale Änderung jetzt etwa 5 mm beträgt. Ab Juni 2023 führte dies zu einer Verringerung der Neigung um etwa 0,2 mm/Jahr und zu einer Verringerung der „Beschleunigung“ um etwa 0,003 mm/Jahr².

In diesem Stadium wurde beschlossen, eine kombinierte Darstellung der Novemberdaten zu erstellen, welche die NASA-Daten und die Kurve zeigt, die durch die Kombination der linearen Linie mit der sinusförmigen Veränderung entsteht (Abbildung 13):

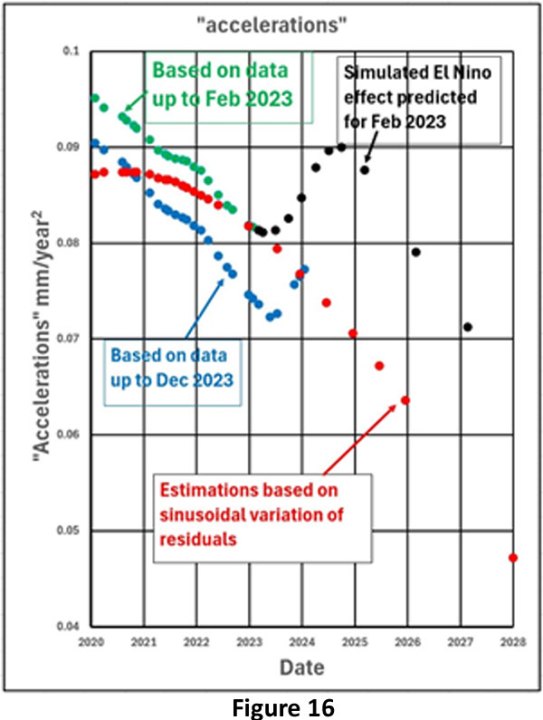

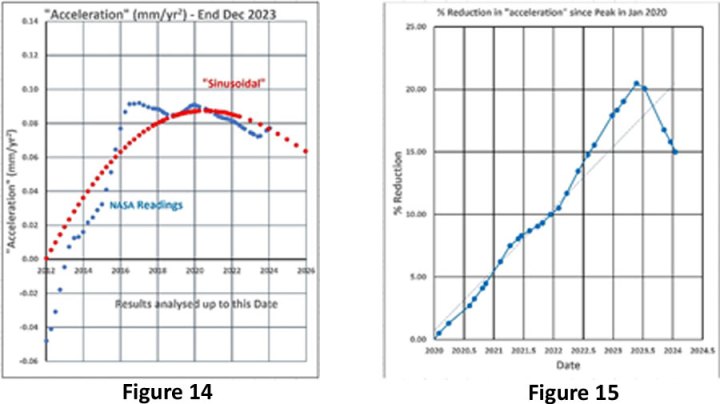

Die Abbildungen 14 und 15 zeigen die neuesten (Dezember 2023) Diagramme der „Beschleunigung“ und der Verringerung der „Beschleunigung“ seit dem Höchststand von 2020:

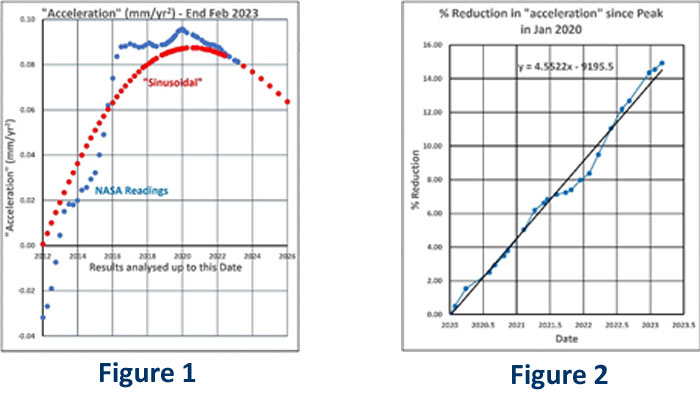

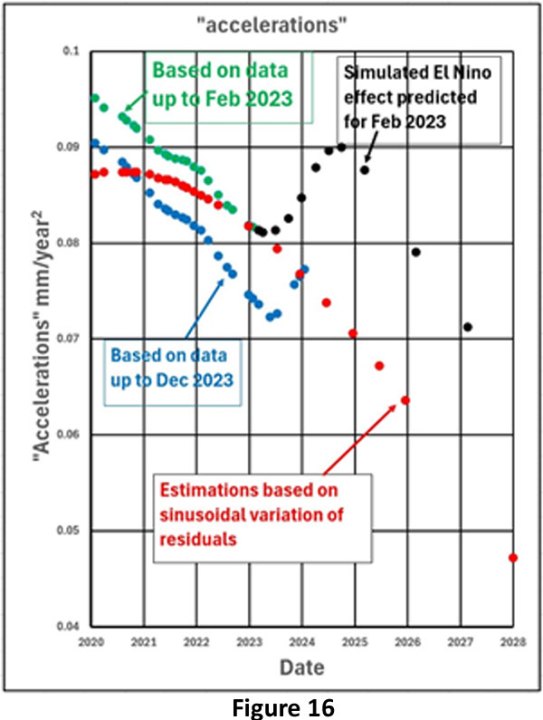

Die abschließende Abbildung 16 zeigt einen Vergleich der „Beschleunigungen“ seit Januar 2020 auf der Grundlage der Daten vom Februar 2023 mit der zusätzlichen El-Niño-Simulation und den Daten vom Dezember 2023. Wenn der Trend für 2024 den Simulationstrends folgt, werden die „Beschleunigungen“ im Spätsommer 2024 einen Höchststand von etwa 0,085 mm/Jahr² erreichen und dann schnell auf fast 0,01 mm/Jahr² zurückgehen, bis der nächste signifikante El Niño auftritt.

Wer mag keine Vorhersagen? Ich schaue über der Wand, aber mit 86 Jahren, ohne Agenda, Ruf, Universitätsrolle oder Job, den ich behalten muss, ist es schön, diese Freiheit zu haben. Ich muss nur weiterhin die Tabletten einnehmen, um zu sehen, ob sich alles bewahrheitet!

Eine Schlussfolgerung ist, dass die berechneten „Beschleunigungen“ nicht die Vorboten des Unheils sind, wie sie von vielen Klimawissenschaftlern, der BBC und der Zeitung Guardian dargestellt werden. Diese „Beschleunigungen“ sind vielleicht nur mathematische Macken und nicht von größerer physikalischer Bedeutung, aber es könnte aufschlussreich sein zu versuchen, sie zu vergleichen und künftige Veränderungen vorherzusagen, insbesondere in den nächsten 10 Jahren oder so.

———————

1. https://wattsupwiththat.com/2022/05/14/sea-level-rise-acceleration-an-alternative-hypothesis/

2. https://wattsupwiththat.com/2022/06/28/sea-level-rise-acceleration-an-alternative-hypothesis-part-2/

3. https://wattsupwiththat.com/2023/05/02/30-years-of-measuring-and-analysing-sea-levels-using-satellites/

4. Nerem, R. S., Beckley, B. D., Fasullo, J. T., Hamlington, B. D., Masters, D., & Mitchum, G. T. (2018). Climate-change-driven accelerated sea-level rise detected in the altimeter era. (full text .pdf) Proceedings of the National Academy of Sciences of the United States of America, 115(9). First published February 12, 2018

——————

Kommentar von Kip Hansen:

Ich habe die Veröffentlichung dieses Aufsatzes ermöglicht, des vierten Beitrags von Dr. Welch hier. Dr. Welch und ich unterhalten uns seit mehreren Jahren über die Geschwindigkeit des Meeresspiegelanstiegs und die Behauptung von Nerem et al. nebst anderen, dass sich der Anstieg des Meeresspiegels beschleunigt (d. h., dass er immer schneller ansteigt). NASA/NOAA bezeichnen die Veränderung der Rate, die sich ergibt, wenn der satellitenberechnete SLR an die Aufzeichnungen der globalen Gezeitenpegel für das Jahr 1996 angehängt wird, ebenfalls als „beschleunigter SLR“. Wie bei allen numerischen Daten, die mit dem Klimawandel in Verbindung gebracht werden können, wird und wurde an den Methoden, Berechnungen und den sich daraus ergebenden Zahlen viel herumgepfuscht. Daher kann bei Meeresspiegeldaten, bei denen die jährlichen Veränderungen im Vergleich zum Ausmaß der Störfaktoren gering sind, wenig bis gar nichts mit einem gewissen Grad an wissenschaftlicher Sicherheit festgestellt werden.

Langjährige Leser werden sich erinnern, dass ich kein Fan des Themas SLR-Beschleunigung bin – aus den oben genannten Gründen.

Dr. Welchs Ansicht zur Beschleunigung ist so gültig wie jede andere da draußen.

Der Meeresspiegel der Erde steigt – und er wird weiter steigen, aus all den Gründen, aus denen er in den letzten paar hundert Jahren gestiegen ist. Meiner Meinung nach wird er auch in Zukunft mit der gleichen Geschwindigkeit – 2 oder vielleicht sogar 3 mm pro Jahr – steigen. Dieser langsame, stetige Anstieg kann und wird für hochentwickelte, tief liegende Gebiete ein Problem darstellen. In einem Abstand von weniger als 20 cm zum heutigen Meeresspiegel – dem mittleren Hochwasser – zu bauen, ist und war schon immer außerordentlich töricht.

Mein Dank gilt Dr. Alan Welch für seine ständigen Bemühungen, das Thema genau im Auge zu behalten, was es ihm ermöglicht, wiederholte Änderungen der verwendeten Datensätze zu erkennen.

Link: https://wattsupwiththat.com/2024/03/21/measuring-and-analysing-sea-levels-using-satellites-during-2023/

Übersetzt von Christian Freuer für das EIKE

Abbildung 1 (

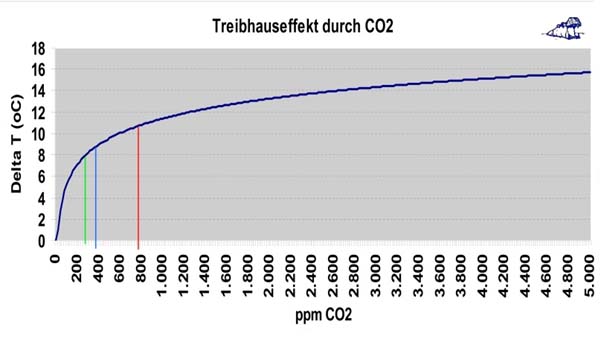

Abbildung 1 ( In der nachfolgenden Abbildung wird dieser logarithmische Zusammenhang zwischen dem atmosphärischen CO2-Gehalt und der Temperatur deutlich:

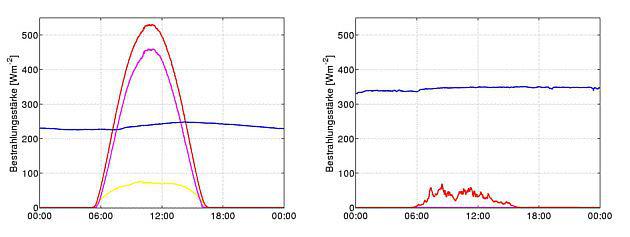

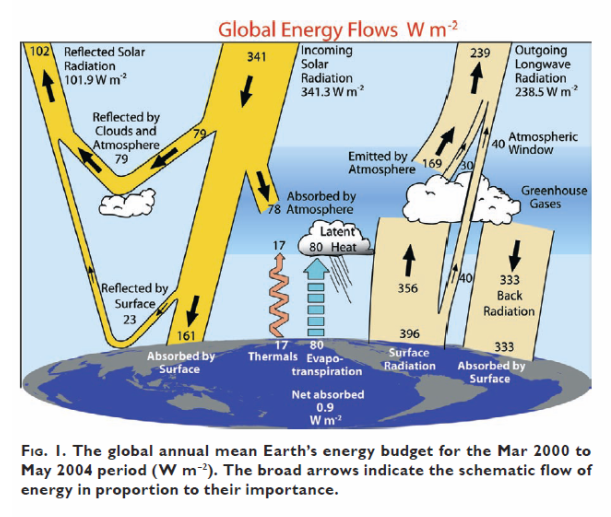

In der nachfolgenden Abbildung wird dieser logarithmische Zusammenhang zwischen dem atmosphärischen CO2-Gehalt und der Temperatur deutlich: Abbildung 3: Das globale jährliche Energiebudget von März 2000 bis Mai 2004 in [W/m²]

Abbildung 3: Das globale jährliche Energiebudget von März 2000 bis Mai 2004 in [W/m²]