Windkraft und ihre verheerenden Folgen für Mensch und Natur

Die rücksichtslose Art und Weise, wie die Windkraft in Deutschland durchgesetzt wird, erinnert an die brutale Art und Weise, wie die „Betonfraktion“ in der Nachkriegszeit vielen deutschen Städten den Rest gab. Eine Windwahn-Bestandsaufnahme.

von Georg Etscheit

31. Januar 2020: Gesetz zur weiteren Beschleunigung von Planungs- und Genehmigungsverfahren im Verkehrsbereich; 14. Mai 2020: Planungssicherstellungsgesetz; 5. November 2020: Investitionsbeschleunigungsgesetz; 7. Juli 2022: „Osterpaket” mit Änderung des Erneuerbare-Energien-Gesetzes und des Bundesnaturschutzgesetzes, Beschluss des „Wind-an-Land-Gesetz”; 19. Dezember 2022: EU-Notfallverordnung; 10. Februar 2023: Novelle der Verwaltungsgerichtsordnung. Seither gelten „Ökokraftwerke“ und neue Stromleitungen als Frage des nationalen Interesses, ein „Totschlags“-Konstrukt, das in der gerichtlichen Abwägung der verschiedenen Rechtsgüter kaum schwerer wiegen könnte.

Seit die Ampelregierung und mit ihr die „Grünstrom“-Lobby an die Schalthebel der Macht gekommen sind, jagt ein neues Gesetz, eine neue Verordnung und eine Novelle die andere. Schutznormen für Landschaft und Natur werden beschnitten, die einst (unter maßgeblicher Beteiligung grüner Regierungen) stark ausgeweiteten Beteiligungsmöglichkeiten von Naturschützern und Bürgern geschmälert, um den Bau von Verkehrswegen, Industriegebieten, Stromleitungen oder Windkraftanlagen unkompliziert auch gegen Widerstände durchsetzen zu können. Über allem schwebt das berühmt-berüchtigte Klimaschutz-Grundsatzurteil des Bundesverfassungsgerichts und eine weitgehend analoge Rechtsprechung des Europäischen Gerichtshofes.

Die mannigfaltigen gesetzgeberischen Vorhaben werden flankiert von weiteren Initiativen der Europäischen Union im Rahmen des „Green New Deals“ sowie der Bundesländer. So hat Bayern beispielsweise das Landesdenkmalschutzgesetz liberalisiert, damit künftig auch im Umkreis wertvoller, landschaftsprägender Kulturdenkmale Windkraftwerke ohne Berücksichtigung von denkmal- und heimatpflegerischen Belangen errichtet werden dürfen.

Amoklauf zulasten von Mensch und Natur

Gegen diese Novelle läuft eine Popularklage um den Denkmalschutz besorgter Bürger – neben Bürgerentscheiden eines der wenigen noch verbliebenen Instrumente, um den Amoklauf zulasten von Mensch und Natur, zu dem sich die „Energiewende“ entwickelt hat, noch etwas entgegenzusetzen. Zumal auch der verwaltungsgerichtliche Instanzenweg verkürzt wurde, um Klageverfahren schneller abschließen zu können.

Erklärtes Ziel ist es, die letzten Hürden auszuräumen, die einem beschleunigten Ausbau der Windkraft und anderer sogenannter Erneuerbarer Energien in Deutschland bislang noch im Wege standen. Bis 2045 soll die trotz schleichender Deindustrialisierung immer noch viertgrößte Industrienation der Welt „klimaneutral“ sein. Dabei hat sich die Bundesregierung und vor allem ihr grüner Wirtschafts- und Klimaschutzminister Robert Habeck selbst absichtsvoll unter Druck gesetzt, indem wichtige atomare und fossile Kraftwerkskapazitäten geschleift wurden und werden. Die Absage an kostengünstiges russisches Erdgas, begründet mit dem Einmarsch der Russen in die Ukraine, trägt ein Weiteres zur latenten Energieknappheit bei.

Mittlerweile laufen flächendeckend auf allen Ebenen der Verwaltung – Kommunen, Regionalverbände, Bundesländer – Planungen zum Bau insbesondere von tausenden neuer Windkraftwerke. Vor allem in Süd- und Südwestdeutschland sehen die Energiewendestrategen großen Nachholbedarf. Weil die meisten windhöffigen Flächen schon belegt sind, werden neue „Windparks“ mehr und mehr in „Schwachwindgebieten“ sowie in den letzten, noch wenig tangierten Höhenlagen der Mittelgebirge wie des Schwarzwaldes und des Bayerischen Waldes gebaut, wo die schädlichen Auswirkungen besonders groß sind. Sogar der frühere FDP-Wirtschaftsminister Martin Zeil kritisierte jüngst, dass es zu seiner Zeit noch nicht politische Zielvorstellung gewesen sei, „unsere Wälder in großem Stil“ für die Windkraft abzuholzen.

Derzeit drehen sich, so der Wind denn mal weht, hierzulande gut 30.000 Windkraftanlagen. Mindestens zehntausend sollen in naher Zukunft hinzukommen. Der Anteil der von diesen Anlagen direkt beanspruchten Fläche soll von derzeit 0,5 Prozent auf mindestens zwei Prozent steigen, wobei schon diese zwei Prozent 100 Prozent Landschaftszerstörung bedeuten. Ob die angestrebten Ausbauziele in vollem Umfang erreicht werden, ist zweifelhaft. Trotzdem dürfte sicher sein: Wenn kein politisches Wunder geschieht, wird sich Deutschland spätestens zum Ende dieses Jahrzehnts in eine unwirtliche, weitgehend lebensfeindliche „Energielandschaft“ verwandelt haben. Jedenfalls abseits urbaner Ballungsräume und (bislang noch) tabuisierter Nationalparks und Naturschutzgebiete.

Der Landschaftsschutz kommt unter die Räder

Die Auswirkungen von zehntausenden bis zu 250 Meter hoch aufragender „Windräder“ – die modernsten Anlagen erreichen mit rund 300 Metern Höhe fast Eifelturmniveau – sind schon heute enorm. Die gigantischen Industrieanlagen überdecken bereits weite Teile Nord-, Ost-, und Westdeutschlands und mehr und mehr auch die Ostsee und die Deutsche Bucht. Dabei geht es um die Bestände wertvoller Vogel- und Fledermausarten, aber auch den Schutz von Insekten, Meeressäugern, Wäldern, Böden, Wasserhaushalt, Mikroklimata und, nicht zuletzt, der menschlichen Gesundheit.

Ganz zu schweigen vom Erhalt der Kulturlandschaften, ein Schutzgut, das im Zuge der „Energiewende“ zuallererst unter die Räder kam. Mussten bei Eingriffen in Landschaftsschutzgebiete vor einigen Jahren noch aufwändige Abweichungs- und Zonierungsverfahren durchgeführt werden, haben die Planer heute „Carte blanche“. In Bezug auf den Bau von Anlagen zur Bereitstellung erneuerbarer Energie sind Landschaftsästhetik und Landschaftsschutz unterdessen praktisch inexistent und spielen, anders als in Frankreich, auch in Gerichtsverfahren so gut wie keine Rolle.

Für Vögel galt in seligen Zeiten des Natur- und Artenschutzes ein auf jedes einzelne Individuum bezogenes Tötungsverbot. Weil sich diese Regelung als bedeutendes Hindernis für Planung und Bau von Windindustriegebieten erwies, geht es heute nur noch um den Schutz von Populationen. Nur wenn ein geplantes Projekt etwa ein „Dichtezentrum“ des Roten Milans in seinem gesamten Bestand zu gefährden droht, gibt es überhaupt eine Handhabe für die Naturschutzbürokratie.

Gefährdete Vogelarten geschreddert

Doch diesen Nachweis zu führen ist schwierig und er scheitert oft schon daran, dass es an belastbaren Beobachtungsdaten mangelt. Oft müssen klagende Bürgerinitiativen oder Umweltverbände selbst ein kostspieliges Monitoring möglicher gefährdeter Arten veranlassen, wobei darauf spezialisierte ökologische Planungsbüros oft im Sold der Windindustrie stehen und indirekt dazu angehalten sind, besser keinen Schwarzstorch- oder Milanhorst oder ein Habitat von Waldschnepfe und Auerwild zu finden.

Nur wenige Schlaglichter zu den Gefahren, die der Vogelwelt drohen: Von März bis November 2015 führte die Schweizerische Vogelwarte Sempach im Auftrag des Bundesamtes für Energie im Schweizer Jura eine systematische Schlagopfersuche an drei (nur) 150 m hohen Windkraftwerken durch. Unter Berücksichtigung aller Faktoren, auch der Entdeckungswahrscheinlichkeit und der Rate jener Kadaver, die von Predatoren aufgefressen werden, ergab die Hochrechnung eine absolute Kollisionsrate von rund 21 Individuen pro Jahr und Windkraftanlage. Bei 40.000 oder mehr Windkraftwerken, die in Deutschland geplant sind, würde wohl rasch die Millionengrenze überschritten.

Zu den windkraftsensiblen Großvogelarten gehört auch nach Einschätzung des Bundesumweltministeriums der Rote Milan. Nach einer in der Zeitschrift Vogelwelt publizierten Studie war für flügge Rotmilane in Brandenburg in den vergangenen drei Jahrzehnten Windkraft mit 33 Prozent die häufigste Todesursache, gefolgt vom Straßenverkehr mit 17 Prozent. Bei der Zuordnung zu Altersgruppen sei der Anteil adulter Vögel mit rund achtzig Prozent unter den Windkraftopfern sehr hoch, betonen die Autoren.

Fledermäuse und Insekten schwer dezimiert

Auch für die in Deutschland vorkommenden etwa 25 Fledermausarten stellen Windkraftwerke eine signifikante Gefahr dar, nicht zuletzt deshalb, weil die an den Spitzen der sich mit bis zu halber Schallgeschwindigkeit drehenden Rotorblätter erzeugten Luftdruckschwankungen die empfindlichen Sinnesorgane der Tiere zerstören können. Studien zufolge verursacht jedes deutsche Windrad jährlich den Tod von rund zehn bis zwölf Fledermäusen, das wären derzeit etwa 400.000 Tiere jährlich, wobei die Zahlen je nach geographischer Lage und Anlagentypus variieren. Siebzig Prozent der getöteten Fledermäuse stammen von Populationen, die nicht in Deutschland, sondern in anderen Ländern heimisch sind.

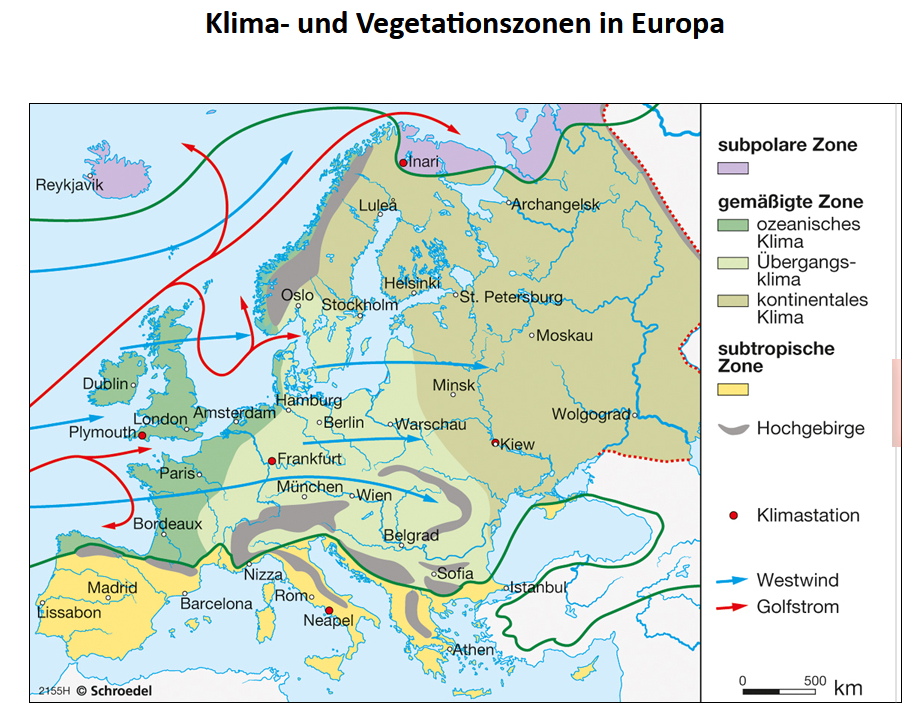

Wegen seiner zentralen Lage durchqueren Fledermäuse Deutschland auf dem Weg von ihren nordosteuropäischen Sommerlebensräumen hin zu ihren süd- und westeuropäischen Winterlebensräumen und zurück. Deutschland habe die besondere Verantwortung, migrierende Arten zu schützen, so Christian Voigt, einer der Autoren der zitierten Studie. Die hohe Mortalitätsrate werde sich bestandsbedrohend auf die Fledermaus-Populationen in ihren europäischen Herkunftsgebieten auswirken.

Windkraftanlagen haben auch erhebliche Auswirkungen auf Fluginsekten, wie eine im Jahr 2017 veröffentlichte Studie des Deutschen Zentrums für Luft- und Raumfahrt (DLR), Institut für Atmosphärenphysik in Oberpfaffenhofen zeigt. Aufgrund von veränderten Wind- und Temperaturbedingungen werden Insekten von Windkraftanlagen angelockt und sterben in großer Anzahl – hochgerechnet an allen deutschen Windkraftanlagen während der warmen Jahreszeit (200 Tage von April bis Oktober) rund fünf bis sechs Milliarden Insekten pro Tag.

Gefahr auch für die Meeresfauna

Eine vielfach vernachlässigte Gefährdung geht von den negativen Einflüssen der Druck- und Schallwellen der Windkraftanlagen, der sogenannten Scheuchwirkung, auf einige Tierarten mit einem extrem empfindlichen Gehörsinn aus. Zu diesen akustisch besonders sensiblen und störungsempfindlichen Arten zählen alle Fledermäuse und Eulen, der Luchs und die Wildkatze sowie zahlreiche Vogelarten, darunter die in ihrem Bestand rückläufige und in der „Vorwarnliste“ aufgeführte Waldschnepfe.

Je mehr die Windkraftindustrie auch die meist küstennahen Meeresoberflächen zur Energiegewinnung heranzieht, wachsen die Gefahren für die Meeresfauna. Ziel einer am 1. Januar 2023 in Kraft getretenen Änderung des Gesetzes zur Entwicklung und Förderung der Windenergie auf See (WindSeeG) ist es, die installierte Leistung von Offshore-Windenergie bis 2045 auf mindestens 70 Gigawatt (heute rund 8,5 GW) zu steigern, wobei auch hier Artenschutzregelungen zugunsten beschleunigter Planungen ausgehebelt wurden.

Die flächendeckende Industrialisierung der Meere könnte nach Einschätzung von Meeresökologen zur Folge haben, dass die einzigen heimischen Meeressäuger, die in der Nordsee lebenden Schweinswale, aus ihrem angestammten Lebensraum verdrängt werden. Vor allem die beim Bau der Offshore-Wind-„parks“ notwendigen Rammarbeiten mit hohen unterseeischen Schallpegeln bewirken einen signifikanten Vertreibungseffekt auf die akustisch hoch sensiblen Tiere. „Sollten immer mehr Offshore-Windparks entstehen, wird das enorme Auswirkung auf die Schweinswal-Populationen in der Nord- und Ostsee haben“, heißt es in einer Stellungnahme der Gesellschaft zur Rettung der Delphine.

Infraschall macht Menschen zu schaffen

Bliebe ein wichtiges Thema, das den Menschen ganz direkt betrifft, genauer gesagt jene Menschen, die in der Nähe von Windkraftwerken leben müssen: der Infraschall. Mit zunehmender Flächendichte dieser Anlagen wird die Zahl der unmittelbar Betroffenen, die über heftige Gesundheitsbeschwerden wie Schlaflosigkeit, Schwindel, Kopfschmerzen, Depressionen bis hin zu Tinnitus, Hör- und Sehstörungen und Herzrhythmusstörungen klagen, sprunghaft zunehmen, zumal in wohl keinem anderen Land Europas so laxe Abstandsregelungen gelten wie in Deutschland – die Schutzabstände reichen von wenigen hundert Metern bis zu maximal einem Kilometer.

Die in Bayern lange Zeit gültige, vorbildhafte 10H-Abstandregelung wurde mittlerweile leider verwässert und durch konkurrierende Gesetzgebung des Bundes marginalisiert. Sie sah vor, dass der Abstand zwischen einer Windenergieanlage und der nächstliegenden Wohnbebauung dem Zehnfachen der Anlagenhöhe entsprechen muss. Bei einem 250 Meter hohen Windrad wären das bis zu drei Kilometer.

Immer noch zu wenig, wie nicht wenige Wissenschaftler meinen. Denn die Reichweite des von Windkraftanlagen emittierten, luftgetragenen Infraschalls kann nach Messungen der Bundesanstalt für Geologie und Rohstoffe mehr als zehn Kilometer betragen. Mittlerweile kann als wissenschaftlich gesichert gelten, dass Infraschall weit unter der Hörschwelle Wirkungen auslöst, die von den menschlichen Sinnesorganen als Stressoren bewertet werden.

Dabei ist der kritische Parameter offenbar nicht der mittlere oder maximale Schalldruck, sondern das Auftreten steiler Änderungen, sogenannter peaks, schreibt Werner Roos, emeritierter Professor für pharmazeutische Biologie in einer Übersicht. Deren Häufigkeit sowie das Ausmaß der Druckschwankungen wird durch die Größe der Anlage und die Drehzahl bestimmt. Bei der Wahrnehmung spielen dann auch geografische und meteorologische Bedingungen eine Rolle sowie die jeweilige Disposition der Betroffenen, wobei offenbar nicht jeder Mensch ähnlich infraschallsensibel ist.

Es wird weiter auf die Tube gedrückt, ohne Rücksicht auf Verluste

Vonseiten der Windkraftlobby und der sie unterstützenden Politik werden die Auswirkungen von gepulstem Infraschall systematisch heruntergespielt. Beim „Windturbinen-Syndrom“ handele es sich um eine eingebildete Krankheit, die aus einer negativen Einstellung gegenüber der Windenergie herrühre. Doch selbst wenn es auch solche psychischen Effekte geben sollte, resultieren daraus wirkliche Leiden, derer sich die Verantwortlichen annehmen müssen.

Auf jeden Fall wäre ein Moratorium zum Bau neuer Anlagen notwendig, bis weitere, belastbare epidemiologische Studien zu den Auswirkungen des von Windkraftwerken emittierten Infraschalls vorliegen. In Frankreich wurde jüngst per höchstrichterlicher Anordnung die Neuzulassung von Windrädern an Land gestoppt, bis die Probleme mit dem Infraschall geklärt sind.

Wohl undenkbar in Deutschland. Stattdessen wird weiter auf die Tube gedrückt, koste es, was es wolle. Mit einem neuen Gesetz zur Umsetzung einer EU-Richtlinie soll es bald möglich sein, „Beschleunigungsgebiete“ für Windkraft und PV auszuweisen, in denen unter anderem Umweltverträglichkeitsprüfungen und artenschutzrechtliche Prüfungen nicht mehr notwendig sein sollen. Mittlerweile ist der gesetzgeberische Wust selbst für Experten kaum noch zu durchschauen. Für die unterbesetzten Genehmigungsbehörden in den Landratsämtern ohnehin nicht, die längst fast jede Planung durchwinken. Wahnsinn? Ja, aber mit Methode!

Ich danke Dr. Wolfgang Epple www.wolfgangepplenaturschutzundethik,de für die fachliche Beratung.

Der Beitrag erschien zuerst bei ACHGUT hier