von Dr. Eike Roth

Problemstellung:

Die CO2-Konzentration in der Atmosphäre ist sehr schnell gewachsen. Ursache hierfür wären ausschließlich die anthropogenen Freisetzungen, wird meist gesagt, z. B. im AR 6 von IPCC, /1/. Manche Autoren halten das aber für unmöglich, die anthropogenen Freisetzungen würden viel zu langsam wachsen, um alleine das erforderliche CO2 liefern zu können, eine erhebliche zusätzliche Quelle müsse mitgewirkt haben, z. B. /2/ bis /5/.

In diesem Diskussionsbeitrag hier wird gezeigt, dass die zusätzliche Quelle aus rein physikalischer Sicht höchstwahrscheinlich erforderlich ist und die üblichen Gegenargumente nicht tragen. Wenn das stimmt, hat es gravierende Konsequenzen.

These:

Das andauernde schnelle Wachsen der CO2-Konzentration in der Atmosphäre kann durch die anthropogenen Freisetzungen alleine nicht erklärt werden, weil die mit ihrem langsamen Wachsen nicht ausreichend viel CO2 zur Verfügung stellen können. Die Physik fordert eine erhebliche zusätzliche Quelle, die ihrerseits auch stark wächst.

Wichtig in dieser These ist das Wort „andauernde“, denn bei stark wechselnden Freisetzungen kann es vorübergehend auch anders sein: So dauert es z. B. nach einer sprungförmigen Erhöhung der Freisetzungen einige Zeit, bis die Entnahmen auf das Niveau der Freisetzungen angewachsen sind. In dieser Zeit wächst die Konzentration schneller als die Freisetzungen wachsen. Aber solange Sprünge im Prozentbereich bleiben, bzw. wenn Änderungen eher langsam ablaufen, dann wird das Gleichgewicht immer sehr schnell erreicht, innerhalb von maximal einigen Jahren, bzw. es laufen dann auch Transienten immer sehr nahe am Gleichgewicht ab. Ursachen hierfür sind der starke CO2-Austausch (jährliche Umwälzung von etwa einem Viertel des Inventars!) und das Anwachsen der Entnahme (nicht der Netto-Entnahme!) mit der Konzentration. Über einen längeren Zeitraum hinweg kann die Konzentration daher eindeutig nicht schneller wachsen, als die Freisetzungen wachsen, weil dafür der Nachschub an CO2 nicht reicht.

Beweisführung:

Daten:

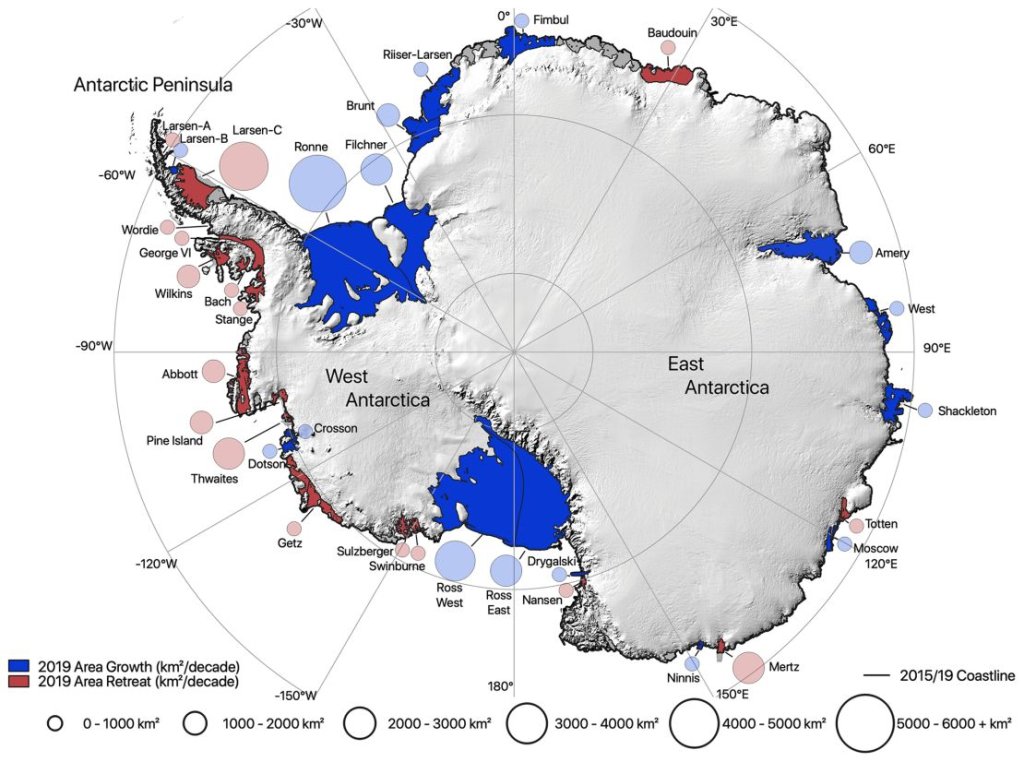

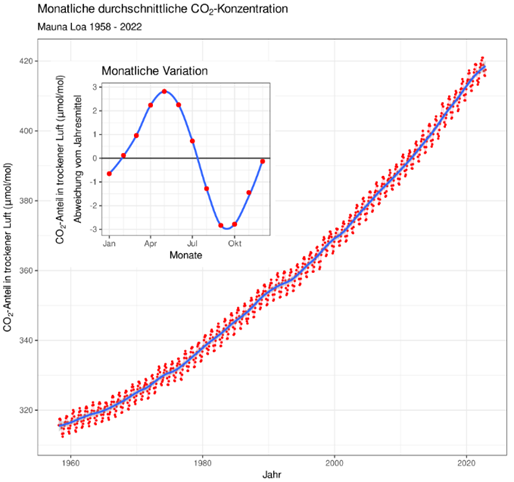

Abb. 1: Monatliche CO2-Konzentration, Mauna Loa, Hawaii, 1958-2022; Quelle: http://w.wiki/4ZWn.

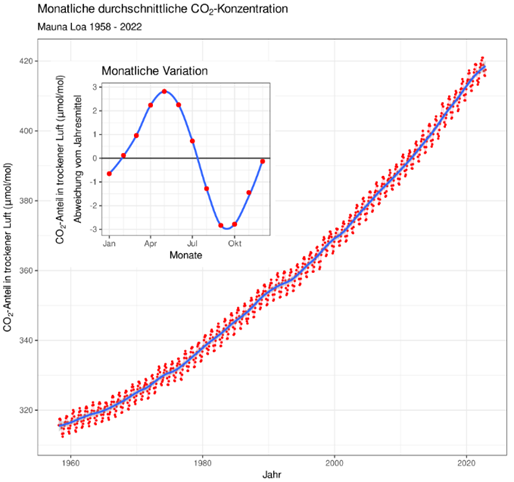

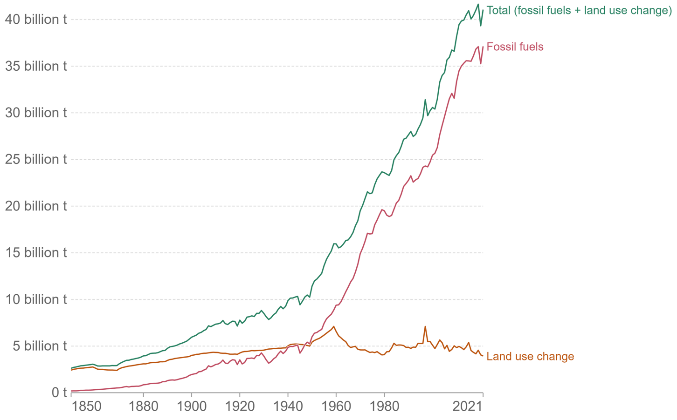

Abb. 2: Weltweite CO2-Emissionen 1850-2021 (Umrechnung: 7,8 billion (nach deutscher Benennung „Milliarde“) t CO2/a = 1 ppm CO2/a). Quelle: Hannah Ritchie, Max Roser and Pablo Rosado (2020) – „CO₂ and Greenhouse Gas Emissions“. Published online at OurWorldInData.org. Retrieved from: ‚https://ourworldindata.org/CO2-and-greenhouse-gas-emissions‘ [Online Resource]

Nach Abb. 1 betrug die CO2-Konzentration in der Atmosphäre im Jahr 1960 ca. 318 ppm und sie wuchs um ca. 0,7 ppm/a („freihändig“ in Abb. 1 im entsprechenden Punkt eine Tangente gelegt und deren Steigung herausgelesen), im Jahr 2020 waren es ca. 413 ppm bzw. ca. 2,5 ppm/a. In 60 Jahren ist die Zunahme der Konzentration also von ca. 0,7 ppm/a auf ca. 2,5 ppm/a angestiegen. Wenn man einen exponentiellen Anstieg unterstellt (die Kurve schaut recht gut danach aus), dann ist die Kurve jährlich um ca. 2,1 % steiler geworden.

Eigentlich müsste man für einen korrekten Vergleich bei den anthropogenen Freisetzungen das gleiche Zeitfenster betrachten. Die anthropogenen Freisetzungen sind aber in den letzten 10 Jahren deutlich abgeflacht, siehe Abb. 2. Zur konservativen Überprüfung der These betrachte ich daher lieber das steilere Wachsen davor. Dabei habe ich mich wenigstens für ein gleich langes Betrachtungsfenster entscheiden, auch, weil die Kurve gem. Abb. 2 von etwa 1950 an ziemlich gleichmäßig verläuft. 1950 betrugen die anthropogenen Freisetzungen ca. 1,54 ppm/a und sie nahmen jedes Jahr um ca. 0,048 ppm/a zu (Vorgehen analog wie oben, Umrechnung mit 1 ppm = 7,8 Gt CO2), 2010 waren es ca. 5,13 ppm/a bzw. ca. 0,085 ppm/a. In 60 Jahren ist der Zuwachs der anthropogenen Freisetzungen also von jährlich ca. 0,048 ppm/a auf jährlich ca. 0,085 ppm/a angestiegen. Wenn man wieder einen exponentiellen Anstieg unterstellt, ist die Kurve jährlich um ca. 0,95 % steiler geworden.

Vollständigkeit:

Die Kurve der Konzentration [ppm] ist also immer deutlich schneller angestiegen, als die Kurve der anthropogenen Freisetzungen [ppm/a], um ca. 2,1 %/a gegenüber ca. 0,95 %/a. Da mögen Ableseungenauigkeiten dabei sein, aber ein erheblicher Unterschied in der Steigung ist wohl unbestreitbar. Die Abb. 1 und 2 täuschen insofern, als der Maßstab beide Male so gewählt wurde, dass die jeweiligen Veränderungen möglichst deutlich sichtbar werden.

Aber genau genommen ist Abb. 2 ohnehin unvollständig, weil sie nur die anthropogenen Freisetzungen darstellt. Zu diesen kommen noch die Freisetzungen aus natürlichen Quellen hinzu. Im vorindustriellen Gleichgewicht betrugen diese nach IPCC etwa 80 ppm/a (bei einer Konzentration von ca. 280 ppm). Nach Meinung von IPCC ist dieses vorindustrielle Gleichgewicht prinzipiell bis heute unverändert geblieben und nur durch die anthropogenen Freisetzungen überlagert worden. Für die gesamten Freisetzungen ergibt sich daher nach IPCC eine um 80 ppm/a parallel nach oben verschobene Kurve. Die Steilheit der Kurve ändert sich dadurch natürlich nicht. Die gesamten Freisetzungen sind also von 1950 bis 2010 von 81,5 auf 85,1 ppm/a angestiegen und die Steilheit der Kurve hat von jährlich 0,048 ppm/a auf jährlich 0,085 ppm/a zugenommen, was einem Wachstum von 0,95 %/a entspricht.

Diskussion:

- Schneller Wachsen geht nicht?

Wie gezeigt, ist die Konzentration eindeutig viel schneller gewachsen, als auf Basis der IPCC-Annahme die (gesamten) Freisetzungen gewachsen sind. Das geht aber aus Gründen der Massenbilanz nicht, dafür langt der CO2-Nachschub nicht. Das hohe Wachstum der Konzentration kann daher nur zustande gekommen sein, indem eine zusätzliche Quelle ganz erheblich mitgeholfen hat, und diese zusätzliche Quelle muss ihrerseits auch stärker wachsen, als die anthropogenen Freisetzungen wachsen.

Was diese zusätzliche Quelle ist, kann so natürlich nicht gesagt werden, aber nach Lage der Dinge dürfte die allgemeine Erwärmung zumindest mit beigetragen haben. Z. B. Umlagerungen von Meeresströmungen mit unterschiedlichem C-Gehalt oder vulkanische Ausgasungen wären andere Möglichkeiten. Welches die zusätzliche Quelle ist, bedarf weiterer Forschungen, sicher scheint nur zu sein, dass es eine geben muss.

Nachsatz: Wenn mir irgendjemand ein realistisches Beispiel zeigt, bei dem die Konzentration im relevanten Bereich andauernd schneller wächst, als die Freisetzungen wachsen, dann will ich das gerne zurücknehmen. Bisher hat noch niemand so ein Beispiel vorgelegt.

2. Eine Senke ist keine Quelle!

Das wohl am häufigsten vorgebrachte Gegenargument ist, dass die anthropogenen Freisetzungen laufend etwa doppelt so viel CO2 freigesetzt haben, wie sich in der Atmosphäre angesammelt hat. Ozean und Biomasse waren daher immer Senke gewesen und eine Senke könne keine Quelle sein, wird gesagt. Das Argument übersieht aber, dass Ozean und Biomasse immer gleichzeitig Quelle und Senke sind. Und zwar mit Flüssen, die weit größer sind als die anthropogenen Freisetzungen. Es ist im Wesentlichen das Verhältnis dieser beiden natürlichen Flussgrößen zueinander, das den Verlauf der Konzentration bestimmt, der viel kleinere Beitrag der anthropogenen Freisetzungen läuft nur mit und kann das Ergebnis auch nur entsprechend wenig beeinflussen.

Nehmen wir einmal beispielhaft an, die Freisetzungen aus natürlichen Quellen sind im Laufe der Zeit um 35 ppm/a gestiegen, zusätzlich zum allmählichen Anstieg der anthropogenen Freisetzungen auf 5 ppm/a. Die gesamten Freisetzungen haben sich dann um 40 ppm/a erhöht, von 80 auf 120 ppm/a. Wenn sie auf diesem Niveau eingefroren werden, dann stellt sich ein neues Gleichgewicht ein, bei der Konzentration, bei der die Entnahmen auf ebenfalls 120 ppm/a angewachsen sind. Vorher hinken die Entnahmen noch etwas nach und Ozean und Biomasse wirken so lange netto als Senke. Genau so einen Zustand haben wir offensichtlich heute: Die Konzentration wächst um ca. 2,5 ppm/a, also sind die (gesamten) Entnahmen (noch) um ca. 2,5 ppm/a kleiner, als die (gesamten) Freisetzungen sind (117,5 gegenüber 120 ppm/a im genannten Beispiel). Zur Konzentrationserhöhung hat aber die Zunahme der Freisetzungen aus den natürlichen Quellen 10-mal mehr beigetragen, als die anthropogenen Freisetzungen beigetragen haben!

Natürlich war die Annahme der Erhöhung der Freisetzungen aus natürlichen Quellen um 35 ppm/a zunächst einmal ein fiktives Beispiel, diese Freisetzungen können wir ja nicht messen. Messen können wir nur die Konzentration. Und die ist eindeutig um ca. 50 % angestiegen. Daraus können wir aber abschätzen, dass die Entnahmen auch um fast 50 % (das wären 40 ppm/a) gewachsen sein müssen, „fast“ 50 %, weil wir nicht ganz im Gleichgewicht sind. Nehmen wir diesen Abstand zum Gleichgewicht mit 2,5 ppm/a an, dann sind die Entnahmen heute (noch) nicht um 40 ppm/a größer als sie früher waren, sondern sie sind nur um 37,5 ppm/a größer. Und aus diesem Wert kann man dann ausrechnen, wie hoch die (gesamten) Freisetzungen heute sein müssen, damit die Konzentration um gerade 2,5 ppm/a wachsen kann: Sie müssen um 40 ppm/a gewachsen sein. Bei 5 ppm/a anthropogenen Freisetzungen ergibt das die oben getroffene Auswahl von 35 ppm/a für die Zunahme der Freisetzungen aus natürlichen Quellen.

Ergänzend sei noch angemerkt, dass das derzeitige Wachsen der Konzentration um ca. 2,5 ppm/a nur bedeutet, dass die gesamten Freisetzungen um 2,5 ppm/a größer sind als die gesamten Entnahmen. Diese Differenz kann mit einer unendlichen Anzahl von Zahlenpaaren erreicht werden. IPCC wählt aufgrund der Annahme, dass nur die anthropogenen Freisetzungen hinzugekommen sind, das Zahlenpaar 85 und 82,5 aus, die hier vorgestellten physikalischen Überlegungen sprechen für das Zahlenpaar 120 und 117,5.

Zur Klarstellung: Wäre der gleiche Anstieg der (gesamten) Freisetzungen ausschließlich aus entsprechend stärkeren natürlichen Quellen zustande gekommen, dann hätte das klarerweise am Ergebnis nichts geändert (die einen CO2-Moleküle sind so gut wie die anderen!). Wären demgegenüber die Freisetzungen aus den natürlichen Quellen die gleichen gewesen, aber alleine, also ohne ergänzende anthropogene Freisetzungen, dann wäre die Konzentration etwas langsamer gestiegen und damit wäre auch die Entnahme etwas langsamer gewachsen. Viel hätte sich aber nicht geändert. Die anthropogenen Freisetzungen spielen eben nur eine untergeordnete Rolle, bestimmend sind die Freisetzungen aus den natürlichen Quellen.

3. Von wegen Ansammeln der Hälfte der Freisetzungen in der Atmosphäre

IPCC meint, dass die Hälfte der anthropogenen Freisetzungen sich in der Atmosphäre ansammelt. Diese Interpretation des Geschehens kann aber schon deswegen nicht stimmen, weil die anthropogenen Freisetzungen sich nicht anders verhalten können, als die Freisetzungen aus natürlichen Quellen. Würde sich von den einen die Hälfte in der Atmosphäre ansammeln, müsste sich auch von den anderen die Hälfte in der Atmosphäre ansammeln. Das ist aber eindeutig nicht der Fall. Tatsächlich sammelt sich von nichts die Hälfte in der Atmosphäre an, sondern es sammelt sich nur ein ganz kleiner Teil von den gesamten Freisetzungen an, und auch das nur solange, wie die gesamten Freisetzungen größer sind als die gesamten Entnahmen. Sind beide gleich groß, sammelt sich nichts an, auch wenn ein Teil der Freisetzungen aus anthropogenen Quellen stammt.

4. Proportionalität

Die Entnahme von CO2 aus der Atmosphäre erfolgt im Wesentlichen durch zwei Prozesse: Verbrauch von CO2 durch Photosynthese von Pflanzen und Lösung von CO2 im Ozeanwasser. In beiden Fällen ist der eigentliche Vorgang die Diffusion von CO2-Molekülen aus der Atmosphäre in ein anderes Speichermedium. Solche Diffusionsvorgänge verlaufen in der Physik prinzipiell proportional zur Konzentration.

Erklärung: Üblicherweise wird bei der Diffusion der netto-Fluss durch die Trennfläche hindurch angegeben und es wird gesagt, dass dieser netto-Fluss proportional zur Partialdruckdifferenz ist. Den absoluten Fluss in einer Richtung erhält man, indem man in der Formel für den netto-Fluss den Partialdruck auf der anderen Seite mit null annimmt: Dann wird aus dem „proportional zur Partialdruckdifferenz“ ein „proportional zum Partialdruck“. Ist die Partialdruckdifferenz null, ist der netto-Fluss auch null, die beiden Teilflüsse hin und zurück können jedoch sehr hoch sein, vor allem aber sind sie (zumindest angenähert, siehe gleich) proportional zur Konzentration.

Proportionalität gilt also grundsätzlich. In beiden Fällen (Entnahme durch Biomasse und durch Ozean) gibt es jedoch auch störende Einflüsse, sodass die Proportionalität real wahrscheinlich nur angenähert gilt. Das Pflanzenwachstum etwa hängt nicht nur vom CO2 ab, sondern auch z. B. von der Wasser- und Nährstoffverfügbarkeit. Pflanzen wachsen aber vor allem dort stark (und entnehmen daher auch dort viel CO2 aus der Atmosphäre!), wo es diesbezüglich keine Einschränkungen gibt (außerdem gilt Proportionalität zur Konzentration wahrscheinlich auch dort, wo Wasser- und/oder Nährstoffmangel das Wachstum klein halten, das weiß ich aber nicht genau, lassen wir das daher mal außen vor, es genügt angenäherte Proportionalität). Beim Ozeanwasser ist vor allem zu beachten, dass sich in ihm gelöstes CO2 größtenteils in andere chemische Verbindungen umwandelt (hauptsächlich in Karbonat und Bikarbonat, das ist der sogenannte „Revelle-Effekt“), die nichts zum CO2-Patialdruck beitragen. Aber das beeinflusst vor allem die wirksame Größe als Speicher (nur deswegen kann der Ozean überhaupt so viel CO2 aufnehmen!) und nur relativ wenig die Austauschraten (Begründung: Der Revelle-Faktor ändert sich im relevanten Bereich nur wenig mit der Konzentration). Insgesamt sollte die Proportionalität daher zumindest angenähert sehr wohl gelten.

Wichtig ist auch noch, dass beide Entnahmeprozesse (in die Biomasse und ins Wasser) voneinander unabhängig sind und dass es zum Aufrechterhalten der hier verteidigten These genügen würde, wenn auch nur einer der beiden Prozesse (angenähert) proportional zur Konzentration verläuft. Das würde schon reichen, eine zusätzliche Quelle unentbehrlich zu machen. Dass in beiden Überlegungen zur Proportionalität ein gravierender Fehler enthalten ist, ist sehr unwahrscheinlich.

5. Die antreibende Kraft und die Zeitkonstante

Vielfach wird argumentiert, dass das vorindustrielle Gleichgewicht immer unverändert gültig wäre und die Atmosphäre bei Beendigung der anthropogenen Freisetzungen zu diesem Zustand zurückkehren würde. Die Rückstellkraft hierfür wäre die aktuelle Überschusskonzentration über die 280 ppm aus dem vorindustriellen Gleichgewicht hinaus. Bei der aktuellen Konzentration von ca. 420 ppm wären das dann ca. 140 ppm. Aus diesen ca. 140 ppm Rückstellkraft, und aus der derzeitigen Netto-CO2-Aufnahme durch Ozean und Biomasse von ca. 2,5 ppm/a, wird eine Zeitkonstante von ca. 50 Jahren für die Abnahme der CO2-Konzentration nach Einstellung der anthropogenen Freisetzungen errechnet.

Das ist mathematisch korrekt gerechnet, physikalisch aber unbegründet. Es resultiert aus der Grundannahme, dass nur die anthropogenen Freisetzungen als einzige Veränderung eingetreten sind. Das aber ist physikalisch nicht haltbar. Erstens, weil die Atmosphäre gar kein Gedächtnis für dieses alte Gleichgewicht hat. Sie kennt nur die derzeitigen Randbedingungen und richtet ihr Gleichgewicht nach diesen aus. Und zweitens könnte eine rücktreibende Kraft von 140 ppm nur zustande kommen durch extreme Veränderungen, wie z. B. eine sprungförmige Erhöhung der Konzentration um 140 ppm. Bei den langsam laufenden realen Änderungen der Konzentration, bei der hohen Austauschrate zwischen der Atmosphäre und ihren Senken, und bei der Zunahme der Entnahme mit wachsender Konzentration, ist ein solch enormer Abstand vom (aktuellen!) Gleichgewicht aber völlig ausgeschlossen. Wenn die anthropogenen Freisetzungen beendet werden, dann ändert sich nicht viel, weil die davon nicht betroffenen Freisetzungen aus natürlichen Quellen weiterhin das Geschehen dominieren.

Das alte Gleichgewicht gibt es nicht mehr. Die Überschusskonzentration über das, bei den aktuellen Randbedingungen aktuell gültige Gleichgewicht hinaus, ist die heute gültige Antriebskraft für die netto-Entnahme (also mit Gegenrechnung der gleichzeitigen Freisetzung), die Antriebskraft für die absolute Entnahme (ohne Gegenrechnung der gleichzeitigen Freisetzung) ist immer die absolute Konzentration. In vielen Diskussionen wird das nicht ausreichend sauber auseinandergehalten.

6. Ansammeln durch systematisches Nachhinken

Vielfach wird argumentiert, die 140 ppm antreibende Kraft wären eine Folge davon, dass laufend mehr CO2 eingespeist wird als entnommen werden kann, der Überschuss hätte sich also infolge Überforderung der Senken allmählich bis auf 140 ppm aufgebaut. Dem widersprechen aber die saisonalen Schwankungen der Konzentration (Abb. 1): Die kommen zustande, weil die Pflanzen (überwiegend in der Nordhemisphäre mit ihrem größeren Landanteil) in der Wachstumsphase Frühjahr und Sommer viel CO2 entnehmen, das sie im Herbst und Winter dann wieder durch Verrotten zurückgeben. Wenn die Senken bei jeder „Hintergrundkonzentration“ ein halbes Jahr lang mehr aufnehmen können, dann sind sie nicht am Ende ihrer Leistungsfähigkeit! Sie bauen dann nicht nur die saisonalen Spitzen wieder ab, sondern sie würden auch jede sich aufbauende Überschusskonzentration abbauen.

7. So einen Zufall kann es gar nicht geben!

Doch, kann es sehr wohl! Gemeint ist der Zufall, dass die verstärkten Freisetzungen aus natürlichen Quellen die ganze Zeit über in einer ganz bestimmten Weise hätten wachsen müssen, damit der Anstieg der Konzentration immer im Ausmaß der Hälfte der anthropogenen Freisetzungen geschieht. So einen Zufall über so lange Zeit könne man sicher ausschließen, wird gesagt. Aber erstens würde genau das Gleiche für jedes sich konkret einstellende Ergebnis gelten. Wären die gesamten Freisetzungen nicht um konstant 50 % der anthropogenen Freisetzungen größer als die gesamten Entnahmen gewesen, sondern hätte es irgendeinen anderen Verlauf geben, dann wäre dieser im genau gleichen Ausmaß unwahrscheinlich, wie der eingetretene Verlauf. Welcher Verlauf auch immer sich einstellt, als konkreter Wert ist er sehr unwahrscheinlich, aber einen Verlauf muss es geben. Beispiel: Wenn ich am Strand einen beliebigen Kieselstein aufhebe, dann ist die Wahrscheinlichkeit, dass es gerade ein ganz bestimmter Kieselstein ist, beliebig klein, egal, welchen ich aufhebe. Aber in der Hand habe ich trotzdem einen, allen (Un)Wahrscheinlichkeiten zum Trotz.

Zweitens stimmt das mit der geringen Wahrscheinlichkeit ohnehin nicht so ganz, denn wenn man genauer hinschaut, dann sind Freisetzungen und Entnahmen nicht unabhängig voneinander, sondern es besteht sehr wohl ein Zusammenhang zwischen ihnen: Über die Konzentration, die wächst mit den Freisetzungen und mit ihr wachsen die Entnahmen. Weiters: Wenn die Freisetzungen aus natürlichen Quellen stark gewachsen sind, dann sind sie mit hoher Wahrscheinlichkeit zumindest angenähert exponentiell angewachsen, bei natürlich ablaufenden Prozessen ist das meistens so. Angenähert exponentiell gewachsen sind aber auch die anthropogenen Freisetzungen, wenn auch auf viel kleinerem Niveau. Das Verhältnis zwischen den beiden Größen muss daher immer in etwa das gleiche gewesen sein. Und da die Konzentration mit den (gesamten) Freisetzungen wächst und da die (gesamten) Entnahmen immer etwas nachhinken, umso mehr, je steiler die Freisetzungen wachsen, und da dieses Nachhinken die Differenz zwischen Freisetzungen und Entnahmen ausmacht (also das Wachsen der Konzentration), ist es gerade kein Zufall, dass die Konzentration immer um den gleichen Prozentsatz der anthropogenen Freisetzungen wächst. Nur, dass es gerade etwa 50 % sind, das ist Zufall, es könnte genauso gut auch ein anderer Prozentsatz sein (welcher, hängt vor allem davon ab, wie schnell die Freisetzungen wachsen). Ein fester Prozentsatz ist vom Ablauf her jedoch gut erklärbar.

8. Kreisflüsse und Senkenflüsse

Zum Wachsen der Konzentration und dessen Ursachen gehört auch die Diskussion über Kreisflüsse und Senkenflüsse (die einen gehen durch die Atmosphäre hindurch, die anderen aus der Atmosphäre heraus, wie das innerhalb der Atmosphäre zu unterscheiden ist, habe ich nie so richtig verstanden). Vielfach wird gesagt, Kreisflüsse wären eben schnell, aber ohne Einfluss auf die Konzentration, während Senkenflüsse demgegenüber langsam wären und die Konzentration reduzieren würden. Aber auch das widerspricht der Physik: Alle CO2-Moleküle sind gleich und in der Atmosphäre werden alle Zuflüsse durch Wind und Wetter gut durchmischt. Es gibt daher nur einen Fluss durch die Atmosphäre hindurch. Dieser einheitliche Fluss kann sich allenfalls außerhalb der Atmosphäre in verschiedene Teilflüsse aufteilen, die teils per Rückführung zum Kreis geschlossen sein können (mit unterschiedlichen Umlaufzeiten), oder auch nicht, die Atmosphäre weiß das gar nicht. Sie kennt nur Eintrag, Mischung und Konzentration, und ihren Austrag richtet sie nach der Konzentration. Innerhalb von ihr ist, wie gesagt, alles ein gemeinsamer Fluss, ohne herkunftsabhängige Unterteilung. Alle Quellen tragen entsprechend ihrer jeweiligen Stärke zur Mischung in der Atmosphäre bei und alle Senken entnehmen nur aus dieser guten Durchmischung. Eine herkunftsabhängige Sonderbehandlung bestimmter CO2-Mengen ist nicht möglich und ein überproportionaler Beitrag einer bestimmten Quelle (zur Konzentration und zu allem, was von der Konzentration abhängt) ist ausgeschlossen! 5 % anthropogene Freisetzungen können daher nur 5 % zur Konzentration beitragen!

Als Beispiel für einen „Kreisfluss“ wird immer wieder die Entnahme von Wasser aus einem Behälter mittels einer Pumpe mit Wiedereinspeisen der gleichen Menge genannt. So ein Kreislauf hat trivialerweise keinen Einfluss auf den Wasserstand im Behälter. Aber in der Physik der Atmosphäre gibt es keine Entnahme mit einem konstant laufenden oder sonstwie von außen gesteuertem Motor. Was auch immer der Atmosphäre entnommen wird (absolut, nicht netto!), das hängt von den Randbedingungen innerhalb der Atmosphäre ab und ändert sich mit diesen, insbesondere mit der Konzentration.

Zur Klarstellung: Das alles gilt, weil die Entnahme konzentrationsabhängig ist. Hält man die Entnahme irgendwie konstant (wie eine konstante Pumpe), dann erhöht jede zusätzliche Freisetzung, auch die kleinste, die Konzentration im vollen Umfang. Eine Erhöhung der Konzentration um die Hälfte einer bestimmten Freisetzung ist entweder rein zufällig, oder systematisch könnte es sie nur dann geben, wenn alle Senken zusammengenommen gerade gleich viel CO2 speicherten wie die Atmosphäre (dann verteilte sich das CO2 eben zu gleichen Teilen auf die Atmosphäre und auf die Senken). Das „zusammen gleich groß“ trifft aber für die direkt mit der Atmosphäre wechselwirkenden Senken Biomasse und oberflächennahen Ozeanschicht nicht zu und mit Einbeziehen der indirekt wechselwirkenden Senke „tiefer Ozean“ trifft es schon gar nicht zu. Einen physikalischen Prozess, bei dem immer die Hälfte der anthropogenen Freisetzungen in der Atmosphäre verbleibt, unabhängig von der Höhe dieser Freisetzungen und unabhängig von der schon erreichten Konzentration, hat noch niemand angeben können (jedenfalls habe ich keinen gefunden).

9. Die letzten 10 Jahre

Wie schon kurz erwähnt und aus Abb. 2 ersichtlich, haben sich die anthropogenen CO2-Freisetzungen in den letzten 10 Jahren deutlich abgeflacht. Man kann das immerhin als wenigstens bescheidenen Erfolg der Bemühungen zur CO2-Eindämmung ansehen. Nur hat das nichts gebracht, die Konzentration ist völlig ungebremst weitergestiegen (Abb. 1). Ein klares Zeichen dafür, dass die anthropogenen Freisetzungen nicht die bestimmende Größe für die Konzentration sind. Denn wären sie es, dann hätte sich deren Anstieg ebenfalls abflachen müssen! Hat er aber nicht!

Abb. 2 zeigt auch deutlich einen echten Einbruch in den anthropogenen Freisetzungen im Jahr 2020. Zurückzuführen ist der auf die Lockdown-Maßnahmen infolge der Corona-Pandemie. In der Spitze sind die anthropogenen Freisetzungen immerhin um 17 % zurück gegangen. Wären sie die bestimmende Größe für die Konzentration, müsste man dort auch eine entsprechende Delle sehen! Sieht man aber nicht!

10. Drei Stufen

Das Geschehen nach einer Freisetzung von CO2 in die Atmosphäre kann man in drei Stufen einteilen: Die erste betrachtet nur das Geschehen in der Atmosphäre alleine. Das hatten wir schon, die Atmosphäre wird durch Wind und Wetter sehr schnell und effektiv durchmischt, sodass sie dann nur mehr als Ganzes reagieren kann.

Für das Weitere müssen wir zuerst den Ozean unterteilen: in die oberflächennahe Schicht (ca. 50 bis 100 m dick, durch Wind und Wellen gut durchmischt, sonnendurchschienen, daher findet hier auch Photosynthese statt, intensiver CO2-Austausch mit der Atmosphäre einerseits und mit dem tiefen Ozean andererseits) und den tiefen Ozean (alles darunter, riesengroß, schlecht durchmischt, Austauschvorgänge auch stark von Meeresströmungen abhängig).

Stufe 2 ist die Verteilung des CO2 aus der Atmosphäre auch auf die beiden Speicher terrestrische Biomasse und oberflächennahe Ozeanschicht unter Ausklammerung der Wechselwirkungen mit dem tiefen Ozean. Das wichtigste Charakteristikum in dieser Stufe 2 ist der sehr intensive und konzentrationsabhängige CO2-Austausch zwischen den Partnern: Jährlich wird etwa ein Viertel des CO2-Inventars der Atmosphäre ausgetauscht! Es wird daher immer sehr schnell (innerhalb weniger Jahre) Gleichgewicht erreicht, bzw. es laufen Transienten immer sehr nahe am Gleichgewicht ab. Einzelheiten zu diesen Austauschvorgänge hatten wir schon, insbesondre die Proportionalität der Flüsse zur Konzentration.

Wichtig ist aber auch noch die relativ kleine Größe der Biomasse und der oberflächennahe Ozeanschicht. Dadurch steigt in diesen die Konzentration relativ schnell an, wenn sie CO2 aus der Atmosphäre entnehmen. Infolge der höheren Konzentration in ihnen steigt dann auch die Rückgabe aus ihnen zurück in die Atmosphäre an. Das ist dann zwar eine Folge der anthropogenen Freisetzungen, aber es ist trotzdem eine Freisetzung in die Atmosphäre aus natürlichen Quellen und alle oben gemachten Aussagen zur Atmosphäre und zu Quellen und Senken bleiben mit diesem Verständnis voll gültig. Sie gelten sinngemäß aber auch für die Speicher Atmosphäre, Biomasse und oberflächennahe Ozeanschicht als untereinander gut durchmischte Einheit. Auch diese Einheit unterliegt den gleichen Gesetzen, wie die Atmosphäre isoliert betrachtet.

Stufe 3 ist dann die Weitergabe von Kohlenstoff aus der oberflächennahen Ozeanschicht (und damit indirekt auch aus der Atmosphäre und über diese gekoppelt auch aus der terrestrischen Biomasse) in den tiefen Ozean. Auch da gelten prinzipiell die gleichen Gesetze, insbesondere die Proportionalität der Flüsse zur Konzentration, nur hat dieser „tiefe Ozean“ eine Besonderheit: Er ist riesengroß und in ihm herrschen so langsame Strömungen, dass die Rückgabe aus ihm in die oberflächennahe Schicht (und dann aus dieser auch zurück in die Atmosphäre) um ca. 500 bis 1000 Jahre verzögert erfolgt (und auch dann auf jeden Fall nur stark abgeschwächt erfolgt, der meiste Kohlenstoff verbleibt im tiefen Ozean). In diesen 500 bis 1000 Jahren ist zwar die Einlagerung in den tiefen Ozean als Folge steigender Konzentration in der Atmosphäre erhöht, nicht aber die Rückgabe aus ihm. In der Zeit wirkt der tiefe Ozean daher netto als äußerst kräftige Senke (und auch anschließend ist er noch eine sehr große Senke). Diese äußerst kräftige Senke verhindert, dass relativ kleine Freisetzungen in die Atmosphäre zu einer erheblichen Konzentrationszunahme führen können. Die in Stufe 2 als Rückkopplung auf die erhöhte Konzentration in der Atmosphäre erfolgende erhöhte Freisetzung aus natürlichen Quellen (die dort jedenfalls einen Teil der zusätzlich erforderlichen Quelle erklären kann, im Extremfall sogar alles) funktioniert beim tiefen Ozean erst in 500 bis 1000 Jahren (und auch dann nur wesentlich schwächer ausgeprägt)! Bis dahin gibt es keine Reaktion aus dem tiefen Ozean. Neben den anderen oben angestellten Betrachtungen ist es letztlich diese Besonderheit des tiefen Ozeans, die zwingend und unabänderlich eine von den anthropogenen Freisetzungen entkoppelte zusätzliche erhebliche Freisetzung fordert. Die kann zwar auch aus dem tiefen Ozean kommen, nur eben nicht als Reaktion auf die anthropogenen Freisetzungen, sie muss vielmehr durch irgendetwas anderes verursacht sein.

Fazit:

Natürlich kann irgendwo noch ein versteckter Fehler vorhanden sein, der alles über den Haufen wirft. Aber die Sachlage scheint sehr klar und durch vielfache Argumente auch sehr gut abgesichert zu sein: Die eingangs aufgestellte These stimmt höchstwahrscheinlich! Nach bestmöglicher Beurteilung ist die IPCC-Erklärung für das Zustandekommen der hohen CO2-Konzentration in der Atmosphäre als ausschließliche Folge der anthropogenen Freisetzungen nicht haltbar, weil nach den Regeln der Physik keine Quelle überproportional zur Konzentration in der Atmosphäre beitragen kann. Die hohe Konzentration kann deshalb nur durch eine stake und auch stark wachsende zusätzliche Quelle als Hauptverursacher zustande gekommen sein. Eine solche Quelle ist jedenfalls voll mit der Physik verträglich. Mehr noch: Die Physik scheint sie unabdingbar zu fordern!

Es gibt daher nur noch 2 Möglichkeiten: Entweder wird das Klima von natürlich freigesetztem CO2 bestimmt, oder gar nicht von CO2, sondern von ganz anderen Einflussgrößen! In beiden Fällen macht eine Reduzierung der anthropogenen Freisetzungen keinen Sinn, jedenfalls nicht aus Klimagesichtspunkten. Das Klimaproblem muss deshalb völlig neu durchdacht werden. Höchste Priorität sollte dabei eine nochmalige Überprüfung der Herkunft des vielen CO2 in der Atmosphäre haben, doch sollte das auch als Anlass genommen werden, gleich auch noch andere noch offene Fragen zum Klima zu klären, siehe z. B. /6/.

Literatur

/1/ IPCC, AR 6, 2021: Climate Change 2021: The Physical Science Basis. Contribution of Working Group I to the Sixth Assessment Report of the Intergovernmental Panel on Climate Change [Masson-Delmotte, V., P. Zhai, A. Pirani, S.L. Connors, C. Péan, S. Berger, N. Caud, Y. Chen, L. Goldfarb, M.I. Gomis, M. Huang, K. Leitzell, E. Lonnoy, J.B.R. Matthews, T.K. Maycock, T. Waterfield, O. Yelekçi, R. Yu, and B. Zhou (eds.)]. Cambridge University Press, Cambridge, United Kingdom and New York, NY, USA, 2391 pp. doi:10.1017/9781009157896.

/2/ Hermann Harde: “What Humans Contribute to Atmospheric CO2: Comparison of Carbon Cycle Models with Observations”, Earth Sciences, Vol. 8, No. 3, 2019, pp. 139–159. doi: 10.11648/j.earth.20190803.13.

/3/ Peter Stallinga: „Residence Time vs. Adjustment Time of Carbon Dioxide in the Atmosphere“, Entropy 2023, 25(2), 384; https://doi.org/10.3390/e25020384.

/4/ Edwin X Berry: “Human CO2-Emissions Have Little Effect on Atmospheric CO2”, International Journal of Atmospheric and Oceanic Sciences, Vol. 3, No. 1, 2019, pp. 13–26; doi: 10.11648/j.ijaos.20190301.13.

/5/ Eike Roth: „Das große Klimarätsel: Woher kommt das viele CO2?“ BoD-Verlag Norderstedt 2022, ISBN 978-3-7562-2033-5, als E-Book 978-3-7562-5347-0.

/6/ Eike Roth: „Probleme beim Klimaproblem – Ein Mythos zerbricht“, BoD-Verlag Norderstedt 2019, ISBN 978-3-7481-8275-7, als E-Book 978-3-7494-0328-8.