Frühlingsverlauf: Ein weiterer Beweis gegen die These einer Treibhausgas-Erwärmung

Der Frühling wird in der Gegenwart nicht wärmer; vor allem die Nächte werden kälter

Josef Kowatsch, Matthias Baritz, Raimund Leistenschneider

Hinweis: Der Artikel ist komplex und er wird zeigen, dass nicht nur bei den Temperaturen, sondern auch bei den Niederschlägen große Ungereimtheiten bei den Angaben des DWD bestehen. Außerdem werden die tatsächlichen Einflussfaktoren auf die Temperaturen dargelegt. Eine ausführliche Zusammenfassung ist am Schluss zu finden.

Bei der Hypothese einer sog. menschengemachten Erwärmung durch Treibhausgase sind folgende Grundforderungen die Basis:

- Kohlendioxid (und andere THG) allein bestimmt die Temperaturen

- Weil Kohlendioxid ständig steigt, steigen auch die Temperaturen

- Wegen der steigenden Frühlingstemperaturen verfrüht sich die Vegetation

- Je höher der atmosphärische CO₂-Gehalt, umso wärmer wird es und noch wärmer soll es werden

Wir zeigen in diesem Artikel, dass kein Punkt davon einer Überprüfung standhält. Dabei verwenden wir die Originaltemperaturdaten des Deutschen Wetterdienstes.

Die Jahreszeit Frühling besteht aus den Monaten März/April/Mai. Diese Monatsschnitte zusammen ergeben den Frühling eines bestimmten Jahres.

Als Messzeitraum betrachten wir die Jahre 1988 bis heute, das sind 36 Frühlinge und die Gegenwart, von 2000 bis heute.

1988 deshalb, weil damals ein Temperatursprung auf ein höheres Temperaturniveau in Mitteleuropa erfolgte, und weil seit 1988 der sog. Weltklimarat und dann das PIK Potsdam die ständig fortsetzende CO₂-Erderwärmung postulierten, die inzwischen zur Klimapanikerzeugung gesteigert wurde. Nahezu täglich wird Angst verbreitet.

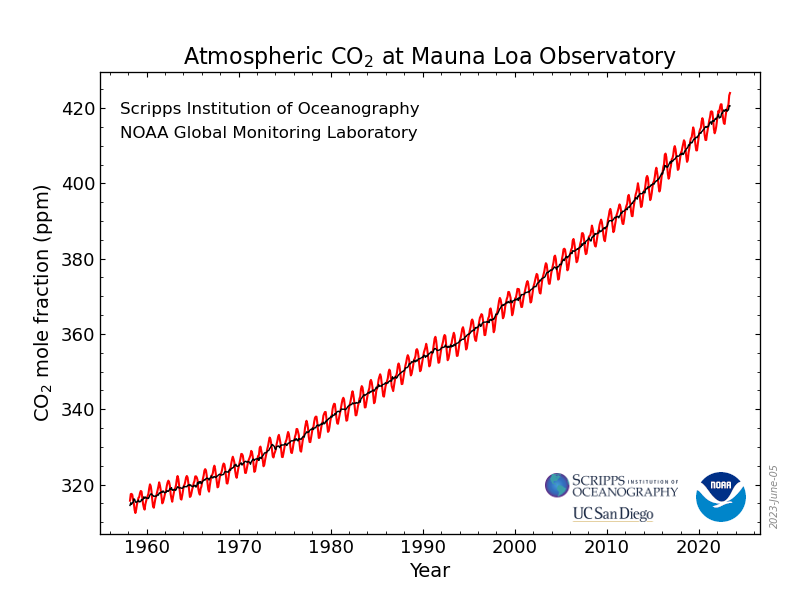

Die folgende Grafik der steigenden CO₂-Konzentrationen scheint Punkt 2 der obigen Behauptungen zu bestätigen, Grafik vom 5. Juni 2023

Grafik 1: Aktueller atmosphärischer CO₂-Pegel, Anfang Juni 2023, gemessen auf dem Mauna Loa. 424 ppm, seit 1988 ein Anstieg um deutlich über 70 ppm. In der Gegenwart verläuft der CO₂-Anstieg in der Atmosphäre immer steiler. Im letzten Jahr um 3 ppm.

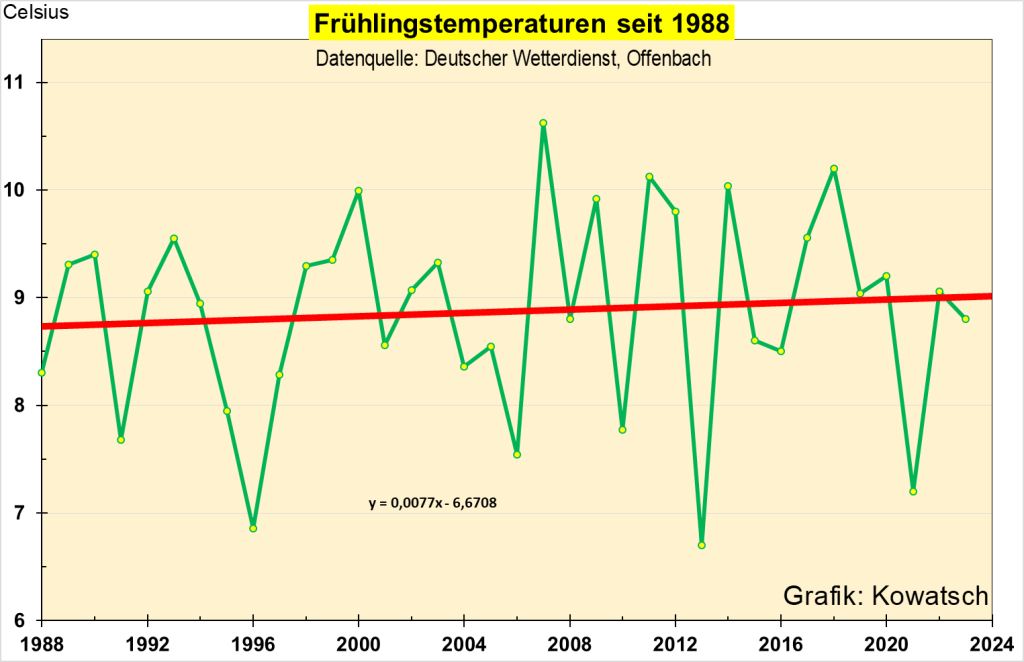

Dazu im Vergleich die deutschen Frühlingstemperaturen, laut Daten des Deutschen Wetterdienstes.

Grafik 2: Wir verwenden die Originaltemperaturdaten des Deutschen Wetterdienstes und stellen fest: Die Frühlingstemperaturen sind bei den Wetterstationen des DWD nur völlig unbedeutend gestiegen.

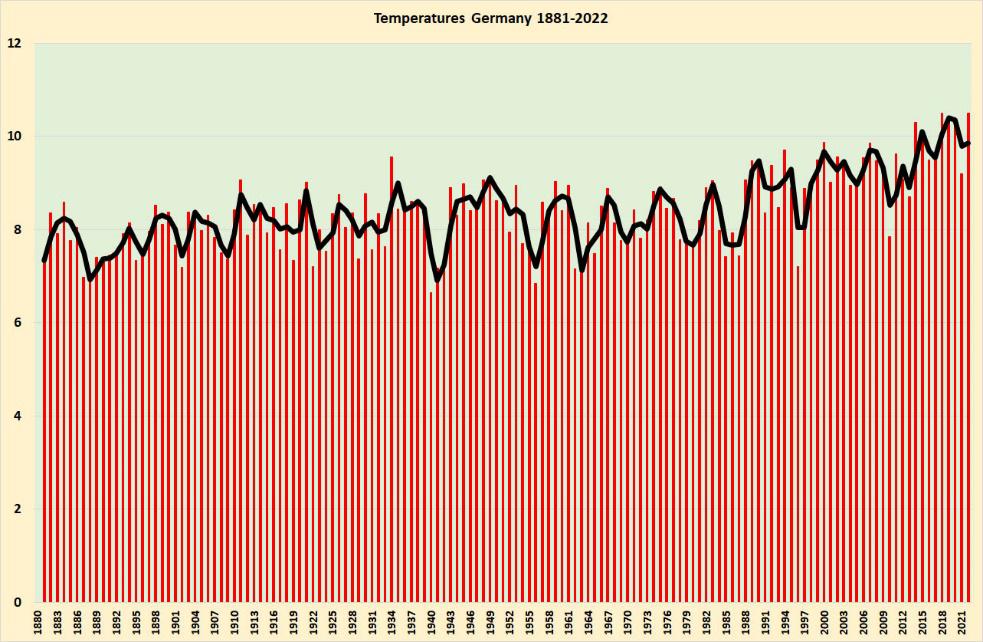

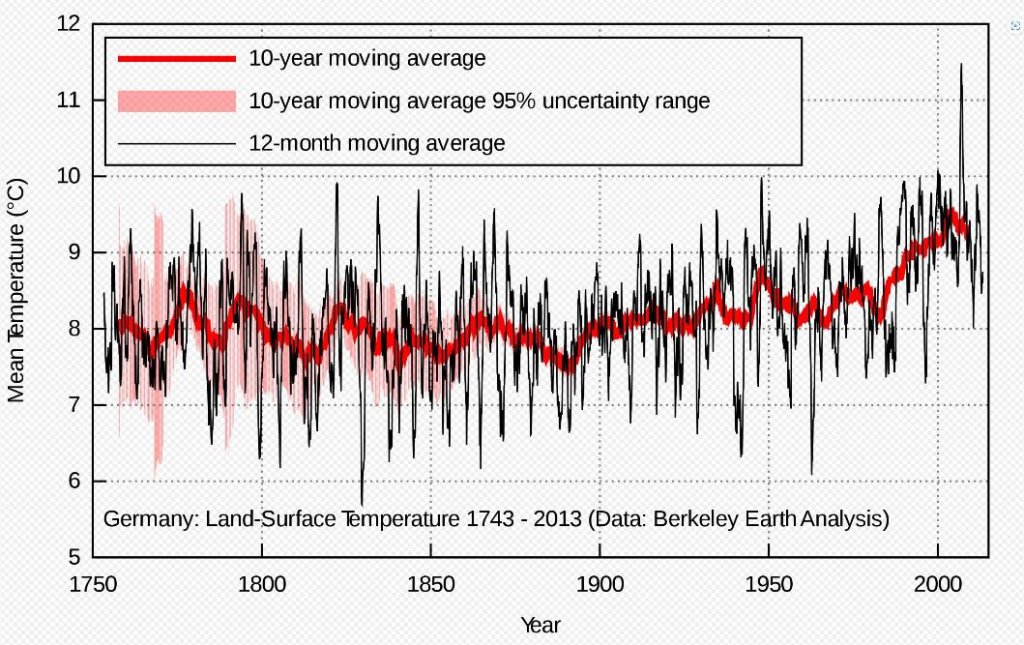

Da das kleine Deutschland natürlich nicht maßgebend ist, schauen wir daher auf die globalen Temperaturen.

Grafik 3, Quelle: (https://www.climate4you.com/), zeigt die globalen Temperaturabweichungen aus Satellitensicht, bis zum 15.05.2023. Obwohl der CO₂-Pegel in Grafik 1 immer schneller ansteigt, stagnieren seit knapp 10 Jahren die Temperaturen: Es wird nicht mehr wärmer!

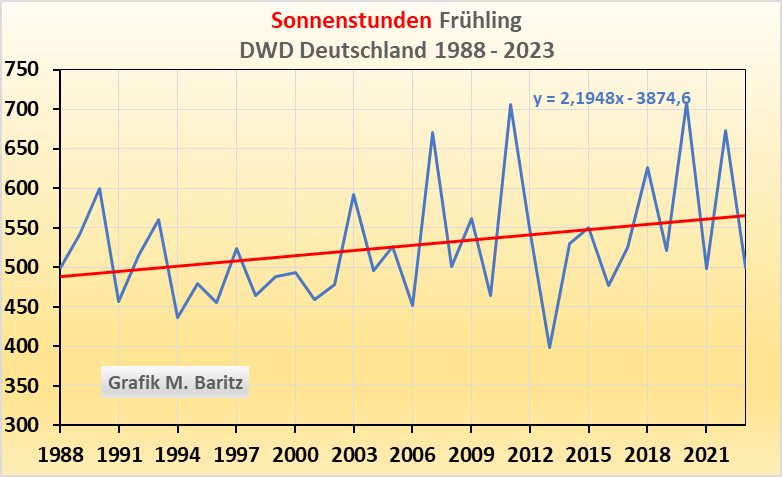

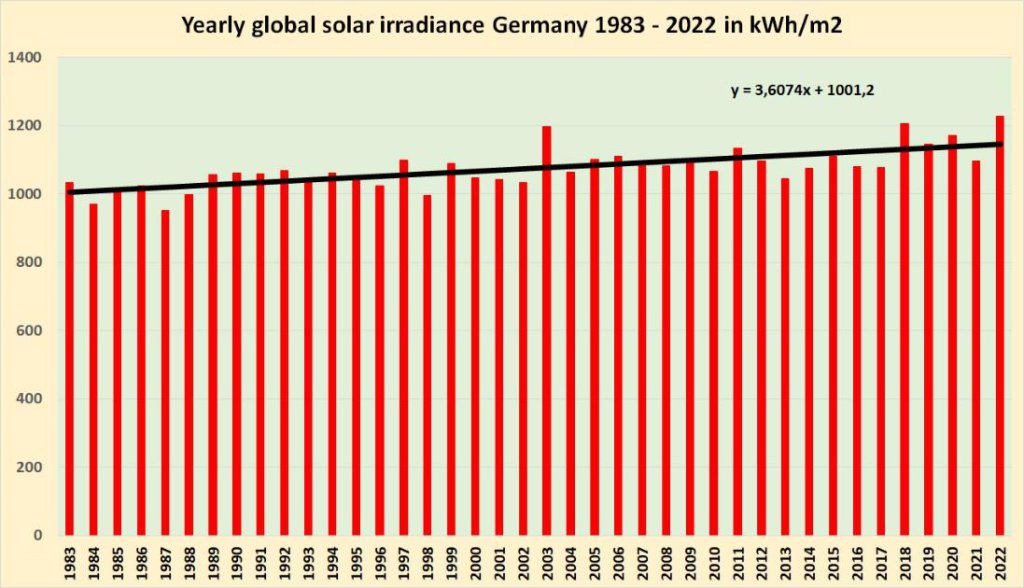

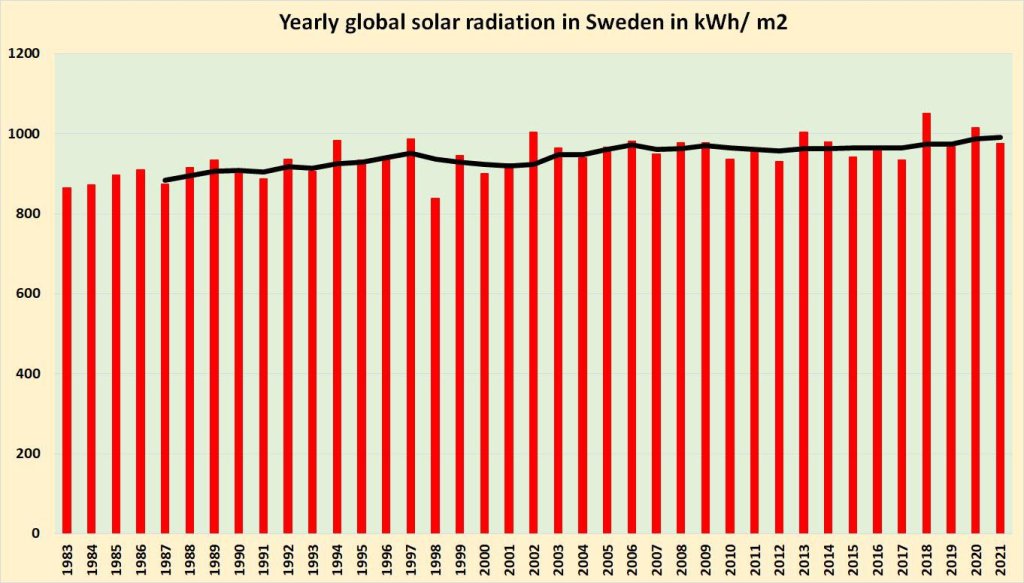

Doch zurück zu Deutschland. In Anbetracht dessen, dass die Sonnenstunden bei den DWD-Stationen, laut DWD, deutlich zugenommen haben und die DWD-Stationen bevorzugt in Wärmeinseln stehen, drängt sich förmlich eine andere Erklärung für die leichte Erwärmung in Deutschland auf. Dazu später mehr.

Grafik 4: Auch trotz deutlicher Zunahme der Sonnenstunden sind die vom DWD erhobenen Frühlingstemperaturen bei seinen Wetterstationen seit 1988 nicht mehr nennenswert gestiegen.

Eine weitere Behauptung der CO₂-Klimagläubigenkirche ist: In der Gegenwart soll sich die Erwärmung beschleunigt haben. Das wird uns täglich durch die gleichgeschaltete Qualitätspresse versucht einzureden. Dem PIK Potsdam, dem DWD und mittels der Politik, vor allem den Grünen. Die Autoren sind grundsätzlich skeptisch, wenn bei einem Billionengeschäft, wie dem Klimawandel (man betrachte nur die Gelder, die dabei fließen und natürlich von uns, den Bürgern, bezahlt werden müssen) sog. „Wahrheiten“ unters Volk gebracht werden.

Anhand Grafik 1 steigt die CO₂-Konzentration in der Atmosphäre seit der Jahrtausendwende immer schneller. Und wie sieht es bei den Temperaturen aus?

Die Temperaturen des Frühlings in der Gegenwart

Als Gegenwartszeitraum dienen uns die 24 Frühlinge seit 2000, ab denen sich der CO₂-Anstieg immer mehr beschleunigt haben soll.

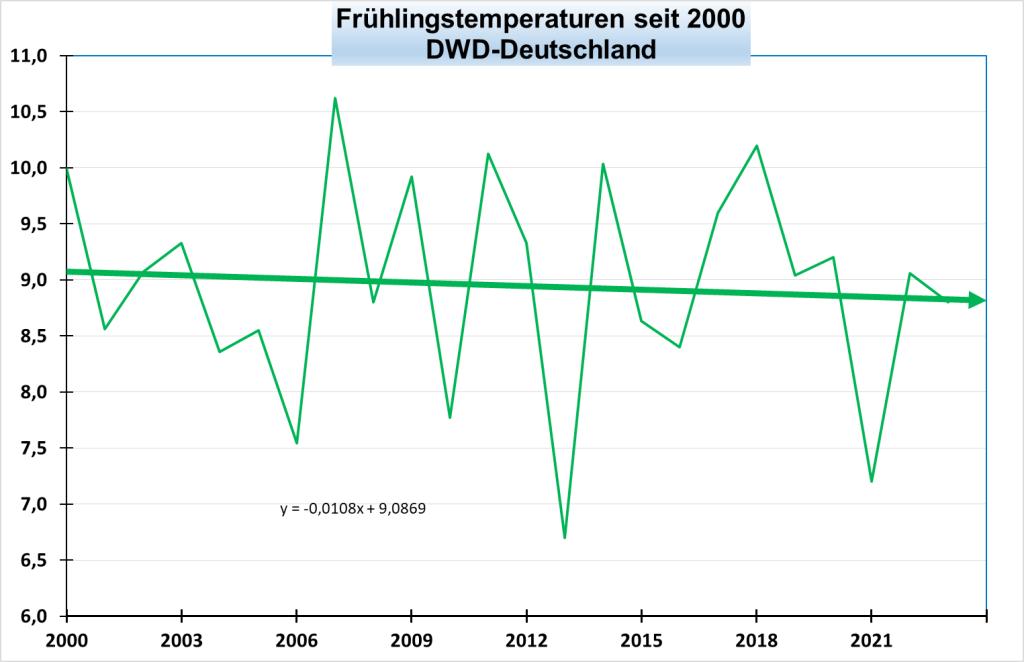

Grafik 5: In der Gegenwart, also seit 2000 zeigen die DWD-Wetterstationen einen leicht negativen Steigungsverlauf der gemittelten Durchschnittstemperaturen. Also einen abnehmenden Temperaturverlauf.

Ergebnis: In der Gegenwart wird der Frühling, laut DWD-Wetterstationen, kälter und nicht, wie behauptet, wärmer.

Dem Leser ist bestimmt schon aufgefallen, dass die Autoren von DWD-Wetterstationen sprechen und von den DWD-Temperaturen. Man muss als Leser wissen, dass der DWD seine Daten aus immer wärmer gemachten Wetterstationen erhebt, um die (Frühlings-)Abkühlung zu verschleiern. Zum einen, weil er Wetterstationen zum Gesamtschnitt hinzufügt, die in wärmeren Regionen stehen und Stationen in der Höhe ausscheidet, wie jüngst Mittenwald auf 1000m NN. Zum anderen werden die DWD-Stationen aber auch deshalb wärmer, weil sich die Bebauung, Flächenversiegelung und Trockenlegung Deutschlands ungebremst fortsetzt. Am besten zeigt das der Flächenversiegelungszähler. Stand bei Redaktionsschluss: 50 709 km² (Quelle).

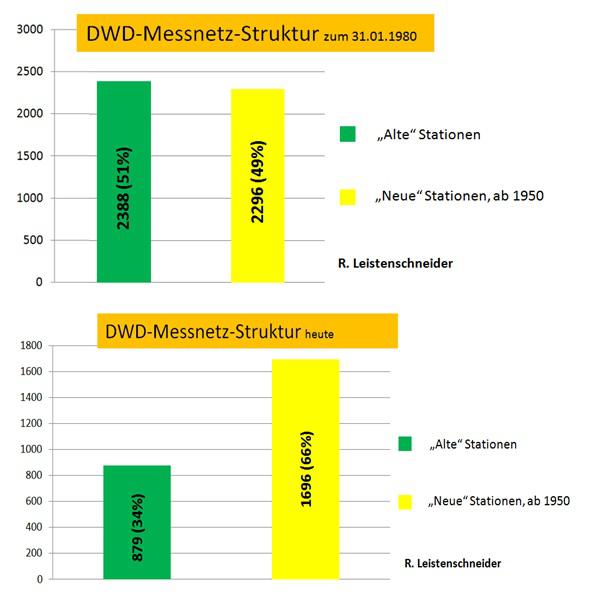

Anmerkung: Ein weiterer raffinierter Trick des DWD ist die Verringerung seiner Messstationen. Dadurch wird mathematisch den wärmeren Stationen ein höheres statistisches Gewicht zugeordnet. Wodurch das Mittel wärmer wird, obwohl sich an den Temperaturen selbst gar nichts ändert. So etwas nennt man im Volksmund „Äpfel mit Birnen vergleichen“. Auch dazu später mehr.

Diese ständige wärmende Landschafts-Veränderung wird in der Wissenschaft mit Wärmeinselerwärmung (WI) bezeichnet. Man darf sie nicht mit der CO₂-Konzentrationszunahme verwechseln.

Merke: Ein Großteil aller DWD-Wetterstationen steht in den Wärmeinseln, also in den 15% der Deutschlandfläche, die der Flächenversiegelungszähler anzeigt oder in unmittelbarer Umgebung.

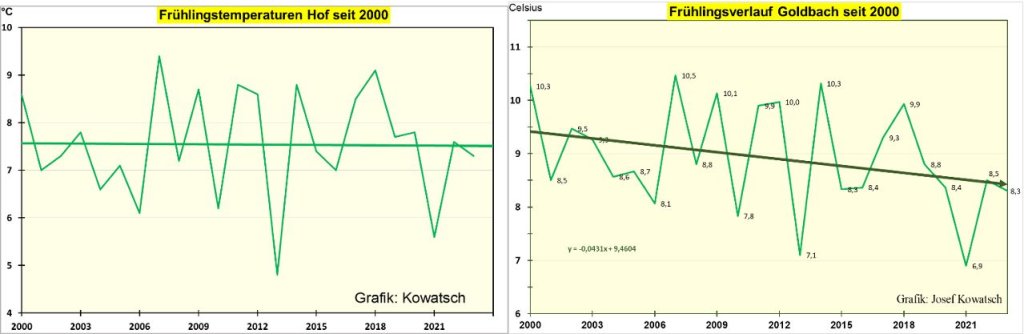

Wie groß diese Wärmeinselzusatzerwärmung sein kann, zeigen wir in folgender Grafik, mit den Wetterstationen Goldbach in der Lausitz und Hof, durch Gegenüberstellung.

Die Wetterstation Hof wird in ein Gewerbegebiet „eingemauert“ und Goldbach blieb unverändert.

Grafik 6a/b: Die DWD-Wetterstation Hof zeigt in der Gegenwart im Vergleich zu Grafik 5 keine Frühlingsabkühlung, weil sie durch Baumaßnahmen ständig zusätzlich erwärmt wird. Die von solchen Rahmenbedingungen unbeeinflusste Wetterstation Goldbach, zeigt den unbeeinflussten Temperaturverlauf.

Merke: In der freien Fläche Deutschlands und in kleinen Weilern, die sich baulich nicht verändert haben, wurde die Jahreszeit Frühling in der Gegenwart deutlich kälter.

Gute Naturbeobachter haben das längst an der Vegetationsverspätung in der freien Landschaft festgestellt. So zeigt selbst der Forsythienstrauch in der Hamburger Innenstadt an der Alster seit 40 Jahren, also seit 1984 eine ebene Trendlinie. Das ist für uns nicht verwunderlich, denn Hamburg ist zwar eine riesige Wärmeinsel und der Strauch blüht sehr früh im Jahr, oftmals vier Wochen früher als die Forsythien in der freien Natur, aber seit 40 Jahren hat sich an der Alster baulich kaum mehr was verändert. Die Wärmeinselumgebung blieb in etwa gleich.

„Ich glaube nur der Statistik, die ich selbst gefälscht habe“ oder, wie der DWD*1) sich seine Wahrheiten zurecht biegt.

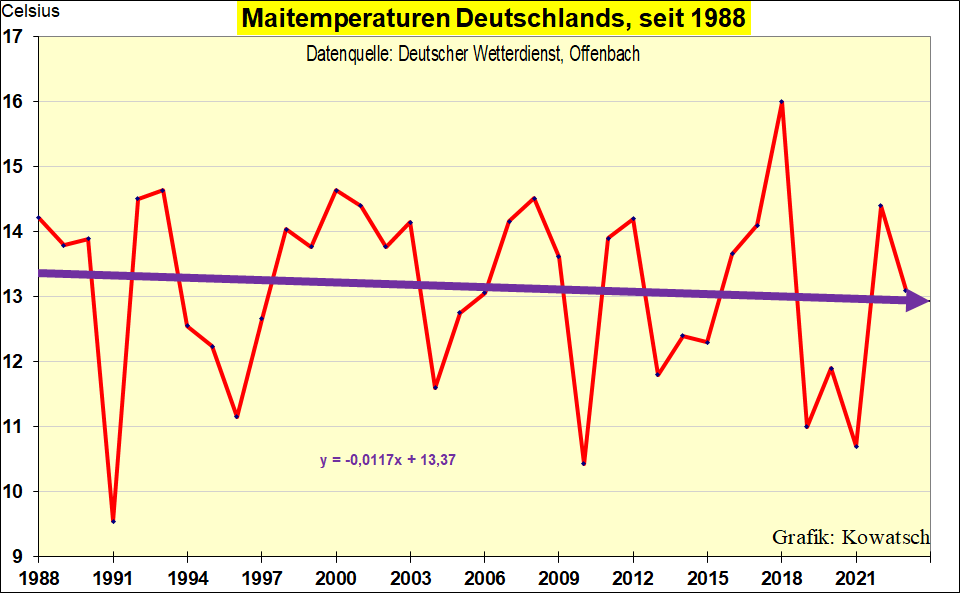

Den ersten Teil des Satzes kennt sicher jeder. Dazu passt die Aussage des DWD zu den Maitemperaturen 2023. Laut DWD war der Mai 2023 etwas wärmer als der Durchschnitt. Also der Durchschnitt des internationalen klimatologischen Referenzzeitraumes von 1991 – 2020.

*1) Wenn die Autoren vom DWD schreiben, dann meinen sie nicht die vielen dortigen Meteorologen und Wissenschaftler, die jeden Tag akribisch ihrer Tätigkeit nachgehen, um verwertbare Ergebnisse zu liefern, sondern die dortige Führungsmannschaft, die nicht müde wird, sich und damit ihre Behörde und natürlich den Bundesverkehrsminister – der DWD ist eine Behörde im Bundesverkehrsministerium – mit unsoliden und unwissenschaftlichen Aussagen lächerlich zu machen, siehe hier oder hier.

Der DWD hat damit nicht etwa etwas Falsches behauptet, sondern „nur“ etwas, das ins Bild einer angeblichen Klimakatastrophe passt: Wärmer und wärmer. Wird hingegen linear (Grafik 7) und nicht digital betrachtet, so ist festzustellen: Nanu, es wird ja gar nicht wärmer, sondern kälter. Aber so etwas passt halt nicht ins Bild einer angeblichen Klimakatastrophe, mit der wir Bürger immer mehr und mehr zur Kasse gebeten werden (Heizungsdiktat und vieles mehr) und wie das dumme Schlachtvieh, sollen wir darüber auch noch „Sieg Heil“ – Entschuldigung – rufen, siehe hier.

Grafik 7 zeigt nach DWD-Daten den Maiverlauf in Deutschland seit Beginn der Klima-Hype des IPCC. In der freien Fläche ist die Abkühlung noch deutlicher.

Nichts von einer Erwärmung zu sehen! Und dass, obwohl der DWD in drastischer Weise sein Messnetz, hin zu wärmeren Stationen, verändert.

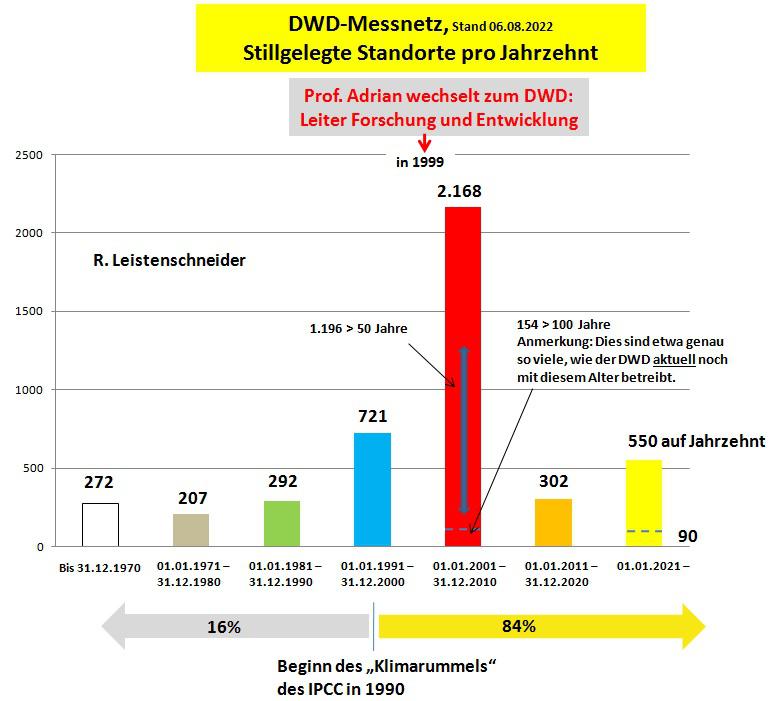

Grafik 8, Datenquelle: Deutscher Wetterdienst (DWD), zeigt, wie sehr der DWD sein Messnetz in den Jahren kurz vor Beginn der Klimahype zu heute drastisch verändert hat und dadurch nichts mehr mit dem von früher zu tun hat: Irgendwelche Klima-Vergleiche also unwissenschaftlich sind.

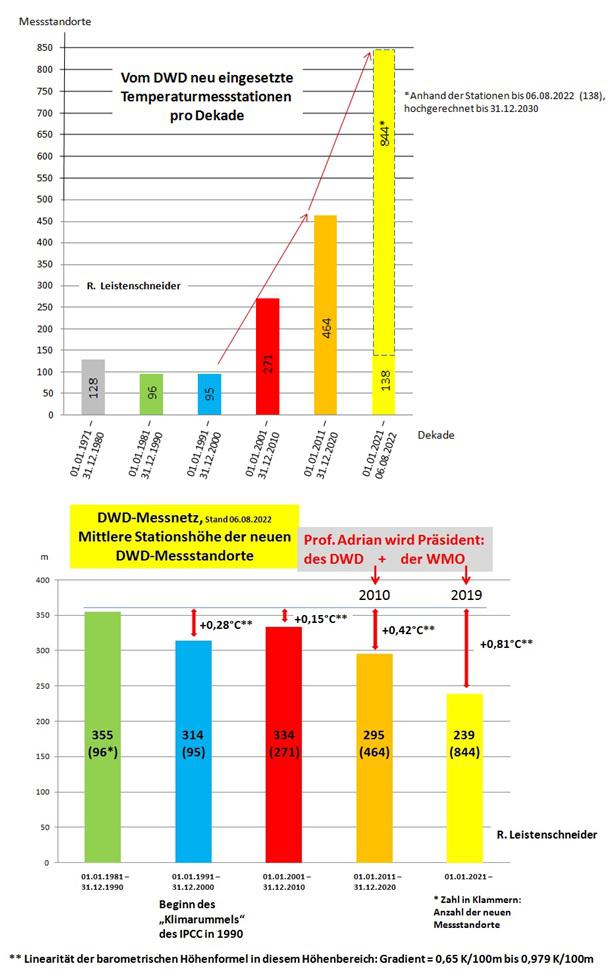

Vor der Klimahype (Grafik 8 oben) hatte der DWD noch ein ausgeglichenes Messnetz von „alten“ und „neuen“ Messstationen. Heute trifft dies nicht mehr zu. Es findet eine starke Veränderung hin zu neu aufgenommenen und wärmeren Messstandorten statt (Grafik 9 bis 11). Auch die Anzahl der Stationen wurde drastisch reduziert, was statistisch zur Folge hat, dass neuere und damit wärmere Stationen in der Gesamtheit ein größeres Gewicht bekommen. Daher auch die Anspielung auf die „Binsenweisheit“: „Ich glaube nur der Statistik, die ich selbst gefälscht habe“.

Die Änderungen des DWD-Messnetzes zeigt die nächste Grafik.

Grafik 9, Datenquelle DWD, zeigt, dass just zum Beginn der Klimahype des IPCC in 1990 (First Assessment Report), der DWD sein Messnetz drastisch verändert und Messstationen stilllegt.

Allein in den 1990-Jahren fast so viele, wie in 100 Jahren zuvor, um dann in den 2000er-Jahren, als der jetzige DWD- und WMO-Präsident (seit 2019), das dazu im DWD führende Amt übernimmt, nochmals galoppierend zunimmt.

Dies zeigt Grafik 10.

Grafik 10, Datenquelle ebenfalls DWD, zeigt oben die Hinzunahme neuer Messstandorte und unten, wie sich deren Höhe und dadurch deren Messergebnis verändert, obwohl sich an den Gegebenheiten (z.B. Temperaturen) selbst gar nichts verändert hat. Grafik 11 zeigt das gewünschte Ergebnis.

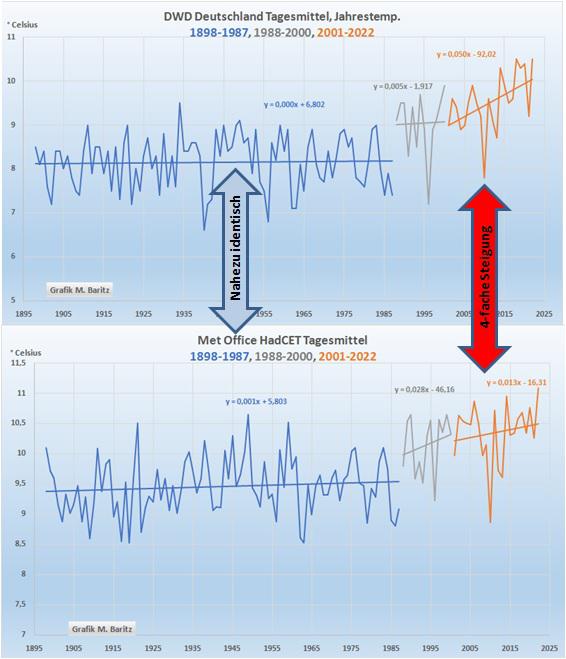

Grafik 11, Datenquelle DWD (oben) und Hadley Center (unten) zeigt, wie in Deutschland plötzlich, just mit Durchstarten der Klimahype und „Erscheinen“ des jetzigen DWD-und WMO-Präsidenten beim DWD, also den Standortmanipulationen des DWD, die Temperaturen, im Vergleich zu ländlichen Gebieten in England, sprunghaft steigen! Ein Schelm, der Böses dabei denkt.

Anmerkung: Im Zeitraum von 1988 – 2000 steigen die Temperaturen in Deutschland im Vergleich langsamer. Dies ist dem Kaltjahr 1996 geschuldet, dessen Auswirkungen auf der Insel abgemildert wurden und damit die Steigung dort stärker ist.

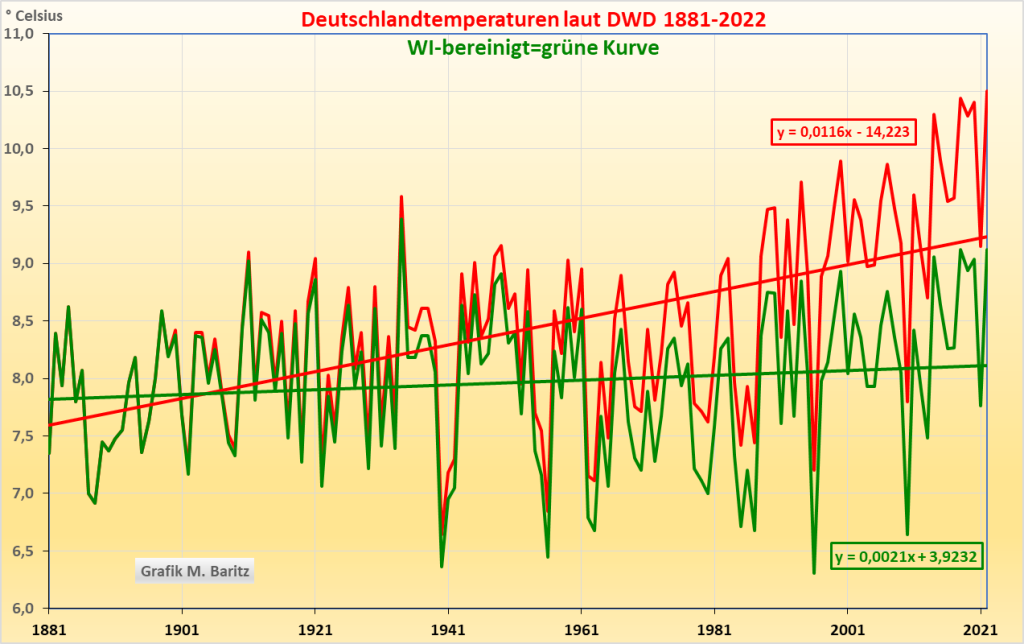

Ohne diese Manipulationen sähe der reale Temperaturverlauf in Deutschland, der verblüffend dem globalen Temperaturverlauf der letzten Jahrzehnte in Grafik 3 gleicht, so aus:

Grafik 12, Quelle: M. Baritz nach Daten des DWD (rote Kurve) und die WI-bereinigte Kurve (grün)*2) nach Leistenschneider.

*2) Der Autor hat vor ca. 10 Jahren, anhand der Vergleichsbetrachtung der Jahrestemperaturdatenreihe der DWD-Referenzmessstation Hohenpeißenberg zu der Datenreihe der DWD-Deutschland-Jahrestemperaturen, auf mathematische Weise, deren theoretische Überlegungen auf den Strahlungsgesetzen nach Planck und dem Abkühlungsgesetz nach Newton beruhen (ob man so vorgehen darf) und anhand von Steigungsvergleichen beider Messreihen (wo „Sprünge“ zu finden sind), ermittelt, dass die vom DWD herausgegebenen Jahresmittelwerte der Temperatur für Deutschland um +0,9°C bis +1,2°C zu hoch sind.

Zu „Sprünge“ der Fachmann, Prof. Malberg, FU, Met Inst.:

„Die Verlagerung von Klimastationen an neue Standorte führt in der Regel zu sprunghaften Änderungen der Klimawerte. Wird die neue Station nicht auf bisherige Messreihe (oder umgekehrt) mittels vieljähriger Parallelbeobachtungen reduziert, so kann der Bruch so groß sein, dass die Klimareihe für die Analyse des langfristigen Klimawandels unbrauchbar wird.“

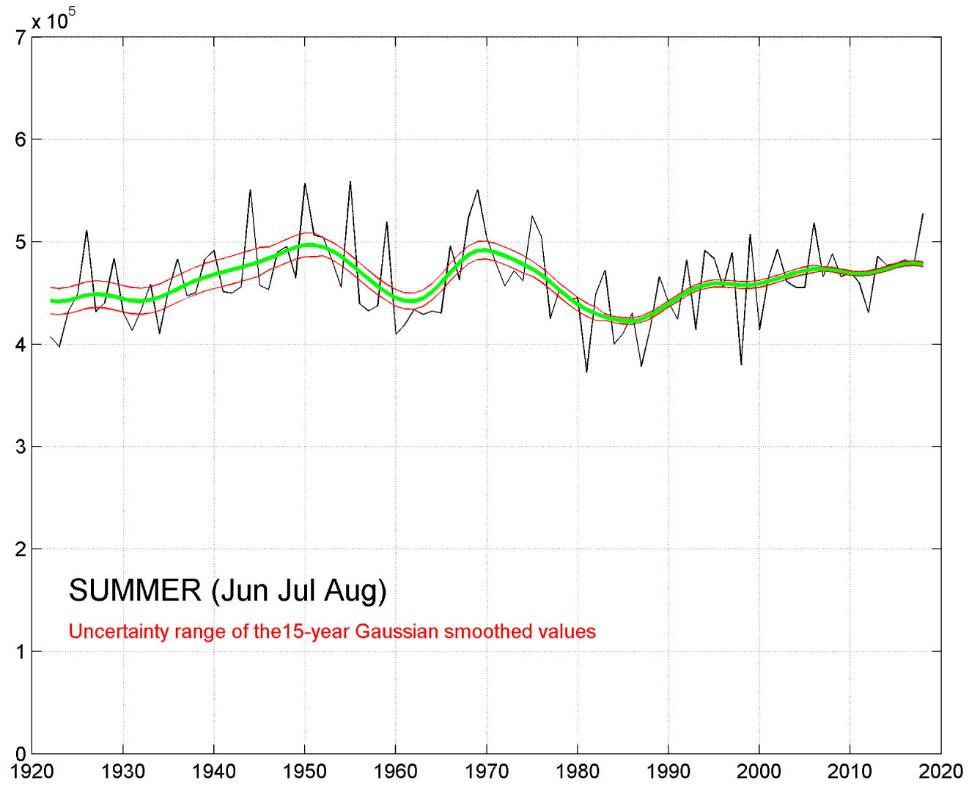

Frühling in Deutschland: Deutlich kälter wurden vor allem die Nächte.

Leider bietet der DWD für seine rund 2500 Wetterstationen keine Daten an. Es gibt also keine Tmax/Tmin Deutschlanddaten über einen längeren Zeitraum. Das ist auch nicht möglich, angesichts des ständigen Stationstausches. Viele neue Stationen kamen hinzu, deren Aufzeichnungszeitraum vglw. kurz ist. Jedoch von Einzelstationen liegen Daten vor. Wir haben weit über 30 ausgewertet und zeigen eine Reihe, verteilt über Deutschland.

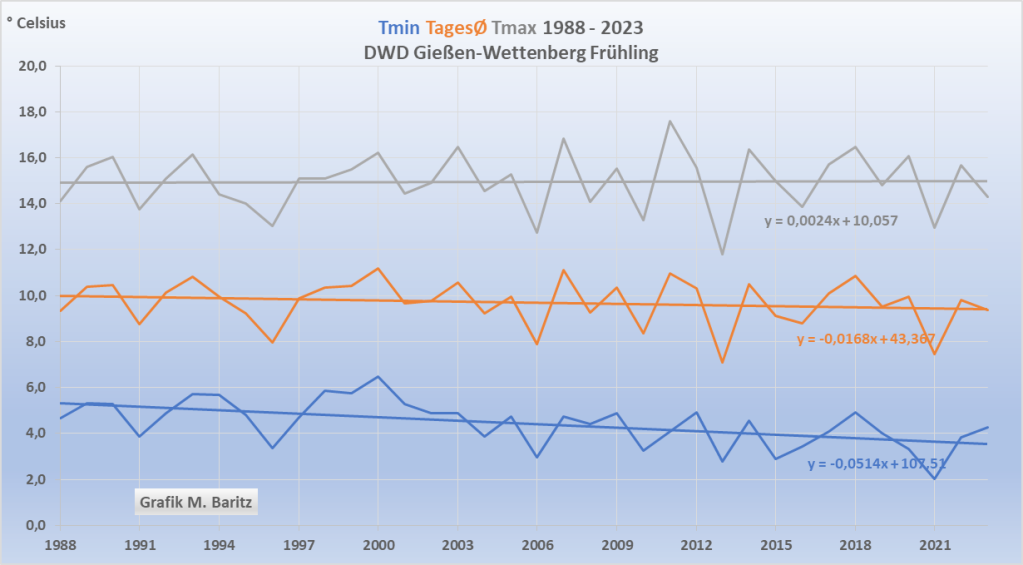

DWD-Wetterstation Gießen-Wettenberg

Grafik 13a: Die Wetterstation war zuerst am östlichen Stadtrand, vor ca. 16 Jahren wurde sie nach Westen, in die freie Fläche, verlegt. Bitte die Differenz zwischen Tag – ganz oben – und den Nachttemperaturen – ganz unten – beachten.

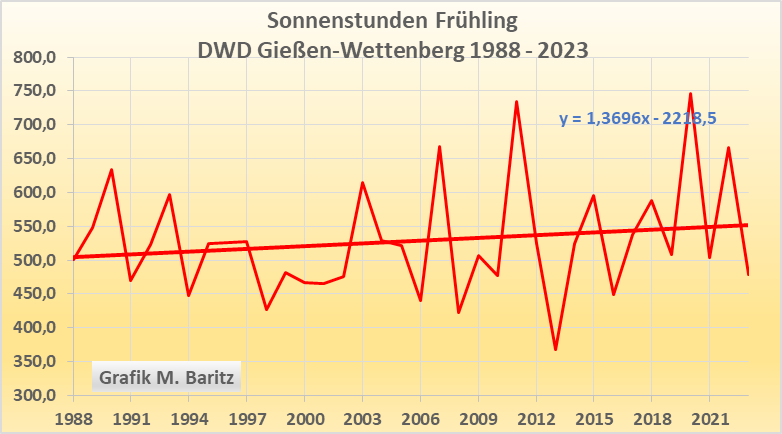

Wichtig sind dabei die Sonnenstunden im Betrachtungszeitraum.

Grafik 13b: Die Sonne erwärmt nur am Tage, deshalb werden die Nächte kälter. Das gilt für alle weiteren Stationen.

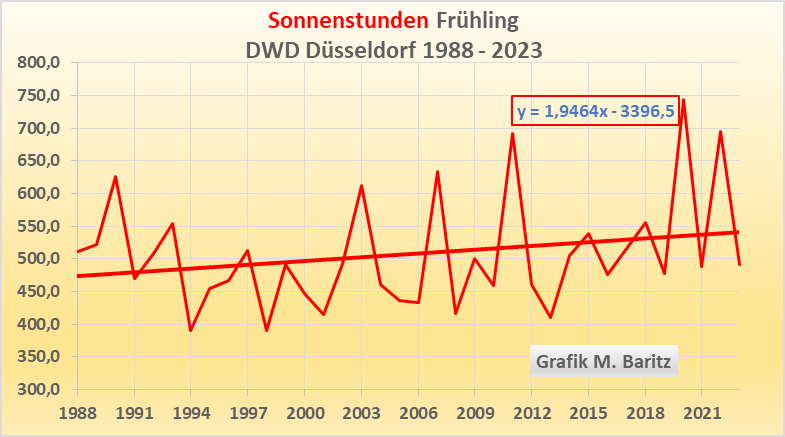

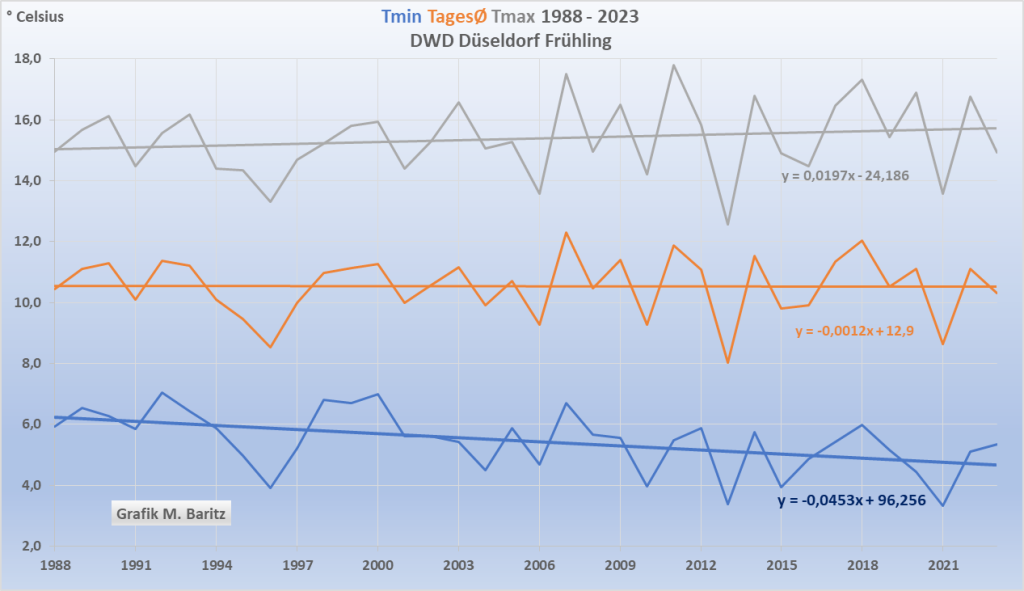

DWD Wetterstation Düsseldorf, seit 1988

Grafiken 14a/b: Zunahme der Sonnenscheindauer über 10% seit 1988. Daher findet eine Erwärmung auch nur tagsüber statt.

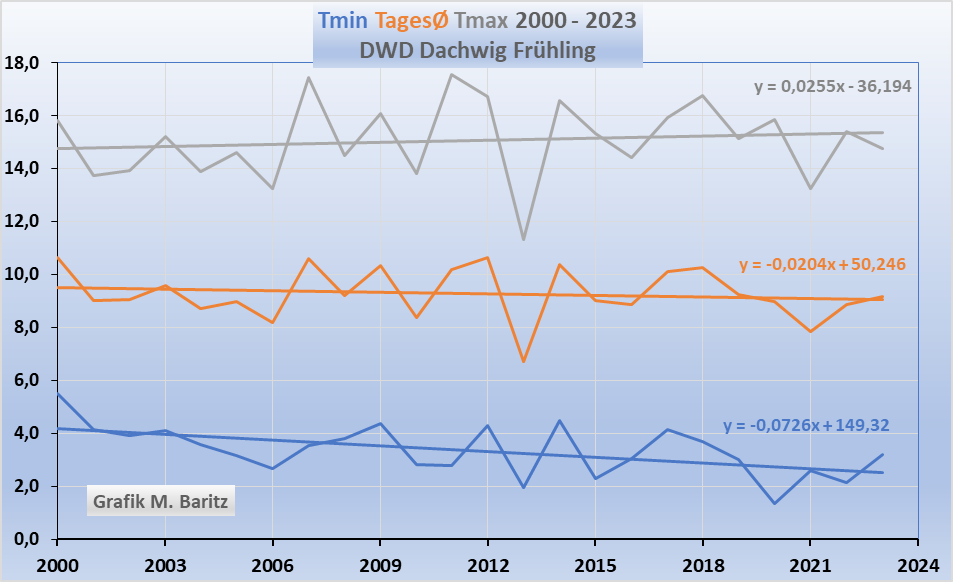

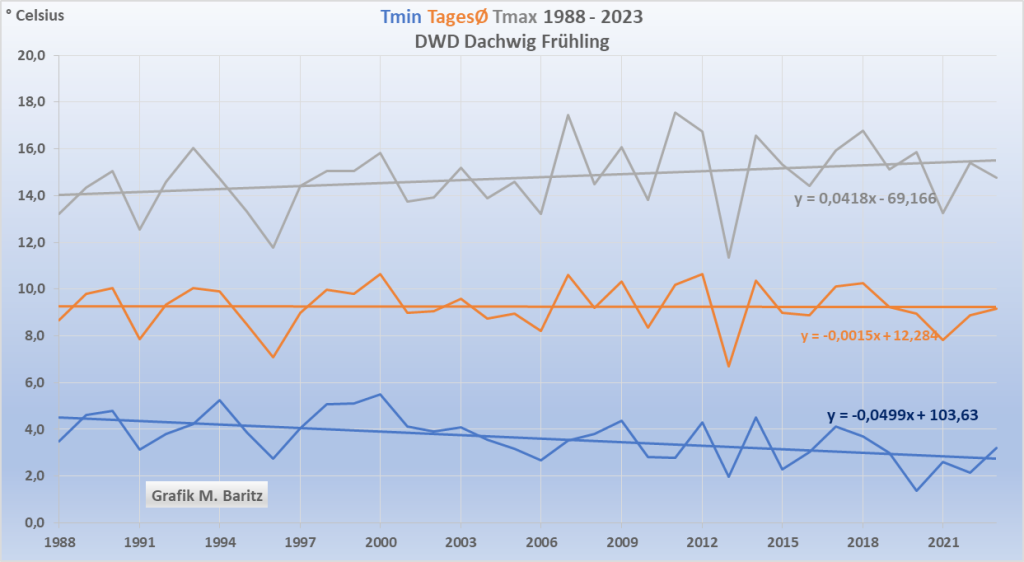

DWD Wetterstation Dachwig in Thüringen, sehr ländlich

Grafik 15b: Das gleiche Bild bei Dachwig: 10% Sonnenstundenzunahme, deutliche Erwärmung am Tage und deutliche Abkühlung der Nächte.

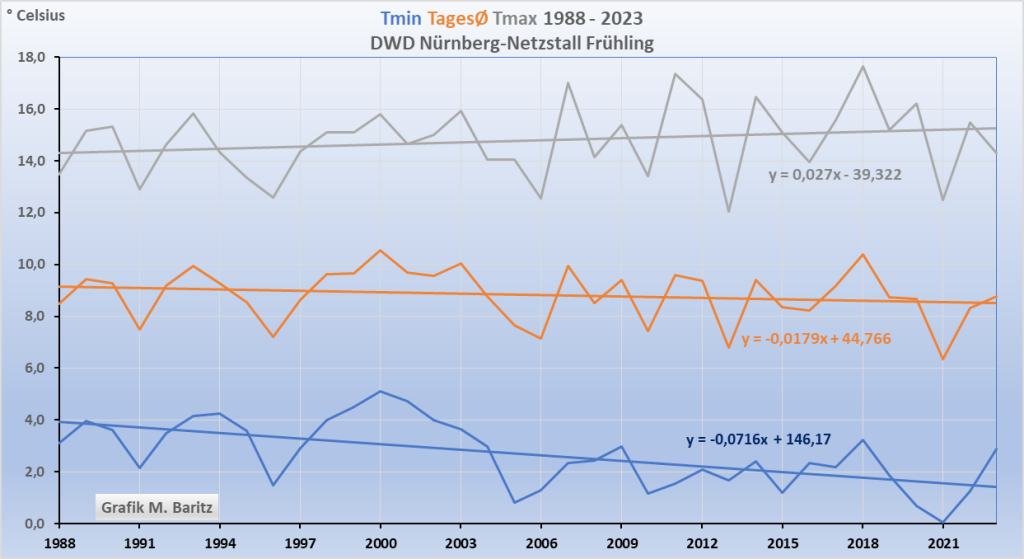

Hinweis: Die ländliche Station Dachwig zeigt bei unserer Auswahl,zusammen mit Nürnberg,die größte Steigungsdifferenz zwischen Tmax/Tmin. Hier gehen die „Scheren“ zwischen Tmax und Tmin am deutlichsten auseinander. Auffallend ist die stark steigende Tmax-Reihe tagsüber in Dachwig. Dass weist auf stark sonnenspeichernde Stoffe in unmittelbarer Stationsumgebung hin (Beton, Kopfsteinpflaster, etc.).

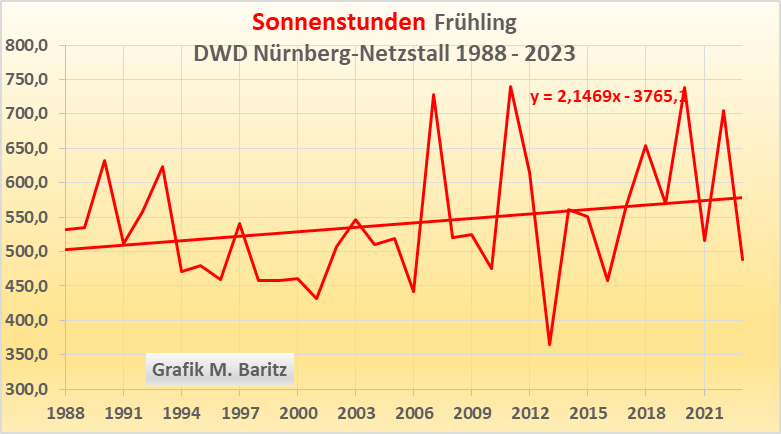

Nürnberg Netzstall, die DWD-Station mit der DWD-Nr. 3667 wurde am 1. März 2005, unter Beibehaltung der Stationsnummer, an den jetzigen Standort verlegt. Wir verwenden die Original DWD-Daten, wie diese im Internet für diese Station abrufbar sind.

Grafik 16a/b: Ebenso Nürnberg Netzstall, starke Zunahme der Sonnenscheindauer und Tagestemperaturzunahme. (Die Sonne wirkt nur tagsüber.)

Es würde hier den Rahmen sprengen, all unsere vielen Auswertungen zu zeigen. Zusammengefasst ist festzustellen:

- Die Tmax-Trendlinien steigen überall

- Schere zwischen Tmax und Tmin geht auseinander, bei Dachwig und Nürnberg/Netzstall um deutlich mehr als 3 Grad!

- Sonnenstunden nehmen überall zu, im Schnitt über 10%.

- Die Tagesmitteltemperaturen steigen nur unwesentlich, was der Tmax geschuldet ist. Diese Tmax-Steigerung ist der Zunahme der Sonnenstunden geschuldet.

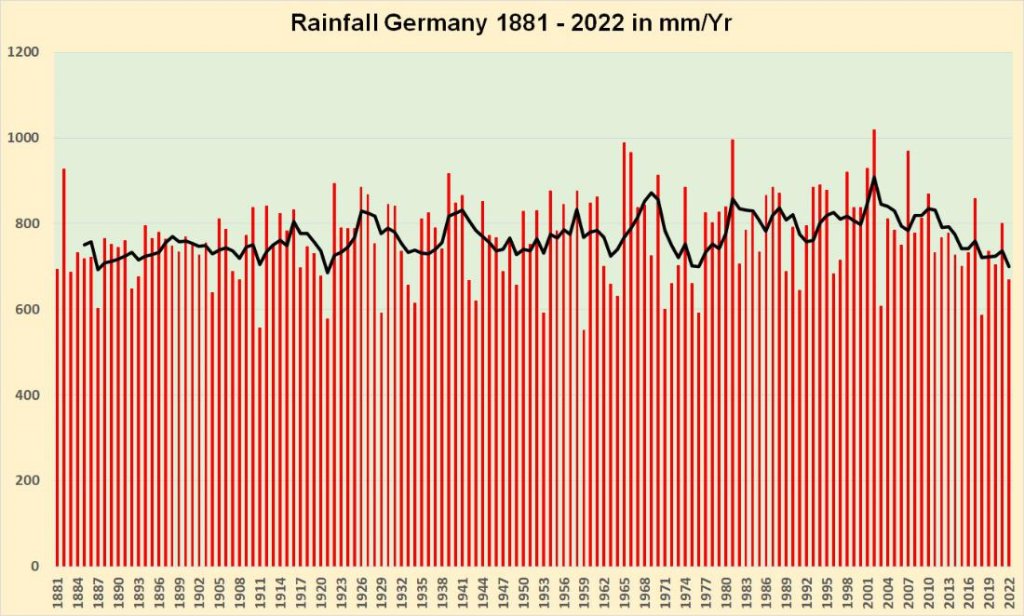

- Die Niederschlagsabnahme liegt mit 8% (13% gesamt in D) in 34 Jahren*3) auch nicht alarmierend tief.

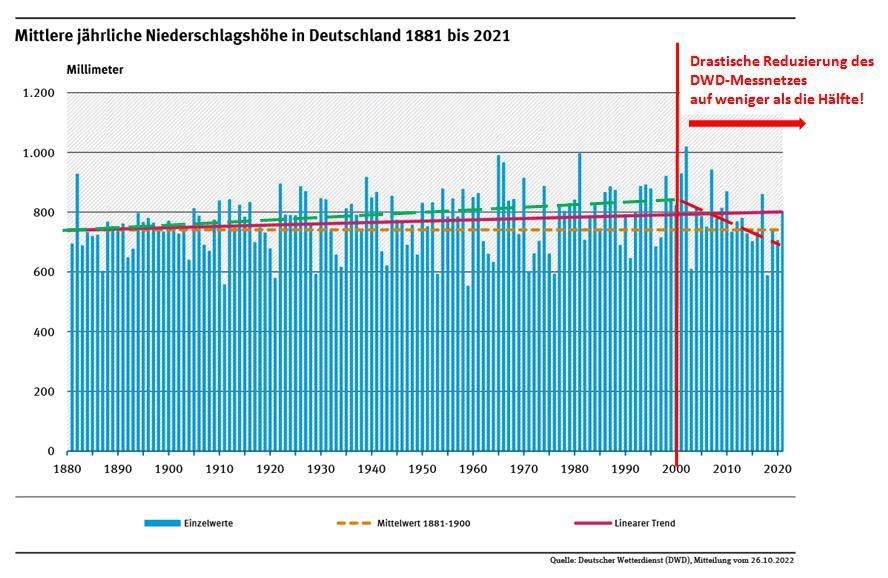

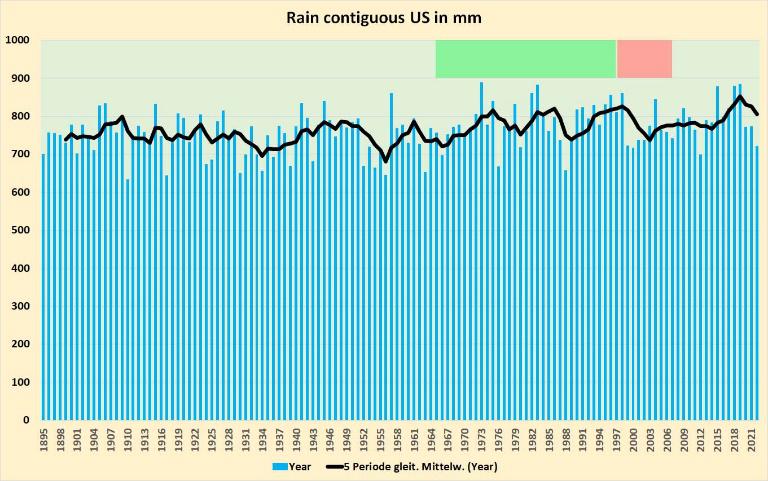

Anmerkung: Werden längere Zeiträume betrachtet, wie z.B. 100 Jahre, so ist die Niederschlagsmenge zunehmend, und in den Jahrzehnten nach der Jahrhundertwende 1900 war es in Deutschland trockener als heute (Grafik 17).

Eigentlich eine ganz normale Entwicklung des Frühlings in Deutschland seit 1988!!

*3)Nicht nur bei den Temperaturen, sondern auch beim Niederschlag, hat der DWD seit der Jahrtausendwende sein Messnetz drastisch verändert/reduziert, so dass die heutigen Messungen grundsätzlich nicht mehr mit den Niederschlagsmessungen vor 2000 vergleichbar sind, siehe hier bei Wikipedia. Auch hier das „gewünschte“ Ergebnis einer vermeintlichen Klimakatastrophe, was dann als Dürre „verkauft“ wird.

Auszug: „Das DWD-Niederschlagsmessnetz besteht derzeit aus rund 1900 Messstellen. Seit etwa 60 Jahren liegen Tageswerte in hoher räumlicher Dichte vor, die in früheren Jahrzehnten teilweise aber noch deutlich höher war als heute. Von 1969 bis 2000 gab es beispielsweise mehr als 4000 Stationen.“

Grafik 17, Quelle: Bundesumweltamt mit Quellenhinweis zum DWD zeigt, dass kein negativer Trend beim Niederschlag zu verzeichnen ist, wird der Klimazeitraum des DWD seit 1881 betrachtet. Mehr noch, der lineare Trend ist merklich steigend (um ca. 8%)! In Deutschland fällt also nicht weniger, sondern immer mehr Niederschlag. Dies zeigt das Umweltbundesamt und sagt der DWD.

Der DWD gibt den Mittelwert für die Jahre 1881 – 1900 an. Errechnet sind dies 739 Liter je Quadratmeter. Für den Zeitraum 1881 – 2021 liegt der errechnete Mittelwert bei 771 l/m², was einer Erhöhung der Niederschlagsmenge bedeutet: Deutschland wird nicht trockener, sondern „nasser“.

Leistenschneider hat in der Grafik 17 den Zeitraum (Jahr) angegeben, ab dem der DWD sein Niederschlagsmessnetz laut obiger Quelle auf weniger als die Hälfte reduziert hat und dazu näherungsweise zwei Steigungen eingetragen:

– von 1881 – 2000 (grün)

– von 2000 – 2021 (rot)

Schon sehr merkwürdig, dass just zu dem Zeitpunkt, als der DWD sein Niederschlagsmessnetz drastisch reduziert hat, plötzlich die Trockenheit in Deutschland Einzug hält! Dies erweckt den Eindruck, dass beim DWD, wie bei den Temperaturen, auch beim Niederschlag „gefingert“ wird.

Nun könnte argumentiert werden, dass eine höhere Sonnenscheindauer verantwortlich dafür ist. Denn, je mehr Sonnenstunden, desto weniger Wolken und je weniger Wolken, umso weniger Regen. Dies ist allerdings nicht so! Bei den Auswertungen der Autoren (Baritz) an DWD-Messstandorten zeigt sich, dass die Sonnenscheindauer um mehr als 10-20-fach (im Steigungsvergleich) zunahm, als die Niederschlagsmenge sich verringert hat. Oder anders ausgedrückt: Der starken Zunahme der jährlichen Sonnenscheindauer steht ein fast Gleichbleiben der jährlichen Niederschlagsmenge gegenüber.

Daher die Schlussfolgerung, dass, wie bei den Temperaturen, die DWD-Vergleiche zu Jahren vor 2000, auch bei den Niederschlägen, zutiefst unseriös sind.

Zurück zu den Temperaturen und zum WI.

Ein aktuelles Beispiel zum Wärmeinseleffekt. Die Tmin-Trendlinien fallen in ländlichen Stationen stärker als in städtischen. Dazu passend, „Sven Plöger am 09.06 bei „Wetter vor acht“ in Grafik 18.

Grafik 18….. Tiefsttemperaturen Richtung Müritz bei 7°C und Berlin dann 17°C, die Stadt (Berlin) produziert ihre Eigenwärme…. Quelle: ARD-Mediathek ab Min 1.55

Fazit: Der WI-Effekt bestimmt neben den DWD-Standortmanipulationen die Temperaturen und nicht der CO₂-Effekt.“

Diese Gutgläubigen sagen es selbst, verbreiten aber trotzdem den Unsinn einer enormen CO₂-Erwärmung (Stichwort: Klimakrise).

Keine Klimakrise oder Klimakatastrophe erkennbar.

Und wie wirkt die angeblich starke Klimasensitivität von Kohlendioxid und die Behauptung, CO₂ sei der Temperaturtreiber oder gar ein Klimakiller?Antwort: Ein Zusammenhang ist nicht erkennbar und damit in der Realität nicht gegeben. Nichts vom angeblich menschengemachten CO₂-Klimawandel, Klimakrise, Klimakiller und weiteren Begriffslügen stimmt. Die Sonne bestimmt die Erwärmung. Scheint sie nicht (in den Nächten), so wird es kälter.

Schlussfolgerung:

Wäre CO₂ – wie behauptet – der entscheidende Erwärmungsgrund und Temperaturtreiber, dann müssten die Steigungen der Tag-/Nachtemperaturen bei den jeweiligen Stationen zumindest nahezu gleich verlaufen. Was erkennbar nicht der Fall ist.

Zusammenfassung:

Trotz zunehmender Kohlendioxid-Konzentrationen sind die mittleren deutschen Frühlingstemperaturen nicht gestiegen. Das bedeutet, die Kohlendioxid-Theorie der starken Erderwärmung ist erwiesenermaßen falsch.

In der freien Fläche, außerhalb der Wärmeinseln, das sind 80% der Deutschlandfläche, sind die mittleren Frühlingstemperaturen sogar deutlich gefallen.

Vor allem wurden die Nächte in der Gegenwart kühler, während die Temperaturen tagsüber keine Abkühlung zeigten. Dieser Umstand ist mit dem Anstieg der Sonnenstunden seit 1988 zu erklären. Siehe hierzu auch „Klimaschwindel bei DWD, ZDF und Co. – oder: wie Öffentlichkeit und Politik getäuscht werden (hier, 1)“, darin ab Abb.9.

Es kann keine Frühlings-Vegetationsverfrühung seit 1988 festgestellt werden, aber die Gefahr der Erfrierung, vor allem außerhalb der Wärmeinseln, siehe Eingangsbild, hat zugenommen.

Und in der Gegenwart hat sich der Trend verstärkt. Dies zeigt z.B. die ländliche Station Dachwig in Thüringen in Grafik 19. Trendlinien bitte mit obiger Grafik 15 vergleichen.

Grafik 19: Man beachte die Steigungsunterschiede zwischen Tag und Nacht. Ländliche Stationen kühlen nachts besonders aus.

Fazit: Die Temperaturentwicklung im Frühling und der starke Anstieg der CO₂-Konzentrationen haben keinen Zusammenhang.

Wir konnten zeigen: Der Frühling wird seit 1988 und vor allem seit der Jahrtausendwende kälter. Der Grund sind die kälter werdenden Frühlingsnächte in Deutschland.

Es gibt keinen verfrühten Vegetationsfrühlingsbeginn seit 1988.

Die CO₂-Erwärmungstheorie (postulierter Treibhauseffekt) ist in der behaupteten Größenordnung rundum falsch. Kohlendioxid ist kein Temperaturtreiber und schon gar kein sog. Klimakiller. Eine Klimakatastrophe existiert nicht!

Josef Kowatsch – Naturbeobachter, aktiver Naturschützer und unabhängiger, weil unbezahlter Klimaforscher

Matthias Baritz – Naturwissenschaftler und Naturschützer

Raimund Listenschneider – EIKE

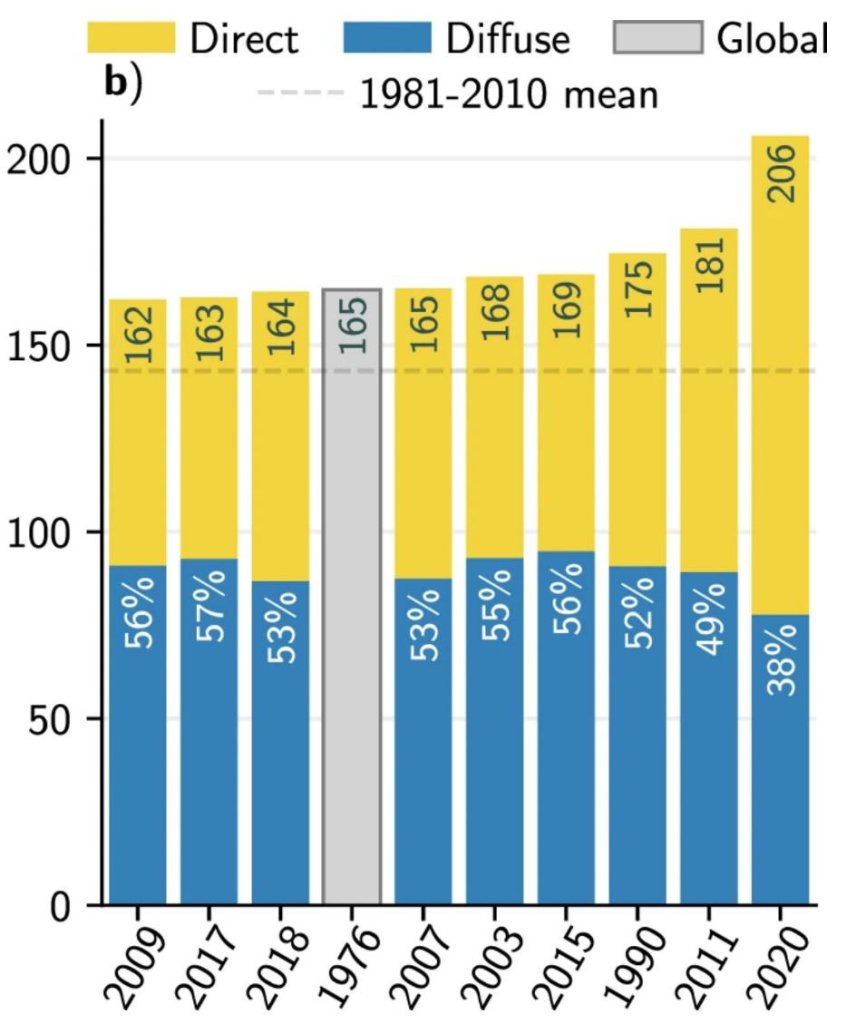

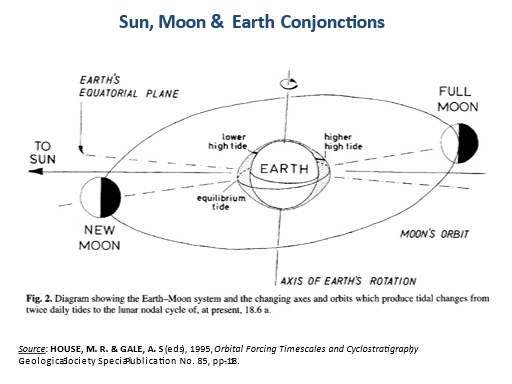

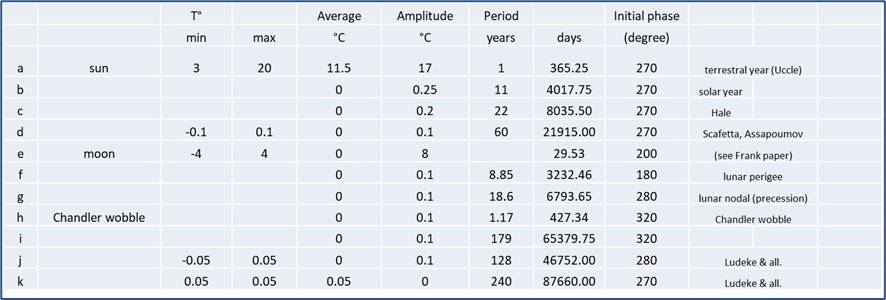

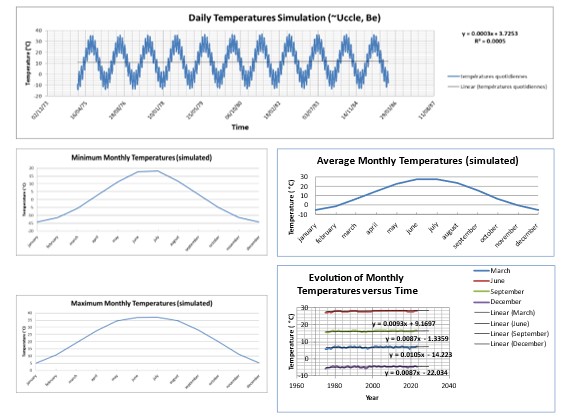

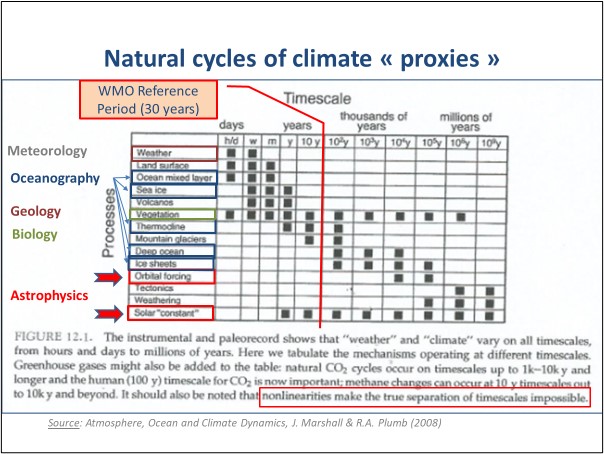

Tabelle 2: Einige natürliche Zyklen im Vergleich zu dem für die Berechnung der Temperaturanomalien verwendeten Bezugszeitraum.

Tabelle 2: Einige natürliche Zyklen im Vergleich zu dem für die Berechnung der Temperaturanomalien verwendeten Bezugszeitraum.

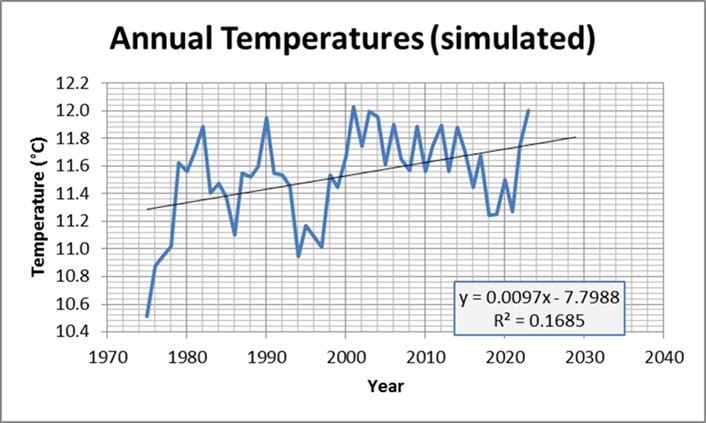

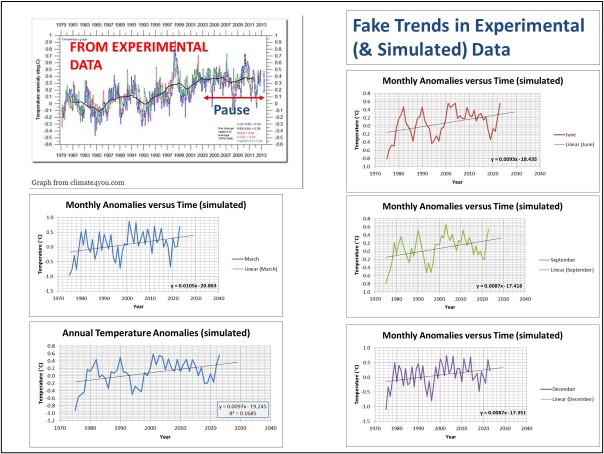

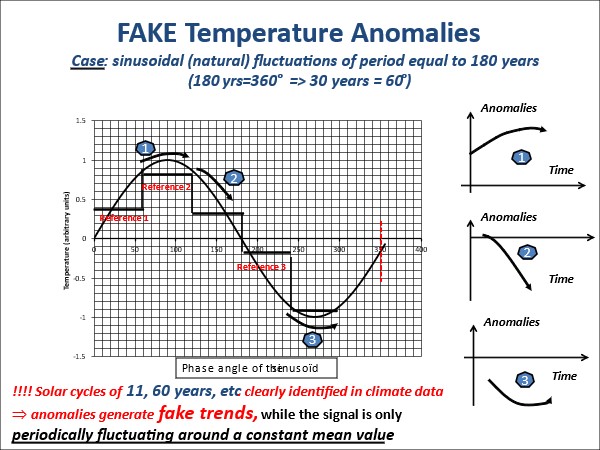

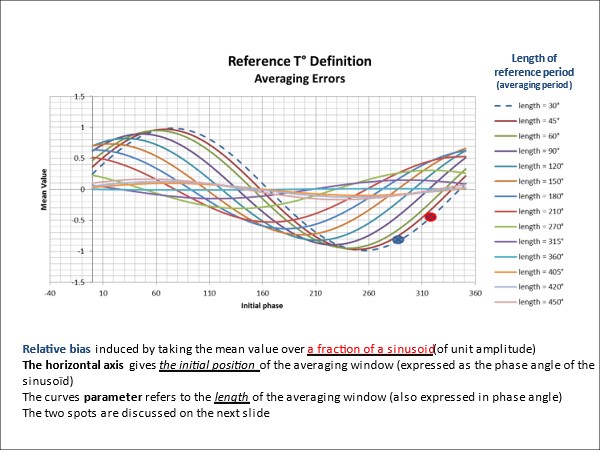

Abbildung 13: Verzerrung des zur Berechnung der Anomalien verwendeten Basiswerts nach Länge der Referenzperiode. Die Periode der Sinuskurve mit Einheitsamplitude wird in Grad (360°) ausgedrückt. Die Kurven stellen die Länge der Referenzperioden dar, die für die Berechnung der Anomalien verwendet wurden. Sie sind ebenfalls in Grad angegeben (die Bruchteile der Periode darstellen). Die Punkte der verschiedenen Kurven entsprechen dem anfänglichen Offset der Referenzperiode. Diese Verzerrungen sind sehr variabel und können bis zur Amplitude der Sinuskurve reichen. In dieser Abbildung wird auch das Problem der „gestuften Verbindung“ deutlich, wenn man von einer Referenzperiode zu einer anderen wechselt, wobei sich die Verzerrung je nach Position auf der Sinuskurve in die eine oder andere Richtung ändert. Die beiden Punkte, die den Kurven hinzugefügt wurden, veranschaulichen dieses Problem.

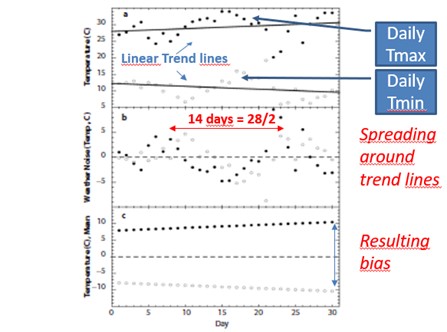

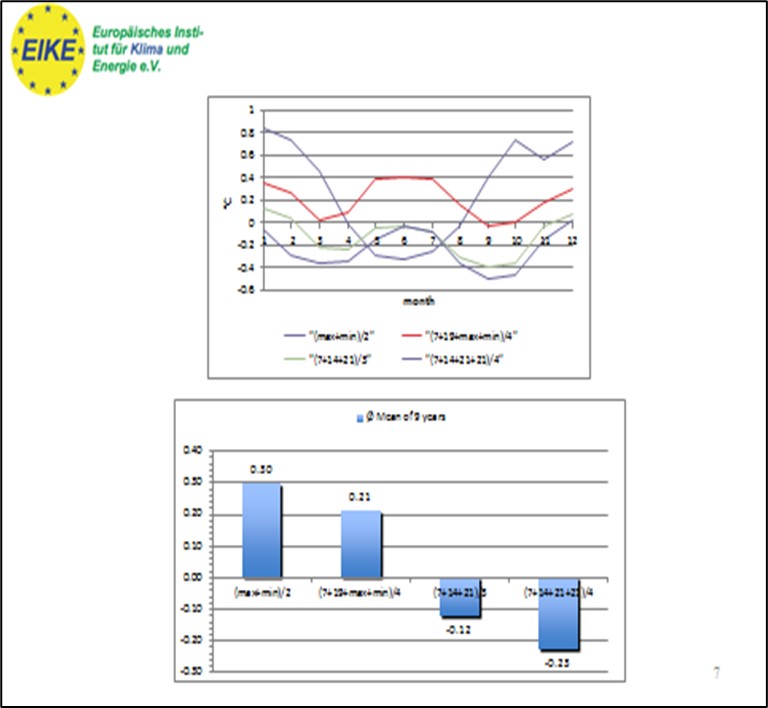

Abbildung 13: Verzerrung des zur Berechnung der Anomalien verwendeten Basiswerts nach Länge der Referenzperiode. Die Periode der Sinuskurve mit Einheitsamplitude wird in Grad (360°) ausgedrückt. Die Kurven stellen die Länge der Referenzperioden dar, die für die Berechnung der Anomalien verwendet wurden. Sie sind ebenfalls in Grad angegeben (die Bruchteile der Periode darstellen). Die Punkte der verschiedenen Kurven entsprechen dem anfänglichen Offset der Referenzperiode. Diese Verzerrungen sind sehr variabel und können bis zur Amplitude der Sinuskurve reichen. In dieser Abbildung wird auch das Problem der „gestuften Verbindung“ deutlich, wenn man von einer Referenzperiode zu einer anderen wechselt, wobei sich die Verzerrung je nach Position auf der Sinuskurve in die eine oder andere Richtung ändert. Die beiden Punkte, die den Kurven hinzugefügt wurden, veranschaulichen dieses Problem. Abbildung 14: Algorithmen zur Bestimmung der Tagestemperatur und Fehler im Vergleich zur tatsächlichen Durchschnittstemperatur, die durch die Integration kontinuierlicher Temperaturmessungen über die gesamten 24 Stunden eines Tages abgeleitet wird. Der Fehler liegt in der Größenordnung von +- 0,6°C

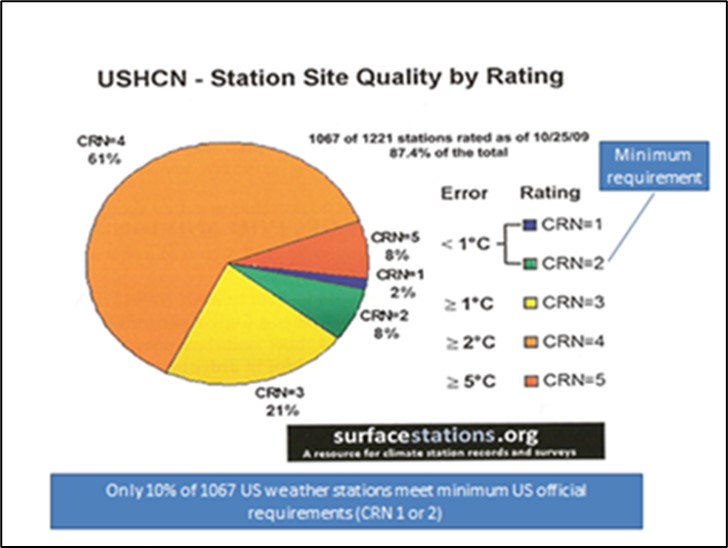

Abbildung 14: Algorithmen zur Bestimmung der Tagestemperatur und Fehler im Vergleich zur tatsächlichen Durchschnittstemperatur, die durch die Integration kontinuierlicher Temperaturmessungen über die gesamten 24 Stunden eines Tages abgeleitet wird. Der Fehler liegt in der Größenordnung von +- 0,6°C Abbildung 15. Genauigkeit der Messungen an terrestrischen Wetterstationen in den USA. Weniger als 10% der 1221 untersuchten Stationen haben einen Fehler von weniger als 1°C.

Abbildung 15. Genauigkeit der Messungen an terrestrischen Wetterstationen in den USA. Weniger als 10% der 1221 untersuchten Stationen haben einen Fehler von weniger als 1°C.