Deutschland – ein Wintermärchen

Ab 2021 gilt eine neue Klima-Normalperiode, die von 1991 bis 2020

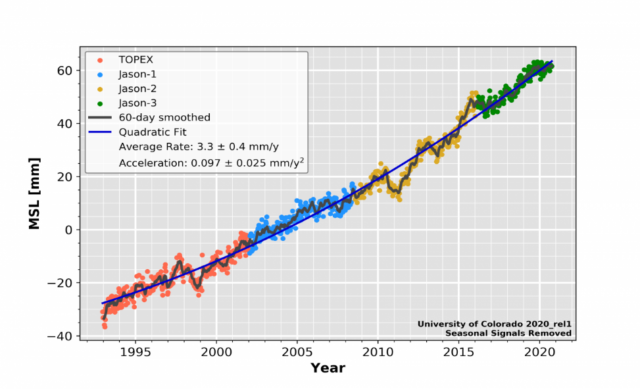

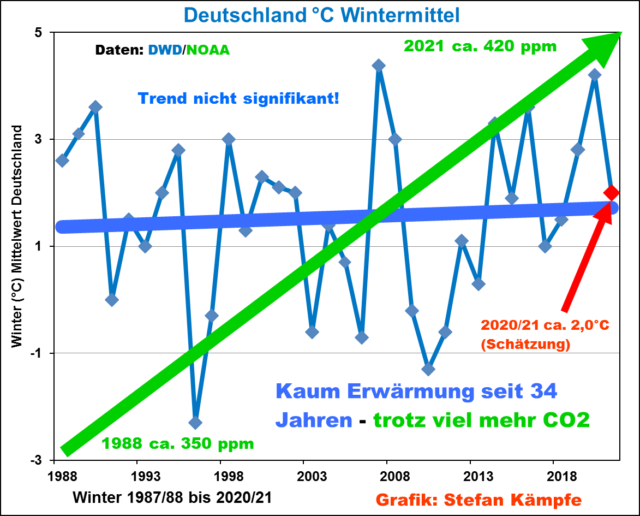

Auch wenn es Klima-Erwärmungsgläubigen schwerfällt – ab sofort wird auf Beschluss der Weltorganisation für Meteorologie (WMO) die alte, kalte und schon reichlich angestaubte Normalperiode von 1991 bis 1990 durch die aktuelle, wärmere von 1991 bis 2020 ersetzt. Das hat Konsequenzen – künftig liegt die Messlatte für warme Jahre und Jahreszeiten viel höher. Für den Winter im Deutschland-Mittel bedeutet es Folgendes: Von 1961 bis 1990 (Abkühlungsphase) betrug das Vergleichs-Wintermittel +0,3°C, von 1981 bis 2010 +0,9°C, 1991 bis 2020 aber +1,4°C. Betrachtet man nun aber die Entwicklung der Winter-Temperaturen im Deutschland-Mittel seit dem „Klimasprung“ von 1987/88, als es letztmalig plötzlich im Winter merklich wärmer wurde, so zeigt sich fast Stagnation; die weitere Erwärmung war gering und nicht signifikant. Der aktuelle Winter wurde dabei vom Verfasser dieses Beitrages eher optimistisch auf +2,0°C geschätzt, diese muss er erst einmal erreichen:

Abbildung 1: Seit Anfang 1987/88 erwärmte sich der Winter in Deutschland kaum noch; auch der aktuelle, recht milde wird wohl etwas kühler ausfallen, als die Winter von 1988 bis 1990. Der extrem milde Rekordwinter von 2006/07 mit fast +4,4°C liegt nun auch schon fast anderthalb Jahrzehnte zurück.

Immer weniger Arktisches Meereis im Winter?

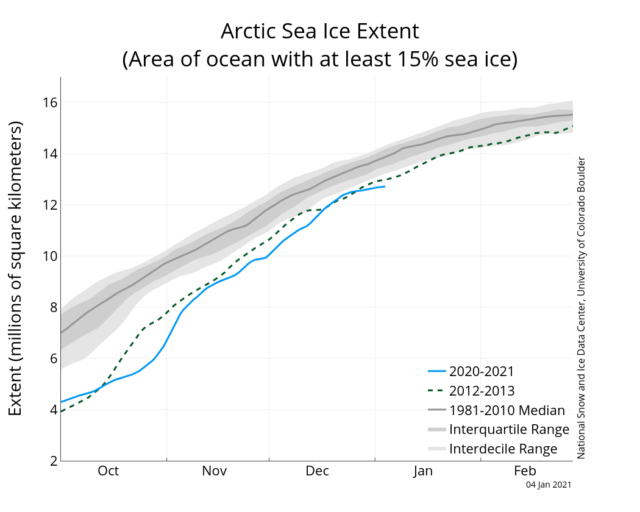

Auch den flächen- und volumenmäßigen Rückgang des arktischen Meereises bestreitet niemand, doch sieht dieser weitaus dramatischer aus, als er tatsächlich ist, denn eine quantitative, kontinuierliche, relativ zuverlässige Erfassung war erst mit der Weiterentwicklung der Satelliten-Technik ab dem Jahre 1979 möglich – aber damals war gerade der Höhepunkt einer Abkühlungsphase erreicht; es wurden schon Wetten abgeschlossen, ob man bald über das Eis von Grönland nach Island laufen könne – und es kam dann ganz anders: Wegen der um 1990 einsetzenden AMO-Warmphase wurde viel Wärme in die Arktis eingetragen; das Eis zog sich zurück. Allerdings gab es derartige Rückzugsperioden auch schon während der AMO-Warmphase um 1930, und wie hätten die Wikinger im frühen Mittelalter Island, Grönland und Neufundland erreichen können, wenn es damals viel Eis gegeben hätte? So zeigt sich auch die aktuelle, winterliche Entwicklung der Meereisbedeckung nur leicht unterdurchschnittlich und keineswegs dramatisch:

Abbildung 2: Flächenentwicklung des Arktischen Meereises bis zum 4. Januar 2021 (hellblaue Linie). Noch im Oktober gab es, gemessen am Mittelwert von 1981 bis 2010, viel zu wenig Eis, doch in den vergangenen 10 Wochen verringerte sich dieses Defizit merklich. Bildquelle

Mehr Schneebedeckung in Eurasien?

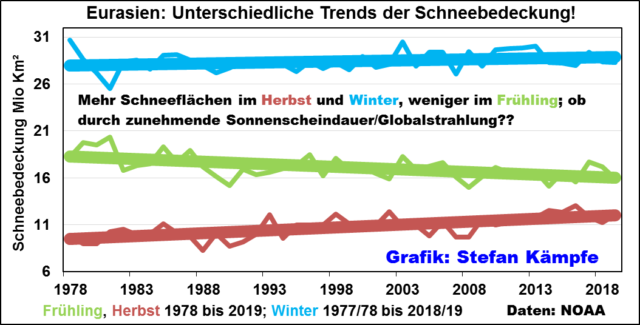

In den vergangenen zwei Wintern hatten Schneefans in Mitteleuropa wenig Freude; die „weiße Pracht“ war, wenn überhaupt, nur im höheren Bergland zu bewundern. Doch Europa ist nur das bedeutungslose Anhängsel des Riesen-Kontinents Eurasien. Betrachtet man dessen Ausdehnung der Schneebedeckung zu verschiedenen Jahreszeiten, so zeigt sich folgendes Bild:

Abbildung 3: Seit 1978, dem Beginn der regelmäßigen Erfassung, hat sich die von Schnee bedeckte Fläche in Eurasien im Herbst deutlich und im Winter leicht vergrößert; im Frühling nahm sie, vermutlich durch längere und intensivere Besonnung, ab.

Beeinflusst die AMO die Wintertemperaturen in Deutschland?

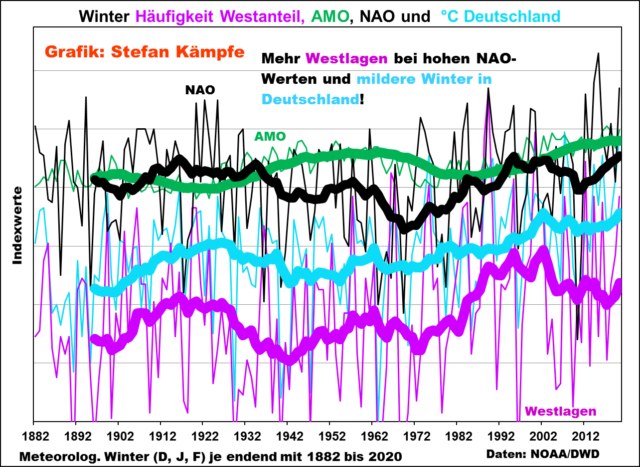

Die Atlantische Multidekaden-Oszillation (Abkürzung AMO; engl. atlantic multidecadal oscillation) ist die Bezeichnung für eine zyklisch auftretende Zirkulationsschwankung der Ozeanströmungen im Nordatlantik. Sie bringt eine Veränderung der Meeresoberflächentemperaturen des gesamten nordatlantischen Beckens mit sich, wodurch Einfluss auf die Atmosphäre ausgeübt wird. Gegenwärtig befinden wir uns in einer AMO-Warmphase, die um 1990 begann und möglicherweise bald enden wird. Doch während für die Jahreszeiten Sommer und Herbst sowie für den April eindeutige, positive Einflüsse bestehen (in AMO-Warmphasen sind diese in Deutschland tendenziell wärmer), konnten für den Winter keine eindeutigen Zusammenhänge gefunden werden:

Abbildung 4: Fast Gleichlauf zwischen der schwarzen Kurve (NAO) und der violetten (Westlagen-Häufigkeit) im meteorologischen Winter. Deren langfristige Entwicklung erklärt recht gut die Entwicklung der Deutschen Wintertemperaturen (hellblau). Zur grünen Kurve (AMO) besteht mit r= 0,146 nur ein geringer, nicht signifikanter positiver Zusammenhang. Weil die vier Größen sehr unterschiedliche Werte haben, wurden sie zur besseren Veranschaulichung in einer Grafik in Indexwerte umgerechnet.

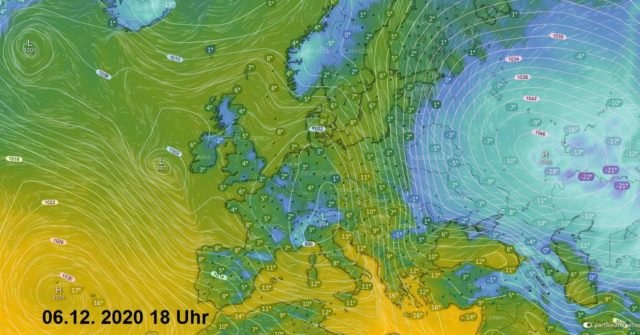

Tendenziell treten in AMO-Phasen mehr Süd- und Südwestlagen auf; doch bringen gerade Südlagen im Winter nicht immer deutlich übernormale Temperaturen. Trotzdem könnte es bei sehr hohen AMO-Werten, wie gegenwärtig, im Einzelfall zu verstärkten, gebietsweisen Warmluft-Einbrüchen im Winter kommen. Der sehr milde Dezember 2020, in dem Westlagen aber eher selten waren, deutet in diese Richtung. Er wies am Monatsanfang und am Monatsende zwei markante Troglagen über West- und Mitteleuropa auf. Dabei standen sich zeitweise ein Tief über dem südlichen Mitteleuropa und ein Russland-Hoch gegenüber; zwischen beiden strömte über Westpolen extrem milde Mittelmeer-Luft nordwärts, während in West-und Mitteleuropa sonst nasskaltes Wetter mit gebietsweisen Schneefällen in den Mittelgebirgen und extrem starken Schneefällen in den Alpen herrschte:

Abbildung 5: Winterlicher, räumlich eng begrenzter Warmlufteinbruch über den Balkan, Böhmen und Westpolen am 6. Dezember 2020. Dort wurden noch abends zweistellige Plusgrade gemessen, während es über Südrussland schon frostig kalt und in Mittel- und Westeuropa nasskalt war. Bildquelle

Winter und Energiewende – das passt nicht gut zusammen

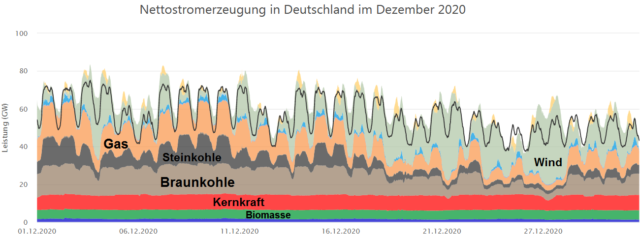

Der Dezember 2020 zeichnete sich, ganz anders als seine beiden Vorgänger, durch viele Flauten aus; auch die Sonnenscheindauer blieb gering:

Abbildung 6: Während die Solarenergie im Dezember 2020 praktisch keinen nennenswerten Strom lieferte, war auch Windstrom bis zur Monatsmitte und am Monatsende Mangelware. Braun- und Steinkohle, Kernkraft und zunehmend Erdgas verhinderten, dass in Deutschland die Lichter ausgingen.

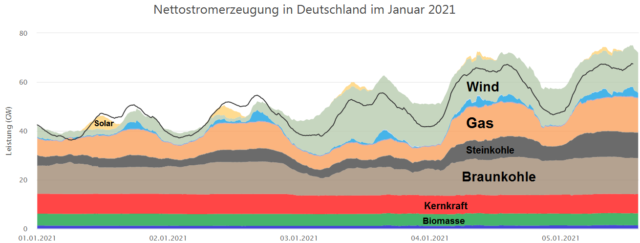

Und in den ersten Januartagen sah es für die „Erneuerbaren“ Energien auch alles andere als rosig aus:

Abbildung 7: Fehlstart der „Erneuerbaren“ bis zum 5. Januar 2021: An den ersten zwei Januartagen kaum Wind, auch danach unterdurchschnittliche Windausbeute. Und die Sonne lieferte praktisch Nichts – zum Glück gibt es (noch) Kohle- und Kernkraftwerke; bei deren Abschaltung werden wir wohl künftige Winter in Kälte und Dunkelheit verbringen müssen.

Im Winter steigt der Stromverbrauch tendenziell an, weil mehr Licht benötigt und die meisten Heizungsanlagen zwar mit Erdgas oder Öl befeuert, aber mit Strom gesteuert werden. Anders als in den übrigen Jahreszeiten, nahm im Winter die Anzahl der unbestimmten, schwachwindigen XX-Lagen nur geringfügig zu; dennoch sind die Produktionsergebnisse des Windstroms trotz weiteren Ausbaus gerade der Offshore-Anlagen unbefriedigend. Sollte sich der Trend zu mehr schwachwindigen Wetterlagen künftig auch im Winter beschleunigen, was durchaus zu erwarten ist, so dürfte das endgültige Scheitern der Energiewende nicht mehr zu verhindern sein.

Zusammengestellt von Stefan Kämpfe, unabhängiger Klimaforscher, am 05. 01. 2021