Die große Transition! – Europas Strompreise explodieren, wenn die Sonne untergeht und der Wind nicht weht

Diese opportunistischen „Teufel“, die zuverlässige, mit fossilen Brennstoffen betriebene Kraftwerke beherrschen, verhalten sich wie wahre Banditen. Während die Energie-Spekulanten-Punters sich auf einen weiteren bitteren Winter vorbereiten, lassen sie die ärmeren Bewohner im Dunkeln frieren.

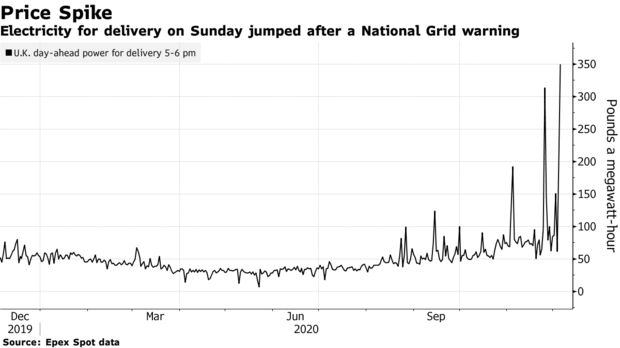

Die Strompreise in Großbritannien steigen, nachdem der nationale Stromnetzbetreiber vor Versorgungsrisiken gewarnt hat

Rachel Morison, Bloomberg, 6. Dezember 2020

Die Strompreise in Großbritannien stiegen auf ein Vierjahreshoch, nachdem der britische Netzbetreiber gewarnt hatte, dass sein Sicherheitspuffer für die Versorgung am Sonntagabend fast erodiert ist.

National Grid Plc sagte in einer auf Twitter veröffentlichten Warnung, dass es „die Situation genau überwacht“. Der Netzbetreiber verbreitete keine offizielle Warnung mehr, die als Electricity Margin Notice [~Strommangel …] bezeichnet wurde und zuletzt am Donnerstag ausgelöst wurde. Normalerweise wird es veröffentlicht, wenn die Sicherheitsmarge für den Betrieb des Systems unter das von der Regierung zugelassene Niveau sinkt.

National Grid ESO – EoZWP2pW8AICxiR

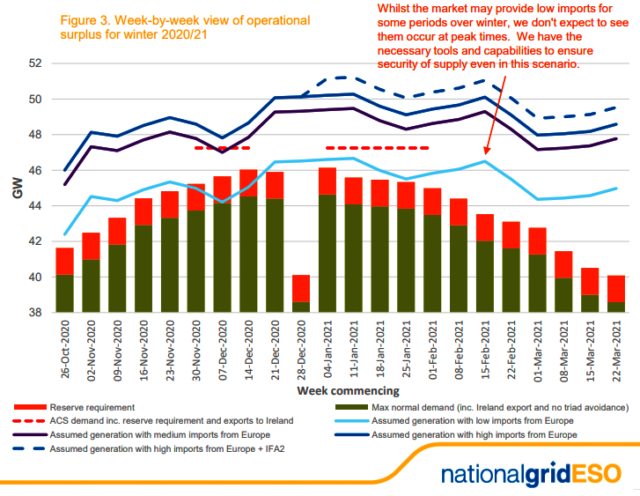

Es ist ungewöhnlich, dass es an einem Wochenende Probleme gibt, wenn der Verbrauch typischerweise niedriger ist, da Büros und Industrie geschlossen sind. Das zeigt, wie nahe das britische Stromnetz in diesem Winter an die Belastungsgrenze gekommen ist. National Grid erwartet in diesem Jahr weitere Versorgungswarnungen, sagte der Vorstandsvorsitzende John Pettigrew in einem Interview mit Bloomberg im vergangenen Monat. Der Spielraum zwischen Angebot und Nachfrage sei der knappste, den Großbritannien seit etwa vier Jahren gesehen habe.

Read more of the interview with National Grid’s CEO here

Der Strom für die Lieferung am Sonntagabend wurde in einer Auktion am Samstag auf der Epex Spot SE mit bis zu 350 Pfund (470 USD) pro Megawattstunde gehandelt. Dies ist der höchste Wert für den Zeitraum von 17 bis 18 Uhr seit November 2016. Der Peakload [Spitzenlast]-Vertrag stieg auf 96,29 Pfund pro Megawattstunde, der höchste Wert seit 2018, wie die Daten zeigen.

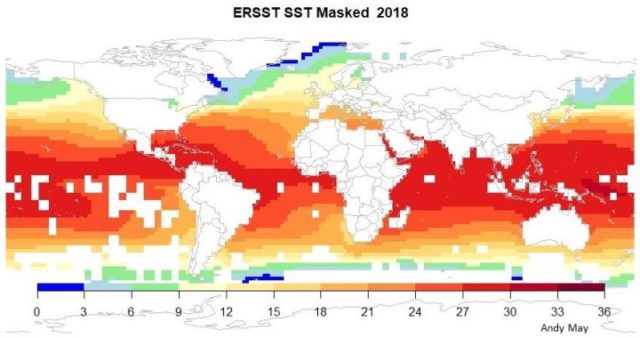

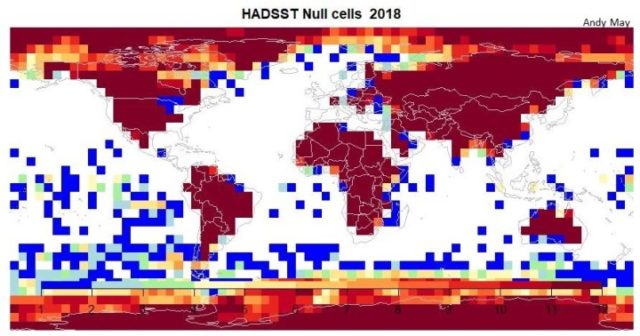

National Grid ESO, Prognosen für den Winter 2020 Seite 12.

Wir erwarten Nettoimporte von Strom durch Verbindungsleitungen von Kontinentaleuropa nach GB für den größten Teil des Winters. Wir erwarten typischerweise Strom- Export von GB nach Nordirland und Irland während der Spitzenzeiten.

Diesen Winter erwarten wir…

- steigende-Preise in GB vor denen in Kontinentaleuropa für den größten Teil der Winterperiode

- Importe in GB zu Spitzenzeiten über IFA, BritNed und Nemo Link Verbindungsleitungen, obwohl gelegentlich nicht vollständig importiert und vorbehaltlich Wettervariationen

- Moyle- und EWIC-Interkonnektoren werden normalerweise von GB nach Nordirland und Irland in Spitzenzeiten exportiert

- Einige Importe über Moyle und EWIC in Zeiten hoher Windleistung in Irland oder in Zeiten von Systemstress in GB

Epex Spot Data – Preisspitzen

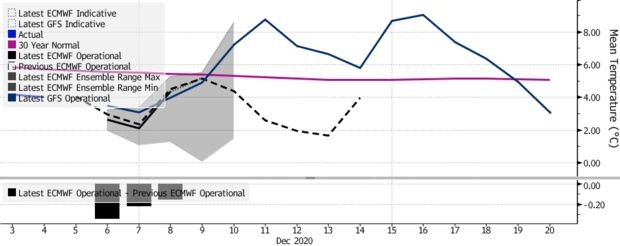

National Grid bemüht sich, das System in der Balance zu halten, da die Nachfrage bei kälterem Wetter steigt und die Winderzeugung voraussichtlich gering ist. Die Prognosen zeigen, dass sich die Situation nächste Woche fortsetzt. National Grid identifizierte nächste Woche als einen der Krisenpunkte in seinen Winteraussichten.

National Grid – Weather outlook

Großbritannien bezieht etwa 8% seiner Stromversorgung über Verbindungsleitungen aus Europa. Eine dieser sogenannten Interkonnektoren führt nach Frankreich. Die angespannte Stromversorgung könnte durch einen geplanten Streik der Mitarbeiter von Electricite de France SA am 10. Dezember noch verschärft werden. Wenn sich der Streik auf die Kernkraftwerke ausweitet und Frankreich keinen Strom nach Großbritannien exportieren kann, könnte National Grid vor einer noch härteren Herausforderung stehen, die Lichter nicht ausgehen zu lassen.

Wenn die verfügbaren Strommengen niedrig sind, fordert National Grid zunächst alle ansprechbaren Kohle- und Gaskraftwerke zum Betrieb auf. Reicht das dann nicht, können einige Großverbraucher aufgefordert werden, ihre Nachfrage zu drosseln, um zu versuchen, das System auf diese Weise am Laufen zu halten. Danach fordert der Netzbetreiber die lokalen Versorger auf, die Stromversorgung der Verbraucher vorübergehend zu unterbrechen. [das heißt dann smart Energiemanagement]

Die Strompreise erreichen in Belgien ein Rekordhoch.

The Brussels Times, 11. Dezember 2020

Die Strompreise stiegen am Montagmorgen in Belgien aufgrund ungünstiger Wetterbedingungen auf Rekordhöhen.

Die Preise schossen auf 2.300 € pro MWh, weil Mangels an Wind und Sonne Windkraftanlagen und Sonnenkollektoren kaum „erneuerbare [?] Energie“ produzierten.

Im Oktober hatten Solar- und Windenergie einen Rekordanteil von 23% im Stromnetz, da in Belgien immer mehr Solarmodule und Windparks errichtet wurden. Darüber hinaus waren die Temperaturen in Belgien niedrig, was dazu führte, dass viele ihre elektrischen Heizungen einschalteten. In Verbindung mit dem Mangel an nuklearer Kapazität in Frankreich stiegen die Kosten für die Stromversorgung auf 66 EUR / MWh.

Übersetzt durch Andreas Demmig

***

Fundstück zur Smart Home Lösung auf der Seite des BMWI

… Die intelligente Verknüpfung von Verbrauchs- und Erzeugungsanlagen ermöglicht es, den Eigenverbrauch unter Berücksichtigung der Wetterentwicklung zu prognostizieren und zu optimieren. Mit einer einzigen App kann ein Haushalt mit Solaranlage beispielsweise bei Vorhersage eines sonnigen Tages die Wasch- oder Spülmaschine am Morgen so programmieren, dass sie mittags läuft. Der zusätzlich gespeicherte Solarstrom kann abends zum gemeinsamen Kochen oder dem Aufladen des Elektroautos genutzt werden.

… Die Einspeisung von Sonnen- und Windenergie unterliegt zudem starken Schwankungen. Intelligentes Energiemanagement muss unter diesen Voraussetzungen Erzeugungs- und Verbrauchsmuster in Einklang bringen“, erklärt Dr. Thomas Goette, Geschäftsführer der Kölner GreenPocket GmbH.

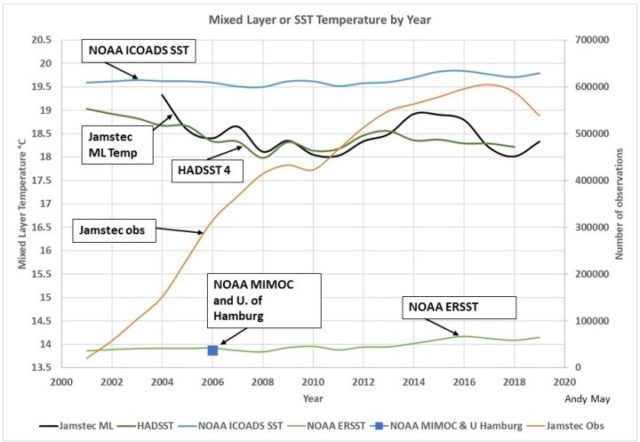

Zum Smart (?) kein Kommentar, aber das hier zur Erinnerung