-

Irreführende Durchschnitts-Temperatur

Eigentlich ist die Temperatur eine so genannte «intensive» Größe, die sich auf einen bestimmen Ort und Zeitpunkt bezieht und daneben oder am gleichen Ort etwas später einen ganz anderen Wert haben kann. Die mit seriöser Physik formulierten Gesetze, in der die Temperatur vorkommt, beziehen sich deshalb immer auf einen solchen Punkt.

Da es nicht möglich ist, dem CO2 irgendeine Wirkung auf die Temperatur nachzuweisen, beziehen sich die Matadore der herrschenden Klima-Ideologie auf den ganzen Planeten und dessen Durchschnittstemperatur, auf die «Welt-Durchschnittstemperatur», berechnet über das ganze Jahr, rund um den Planeten, aus einer Spanne von allenfalls -50°C oder noch weniger am Südpol und den höchsten Temperaturen von etwa 60°C im Death Valley, alles auf ein halbes Grad C genau! Dieser Durchschnitts-Wert wird zum Maß für das «Klima»; eine für die Ansprüche seriöser Physik etwas groteske Definition, und die Physik wäre eigentlich für das Thema zuständig.

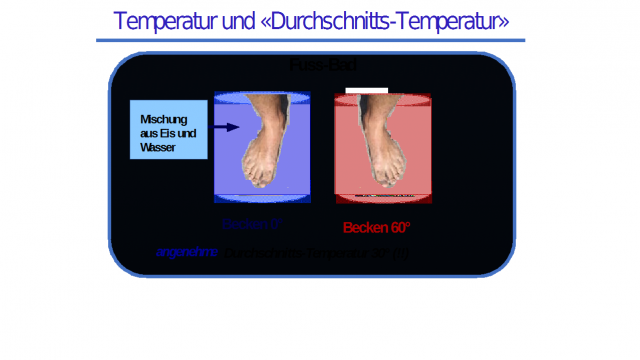

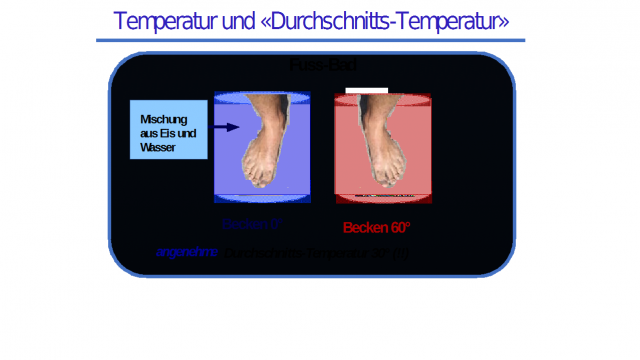

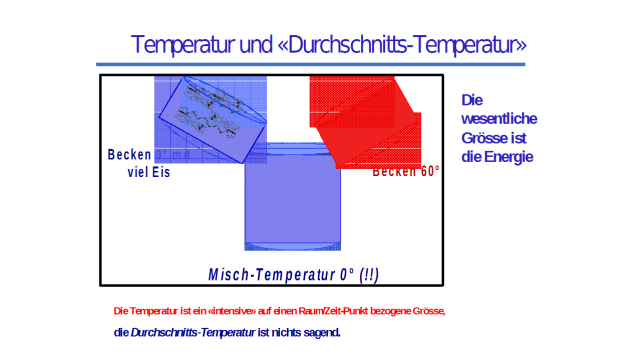

Wie irreführend die Durchschnittstemperatur immer wieder ist, sogar auf lokalem engen Raum, sei an einem einfachen Beispiel demonstriert: 2 Becken sind mit Wasser gefüllt, das linke mit einer Mischung von Eis von 0°C und Wasser von ebenfalls 0°C, im rechten Becken Wasser von 60°C. Die numerisch ermittelte «Durchschnitts-Temperatur» beträgt für ein Fußbad angenehme 30°C – in Wirklichkeit mit den 2 verschiedenen, für den menschlichen Körper extremen Temperaturen natürlich eine ungemütliche Situation!

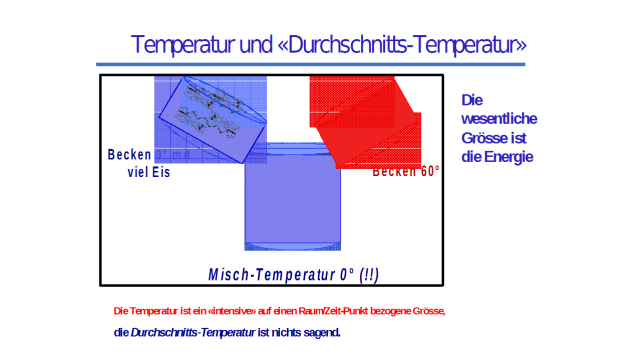

Somit mischen wir die beiden Becken zusammen in ein großes, damit wir mit dem Fußbad endlich beginnen können. Die numerisch berechnete «Durchschnittstemperatur» beträgt 30°C – ideal für ein Fußbad.

Das Resultat jedoch, au weia – eiskalt. Die Durchschnittstemperatur beträgt immer noch 0°C. Durch die vom warmen Becken gelieferte Energie wurde ein Teil des Eises geschmolzen, aber nicht alles, sodass die Durchschnitts-Temperatur 0°C beträgt. Die physikalisch wesentliche Größe ist die Energie, nicht die Temperatur!

Wenn wir beim Thema Eis sind, weshalb schmelzen Gletscher? Nein, nicht weil die Luft zu warm ist, sondern weil zu wenig Niederschläge fallen. Gletscher an Land sind durch Niederschläge entstanden, wachsen dank dieser und gehen zurück, wenn zu wenig Schnee fällt. Draußen im Weltall würde ein Gletscher bei -270° C verdunsten! Eine Kuriosität dieser Art sind die Trockentäler ohne Eis und Schnee in der Antarktis, nahe beim Südpol, trockener als die Sahara bei Temperaturen zwischen -40° C und –10° C.

Auf dem Meer entsteht die erste Schicht eines Gletschers, wenn die Oberfläche des kalten Wassers gefriert. Der Gletscher kann danach von oben ebenfalls durch Schnee genährt werden oder durch mehr kaltes Wasser von unten, und er schmilzt, wenn er in eine wärmere Strömung gerät, wie typischer Weise Eisberge, die Richtung Äquator schwimmen.

Der Mensch hat mit 2 Arten von Temperatur andauernd zu tun, mit der über die Sinne auf der Haut wahrgenommene Temperatur seiner unmittelbaren Umgebung sowie mit der seines Körpers, die man meistens nur im Zusammenhang mit einer Erkrankung durch Messungen zur Kenntnis nimmt, typischerweise ab und zu bei einem als Fieber bezeichneten zu hohen Wert.

Bild-Quelle: de.wikipedia.org/wiki/Fieberthermometer#/media/Datei:Quecksilber-Fieberthermometer.jpg

https://de.wikipedia.org/wiki/Gemeinfreiheit?uselang=de

Der Organismus eines Warmblüters reguliert seine Temperatur mit aufwendigen Prozessen. Aber auf ein halbes Grad genau kommt es sogar da nicht an. Die Temperatur des gesunden Körpers beträgt etwa 36,6° C. Sie sinkt nachts unter normalen Umständen etwa um ein halbes Grad. 1°C mehr als die normale Temperatur ist noch kein Fieber. Bei einem gesunden Menschen nimmt die Körpertemperatur bei höherer Leistung zu, und er schwitzt dann, um den Körper zu kühlen.

Die Körpertemperatur wird an einer Öffnung des Körpers gemessen. Im Innern kann sie vom gemessenen Wert ein wenig abweichen. Der Vergleich demonstriert, wie grotesk es ist, sich über die Durchschnittstemperatur der Erdoberfläche große Sorgen zu machen, die man sowieso nicht beeinflussen kann.

Die Meteorologen messen die Temperatur der Luft an einem schattigen Ort in 2 Meter Höhe. Das ist für die Zwecke der Wettervorhersage eine gute Möglichkeit, während man bei einer seriösen Betrachtung des Klimas eher an der lokal gespeicherten Energie interessiert wäre, die man durch Messungen der Bodentemperatur feststellen kann. Die Durchschnittstemperatur über die ganze Erde ist an sich bereits eine unsinnige Größe, und obendrein auf ein halbes Grad genau ist sie grotesk.

Naive irreführende Interpretationen von Durchschnittswerten sind quasi ein «running gag» der elementaren mathematischen Statistik. Daneben wird diese Größe auch immer wieder für Tricks verwendet, ein ahnungsloses Publikum zu täuschen und manchmal auch sich selbst.

-

Die grosse Geste: Globales Energie-Budget

Mit der mühseligen, aber einzig seriösen Kleinarbeit, indem man den Zustand und allfällige Entwicklungen der Klimavariablen in vielen Regionen untersucht und vergleicht, könnten die Adepten alarmistischer Botschaften ihr gewünschtes Resultat nicht finden, eine angeblich durch die Menschheit verursachte Erwärmung des «globalen Klimas». Statt dessen hantieren sie mit einer Übersicht über das globale Energie-Budget der Erde gegenüber dem Weltall.

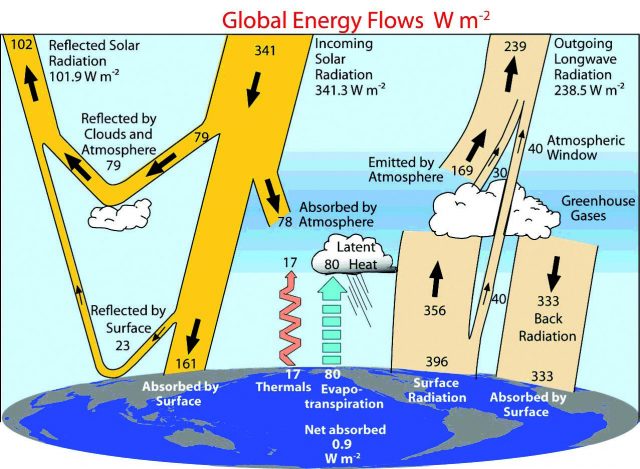

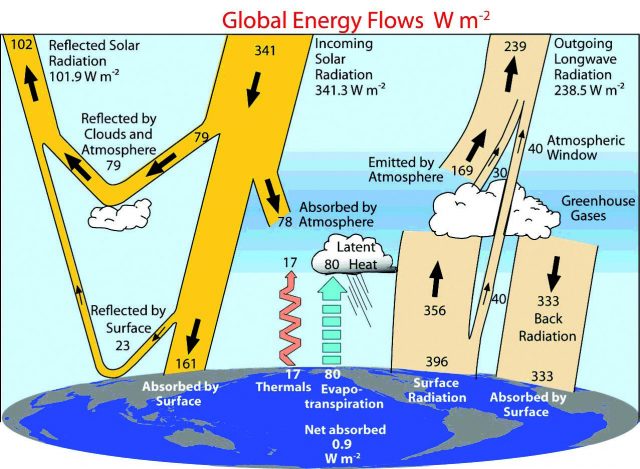

Die Energiebilanz der Erde gegenüber dem Weltall mit Zu- und Abflüssen wird durch die bekannte, im Auftrag des IPCC von Trenberth et al. erarbeitete Graphik dargestellt:

Die an der Erdoberfläche und in der Atmosphäre vorhandene Energie wird durch die Sonnenstrahlung geliefert, davon aber auch quasi alles wieder ins Weltall zurück gestrahlt, teilweise umgehend an Wolken, Schnee und Gewässern reflektiert oder verzögert, nachdem die von der Sonne gelieferte Energie zunächst bei Tag erreichte Flächen der Erde erwärmt, die danach als Infrarot abgestrahlt wird, auch nachts.

Fast alle Energie wird auf dieser Darstellung in Form elektromagnetischer Strahlung transportiert und legitimerweise als «Energie-Fluss» bezeichnet, ausgedrückt in Watt pro Quadratmeter Erdoberfläche; allerdings wohl verstanden, Watt gemittelt über den Jahres-Durchschnitt, über Tag und Nacht, Sommer und Winter, ermittelt über die ganze Erdoberfläche, vom Äquator bis zu den Polen. Wenn man sich diese Darstellung als ungefähre Schätzung vorstellt, ist sie durchaus berechtigt. Aber sie enthält noch ein verstecktes Pferdefüßchen. Von den im Durchschnitt pro Quadratmeter Erdoberfläche eingestrahlten 341 Watt fließen per Saldo nach Rückstrahlung ins Welt-All 0.9 Watt zusätzlich ins System Erde-Atmosphäre und erwärmen somit dieses System ein kleines bisschen, «net absorbed» 0,9 W pro Quadratmeter, die wir dem «Treibhaus-Effekt» zu verdanken hätten.

Bei diesem gewaltigen auf und ab der Temperatur und einem Brutto-Zufluss von 341 W pro Quadratmeter will man einen winzigen Netto-Zufluss von milde aufgerundeten 2,64 Promille heraus rechnen, einmal mehr, genau wie bei der «Durchschnitts-Temperatur», eine völlig überzogene Scheingenauigkeit.

Die angegebenen Werte wurden natürlich nicht im Detail ermittelt, sondern mit spekulativen Methoden aus einzelnen Messungen zusammen gerechnet. Und wer dieses Ergebnis nicht glaubt, zahlt dennoch einen Taler, nämlich Abgaben auf das durch seine Aktivität produzierten CO2, wobei das Ausatmen, die erste Quelle für das vom Menschen verursachte CO2 einstweilen noch großzügig von solchen Abgaben verschont wird!

Für die angeblich garantierte globale Erwärmung gibt es auch eine von den Autoren Schneider und Mas ausgetüftelte mathematische Formel:

Keine der in dieser Formel enthaltenen Variablen betreffen echte Physik oder Meteorologie. Es handelt es sich um spekulativ konstruierte Phantasiegrößen, die man nicht empirisch nachweisen kann. Die «Temperatur» Ts ist die in diesem Zusammenhang bereits erwähnte berüchtigte weltweite Durchschnittstemperatur. Der phantasievoll konstruierte so genannte «Strahlungsantrieb» postuliert ein ideales Gleichgewicht der globalen Strahlung, das durch Treibhausgase gestört werde.

Den seriösesten, ehrlichsten Beitrag zu dieser Art Klima-Wissenschaft lieferte der Mitautor der obigen Formel, Schneider, mit seinem berühmten unverblümten Geständnis, «also müssen wir ängstigende Szenarien liefern, einfache, dramatische Äußerungen machen, und Zweifel, die wir vielleicht haben, wenig erwähnen».

-

«Klima-Ziele»

Auf jedem Gebiet ist der Durchschnitts-Wert aus einer Gesamtheit eine heikle, oft nichts sagende Größe, die immer wieder zu irreführenden Schlüssen führt, in der Agitation zum Klima wurde sie gezielt, allerdings auch plump zur Täuschung des Publikums verwendet.

Bitte sehr, die Frage ist zwar ein bisschen unsinnig. Aber wenn ihr schon fragt, wie hoch ist sie denn, diese «Welt-Durchschnitts-Temperatur»? Man vernimmt da je nachdem Werte um 15°C, ermittelt aus einem unvermeidlich dünnen Netz von Messstationen rund um den Globus mit beliebig großer Fehler-Abweichung. Aber so genau wollen es die Alarmisten ohnehin nicht wissen. Gemäß den im Klima-Abkommen von Paris im Jahre 2015 festgelegten «Klima-Zielen» soll eine mögliche «Erderwärmung» begrenzt werden – um einen sehr präzisen Betrag, Zitat:

-

das Ziel, den Anstieg auf 1,5 °C zu begrenzen, da dies die Risiken und Folgen des Klimawandels deutlich vermindern würde…

Bis zum Jahr 2100 darf diese Erwärmung somit höchstens 2° C betragen, eigentlich lieber 1,5°C. Ok, 2° C wärmer als was bitte? Nun 2° C wärmer als die vorindustriellen Werte! Das ist doch mal eine klare Ansage! Vor Beginn der Industrialisierung hatte die Menschheit ja noch Muße, die Welt-Durchschnitts-Temperatur bis auf ein halbes Grad genau zu ermitteln!?

Vor Beginn der Industrialisierung gab es – mindestens in Europa – die bereits erwähnten extrem kalten Winter. Ja es gab noch Schlimmeres – Eiszeiten. Gemäß den üblichen Theorien zur Erdgeschichte leben wir gegenwärtig im Holozän, einer Zwischeneiszeit, die allenfalls bald zu Ende gehen könnte, so dass sich die Menschheit dann um die 2°C Erwärmung wirklich keine Sorgen mehr machen muss. Umgekehrt kann man vermuten, während der mittelalterlichen Warmzeit sei es in Europa noch wärmer gewesen als heute.

Die «Klima-Ziele» sind eigentlich derart grotesk, dass man sich manchmal fragt, ob sie von heimlichen Saboteuren formuliert wurden, quasi als versteckte Botschaft an die Menschheit, wenn ihr den hier formulierten Unsinn nicht erkennt, ist euch eh nicht zu helfen!

-

Wirtschaftliche Interessen

Die Agitation für «Klima-Schutz» ziert sich mit einer prächtig grün-linken Fassade, aufgebaut von idealistischen Gutmenschen. Aber hinter dieser Fassade haben sich vielerlei handfeste wirtschaftliche Interessen versammelt. Sogar die «schweizerische Erdölvereinigung» bekannte sich opportunistisch zum «Klimaschutz», statt unverblümt zu bekennen, «hört mal, wir glauben nicht an diesen Klima-Blödsinn». Für ihre Scheinheiligkeit wurde die Erdölvereinigung allerdings abgestraft. Die Organisation SwissCleantech legte Beschwerde ein bei der Schweizerischen Lauterkeitskommission, die Erdölvereinigung gehöre nicht zur Vereinigung der Edlen und Reinen. Dabei hat die Erdölvereinigung ein nahe liegendes Motiv, scheinheilig mit den Wölfen zu heulen. Hohe Preise für Erdöl? Aber bitte sehr, wir sind für «Klimaschutz» und sind dann halt nebenbei auch noch zu höheren Gewinnen gezwungen!

SwissCleantech versammelt einen bunten Haufen von Unternehmen, die «alternative Energie» produzieren. Darunter mögen durchaus interessante Technologien vertreten sein. Allerdings könnte man mit diesen niemals den ganzen Energiebedarf decken, und ohne massive staatliche Hilfe wäre vieles davon auf dem Markt nicht konkurrenzfähig. Einige der neuen Technologien sind sogar äußerst bedenklich, etwa Autos mit elektrischem Antrieb als Ersatz für die bisherigen Verbrennungsmotoren. Bei den Elektroautos kommt der Strom zwar bequem aus der Steckdose. Aber von wo und wie gelangt er dort hin? Sollte die Anzahl Elektroautos zunehmen, würden enorme Probleme entstehen, die unter dem Schutz staatlicher Maßnahmen einstweilen nicht ernst genommen werden.

Das große Geschäft ist der «Klima-Schutz» auch für die Riege jener Politiker, die ohne das konstruierte Schreckgespenst nichts zu bieten hätten und wo möglich gezwungen wären, ihren Lebensunterhalt durch Arbeit zu verdienen, wie Kenner wissen, eine manchmal mühsame Sache.

Ein wesentlicher Teil des «Klima-Schutzes» ist direkt oder indirekt nichts weiter als eine Steuer auf den Konsum und damit degressiv, eigentlich ein bisschen unsozial. Aber das stört die etablierten Aktivisten des begüterten grün-roten Establishments gewiss nicht.

Unmittelbar persönliche wirtschaftliche Interessen vertreten die Hohepriester der Klima-Ideologie, die aus ihren üppig entlohnten Positionen in Akademia, an Universitäten und Institutionen zur «Forschung» die herrschende Lehre verkünden und nebenbei den Niedergang jeder seriösen intellektuellen Kultur repräsentieren, in der Widerspruch oder gar Diskussionen unterbunden werden. In einem solchen Schonklima gedeiht entsprechend allerhand Fake Science. Der prominente französische Geophysiker Vincent Courtillot hat schon vor Jahren gewarnt, die Wissenschaft werde für solchen Opportunismus, für die Kollaboration mit den Adepten einer lukrativen Scheinwissenschaft, ihren Preis zahlen müssen.

Wissenschaft hat in vielfältiger Weise maßgeblich zum Fortschritt der Menschheit beigetragen. Gegen Allüren einer quasi religiösen Unfehlbarkeit muss sich die freie Gesellschaft hingegen energisch wehren.