Als hätten Sie nicht schon damit genug zu tun, kommen einfach so ein paar Leute daher stellen 16 „unschuldig anmutende Fragen.“, ob man mit dem Klimawandel nicht auch anders umgehen könne. https://www.klimafragen.org/ Wie kommen die überhaupt dazu, fragen Sie. Schließlich haben die Initiatoren und Unterzeichner keinen persönlichen Vorteil davon, sie müssen nicht ein Institut am Leben halten oder sich wie Politiker als „action heros“ gebären, warum also „verschwenden“ sie ihre Zeit, Kraft und Geld daran, die „Große Transformation“ des Landes zu hinterfragen?

Ob Sie es glauben oder nicht, aber diese Frage stellen wir uns auch manchmal. Warum tun wir uns dies an? Nur, um auch einmal ordentlich diffamiert zu werden? Vielleicht treibt uns die leise Hoffnung an, dass Intelligenz und Vernunft in unserem Land noch nicht völlig ausgestorben sind. Dann aber kommen wieder Zweifel hoch, insbesondere wenn man Beiträge wie den Ihren liest und feststellt, dass die einflussreichen Experten, auf deren Aussage hin wir unser Land umbauen sollen, offenbar nicht einmal sinnentnehmend lesen können. So steht für jedermann erkennbar folgender Satz am Anfang der Fragen:

„Ausgehend von der Annahme, eine menschengemachte Klimaerwärmung sei erwiesen und menschliches Reaktionshandeln darauf geboten, muss – vernunftgeleitet – erörtert werden: Welche Folgen ergeben sich aus dieser Erkenntnis und mit welchen möglichen Maßnahmen kann einer schädlichen Klimaerwärmung mit Aussicht auf Erfolg entgegengewirkt werden?“

Die Tatsache, dass der Klimawandel als solcher unterstellt wird, erschließt sich zudem daraus, dass wir explizit nach möglichen positiven Effekten des Wandels fragen. Das setzt – na, was? Richtig, das setzt einen Wandel voraus.

Tatsächlich hatten wir erwartet, dass Wissenschaftler und auch Journalisten sowohl sinnentnehmend lesen können wie auch grundlegende logische Zusammenhänge verstehen. Wenn dem nicht so ist, dann …Nein, diesen Gedanken wollen wir gar nicht zu Ende denken.

Das Problem ist: So geht es in ihrem Beitrag weiter.

Sie behaupten, wir hätten den IPCC mit den Worten „In Sachen Klimaforschung und -modellierung sollten wir anerkennen, dass es sich dabei um ein gekoppeltes, nicht-lineares, chaotisches System handelt. Deshalb sind längerfristige Vorhersagen über die Klimaentwicklung nicht möglich.“ falsch zitiert hätten.

Das habe er habe nicht gesagt, das wäre falsch übersetzt, außerdem habe er das, was er nicht sagte, so auch nicht gemeint, es handle sich um eine Fehlinterpretation. Im Übrigen habe sich der IPCC um die Probleme der „Restunschärfe“ der Modelle oder auch die „verbleibenden Unsicherheiten“ gekümmert.

Ja was denn nun? Hat er es so nicht gesagt, weil falsch übersetzt oder nicht gemeint? Wenn er es nicht sagte und nicht meinte, welche „Unsicherheiten“ und „Unschärfen“ gibt es dann überhaupt?

Geschrieben hat der IPCC folgendes:

„In climate research and modelling we should recognize, that we are dealing with a coupled non linear chaotic system and therefore that the long-term prediction of future climate states is not possible.” (IPCC, Third Assessment Report, 2001, Section 14.2.2.2, S. 774).

Also wurde der IPCC wortwörtlich richtig zitiert.

Im Folgesatz schreibt „Klimafragen.org“:

„Tatsächlich wohnt Prognosen der klimatischen Entwicklung, die über einen Zeitraum von mehr als zehn Jahren hinausgreifen, keinerlei Vorhersagekraft mehr inne. Die Klimaforschung behilft sich daher mit Szenarien, die zwar plausibel und in sich widerspruchsfrei sind, denen aber aufgrund ihrer Konstruktion keine Eintrittswahrscheinlichkeiten zugeordnet werden können.“

Im englischen Original heißt der Satz:

„The most we can expect to achieve is the prediction of the probability distribution of the system’s future possible states by the generation of ensembles of model solutions. This reduces climate change to the discernment of significant differences in the statistics of such ensembles.”

Wörtlich ins Deutsche übersetzt:

“Das Höchste, was wir erwarten können, ist die Vorhersage der Wahrscheinlichkeitsverteilung der zukünftigen möglichen Zustände des Systems durch die Generierung von Ensembles von Modelllösungen. Dies reduziert den Klimawandel auf die Feststellung signifikanter Unterschiede in der Statistik solcher Ensembles.“

Nochmal: „… die Vorhersage der Wahrscheinlichkeitsverteilung… reduziert den Klimawandel auf die Feststellung signifikanter Unterschiede in der Statistik solcher Ensembles“

Genau das hat „Klimafragen.org“ sinngemäß ausgedrückt und spricht von „keinerlei Vorhersagekraft“.

Also richtige Übersetzung und richtige Interpretation!

Ihr Einwand, dass der IPCC versucht hat, mit Simulationen, die auf unterschiedlichen Modellen auf der Grundlage unterschiedlicher Anfangsdaten beruhen, „die Unschärfe zu beschreiben“ stimmt. Und was ist das Ergebnis?

Auf S. 62 des „Technical Summary“ – Sie wissen schon, der Teil, den weder Politik noch Presse lesen – steht zum Thema:

“Model Response Error

The discrepancy between simulated and observed GMST trends during 1998–2012 could be explained in part by a tendency for some CMIP5 models to simulate stronger warming in response to increases in greenhouse-gas concentration than is consistent with observations. ….

Another possible source of model error is the poor representation of water vapour in the upper atmosphere.”

Das heißt, es gibt eine erhebliche Diskrepanz zwischen simulierter und gemessener globaler Durchschnittserwärmung (Global Mean Surface Warming -GMST), welche zum Teil durch die Tendenz einiger CMIP5 Modelle erklärt werden könnte, eine stärkere Erwärmung aufgrund von Treibhausgasen zu simulieren als sie den Beobachtungen entspricht. Also ist das mit der „Beschreibung der Unschärfe“ zwar sehr hübsch gelungen, nur beseitigt wurde sie nicht.

In Ihrem Beitrag findet sich der bemerkenswerter Satz: Und es ist offensichtlicher Unsinn, allein schon weil die Klimamodelle seit fünfzig Jahren die globale Erwärmung korrekt vorhergesagt haben – übrigens sogar die Firma Exxon im Jahr 1982.“ Damit wird die uneingeschränkte Tauglichkeit von Computermodellen für die Prognose zukünftiger Klimaentwicklungen behauptet – und dies nicht nur für den gegenwärtigen, vergleichsweise fortgeschrittenen Stand der Modellierung, sondern sogar für das vergangene halbe Jahrhundert. Tatsächlich konnte weder der Abfall der Globaltemperatur zwischen 1945 und 1975 (der übrigens damals führende Klimatologen zur Prophezeiung einer neuen Eiszeit veranlasste) noch die zehnjährige „Hiatuspause“ vorher rechnerisch dargestellt werden. Und im Bericht des IPCC von 2007 hieß es noch: „Die Gletscher im Himalaja sind mit hoher Wahrscheinlichkeit bis 2035 oder vielleicht schon früher verschwunden.“ Nach lebhafter Kritik an dieser Aussage brauchte der Weltklimarat drei Jahre, um sie zu revidieren.

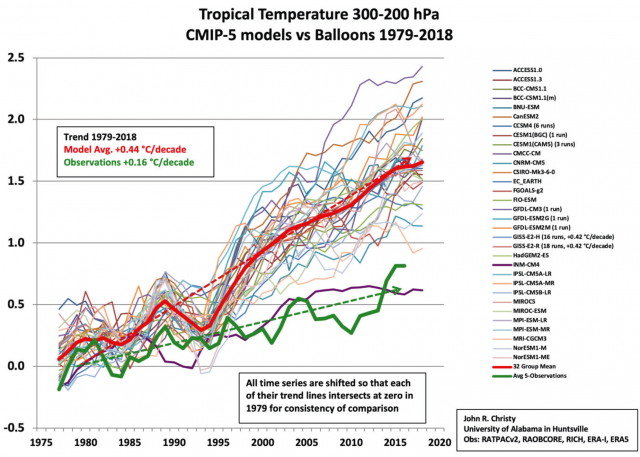

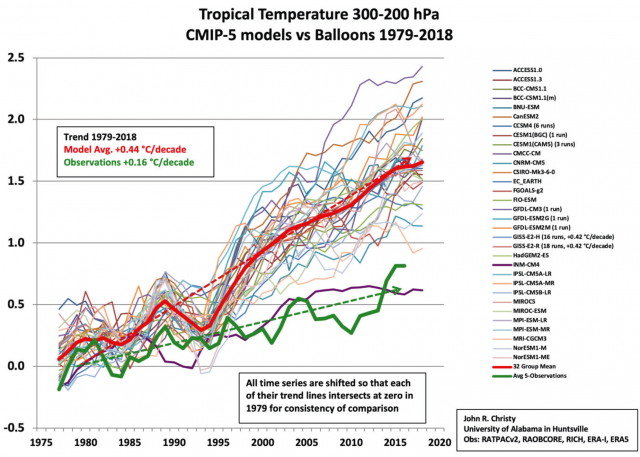

Zur Kennzeichnung der gegenwärtigen Situation soll hier eine Grafik wiedergegeben werden, deren Urheber ein Klimatologe von unbestrittener Weltgeltung ist. Sie wurde dem Protokoll der Anhörung von John R. Christy, vor dem Ausschuss für Wissenschaft, Weltraum & Technologie der Vereinigten Staaten am 29. März 2017 entnommen. John R. Christy ist Klimatologe des Staates Alabama und Professor für Atmosphärenwissenschaft sowie Direktor des Instituts für Wissenschaft des Erdsystems an der Alabama Universität in Huntsville, Leitautor und Peer-Reviewer von Veröffentlichungen des IPCC. Die Grafik 1 zeigt die Ergebnisse von 32 Computermodellen des IPCC für Temperaturverläufe in den Tropen.

Die dicke rote Kurve ist deren Mittelwert. Im Vergleich dazu wurden in der dicken grünen Kurve die realen, durch Ballonmessungen gewonnen Daten eingetragen. Nicht nur die Unterschiede zwischen den Rechenergebnissen verschiedener Institute sondern vor allem die erhebliche Abweichung zwischen deren Mittelwert und dem realen Verlauf zeigen überdeutlich, dass von „korrekter Vorhersage“ keine Rede sein kann.

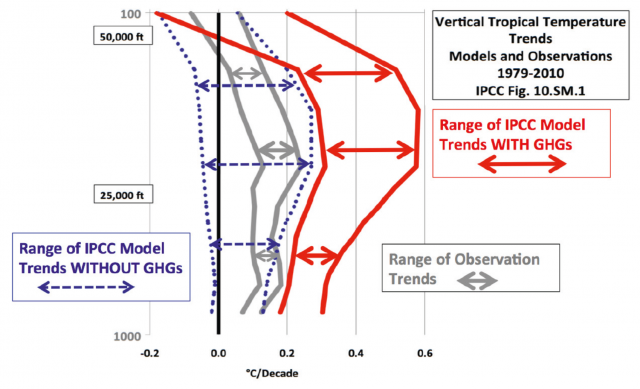

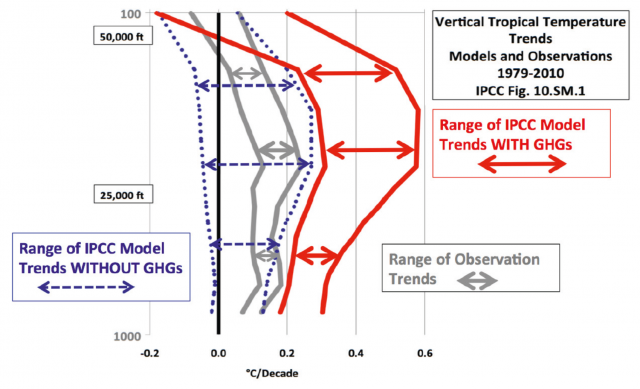

Das Anhörungsprotokoll enthält noch ein weiteres hochinteressantes Ergebnis: Temperaturprofile in den Tropen wurden vom IPCC zum einen unter Berücksichtigung des Treibhauseffektes modelliert und zum anderen ohne diesen Effekt. Während die ersteren keine Übereinstimmung mit den gemessenen Werten aufweisen, liegen die Messungen vollständig im Bereich der Modelle ohne Treibhauseffekt (Grafik 2).

Grafik 1 Quelle: J. R. Christy, Alabama Universität

Grafik 2 Quelle: J. R. Christy, Alabama Universität

Wie volatil die Prognosen des IPCC tatsächlich sind, zeigt auch ein Interview SPIEGEL vom 05. Oktober 2018 mit einem der Leitautoren des letzten Sachstandsberichtes des IPCC , dem Direktor des Max-Planck-Instituts für Meteorologie in Hamburg, Professor Jochem Marotzke. Er erklärt darin: „Unser verbleibendes CO₂-Budget für das 1,5-Grad-Ziel ist wohl mindestens doppelt so groß wie gedacht, fast tausend Gigatonnen. … Offenbar verbleibt ein kleinerer Teil der ausgestoßenen Treibhausgase in der Atmosphäre, weil Wälder und Ozeane mehr davon schlucken als gedacht.“

Das ist eine plötzliche Änderung der bis dahin vom IPCC vertretenen Vorstellungen um mehr als 100 Prozent.

Ein anderer Auszug aus dem Interview ist ebenfalls bemerkenswert:

- SPIEGEL: Warum wurde die Grenze für die Temperaturerhöhung von 2 Grad auf 1,5 Grad abgesenkt?

- Prof. Marotzke: „Das kam auch für uns Klimaforscher überraschend.“

- SPIEGEL: Haben wir es also eher mit politischen Grenzwerten zu tun, nicht mit wissenschaftlich begründeten?

- Prof. Marotzke: „Ja, aber die Größenordnung ist physikalisch durchaus vernünftig.“

Und schließlich konterkariert auch eine weitere lesenswerte Darstellung der Probleme von Klimamodellierung durch einen ausgewiesenen Experten die Behauptung von der „exakten Vorhersage“. Sie findet sich in der SPIEGEL-Ausgabe vom 22. März 2019 und hat den Titel:

„Prognosen zur Erderwärmung, Warum Wolken der Fluch aller Klimaforscher sind“. Darin schildert der seit 20 Jahren am Hamburger Max-Planck-Institut für Meteorologie auf dem Feld der Klimamodellierung forschende Prof. Bjorn Stevens die Schwierigkeiten einer Modellierung des Wolkenphänomens; einige seiner Aussagen lauten „Die Rechenleistung der Computer ist auf das Vielmillionenfache gestiegen, aber die Vorhersage der globalen Erwärmung ist so unpräzise wie eh und je. …. Es ist nicht leicht, dieses Versagen der Öffentlichkeit zu vermitteln. … Die Temperaturen in der Arktis zum Beispiel klaffen in den verschiedenen Modellen um teilweise mehr als zehn Grad auseinander. Das lässt jede Prognose der Eisbedeckung wie bloße Kaffeesatzleserei erscheinen.“

Das könnte nun daran liegen, dass das Weltklima nicht nur ein chaotisches, sondern sogar ein komplexes System ist, das sich mit Differentialgleichungen und anderen mathematischen Modellierungsverfahren gar nicht modellieren lässt. Daher können Klimamodelle bestenfalls die Vergangenheit erklären, aber nichts prädizieren, wie der IPCC zutreffend festgestellt hat.

Nun gibt es zwei Möglichkeiten:

Entweder, man sagt, der IPCC hat Unsinn erzählt und natürlich kann man komplexe Systeme exakt modellieren, alles gar kein Problem. Hier also die Frage an Sie, Herr Rahmstorf: Wollen Sie das behaupten?

Oder man erkennt an, dass der IPCC die Schwierigkeiten bezüglich der Vorhersagbarkeit zutreffend dargestellt hat. Dann allerdings muss unsere Frage 1 mit der Feststellung beantwortet werden, dass man die Einhaltung von Klimazielen nicht sicherstellen kann. Das aber wäre peinlich, oder?

Dann wird es richtig interessant: Der Jahrhundertsommer 2003 habe 70.000 Todesopfer gekostet, alles unmittelbare Folge des Klimawandels. Beweis einer Kausalität? Fehlanzeige. Und der naheliegende Gedanke an den ebenso einfachen wie lebensrettenden Einsatz von Klimaanlagen, der ohne große Transformation möglich wäre, ebenso Fehlanzeige.

Der Krieg in Syrien – klarer Fall, auch Klimawandel. Bei allem Respekt, aber so geht es nicht

Fazit ist: Sie haben viel geschrieben, aber nicht eine einzige Frage beantwortet.

Alles in allem erreicht das Filmchen eine neue Stufe der Desinformation durch den Haltungsjournalismus in den öffentlich-rechtlichen Medien. In der Einleitung werden Behauptungen aufgestellt, die in dem nachfolgenden Bericht gar nicht wieder aufgegriffen, geschweige denn belegt werden und sie lassen sich überdies mit ein paar Klicks im Internet bei der Originalquelle widerlegen.

Alles in allem erreicht das Filmchen eine neue Stufe der Desinformation durch den Haltungsjournalismus in den öffentlich-rechtlichen Medien. In der Einleitung werden Behauptungen aufgestellt, die in dem nachfolgenden Bericht gar nicht wieder aufgegriffen, geschweige denn belegt werden und sie lassen sich überdies mit ein paar Klicks im Internet bei der Originalquelle widerlegen.