Merkel, das IPCC und die Geister, die sie rief: Teil 4 – Der „himmlische“ Wind

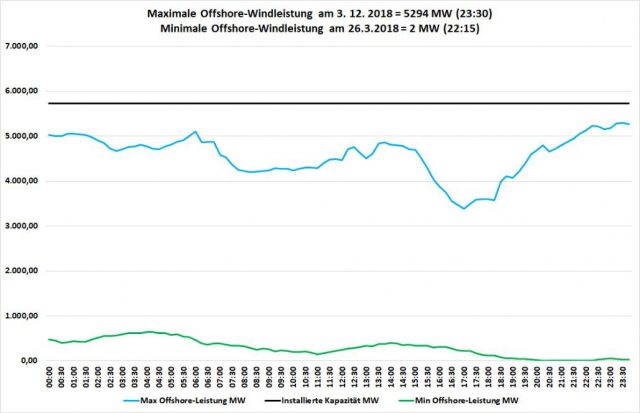

Im Teil 3 war dargelegt worden, welche Anforderungen Technologien zur Stromerzeugung erfüllen sollten, wenn damit unsere heutige technische Zivilisation aufrechterhalten werden soll. Dazu wurde der aktuelle Strombedarf sowohl bezüglich des Jahresverlaufs als auch im Detail des Wochen- und Tagesverlauf analysiert und aufgezeigt, wie entscheidend die Frage sofortiger Verfügbarkeit bei Bedarf ist. Eine eingehende Betrachtung der Charakteristiken der Fotovoltaik zeigte bereits, dass diese in keiner Weise imstande ist, die sichere Versorgung einer modernen Industrienation mit elektrischer Energie zu gewährleisten. Werfen wir jetzt einen Blick auf das Potenzial der Windenergie – sowohl an Land als auch auf See.

Windenergie an Land

In Deutschland standen im Jahr 2018 rund 29.000 Windenergieanlagen an Land (Onshore) mit einer (im Jahresmittel) nominellen Leistung von 52.014 MW. Im Verlauf des Jahres lieferten sie insgesamt 89.500.000 MWh (89,5 Terawattstunden) Strom ab. Hieraus ergibt sich ein mittlerer Jahres-Nutzungsgrad von lediglich 19,6 %. Anders ausgedrückt: Im Prinzip stehen diese Milliarden teuren Windräder zu mehr als 80 % des Jahres still und liefern keinen Strom. In der gewerblichen Wirtschaft könnten Kaufleute oder Ingenieure, die so etwas zu verantworten hätten, vermutlich ihre Papiere abholen. Politiker werden dagegen für solche Leistungen mit Wählerstimmen belohnt…

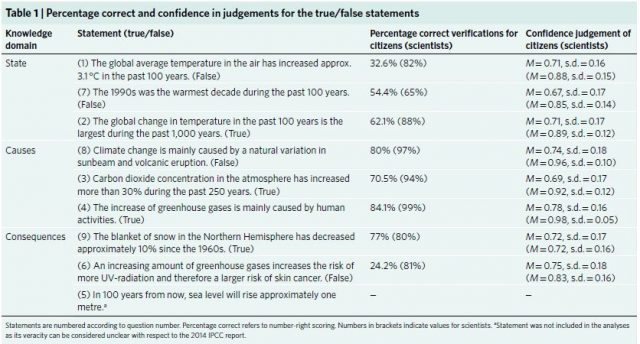

Zunächst interessiert natürlich die Frage, wie gut denn nun die tägliche Windstromerzeugung zum jeweiligen Tagesbedarf über das Gesamtjahr 2018 hinweg passt, Bild 2.

Bild 2. Tag-für-Tag-Gegenüberstellung der Onshore-Windstromerzeugung mit dem jeweiligen Bedarf (Grafik und Berechnungen: Autor, Daten)

Bild 2 vermittelt auf den ersten Blick noch nicht allzu viele Erkenntnisse, abgesehen von der Tatsache, dass die Windstromproduktion von Tag zu Tag erheblichen Schwankungen unterliegt. Um die tatsächliche Bedeutung dieser Schwankungen besser einschätzen zu können, sollte man sich zunächst die absoluten Minimal- und Maximalwerte ansehen, da dies Informationen über die Zuverlässigkeit der Stromquelle „Windenergie“ liefert. Dass der Wind lokal starken Schwankungen unterliegt, ist ja bereits seit den Zeiten der ersten Segelschiffe bekannt. Wir erinnern uns auch, dass die Vertreter der Windkraftlobby in diesem Zusammenhang mit dem Spruch „irgendwo weht immer Wind“ auftraten und behaupteten, unterschiedliche Windstärken würden sich aufgrund der Größe Deutschlands mehr oder weniger ausgleichen. Da uns die Erzeugungsdaten von 29.000 über ganz Deutschland verteilten WEA-Anlagen zur Verfügung stehen, schauen wir uns einmal diese Min-Max-Werte genauer an, Bild 3.

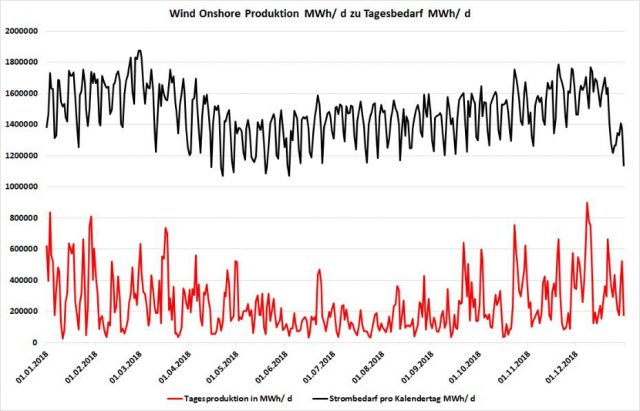

Bild 3. Minimale und maximale Leistung der deutschen Onshore-Windenergieanlagen im Jahr 2018 (Grafik und Berechnungen: Autor, Daten)

Der in Bild 3 dargestellte Leistungsverlauf bei Schwachwind ist mit Blick auf die Versorgungssicherheit geradezu niederschmetternd. Entscheidend für die Netzversorgung ist nämlich die sogenannte gesicherte Leistung, d.h. diejenige Leistung, auf welche sich die Versorger auch im sogenannten „worst case“-Fall in jedem Fall verlassen können. Diese entspricht mit blamablen 179 MW gerade einmal 3,4 PROMILLE der installierten Gesamtleistung von 52.014 MW. Da der Sonnenstrom seinerseits trotz einer installierten Leistung von 43.036 MW überhaupt keine gesicherte Leistung liefern kann, sind Solar- und Onshore-Windstrom selbst zusammen trotz ihrer Gesamtkapazität von zusammen 95.050 MW bei ungünstiger Wetterkonstellation nicht imstande, zusammen auch nur 1,9 PROMILLE ihrer Nennleistung ins Netz zu liefern. Anders ausgedrückt: Zur Sicherstellung der Versorgung der Bevölkerung mit Strom muss zu allen Zeiten ein komplettes Ersatz-System mit der vollen Kapazität zur Deckung der Netzlast von bis zu 90.000 MW als Ersatz für die „klimarettenden“ Technologien bereitstehen und innerhalb kürzester Zeit in Aktion treten können. Das entspricht der Kapazität von mindestens 90 Steinkohlekraftwerken oder 64 Kernkraftwerken oder 105 Gas-und-Dampf-Kraftwerken des Typs Irsching 5. Diese Kraftwerke müssen wohlgemerkt rund um das Jahr mitsamt vierschichtiger Belegschaft im perfekt gewarteten und einsatzbereiten Zustand bereitstehen, um jederzeit einspringen zu können, wenn Wind und Sonne keine Lust haben, ihren Job zu erledigen. Das bedeutet, dass der komplette Kostenumfang (bis auf die Brennstoffkosten) das gesamte Jahr über anfällt und selbstverständlich vom Stromkunden zu bezahlen sein wird. Angesichts dieser Zahlen aus der Realität ist es nichts weiter als ein schlechter Witz, wenn die bundeseigene Deutsche Energie Agentur (DENA) für die Beurteilung der gesicherten Leistung des Windstroms bei der Kalkulation des sogenannten Leistungskredits von Windenergieanlagen einen Satz von vollen 6 Prozent in Ansatz bringt. Ein weiterer der zahllosen Tricks, mit denen sich die Politik ihr Ziehkind „Energiewende“ schönrechnet.

Um die Sache auf den Punkt zu bringen: Deutschland hätte von heute auf Morgen eine gesicherte Stromversorgung, einfach indem sämtliche Wind- und Solaranlagen sofort endgültig abgeschaltet würden. Und wir hätten uns eine Billion Euro an sinnlos aus dem Fenster geworfenem Geld erspart.

Und das „Wunderkind“ Offshore-Windenergie?

Da der Wind auf See bekanntlich stärker und gleichmäßiger weht als an Land, wurden bereits seit Jahrzehnten Planungen zur Errichtung von sogenannten Offshore-Windenergieanlagen vorangetrieben. Handicap waren die im Vergleich zu Installationen an Land erheblich höheren Anlagenkosten, die sehr rauen Einsatzbedingungen sowie die Kosten und Probleme der Stromübertragung von See an Land. Investoren mussten daher mit besonders hohen EEG-Zahlungen sowie der Übernahme der gesamten Anschlusskosten bis zum Land zusätzlich angelockt werden. Die ersten Stromlieferungen von Offshore-Windparks setzten daher erst im Jahre 2013 ein, mit Ende 2018 waren dann insgesamt rund 6400 MW Leistung vorhanden. Die mittlere Anlagenkapazität lag für 2018 bei 5730 MW, also etwas mehr als 10 % der Onshore-Kapazität. Im Bau sind inzwischen weitere Parks mit mehr als 3.000 MW.

Angesichts der erheblich besseren Windverhältnisse auf See gab es bei den entsprechenden Unternehmen hochfliegende Erwartungen bezüglich der zu erwartenden Nutzungsgrade, die bei deutlich über 40 % liegen sollten. Dem Verfasser ist noch eine Fernsehsendung erinnerlich, in der eine Ingenieurin davon schwärmte, mit den Offshore-Windparks sei man fast schon grundlastfähig. Diese Erwartungen scheinen sich allerdings nicht so recht zu erfüllen, denn der Nutzungsgrad der deutschen Offshore-Windstromproduktion lag für das Jahr 2018 bei lediglich 38 %, das ist nur etwa doppelt so hoch wie der an Land erzielte Wert.

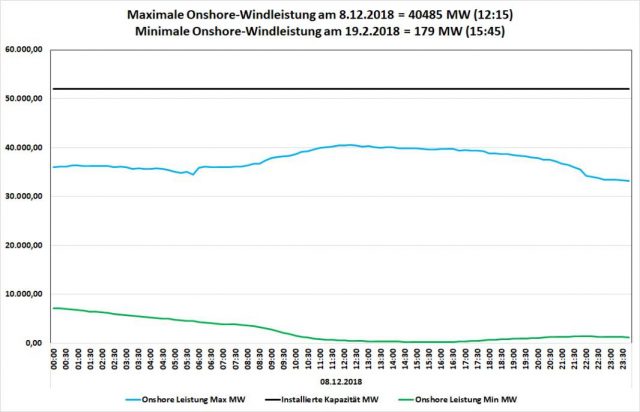

Als nächstes ist anschließend von Interesse, wie sich die angeblich stabileren Windverhältnisse auf See auf die Mindest-Stromerzeugung auswirken, Bild 4.

Bild 4. Minimale und maximale Leistung der deutschen Offshore-Windenergieanlagen im Jahr 2018 (Grafik und Berechnungen: Autor, Daten)

Wie Bild 4 ausweist, erreichten die Offshore-WEA am besten Tag des Jahres geradezu phantastische Leistungsabgaben zwischen 59 und mehr als 90 % ihrer Nennleistung (Höchstwert 92,4 %). Doch wie sieht es am anderen Ende der Leistungsskala aus? Der Minimalwert am 26.3.2018 ist mit ganzen 2 MW bzw. 0,35 PROMILLE der Nennleistung sogar noch enttäuschender als derjenige der Onshore-Anlagen. Es kann daher festgehalten werden, dass weder Sonne noch Wind – egal ob Offshore oder Onshore – imstande wären, die für Deutschland unabdingbare kontinuierliche Versorgung mit elektrischem Strom sicherzustellen. Um eine komplette, ununterbrochen an 365 Tagen im Jahr rund um die Uhr einsatzbereite Phalanx einsatzbereiter Fossil- oder Kernkraftwerke kämen wir daher auch bei forciertem Ausbau der Offshore-Windenergieversorgung keinesfalls herum.

Auch zusammengeschirrt bilden drei tote Pferde kein brauchbares Gespann

Wie diese Beispiele deutlich zeigen, erfüllt keine der drei angesprochenen Stromerzeugungstechnologien auch nur annähernd die Anforderungen, die an die Stromversorgung Deutschlands zu stellen sind. Da jedoch Sonne und Wind sowie Onshore- und Offshorewind nicht unmittelbar voneinander abhängen, wird seitens der Profiteure dieser Energieformen immer wieder behauptet, die Schwächephasen träten nicht gleichzeitig auf und in der Kombination aller drei Quellen komme es zu einem Ausgleich. Was sagen hierzu die Daten des Jahres 2018, Bild 5 und Bild 6.

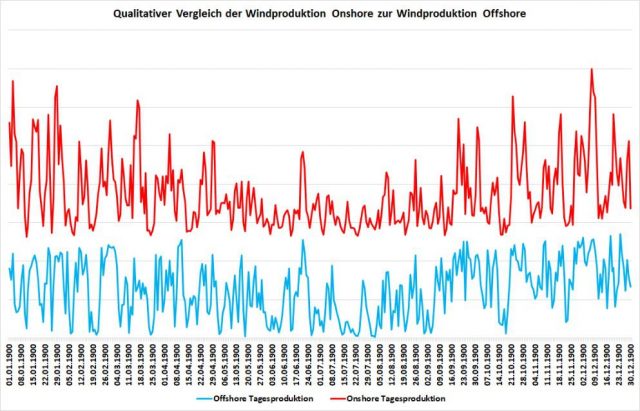

Bild 5. Qualitativer Vergleich der Tagesproduktion von Onshore- und Offshore-Windstromanlagen in Deutschland für das Jahr 2018 (Grafik und Berechnungen: Autor, Daten)

Zur besseren Vergleichbarkeit wurde die Kurve der Offshore-Windstromdaten in Bild 5 so gespreizt, dass die relativen Amplituden denen der Onshore-Windstromdaten entsprechen. Aus den Kurvenverläufen ist zu erkennen, dass Leistungsspitzen und -täler häufig zeitlich mehr oder weniger überlappend auftreten, auch wenn sich ihre relativen Amplituden teils deutlich unterscheiden. Das ist auch nicht weiter verwunderlich, da die Windfelder zwischen Land und See eine gewisse Zeit unterwegs sind, bevor sie Einfluss auf die jeweilige Stromproduktion haben. Eine nennenswerte gegenseitige Kompensation ist jedenfalls nicht erkennbar. Besonderes Augenmerk verdient in diesem Zusammenhang der Verlauf der drei „erneuerbaren“ Stromerzeuger am 19.2.2018, Bild 6.

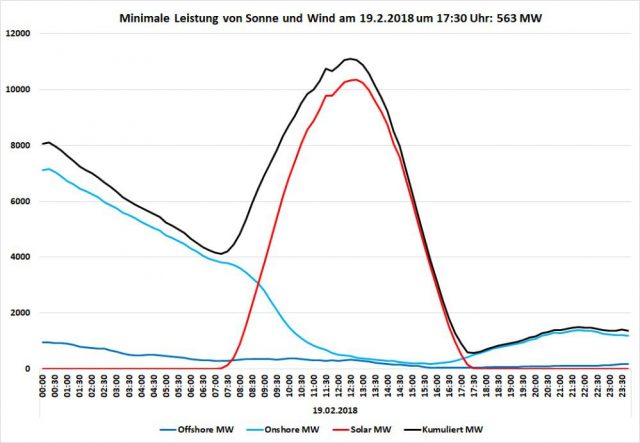

Bild 6. Verlauf der Leistungsabgaben von Sonne und Wind am 19.2.2018 (Grafik und Berechnungen: Autor, Daten)

Der 19.2.2018 war ein eisiger Tag mit Temperaturen bis teils in den tiefen Frostbereich. In Zeitschriften war von einer „Russenpeitsche“ die Rede, d.h. einer Ostströmung kalter Luft. Tagsüber lag der Strombedarf bei bis zu 77.000 MW und fiel auch in den Nachtstunden nicht unter ca. 60.000 MW. Die Kombination aus kalter Luft aus dem Osten bei niedrigen Windgeschwindigkeiten und geringer Sonneneinstrahlung aufgrund der kurzen Tageslichtzeit und des niedrigen Sonnenstandes ist in Fachkreisen auch als „Dunkelflaute“ bekannt. Gerade in dieser kritischen Lage zeigte sich, dass Deutschland nicht auf die „erneuerbaren“ zählen konnte. Die getrennte Darstellung der drei Erzeugervarianten zeigt, dass sowohl Onshore- als auch Offshore-Windenergie bereits ab ca. 07:00 Uhr auf katastrophal niedrige Werte einbrachen. Ab dieser Zeit hielt einzig die aufgrund des klaren Himmels einigermaßen ansteigende Solarstromproduktion die „EE“-Fahne noch hoch, während der Wind seinen Dienst um ca. 15:00 Uhr nahezu komplett einstellte. Nur Onshore-Wind frischte ab ca. 16.00 wieder etwas auf, so dass die Bilanz nicht ganz so katastrophal ausfiel, wie es hätte sein können. Immerhin lieferten Sonne und Windanlagen um 17:30 Uhr zusammen noch 563 MW ins Netz. Das waren stolze 5,6 PROMILLE der gesamten installierten 100.780 MW an installierter „EE“-Leistung. Bei den einzelnen Teilnehmern an diesem Wettbewerb brauchen wir nur die beiden Wind-Kategorien zu berücksichtigen, da Solarstrom aus den bekannten Gründen von vorherein keinerlei Versorgungssicherheit bieten kann. Bei Onshore-Wind lag das Leistungsminimum bei 179 MW (3,4 PROMILLE der installierten Leistung), während Offshore noch 42 MW ablieferte, was immerhin 7,3 PROMILLE der eigentlich installierten Kapazität ausmachte. Lediglich der Zeitversatz von etwa 75 Minuten zwischen den beiden Minima und die Tatsache, dass die Sonne noch etwa eine Stunde lang stützend zur Verfügung stand, verhinderte Schlimmeres. Selbst für jemanden ohne tiefer gehenden technischen Sachverstand ist es unbegreiflich, wie eine Regierung auf ein solches Gespann toter Pferde als entscheidende Stützen der künftigen Energieversorgung des Lands setzen kann.

Zusatzproblem: Prognoseabweichungen

Ein bisher in Veröffentlichungen zur Windenergie wenig berücksichtigtes Problem sind die sogenannten Prognoseabweichungen. In einem komplexen Hochleistungssystem wie unserer Stromversorgung ist die Planbarkeit von Leistung unabdingbar, und zwar sowohl bezüglich des Bedarfs als auch mit Blick auf die Produktion. Nur so ist es möglich, teure Kapazitäten und Ressourcen so kosteneffizient wie möglich bereitzustellen. Ja brutaler man anderenfalls Kraftwerke bei ungeplanten Laständerungen „mit quietschenden Reifen durch die Gänge jagen“ muss, desto höher ist der Verschleiß und desto häufiger sind Stillstände sowie vorzeitige (und oft sehr teure) Reparaturen. Dies wirkt sich auch unmittelbar auf die Beschaffungspreise für den Strom aus, denn je kurzfristiger ungeplante Beschaffungen oder Stornierungen anfallen, desto teurer dann an den Börsen. Deshalb haben die Erzeuger die voraussichtlichen Lastgänge schon seit Jahrzehnten sorgfältig abgeschätzt, um z.B. bei abendlichen Fußballereignissen bereit zu sein, wenn Millionen Sportfans nahezu gleichzeitig ihre Fernseher anknipsen. Allerdings hatte man damals zumindest Gewissheit darüber, dass die Kraftwerke dann das, was das Netz benötigte, auch würden liefern können.

Mit der Zunahme der wetterabhängigen Stromquellen Wind und Sonne wird diese Berechenbarkeit auf der Versorgungsseite ausgehebelt. Neben den bisherigen – und dank der Erfahrung der Versorger einigermaßen gut abschätzbaren – Störgrößen kommen jetzt auch noch diejenigen auf der Erzeugerseite hinzu, die in ganz anderen Größenordnungen auftreten. Hierfür gibt es mittlerweile spezialisierte Dienstleister, die mithilfe von Wetterdaten und ausgefeilten Programmen versuchen, die Auswirkung der jeweiligen Wetterkapriolen auf die Lieferung von Solar- und Windparks vorherzusagen. Schließlich müssen die Stromversorger alles, was Wind und Sonne zu liefern imstande sind, komplett abnehmen und den „fossilen“ dann eventuell kurzfristig mitteilen: „Nett, dass ihr euren Kessel auf Betriebstemperatur vorgeheizt habt, aber auf den entsprechenden Kosten bleibt ihr leider sitzen, wir brauchen euren Strom doch nicht, weil der Wind plötzlich aufgefrischt hat“. Auf den Kosten bleiben die „konventionellen“ Erzeuger dann sitzen bzw. müssen sie über ihre Preise letztlich an die Verbraucher weiterreichen.

Leider sind Wetterprognosen bekanntlich mit großen Ungenauigkeiten behaftet (es sei denn, sie betreffen die ferne Zukunft, dann erreichen sie als Klimaprognosen eine verblüffende Präzision). Beim Wind ist es besonders schwierig, und leider geht gerade die Windgeschwindigkeit mit der 3. Potenz in die Stromertragskalkulation der Windenergieanlagen ein. Schauen wir uns daher einmal an, wie weit manche Prognosen nach unten bzw. oben im Jahr 2018 an der Realität vorbeigingen, Bild 7 und Bild 8.

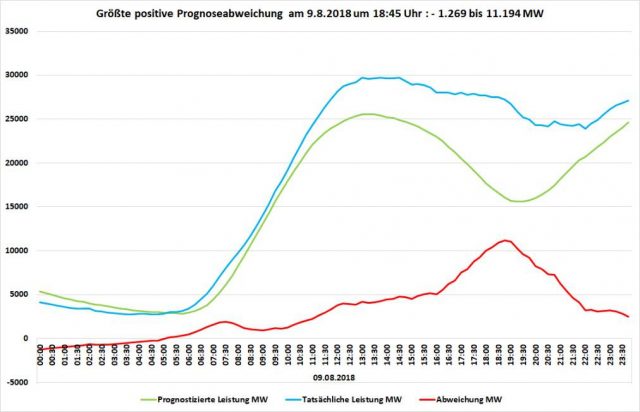

Bild 7. Größte Prognoseabweichung nach oben des Jahres 2018 (Grafik und Berechnungen: Autor, Daten)

Der Autor hatte bereits im Jahr 2014 Untersuchungen zu Prognoseabweichungen bei der Windstromerzeugung durchgeführt. Damals erreichte der größte positive Prognosefehler 7.800 MW bei rund 34.000 MW an installierter Leistung. Zu den 2018 in Bild 7 ausgewiesenen mehr als 11.000 MW ist anzumerken, dass hierzu im Prinzip noch die am gleichen Tag aufgetretene Negativabweichung von -1.269 MW hinzuzurechnen ist. Deswegen hatten die Stromversorger innerhalb von nur 19 Stunden diese Gesamt-Prognosedifferenz von 12.463 MW zu bewältigen. Da beide Peaks – der positive wie auch der negative – außerhalb des Zeitfensters starker Solarleistung auftraten, sind die Abweichungen nahezu ausschließlich dem Konto der damals installierten Windkapazität von rund 57.740 MW zuzurechnen. Der Fehler lag in beiden Jahren mit jeweils 21,6 bzw. 22,9 % der installierten Gesamtleistung erstaunlich gut in der gleichen Größenordnung. Dies weist darauf hin, dass die Zuverlässigkeit der Prognosen in den fünf Jahren seither trotz aller Fortschritte der Computer- und Messtechnik nicht verbessert werden konnte.

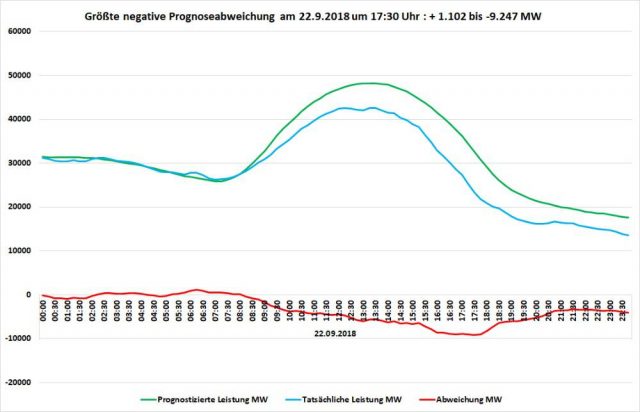

Bild 8. Größte Prognoseabweichung nach unten des Jahre 2018 (Grafik und Berechnungen: Autor, Daten)

Wesentlich kritischer sind allerdings die negativen Prognoseabweichungen, die bei der damaligen Untersuchung noch bei der Hälfte dessen lagen, was in positiver Richtung auftrat. Wie Bild 8 zeigt, liegen sie inzwischen in der gleichen Größenordnung wie die positiven (-9.247 -1.102 = -10.349). Für die Versorgungssicherheit sind negative Abweichungen viel kritischer als positive. Wenn weniger Leistung benötigt wird als prognostiziert, kann man den Überschuss wenigstens noch mit negativen Preisen ins Ausland verhökern, wie es ja heute immer mehr zur Regel wird, denn der Schaden ist dann zumindest nur rein finanzieller Art. Anders ist es jedoch bei größeren Defiziten, denn dann drohen irgendwo die Lichter auszugehen. Mehr als 10.000 MW an Leistungs-Unterdeckung bedeutet, dass mal eben auf die Schnelle rund 10 Großkraftwerke von Null auf volle Leistung hochgefahren werden müssen. Und in wenigen Jahren sollen ja genau diese Kraftwerke nicht mehr zur Verfügung stehen.

Zusatzproblem: Die Gradienten von Sonnen- und Windstrom

Ein weiteres Handicap der „EE“-Stromerzeugung resultiert aus der Kombination der Willkürlichkeit der Schwankungen der jeweils angebotenen Leistung mit den ständig gesteigerten Kapazitäten, was sich in den nächsten Jahren weiter verschärfen wird. Bereits Anfang 2019 lag die nominell installierte Kapazität von Onshore- und Offshore-Windanlagen sowie Fotovoltaik bei insgesamt rund 104.000 MW (6.393 MW Offshore-Wind, 52.700MW Onshore-Wind und 44.905 Solar). Bei entsprechender Wetterlage könnten diese Anlagen bereits nahezu den gesamten Strombedarf decken, insbesondere an Feiertagen in der warmen Jahreszeit. Das Problem: Damit würden nicht nur sämtliche fossilen und kerntechnischen Kraftwerke faktisch zum Stillstand gezwungen, sondern es käme auch zu Konflikten mit den anderen „EE“-Erzeugern wie Wasserkraft, Biomasse oder Müllverbrennung sowie der Kraft-Wärmekopplung. Über diese mit dem weiteren Zubau zunehmend drohenden Probleme hört man jedoch kaum etwas. Auf der anderen Seite müssen immer ausreichend Kraftwerkskapazitäten bereitstehen, damit bei schwächelnder „EE“-Stromerzeugung die Versorgung des Landes nicht zusammenbricht. Das stellt sowohl die Besitzer konventioneller Kraftwerke als auch die Betreiber der Übertragungsnetze vor Aufgaben, die mit jeder zusätzlichen Windmühle sowie jedem zusätzlichen Solarpaneel schwieriger bis unlösbarer werden. Schauen wir uns einmal an, welche Folgen es für die anderen Stromversorger hat, wenn die Stromproduktion aus Wind und Sonne wetterbedingt massive Schwankungen hinlegt, Bild 9.

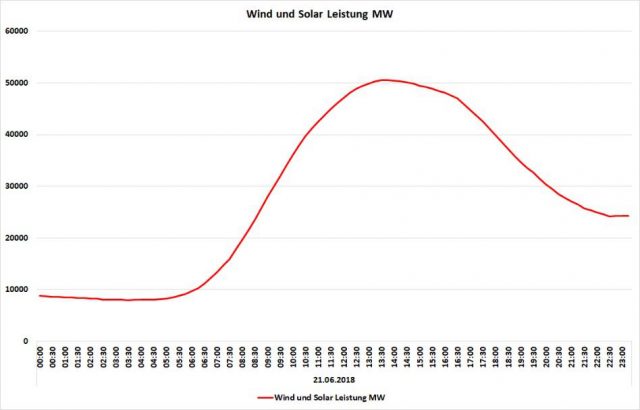

Bild 9. Entwicklung der Leistungsbereitstellung von Wind- und Solarstromerzeugern im Laufe des 21. Juni 2018 (Grafik und Berechnungen: Autor, Daten)

Aus Bild 9 geht hervor, dass die kombinierte Leistung der Wind- und Solarstromerzeuger am 21.6.2018 ab 5:00 Uhr innerhalb von nur 8 Stunden um gut 42.500 MW nach oben schoss, um danach wieder auf rund 24.300 MW abzusacken. Das entspräche dem gestaffelten Zuschalten von 42 Kohlekraftwerken oder fast 50 Gaskraftwerken des Irsching-5-Typs innerhalb einer einzigen Schicht. Und kurz danach hätte man 26 dieser Kohlekraftwerke bzw. 31 Gaskraftwerke wieder auf Null herunterfahren müssen, nur um diese wetterbedingte Leistungsschwankung wieder aufzufangen. Die konventionellen Erzeuger werden nicht nur immer stärker zu reinen Lückenbüßern der „erneuerbaren“ degradiert. Diese brutalen Schwenks verursachen zudem immer höhere Kosten. Andererseits erlauben die Behörden den Betreibern häufig nicht, ihre ins Defizit getriebenen Erzeugungseinheiten abzuschalten und vom Markt zu nehmen. Derzeit sind von den Betreibern 45 Kraftwerke mit einer Gesamtleistung von 11.179 MW zur Stilllegung angemeldet. Hiervon wurden 23 mit einer Gesamtkapazität von ca. 6.800 MW als „systemrelevant“ eingestuft, was bedeutet, dass die Betreiber gezwungen werden, ihre nicht mehr rentablen Einheiten weiterhin betriebsbereit zu erhalten.

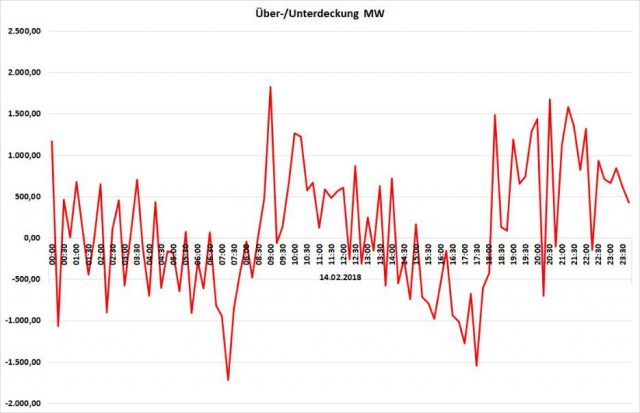

Ebenso bedeutsam, aber in der Regel kaum irgendwo erwähnt ist die Frage des Ausgleichs der kurzfristigeren Schwankungen zwischen dem Netzbedarf und der Erzeugung von Sonnen- und Windstrom. Hierzu wurden die viertelstündlichen Messdaten von Erzeugung und Verbrauch miteinander verglichen und die Veränderungen herausgefiltert. Es geht also nur um die innerhalb der jeweiligen Viertelstunde erkennbaren Unterschiede, die selbstverständlich von den (noch) vorhandenen regelbaren Kraftwerken sekundengenau ausgeglichen werden müssen, Bild 10.

Bild 10. Kurzzeitschwankungen und damit entstehender kurzfristiger Ausgleichsbedarf zwischen Erzeugung (Wind und Solar) sowie Netzbedarf am 14.2. 2018 (Grafik und Berechnungen: Autor, Daten)

Die grafische Auftragung zeigt ein wildes Zackenmuster mit Amplituden von bis zu mehr als ± 1.500 MW. Jede dieser Zacken erfordert also die sehr kurzfristige Bereitstellung von Ausgleichsleistung – teils negativ, teils positiv – in einer Größenordnung, die der Leistung von 1-2 Kohle- oder Gaskraftwerken entspricht. Ohne dieses ständige Ausbügeln der Schwankungen der „erneuerbaren“ Stromerzeuger würde das Netz innerhalb kürzester Zeit instabil werden. Je mehr dieser „Zappelstromquellen“ die Bundesregierung jetzt mit der Brechstange ans Netz bringen will, desto schlimmer wird es. Mit der weiter voranschreitenden Stilllegung zuverlässig regelbarer Kraftwerke wird irgendwann ein Kipppunkt unterschritten werden, ab dem die Netzstabilität nicht mehr gewährleistet werden kann.

Hintergrundliteratur

Limburg, M.; Mueller, F.: Strom ist nicht gleich Strom TvR Medienverlag, Jena, ISBN 978-3-940431-54-7