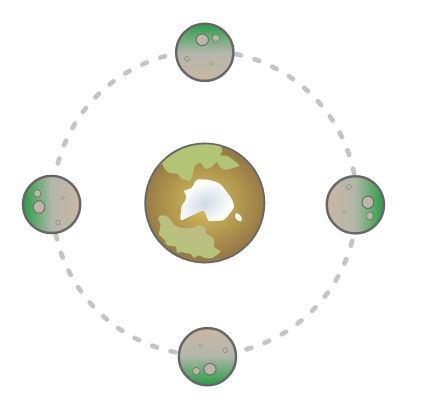

Erste Erkennung von Klimawandel auf einem anderen Planeten?

Falschfarbenbild der Nachtseite der Venus, aufgenommen mit der IR2-Kamera auf Akatsuki bei 1,735 µm (blau) und 2,26 µm (rot) und Mischung der beiden (grün). Auf der Nachtseite der Venus beobachtet IR2 das Infrarotlicht, das aus der unteren Atmosphäre durch die Wolken kommt, und der Schatten der Wolken ist im Bild zu sehen. Hier werden Hell und Dunkel umgekehrt, um Wolken in weißlicher Farbe anzuzeigen. (Bildnachweis: JAXA / PLANET-C-Projektteam –http://cosmos.isas.jaxa.jp/?p=700)

Akatsuki hat möglicherweise entdeckt, warum sich die Atmosphäre der Venus so schnell dreht. Der Grund kann für die Bewohnbarkeit erdgroßer Exoplaneten eine entscheidende Rolle spielen.

Die Venus ist ein Planet, der in Größe und Masse fast wie die Erde ist. Dies ist eine wesentliche Studie, um die möglichen Bedingungen auf felsigen Planeten zu verstehen. Ein bestimmendes Merkmal unserer Nachbarwelt ist eine dichte, dicke Atmosphäre, deren reflektierende Eigenschaften die Astronomen dazu verleiteten, den Planeten nach der mythologischen Göttin der Schönheit zu benennen – die Fähigkeit der Atmosphäre Wärme einzufangen, treibt jedoch die Oberflächentemperatur bis zum Schmelzpunkt von Blei.

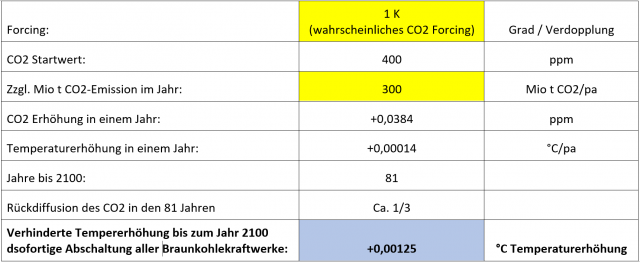

Ausgewählte Werte zum Vergleich der Planeten

Quelle: Mark A. Garlick, „Der große Atlas des Universums“, Kosmos Verlag, 2011, 2. Ausg.

| Erde | Venus | |

| Durchschnittlicher Sonnenabstand |

149,6 Mio km (1AE) | 108,2 Mio km (0,72 AE) |

| Sonneneinstrahlung gemittelt |

1361 Watt/m² (max, oberer Rand der Atm.) |

(Erde = 1) 1,91 |

| Äquatordurchmesser | 12.756 km | 12.104 km |

| Rotationsdauer (siderisch, d.h. vollständige Umdrehung) | 23,93 h | 243 Tage (retrograd = rückläufig) |

| Masse | 5,974 x 10^24 kg | (Erde = 1) 0,82 |

| Volumen | 1,08 Bill km³ | (Erde = 1) 0,86 |

| Gravitation an Oberfläche | 1 g (9,8 m/s²) | (Erde = 1) 0,91 |

| Durchn. Dichte | 5,5 (Wasser = 1) | 5,24 |

| Druck an der Oberfläche | 101,4 kP | (Erde = 1) 92 |

| Höchsttemperatur | 58°c | 464 °C |

| Tiefstemperatur | -88°C (~-94°C akt. !) |

Ergänzung durch den Übersetzer

Die seltsamste Erscheinung der venusianischen Atmosphäre ist vielleicht ihre Geschwindigkeit. Winde peitschen um den Planeten bis zu 60-mal schneller als sich die Oberfläche dreht; ein Phänomen, das als atmosphärische Superrotation bekannt ist.

Die Windgeschwindigkeiten auf der Venus sind in den oberen Wolkenschichten mit mehr als 100 m/s (360 km/h) recht hoch. Die Oberfläche des Planeten dreht sich jedoch extrem langsam. Der Planet umkreist die Sonne in 225 Erd-Tagen, benötigt jedoch 243 Erd-Tage, um sich um seine Achse zu drehen, wodurch der Venus-Tag (eine vollständige Umdrehung) länger dauert als ein Venus-Jahr.

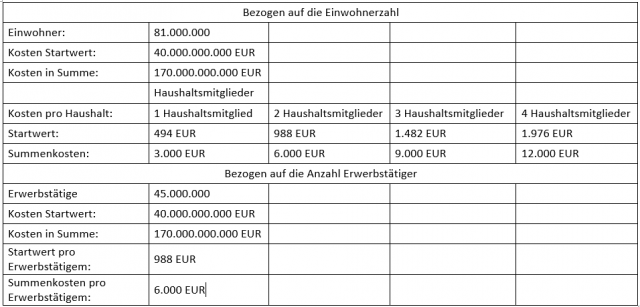

Abbildung der Gezeiten- Verriegelung. Die grüne Region des Satelliten (Mond oder Planet) ist niemals von der Oberfläche des Zentralkörpers (Planet oder Stern) aus sichtbar. (Bildnachweis: en.wikipedia/)

Eine solche langsame Rotation kann ein übliches Merkmal von Exoplaneten in Erdgröße sein, wie dem TRAPPIST-1-System und Proxima Centauri-b, deren enge Umlaufbahnen zu ihrem Stern wahrscheinlich zu Blockierung der Rotation geführt haben. Wie der Mond, der die Erde umkreist, dreht sich eine tidally locked world [Gezeitensperre] einmal pro Umlaufbahn, so dass eine Seite permanent dem Stern (der Sonne) zugewandt ist, während die andere eine ewige Nacht erlebt. Planeten mit langsamer Rotation und erdähnlichen Atmosphäre müssen die Wärme effizient um den Planeten transportieren, oder sie riskieren den Zusammenbruch der Atmosphäre, wenn auf der kalten Nachtseite die Welt gefriert. Ein solch katastrophales Ende könnte vermieden werden, wenn tidally-locked Welten typischerweise die schnellen Winde einer superrotierenden Atmosphäre haben.

Also, was ist die Ursache für die Super-Rotation der Venus?

Klassisch gibt es zwei Hauptthesen für die Super-Rotation. Im ersten Szenario führt der Reibungswiderstand der Atmosphäre über der Planetenoberfläche zu einer Verlangsamung der Rotation des Planeten, um die Winde zu beschleunigen (Gierasch-Rossow-Williams-Mechanismus). Im zweiten Szenario werden die Winde aufgrund der Erwärmung durch die Sonne (so genannte Solarthermie) angeregt.

Modelle des ersten „Surface-Up“ -Mechanismus sind bekanntermaßen empfindlich für die genauen Startbedingungen auf dem Planeten. Geringfügige Änderungen der Temperaturverteilung des Planeten können die Super-Rotation töten oder einleiten. Dies lässt vermuten, dass relativ wenige sich langsam drehende Welten zu atmosphärisch erhaltenden, superdrehenden Winden führen würden, da die Bedingungen auf dem Planeten genau richtig sein müssten.

Künstlerische Gestaltung des Akatsuki Venus Klima-Orbiters, der sich der Venus nähert.

Super-Rotation auf der Venus wurde jedoch sowohl an den oberen Wolkenschichten als auch in Tiefen von mehreren zehn Kilometern beobachtet. Könnte der Einfluss der Sonne angesichts der Tatsache, dass die Venus einen großen Teil des einfallenden Sonnenlichts reflektiert, tatsächlich die Superrotation der mittleren Schichten antreiben?

Die Raumsonde Akatsuki (japanisch „Morgendämmerung“) drang am 7. Dezember 2015 in den Orbit der Venus ein. Am dritten Jahrestag des Orbit-Einsatzes fand in Tokio eine Pressekonferenz statt, um die neuesten Ergebnisse zu diskutieren.

Unter der Leitung des International Top Young Fellow (JAXA’s prestigeträchtiges Postdoc-Stipendienprogramm), Dr. Javier Peralta , präsentierte die Pressekonferenz die Ergebnisse einer neuen Studie, die im Dezember in dem Astrophysical Journal Supplement veröffentlicht wurde.

Dr Javier Peralta, ITYF at ISAS/JAXA und Hauptautor dieser Studie.

In dieser Studie verwendete Peralta 466 Bilder der Venuswolken, die von der IR2-Kamera auf Akatsuki bei einer Infrarotwellenlänge von 2,26 Mikrometern zwischen März und November 2016 aufgenommen wurden. Durch den Vergleich von Bildern, die zu verschiedenen Zeitpunkten aufgenommen wurden, konnte Peralta die Wolken verfolgen, während sie um die venusianische Kugel herumschwirrten, um ihre Geschwindigkeit zu messen.

An der Tagseite der Venus wird die Atmosphäre durch das einfallende Sonnenlicht beleuchtet.

Stark reflektiert wird das sowohl in ultravioletten wie auch in infraroten Wellenlängen durch die oberen Wolkenschichten in einer Höhe von 60 bis 70 km oberhalb der Planetenoberfläche. Die nächtliche Beleuchtung wird jedoch durch Infrarotwärme erzeugt, die von Venus ‚heißer Oberfläche ausgeht. Dies wird teilweise durch Wolken in tieferen Höhenlagen zwischen 48 und 60 km blockiert. Da die Wolken für dieses Infrarotlicht unterschiedliche Transparenz haben, werden ihre Formen sichtbar, wenn sie mit der IR2-Kamera von Akatsuki betrachtet werden. Es waren diese tieferen Wolken der Nachtseite, die Peralta aufspürte.

Falschfarbenbild der Nachtseite der Venus unter Verwendung von mit IR2-Kamera aufgenommenen Bildern von 1,735 um (blau) und 2,26 um (rot). (Bildnachweis: JAXA / PLANET-C-Projektteam)

Der Cloud-Tracking-Algorithmus (Wolken-Verfolgung) von Peralta war halbautomatisch und wurde sowohl manuell als auch per Computer durchgeführt. Die Wolken wurden manuell identifiziert und dann per Software kartiert und das Ergebnis erneut von Hand bestätigt.

Das Ergebnis waren 2.947 Windmessungen, die ein interessantes Muster zeigten. Es gab eine deutliche Beschleunigung der Wolken, die an den Standort der Sonne gebunden war. Dies deutet stark darauf hin, dass die Sonnenstrahlung sich auch weit unterhalb der oberen Atmosphäre auf die Wolken auswirkt.

In niedrigeren Höhenschichten war diese Beschleunigung vorwiegend zonenförmig (wickelte sich westwärts um den Planeten), wobei keine meridionalen (Nord-Süd-) Windbeschleunigungen festgestellt wurden. Dies deutete auf ein von der Sonne angetriebenes System hin, da die Oberfläche zu Windströmungen in beide Richtungen hätte führen sollen. Peralta ist jedoch vorsichtig, als er darauf bestand, dass dies „Fall nicht abgeschlossen“ sei.

„Bei den Meridianwinden ist mit Akatsuki kein klarer Trend zu erkennen“, sagte er. „Aber wir sollten das bestätigen, indem wir Windmessungen mit noch höherer Genauigkeit versuchen.“

Peralta hofft, dass die kombinierten Ergebnisse von Akatsuki und Venus Express der Europäischen Weltraumorganisation noch mehr über dieses System enthüllen könnten. Animationen, Bilder und die Windmessungen der Peralta-Studie stehen zum Download zur Verfügung und können von der Community erkundet werden.

Peralta sichtete auch andere Daten als nur von Akatsuki und verglich die Ergebnisse früherer Venus-Missionen bis ins Jahr 1978. Wobei es schwierig ist, die Ergebnisse von Instrumenten verschiedener Raumsonden und Bodenteleskope zu vergleichen,

Peraltas Ergebnisse deuteten darauf hin, dass sich die Windgeschwindigkeiten der Venus in den letzten dreißig Jahren verändert haben. Eine solche Entdeckung stimmt nicht nur mit einem Solartreiber überein, sondern kann auf die erste Erkennung von Klimawandels auf einem anderen Planeten hinweisen.

„Wenn die Gezeiten der Sonne durch superrotierende Winde angetrieben werden, kann dies bedeuten, dass sich die Wolkenalbedo (das Maß der Reflektion) im Laufe der Zeit verändert hat und die Auswirkungen der Sonnenstrahlung beeinflusst hat“, erklärt Peralta.

Ein solches Ergebnis ist eine gute Nachricht für tidally-locked Welten. Wenn der superrotierende Wind der Venus von der Sonne angetrieben werden kann, könnte eine solche schnelle Zirkulation bei langsam drehenden, aber möglicherweise gemäßigten Welten um andere Sterne üblich sein. Während das Wetter unter einer super-rotierenden Atmosphäre sich sehr von dem auf der Erde unterscheiden würde, könnte es dem Planeten ermöglichen, seine Atmosphäre und sogar die gewünschten Oberflächenbedingungen für das Leben zu erhalten.

Durch den Vergleich der beiden erdgroßen Planeten in unserem eigenen Sonnensystem, können wir viel mehr darüber lernen, was es braucht, um eine bewohnbare Welt zu sein.

Weitere Information: The Akatsuki spacecraft homepage

Journal paper by Peralta et al. (uneingeschränkter Zugang)

Nachtwinde an den unteren Venuswolken mit Akatsuki / IR2: Längen-, Ortszeit- und Dekadavariationen aus dem Vergleich mit früheren Messungen

Abstrakt

Wir zeigen Messungen der Windgeschwindigkeiten an den nächtlichen unteren Venuswolken aus Beobachtungen der JAXA-Mission Akatsuki im Jahr 2016, ergänzt durch neue Windmessungen aus bodengestützten Beobachtungen, die mit dem TNG / Near Infrared Camera Spectrometer (NICS) von 2012 und IRTF / aufgenommen wurden. SpeX in den Jahren 2015 und 2017. Die zonalen und meridionalen Komponenten der Winde wurden mittels Cloud-Tracking an insgesamt 466 Akatsuki- Bildern der Venus gemessen, die mit der Kamera IR2 unter Verwendung der 2,26 μ aufgenommen wurden-Filter mit räumlichen Auflösungen von 10 bis 80 km pro Pixel und Abdeckung vom 22. März bis 31. Oktober 2016. Mehr als 149.000 Windvektoren wurden mithilfe einer automatischen Schablonenanpassungstechnik erhalten, und 2947 Windvektoren wurden mithilfe eines manuellen Verfahrens abgeleitet. Die Meridianprofile beider Windkomponenten stimmen mit den Ergebnissen der Venus Express- Mission in den Jahren 2006–2008 überein. Allerdings ist eine stärkere Windvariabilität für die Zonenkomponente in äquatorialen Breiten zu erkennen, in denen Akatsuki- Beobachtungen eine bessere Betrachtungsgeometrie als Venus Express aufweisen. Die zonalen Winde in niedrigen Breiten deuten auch auf eine zonale Variabilität hin, die mit Sonnenfluten oder sich vertikal ausbreitenden orographischen Wellen zusammenhängen könnte. Schließlich deutet die Kombination unserer Windmessungen aus TNG / NICS-, IRTF / SpeX- und Akatsuki- Bildern mit den von 1978 bis 2017 veröffentlichten Daten auf Variationen von bis zu 30 ms −1 im Wind an den nächtlichen unteren Venuswolken hin.

***

Gefunden auf Whatsupwiththat vom 24.01.2019

Übersetzt durch Andreas Demmig

https://wattsupwiththat.com/2019/01/24/first-detection-of-climate-change-on-another-planet/