Ein kleines Programm zur Klärung einiger unliebsamer Tatsachen

Unstreitig ist hoffentlich das die Frequenz eines Stromnetzes die wichtigste Größe zur Haltung eines sicheren Betriebes ist. Am Stromnetz werden Synchronuhren betrieben, welche die Netzzeit anzeigen. Diese Uhren sollen mit den Uhren der physikalisch technischen Bundesanstalt (Sender Mainflingen) möglichst gleichlaufend sein. Das ist nur der Fall, wenn die Netzfrequenz sauber nahe bei 50 Hz gehalten wird. In meiner Zeit gab es dafür in der Blockwarte zwei Uhren. Eine zeigte die Netzzeit des Bremer Netzes, die andere die Netzzeit des NWK-Netzes, das Bremen umgab und mit dem Bremer Netz gekoppelt war. Es konnte aber auch geschehen, dass die Kupplung für eine Zeit nicht geschlossen war. Dann liefen die Uhren zeitlich auseinander und man musste durch Änderung der Frequenz im Bremer Netz für Zeitgleichheit sorgen. War Zeitgleichheit erreicht, konnte man die Kupplung, nach Synchronisierung der beiden Netze, wieder einschalten. Mein Aufsatz beschreibt nun welche Probleme auftreten, wenn man ein Inselnetz betreibt, das nicht ans Verbundnetz gekoppelt ist, wie früher mein Wohnort, wenn die Netzkupplung offen war. Die Probleme sind nicht weg, wenn man an das Verbundnetz gekoppelt ist, man kann sie aber dann auf andere Schultern schieben.

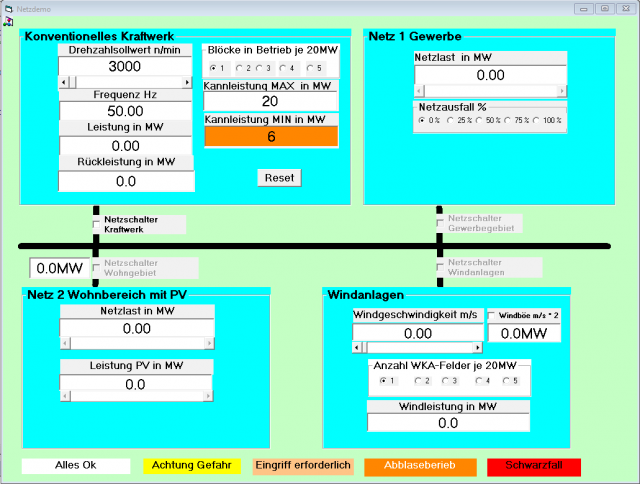

Bild 1 zeigt das Fenster des Programms, in dem sich alle Bedienelemente befinden. Die genaue Beschreibung des Programms befindet sich im Anhang, als PDF-File, zu dieser Kurzform meines Beitrages.

Im Beispiel ist die WKA-Installation viel zu klein um die konventionellen Kraftwerke zu ersetzen. An ihrem Standort ist mit einem Erntegrad von 30% zu rechnen. Das bedeutet, dass der Wind die installierte Leistung von 100 MW nur zu 30% auslastet. Um die gleiche Arbeit erzeugen zu können wie das Kraftwerk müsste man also ca. drei mal soviel WKA-Leistung installieren. Dabei ist zu bedenken das Windkraft auch mal völlig bei Windstille fehlen kann. Ein Inselnetz ist dann stromlos oder man erlaubt sich weiterhin ein konventionelles Kraftwerk zur Überbrückung dieser Zeiten. Die Problematik der Windböen, die ja die Leistung eines Windfeldes gewaltig erhöhen kann und zum Blackout führen kann, ist damit auf ein höheres Niveau gehoben. Der Traum des Bürgermeisters von 100% EE-Versorgung ist nur mit einer Kopplung ans Verbundnetz zu erreichen. Dann übernehmen andere die Versorgung bei Flaute und nehmen die Überproduktion bei zu viel Wind auf. Dafür müssen sie natürlich ihre eigenen Kraftwerke zurückfahren und deren Wirtschaftlichkeit ruinieren. Die Probleme sind dann auf andere verschoben und der Bürgermeister kann sich im Glanz der 100% EE-Versorgung präsentieren. Ob seine Bürger das alles bezahlen wollen, glaube ich nicht.

Auf Speicheranlagen verzichte ich bewusst. Die funktionieren einwandfrei als Pumpspeicherwerke, sorgen aber nur für astronomische Kosten, die kein normal denkender Mensch bezahlen will. Man hat auch keine Standorte dafür und kein normal denkender Mensch möchte im Tal unter einem solchen Speichersee leben. Wasserkraft hat die meisten Menschenleben von allen Stromerzeugungstechniken gekostet. Wer von Batteriespeichern träumt, sollte bedenken, dass die heutigen Batterien der Stand der Technik nach 150 Jahren Entwicklung sind. Dass da nicht mehr viel kommt ist so sicher wie das Amen in der Kirche. Was da sonst noch angeboten wird, raubt mir den Glauben an den gesunden Menschenverstand. Es ist aber so, besonders in der Wissenschaft, dass der Glaube an das, was man nicht versteht, am größten ist, wenn die Lügen, die dazu führen, ausreichend groß sind.

Jetzt noch ein paar Sätze zur Speicherfähigkeit eines Netzes, die ja immer bei Störungen der Netzfrequenz beschworen wird. Es gibt sie nicht. Außer in grünen Köpfen. Die speichern ja schon Energie, wenn man Elektrozählerstände in einer Internet-Cloud speichert. So wird dann das Internet zum Energiespeicher. Es gibt aber einen Selbstheilungseffekt im Netz. Dieser Effekt wird nicht durch die rotierenden Massen im Kraftwerk ausgelöst, dazu sind die Massen viel zu gering. Auslöser sind die rotierenden Arbeitsmaschinen im Netz, deren Drehzahl von der Netzfrequenz bestimmt wird. Bei fallender Frequenz reduziert sich die Wellenleistung der Motoren je nach Typ der angetriebenen Arbeitsmaschine. Der Effekt beträgt im Netz ca. 1% der aktuellen Leistung pro Hz. Ganz anders funktioniert die Frequenzregelung bei drehzahlregelbaren Maschinen. Dort wird bei Abweichung der Frequenz vom Sollwert die Leistung der Antriebsmaschinen geändert. Die Statik beträgt 5%. Das bedeutet, dass die Nennleistung eines Kraftwerksblocks bei 5% Unterschreitung der Drehzahl unter den Drehzahlsollwert erreicht wird. Es ist eine Proportionalregelung und die führt nicht selbstständig auf die Sollfrequenz von 50 Hz zurück. Das muss die Netzleitwarte durch Anweisung an die Blockwarten bewirken. Die Reaktionszeit des Drehzahlreglers liegt im Millisekundenbereich. Moderne Anlagen haben einen elektronischen Turbinenregler. Bei dem kann man den Frequenzeinfluss abschalten und die Maschine ohne Beachtung der Frequenz leistungsgeregelt fahren. Dadurch entsteht ein neuer Markt, der Regelleistungsmarkt. Da wird der Strom höher bezahlt. Aber ich schweife ab.

Jetzt folgt für alle Interessierten, die sich das Programm heruntergeladen und installiert haben, mithilfe des Programms eine kleine Einführung in die Funktion eines Elektrizitätsnetzes. Eine Anleitung zur Installation befindet sich am Ende dieses Aufsatzes. Bitte öffnen Sie die PDF-Datei „Netzdemo.pdf“ am Ende dieses Beitrages.

Ich fasse die Ergebnisse der Tests zusammen:

In dem Inselnetz erfolgt der Blackout immer durch falsche oder risikoreiche Fahrweise der Anlagen. Das erhöhte Risiko eines Blackouts muss man in Kauf nehmen, um mit der EE-Erzeugung in eine einigermaßen wirtschaftliche Situation zu kommen, trotz massiver Subvention. Die Kosten tragen ja nicht die Betreiber, sondern die Verbraucher. Die technischen Gründe für den Blackout sind folgende:

-

Zu geringes Abwurfvermögen des Kraftwerks. Es wird durch die Fahrweise der EE-Anlagen eine Situation hervorgerufen, in der durch eine Windböe Windleistung entsteht, die nicht vom Kraftwerk abgeworfen werden kann. Eine weitere Möglichkeit ist der Ausfall eines Teilnetzes oder eines Großverbrauchers durch Schäden an der Technik. Auch dieser Verlust muss vom Kraftwerk abgeworfen werden können. Der Grund ist immer zu hohe EE-Erzeugung, die nicht regelbar ist.

-

Zu wenig laufende Leistungsreserve im Kraftwerk. Bei normalem Kraftwerksbetrieb kann immer der Leistungsverlust eines Blocks von den anderen Blöcken des Werkes aufgefangen werden. Das ist gegenüber der EE-Erzeugung nicht der Fall. Der Wunsch des Bürgermeisters, möglichst viel Strom mit EE-Anlagen zu erzeugen, führt dazu, dass die durch EE-Strom ersetzten Kraftwerksblöcke in den Abblasebetrieb gehen, was ordentlich Geld kostet. Also wird man einen Block nach dem anderen abfahren, bis der Abblasebetrieb beendet ist. Das reicht aber den EE-Hanseln noch nicht, denn sie merken, dass die Leistung des Kraftwerks auch von nur einem Block erbracht werden kann. Also nehmen sie alle Blöcke bis auf einen außer Betrieb. Den braucht man ja zur Vorgabe der Frequenz an die EE-Anlagen. Jetzt braucht nur eine Flaute eintreten, Windanlagen ausfallen, PV-Strom ausfallen, oder ein Großverbraucher wird zugeschaltet, schon ist der Blackout durch Unterfrequenz da.

Ich weise nur noch einmal darauf hin, dass der letzte einigermaßen sichere Betriebszustand erreicht war, als eine Last von 60 MW mit 7,5 MW Windleistung, der Rest vom konventionellen Kraftwerk gedeckt wurde. Dazu waren drei Windfelder mit 60 MW Nennleistung erforderlich. Der Bürgermeister sollte jetzt die Windböen gesetzlich verbieten lassen.

Die Situation für dieses Netz ändert sich sofort, wenn es ans Verbundnetz gekoppelt ist. Dann kann man alle erlebten Probleme auf andere abwälzen. Das ist ja deutsche Politik aus der Nähe betrachtet. Dass die Nachbarn am Verbundnetz das Gleiche machen, ist nicht auszuschließen. Dann hat man die A….-Karte gezogen.

Ich Danke allen die bis hierher durchgehalten haben.

Herzlichst Michael Treml, Bremen

PS.:

Hier ist die Anleitung zur Installation des Programms. Richten Sie einen Ordner dafür ein. Nennen Sie ihn z. B. „Netzdemo“. Laden Sie die folgenden Links in diesen Ordner. Den Anweisungen des Fileservers „Filehorst“ folgen. Immer „Datei speichern“ wählen.

https://filehorst.de/d/cdoEHnwH

https://filehorst.de/d/cqEywxjk

https://filehorst.de/d/cioynvmq

Es sind die Dateien: Netzdemo.Cab Setup.exe SETUP.LST

Die Dateien sind nach dem herunter laden im Ordner „Downloads“. Dateien in den Ordner „Netzdemo“ verschieben. Starten Sie die Datei „setup.exe“. Die Datei wird installiert. Starten Sie das Programm „Netzdemo.exe“.