Autonomes Fahren – Ein Schlaglicht auf den Stand der Dinge

Im Forum gab es dazu eine lebhafte Diskussion von Gegnern und Befürwortern der autonomen automobilen Fortbewegung. Neben einer Reihe kritisch-sachkundiger Kommentatoren meldeten sich wie üblich lautstark und zahlreich die Befürworter des klimatischen und elektroautomobilen Fortschritts zu Wort. Dutzendfach war da zu lesen, dass man ja gesehen habe, dass der Mensch schuld war, der Computer habe eine makellos weiße Weste, der Fortschritt der alleinseligmachenden elektromobil-fahrerlosen Zukunft sei nicht aufzuhalten und werde uns schon in wenigen Jahren von der Unbill des fehlbaren menschlichen Fahrzeuglenkers befreien. Leider erlaubte es das gezeigte Bild nicht, die Situation zu beurteilen. Stutzig machte allerdings der Text, wonach der Unfallgegner beim Rückwärtsfahren das Shuttle mit seiner Vorderseite „gerammt“ hatte. Ein rückwärts fahrendes Fahrzeug, das mit seiner Vorderseite ein anderes Fahrzeug „rammt“? Das verblüfft schon etwas. Wie so üblich bei Meldungen unserer heutigen „Qualitätspresse“: Wer die Wahrheit finden will, der muss schon selbst recherchieren.

Das Projekt

Einer Meldung von Engadget [ENGA] zufolge, einer „Multimediaorganisation an der Schnittstelle zwischen Technologie, Spielen und Unterhaltung“, handelt es sich um ein Projekt der Firma Navya, die das Shuttle herstellen, der Firma Keolis, laut Webseite weltweit führend beim Betrieb automatischer Metro- und Straßenbahnsysteme, sowie der Stadt Las Vegas. Das Shuttle bietet Platz für 12 Passagiere und transportiert diese bis zum 20. Januar 2018 mit einer maximalen Geschwindigkeit von 19 km/h (12 mph) kostenlos durch ein Vergnügungsviertel in Las Vegas. Auf dieser Route kam es dann schon kurz nach dem Start am 8. November zum Unfall.

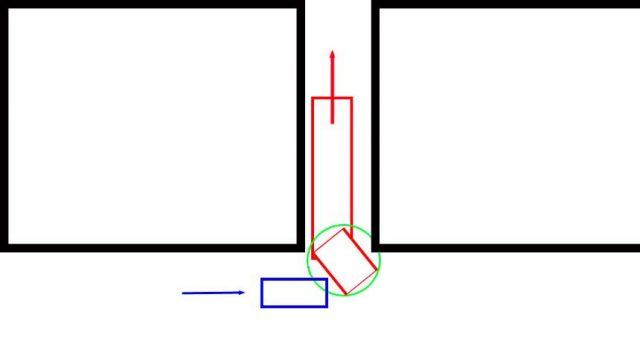

Augenscheinliche Unfallsituation: Zwei Gebäude (schwarz) mit engem Zwischenraum und ein Sattelschlepper-LKW (rot), der rückwärts in die Lücke manövriert. Der grüne Kreis markiert die ausgeschwenkte Zugmaschine, die vom Shuttle (blau) blockiert wird

Was tatsächlich passiert ist

Erst bei genauer Betrachtung des in einer US-Onlinemeldung gezeigten Bildes [FOTO] wird klar, dass die Situation bei weitem nicht so eindeutig gewesen sein kann, wie dies in der Pressemitteilung der Stadt Las Vegas suggeriert wird. Auf diesem Foto erkennt man als Unfallgegner einen schweren Sattelschlepper-LKW, der im Liefereinsatz für einen Gewerbebetrieb war. Im deutschen SPON-Artikel war von einem „Lieferwagen“ die Rede, obwohl man hierzulande hierunter in der Regel lediglich einen Kleintransporter versteht. Der gezeigte LKW hat dagegen recht beeindruckende Abmessungen. Beim Rückwärtsrangieren in engen Umgebungen ist die Handhabung eines solchen Kolosses aufgrund der Sattelschlepper-Ausführung sehr knifflig. Zu den besonderen Handicaps gehört, dass der Fahrer beim Rückwärtsfahren mit der Zugmaschine oft weit nach beiden Seiten ausschwenken muss, da er den Auflieger nur so in die gewünschte Richtung schieben kann. Das ist eine Aufgabe, die volle Konzentration erfordert. Erschwerend kommt hinzu, dass man beim Ausschwenken der Zugmaschine meist nur eine Seite des Aufliegers im Rückspiegel sehen kann, weil dessen Aufbau auf der anderen Seite die Sicht nach hinten blockiert.

Beim Rückwärts manövrieren eines Sattelschleppers blockiert der Auflieger bei den Schwenks der Zugmaschine die Sicht in den Rückspiegeln auf einer Seite meist komplett

In der Unfallsituation [FOTO] betraf diese Sichtblockierung die rechte Fahrzeugseite, weshalb die Aufmerksamkeit des Fahrers selbstverständlich vorrangig den linken Außenspiegeln bzw. dem Bildschirm der evtl. vorhandenen Rückseitenkamera galt.

Erschwert wurde ihm das Manöver zusätzlich durch die Tatsache, dass er aus einer sowieso schon engen Durchgangsstraße rückwärts in eine noch viel engere Lücke zwischen zwei Gebäuden hineinmanövrieren musste. Bei einem solch diffizilen Manöver kann man zwangsläufig nicht auf alles achten – am wenigsten auf ein Fahrzeug auf der „falschen“ Seite des Zugfahrzeugs, das von einem elektronischen Volltrottel statt von einem denkenden Menschen geführt wird.

Das Fehlverhalten der Software

Während seines Manövers blockierte der Truck zwangsläufig die gesamte Breite der Durchgangsstraße. Menschliche Fahrer in anderen Fahrzeugen in diesem Bereich hätten in dieser Situation so frühzeitig angehalten, dass der Zugmaschine des LKW genügend Raum für die erforderlichen Lenkausschläge geblieben wäre.

Nicht so der Hochleistungsidiot am „Steuer“ des Shuttles. Anscheinend war es keinem der Programmierer für dieses „autonom“ fahrende Auto in den Sinn gekommen, diese im normalen Fahralltag übliche Situation in die Überlegungen bei der Softwareerstellung mit einzubeziehen. Aus der Stellung der Fahrzeuge kann man unschwer erkennen, was passiert sein dürfte. Das Shuttle hat den quer über der Straße stehenden LKW vermutlich als stehendes Hindernis eingestuft und ist so dicht aufgefahren, wie es das z.B. an Ampeln tun sollte. Da die Zugmaschine zu diesem Zeitpunkt sehr weit nach links ausgeschwenkt war, fuhr das Shuttle soweit heran, bis seine Vorderfront schon fast auf einer Linie mit der Mittelachse des Anhängers war. Damit blockierte es Schwenkmanöver des LKW-Fahrers nach rechts, während dessen Aufmerksamkeit der linken Seite seines Fahrzeugs galt. Dieser hatte augenscheinlich – und verständlicherweise – angenommen, dass andere Verkehrsteilnehmer als denkende Wesen nicht so dämlich sein würden, ihm den Manövrierraum zu blockieren, um anschließend einfach stur an Ort und Stelle stehenzubleiben. Selbst sehr unerfahrene Führerscheinneulinge hätten ihren Irrtum schnell erkannt und als nächstes versucht, sich rückwärts aus der Gefahrenzone zu bringen. Der Shuttlebus hat vermutlich weder zurückgesetzt noch gehupt, sondern schlicht nichts getan. Damit war die Streifkollision – im wörtlichen Sinne des Wortes – vorprogrammiert.

Fragwürdige Schuldzuweisung

Da in Verkehrsregeln meist festgelegt ist, dass ein stehendes Fahrzeug bei einem Unfall keinesfalls schuld sein kann, blieb der hinzugezogenen Polizei gar nichts anderes übrig, als sich den LKW-Fahrer vorzuknöpfen und ihm die Schuld zuzuweisen. Die wirklich Schuldigen sind jedoch die Geschäftemacher, die in Erwartung künftige Milliardendeals „Lösungen“ auf die Menschheit loslassen, die so offensichtlich unausgereift sind. Der Entwicklungsstand der Software scheint so unausgereift zu sein, dass es schon als kriminell eingestuft werden darf, Menschen im Straßenverkehr als unfreiwillige Versuchskaninchen hierfür zu missbrauchen. Mit derart stümperhaft gestrickten Software-Konzepten sind Unfälle früher oder später unausweichlich. Selbst ohne Verletzte oder gar Tote gehörten die verantwortlichen Manager eigentlich auf die Anklagebank.

Erschreckende Inkompetenz

Als Fazit ist festzuhalten, dass durch diesen Unfall erschreckend deutlich geworden ist, auf welch geradezu fahrlässig amateurhaftem Stand die Software sich tatsächlich befindet. Man darf unterstellen, dass sich vergleichbare Fehler auch bei zahllosen anderen Fällen des realen Straßenverkehrs zeigen dürften. Keinem Flugzeug würde man gestatten, mit derartig unausgereiften Programmen statt mit Piloten in die Luft zu gehen. Obwohl es auch im Straßenverkehr um Gesundheit und Leben von Menschen geht, wird man jedoch vermutlich leider nicht die eigentlich notwendigen Konsequenzen ziehen und weitere Straßentests verbieten, bis ein vertretbarer und vor allem weit höherer Reifegrad dieser Programme sichergestellt ist. Dem steht die aktuelle Goldgräberstimmung bei zahlreichen großen Akteuren entgegen. Deshalb wird voraussichtlich weiterhin dazu kommen, dass derart stümperhafte Fahrzeuge sogar in zunehmender Zahl auf der Straße herumkurven. Interessierten US-Konzerne wie die Google-Mutter Alphabet oder Tesla sind zu mächtig und verfügen für solche Fälle über ganze Heere hochbezahlter Rechtsanwälte. Denen wird nichts passieren, ebensowenig wie bei dem tödlichen Unfall mit einem Tesla unter einem angeblichen „Autopilot“, der anschließend flugs zum lediglich „fortgeschrittenen Assistenzsystem“ umetikettiert wurde. Stattdessen wird man immer denjenigen die Schuld in die Schuhe schieben, die mit der Blödheit der Automaten nicht gerechnet haben.

Das grundsätzliche Problem

Das entscheidende Problem bei „autonom“ fahrenden Fahrzeugen erwächst aus der Tatsache, dass der reale Verkehr vom Grundsatz her keine Aufgabe mit unverrückbar feststehenden Regeln ist. Künstliche Intelligenzen (KI) eignen sich dank der heute verfügbaren Rechner- und Speicherleistungen ganz hervorragend dafür, komplexe Aufgabenstellungen zu bewältigen, solange ein festes, unverrückbar definiertes Regelwerk gilt, wie es beim Schach oder beim Go-Spiel der Fall ist. In einer Fabrikhalle oder auf einem abgetrennten Firmengelände sind autonom navigierende Fahrzeuge schon heute von erheblichem Nutzen. Auf der Straße hat man es jedoch mit sich ändernden Regeln zu tun. Wann eine Abweichung davon Sinn macht und erlaubt oder gar geboten ist, muss auf intelligente Weise beurteilt und entschieden werden. Damit ist eine KI vermutlich noch lange überfordert. Wenn beispielsweise der Tanklaster mit Benzin, der vor einem auf der Straße steht, plötzlich anfängt zu brennen, müssen die Regeln geändert werden. Dann darf man sich nicht scheuen, auch mal eine durchgezogene Linie zu überfahren oder gar eine Einbahnstraße in falscher Richtung zu benutzen. Das erkennen und richtig einzuschätzen ist beim heutigen Stand der Sensorik und der Interpretation von Ausnahmesituationen wohl noch auf längere Sicht nicht möglich. Der Vorfall in Las Vegas wirft ein grelles Schlaglicht darauf. Eine wirkliche Straßentauglichkeit wird wohl noch auf etliche Jahre hinaus nicht zu erwarten sein. Auch wenn uns computerbegeisterte Freaks und Großverdiener mit Dollarzeichen in den Augen das Gegenteil weismachen wollen: Die Technik taugt zum jetzigen Zeitpunkt offensichtlich nur fürs Labor und keinesfalls für die Straße.

Fred F. Mueller

Quellen

[ENGA] https://www.engadget.com/2017/01/11/las-vegas-autonomous-shuttle-pilot/

[FOTO] http://www.foxnews.com/auto/2017/11/09/truck-driver-at-fault-in-las-vegas-driverless-shuttle-crash-say-police.html

[SPON] http://www.spiegel.de/auto/aktuell/selbstfahrender-bus-startet-und-wird-gerammt-a-1177118.html