Vehicle-to-Grid (V2G)

Dieses Techno-Kürzel beschreibt keine Energiewandlung wie zum Beispiel “P2H” (Strom zu Wärme) oder “P2G” (Strom zu Gas), sondern meint ein Konzept zur Stromspeicherung. Eine Vielzahl mit dem Netz verbundener E-Fahrzeuge könnte überschüssigen Strom kurzfristig einspeichern und bei Bedarf als Schwarmstrom auch ans Netz zurückgeben. „Bidirektionales Laden“ lautet dafür der Fachbegriff.

Ein großer Vorteil wäre, dass dadurch der aufwändige Bau großer zentraler Stromspeicher reduziert werden könnte. Auch E-Mobile stehen zu über 90 Prozent der Zeit unbenutzt herum. Da könnte man doch deren Akkus nutzen?

Der visionäre Ansatz offenbart Schwächen durch seine Komplexität. Zunächst bedarf es einer Vielzahl an Fahrzeugen, die am System teilnehmen, um tatsächlich Wirkung im Netz zu erzielen. Die Speicher im Auto können nicht im vollen Umfang entladen werden, weil der Nutzer höchstwahrscheinlich auch fahren will. Und damit kommen wir zum kritischen Punkt der Vision, dem Nutzer des E-Mobils, der als Verbraucher auftritt. Also dem mithin unbekannten Wesen. Es legt ein Nutzerverhalten an den Tag, das uneinheitlich und unberechenbar ist. Zunächst wird sich niemand einen Stromer kaufen, um dessen Reichweite durch einen Vertrag mit dem Netzbetreiber einzuschränken und einen Teil der Fahrzeugbatterie als tote Masse durch die Gegend zu fahren. Für das Netzmanagement wird sich der E-Fahrer nicht zuständig fühlen, und das zu Recht.

Die Freiheit des Individualverkehrs besteht nun mal darin, nicht stets zu fahren, sondern stets fahren zu können. Dazu kommt, dass jetzt und wohl auch künftig ein großer Anteil der E-Mobile zu Firmenflotten und Car-Sharing-Verbünden gehören, so dass ihre Nutzung in der Regel nicht vorhersehbar ist und sie stets „vollgetankt“ zur Verfügung stehen müssen.

Vision und Preis

Man könnte die Batterie- (korrekt natürlich Akkumulatoren-) nutzung durch den Netzbetreiber finanziell anreizen, durch Vergütung für den gespeicherten Strom oder durch Rabatte beim Ladestrom. Dann wäre allerdings die sinnvollere Variante, sich einen möglichst großen Akku in den Keller oder die Garage zu stellen, was von einer täglichen Kalkulation der geplanten Fahrstrecke oder der Startzeit am Folgetag entbinden würde. Damit kommen wir zum Grundproblem – wer zahlt? Speicher generieren per se keine Wertschöpfung, sie sind verlustbehaftete Stromparkplätze und müssen irgendwie über den Preis abgerechnet werden. Dazu kämen Kosten für Ladesoftware und Leittechnik für die Steuerung hunderttausender Ladestationen in Abhängigkeit der Netzsituation. Schaut man sich die Kosten normaler Ladestationen an, ist der Aufwand beträchtlich und geht pro Stück schnell in die Tausende. Hinzu kommen Kosten für die Elektronik und Vernetzung für das bidirektionale Laden. Möglich ist die Abrechnung über die Netzgebühren, die mit dem weiteren Fortgang der „Wende“ ohnehin der am stärksten steigende Kostenfaktor sind.

Wie ist die technische Realisierbarkeit? Mit dem Projekt „e-SolCar“ gelang bereits 2014 an der Brandenburgisch-Technischen Universität in Cottbus der Nachweis, dass bidirektionales Laden und somit die Nutzung von E-Fahrzeugakkus zur Kurzzeitspeicherung möglich sind. Speziell die Steuerungstechnik für das Ein- und Ausspeichern wurden am Lehrstuhl von Professor Schwarz entwickelt und getestet.

Seitdem gibt es keine weiteren Schritte in Richtung einer breiten Anwendung. Die Voraussetzung einer existierenden großen Anzahl an E-Fahrzeugen ist einfach nicht gegeben. So fehlen natürlich auch die Steuerungstechnik für die Schwarmspeicher beim Netzbetreiber und entsprechende Tarife.

Die Frage, warum in Deutschland trotz der Subventionen so wenig E-Autos verkauft werden, bringt uns zu einer völlig schräg geführten Diskussion. Permanent prügeln Politiker und Journalisten auf die Autoindustrie ein und verlangen höhere Verkaufszahlen ihrer E-Modelle und Hybride. Entscheidend ist jedoch das Käufer- und Verbraucherverhalten und speziell im automobilen Bereich wird niemand eine Kaufentscheidung treffen, die zu einem Neuwagen führt, der teuer ist und schlechtere Gebrauchseigenschaften hat als das Altfahrzeug. Potenzielle Käufer führen die bekannten Gründe an, die vom Kauf eines Stromers abhalten:

- Preis, 2. Reichweite, 3. Verfügbarkeit der Ladestationen, 4. Noch unklare Batterielebensdauer und damit unklarer Wiederverkaufswert. Die Hersteller bauen, was der Kunde möchte. Für ausbleibende Kaufentscheidungen die Konzerne verantwortlich zu machen, zeugt vom nur partiell vorhandenen Wirtschaftsverständnis von Politikern und Journalisten.

Nachfrage und Angebot oder Quote

Manche Medien machen die bösen Autokonzerne verantwortlich dafür, dass durch ihre aggressive Werbung die Käufer die SUV´s bevorzugen würden. Zweifellos besteht unsere Bevölkerung, wie in anderen Ländern auch, aus einem nicht unerheblichen Anteil von Deppen. Eine Kaufentscheidung zugunsten eines Automobils, die zu den größten Haushaltsausgaben gehört und manche Haushalte an die finanzielle Schmerzgrenze bringt, wird in aller Regel aber gut abgewogen und bedacht. Der 3-Liter-Lupo wurde seinerzeit umfangreich beworben und medial sehr positiv begleitet, ohne dass es der VW-Bestseller wurde. Früher wurde der Kunde sogar König genannt, heute spricht man ihm eigenes Denken ab. Um das Kundenverhalten zu umgehen, sinniert man im Bundeswirtschaftsministerium über eine Quotenregelung für die Hersteller. Adäquat entschied seinerzeit auch die staatliche Plankommission der DDR, dass Weiterentwicklungen des „Trabant“ unterbleiben, da dieser für den Bevölkerungsbedarf ausreichend sei.

Der regelmäßige Verweis auf höhere Verkaufszahlen von E-Mobilen in Asien oder Norwegen ist pauschal und auf unsere Verhältnisse nicht übertragbar. Auch anderswo lebt die Elektromobilität von Subventionen und wenn diese wegfallen, bricht der Boom zusammen. Im März endete in Hongkong die staatliche Förderung, wonach der Absatz im April auf null zurückging – nach noch einigen hundert in den Vormonaten. Auch in Dänemark brach der Absatz nach Subventionskürzungen ein und deren gänzliche Streichung wurde vorerst ausgesetzt.

Gern wird Norwegen als Beispiel angeführt und hier macht die E-Mobilität auch Sinn, zumindest in den Städten. Zum Einen ist die Staatskasse prall genug gefüllt, um üppig zu fördern, zum anderen besteht der Energiemix zu 99 Prozent aus Wasserkraft. Hier werden also tatsächlich Emissionen vermieden. Was kaum erwähnt wird: Die E-Mobilität konzentriert sich auf Oslo und andere Städte, im dünn besiedelten und kalten Land zwischen Gletschern, Schären und Küste wird man noch sehr lange fossil fahren, denn das Reichweitenproblem haben auch die Norweger. Zudem kann man das Verkehrsaufkommen im 5,3–Millionen-Einwohner-Land mit wenig Großindustrie nicht mit Deutschland vergleichen.

Lernen kann man trotzdem, zum Beispiel, dass eine generös geförderte individuelle Mobilität die Straßen in Oslo verstopft und die Fahrgastzahlen im ÖPNV reduziert.

Was für norwegische Emissionen gut ist, erweist sich für die chinesischen als eher kontraproduktiv. Der dortige Energiemix beinhaltet 63 Prozent Kohlestrom und die

Elektromobilität wird gefördert, um lokale Emissionen zu senken. In Summe steigt der Strombedarf und wird überwiegend aus Kohlekraftwerken gedeckt.

Kohle im Tank

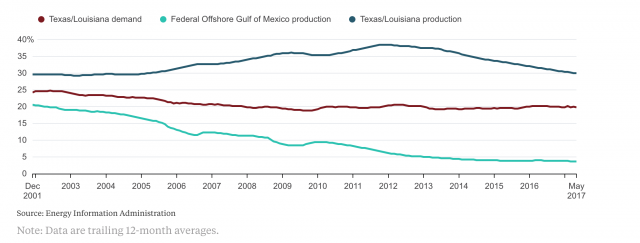

Wo kommt bei uns der Strom zum Fahren her? Bei Bilanzrechnungen zur Emission von Stromern wird üblicherweise der Mix im Netz zugrunde gelegt. Kann man machen, ist aber nicht korrekt.

Dazu ein Gedankenexperiment: Mario Mustermann biegt nach getaner Arbeit am späten Nachmittag auf den Stellplatz seines Eigenheims ein. Lässig und im tiefen Bewusstsein ökologischer Reinheit klappt er die Wagentür zu, schreitet zum Ladekabel und führt dieses in Richtung der Steckdose.

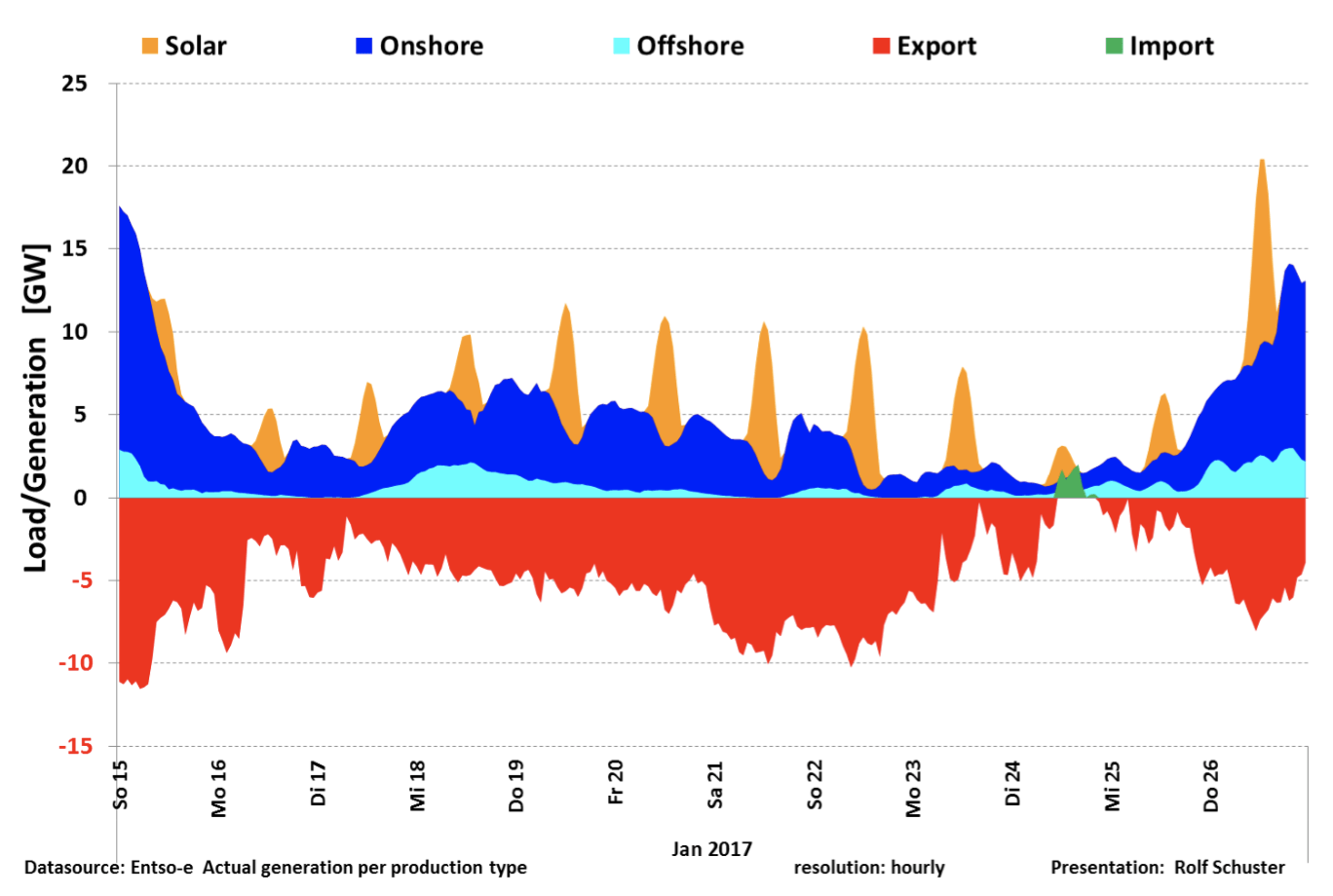

Halt! Genau jetzt stoppen wir den Gedankenfilm und machen uns ein Bild vom Zustand im Netz. Nehmen wir einen durchschnittlichen Strommix von 70 (konventionell) zu 30 (regenerativ) an und eine vorbildliche Frequenz von 50,000 Hertz. Gemäß Einspeisevorrang im EEG sind alle regenerativen Erzeuger, also hauptsächlich Wind, Sonne und Biomasse, mit der ganzen verfügbaren Kapazität am Netz.

Film weiter: Mustermann steckt den Stecker und startet den Ladevorgang. Damit ergibt sich im Netz eine Frequenzabweichung nach unten, die bei einem einzelnen Fahrzeug vermutlich nicht registrierbar ist. Machen in diesen Minuten aber hunderte oder tausende Mustermänner das gleiche wie Mario, geht die Frequenz merkbar für die Leittechnik der Kraftwerke nach unten. Einige tausendstel Hertz reichen aus, die (vertraglich vom Netzbetreiber gebundene) Primärregelleistung der konventionellen Kraftwerke aufzurufen. Automatisch erhöhen diese ihre Leistung innerhalb eines vorgegebenen Regelbandes und sorgen dafür, dass die Frequenz wieder 50 Hertz erreicht. Fazit: Der Ladestrom kann bilanziell nur konventionellen Ursprungs sein, da der regenerative Strom nicht hochgeregelt werden kann. Natürlich könnte zufällig in diesen Minuten der Wind auffrischen, wahrscheinlicher ist aber, dass am späten Nachmittag die Sonne untergeht und nachts nicht scheinen wird. Zusammen mit der Ökobilanz für die Herstellung der Batterien ist ersichtlich, dass bezogen auf die Gesamtemissionen die E-Fahrzeuge heute kein Fortschritt sind.

Der Traum vom emissionsfreien Elektroverkehr ließe sich nur erfüllen, wenn 100-Prozent-Erneuerbar – wie in Norwegen – schon Realität wären. Solange aber die Sektorkopplung im jetzigen Energiemix vorangetrieben wird, stabilisiert dies die Grund- und Regellast der konventionellen Erzeuger – was ich wiederum gut finde. Ein gut belastetes Netz regelt sich besser und ist damit sicherer.

Was bei der „Energiewende“ schon vor Unausgewogenheit, Wunschdenken und Verdrängung der Realitäten nur so strotzt, erfährt bei der „Verkehrswende“ noch eine Steigerung. Sachliche Diskussionen und pragmatische Lösungsvorschläge sind Mangelware. Die übliche Schwarz-Weiß-Malerei meinungsführender NGO`s wird politisch und medial übernommen. Der Hype ist allerdings nicht neu und kehrt alle paar Jahre wieder. Schon der Halbgott der Journalisten und ehemalige Chef der Hamburger Journalistenschule, Wolf Schneider, schrieb während seiner Zeit bei der „Süddeutschen“ unter der Überschrift „Tod dem Verbrennungsmotor“: „Die Zukunft kann nur dem Elektroauto gehören! . . . Der Verbrennungsmotor ist vermeidbar. Nach der Vernunft wie nach unseren technischen Möglichkeiten gebührt ihm der Tod.“

Das war am 5. Februar 1966.

Vision statt Plan

Nüchtern betrachtet wird auch der Verkehr der Zukunft aus einem Mix an Antriebssystemen bestehen. Natürlich kann man Diesel-Pkw zunächst durch Benziner ersetzen, allerdings stehen diese als nächste am Pranger auf Grund ihres höheren CO2-Ausstoßes. Dass Stickoxide giftig sind, CO2 dagegen nicht, spielt dabei keine Rolle. Sicher wird im Kurzstreckenverkehr und in Ballungsgebieten mehr elektrisch gefahren werden. Für den Fernverkehr ist nur die Elektrotraktion auf der Schiene erste Wahl. Was auf Gummi rollt, wird Brennstoff brauchen, der in Teilen natürlich synthetischen oder biogenen Ursprungs sein kann. Beim Schwerlastverkehr führt am Diesel vorerst kein Weg vorbei, desgleichen auf der Schiene im nichtelektrifizierten Bereich.

Will man Emissionen senken, sind Gasantriebe die erste Wahl. Sowohl LPG- (Flüssiggas) als auch CNG- (Erdgas)-Motoren sind technisch ausgereift und bezahlbar. Die Verdichtung des entsprechenden Tankstellennetzes würde Peanuts kosten, verglichen mit einem flächendeckenden Ausbau stromfressender E-Ladestationen, der mit einem notwendigen Netzausbau im Niederspannungsbereich einhergeht. Merkwürdigerweise spielen die Gasantriebe bei allen Visionen zur Verkehrswende keine Rolle.

Anstelle eine realisierbare Strategie zu entwickeln, hantiert die verantwortliche Politik mit Subventionen und Verboten und denkt auf dem Weg zur Planwirtschaft über vorgegebene Quoten nach. Jeder profilneurotische, meist grün lackierte Hinterbänkler im Politikbetrieb und der Großteil der Journalisten vom Fachgebiet Weltrettung hält sich für weiser als Wissenschaftler und die Ingenieure in den Entwicklungsabteilungen der Hersteller. Die verantwortlichen Manager winden sich im Appeasement und im Wissen, dass ihr möglicher Fall ein sehr weicher sein wird.

Sicher ist, dass P2V (Power to Vehicle) wachsen wird. Sinnvolle Anwendungen gibt es zuhauf: Paket- und Pflegedienste, Taxis, Car-Sharing-Fahrzeuge, lokaler Kurier- und Warenverkehr. Dagegen ist V2G nicht mal am Horizont zu sehen.