Gefährliche Ladung – Die E-Auto sind Energieverschwender, die Batterien giftige Umweltsünder erster Klasse

In Zeiten, in denen Industrie, Politik und Justiz versuchen, die Dieselkrise zu bewältigen, scheint es keine löblichere Fortbewegungsart zu geben als die mit Elektrizität. Diesen Eindruck erwecken zumindest all die Politiker- und Zeitungskommentare, die den Stromantrieb als bessere Alternative zum Verbrennungsmotor preisen. Elektroautos seien ökologischer und schonten die Ressourcen, so der Tenor. So propagierte der Tages-Anzeiger die E-Mobilität mit dem Argument, es brauche «einen effizienteren und sparsameren Umgang mit Energie». Bereits plant der Verein E-Mobil Züri, mitten in der grössten Schweizer Stadt ein Elektroauto-Rennen zu veranstalten. Wäre Gleiches mit Kraftstoff-Boliden geplant, würde man eine solche Idee wohl als Aprilscherz erachten.

In anderen Weltgegenden scheint man von den Vorteilen der E-Mobilität weniger überzeugt zu sein. So brummten die Verkehrsbehörden von Singapur letztes Jahr dem Käufer eines Tesla S eine Umweltsteuer von umgerechnet über 10 000 Franken auf – mit dem Hinweis, das Fahrzeug brauche besonders viel Energie, nämlich über 44 Kilowattstunden (kWh) Strom pro 100 Kilometer. Dabei benötigt die elektrische Luxuskarosse aus dem Silicon Valley gemäss Katalog doch nur 18 kWh. Singapurs Behörden sind aber nicht etwa von allen guten Öko-Geistern verlassen, sondern mit einer Extraportion Sachverstand gesegnet. Denn Elektroautos verschlingen tatsächlich besonders viel Energie. Dies zeigt folgende Berechnung.

Tieferer Wirkungsgrad im Winter

Gemäss den Prospekten ihrer Produzenten benötigen gängige Elektroautos – vom Nissan Leaf über den VW E-Golf, den Mitsubishi i-MiEV bis hin zum neuen Tesla 3 – bloss rund 15 kWh Strom pro 100 km, manche etwas mehr, manche etwas weniger. Grundsätzlich weiss jeder Autofahrer, sei er nun mit Strom oder Brennstoff unterwegs, dass solche Herstellerangaben bloss Theorie sind. Die Werte werden unter Bedingungen ermittelt, die mit dem realen Strassenverkehr fast nichts gemeinsam haben: Die Prüfzyklen finden auf Rollen statt und sind von tiefen Geschwindigkeiten und sanften Beschleunigungen geprägt. Zusatzverbraucher wie etwa Scheinwerfer sind ausgeschaltet. Fahrtwind gibt es im Labor auch keinen. Laut dem Forschungsverband ICCT (International Council on Clean Transportation) liegt der tatsächliche Verbrauch von Autos mit Verbrennungsmotor im Schnitt happige 42 Prozent über den offiziellen Angaben. Bei Elektrofahrzeugen klaffen Realität und Theorie aber noch viel weiter auseinander: Das deutsche Prüfunternehmen TÜV Süd ermittelte 2014 den Verbrauch einiger gängiger Elektroautos bei realen Testfahrten. Es zeigte sich, dass im Schnitt 31 kWh Strom für 100 km nötig sind, wenn man je zur Hälfte auf Landstrassen und auf Autobahnen fährt – also rund doppelt so viel als von den Herstellern angegeben.

Doch das ist erst die halbe Wahrheit, denn TÜV Süd testete bei Temperaturen von 23 Grad. Bei Kälte steigt der Strombedarf von Elektrofahrzeugen jedoch deutlich: Der Wirkungsgrad der Batterie ist dann viel tiefer, und die Fahrerkabine kann nicht wie bei konventionellen Autos durch die Abwärme des Verbrennungsmotors geheizt werden. Dänemarks Technische Universität zeigte 2016 anhand von Messungen, dass Elektroautos im Winter ein Drittel mehr Energie benötigen als im Sommer. Davon kann man ableiten, dass der Verbrauch bei ganzjährigem Gebrauch in der Schweiz (Durchschnittstemperatur etwa neun Grad) 11 Prozent höher liegt als bei den Tests von TÜV Süd.

Beträchtliche Ladeverluste

Weiter sind Ladeverluste zu beachten. Hängt ein Elektroauto an der Steckdose, kann die Batterie nur einen Teil der übertragenen Energie speichern. Gemäss Tests, etwa des deutschen Wuppertal-Instituts, gehen zwischen 10 und 30 Prozent als Wärme verloren, wobei die Verluste bei Schnellladungen grösser sind. Wird bei tiefer Aussentemperatur geladen, kann der Verlust sogar fast 50 Prozent betragen. In diesem Artikel soll ein durchschnittlicher Ladeverlust von 20 Prozent angenommen werden.

Geht man also von einem Verbrauch von rund 31 kWh (gemäss TÜV Süd) bei Sommerbetrieb aus und addiert 11 Prozent bei Ganzjahresbetrieb und 20 Prozent wegen Ladeverlusten, müssen an den Ladestationen rund 41 kWh Strom bereitstehen, damit ein Elektroauto 100 Kilometer weit fahren kann. Der reale Verbrauch ist somit über 2,5-mal so hoch als von den Herstellern angegeben.

Für eine Bilanz ist nicht nur die Betriebsenergie massgebend, sondern auch diejenige für die Fahrzeugherstellung. Bei Elektrofahrzeugen ist insbesondere die Produktion der Batterien sehr energieintensiv. Wegen Erschöpfung müssen diese Batterien zudem nach einigen Jahren Betrieb ersetzt werden. Bei einer durchschnittlichen Nutzung des Fahrzeugs müssen mindestens 15 kWh pro 100 Kilometer Fahrt dazugerechnet werden. Batterien enthalten zudem hochgiftige Stoffe, von denen auch bei konsequentem Recycling ein Teil entsorgt werden muss. Lithium, das besonders häufig verwendet wird, ist ähnlich toxisch wie schwach bis mittel radioaktive Stoffe. Das bedeutet, dass eine ebenso sichere Endlagerung wie bei Atomabfällen nötig ist (siehe Artikel rechts) – was mit beachtlichem Energieaufwand verbunden ist: Für 100 Kilometer Elektrofahrt kommen darum mindestens 3,5 kWh dazu. Insgesamt beträgt der Energieaufwand für Elektroautos auf Schweizer Strassen somit etwa 60 kWh pro 100 km.

Dieser Wert soll mit einem Auto mit Benzinmotor verglichen werden: Für dieses wird ein durchschnittlicher Verbrauch von acht Litern pro 100 Kilometer angenommen – bei realen Nutzungsbedingungen und ganzjährigem Gebrauch. Um diesen Verbrauch mit demjenigen von Elektromobilen in Relation zu setzen, muss man den Energiegehalt von Benzin heranziehen und beachten, dass die Produktion von Strom mit beträchtlichen Energieverlusten einhergeht (Wirkungsfaktor für die Erzeugung von Elektrizität aus Primärenergie gemäss BP: 0,38). Insgesamt kann ein Liter Benzin so mit 3,4 kWh Strom gleichgesetzt werden. Ein Verbrauch von acht Litern entspricht somit rund 27 kWh Strom pro 100 km. Ein Zuschlag für Herstellung und Entsorgung des Benzinantriebs drängt sich nicht auf, da der entsprechende Energieaufwand vernachlässigbar klein ist. Ein Elektrofahrzeug mit 60 kWh pro 100 km verbraucht somit mehr als doppelt so viel Energie wie ein Fahrzeug mit Benzinmotor. Ein Vergleich mit einem Dieselfahrzeug dürfte noch schlechter ausfallen. Elektromobilität bedeutet also Energieverschwendung der Extraklasse.

Auch bei den anderen ökologischen Vorteilen handelt es sich weitgehend um leere Behauptungen. Sogenannt sauber sind E-Mobile nur, wenn man lediglich den Betrieb beachtet. Berücksichtigt man die Produktion des Stroms für diesen Betrieb, schneiden E-Mobile bezüglich Klimagasen nur dann klar besser ab als konventionelle Autos, wenn der Strom weitgehend CO2-frei erzeugt wird (vergleiche Weltwoche Nr. 32/17). Das ist in der Schweiz heute dank Wasser- und Atomkraft zwar noch der Fall. Es braucht aber viel Optimismus, zu glauben, dass die Versorgung auch nach dem beschlossenen Atomausstieg ohne fossilen Strom erfolgen kann. Ein Umstieg auf Elektrofahrzeuge im grossen Stil würde zudem den Stromverbrauch deutlich erhöhen. Die Empa geht davon aus, dass die Nachfrage um einen Fünftel steigt, falls alle Autos in der Schweiz elektrisch betrieben würden. Ohne den Einsatz von CO2-intensivem Gas- oder Kohlestrom wäre diese Nachfrage kaum zu bedienen.

Wegen des erwähnten grossen Energieaufwands entstehen zudem bei der Herstellung der Batterien enorme Mengen an CO2. Gemäss einer neuen schwedischen Studie müssen Besitzer eines Tesla Model S acht Jahre lang fahren, bis das CO2, das bei der Batterienproduktion freigesetzt wurde, kompensiert ist. Nach acht Jahren Betrieb ist aber wohl längst ein erster Batterientausch fällig.

Die Grüne Partei verlangt, dass die Schweiz ab 2025 keine neuen Autos mit Verbrennungsmotor mehr zulässt, sondern nur noch Elektromobile. Der Schaden für die Umwelt wäre enorm, sollte Bundesbern dieser Forderung nachkommen.

*Ferruccio Ferroniist diplomierter Ingenieur ETH.

Batterien

Lithium, ade!

Setzen sich Elektroautos im grossen Stil durch, gibt es ein Rohstoff- und Giftmüllproblem.

Bei Elektromobilen kommen meist Batterien auf Basis von Lithium zum Einsatz. Denn mit dem Alkalimetall kann, verglichen mit dem Gewicht, am meisten Energie gespeichert werden. Auch Lithium-Batterien erschöpfen sich aber. Nach etwa 500 Ladevorgängen muss man sie ersetzen. Ein Set Batterien für den neu auf den Markt gekommenen Tesla 3 benötigt elf Kilogramm Lithium. Ist das Fahrzeug zwölf Jahre in Betrieb und legt es dabei total 150 000 Kilometer zurück, müssen die Batterien wegen der Erschöpfung zweimal ersetzt werden. Für die Lebensdauer eines Tesla 3 sind somit 33 Kilogramm Lithium nötig.

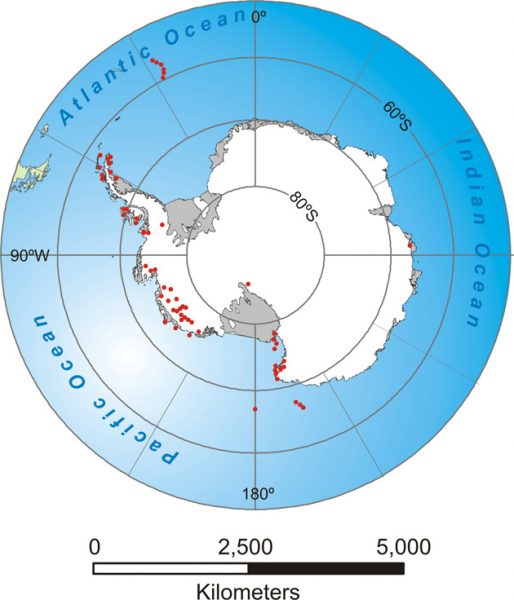

Setzt sich die Elektromobilität durch, droht ein Rohstoffproblem: Gemäss der US-Behörde Geological Survey betragen die weltweiten Lithium-Reserven 14 Millionen Tonnen. Falls davon die Hälfte für Elektrofahrzeuge verwendet wird (Batterien werden auch für andere Zwecke benötigt), reichen die Reserven selbst bei idealem Re- cycling von Lithium nur für rund 400 Millionen Elektrofahrzeuge vom Typ Tesla 3 (inkl. Batterienersatz). Derzeit kurven aber 1,2 Milliarden Autos auf den Strassen der Welt herum. Es entsteht also ein Engpass, falls mehr als ein Drittel des motorisierten Verkehrs auf Elektroantrieb umstellt. Zwar könnte man Batterien anderen Typs verwenden. Der Aufwand für deren Produktion wäre aber noch höher als bei Lithium-Batte- rien, zudem stiege das Batteriengewicht. Die Energiebilanz der Elektromobilität würde nochmals deutlich schlechter.

Tödliche Gefahren

Dazu kommt, dass Lithium hochgiftig ist. Bereits bei einer Einnahme von wenigen Milligramm pro Tag drohen tödliche Gefahren für den Menschen. Setzt sich Elektromobilität breit durch, müssten jedoch mehrere Millionen Tonnen Lithium entsorgt werden, das nicht mehr recycelt werden kann. Der Aufwand, um eine sichere Isolation vor der Umwelt zu gewährleisten, ist vergleichbar mit dem für die Entsorgung schwach- bis mittelradioaktiver Abfälle. In der Schweiz müsste man wohl die Nagra mit der Endlagerung von Lithium beauftragen. Die entsprechend hohen Kosten hätten die Elektroautofahrer zu tragen.

Ferruccio Ferroni und Alex Reichmuth

übernommen von Die Weltwoche hier

Anmerkung der Redaktion

in einem Mailwechsel mit Autor Ferroni wurde festgestellt, dass gem. John Petersen von Seeking Alpha Rohstoffspezialist u.a. für Lithium und Kobalt und Kritiker von TESLA sowie von Battery University and Avicenne Energy in einer TESLA Model 3 Batterie 93 Kg Kobalt verbaut sind,(d.h. 1.44 kg Co pro kWh Kapazität). Aus diesem Grund wird die Nachfrage nach Kobalt rasant steigen und die Schlussfolgerungen des Artikel in EIKE über die furchtbare völlig inakzeptable Lage der Kinderarbeiter darunter Kleinkinder ab 4 Jahren, die für den Abbau in Demokratischen Republik Kongo schuften müssen, evtl. nur der Anfang sind.