Wo Klimaschutzprogramme bestimmen, spielen Sinn und Geld überhaupt keine Rolle mehr

Die Berliner Stadtreinigung reinigt nun auch die Luft vom Pflanzendünger CO2

Beispiele zum Beleg gräbt in schöner Regelmäßigkeit die (Des-)Informationsseite unserer Klimaberaterin aus, allerdings – im Gegensatz zum Autor – um damit die großen Erfolge im Klimakampf zu preisen.

Klimaretter.Info: [1] Stadtreinigung will sich von CO₂ reinigen

… wollen die Berliner Stadtreinigungsbetriebe (BSR) bis 2025 weitere 67.000 Tonnen CO2 einsparen. Dazu unterzeichneten der mit rund 5.000 Beschäftigten größte kommunale Entsorger Deutschlands und der Berliner Senat am Donnerstag ihre dritte Klimaschutzvereinbarung, wie beide Partner am Donnerstag mitteilten.

In der Pressemitteilung der Stadt Berlin kann man es dann in Fakten und Zahlen nachlesen. Je mehr (Geld-)Sorgen ein Bundesland hat, um so, mehr muss es sich zur Weltrettung verpflichten. Denn das Geld der Armen ist ja ein Mehrfaches dessen der Reichen wert.

Senat Berlin, Pressemitteilung: [2] Auf freiwilliger Basis verpflichtet sich darin die BSR zum dritten Mal in Folge, die Kohlendioxidemissionen zu reduzieren. So soll durch gezielte Investitionen und Maßnahmen in verschiedenen Bereichen bis 2025 eine CO2-Entlastung von 67.000 Tonnen erreicht werden.

… Berlin will bis zum Jahr 2050 klimaneutral werden … Klimaschutzvereinbarungen mit landeseigenen Unternehmen wie der BSR setzen ein Zeichen für diese gemeinsame Anstrengung für mehr Klimaschutz in Berlin.

Für eine so wichtige Aufgabe müssen sogar Wahlversprechen hintenangestellt werden. Wer dachte, mit der Wahl von GRÜN in Berlin würde sich (Wahl-)Politik ändern, sieht sich getäuscht (dass GRÜN beim Versuch, Diäten heimlich zu erhöhen, ebenfalls sofort mit dabei ist, kann man wiederum in BW sehen [6]):

DER TAGESSPIEGEL: [3] Rot-Rot-Grün Wasser und BSR werden nicht billiger

… Nein, in diesem Jahr steigen die Gebühren der BSR für die Müllabfuhr nicht noch einmal – die Stadtreinigung hat schon erhöht im Januar. Und die Wasserbetriebe bekommen nicht noch mehr Geld – deren Tarife waren schon so hoch, dass das Bundeskartellamt einschreiten musste…. Und früher wetterten die Grünen auch gegen die hohen Gebühren. Zumal diese Haushalte mit kleinem Budget besonders hart treffen.

Man muss das verstehen. Schließlich sind 130 Millionen EUR zur CO2-Minderung auch kein Pappenstiel. Wie gut, dass man sich da wenigstens beim Geld-Ausgeben zuverlässig auf Kollegialität verlassen kann.

Stefan Tidow (Bündnis 90/Die Grünen, Politologe) erklärt: [2] „Die BSR bleibt ein verlässlicher Partner des Landes. Das gilt auch, wenn es darum geht, die ehrgeizigen klimapolitischen Ziele Berlins zu erreichen … Für BSR-Chefin Dr. Tanja Wielgoß ist Klimaschutz Teil der Strategie des Unternehmens: „Wir ruhen uns nicht auf den Erfolgen der letzten Jahre aus, sondern legen nochmal eine Schippe drauf … Dafür werden wir in den nächsten Jahren 130 Millionen Euro investieren.“

Die „Erfüllungsgehilfen“ – nein, natürlich die Fachmannschaft der unteren Ebenen, hat man dafür schon gebildet:

EIKE, 22.03.2017: Klimamönche*, alternativ: die Klimaelite unserer Behörden,

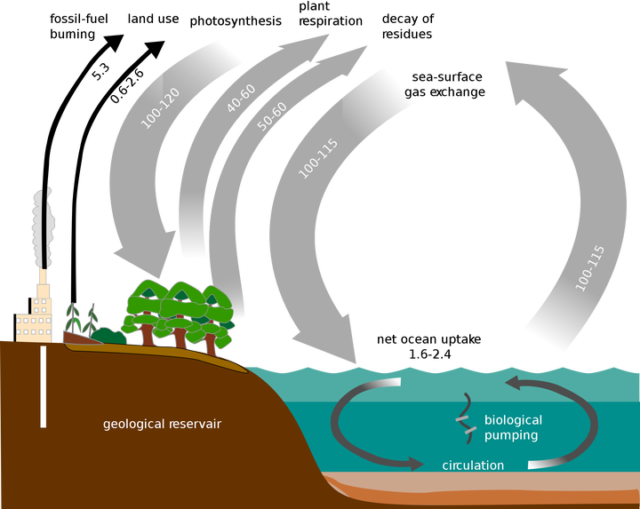

und mit diesen soll es gelingen, den neuen Treppenwitz der Geschichte, von Klimaretter freudig verkündet: Reinigen der Atmosphäre vom lebensnotwendigen Pflanzennährstoff CO2, umzusetzen. Schmutz bleibt Schmutz und der Auftrag ist Schmutz zu entfernen, Denken findet sich nicht unter der Rubrik Beauftragung.

Zum Glück gelingt dies auf diese Art nicht, aber die Kosten dafür sind trotzdem mehr als nur Peanuts.

Wieder ein grober Nutzen- / Kosten-Vergleich

Maßnahme der Berliner Stadtreinigung: 130 Millionen Euro Ausgaben zur Vermeidung von 67.000 Tonnen CO2 bis zum Jahr 2025!

Man rechne einmal kurz nach:

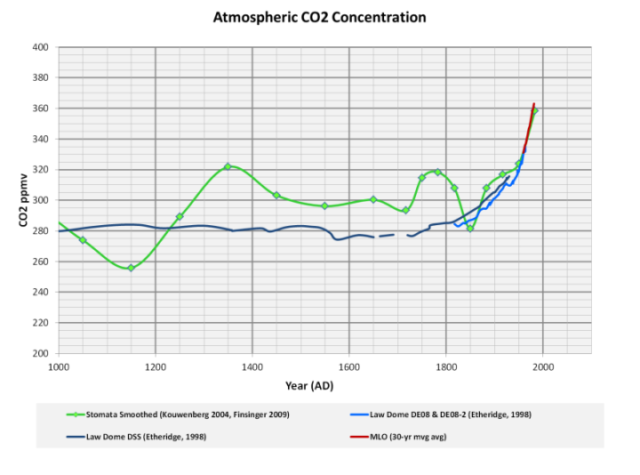

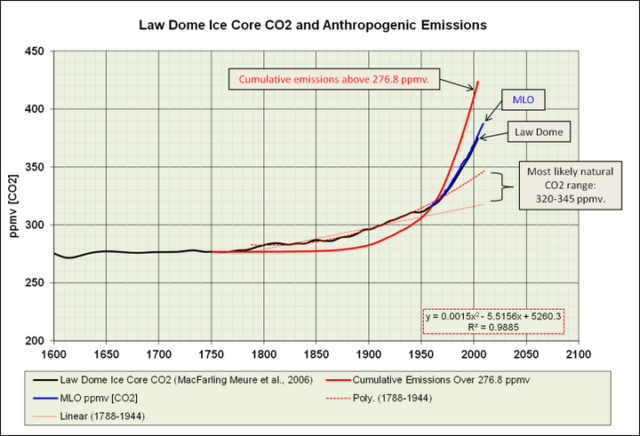

67.000 Tonnen CO2 ergeben 8,7 x 10-6 ppm CO2-Anteil in der Atmosphäre (Anmerkung: 1 ppm = 0,000001).

Pro Jahr „entgiftet“ die Berliner Stadtreinigung die Atmosphäre damit um 0,0000011 Stück CO2-Moleküle pro 1 Millionen Luftmolekülen, an denen die klimaerhitzende Strahlung nicht mehr zurückprallt und die Welt aufheizen könnte.

Die segensreiche Wirkung auf das Weltklima ist entsprechend fulminant:

Der aktuelle Wert von ca. 400 ppm CO2-Anteil in der Atmosphäre „verringert“ sich dank der BSR in den 8 Jahren auf 399,9999913 ppm; oder um ca. 0,0000011 ppm / pa.

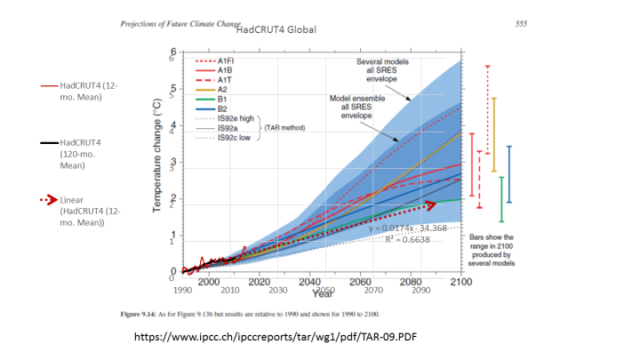

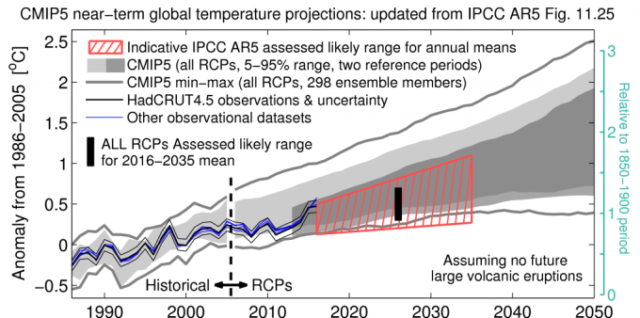

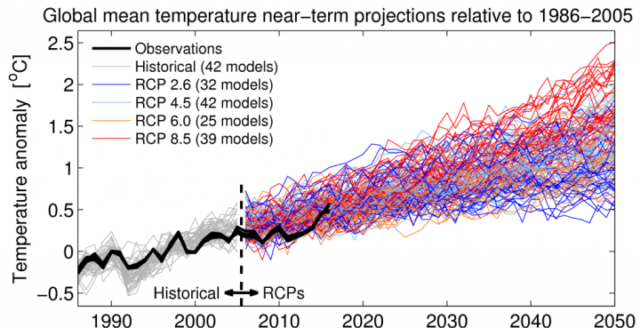

Als Nutzen ergibt sich eine (rechnerische) Temperaturverhinderung beim (zu hohen) IPCC-Forcing in den acht Jahren von:

-93 x 10-9 °C, ausgetippt ca. minus 0,0000001 °C, oder minus 0,0000000116 °C / pa, sehr wahrscheinlich davon jedoch nur ein Drittel, wenn das realistischere Forcing von 1 °C / ppm-Verdopplung angesetzt wird.

Würde die BSR diese Maßnahme konsequent bis zum Jahr 2100 weiterführen (rein hypothetisch, aber wenn man diese mit dem Jahr 2025 enden lässt, wird die Anzahl an Nullen nach dem Komma viel zu lang), würde durch die generöse Maßnahme der Berliner Stadtreinigung die Welttemperatur um ganz, ganz grob maximal:

0,0000006 °C*,

aber eher unter 0,0000002 °C* „verringert,

und das zu (fiktiven) Kosten von 10,8 Milliarden EUR.

Anm.: Hoffentlich haben sich beim Schätzen nicht irgendwo Nullen verschoben. Aber auf ein paar Nullen mehr oder weniger kommt es (sprichwörtlich) wirklich nicht an.

*Zur Abschätzung: pauschaliert die Hälfte eines Einmalimpulses dieser CO2-Menge, die in diesem Zeitraum bereits erhebliche Rückdiffusion nicht berücksichtigt.

Fester Glaube kann Berge versetzten

Diese wirklich monströsen Erfolge im Klimakampf der Stadt Berlin werden von einem ehemaligen Büroleiter der Frau C. Roth und einer geschichtspolitisch promovierten BSR-Chefin vollmundig proklamiert:

Stefan Tidow erklärt: [2] „Die BSR bleibt ein verlässlicher Partner des Landes … Das gilt auch, wenn es darum geht, die ehrgeizigen klimapolitischen Ziele Berlins zu erreichen ...

… Für BSR-Chefin Dr. Tanja Wielgoß ist Klimaschutz Teil der Strategie des Unternehmens: „Wir ruhen uns nicht auf den Erfolgen der letzten Jahre aus … Dafür werden wir in den nächsten Jahren 130 Millionen Euro investieren.“

Man erkennt überdeutlich, dass diese „Eliten“ noch nie über ihre auswendig gelernten Sprechblasen nachgedacht haben und Fake-News in Reinkultur präsentieren. Leider verhalten sich die berichtenden Redakteure ebenso, womit diesen „Führungskräften“ die Blamage einer reflektierenden Argumentation erspart bleibt.

Für einen noch nicht so schlimm denkruinierten Bürger stellt sich jedoch die Frage, ob Abwarten und Anpassung an das sich stetig verändernde Klima nicht die bei Weitem sinnvollere Variante wäre.

Solche gedanklichen Abweichungen wären allerdings für Personen, welche im politisch beeinflussten Umfeld etwas werden möchten, höchst gefährlich. Denn unsere Kanzlerin hat mit ihrer Bestätigung des „Stern-Reports“ in ihrer Rede am 5.Juli 2016 beim VII. Petersberger Klimadialog genau dieses verneint:

Fr. Merkel: … Ich will diese Mehrkosten nicht kleinreden. Aber wir wissen spätestens seit dem Stern-Report, dass sie sich langfristig – eigentlich schon mittelfristig – bezahlt machen. Wenn wir sehen, wie viele Folgen des Klimawandels wir ansonsten zu gewärtigen haben, dann wissen wir, dass sich das allemal lohnt.

Und wenn es unsere Kanzlerin so sicher weiß. Wer wagt es, dieser ausgewiesenen Fachfrau und einem von einem leibhaftigen „Sir“ geschriebenem Report ([8]: … Auftragsarbeit eines Beamten für eine Regierung mit einem politischen Programm …“) zu widersprechen? – nur jemand, der seinen sicheren, politischen Selbstmord als Planziel vorhat.

Im Achgut-Artikel [8] Unbequem ist stets genehm, ist beschrieben, wie ein Bundespräsident dieses „Problem“ eigenständigen Denkens vorbildlich gar nicht erst aufkommen lässt.

Fast freut man sich inzwischen über „ehrlichen“ Beschiss

Eine Anmerkung kann sich der Autor nicht verkneifen. Ihm sind Versorger-Vorstände wie der hoch-bezahlte der Nürnberger N-Ergie da fast schon „lieber“. Bei solchen merkt man, dass sie aus persönlichen Vorteilen (bekommt, wie ein SPD-Verantwortlicher der Stadt extra in der Zeitung betonte „bewusst“ ein so hohes Gehalt) heraus ihre Kunden und den politisch besetzten Aufsichtsrat mit ihren „Weltrettungsmaßnahmen“ einfach nur über den Tisch ziehen wollen [4] [5]. Dagegen lässt sich sachlich argumentieren.

Wenn Politologen – die modernen Theologen der Ideologien -, inzwischen scheinbar „massenhaft“ von UNIs produziert, es „vollbringen“, weiß man nie so recht, wie argumentativ dagegen anzugehen wäre. Man fragt sich immer: Glauben die das wirklich – fiele ihnen in aller Regel ja nicht schwer, da selten eine Ausbildung zum Fachgebiet vorliegt – oder machen sie es auch nur zu ihrem Vorteil? Das Ergebnis: Hohe, gut bezahlte Posten im Einflussbereich der Politik, ist allerdings das Gleiche:

BSR Vorstandsvorsitzende, Tanja Wielgoß: WIKIPEDIA Studium: Politik-, Geschichts- und Wirtschaftswissenschaften, Dissertation: „Der Parti socialiste und die Sozialdemokratische Partei Deutschlands im europäischen Integrationsprozess – 1989-1999“,

Stefan Tidow (Bündnis 90/Die Grünen, Politologe): Politikwissenschaft, Volkswirtschaftslehre und Pädagogik, ehemals Büroleiter von C. Roth und J. Trittin.

Als Trost hilft da nur: Nicht alles von dem ausgegebenen Geld ist verpuffender Öko-Weihrauch. Zumindest ein Teil des Invests hat ja auch einen praktischen Nutzen. Zudem entstehen bei den nach Gewerkschaftsmeinung sowieso viel zu „schlanken“ öffentlichen Unternehmen neue Arbeitsplätz, die vorher unbekannt waren und welcher (dafür zahlende) Bürger könnte etwas gegen Arbeitsplätze haben:

[2] … Dazu gehören BSR-Beschäftigte, die als Klimalotsen in ihren jeweiligen Organisationseinheiten für „Gutes Klima“ sorgen, indem sie die Energiesparziele der BSR mit Tipps und Kniffs vor Ort voranbringen …

EIKE, 22.03.2017: Klimamönche*, alternativ: die Klimaelite unserer Behörden

Und immer daran denken: Die Grünen fordern in jedem Bundesland ein Klimaschutzgesetz. Dann kann jedes Kind das Land zu mehr Aktivismus verklagen und wird von den entsprechenden NGOs und Interessenverbänden dazu hofiert:

Klimaretter.Info: [7] Indisches Mädchen verklagt Regierung

Richter entscheiden nach dem Gesetz und nicht nach dem Verstand. Hier gibt es wirklich einen der ominösen Kippunkte, ab dem Wahnsinn eine Eigendynamik entfalten kann, wie es aus der Geschichte bekannt ist.

Quellen

[2] Berlin, Senatsverwaltung für Umwelt. Verkehr und Klimaschutz: Pressemitteilung vom 20.04.2017 BSR will bis 2025 weitere 67.000 Tonnen CO2 einsparen

[3] DER TAGESSPIEGEL: Rot-Rot-Grün Wasser und BSR werden nicht billiger

[4] EIKE 06.02.2016: Nachgefragt: Ein lokaler Versorger bricht die Macht der Stromgiganten

[5] EIKE 30.11.2016: Ökostrom verschieben zur Lösung der EEG-Blockade Ein lokaler Versorger ist innovativ und löst das Speicherproblem – koste es was es wolle

[6] STUTTGARTER ZEITUNG: Rückkehr zur Abgeordneten-Pension Vor Jahren eine Großtat, heute nur Murks

[7] Klimaretter.Info: Indisches Mädchen verklagt Regierung

[8] Achgut.com: Unbequem ist stets genehm: Die Irrtümer des Klimawarners Joachim Gauck